در این مطلب، ویدئو شبکههای عصبی مکرر (RNN) – یادگیری عمیق با پایتون، تنسورفلو و کراس ص.7 با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

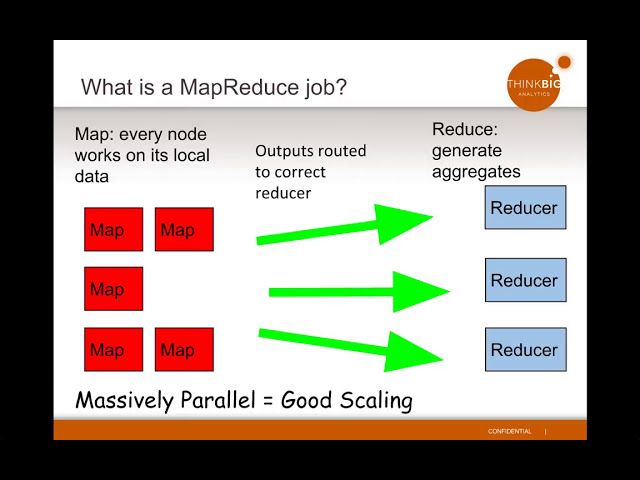

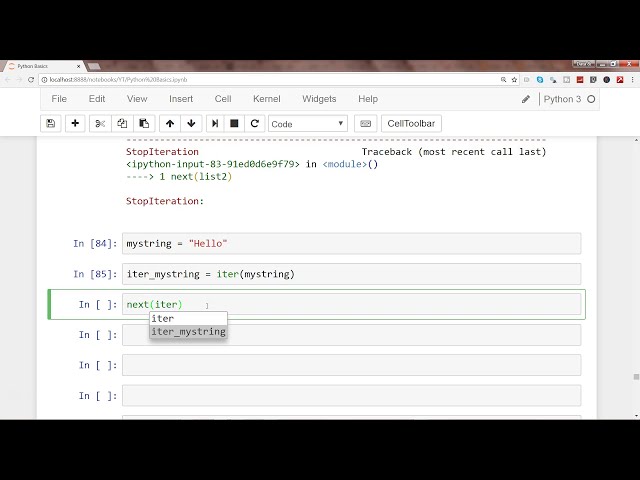

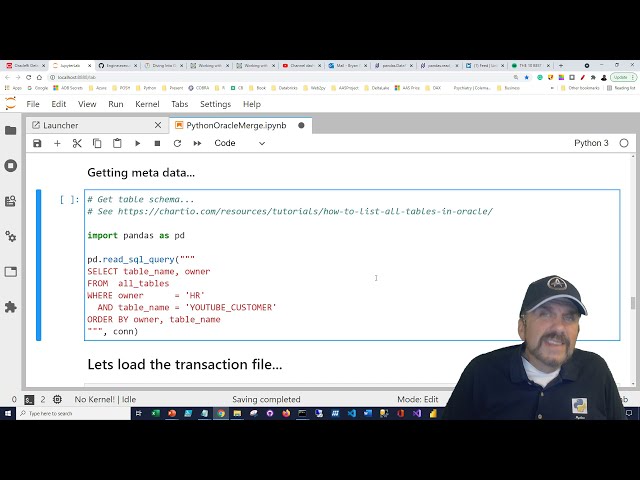

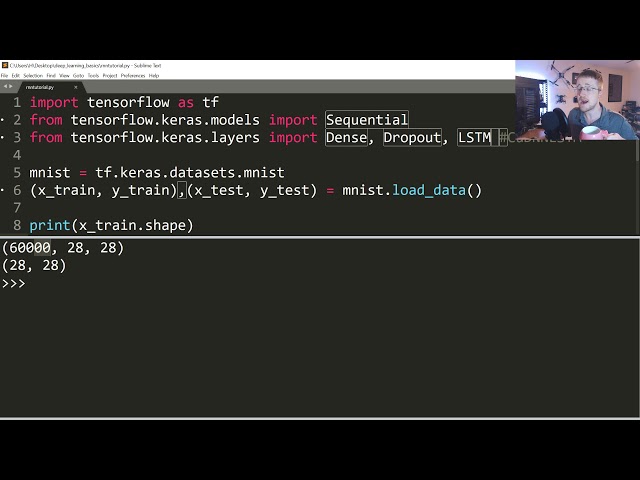

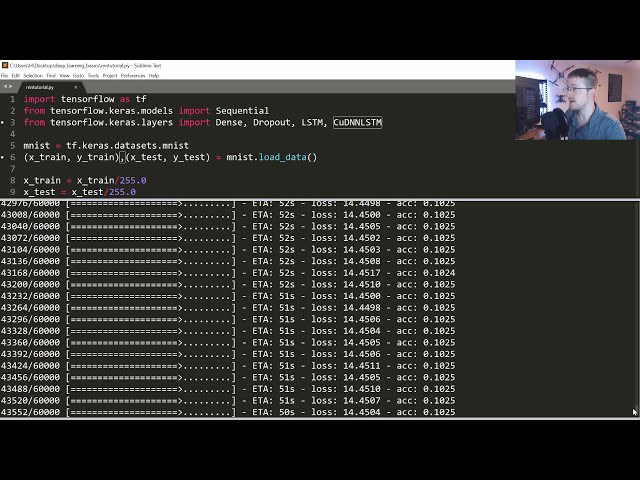

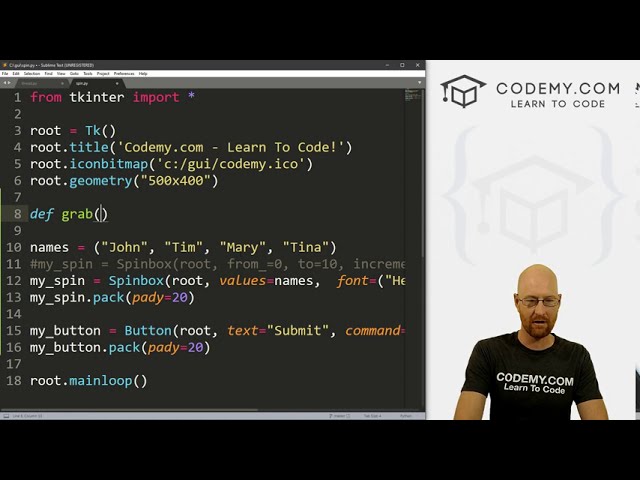

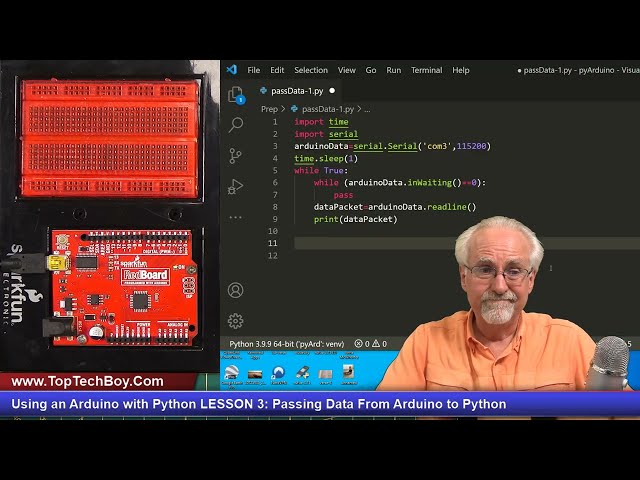

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,949 –> 00:00:02,970

چه در جریان است و

2

00:00:02,970 –> 00:00:06,089

به قسمت 7 از آموزش عمیق با

3

00:00:06,089 –> 00:00:08,519

پایتون tensorflow در سری آموزش آشوب خوش آمدید

4

00:00:08,519 –> 00:00:10,170

در این قسمت آنچه که در

5

00:00:10,170 –> 00:00:12,690

مورد آن صحبت خواهیم کرد شبکه عصبی بازگشتی

6

00:00:12,690 –> 00:00:15,630

است بنابراین ایده

7

00:00:15,630 –> 00:00:19,470

شبکه عصبی تکراری این است که ترتیب برخی از

8

00:00:19,470 –> 00:00:24,150

داده ها دارای اهمیت و اهمیت هستند،

9

00:00:24,150 –> 00:00:27,570

بنابراین دو حوزه ای که در آنها این امر

10

00:00:27,570 –> 00:00:29,550

وجود دارد، مانند داده های سری زمانی است که

11

00:00:29,550 –> 00:00:32,579

داده ها به صورت زمانی یا زمانی سازماندهی می شوند،

12

00:00:32,579 –> 00:00:35,280

در غیر این صورت ممکن است

13

00:00:35,280 –> 00:00:38,670

این موضوع در زبان طبیعی مهم باشد،

14

00:00:38,670 –> 00:00:40,230

بنابراین ترتیب چیزی در یک جمله

15

00:00:40,230 –> 00:00:41,969

حاوی یک تا آنجا

16

00:00:41,969 –> 00:00:44,460

که معنی آن جمله اهمیت زیادی دارد، به

17

00:00:44,460 –> 00:00:46,530

عنوان مثال، اگر میگویید میدانید که برخی

18

00:00:46,530 –> 00:00:51,930

افراد یک شبکه عصبی درست کردهاند، چه اتفاقی میافتد وقتی

19

00:00:51,930 –> 00:00:53,670

آن را از طریق نوعی الگوریتم پردازش زبان طبیعی تغذیه میکنید،

20

00:00:53,670 –> 00:00:57,510

بیایید بگوییم

21

00:00:57,510 –> 00:00:59,399

که فقط یک شبکه عصبی عمیق است.

22

00:00:59,399 –> 00:01:00,989

معمولاً اینطور است که ما

23

00:01:00,989 –> 00:01:03,899

دادهها را نشانهگذاری میکنیم که فقط به این

24

00:01:03,899 –> 00:01:05,729

معنی است که در این مورد میخواهیم

25

00:01:05,729 –> 00:01:08,010

آنها را بر اساس کلمات تقسیم کنیم تا هر کلمه منحصر به فرد خودش باشد.

26

00:01:08,010 –> 00:01:11,070

ویژگی ue اما مشکل یک

27

00:01:11,070 –> 00:01:12,900

شبکه عصبی عمیق این جمله است

28

00:01:12,900 –> 00:01:14,760

که همان معنی را میدانید که

29

00:01:14,760 –> 00:01:19,380

یک شبکه عصبی باعث ایجاد برخی

30

00:01:19,380 –> 00:01:22,140

افراد شده است و بدیهی است که این دو جمله

31

00:01:22,140 –> 00:01:25,890

معانی و تأثیرات بسیار متفاوتی دارند

32

00:01:25,890 –> 00:01:29,400

و همه چیز از این رو

33

00:01:29,400 –> 00:01:33,270

مهم است. در این جملات،

34

00:01:33,270 –> 00:01:34,350

بنابراین ایده یک شبکه عصبی تکراری

35

00:01:34,350 –> 00:01:36,299

است، بنابراین چگونه آنها واقعا کار می کنند و

36

00:01:36,299 –> 00:01:37,799

من چند نقاشی زیبا و زیبا

37

00:01:37,799 –> 00:01:39,780

دارم، نمی دانم چه کسی آنها را کشیده است، اما

38

00:01:39,780 –> 00:01:43,229

به هر حال آنها زیبا هستند، بنابراین

39

00:01:43,229 –> 00:01:45,360

ایده اینجا این است که بیایید بگو این

40

00:01:45,360 –> 00:01:48,329

جعبههای سبز در اینجا سلولهای مکرر هستند، بنابراین

41

00:01:48,329 –> 00:01:50,659

شما میتوانید یک سلول بازگشتی اولیه داشته باشید،

42

00:01:50,659 –> 00:01:53,220

به ندرت از این سلولها استفاده میشود،

43

00:01:53,220 –> 00:01:55,399

معمولاً مانند یک LS TM است که برای

44

00:01:55,399 –> 00:01:58,829

حافظه کوتاهمدت کوتاه است،

45

00:01:58,829 –> 00:02:01,619

گرو یا یک واحد بازگشتی دردار نیز وجود دارد، اما دوباره

46

00:02:01,619 –> 00:02:03,780

من تقریباً ببینید که

47

00:02:03,780 –> 00:02:07,020

همه از سلولهای LST M با صداقت استفاده میکنند، بنابراین نحوه

48

00:02:07,020 –> 00:02:08,399

کار اینها میدانید که

49

00:02:08,399 –> 00:02:10,709

دادههای متوالی خود را در اینجا دریافت کردهاید و

50

00:02:10,709 –> 00:02:13,470

دادههای متوالی به عنوان مثال به یکی از

51

00:02:13,470 –> 00:02:13,950

این و آنها منتقل میشوند.

52

00:02:13,950 –> 00:02:16,980

en سلول این کار را انجام می دهد – دو خروجی می دهد

53

00:02:16,980 –> 00:02:19,380

– دو مکان یکی را به لایه بعدی خروجی می دهد

54

00:02:19,380 –> 00:02:22,620

اما – و لایه بعدی

55

00:02:22,620 –> 00:02:25,380

می تواند لایه بعدی باشد که می دانید می تواند

56

00:02:25,380 –> 00:02:27,840

ورودی لایه تکراری بعدی باشد

57

00:02:27,840 –> 00:02:29,489

یا می تواند لایه خروجی یا یک لایه باشد.

58

00:02:29,489 –> 00:02:30,750

لایه متراکم چه کسی

59

00:02:30,750 –> 00:02:33,209

میداند اما به هر حال هر سلول در

60

00:02:33,209 –> 00:02:37,170

جایی به لایه دیگر خروجی میدهد، بلکه

61

00:02:37,170 –> 00:02:43,560

به گره بعدی در لایه تکراری خاص،

62

00:02:43,560 –> 00:02:45,989

حالا این خروجیها کجا هستند

63

00:02:45,989 –> 00:02:49,350

– لزوماً لازم

64

00:02:49,350 –> 00:02:53,580

نیست – چیز بعدی پایین است و سپس

65

00:02:53,580 –> 00:02:55,560

همچنین لازم نیست فقط در یک

66

00:02:55,560 –> 00:02:56,930

جهت حرکت کند، میتوانید

67

00:02:56,930 –> 00:02:59,640

برای مثال لایههای تکرارشونده دو طرفه داشته باشید و میتوانید

68

00:02:59,640 –> 00:03:01,860

69

00:03:01,860 –> 00:03:03,690

با ترتیب چیزها و مکانهایی که دادهها منتقل میشوند و

70

00:03:03,690 –> 00:03:05,670

چیزهای دیگر واقعا دیوانه شوید، اما به طور کلی این یک کار فوقالعاده

71

00:03:05,670 –> 00:03:09,450

اساسی است. یکی پس یک راه دیگر برای نگاه کردن به آن

72

00:03:09,450 –> 00:03:11,790

این است که این یک سلول است و بنابراین بیایید

73

00:03:11,790 –> 00:03:13,319

بگوییم که شما اساساً دارید، بگذارید بگوییم

74

00:03:13,319 –> 00:03:15,360

این مانند سلول دوم در لایه است، بنابراین

75

00:03:15,360 –> 00:03:16,530

فرض کنید که ما در اینجا به

76

00:03:16,530 –> 00:03:19,799

این سلول نگاه می کنیم بنابراین این جعبه

77

00:03:19,799 –> 00:03:23,730

سبز این سلول است o اصولاً

78

00:03:23,730 –> 00:03:25,560

برخی از دادهها از

79

00:03:25,560 –> 00:03:27,600

سلول قبلی آمده است، در اینجا پیچیده شده است،

80

00:03:27,600 –> 00:03:30,600

در حال ورود است و سلول lsdm

81

00:03:30,600 –> 00:03:33,209

که در اینجا به آن نگاه میکنیم، خوب انتخاب میکند که چه چیزی را

82

00:03:33,209 –> 00:03:36,540

میخواهیم از گره قبلی فراموش کنیم،

83

00:03:36,540 –> 00:03:39,540

سپس دادههای ورودی وجود دارد که بر اساس اوکی وارد میشوند.

84

00:03:39,540 –> 00:03:41,100

در این داده ورودی، چه چیزی را میخواهیم

85

00:03:41,100 –> 00:03:43,500

به این بسته اطلاعاتی که داریم اضافه

86

00:03:43,500 –> 00:03:46,769

کنیم و سپس در نهایت خوب، بر اساس

87

00:03:46,769 –> 00:03:48,239

این اطلاعات بسته، چه چیزی را میخواهیم

88

00:03:48,239 –> 00:03:51,450

به لایه بعدی و

89

00:03:51,450 –> 00:03:54,690

گره بعدی که میخواهیم خروجی دهیم، خروجی کنیم. به طوری

90

00:03:54,690 –> 00:03:57,269

که این وظیفه سلول LST M

91

00:03:57,269 –> 00:03:59,430

است که اکنون واضح است که بسیار پیچیده است،

92

00:03:59,430 –> 00:04:01,290

به خصوص زمانی که می دانید همه این

93

00:04:01,290 –> 00:04:02,609

چیزها مانند کل نکته این است که

94

00:04:02,609 –> 00:04:05,519

در نهایت فقط مانند یک مقدار اسکالر منتقل

95

00:04:05,519 –> 00:04:09,510

شوند، بنابراین

96

00:04:09,510 –> 00:04:11,760

اگر می خواهید یاد بگیرید چگونه این چیزهای بسیار چالش برانگیز را انجام دهیم.

97

00:04:11,760 –> 00:04:14,670

اطلاعات بیشتر در مورد نحوه عملکرد سلول های LST M به

98

00:04:14,670 –> 00:04:17,070

طور خاص،

99

00:04:17,070 –> 00:04:19,738

در سلول LST M که من به

100

00:04:19,738 –> 00:04:20,910

آن در نسخه مبتنی بر متن

101

00:04:20,910 –> 00:04:22,260

آموزش پیوند داده ام، یک جاودانه عالی وجود دارد، بنابراین اگر می خواهید حتماً آن را بررسی

102

00:04:22,260 –> 00:04:25,590

کنید، در غیر این صورت اجازه دهید وارد

103

00:04:25,590 –> 00:04:27,810

نوشتن شویم.

104

00:04:27,810 –> 00:04:29,160

شبکه عصبی فعلی خود شما هستید، بنابراین کاری که

105

00:04:29,160 –> 00:04:30,389

ما در این ویدیو انجام می دهیم این است که یک کار

106

00:04:30,389 –> 00:04:32,160

بسیار ساده انجام دهیم تا بتوانیم به این

107

00:04:32,160 –> 00:04:35,940

فکر کنیم که خود یک

108

00:04:35,940 –> 00:04:38,870

شبکه عصبی تکراری چقدر آسان است، اما

109

00:04:38,870 –> 00:04:40,710

آنها واقعاً قسمت سخت هستند. با

110

00:04:40,710 –> 00:04:42,870

شبکههای عصبی مکرر،

111

00:04:42,870 –> 00:04:45,360

مجموعه دادههای شما به گونهای ساختار مییابد،

112

00:04:45,360 –> 00:04:46,860

زیرا نوع دادهای که

113

00:04:46,860 –> 00:04:49,500

قرار است استفاده کنید معمولاً

114

00:04:49,500 –> 00:04:52,470

اهدافی ندارد، فقط سریهای

115

00:04:52,470 –> 00:04:54,720

زمانی است، فقط یک نوع داده غیررسمی است و ما

116

00:04:54,720 –> 00:04:56,400

نداریم. واقعاً آیا میدانید

117

00:04:56,400 –> 00:04:57,780

ما واقعاً میخواهیم به این موضوع اشاره کنیم،

118

00:04:57,780 –> 00:04:59,130

بنابراین معمولاً

119

00:04:59,130 –> 00:05:00,229

120

00:05:00,229 –> 00:05:03,270

وقتی با شبکههای عصبی مکرر کار میکنید، مقدار زیادی پیش پردازش درگیر میشود،

121

00:05:03,270 –> 00:05:04,440

بنابراین کاری که ما در

122

00:05:04,440 –> 00:05:07,020

اینجا انجام میدهیم این است که فقط از یک مثال ساده M Nest استفاده

123

00:05:07,020 –> 00:05:08,880

کنیم. در آموزش بعدی یک

124

00:05:08,880 –> 00:05:10,979

مثال واقعی با برخی از داده های سری زمانی به

125

00:05:10,979 –> 00:05:13,320

طور خاص با قیمت ارزهای رمزنگاری شده انجام

126

00:05:13,320 –> 00:05:18,930

می دهیم، بنابراین بله، به هر حال من این را به حداقل می رسانم

127

00:05:18,930 –> 00:05:21,630

و بیایید با برخی واردات شروع کنیم،

128

00:05:21,630 –> 00:05:26,550

بنابراین

129

00:05:26,550 –> 00:05:29,010

اگر تانسور من همیشه این کار را با من انجام می دهد، جریان تانسور را وارد کنید. flow اصلاح TF است

130

00:05:29,010 –> 00:05:33,090

که پس از آن از

131

00:05:33,090 –> 00:05:36,630

مدلهای Karros تانسور جریان تانسور میرویم،

132

00:05:36,630 –> 00:05:39,390

میخواهیم نوع متوالی

133

00:05:39,390 –> 00:05:43,650

مدل را از لایههای تانسور جریان کاراس نقطه نقطه

134

00:05:43,650 –> 00:05:46,560

وارد کنیم، لایه متراکم یک را وارد میکنیم

135

00:05:46,560 –> 00:05:48,300

زیرا لایه خروجی

136

00:05:48,300 –> 00:05:50,940

خود باید یک لایه متراکم باشد، اما

137

00:05:50,940 –> 00:05:52,860

همچنین ما میخواهیم با لایهای دیگر به پایان برسانیم، مانند

138

00:05:52,860 –> 00:05:54,870

یک لایه واقعی، شما میدانید یک لایه متراکم

139

00:05:54,870 –> 00:05:57,630

قبل از لایه خروجی که یک

140

00:05:57,630 –> 00:06:00,270

عملیات بسیار معمول است انجام میشود و سپس

141

00:06:00,270 –> 00:06:02,340

مقداری از آن حذف میشویم تا چیزی

142

00:06:02,340 –> 00:06:04,710

بیش از حد وزن نشود. و سلول LST M

143

00:06:04,710 –> 00:06:07,169

در اینجا نظر خواهم داد اگر

144

00:06:07,169 –> 00:06:10,289

از نسخه GPU تنسورفلو استفاده می

145

00:06:10,289 –> 00:06:14,190

کنید، سلول KU d NN l STM را بررسی کنید، بنابراین حتی

146

00:06:14,190 –> 00:06:15,870

اگر از نسخه GPU

147

00:06:15,870 –> 00:06:17,880

تنسورفلو استفاده می کنید، این سلول l esteem

148

00:06:17,880 –> 00:06:21,930

واقعاً روی GPU شما اجرا می شود. سلول STM KU d n NL

149

00:06:21,930 –> 00:06:24,180

حتی بهینهتر است

150

00:06:24,180 –> 00:06:28,169

و من پنج برابر سریعتر است، حتی

151

00:06:28,169 –> 00:06:30,570

اگر هر دو روی پردازنده گرافیکی شما اجرا شوند، اگر

152

00:06:30,570 –> 00:06:32,669

از نسخه cpu tensorflow استفاده میکنید،

153

00:06:32,669 –> 00:06:34,800

میدانید که میخواهید این آموزش را مانند

154

00:06:34,800 –> 00:06:36,510

این مدل انجام دهید. تا پنج

155

00:06:36,510 –> 00:06:38,220

ساعت طول بکشد باران یا چیزی در

156

00:06:38,220 –> 00:06:42,420

هر صورت مشکلی نیست، بنابراین اینها

157

00:06:42,420 –> 00:06:44,700

چیزهایی هستند که ما به آن نیاز داریم و اکنون ما به

158

00:06:44,700 –> 00:06:46,080

مجموعه داده نیاز داریم، بنابراین میخواهیم آن را

159

00:06:46,080 –> 00:06:48,450

سریعاً NIST

160

00:06:48,450 –> 00:06:51,870

بگیریم، بنابراین Ms برابر است با عفو مجموعه دادههای TF karosta و سپس میتوانیم

161

00:06:51,870 –> 00:06:53,430

فقط به آن را باز کنید تا

162

00:06:53,430 –> 00:06:56,150

فقط این دو تاپل باشد و سپس

163

00:06:56,150 –> 00:07:01,950

باران سفید شدید باشد، سپس تست X تست Y است

164

00:07:01,950 –> 00:07:06,270

و این دادههای زیرخط بارگذاری نقطهای M است،

165

00:07:06,270 –> 00:07:09,090

بنابراین باز هم

166

00:07:09,090 –> 00:07:11,580

بابت استفاده از لانههای M عذرخواهی میکنم، اما فکر میکنم

167

00:07:11,580 –> 00:07:14,040

بهتر است این کار را انجام دهید تا این یکی ساده باشد.

168

00:07:14,040 –> 00:07:16,020

ممکن است و سپس در قسمت بعدی

169

00:07:16,020 –> 00:07:18,060

ما دریافت می کنیم زیرا صادقانه بگویم که این

170

00:07:18,060 –> 00:07:19,710

کار ما را می گیرد، احتمالاً شبیه این است که قسمت

171

00:07:19,710 –> 00:07:21,240

بعدی احتمالاً ما را دو سه

172

00:07:21,240 –> 00:07:24,480

یا حتی چهار قسمت خواهد برد فقط برای اینکه به حالت عادی برسیم،

173

00:07:24,480 –> 00:07:26,310

اکنون آن را از طریق شبکه عصبی تغذیه می کنیم

174

00:07:26,310 –> 00:07:28,650

و این بخش آسان است واقعا

175

00:07:28,650 –> 00:07:30,870

تغذیه آن خیلی سخت نیست،

176

00:07:30,870 –> 00:07:33,450

بنابراین به عنوان مثال اجازه دهید یک

177

00:07:33,450 –> 00:07:38,640

شکل قطار X را چاپ کنیم و سپس

178

00:07:38,640 –> 00:07:43,140

باید بتوانیم این کار را از بالا استنتاج کنیم،

179

00:07:43,140 –> 00:07:46,380

اما X train و اجازه دهید فقط

180

00:07:46,380 –> 00:07:49,470

اولین نمونه شکل نقطه را بدست آوریم. بنابراین ما می فهمیم

181

00:07:49,470 –> 00:07:51,960

که چیست ما در اینجا با آن سروکار

182

00:07:51,960 –> 00:07:54,479

داریم، بنابراین میتوانیم ببینیم که 60000 نمونه از

183

00:07:54,479 –> 00:07:58,950

تصاویر 28 در 28 داریم و البته

184

00:07:58,950 –> 00:08:02,610

عنصر صفر فقط 28 در 28 است، بنابراین

185

00:08:02,610 –> 00:08:06,540

یک دقیقه مکث کنید و در مورد خوب فکر کنید، بنابراین

186

00:08:06,540 –> 00:08:08,910

این دادههای آموزشی ما است و

187

00:08:08,910 –> 00:08:10,860

در حال حاضر در توالی برای ما درست است و

188

00:08:10,860 –> 00:08:12,810

دنباله ها چه هستند خوب در

189

00:08:12,810 –> 00:08:15,900

توالی هایی مانند این 28 در 28

190

00:08:15,900 –> 00:08:21,660

چاه 28 ردیف آن 28 پیکسل در هر ردیف است، بنابراین

191

00:08:21,660 –> 00:08:24,930

می توانیم در تئوری بگوییم هر

192

00:08:24,930 –> 00:08:27,240

ردیف بخشی از یک دنباله است و اگر شما بودید برای

193

00:08:27,240 –> 00:08:29,400

گرفتن ردیف اول و سپس یک نوع اسکن

194

00:08:29,400 –> 00:08:31,770

به سمت پایین، می توانید بفهمید که

195

00:08:31,770 –> 00:08:35,640

احتمالاً چه عددی است، بنابراین امید این است

196

00:08:35,640 –> 00:08:36,960

که یک شبکه عصبی تکراری

197

00:08:36,960 –> 00:08:40,580

واقعاً بتواند این کار را انجام دهد و شاید حتی بیشتر از آن

198

00:08:40,580 –> 00:08:43,169

باید ببینیم که به طور قابل قبولی می تواند

199

00:08:43,169 –> 00:08:44,970

این کار را انجام دهد. بهتر از یک شبکه عصبی عمیق است،

200

00:08:44,970 –> 00:08:48,900

اما میبینیم که مهمتر این

201

00:08:48,900 –> 00:08:50,339

است که به هر حال شبکه تکراری را نشان دهیم،

202

00:08:50,339 –> 00:08:53,339

اما بله، این دنباله

203

00:08:53,339 –> 00:08:57,330

است، دنبالهای از ردیفهایی از پیکسلهایی

204

00:08:57,330 –> 00:08:59,160

است که قرار است

205

00:08:59,160 –> 00:09:00,990

از طریق این شبکه عصبی تغذیه کنیم. بنابراین اکنون می

206

00:09:00,990 –> 00:09:02,640

خواهیم th را بسازیم خود مدل واقعی است، بنابراین

207

00:09:02,640 –> 00:09:04,339

ما میخواهیم بگوییم مدل برابر است، من

208

00:09:04,339 –> 00:09:07,770

به ما فضایی را در اینجا میدهم که مدل برابر است و

209

00:09:07,770 –> 00:09:09,240

فقط آن مدل متوالی خواهد بود،

210

00:09:09,240 –> 00:09:11,040

حالا ما آن تبلیغ را مدلسازی

211

00:09:11,040 –> 00:09:14,060

میکنیم و میخواهیم آن را اضافه کنیم. یک LST M بنابراین

212

00:09:14,060 –> 00:09:17,520

چند سلول در لایه تیم الیس وجود دارد درست است

213

00:09:17,520 –> 00:09:20,100

که می خواهیم چند سلول داشته باشیم، در حال حاضر

214

00:09:20,100 –> 00:09:22,620

فقط از 128 استفاده

215

00:09:22,620 –> 00:09:26,160

می کنیم، شکل ورودی را مشخص می کنیم و

216

00:09:26,160 –> 00:09:28,970

این 28 در 28 است، ما قبلاً می دانیم که

217

00:09:28,970 –> 00:09:31,650

اما میتوانیم با

218

00:09:31,650 –> 00:09:39,510

انجام دادن شکل نقطه X قطار و سپس 1: این را تا حدودی پویا

219

00:09:39,510 –> 00:09:42,000

کنیم، بنابراین میتوانیم یک تابع فعالسازی را پاس

220

00:09:42,000 –> 00:09:45,420

کنیم و از دوست خوب خود از خطی اصلاحشده استفاده میکنیم

221

00:09:45,420 –> 00:09:50,670

و مجدداً ku ku D

222

00:09:50,670 –> 00:09:52,770

anomalous TM I’m not این کار را انجام

223

00:09:52,770 –> 00:09:54,540

میدهم، اما احتمالاً قبل

224

00:09:54,540 –> 00:09:56,459

از اجرای آن، آن را تغییر خواهم داد، زیرا واقعاً

225

00:09:56,459 –> 00:09:59,190

سریع است، اما در حال حاضر فقط آن را نگه میداریم.

226

00:09:59,190 –> 00:10:01,110

227

00:10:01,110 –> 00:10:04,680

228

00:10:04,680 –> 00:10:06,839

کاری که میخواهیم انجام دهیم یک پارامتر دیگر است

229

00:10:06,839 –> 00:10:10,110

که دنبالههای زیرخط بازگشت است و

230

00:10:10,110 –> 00:10:12,209

این درست خواهد بود، آیا ما

231

00:10:12,209 –> 00:10:16,140

این را میخواهیم لایه برای برگرداندن دنباله هایی مانند

232

00:10:16,140 –> 00:10:18,810

ورودی بود مانند دنباله هایی که ورودی هستند یا

233

00:10:18,810 –> 00:10:21,050

آیا می خواهیم این لایه

234

00:10:21,050 –> 0

![فیلم آموزشی: آشنایی با دکوراتورها [آموزش پایتون] با زیرنویس فارسی](http://pezhvak24.ir/dl/learn/wp-content/uploads/upyt/nVdF7QT-Gggimage2.jpg)