در این مطلب، ویدئو آموزش Python Scrapy – 13 – ذخیره سازی در JSON، XML و CSV با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:03:31

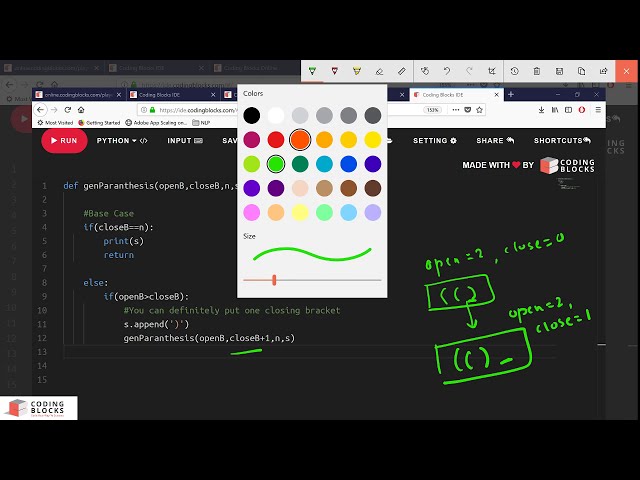

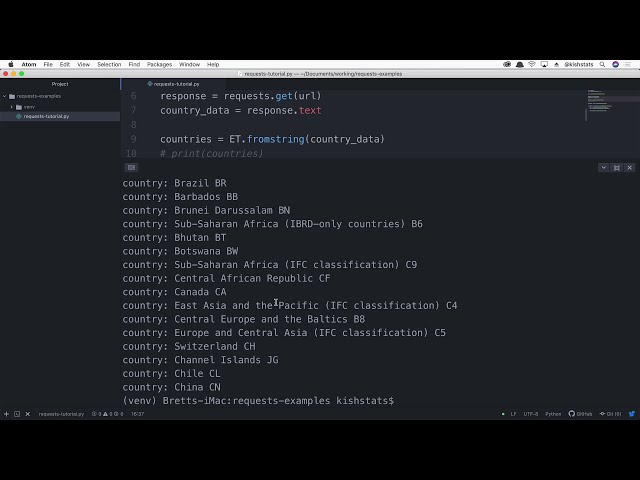

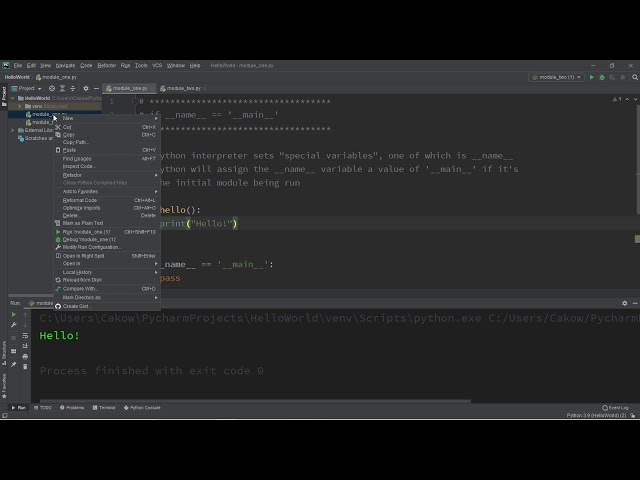

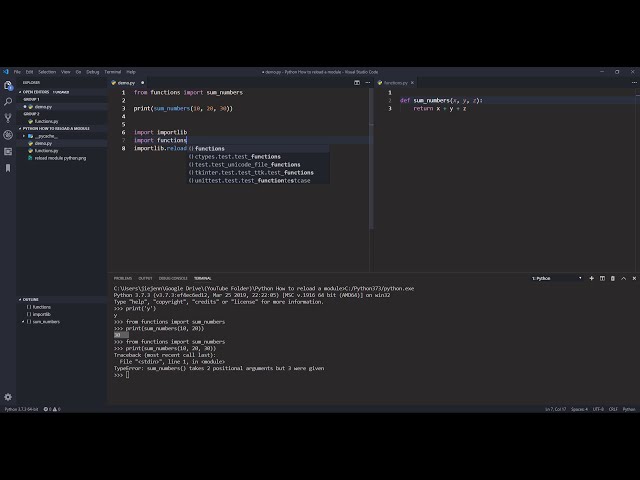

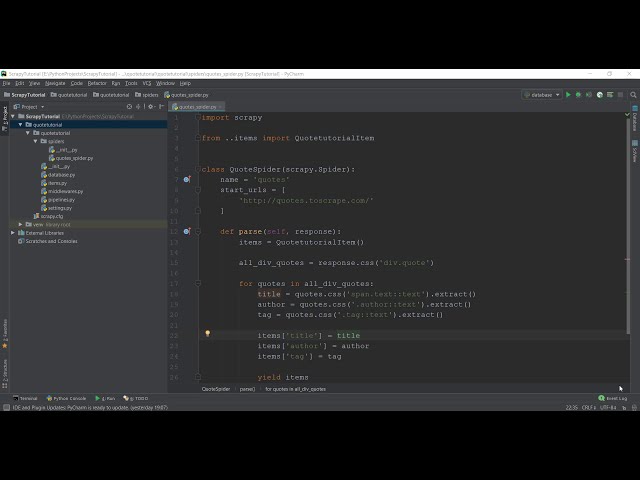

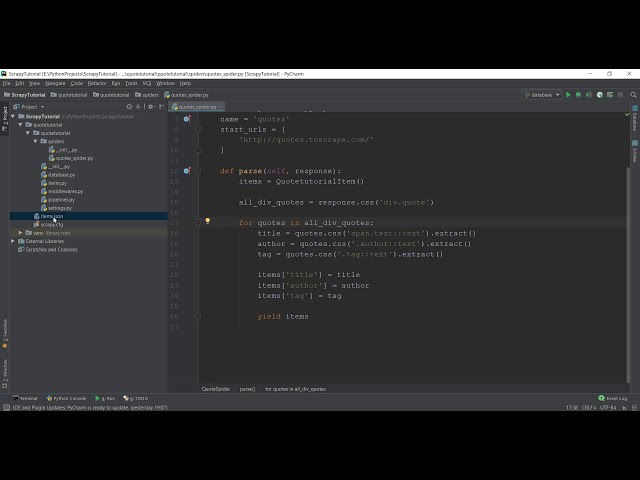

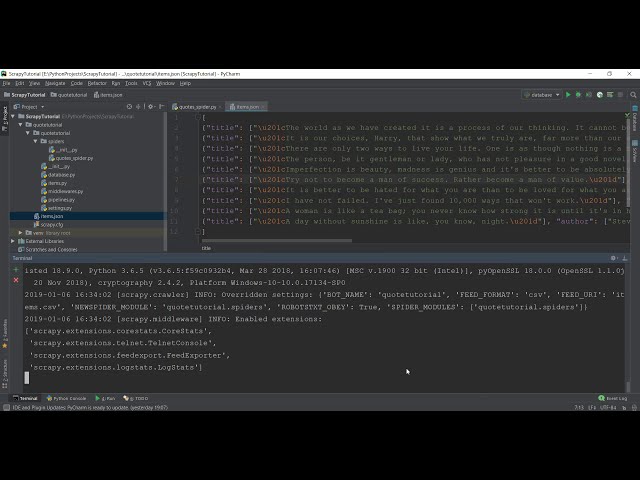

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,060 –> 00:00:01,800

بنابراین در آخرین ویدیو در مورد

2

00:00:01,800 –> 00:00:04,350

ظروف اقلام یاد گرفتیم و اکنون که با

3

00:00:04,350 –> 00:00:06,390

موفقیت داده ها را از

4

00:00:06,390 –> 00:00:08,700

وب سایت دادگاه پاکسازی کرده و آنها را در این

5

00:00:08,700 –> 00:00:10,769

ظروف موقت ذخیره کرده ایم، در نهایت می توانیم

6

00:00:10,769 –> 00:00:13,320

به مرحله بعدی برویم و یاد بگیریم که چگونه

7

00:00:13,320 –> 00:00:15,690

آن داده های ضایعات را در نوعی ذخیره کنیم.

8

00:00:15,690 –> 00:00:18,180

پایگاه داده یا یک سیستم فایل، بنابراین در این

9

00:00:18,180 –> 00:00:19,470

ویدیو در نهایت قصد داریم

10

00:00:19,470 –> 00:00:21,630

یاد بگیریم که چگونه این

11

00:00:21,630 –> 00:00:25,470

داده های استخراج شده را در یک فایل CSV فایل JSON یا یک

12

00:00:25,470 –> 00:00:27,539

فایل XML ذخیره کنیم، بدیهی است که در ویدیوهای آینده

13

00:00:27,539 –> 00:00:28,830

نحوه ذخیره

14

00:00:28,830 –> 00:00:31,769

این داده ها در SQLite را یاد خواهیم گرفت. پایگاه داده های SQLite Momoa DB من

15

00:00:31,769 –> 00:00:33,899

اما برای این ویدیو ما

16

00:00:33,899 –> 00:00:35,280

می خواهیم یاد بگیریم که چگونه آنها را

17

00:00:35,280 –> 00:00:36,300

در این فایل ها ذخیره

18

00:00:36,300 –> 00:00:38,850

کنیم، به عنوان مثال، فایل های JSON فایل های CSV و

19

00:00:38,850 –> 00:00:39,899

فایل های XML،

20

00:00:39,899 –> 00:00:41,730

بنابراین بدون اتلاف وقت بیشتر، بیایید

21

00:00:41,730 –> 00:00:44,160

اکنون آنها را

22

00:00:44,160 –> 00:00:46,770

در داخل این فایل ها ذخیره کنیم. JSON XML و

23

00:00:46,770 –> 00:00:49,020

CSV بسیار آسان است زیرا scrappy

24

00:00:49,020 –> 00:00:51,149

تمام کارهای سنگین را برای شما در پشت

25

00:00:51,149 –> 00:00:53,219

صحنه انجام می دهد، کاری که باید انجام دهید این است که فقط

26

00:00:53,219 –> 00:00:55,469

ترمینال خود را باز کنید و به داخل پوشه پروژه خود

27

00:00:55,469 –> 00:00:57,420

بروید، بیایید به داخل پروژه خود برویم.

28

00:00:57,420 –> 00:01:00,090

پوشه و در داخل پوشه پروژه

29

00:01:00,090 –> 00:01:01,770

فقط باید دستوری به آن بدهیم که

30

00:01:01,770 –> 00:01:04,470

به crappy می گوید داده های ضایعات را

31

00:01:04,470 –> 00:01:07,049

در یک نوع فایل ذخیره کند، پس چگونه

32

00:01:07,049 –> 00:01:09,650

وب سایت خود را حذف کنیم، به درستی scrappy

33

00:01:09,650 –> 00:01:12,420

crawl می کنیم و سپس نام

34

00:01:12,420 –> 00:01:14,430

خزنده را می نویسیم که ما داریم یا نام

35

00:01:14,430 –> 00:01:16,380

عنکبوت را که در حال حاضر داریم نقل قول هایش را داریم

36

00:01:16,380 –> 00:01:19,470

و سپس به اسکرپی می گوییم که هی ما

37

00:01:19,470 –> 00:01:22,710

خروجی را می خواهیم که این باشد – آه

38

00:01:22,710 –> 00:01:25,080

فایل sone انرژی خروجی و من فقط می

39

00:01:25,080 –> 00:01:27,390

خواهم نام آن را آیتم های نقطه JSON شما بگذارم.

40

00:01:27,390 –> 00:01:29,250

فقط می توانید آن را هر چه می خواهید نام گذاری کنید، اما اگر

41

00:01:29,250 –> 00:01:31,200

یک فایل JSON می خواهید مطمئن شوید

42

00:01:31,200 –> 00:01:34,079

که پسوند نقطه ای JSON را بعد از آن دارید و

43

00:01:34,079 –> 00:01:36,420

به طور مشابه اگر یک فایل XML یا CSV

44

00:01:36,420 –> 00:01:39,299

می خواهید، می توانید موارد را بنویسید dot JSON، اجازه دهید در

45

00:01:39,299 –> 00:01:41,520

واقع این را اجرا کنیم و ببینیم چگونه است. به نظر می

46

00:01:41,520 –> 00:01:43,860

رسد اکنون اگر ما خاموش شویم، می توانید

47