در این مطلب، ویدئو یادگیری عمیق برای توسعه دهندگان پایتون: کار با MxNet و Gluon | packtpub.com با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:06:30

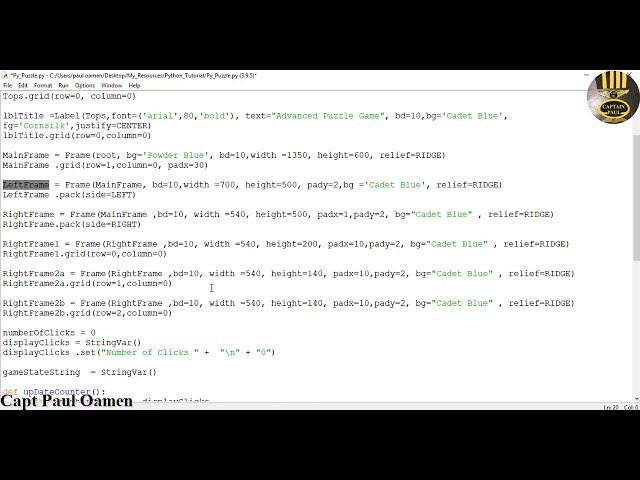

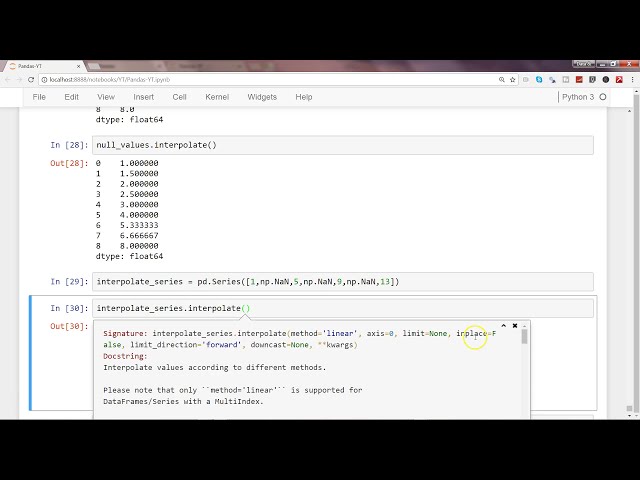

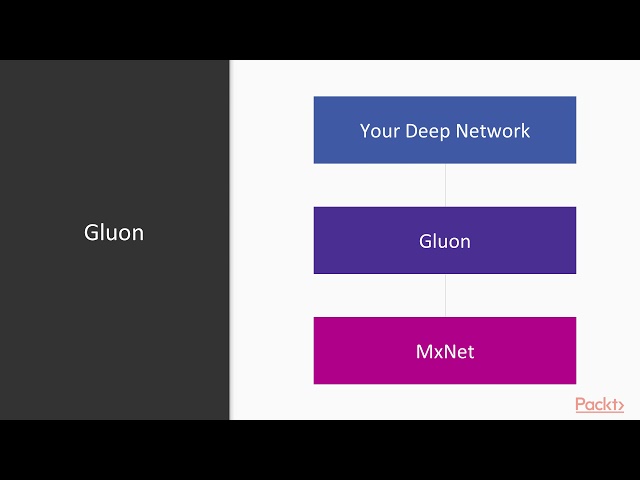

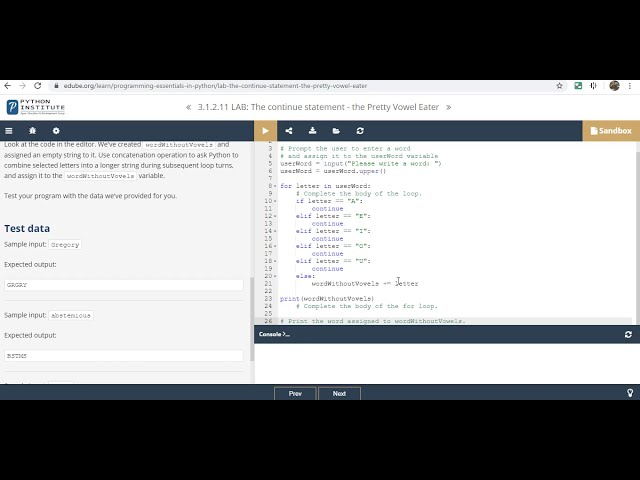

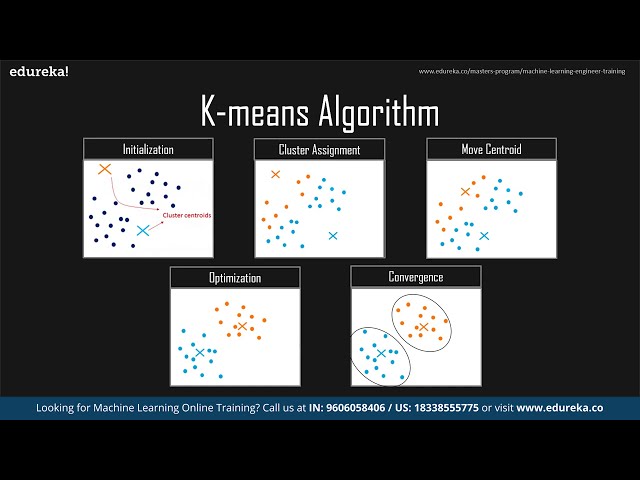

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:08,380 –> 00:00:10,120

در این بخش قصد داریم

2

00:00:10,120 –> 00:00:12,220

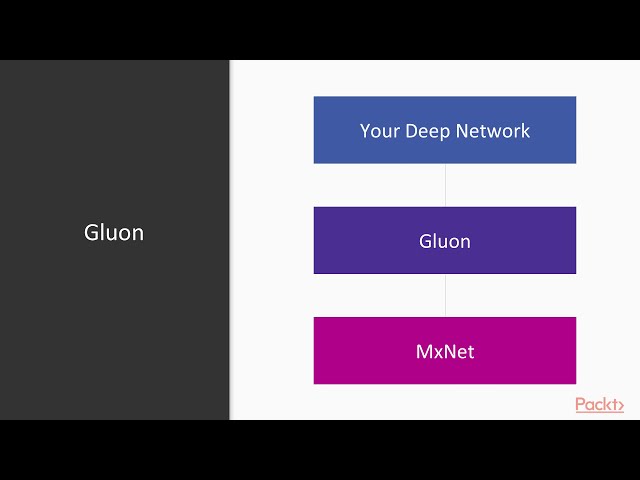

نگاهی به مدلهای عمیق با MX net و

3

00:00:12,220 –> 00:00:12,850

tensorflow

4

00:00:12,850 –> 00:00:15,040

دو فریمورک مختلف بیندازیم تا

5

00:00:15,040 –> 00:00:17,230

مدلهای یادگیری عمیق بسازیم،

6

00:00:17,230 –> 00:00:19,450

کار با MX net و gluon را بررسی خواهیم کرد که یک

7

00:00:19,450 –> 00:00:21,450

فریمورک سطح بالاتر در بالای آن است.

8

00:00:21,450 –> 00:00:23,650

تعریف و آموزش شبکه های عصبی

9

00:00:23,650 –> 00:00:25,779

MX در شبکه MX و گلوئون و سپس کار با

10

00:00:25,779 –> 00:00:27,550

جریان تانسور و کاریس که کریس یک

11

00:00:27,550 –> 00:00:28,119

12

00:00:28,119 –> 00:00:30,520

شبکه سطح بالاتر در بالای حصار یا جریان است و سپس

13

00:00:30,520 –> 00:00:32,049

تعریف و آموزش شبکه های عصبی و

14

00:00:32,049 –> 00:00:34,180

جریان فشرده caris در نهایت ما با هم

15

00:00:34,180 –> 00:00:36,430

مقایسه می کنیم. این دو فریمورک و استفاده از آنچه

16

00:00:36,430 –> 00:00:38,290

که آموخته ایم برای ساختن یک پروژه کوچک

17

00:00:38,290 –> 00:00:40,600

آموزش شبکه آلوکس نت و شبکه سایفر

18

00:00:40,600 –> 00:00:42,610

به منظور مقایسه این دو فریمورک،

19

00:00:42,610 –> 00:00:44,980

اما در مورد مجموعه ای از مشکلات کلاسیک با

20

00:00:44,980 –> 00:00:47,440

تشخیص تصویر، اکنون در این ویدیوی خاص به بررسی

21

00:00:47,440 –> 00:00:48,850

خواهیم پرداخت. در کار با

22

00:00:48,850 –> 00:00:51,760

MX net و gluon ابتدا با نگاه کردن به

23

00:00:51,760 –> 00:00:53,770

اینکه MX net چیست و سپس برخی از

24

00:00:53,770 –> 00:00:55,960

داده های اساسی آن

25

00:00:55,960 –> 00:00:57,850

آرایه و نماد بعدی ND یا n برای

26

00:00:57,850 –> 00:00:59,890

ریاضیات نمادین را بررسی می کنیم، سپس به

27

00:00:59,890 –> 00:01:01,840

گلوئون که سطح بالاتری است نگاه می کنیم. بسته بندی در

28

00:01:01,840 –> 00:01:03,730

بالای شبکه MX و سپس

29

00:01:03,730 –> 00:01:05,409

با

30

00:01:05,409 –> 00:01:07,930

پیاده سازی آن با گلوئون، رگرسیون لجستیک را مجدداً بررسی خواهیم کرد، بنابراین MX

31

00:01:07,930 –> 00:01:09,970

net چیست و این یک کتابخانه از ریاضیات و

32

00:01:09,970 –> 00:01:11,860

یادگیری عمیق است که هم

33

00:01:11,860 –> 00:01:13,960

به معنای ضروری حلقه و هم کد در معنای نمادین،

34

00:01:13,960 –> 00:01:17,049

واسط های اعلامی،

35

00:01:17,049 –> 00:01:18,789

تمایز خودکار است. میتواند

36

00:01:18,789 –> 00:01:21,549

لایههای از پیش تعریفشده گرادیان را محاسبه کند GPU و

37

00:01:21,549 –> 00:01:23,499

پشتیبانی از محاسبات

38

00:01:23,499 –> 00:01:25,780

توزیعشده همگی داخلی هستند. این یک کتابخانه با امکانات کامل است

39

00:01:25,780 –> 00:01:26,969

که میتوانید طیف گستردهای از

40

00:01:26,969 –> 00:01:29,350

محاسبات نمادین ریاضی و شبکه عصبی را

41

00:01:29,350 –> 00:01:31,420

انجام دهید، بنابراین بیایید نگاهی به M

42

00:01:31,420 –> 00:01:33,579

x-men و مقداری کد بیندازیم. نوع داده اصلی

43

00:01:33,579 –> 00:01:35,350

در اینجا آرایه ND یا آرایه n

44

00:01:35,350 –> 00:01:37,329

بعدی است که در غیر این صورت به عنوان تانسور شناخته می شود،

45

00:01:37,329 –> 00:01:39,579

اگر با numpy آشنا هستید،

46

00:01:39,579 –> 00:01:41,859

این یک API مشابه دارد و تقریباً می تواند

47

00:01:41,859 –> 00:01:43,689

یک به یک

48

00:01:43,689 –> 00:01:45,700

از numpy اصلی به عقب و جلو تبدیل شود. مزیت

49

00:01:45,700 –> 00:01:47,499

MX net نسبت به numpy زمانی که ما در حال

50

00:01:47,499 –> 00:01:49,749

انجام یادگیری عمیق هستیم، با

51

00:01:49,749 –> 00:01:52,090

وجود پشتیبانی از GPU و تمایز خودکار، نمایان میشود، بنابراین

52

00:01:52,090 –> 00:01:53,799

در اینجا یک آرایه خالی ایجاد کردهایم و

53

00:01:53,799 –> 00:01:55,179

فقط دارای v تصادفی است. نشان می دهد و

54

00:01:55,179 –> 00:01:56,529

اساساً آنچه را که در RAM باقی مانده است جمع آوری می کند،

55

00:01:56,529 –> 00:01:58,990

اما می توانید ریاضیات ماتریس معمولی را نیز انجام دهید،

56

00:01:58,990 –> 00:02:00,399

مانند اینکه ما می توانیم در واقع دو

57

00:02:00,399 –> 00:02:02,319

مجموعه از یک ها را تنظیم کنیم و آنها را به ساخت دو

58

00:02:02,319 –> 00:02:04,929

اضافه کنیم یا در واقع می توانیم یک آرایه ثابت در سراسر آرایه اضافه کنیم

59

00:02:04,929 –> 00:02:07,630

و آن را پخش کنیم. همچنین

60

00:02:07,630 –> 00:02:09,970

یک آرایه بردارید و یک ردیف را انتخاب کنید یا

61

00:02:09,970 –> 00:02:11,530

گامها و برشهایی را انجام دهید تا

62

00:02:11,530 –> 00:02:13,270

مقادیر مجزای آرایه را

63

00:02:13,270 –> 00:02:14,440

در اینجا انتخاب کنید

64

00:02:14,440 –> 00:02:15,910

. رفتن به عقب و جلو به numpy بسیار

65

00:02:15,910 –> 00:02:18,490

آسان است که در واقع به عنوان numpy بگویید و سپس

66

00:02:18,490 –> 00:02:20,410

میتوانید از آرایه numpy به عنوان

67

00:02:20,410 –> 00:02:22,540

ورودی استفاده کنید. در MX net برای ایجاد

68

00:02:22,540 –> 00:02:24,550

مقادیر نیز بیایید نگاهی به

69

00:02:24,550 –> 00:02:26,410

ریاضیات نمادین

70

00:02:26,410 –> 00:02:27,790

بیندازیم.

71

00:02:27,790 –> 00:02:29,560

72

00:02:29,560 –> 00:02:31,140

73

00:02:31,140 –> 00:02:33,970

کد خود

74

00:02:33,970 –> 00:02:36,130

را به عنوان یک فرمول بدانید و سپس مقادیر مشخصی بدهید و

75

00:02:36,130 –> 00:02:38,020

سپس گرادیان ها را محاسبه کنید و این

76

00:02:38,020 –> 00:02:39,700

می تواند برای ایجاد یک رابط خام برای

77

00:02:39,700 –> 00:02:41,050

انجام شبکه های عمومی استفاده شود، اما نگران نباشید

78

00:02:41,050 –> 00:02:42,550

gluon می تواند بیشتر این موارد را برای

79

00:02:42,550 –> 00:02:44,770

شما انجام دهد، من با دو شروع می کنم. وا ریبل های a

80

00:02:44,770 –> 00:02:46,630

و B و سپس فرمولی ایجاد می کنیم

81

00:02:46,630 –> 00:02:50,380

که در آن دو برابر یک ب علاوه یک

82

00:02:50,380 –> 00:02:51,550

چیز ساده ای است که از جبر در دبیرستان به خاطر می آورید

83

00:02:51,550 –> 00:02:53,860

اکنون آن

84

00:02:53,860 –> 00:02:55,120

متغیرهایی را که در واقع به آن به عنوان یک

85

00:02:55,120 –> 00:02:56,890

فراخوانی تابع در برنامه نویسی منظم یک

86

00:02:56,890 –> 00:02:59,470

اتصال فکر می کنیم ترکیب می کنیم. ما در واقع

87

00:02:59,470 –> 00:03:01,570

مقادیر واقعی را به a و B منتقل می کنیم، بنابراین ما 3

88

00:03:01,570 –> 00:03:04,030

و a و 2 و B را قرار می دهیم و سپس

89

00:03:04,030 –> 00:03:05,680

شبکه را به جلو اجرا می کنیم و شما یک

90

00:03:05,680 –> 00:03:08,110

مقدار خروجی دریافت می کنید که بسیار خوب است

91

00:03:08,110 –> 00:03:09,550

و من به شما قول می دهم

92

00:03:09,550 –> 00:03:11,170

برای کار با

93

00:03:11,170 –> 00:03:13,510

MX net و gluon به ریاضیات زیادی نیاز نیست، بنابراین در ادامه به

94

00:03:13,510 –> 00:03:15,490

95

00:03:15,490 –> 00:03:17,770

رابط سطح بالاتر چسب و لایه بالاتر نگاهی می اندازیم، بنابراین چه چیزی روی آن چسب است

96

00:03:17,770 –> 00:03:19,930

تا شبکه عمیق خود را داشته باشید.

97

00:03:19,930 –> 00:03:21,520

دوباره بسازید و آن را روی چسبی بسازید که

98

00:03:21,520 –> 00:03:23,740

روی آن روی شبکه MX ساخته شده است،

99

00:03:23,740 –> 00:03:25,570

بنابراین عملیات ابتدایی

100

00:0

![فیلم آموزشی: [Python] آرگومان های اختیاری با زیرنویس فارسی](http://pezhvak24.ir/dl/learn/wp-content/uploads/upyt/6sso3x3sGFsimage2.jpg)