در این مطلب، ویدئو مقدمه ای بر خزنده های وب و خراش دادن با اسکرپی با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:28:55

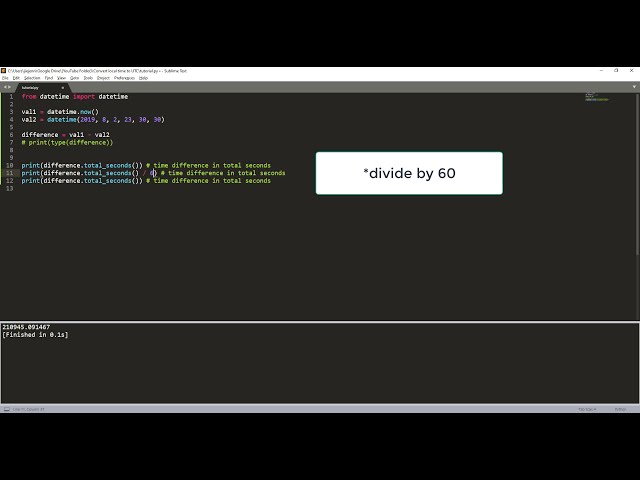

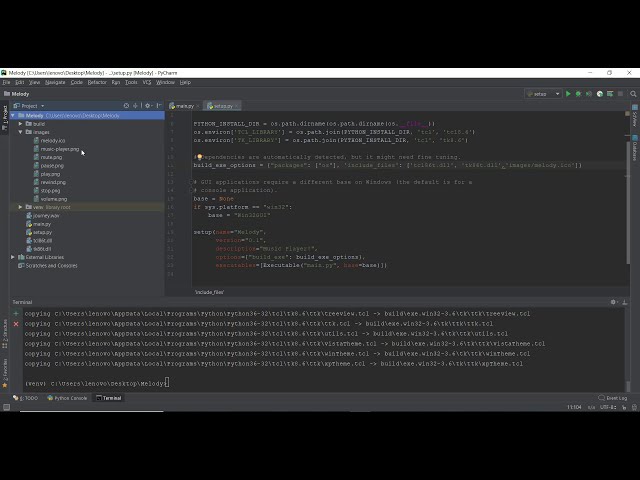

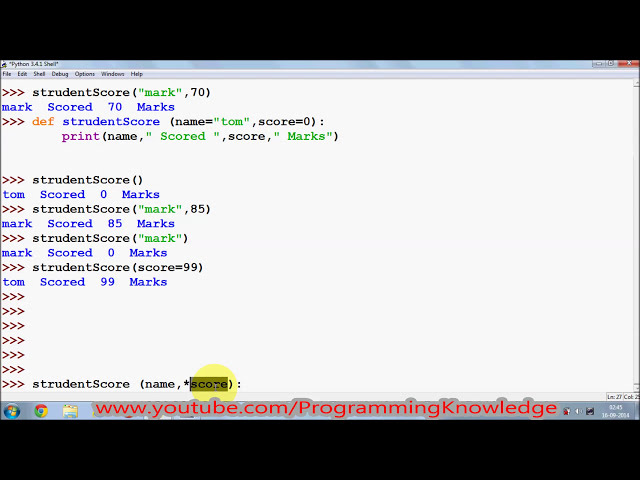

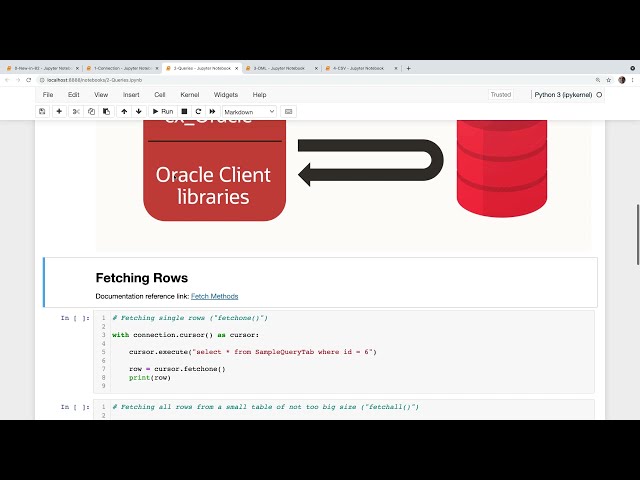

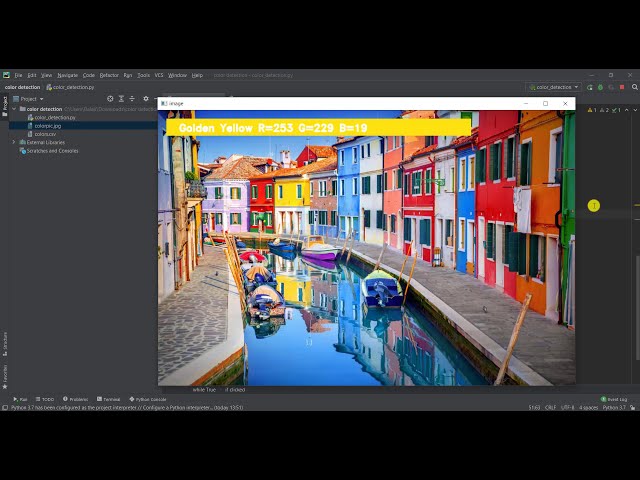

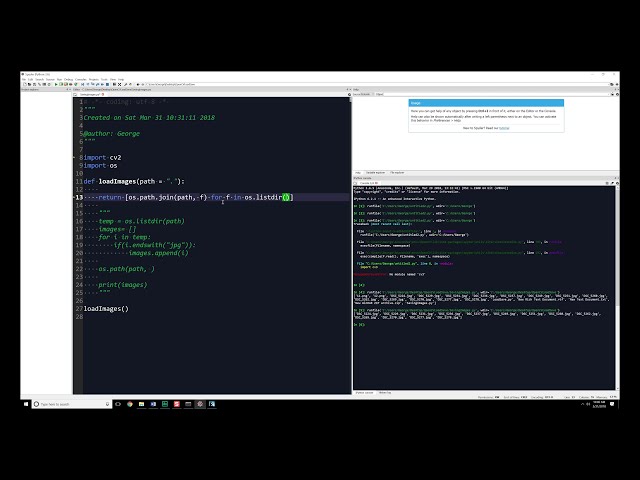

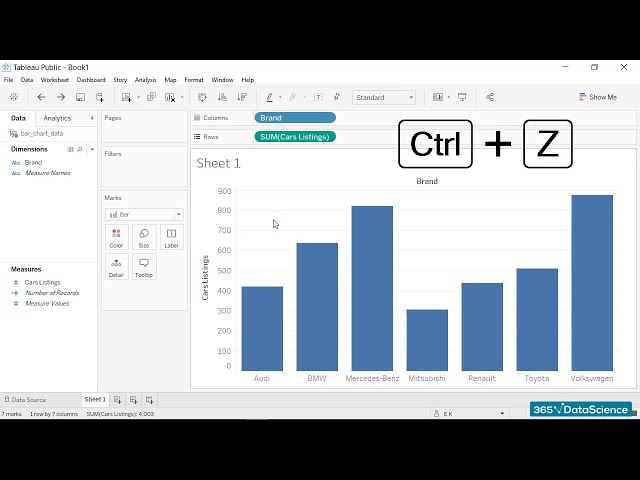

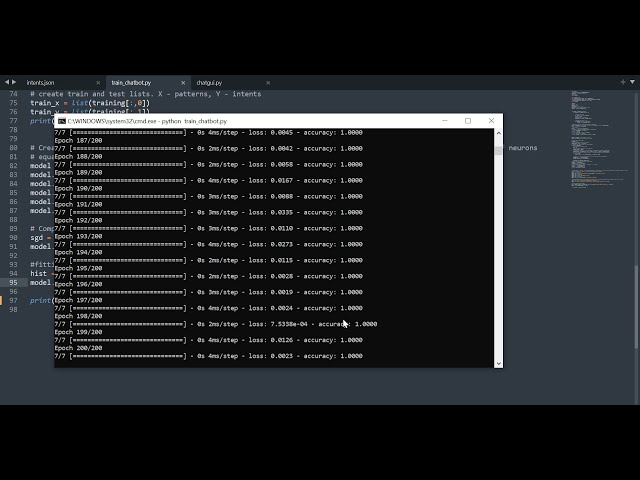

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,530 –> 00:00:06,200

[موسیقی]

2

00:00:06,200 –> 00:00:08,970

این ویدیو توسط kite حمایت می شود که

3

00:00:08,970 –> 00:00:11,190

یک پسوند پایتون برای کد در مقابل و بسیاری از

4

00:00:11,190 –> 00:00:12,960

ویرایشگرهای مدرن دیگر است که

5

00:00:12,960 –> 00:00:14,820

قطعات هوشمند و

6

00:00:14,820 –> 00:00:16,760

مستندات با یک کلیک را با استفاده از برنامه ای به نام

7

00:00:16,760 –> 00:00:19,380

Co-Pilot ارائه می دهد که من در واقع در

8

00:00:19,380 –> 00:00:21,660

این پروژه برای دانلود از آن استفاده خواهم کرد. بادبادک در هر

9

00:00:21,660 –> 00:00:23,220

پلتفرمی روی پیوند در

10

00:00:23,220 –> 00:00:26,519

توضیحات زیر کلیک کنید بچهها

11

00:00:26,519 –> 00:00:28,019

در این ویدیو به scrapey نگاه

12

00:00:28,019 –> 00:00:30,840

میکنیم که یک چارچوب پایتون برای

13

00:00:30,840 –> 00:00:33,000

خزیدن وبسایتها و استخراج دادهها است

14

00:00:33,000 –> 00:00:35,550

و دلایل زیادی وجود دارد که

15

00:00:35,550 –> 00:00:37,050

ممکن است بخواهید از چیزی استفاده کنید. مانند این

16

00:00:37,050 –> 00:00:39,540

برای تجزیه و تحلیل داده

17

00:00:39,540 –> 00:00:42,480

ها برای پردازش اطلاعات داده کاوی بسیاری از خدمات

18

00:00:42,480 –> 00:00:44,670

و وب سایت ها به شما api داده می دهند تا

19

00:00:44,670 –> 00:00:46,920

با آنها کار کنید، اما همه آنها این کار را نمی کنند، بنابراین

20

00:00:46,920 –> 00:00:48,600

ممکن است وب سایتی وجود داشته باشد که در آن

21

00:00:48,600 –> 00:00:50,129

مقداری داده می خواهید اما API در دسترس نیست

22

00:00:50,129 –> 00:00:52,680

تا بتوانید آن را پاک کنید.

23

00:00:52,680 –> 00:00:54,539

اکنون باید خودتان دادهها را در نظر داشته باشید که

24

00:00:54,539 –> 00:00:56,850

اصول اخلاقی و حتی قانونی

25

00:00:56,850 –> 00:00:58,980

زیادی در خراش دادن وب وجود دارد، بنابراین اگر

26

00:00:58,980 –> 00:01:00,870

از آن بهعنوان حرفهای برای یک

27

00:01:00,870 –> 00:01:02,789

محصول یا مقایسه خود استفاده میکنید. ny یا چیزی که

28

00:01:02,789 –> 00:01:04,559

واقعاً میخواهید به آن نگاه کنید که اگر

29

00:01:04,559 –> 00:01:06,390

دادهها را از وبسایت دیگری جمعآوری میکنید،

30

00:01:06,390 –> 00:01:07,530

میخواهید به شرایط و

31

00:01:07,530 –> 00:01:10,200

ضوابط آن نگاه کنید و میدانید که

32

00:01:10,200 –> 00:01:12,330

میخواهید وقتی با خراش دادن وب سروکار دارید اخلاقی باشید

33

00:01:12,330 –> 00:01:13,979

و این واقعاً تمام چیزی است که من میکنم.

34

00:01:13,979 –> 00:01:15,360

من در مورد این موضوع می گویم که به

35

00:01:15,360 –> 00:01:17,280

شما نمی گویم چه کاری باید انجام دهید و چه کاری را انجام ندهید،

36

00:01:17,280 –> 00:01:19,770

بنابراین کاری که ما می خواهیم انجام دهیم این است که

37

00:01:19,770 –> 00:01:22,140

این را در اینجا خراش دهیم این وبلاگ به

38

00:01:22,140 –> 00:01:25,290

نام وبلاگ scraping scraping hub و

39

00:01:25,290 –> 00:01:27,240

من این را در یک سری آموزش دیدهام، بنابراین

40

00:01:27,240 –> 00:01:29,100

فهمیدم استفاده از آن در این ویدیو برای ما خوب است

41

00:01:29,100 –> 00:01:32,729

و فقط یک وبلاگ معمولی است

42

00:01:32,729 –> 00:01:34,890

و میتوانید ببینید که تعداد زیادی

43

00:01:34,890 –> 00:01:36,930

پست دارد و سپس صفحات دیگری از

44

00:01:36,930 –> 00:01:39,000

پستها دارد. دوست

45

00:01:39,000 –> 00:01:42,990

دارم تک تک پست ها را پاک کنم و عنوان را به دست بیاورم، بنابراین من عنوان را می

46

00:01:42,990 –> 00:01:45,420

خواهم تاریخ و نویسنده

47

00:01:45,420 –> 00:01:46,950

و البته شما می توانید چیزهای دیگری نیز دریافت کنید،

48

00:01:46,950 –> 00:01:48,720

اما اینها سه موردی هستند

49

00:01:48,720 –> 00:01:51,060

که من واقعاً می خواهم هدف قرار دهم و تا

50

00:01:51,060 –> 00:01:53,340

پایان این مقاله من می خواهم بتوانم

51

00:01:53,340 –> 00:01:55,860

دستوری را برای خراش دادن وب سایت اجرا کنم و همه

52

00:01:55,860 –> 00:01:58,890

آن موارد را دریافت کرده و در آن قرار دهم در یک فایل JSON بزرگ

53

00:01:58,890 –> 00:02:00,719

و البته میتوانید هر کاری

54

00:02:00,719 –> 00:02:02,219

که دوست دارید با آن انجام دهید، میتوانید آن را در یک

55

00:02:02,219 –> 00:02:05,100

پایگاه داده ذخیره کنید، میتوانید یک CSV ایجاد کنید و

56

00:02:05,100 –> 00:02:06,659

میتوانید آن را از طریق آنچه خطوط لوله نامیده میشود اجرا کنید

57

00:02:06,659 –> 00:02:09,690

و بعد از استخراج دادهها

58

00:02:09,690 –> 00:02:12,120

را به هم بزنید. می توانم انجام دهم، اما این

59

00:02:12,120 –> 00:02:12,830

یک نوع

60

00:02:12,830 –> 00:02:14,810

دوره در سطح دکتری اینچ است، بنابراین ما می

61

00:02:14,810 –> 00:02:17,780

خواهیم یک اسکریپت مانند آنچه که گفتم استخراج کنیم

62

00:02:17,780 –> 00:02:20,480

تا داده ها را از

63

00:02:20,480 –> 00:02:23,120

وبلاگ استخراج کنیم و همچنین در پوسته کار خواهیم کرد

64

00:02:23,120 –> 00:02:24,950

زیرا scrapy دارای یک پوستهای

65

00:02:24,950 –> 00:02:28,280

که میتوانیم مستقیماً انتخابگرها را اجرا کنیم و

66

00:02:28,280 –> 00:02:30,530

روشهایی را روی آن انتخابگرها اجرا کنیم تا

67

00:02:30,530 –> 00:02:33,050

دادهها را به درستی دریافت کنیم، بنابراین بیایید جلو برویم و

68

00:02:33,050 –> 00:02:35,000

به کد vs بپردازیم و من فقط

69

00:02:35,000 –> 00:02:36,890

ترمینال خود را در اینجا باز کردهام، من از

70

00:02:36,890 –> 00:02:39,770

ترمینال یکپارچه خود استفاده میکنم و مانند هر

71

00:02:39,770 –> 00:02:41,720

پایتون دیگری پروژه ما قرار است یک

72

00:02:41,720 –> 00:02:43,520

محیط مجازی ایجاد کنیم و من

73

00:02:43,520 –> 00:02:46,730

فقط از virtual env برای آن استفاده خواهم کرد، بنابراین

74

00:02:46,730 –> 00:02:51,110

اگر Python 3 dash M V env را انجام دهیم و یک

75

00:02:51,110 –> 00:02:54,320

پوشه به نام V env ایجاد کنیم تا

76

00:02:54,320 –> 00:02:55,820

محیط مجازی ما باشد و شما می توانید

77

00:02:55,820 –> 00:02:57,320

داخل آن را ببینید. پوشه bin یک activat وجود دارد

78

00:02:57,320 –> 00:02:59,690

اسکریپت e بنابراین ما فقط میخواهیم

79

00:02:59,690 –> 00:03:04,450

آن را با منبع V و V صدا بزنیم اسلش bin

80

00:03:04,450 –> 00:03:07,520

اسلش فعال کنید تا محیط مجازی ما را فعال

81

00:03:07,520 –> 00:03:09,110

کنند و اگر به

82

00:03:09,110 –> 00:03:10,970

کد حسادت میکنید میخواهید فقط دستور

83

00:03:10,970 –> 00:03:14,000

shift P یا ctrl shift P را برای

84

00:03:14,000 –> 00:03:16,790

مفسر انتخابی پایتون جستجو کنید. و فقط

85

00:03:16,790 –> 00:03:19,130

محیط مجازی خود را انتخاب کنید

86

00:03:19,130 –> 00:03:22,160

که V و V نامیده می شود، بنابراین اکنون ما باید آماده

87

00:03:22,160 –> 00:03:24,230

باشیم، بنابراین من می خواهم scrapey را نصب کنم

88

00:03:24,230 –> 00:03:26,090

و می خواهیم از pit برای آن استفاده کنیم یا

89

00:03:26,090 –> 00:03:28,310

اگر از آن استفاده می کنید از pipi و V استفاده کنیم، بنابراین بیایید

90

00:03:28,310 –> 00:03:32,840

scrapy را نصب کنیم. بسیار خوب، پس وقتی crepe

91

00:03:32,840 –> 00:03:35,120

نصب شد، میتوانیم ادامه دهیم و

92

00:03:35,120 –> 00:03:40,340

با گفتن پروژه شروع scrapey، پروژه ایجاد کنیم

93

00:03:40,340 –> 00:03:41,780

و سپس من فقط اسمش را میگذارم، آن

94

00:03:41,780 –> 00:03:45,920

را میگوییم post scrape ما

95

00:03:45,920 –> 00:03:47,090

هر چه میخواهید آن را خزش کنید و سپس

96

00:03:47,090 –> 00:03:50,630

ما فقط به CD به post Grade بروید

97

00:03:50,630 –> 00:03:53,540

و سپس اجازه دهید نگاهی به پوشه

98

00:03:53,540 –> 00:03:55,400

ای که در اینجا ایجاد شده است بیندازیم، اکنون

99

00:03:55,400 –> 00:03:57,320

یک پوشه دیگر به نام post scrape در

100

00:03:57,320 –> 00:04:00,260

داخل آن به همراه این فایل CFG نقطه scrapy

101

00:04:00,260 –> 00:04:03,260

وجود دارد و در داخل این پوشه ما یک

102

00:04:03,260 –> 00:04:06,890

فایل برای Middlewares برای Pipelines داریم.

103

00:04:06,890 –> 00:04:08,330

ما چیزی به نام داریم خطوط لوله آیتم

104

00:04:08,330 –> 00:04:10,580

که در آن هنگام خزیدن

105

00:04:10,580 –> 00:04:12,860

و استخراج داده ها، می توانید کارهای خاصی

106

00:04:12,860 –> 00:04:14,630

را با آن انجام دهید، می توانید آن را پاک کنید، می

107

00:04:14,630 –> 00:04:17,690

توانید اعتبار سنجی را روی آن اجرا کنید

108

00:04:17,690 –> 00:04:19,010

چیزهای مختلفی که قرار نیست وارد آن

109

00:04:19,010 –> 00:04:21,168

شویم که پیشرفته تر است و آنچه من

110

00:04:21,168 –> 00:04:23,090

می خواهم برای انجام این کار تنها کاری که میخواهم انجام دهم این است که

111

00:04:23,090 –> 00:04:25,640

یک عنکبوت ایجاد کنم، بنابراین در داخل پوشه spiders

112

00:04:25,640 –> 00:04:26,450

113

00:04:26,450 –> 00:04:28,730

یک فایل جدید ایجاد میکنیم به نام posts

114

00:04:28,730 –> 00:04:32,450

underscore spider dot pi بسیار خوب، بنابراین این

115

00:04:32,450 –> 00:04:34,730

فایل اصلی ما خواهد بود که با آن کار میکنیم

116

00:04:34,730 –> 00:04:36,530

و اولین چیزی که با آن کار میکنیم. ما می خواهیم این کار را

117

00:04:36,530 –> 00:04:39,590

انجام دهیم تا scrapie را وارد کنیم تا بتوانیم از

118

00:04:39,590 –> 00:04:42,320

آن استفاده کنیم و سپس باید یک کلاس عنکبوتی ایجاد کنیم،

119

00:04:42,320 –> 00:04:44,930

بنابراین بیایید بگوییم کلاس ما آن را

120

00:04:44,930 –> 00:04:50,740

posts spider می نامیم و این باید

121

00:04:50,740 –> 00:04:54,200

Scrapey dot spider را گسترش دهد، اکنون می خواهم نگاهی بیندازم.

122

00:04:54,200 –> 00:04:57,950

در این کلاس spider و

123

00:04:57,950 –> 00:04:59,750

من از بادبادک برای انجام این کار استفاده می کنم، بنابراین

124

00:04:59,750 –> 00:05:02,270

افزونه kite این پیوند داک را به ما می دهد که

125

00:05:02,270 –> 00:05:04,610

در واقع copilot را باز می کند و

126

00:05:04,610 –> 00:05:06,650

همه چیزهایی را که با این کلاس مرتبط است به ما نشان می دهد

127

00:05:06,650 –> 00:05:09,170

خوب است، بنابراین می توانید ببینید تمام

128

00:05:09,170 –> 00:05:10,880

اعضای مختلف من فقط می خواهم به

129

00:05:10,880 –> 00:05:13,400

شما نشان دهم چند چیز، بنابراین نام چیزی است

130

00:05:13,400 –> 00:05:15,350

که ما به آن نیاز داریم، یک رشته برای

131

00:05:15,350 –> 00:05:17,780

شناسایی عنکبوت است و باید

132

00:05:17,780 –> 00:05:20,390

منحصر به فرد باشد، باید یک رشته باشد، بنابراین بیایید

133

00:05:20,390 –> 00:05:23,690

جلو برویم و یک ویژگی نام را در اینجا اضافه کنیم،

134

00:05:23,690 –> 00:05:27,620

این پست ها را صدا می کنیم و اگر ما

135

00:05:27,620 –> 00:05:31,340

به کمک کیت برمی گردیم، ما همچنین این URL های شروع را می خواهیم

136

00:05:31,340 –> 00:05:34,400

که یک لیست یا آرایه ای از URL ها است

137

00:05:34,400 –> 00:05:37,280

که می خواهیم از آنها بخزیم، بنابراین فرض کنید

138

00:05:37,280 –> 00:05:40,790

URL های زیرخط شروع می شود که آن را به یک

139

00:05:40,790 –> 00:05:47,890

لیست تنظیم کنید و ما HTTP وبلاگ نقطه

140

00:05:47,890 –> 00:05:52,880

خراش hub comm را انجام می دهیم. و ما میتوانیم اسلش،

141

00:05:52,880 –> 00:06:12,020

let’s do /page /parent eyere page را انجام دهیم و

142

00:06:12,020 –> 00:06:15,350

آن را در یک فایل HTML جداگانه قرار دهیم

143

00:06:15,350 –> 00:06:17,780

که به تنهایی به غیر از

144

00:06:17,780 –> 00:06:20,180

مشاهده وبسایت آفلاین چندان مفید نیست، اما اکنون به

145

00:06:20,180 –> 00:06:22,910

شما ایده میدهد که چگونه کار میکند. همچنین

146

00:06:22,910 –> 00:06:27,110

یک روش تجزیه میخواهید، بنابراین بیایید دقیقاً اینجا را ببینیم،

147

00:06:27,110 –> 00:06:29,390

بنابراین تجزیه میکنیم که پاسخ میگیرد،

148

00:06:29,390 –> 00:06:32,030

این پاسخ تماس پیشفرض است که توسط

149

00:06:32,030 –> 00:06:34,430

scrapey برای پردازش پاسخهای دانلود استفاده میشود،

150

00:06:34,430 –> 00:06:36,980

زمانی که درخواستهای آنها

151

00:06:36,980 –> 00:06:39,939

پاسخ به تماس را مشخص نمیکنند، بنابراین اساساً

152

00:06:39,939 –> 00:06:42,069

مسئول پاسخ در برگرداندن اسکراپ است.

153

00:06:42,069 –> 00:06:45,689

داده پس بیایید جلو برویم و parse

154

00:06:45,689 –> 00:06:49,300

و w را تعریف کنیم میخواهد خودش را پاس کند، زیرا این یک

155

00:06:49,300 –> 00:06:51,550

متد از این کلاس است و

156

00:06:51,550 –> 00:06:54,789

سپس پاسخ میدهد، بنابراین پاسخ

157

00:06:54,789 –> 00:06:57,360

اساساً دادههایی است که اکنون میخریم،

158

00:06:57,360 –> 00:06:59,979

در این مورد، ما فقط میخواهیم

159

00:06:59,979 –> 00:07:02,650

اساساً هر دو صفحه را کپی کنیم و

160

00:07:02,650 –> 00:07:05,439

دو صفحه ایجاد کنیم. فایلهای HTML جدید با همان

161

00:07:05,439 –> 00:07:07,719

HTML دقیق، بنابراین

162

00:07:07,719 –> 00:07:11,039

ما بعداً کل صفحه را خراش میدهیم،

163

00:07:11,039 –> 00:07:13,180

عناصر خاصی از صفحه را با استفاده از

164

00:07:13,180 –> 00:07:15,550

انتخابگرها مورد هدف قرار میدهیم و آنها را در یک فایل JSON قرار میدهیم،

165

00:07:15,550 –> 00:07:17,590

بنابراین متغیری

166

00:07:17,590 –> 00:07:20,830

به نام page ایجاد میکنم. و آن را روی URL نقطه پاسخ قرار دهید

167

00:07:20,830 –> 00:07:23,169

تا

168

00:07:23,169 –> 00:07:25,539

به هر دوی این آدرس ها رسیدگی کنیم و من

169

00:07:25,539 –> 00:07:27,580

فقط می خواهم شماره صفحه را بدست بیاورم، بنابراین در

170

00:07:27,580 –> 00:07:30,789

این مورد یک و دو تا بتوانیم از

171

00:07:30,789 –> 00:07:33,310

روش تقسیم استفاده کنیم و می گوییم ما میخواهیم

172

00:07:33,310 –> 00:07:36,099

آنها را با اسلش تقسیم کنیم و میخواهیم

173

00:07:36,099 –> 00:07:39,639

یکی از انتها برویم، بنابراین یک اسلش

174

00:07:39,639 –> 00:07:41,469

از انتها و باید در اینجا به عدد پایان دهیم،

175

00:07:41,469 –> 00:07:43,629

بنابراین

176

00:07:43,629 –> 00:07:45,550

بسته به هر صفحه یا

177

00:07:45,550 –> 00:07:48,610

خراشیدن در این متغیر باید یک یا دو قرار دهیم. می

178

00:07:48,610 –> 00:07:51,400

خواهید یک نام فایل تنظیم کنید و ما

179

00:07:51,400 –> 00:07:54,370

آن را روی pos تنظیم می کنیم ts – و پس از آن شماره صفحه هر چه باشد،

180

00:07:54,370 –> 00:07:57,849

بنابراین من میخواهم از درصدهای خود

181

00:07:57,849 –> 00:08:02,319

توسط مکاننمای خود در اینجا نقطه HTML استفاده کنم و سپس

182

00:08:02,319 –> 00:08:04,389

میخواهیم آن را با هر

183

00:08:04,389 –> 00:08:07,419

شماره صفحه جایگزین کنیم تا در واقع فایلی را ایجاد

184

00:08:07,419 –> 00:08:10,500

کنیم که باید بگوییم open و

185

00:08:10,500 –> 00:08:12,759

این نام فایل

186

00:08:12,759 –> 00:08:15,610

و حالت سمت راست یا حالت فایل را

187

00:08:15,610 –> 00:08:19,599

که قرار است باینری به صورت F

188

00:08:19,599 –> 00:08:23,740

بنویسیم و سپس به صورت F و سپس

189

00:08:23,740 –> 00:08:28,690

نقطه F را درست می گوییم و در آن می

190

00:08:28,690 –> 00:08:31,449

نویسیم. فایل بدنه نقطه پاسخ

191

00:08:31,449 –> 00:08:34,390

که کل HTML است، تمام HTML

192

00:08:34,390 –> 00:08:37,208

هر دو صفحه در این

193

00:08:37,208 –> 00:08:40,269

فایلها قرار میگیرد، بنابراین اجازه دهید آن را ذخیره کنیم و میتوانیم

194

00:08:40,269 –> 00:08:44,169

این را با خزیدن خراش اجرا کنیم و سپس

195

00:08:44,169 –> 00:08:46,510

هرچه نامش را برش دهیم،

196

00:08:46,510 –> 00:08:48,850

پستهای خوبی ارسال میکند. بنابراین هر چیزی که

197

00:08:48,850 –> 00:08:52,529

در اینجا قرار می دهیم همان چیزی است که می خواهیم اینجا بگذاریم

198

00:08:52,529 –> 00:08:54,940

بسیار خوب، بنابراین ما آن را اجرا کردیم و اکنون می توانید ببینید که در

199

00:08:54,940 –> 00:08:58,149

اینجا پست – یک و پست – دو

200

00:08:58,149 –> 00:09:01,839

HTML داریم بنابراین پست – یکی این خواهد بود،

201

00:09:01,839 –> 00:09:03,850

بنابراین ما فقط کل چیز را خراش دادیم و

202

00:09:03,850 –> 00:09:06,519

آن را در این فایل قرار دهید و من حتی می

203

00:09:06,519 –> 00:09:08,880

توانم این را باز کنم، آن را با سرور زنده و راست باز می کنم

204

00:09:08,880 –> 00:09:12,670

در لوکال هاست من اکنون

205

00:09:12,670 –> 00:09:16,630

کل صفحه را داریم، بنابراین منظورم

206

00:09:16,630 –> 00:09:18,310

این است که برای مشاهده آفلاین خوب است

207

00:09:18,310 –> 00:09:20,980

یا به دلایلی اگر

208

00:09:20,980 –> 00:09:25,110

نیاز دارید کل وب سایت را پاک کنید، بنابراین اکنون می خواهیم از این وب سایت فاصله

209

00:09:25,110 –> 00:09:28,959

بگیریم.

210

00:09:28,959 –> 00:09:30,250

برای کمی فایل فایل کنید و ما

211

00:09:30,250 –> 00:09:32,350

در ترمینال کار می کنیم زیرا

212

00:09:32,350 –> 00:09:34,149

با پوسته کار می کنیم تا به

213

00:09:34,149 –> 00:09:36,730

شما نشان دهیم چگونه چیزهایی را انتخاب کنید که چگونه از

214

00:09:36,730 –> 00:09:39,699

روش ها استفاده کنید و غیره.

215

00:09:39,699 –> 00:09:42,759

پوسته scrapy و

216

00:09:42,759 –> 00:09:46,149

سپس دامنه یا نشانی اینترنتی را که میخواهیم بخزیم را فراخوانی کنیم،

217

00:09:46,149 –> 00:09:50,589

بنابراین در این مورد HTTP وبلاگ

218

00:09:50,589 –> 00:09:55,000

scraping نقطهای من حتی

219

00:09:55,000 –> 00:09:59,370

نمیتوانم URL scraping hub dot-com را به خاطر

220

00:09:59,370 –> 00:10:02,889

بسپارم، پس از اینجا من فقط میخواهم

221

00:10:02,889 –> 00:10:06,370

این موارد را با ctrl L پاک کنید، بنابراین از اینجا

222

00:10:06,370 –> 00:10:09,610

میتوانیم از انتخابگرها از انتخابگرهای CSS استفاده

223

00:10:09,610 –> 00:10:12,519

کنیم، بنابراین این کار را انجام میدهیم، همانطور که آن

224

00:10:12,519 –> 00:10:14,500

شی پاسخ را میگیریم که همان چیزی است که

225

00:10:14,500 –> 00:10:17,410

در اینجا وجود دارد، بسیار خوب، پس بعداً

226

00:10:17,410 –> 00:10:18,670

همان کار را انجام خواهیم داد.

227

00:10:18,670 –> 00:10:20,170

ما در اینجا این کار را انجام می دهیم، در روش تجزیه خود این کار را انجام می

228

00:10:20,170 –> 00:10:22,899

دهیم، بنابراین برای استفاده از انتخابگر CSS،

229

00:10:22,899 –> 00:10:26,170

فقط CSS نقطه ای را انجام می دهیم.

230

00:10:26,170 –> 00:10:29,380

فرض کنید میخواهیم عنوان را دریافت کنیم، بنابراین چیزی که

231

00:10:29,380 –> 00:10:31,120

این برمیگرداند چیزی به نام

232

00:10:31,120 –> 00:10:33,639

فهرست انتخابکننده است که فهرستی از

233

00:10:33,639 –> 00:10:36,279

اشیاء انتخابکننده را نشان میدهد که اطراف عناصر HTML را

234

00:10:36,279 –> 00:10:39,009

میپیچد، بنابراین میتوانید انتخابگر را ببینید

235

00:10:39,009 –> 00:10:40,959

که XPath دارد که من کمی در مورد آن صحبت خواهم کرد.

236

00:10:40,959 –> 00:10:43,509

و داده

237

00:10:43,509 –> 00:10:45,579

عنصر واقعی در این مورد

238

00:10:45,579 –> 00:10:48,910

عنوان با برچسب ها و متن

239

00:10:48,910 –> 00:10:50,740

داخل آن خواهد بود و اگر به عنوان آن نگاه کنیم،

240

00:10:50,740 –> 00:10:54,160

وبلاگ مرکز خراش دادن است،

241

00:10:54,160 –> 00:10:57,850

بنابراین اگر بخواهیم فقط عنصر را دریافت

242

00:10:57,850 –> 00:11:01,750

کنیم، پس ما میتواند عنوان CSS نقطه پاسخ را اجرا کند

243

00:11:01,750 –> 00:11:03,670

و میتوانیم روشی مانند get را روی آن اجرا کنیم،

244

00:11:03,670 –> 00:11:04,280

245

00:11:04,280 –> 00:11:07,040

پس کاری که get انجام میدهد این است که اولین

246

00:11:07,040 –> 00:11:10,580

تطابق را میگیرد و آن را برمیگرداند، بنابراین میتوانید ببینید

247

00:11:10,580 –> 00:11:13,220

اکنون فقط عنصر واقعی را دریافت میکنیم، حالا فرض کنید

248

00:11:13,220 –> 00:11:14,900

فقط متن را میخواهیم.

249

00:11:14,900 –> 00:11:16,250

خیلی وقتها نمیخواهید تگ واقعی را بخواهید،

250

00:11:16,250 –> 00:11:19,160

بنابراین در این صورت میتوانیم فقط

251

00:11:19,160 –> 00:11:22,910

یک عنوان دو نقطهای را اینجا اضافه کنیم. اوه،

252

00:11:22,910 –> 00:11:24,350

چه میکنم،

253

00:11:24,350 –> 00:11:27,830

متاسفم متن عنوان نیست، بیایید اجرا کنیم که

254

00:11:27,830 –> 00:11:31,910

دوباره یک متن دو نقطهای است و

255

00:11:31,910 –> 00:11:35,150

فقط متن را به ما می دهد، بنابراین

256

00:11:35,150 –> 00:11:36,850

بیایید wi را آزمایش کنیم این مقدار کمی است،

257

00:11:36,850 –> 00:11:40,490

بنابراین ما یک پاراگراف H 2 را داریم،

258

00:11:40,490 –> 00:11:43,310

بیایید جلوتر برویم و بگوییم

259

00:11:43,310 –> 00:11:49,480

نقطه پاسخ CSS و بیایید در h3 متن را بنویسیم.

260

00:11:49,480 –> 00:11:54,500

نقطه درست می شود، پس کاری که

261

00:11:54,500 –> 00:11:57,260

انجام می دهد این است که متن h3 اول را برای ما دریافت می کند، بنابراین

262

00:11:57,260 –> 00:11:59,420

ادامه دهید. تا به امروز با این خراش دادن،

263

00:11:59,420 –> 00:12:02,510

همین الان اینجاست، اگر

264

00:12:02,510 –> 00:12:05,600

دومی را میخواهیم، میتوانیم همینجا برویم و م

265

00:12:05,600 –> 00:12:07,700

موعهای از براکتها را در آن قرار دهیم و یک

266

00:12:07,700 –> 00:12:10,160

وکی 1 قرار دهیم که اگر سو

267

00:12:10,160 –> 00:12:12,170

ی را میخواهیم، دومی به ما میدهد. میتوان 2 را وارد کرد، بنابراین

268

00:12:12,170 –> 00:12:14,480

درست مانند یک لیست یا یک آرایه است

269

00:12:14,480 –> 00:12:17,390

و سومین مورد است اگر میخواهیم تمام

270

00:12:17,390 –> 00:12:20,210

h3 را دریافت کنیم، میتوانیم از شر آن خلاص شویم و

271

00:12:20,210 –> 00:12:23,660

میتوانیم از روش get all استفاده کنیم تا

272

00:12:23,660 –> 00:12:26,720

همه h3 را دریافت کنیم. متن می فرستد و آن

273

00:12:26,720 –> 00:12:29,540

را در لیست انتخابگر قرار می دهد اگر

274

00:12:29,540 –> 00:12:31,339

بخواهیم تگ ها و ویژگی ها و همه چیزهای دیگر را اضافه

275

00:12:31,339 –> 00:12:33,680

کنیم، می توانیم بدون متن این کار را انجام دهیم

276

00:12:33,680 –> 00:12:36,710

و این کار باعث می شود که

277

00:12:36,710 –> 00:12:39,470

کلاس های ID واقعی h3 هر چیز دیگری که به

278

00:12:39,470 –> 00:12:45,160

آن ضمیمه شده است را بشناسید. می توان با برچسب انتخاب کرد،

279

00:12:45,160 –> 00:12:48,080

بیایید ببینیم چه چیز دیگری را نیز می توانیم

280

00:12:48,080 –> 00:12:52,330

با کلاس یا ID انتخاب کنیم، بنابراین اگر این را باز

281

00:12:52,330 –> 00:12:57,110

کنیم و اجازه دهید o ابزارهای گوگل کروم ما را

282

00:12:57,110 –> 00:13:01,100

در اینجا بنویسید تا ابزارهای توسعه دهنده

283

00:13:01,100 –> 00:13:02,630

مطمئناً وقتی

284

00:13:02,630 –> 00:13:04,160

با خراش دادن وب سر و کار

285

00:13:04,160 –> 00:13:05,930

دارید به کار می آیند، زیرا باید ساختار چیزی

286

00:13:05,930 –> 00:13:07,880

را که خراش می دهید بدانید، بنابراین اگر به یک پست نگاهی درست بیندازیم.

287

00:13:07,880 –> 00:13:12,140

این لیست پست است که

288

00:13:12,140 –> 00:13:14,420

همه آنها را جمع می کند و سپس هر پست دارای

289

00:13:14,420 –> 00:13:17,340

یک div با کلاس آیتم پست است

290

00:13:17,340 –> 00:13:19,050

و در آن آیتم پست ما یک هدر

291

00:13:19,050 –> 00:13:22,290

پست هدر محتوای پست در

292

00:13:22,290 –> 00:13:25,170

هدر پست داریم، یک h2 با یک لینک و

293

00:13:25,170 –> 00:13:29,010

سپس متن برای پست داریم. عنوان خوب است، پس

294

00:13:29,010 –> 00:13:32,580

ما یک بازه خطی با کلاس

295

00:13:32,580 –> 00:13:34,950

تاریخ داریم که دارای نماد و پیوند و

296

00:13:34,950 –> 00:13:37,440

سپس متن تاریخ است، بنابراین مهم است

297

00:13:37,440 –> 00:13:39,540

که ساختار آن را بدانید، مانند استفاده از

298

00:13:39,540 –> 00:13:42,510

CSS یا jQuery که در آن باید موارد خاصی را انتخاب کنید،