در این مطلب، ویدئو Hadoop Tutorial: Hue – آماده سازی داده ها برای تجزیه و تحلیل با Pig و Python UDF با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:05:02

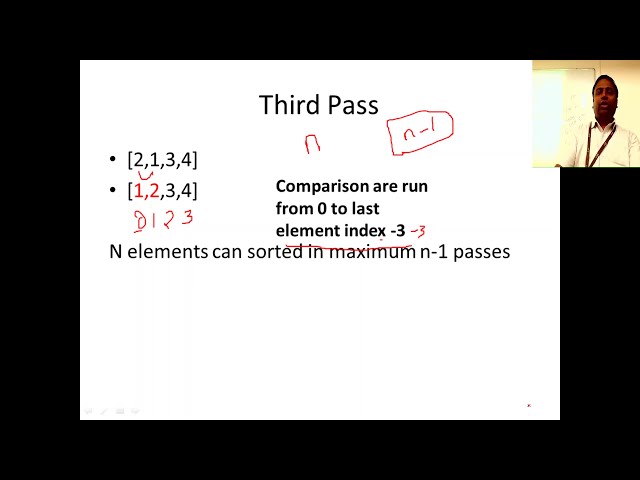

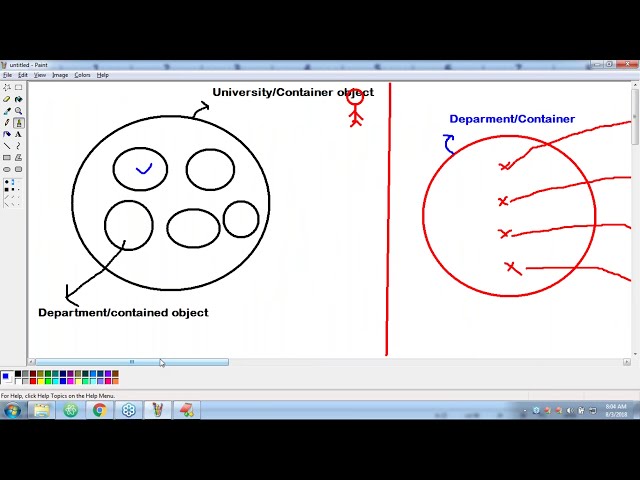

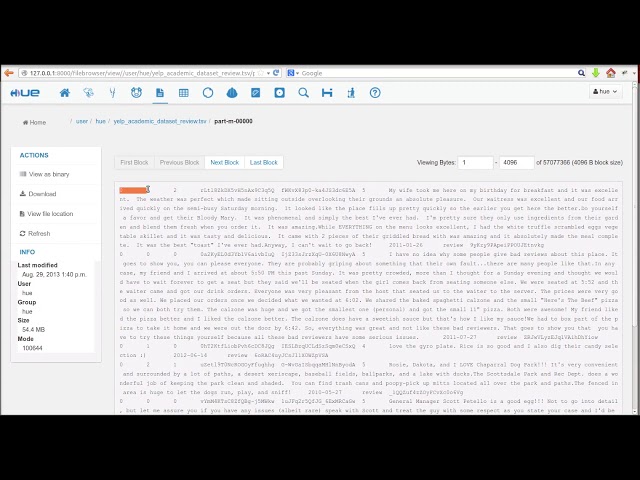

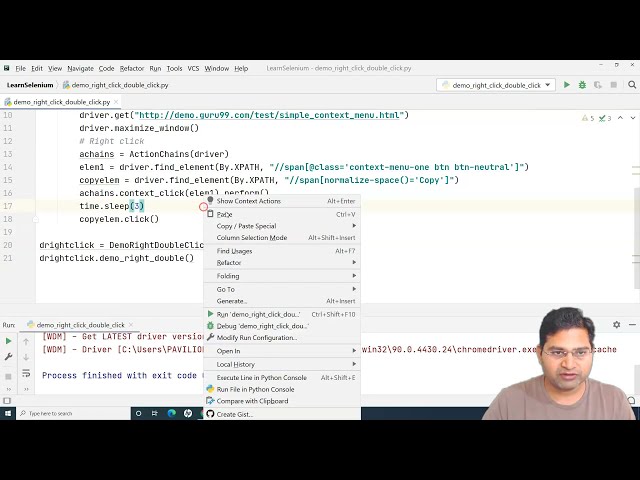

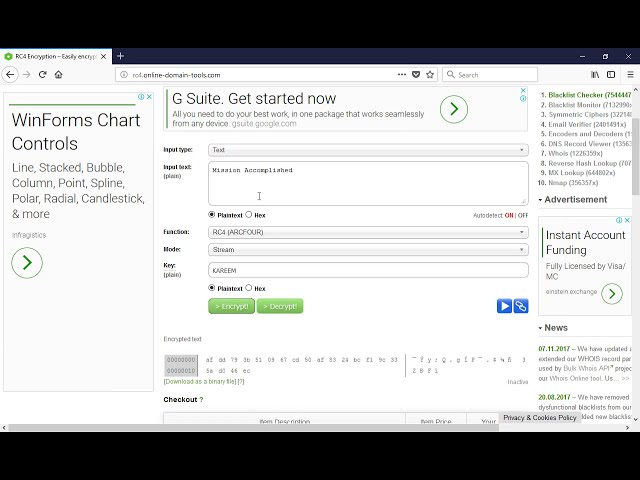

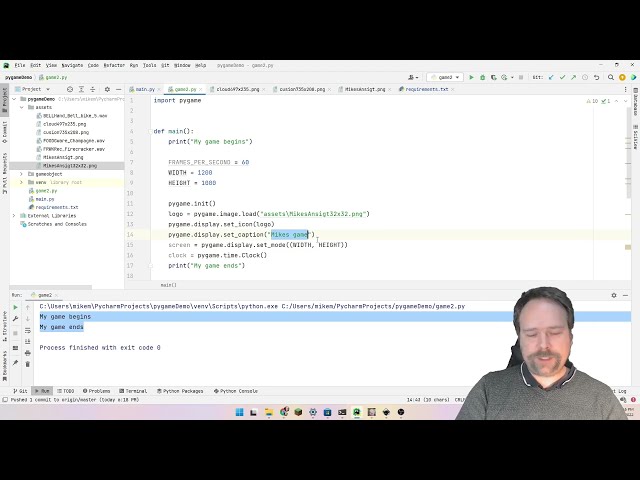

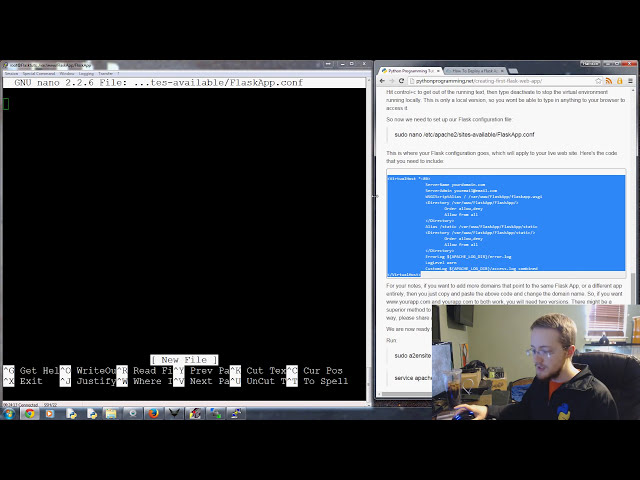

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,230 –> 00:00:06,290

[موسیقی] بسیار

2

00:00:06,290 –> 00:00:09,510

خوب به قسمت اول

3

00:00:09,510 –> 00:00:12,120

فصل دوم سریال انسانی Ossie Ruiz خوش آمدید،

4

00:00:12,120 –> 00:00:14,219

اسم من آبه است. من روی شما کار می کنم و امروز

5

00:00:14,219 –> 00:00:16,289

نشان خواهیم داد که چگونه می توان

6

00:00:16,289 –> 00:00:20,310

با خداحافظی شروع به کار کرد و با

7

00:00:20,310 –> 00:00:22,680

آپلود داده ها در HDFS و سپس شروع می کنیم.

8

00:00:22,680 –> 00:00:25,050

قالببندی آن با استفاده از Pig، ما

9

00:00:25,050 –> 00:00:27,000

با استفاده از یک اسکریپت pig شروع میکنیم و سپس سعی میکنیم

10

00:00:27,000 –> 00:00:30,029

از یک UDF pig استفاده کنیم، ابتدا باید

11

00:00:30,029 –> 00:00:32,460

مجموعه دادههای Yelp را از وبسایت چالش Yelp

12

00:00:32,460 –> 00:00:34,050

13

00:00:34,050 –> 00:00:45,710

[Music] دانلود

14

00:00:45,710 –> 00:00:48,390

کنیم.

15

00:00:48,390 –> 00:00:50,850

ما در قالب JSON باید

16

00:00:50,850 –> 00:00:52,110

این را به چیزی

17

00:00:52,110 –> 00:00:54,660

مفیدتر تبدیل کنیم، اساساً

18

00:00:54,660 –> 00:00:56,640

دادهها را تمیز کرده و به

19

00:00:56,640 –> 00:00:57,670

چیزی قابل استفادهتر تبدیل میکنیم

20

00:00:57,670 –> 00:01:10,469

[Music]

21

00:01:15,850 –> 00:01:18,310

اکنون دادههایی را که

22

00:01:18,310 –> 00:01:20,820

از Yale دانلود کردهایم در HDFS

23

00:01:20,820 –> 00:01:34,040

[Music] آپلود میکنیم. ]

24

00:01:35,500 –> 00:01:37,690

با استفاده از مرورگر فایل، میتوانیم

25

00:01:37,690 –> 00:01:40,280

دادههایی را که به تازگی آپلود کردهایم

26

00:01:40,280 –> 00:01:49,690

[Music]

27

00:01:49,690 –> 00:01:52,909

که JSON بود، بررسی کنیم، حالا بیایید

28

00:01:52,909 –> 00:01:56,540

برای تبدیل آن انتخاب کنیم، همه کدهای استفاده شده در

29

00:01:56,540 –> 00:01:58,850

این آموزشها در آموزشهای Hadoop در دسترس هستند،

30

00:01:58,850 –> 00:02:02,869

نمونههایی که github به آنجا میرود

31

00:02:02,869 –> 00:02:04,160

و دریافت میکند. برخی از اسکریپت هایی که w

32

00:02:04,160 –> 00:02:10,490

قرار است از اسکریپت در ویرایشگر خوک

33

00:02:10,490 –> 00:02:12,650

استفاده کنیم، داده های JSON را با استفاده از

34

00:02:12,650 –> 00:02:15,980

بارگذار JSON بارگیری می کند، سپس آرای

35

00:02:15,980 –> 00:02:18,380

پر شده را در سه ستون مختلف منفجر می کند، همچنین

36

00:02:18,380 –> 00:02:20,540

داده ها را کمی پاک می کند، سپس

37

00:02:20,540 –> 00:02:24,560

داده ها و فرمت TSV را ذخیره می ک

![فیلم آموزشی: لوگوی شرکت [HackerRank] | پایتون | Counter().most_common() | اپراتور باز کردن بسته بندی | مصاحبه](http://pezhvak24.ir/dl/learn/wp-content/uploads/upyt/V1ejEZ6895Mimage2.jpg)