در این مطلب، ویدئو Q Learning توضیح داد | آموزش تقویتی با استفاده از پایتون | یادگیری Q در هوش مصنوعی | ادورکا با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:29:13

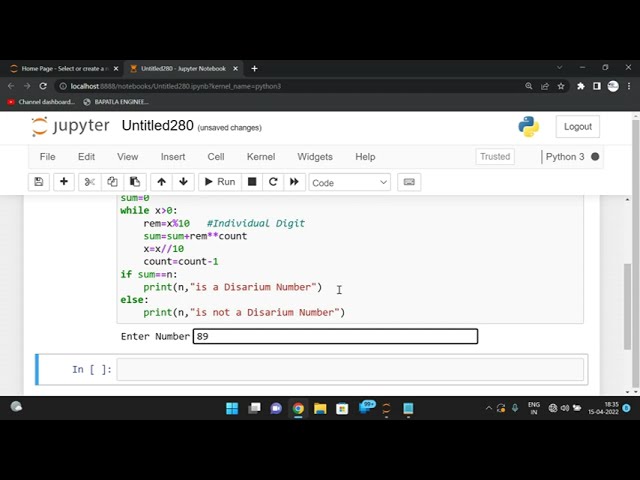

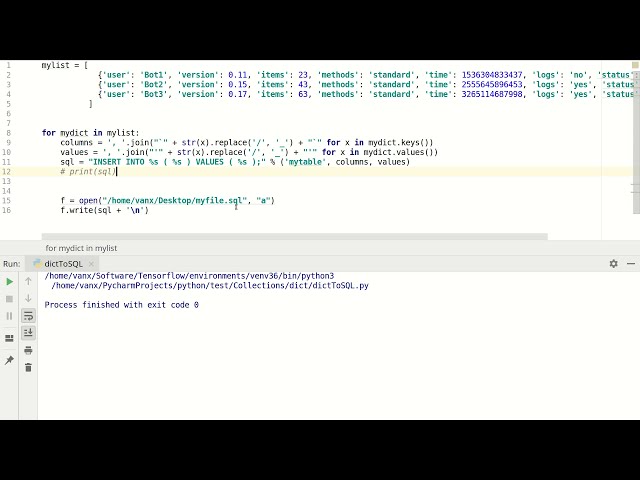

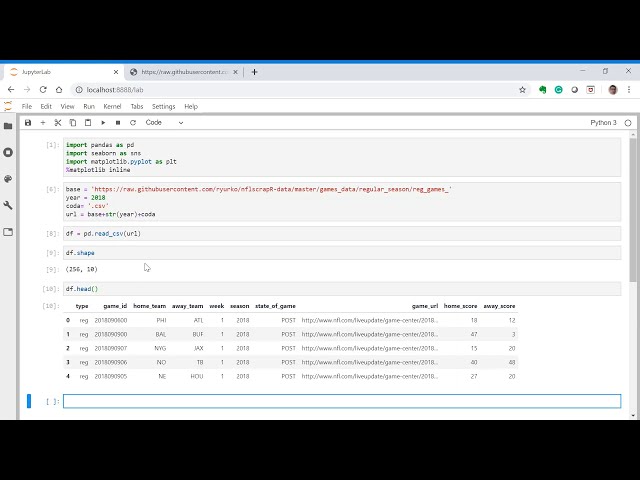

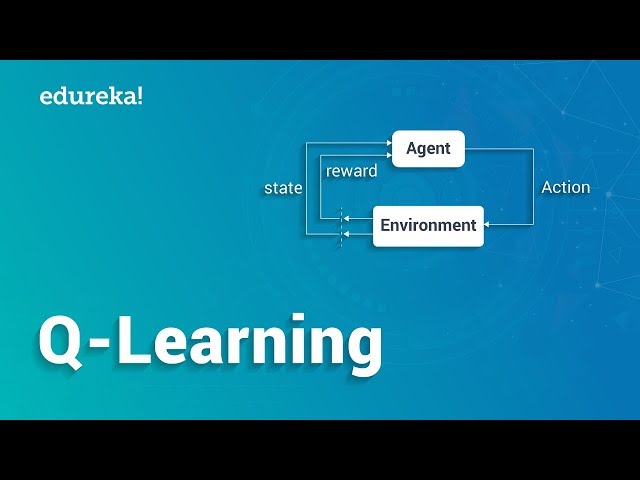

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,810 –> 00:00:10,490

[موسیقی]

2

00:00:10,490 –> 00:00:13,019

سلام به همه و به این

3

00:00:13,019 –> 00:00:16,020

جلسه جالب در مورد یادگیری نشانه خوش آمدید اکنون

4

00:00:16,020 –> 00:00:17,250

بیایید به دنیای

5

00:00:17,250 –> 00:00:19,410

یادگیری تقویتی و

6

00:00:19,410 –> 00:00:21,720

شاخه زیبای هوش مصنوعی قدم بگذاریم که به

7

00:00:21,720 –> 00:00:24,300

ماشین اجازه می دهد خودتان به روشی

8

00:00:24,300 –> 00:00:25,890

متفاوت از یادگیری ماشینی سنتی

9

00:00:25,890 –> 00:00:28,170

در طول زندگی خودمان یاد بگیرد.

10

00:00:28,170 –> 00:00:30,359

تعدادی از اقدامات برای دنبال کردن رویاهایمان،

11

00:00:30,359 –> 00:00:32,698

برخی از آنها پاداش های خوبی برای ما به ارمغان می آورند،

12

00:00:32,698 –> 00:00:35,879

برخی دیگر در طول مسیری که ما به

13

00:00:35,879 –> 00:00:38,010

کاوش در مسیرهای مختلف ادامه می دهیم و کشف می کنیم

14

00:00:38,010 –> 00:00:39,930

که کدام عمل ممکن است به پاداش های بهتری منجر شود،

15

00:00:39,930 –> 00:00:43,079

سخت تلاش می کنیم تا رویاهای خود را

16

00:00:43,079 –> 00:00:45,510

با استفاده از بازخوردی که بر اساس خود دریافت می

17

00:00:45,510 –> 00:00:47,879

کنیم. اقداماتی برای بهبود استراتژیهایمان

18

00:00:47,879 –> 00:00:50,340

به ما کمک میکنند تا تعیین کنیم که چقدر

19

00:00:50,340 –> 00:00:52,739

به اهدافمان نزدیک هستیم. تیمهای حالتهای ذهنی ما به

20

00:00:52,739 –> 00:00:55,260

طور مداوم این

21

00:00:55,260 –> 00:00:57,989

نزدیکی را در توصیف چگونگی

22

00:00:57,989 –> 00:01:00,300

دنبال کردن هدفمان در اوایل زندگی

23

00:01:00,300 –> 00:01:02,640

که برای خودمان تشبیه نماینده خود از یادگیری تقویتی تعریف کردیم، نشان میدهند.

24

00:01:02,640 –> 00:01:05,220

25

00:01:05,220 –> 00:01:07,160

من مثال بالا را خلاصه می کنم که

26

00:01:07,160 –> 00:01:09,450

نکات اصلی مورد علاقه

27

00:01:09,450 –> 00:01:12,149

واقعیت ما را دوباره قالب بندی می کند شامل محیطی است

28

00:01:12,149 –> 00:01:13,860

که در آن اعمال متعددی را انجام

29

00:01:13,860 –> 00:01:15,899

می دهیم، گاهی اوقات

30

00:01:15,899 –> 00:01:17,970

31

00:01:17,970 –> 00:01:20,220

برای دستیابی به اهداف در حال حاضر در

32

00:01:20,220 –> 00:01:22,649

طول زندگی، حالات روحی و

33

00:01:22,649 –> 00:01:25,440

جسمی ما تکامل می یابد، ما

34

00:01:25,440 –> 00:01:27,420

برای بدست آوردن هر چه بیشتر پاداش، عمل خود را تقویت می کنیم.

35

00:01:27,420 –> 00:01:30,390

تا آنجا که ممکن است در حال حاضر موجودیت های کلیدی

36

00:01:30,390 –> 00:01:33,300

مورد علاقه محیط زیست

37

00:01:33,300 –> 00:01:36,330

پاداش عمل و دولت است که اکنون کل این

38

00:01:36,330 –> 00:01:38,250

پارادایم کاوش در محیط

39

00:01:38,250 –> 00:01:41,009

و یادگیری از طریق اقدامات پاداش می دهد و

40

00:01:41,009 –> 00:01:43,920

دولت ها اساس

41

00:01:43,920 –> 00:01:46,440

یادگیری تقویتی را ایجاد می کنند بنابراین یادگیری تقویتی

42

00:01:46,440 –> 00:01:48,539

نوع خاصی از

43

00:01:48,539 –> 00:01:50,640

مشکل را حل می کند که در آن تصمیم گیری ساختن

44

00:01:50,640 –> 00:01:52,890

متوالی است و زغال سنگ درازمدت است،

45

00:01:52,890 –> 00:01:56,399

مانند بازی کردن، مدیریت منابع رباتیک

46

00:01:56,399 –> 00:01:59,520

یا تدارکات در حال حاضر برای یک ربات

47

00:01:59,520 –> 00:02:01,649

و محیط جایی است که در آن

48

00:02:01,649 –> 00:02:04,410

مورد استفاده قرار گرفته است.

49

00:02:04,410 –> 00:02:07,410

50

00:02:07,410 –> 00:02:09,750

ربات

51

00:02:09,750 –> 00:02:11,580

برای جابجایی مواد از یک مکان به مکان

52

00:02:11,580 –> 00:02:14,129

دیگر استفاده می

53

00:02:14,129 –> 00:02:16,440

شود ما دارای ویژگی مشترکی هستیم که

54

00:02:16,440 –> 00:02:18,989

اکنون این وظایف شامل یک محیط می شود

55

00:02:18,989 –> 00:02:21,180

و انتظار داریم که عامل از محیط یاد بگیرد،

56

00:02:21,180 –> 00:02:22,360

57

00:02:22,360 –> 00:02:23,650

اینجاست که یادگیری ماشین سنتی از

58

00:02:23,650 –> 00:02:25,540

بین می رود و از این رو نیاز به

59

00:02:25,540 –> 00:02:28,120

یادگیری تقویتی اکنون خوب است

60

00:02:28,120 –> 00:02:29,950

که یک مرور کلی از

61

00:02:29,950 –> 00:02:32,020

مشکل داشته باشیم. با استفاده از

62

00:02:32,020 –> 00:02:33,550

یادگیری نشانه یا یادگیری تقویتی حل می شود،

63

00:02:33,550 –> 00:02:36,280

بنابراین به تعریف

64

00:02:36,280 –> 00:02:37,900

اجزای اصلی راه حل یادگیری تقویتی کمک می کند

65

00:02:37,900 –> 00:02:40,210

که 18

66

00:02:40,210 –> 00:02:43,510

پاداش عمل محیطی و وضعیت است، بنابراین

67

00:02:43,510 –> 00:02:45,520

فرض کنید که اکنون قرار است چند ربات مستقل برای یک

68

00:02:45,520 –> 00:02:47,590

69

00:02:47,590 –> 00:02:50,350

کارخانه خودروسازی بسازیم. رباتها

70

00:02:50,350 –> 00:02:52,540

با انتقال

71

00:02:52,540 –> 00:02:54,760

قطعات

72

00:02:54,760 –> 00:02:56,740

لازم برای کشیدن ماشین به پرسنل کارخانه کمک میکنند و اکنون این

73

00:02:56,740 –> 00:02:58,570

قطعات مختلف در 9

74

00:02:58,570 –> 00:03:00,459

موقعیت مختلف در انبار کارخانه قرار دارند.

75

00:03:00,459 –> 00:03:02,950

76

00:03:02,950 –> 00:03:06,220

77

00:03:06,220 –> 00:03:08,830

و کارگران کارخانه

78

00:03:08,830 –> 00:03:10,930

محل

79

00:03:10,930 –> 00:03:13,180

قرارگیری بدنه یا شاسی را در اولویت قرار داده اند عمیق ترین

80

00:03:13,180 –> 00:03:15,340

آنهاست، اما آنها

81

00:03:15,340 –> 00:03:17,380

اولویت ها را برای مکان های دیگر نیز ارائه کرده اند

82

00:03:17,380 –> 00:03:19,810

که ما در حال حاضر به بررسی آنها خواهیم پرداخت، اما

83

00:03:19,810 –> 00:03:22,209

این مکان ها در داخل کارخانه

84

00:03:22,209 –> 00:03:24,400

تا حدودی شبیه به این هستند، بنابراین همانطور که می توانید

85

00:03:24,400 –> 00:03:27,250

در اینجا ببینید، ما l1 l2 l3 همه این

86

00:03:27,250 –> 00:03:30,070

ایستگاه ها را داریم اکنون یک چیزی که شما ممکن است داشته باشید.

87

00:03:30,070 –> 00:03:32,470

در اینجا توجه کنید که زندان مانع کمی

88

00:03:32,470 –> 00:03:36,130

در بین مکان ها وجود دارد، بنابراین

89

00:03:36,130 –> 00:03:38,260

l6 مکان اولویت اولی است که

90

00:03:38,260 –> 00:03:40,209

شامل شاسی برای تعمیر بدنه ماشین است،

91

00:03:40,209 –> 00:03:43,180

حال اجازه دهید بپرسیم ربات ها را فعال

92

00:03:43,180 –> 00:03:45,580

می کنند تا بتوانند کوتاه ترین مسیر را

93

00:03:45,580 –> 00:03:47,620

از هر مکان مشخصی پیدا کنند.

94

00:03:47,620 –> 00:03:50,410

مکان دیگری به تنهایی در حال حاضر عوامل در

95

00:03:50,410 –> 00:03:53,230

این مورد ربات ها هستند. محیط

96

00:03:53,230 –> 00:03:56,050

زیست انبار کارخانه خودرو است. حال

97

00:03:56,050 –> 00:03:57,910

بیایید در مورد این حالت ها صحبت کنیم، بنابراین

98

00:03:57,910 –> 00:03:59,709

وضعیت ها مکانی هستند که یک

99

00:03:59,709 –> 00:04:01,780

ربات خاص در آن زمان خاص حضور دارد

100

00:04:01,780 –> 00:04:03,850

که

101

00:04:03,850 –> 00:04:05,830

نشان دهنده آن است. اکنون

102

00:04:05,830 –> 00:04:07,600

ماشینها اعداد را به جای حروف درک

103

00:04:07,600 –> 00:04:10,269

میکنند، بنابراین بیایید کدهای مکان را به

104

00:04:10,269 –> 00:04:11,860

عدد نگاشت کنیم تا همانطور که میبینید اینجا

105

00:04:11,860 –> 00:04:15,100

مکان l1 t را نگاشت کردهایم. o حالت 0 l2 + 1

106

00:04:15,100 –> 00:04:18,850

و به همین ترتیب ما l8 را به عنوان حالت 7 و n

107

00:04:18,850 –> 00:04:20,380

خط در حالت 8 داریم

108

00:04:20,380 –> 00:04:22,600

و در ادامه آنچه در مورد آن صحبت خواهیم کرد

109

00:04:22,600 –> 00:04:25,660

اقدامات هستند بنابراین در مثال ما این عمل

110

00:04:25,660 –> 00:04:28,210

مکان مستقیمی خواهد بود که یک ربات

111

00:04:28,210 –> 00:04:30,130

می تواند از یک ربات برود. موقعیت مکانی خاص را درست در

112

00:04:30,130 –> 00:04:33,220

نظر بگیرید که در مکان l2 قرار دارد

113

00:04:33,220 –> 00:04:35,650

و مکان های مستقیمی که می تواند

114

00:04:35,650 –> 00:04:35,920

115

00:04:35,920 –> 00:04:40,780

l5 l1 و l3 ما را به آن جابجا کند، اکنون شکل اینجا ممکن

116

00:04:40,780 –> 00:04:43,900

است برای تجسم این موضوع مفید باشد،

117

00:04:43,900 –> 00:04:45,940

زیرا ممکن است قبلا حدس زده باشید که

118

00:04:45,940 –> 00:04:48,220

مجموعه اقدامات در اینجا چیزی نیست. اما

119

00:04:48,220 –> 00:04:50,890

مجموعه تمام حالات ممکن ربات برای

120

00:04:50,890 –> 00:04:53,410

هر مکان، مجموعه اقداماتی که یک

121

00:04:53,410 –> 00:04:55,510

ربات می تواند انجام دهد متفاوت خواهد بود، به

122

00:04:55,510 –> 00:04:57,400

عنوان مثال، مجموعه اقدامات تغییر می کند

123

00:04:57,400 –> 00:05:00,670

اگر ربات در l1 باشد نه l2، بنابراین

124

00:05:00,670 –> 00:05:03,250

اگر ربات در l1 باشد، مجموعه اقدامات تغییر می کند.

125

00:05:03,250 –> 00:05:06,700

اکنون که کار ما

126

00:05:06,700 –> 00:05:08,860

با این حالت ها و اقدامات تمام شده است، فقط می توانید به فهرست l4 و l2 بروید، بیایید

127

00:05:08,860 –> 00:05:11,680

در مورد پاداش ها صحبت کنیم، بنابراین حالت ها

128

00:05:11,680 –> 00:05:15,130

اساساً 0 1 2 3 4 هستند و اکشن ها

129

00:05:15,130 –> 00:05:18,370

نیز 0 1 2 3 4 تا 8 هستند و اکنون پاداش ها هستند.

130

00:05:18,370 –> 00:05:20,770

در حال حاضر به یک ربات داده می شود اگر یک

131

00:05:20,770 –> 00:05:24,070

مکان است حالت مستقیماً

132

00:05:24,070 –> 00:05:26,590

از یک مکان خاص قابل دسترسی است، بنابراین

133

00:05:26,590 –> 00:05:28,840

بیایید مثالی بزنیم، فرض کنید n خط

134

00:05:28,840 –> 00:05:31,540

مستقیماً از L 8 به سمت راست قابل دسترسی است، بنابراین اگر

135

00:05:31,540 –> 00:05:34,240

یک ربات از خط LA به خط n برود و

136

00:05:34,240 –> 00:05:37,120

بالعکس، با 1 پاداش داده می شود و اگر

137

00:05:37,120 –> 00:05:39,100

مکانی مستقیماً قابل دسترسی نباشد. از

138

00:05:39,100 –> 00:05:41,140

یک Liquation خاص، ما به

139

00:05:41,140 –> 00:05:43,690

هیچ جایزه ای 0 پاداش نمی دهیم، اکنون پاداش

140

00:05:43,690 –> 00:05:45,550

در اینجا فقط یک عدد است و هیچ چیز دیگری

141

00:05:45,550 –> 00:05:47,890

به ربات ها امکان می دهد تا

142

00:05:47,890 –> 00:05:50,080

حرکات را درک کنند و به آنها کمک می کند تا تصمیم بگیرند

143

00:05:50,080 –> 00:05:52,060

که چه مکان هایی مستقیماً قابل دسترسی هستند

144

00:05:52,060 –> 00:05:53,110

و چه مکان هایی اکنون با آنها نیست.

145

00:05:53,110 –> 00:05:55,720

با این نشانه میتوانیم یک

146

00:05:55,720 –> 00:05:57,520

جدول پاداش بسازیم که حاوی تمام

147

00:05:57,520 –> 00:05:59,470

مقادیر پاداش است که بین تمام

148

00:05:59,470 –> 00:06:01,720

حالتهای ممکن نگاشت شده است، بنابراین همانطور که

149

00:06:01,720 –> 00:06:03,520

در اینجا در جدول میبینید، موقعیتهایی که

150

00:06:03,520 –> 00:06:05,800

با سبز علامتگذاری شدهاند یک پاداش مثبت دارند و

151

00:06:05,800 –> 00:06:08,200

همانطور که میبینید در اینجا همه

152

00:06:08,200 –> 00:06:10,270

پاداشهای ممکن را داریم. که یک ربات می تواند با

153

00:06:10,270 –> 00:06:11,800

جابجایی بین حالت های مختلف

154

00:06:11,800 –> 00:06:14,740

به دست بیاورد، اکنون یک تصمیم جالب می آید، اکنون

155

00:06:14,740 –> 00:06:17,020

به یاد داشته باشید که مدیر کارخانه

156

00:06:17,020 –> 00:06:20,590

اولویت L 6 را بالاترین قرار می دهد، پس چگونه

157

00:06:20,590 –> 00:06:22,690

می توانیم آن را وارد کنیم. این واقعیت را در جدول بالا وارد کنید

158

00:06:22,690 –> 00:06:25,420

اکنون این کار با مرتبط

159

00:06:25,420 –> 00:06:27,160

کردن مکان با اولویت

160

00:06:27,160 –> 00:06:29,860

بالاتر با پاداش بسیار بالا نسبت به موارد معمول انجام می شود، بنابراین

161

00:06:29,860 –> 00:06:33,430

اجازه دهید 999 را در سلول L 6 کاما L 6 قرار دهیم و

162

00:06:33,430 –> 00:06:35,560

اکنون جدول پاداش ها با پاداش بالاتر

163

00:06:35,560 –> 00:06:37,570

برای بالاترین مکان

164

00:06:37,570 –> 00:06:40,330

چیزی شبیه به این به نظر می رسد ما اکنون به طور رسمی

165

00:06:40,330 –> 00:06:42,400

همه مؤلفه های حیاتی را برای

166

00:06:42,400 –> 00:06:44,320

راه حلی که در نظر داریم برای مشکل

167

00:06:44,320 –> 00:06:46,900

مورد بحث تعریف کرده ایم اکنون کمی دنده ها را تغییر می دهیم

168

00:06:46,900 –> 00:06:48,970

و برخی از مفاهیم اساسی

169

00:06:48,970 –> 00:06:49,900

را که

170

00:06:49,900 –> 00:06:51,729

در دیوار

171

00:06:51,729 –> 00:06:53,949

یادگیری تقویتی و Kuehl بر روی دیوار حاکم است مطالعه می کنیم. ابتدا

172

00:06:53,949 –> 00:06:55,500

با معادله بلمن شروع می کنیم و

173

00:06:55,500 –> 00:06:58,120

اکنون مربع اتاق های زیر را در نظر می گیریم

174

00:06:58,120 –> 00:07:00,550

که مشابه محیط واقعی

175

00:07:00,550 –> 00:07:02,830

مشکل اصلی ما است،

176

00:07:02,830 –> 00:07:05,590

اما بدون موانع، اکنون فرض کنید یک

177

00:07:05,590 –> 00:07:08,199

ربات باید به اتاقی که

178

00:07:08,199 –> 00:07:10,180

با رنگ سبز مشخص شده است برود. موقعیت a را

179

00:07:10,180 –> 00:07:13,030

با استفاده از جهت مشخص شده، اکنون چگونه

180

00:07:13,030 –> 00:07:15,100

می توانیم ربات را قادر به انجام این کار به صورت

181

00:07:15,100 –> 00:07:17,320

برنامه ای کنیم، یکی از ایده ها

182

00:07:17,320 –> 00:07:19,539

معرفی نوعی ردپایی است

183

00:07:19,539 –> 00:07:22,000

که r obot اکنون میتواند

184

00:07:22,000 –> 00:07:24,160

در اینجا یک مقدار ثابت در هر یک از اتاقها مشخص شده است که

185

00:07:24,160 –> 00:07:25,960

186

00:07:25,960 –> 00:07:27,669

اگر از

187

00:07:27,669 –> 00:07:29,919

جهت مشخصشده در بالا پیروی کند اکنون در مسیر روباتها قرار میگیرد، به این

188

00:07:29,919 –> 00:07:32,410

ترتیب اگر از محل a شروع شود،

189

00:07:32,410 –> 00:07:34,539

میتواند از طریق آن اسکن کند.

190

00:07:34,539 –> 00:07:37,570

مقدار ثابت است و بر این اساس حرکت می کند، اما

191

00:07:37,570 –> 00:07:39,039

این فقط در صورتی کار می کند که جهت

192

00:07:39,039 –> 00:07:41,380

پیشوند باشد و ربات همیشه

193

00:07:41,380 –> 00:07:43,930

از مکانی شروع به کار کند، اکنون در نظر بگیرید که ربات

194

00:07:43,930 –> 00:07:46,660

از این مکان شروع می شود به جای

195

00:07:46,660 –> 00:07:49,120

قبلی خود، اکنون ربات اکنون

196

00:07:49,120 –> 00:07:51,070

رد پا را در دو جهت متفاوت می

197

00:07:51,070 –> 00:07:53,740

بیند. بنابراین نمیتوانیم تصمیم بگیریم که

198

00:07:53,740 –> 00:07:55,270

برای رسیدن به

199

00:07:55,270 –> 00:07:57,250

مقصد که اتاق سبز است، از کدام راه برویم،

200

00:07:57,250 –> 00:07:59,889

این اتفاق در درجه اول به این دلیل است که

201

00:07:59,889 –> 00:08:01,900

ربات راهی برای به خاطر سپردن

202

00:08:01,900 –> 00:08:05,050

مسیرها برای ادامه کار ندارد، بنابراین کار ما اکنون این است

203

00:08:05,050 –> 00:08:07,000

که ربات را با یک حافظه فعال

204

00:08:07,000 –> 00:08:09,220

کنیم. جایی است که معادله بلمن

205

00:08:09,220 –> 00:08:11,530

وارد عمل می شود، بنابراین همانطور که در اینجا می بینید

206

00:08:11,530 –> 00:08:13,720

دلیل اصلی معادله بلمن این است

207

00:08:13,720 –> 00:08:15,610

که ربات را با حافظه فعال

208

00:08:15,610 –> 00:08:17,800

می کند، چیزی که ما می خواهیم از آن استفاده کنیم.

209

00:08:17,800 –> 00:08:19,479

o معادله چیزی شبیه به این می شود V

210

00:08:19,479 –> 00:08:23,530

از s حداکثر یک R از s را می دهد کاما به

211

00:08:23,530 –> 00:08:27,280

اضافه گامای V خط تیره که در آن s یک

212

00:08:27,280 –> 00:08:30,010

حالت خاص است که یک اتاق است

213

00:08:30,010 –> 00:08:31,960

a عمل حرکت بین اتاق ها است.

214

00:08:31,960 –> 00:08:34,299

خط تیره حالتی است که

215

00:08:34,299 –> 00:08:37,059

ربات از s می رود و گاما ضریب تخفیف

216

00:08:37,059 –> 00:08:39,640

است حالا ما در یک لحظه وارد آن خواهیم شد

217

00:08:39,640 –> 00:08:42,549

و بدیهی است که R از s کامای a یک

218

00:08:42,549 –> 00:08:44,620

تابع پاداش است که حالت s را می گیرد و

219

00:08:44,620 –> 00:08:48,310

عمل a را می گیرد و پاداش را خروجی می دهد اکنون V از

220

00:08:48,310 –> 00:08:50,170

s مقدار است. از قرار گرفتن در یک

221

00:08:50,170 –> 00:08:52,510

حالت خاص که ردپای است،

222

00:08:52,510 –> 00:08:54,550

اکنون همه اقدامات ممکن را در

223

00:08:54,550 –> 00:08:57,100

نظر می گیریم و یکی را که از حداکثر مقدار استفاده می کنید، انتخاب

224

00:08:57,100 –> 00:08:57,459

225

00:08:57,459 –> 00:09:00,100

می کنیم، اما

226

00:09:00,100 –> 00:09:01,870

در مورد ردپای ارزش که

227

00:09:01,870 –> 00:09:03,379

اتاقی است که

228

00:09:03,379 –> 00:09:05,779

دقیقاً زیر اتاق سبز با رنگ زرد مشخص شده است، یک محدودیت وجود دارد.

229

00:09:05,779 –> 00:09:07,819

همیشه مقدار 1 خواهد داشت تا نشان دهد

230

00:09:07,819 –> 00:09:10,069

که یکی از نزدیکترین اتاق های مجاور

231

00:09:10,069 –> 00:09:12,529

به اتاق سبز است، اکنون این نیز برای

232

00:09:12,529 –> 00:09:14,629

اطمینان از اینکه ربات

233

00:09:14,629 –> 00:09:16,459

وقتی از یک اتاق زرد به اتاق سبز می رود جایزه دریافت می کند،

234

00:09:16,459 –> 00:09:19,160

بیایید ببینیم چگونه معنا پیدا می کنیم

235

00:09:19,160 –> 00:09:21,499

معادله ای که داریم در اینجا، بنابراین بیایید

236

00:09:21,499 –> 00:09:24,529

ضریب تخفیف 0.9 را به عنوان

237

00:09:24,529 –> 00:09:26,599

گامای به خاطر بسپاریم که مقدار

238

00:09:26,599 –> 00:09:28,970

تخفیف یا ضریب تخفیف است، بنابراین اجازه دهید

239

00:09:28,970 –> 00:09:31,099

برای اتاقی که

240

00:09:31,099 –> 00:09:33,169

دقیقاً زیر یک علامت گذاری شده است یا اتاق زرد

241

00:09:33,169 –> 00:09:35,720

که علامت تخیلی برای این است، یک نقطه صفر در نظر بگیریم 9

242

00:09:35,720 –> 00:09:38,509

اتاق V از s چه مقدار خواهد بود که

243

00:09:38,509 –> 00:09:41,089

ارزش قرار گرفتن در یک حالت خاص است، بنابراین

244

00:09:41,089 –> 00:09:43,399

برای این V از s چیزی شبیه به

245

00:09:43,399 –> 00:09:46,489

حداکثر a خواهد بود که صفر می شود

246

00:09:46,489 –> 00:09:50,869

که اوایل کامای ما است به اضافه 0.9

247

00:09:50,869 –> 00:09:53,689

که گاما در آن است. 1 و این به ما 0.9 می دهد

248

00:09:53,689 –> 00:09:57,229

اکنون در اینجا ربات هیچ

249

00:09:57,229 –> 00:09:59,869

پاداشی برای رفتن به حالتی که با رنگ زرد مشخص شده است دریافت نمی کند،

250

00:09:59,869 –> 00:10:00,319

251

00:10:00,319 –> 00:10:04,189

بنابراین کاما a در اینجا 0 است،

252

00:10:04,189 –> 00:10:06,079

اما ربات باز شدن دره را در

253

00:10:06,079 –> 00:10:10,359

اتاق زرد می داند بنابراین V خط تیره 1 است.

254

00:10:10,359 –> 00:10:13,220

پس از این برای حالت های دیگر،

255

00:10:13,220 –> 00:10:16,789

باید 0.9 به دست آوریم، سپس اگر 0.9 را

256

00:10:16,789 –> 00:10:20,600

در این معادله قرار دهیم، 0.8 1 سپس 0.72 9 دریافت می کنیم

257

00:10:20,600 –> 00:10:22,970

و سپس دوباره به نقطه شروع می رسیم،

258

00:10:22,970 –> 00:10:25,609

بنابراین جدول

259

00:10:25,609 –> 00:10:28,429

با مقداری ردپای ارزش محاسبه شده از

260

00:10:28,429 –> 00:10:30,679

معادله بلمن به این شکل به نظر می رسد. و چند

261

00:10:30,679 –> 00:10:32,449

چیز به هیچ نکته اینجاست که تابع جرم

262

00:10:32,449 –> 00:10:34,399

به ربات کمک میکند تا همیشه

263

00:10:34,399 –> 00:10:36,379

حالتی را انتخاب کند که به او

264

00:10:36,379 –> 00:10:38,749

بیشترین مقدار قرار گرفتن در آن حالت را میدهد،

265

00:10:38,749 –> 00:10:41,359

اکنون گامای ضریب تخفیف به ربات اطلاع میدهد

266

00:10:41,359 –> 00:10:43,669

که چقدر از مقصد فاصله دارد

267

00:10:43,669 –> 00:10:45,769

، این معمولاً

268

00:10:45,769 –> 00:10:48,139

توسط توسعهدهنده مشخص میشود. الگوریتمی که

269

00:10:48,139 –> 00:10:50,779

اکنون در ربات نصب میشود به

270

00:10:50,779 –> 00:10:53,179

حالتهای دیگر نیز میتوان مقادیر مربوطه خود را

271

00:10:53,179 –> 00:10:55,879

به روشی مشابه داد، بنابراین همانطور

272

00:10:55,879 –> 00:10:58,519

که در اینجا میبینید

273

00:10:58,519 –> 00:11:01,279

کادرهای مجاور ربات برنده شدهاند و اگر

274

00:11:01,279 –> 00:11:03,199

از یک فاصله بگیریم، نقطه صفر میگیریم. نه

275

00:11:03,199 –> 00:11:05,209

نقطه صفر هشت یک نقطه صفر هفت

276

00:11:05,209 –> 00:11:07,639

دو نه و در نهایت ما نقطه صفر

277

00:11:07,639 –> 00:11:10,729

شش شش را می خوانیم اکنون ربات اکنون می تواند

278

00:11:10,729 –> 00:11:13,279

مسیر خود را از طریق اتاق سبز با استفاده از

279

00:11:13,279 –> 00:11:15,589

ردپای ارزش DS ادامه دهد، حتی اگر اکنون اگر ربات فرود بیاید

280

00:11:15,589 –> 00:11:17,270

در هر مکان دلخواه

281

00:11:17,270 –> 00:11:19,730

در مکان داده شده افتاده باشد.

282

00:11:19,730 –> 00:11:22,100

در ناحیه آبی آسمانی

283

00:11:22,100 –> 00:11:25,279

مشخص شده، همچنان دو گزینه برای

284

00:11:25,279 –> 00:11:28,190

انتخاب پیدا میکند، اما در نهایت هر یک از

285

00:11:28,190 –> 00:11:30,170

قسمتها به اندازه کافی برای ربات خوب خواهد بود که

286

00:11:30,170 –> 00:11:32,209

به دلیل ارزش

287

00:11:32,209 –> 00:11:34,610

پایه اکنون

288

00:11:34,610 –> 00:11:36,320

مواردی که باید به آن اشاره کنیم این است که معادله بلمن

289

00:11:36,320 –> 00:11:38,270

یکی از معادلات کلیدی

290

00:11:38,270 –> 00:11:40,100

در دنیای یادگیری تقویتی و

291

00:11:40,100 –> 00:11:41,930

یادگیری نشانه ای است، بنابراین اگر

292

00:11:41,930 –> 00:11:44,149

واقع بینانه فکر کنیم محیط اطراف ما

293

00:11:44,149 –> 00:11:46,610

همیشه آنطور که انتظار داریم قدم نمی زند

294

00:11:46,610 –> 00:11:49,010

، همیشه وجود دارد. کمی شهر تصادفی

295

00:11:49,010 –> 00:11:51,649

درگیر آن است، اما این امر در مورد ربات نیز صدق می کند،

296

00:11:51,649 –> 00:11:53,510

گاهی اوقات ممکن است این اتفاق بیفتد

297

00:11:53,510 –> 00:11:56,630

که ماشین آلات ربات خراب شود،

298

00:11:56,630 –> 00:11:59,000

گاهی اوقات ربات ممکن است در

299

00:11:59,000 –> 00:12:01,700

مسیر خود با مانعی روبرو شود که ممکن است

300

00:12:01,700 –> 00:12:03,620

از قبل به درستی از طریق آن مشخص نباشد و

301

00:12:03,620 –> 00:12:06,020

گاهی اوقات حتی اگر ربات می داند

302

00:12:06,020 –> 00:12:08,360

که باید به سمت راست بپیچد، این کار را

303

00:12:08,360 –> 00:12:10,399

نمی کند، پس چگونه

304

00:12:10,399 –> 00:12:12,890

شهر تصادفی را در مورد خود معرفی کنیم،

305

00:12:12,890 –> 00:12:15,680

اکنون فرآیند تصمیم گیری مارکوف فرا می رسد، اکنون در

306

00:12:15,680 –> 00:12:17,570

نظر بگیرید که ربات در حال حاضر در

307

00:12:17,570 –> 00:12:20,029

اتاق قرمز است و باید به سمت سبز برود.

308

00:12:20,029 –> 00:12:20,300

309

00:12:20,300 –> 00:12:23,060

اکنون اجازه دهید در نظر بگیریم که ربات

310

00:12:23,060 –> 00:12:25,040

احتمال کمی از کار افتادن دارد و

311

00:12:25,040 –> 00:12:27,560

ممکن است به جای چرخش بالا به سمت چپ یا راست یا

312

00:12:27,560 –> 00:12:30,079

پایین بپیچد

313

00:12:30,079 –> 00:12:31,850

تا به آن برسد. اتاق سبز

314

00:12:31,850 –> 00:12:33,920

از جایی که اکنون است که اتاق قرمز است،

315

00:12:33,920 –> 00:12:36,410

اکنون سؤال این است که چگونه

316

00:12:36,410 –> 00:12:38,690

ربات را قادر میسازیم تا

317

00:12:38,690 –> 00:12:40,490

وقتی در محیط مشخصی قرار دارد،

318

00:12:40,490 –> 00:12:42,860

319

00:12:42,860 –> 00:12:45,200

از عهده این

320

00:12:45,200 –> 00:12:48,020

کار برآید. گرفته شود تا حدی تصادفی است و بخشی

321

00:12:48,020 –> 00:12:50,510

دیگر کنترل ربات در حال حاضر تا حدی

322

00:12:50,510 –> 00:12:52,700

تصادفی است زیرا ما مطمئن نیستیم که

323

00:12:52,700 –> 00:12:55,010

ذهن ربات دقیقاً چه زمانی کار می کند و

324

00:12:55,010 –> 00:12:57,050

تا حدودی تحت کنترل ربات است

325

00:12:57,050 –> 00:12:59,120

زیرا هنوز تصمیم می گیرد

326

00:12:59,120 –> 00:13:01,399

خودش به سمت راست بپیچد. و

327

00:13:01,399 –> 00:13:03,410

با کمک برنامه ای که در آن تعبیه شده

328

00:13:03,410 –> 00:13:06,079

است، فرآیند تصمیم گیری مارکوف یک

329

00:13:06,079 –> 00:13:08,839

فرآیند کنترل تصادفی گسسته در زمان است

330

00:13:08,839 –> 00:13:11,690

، یک چارچوب ریاضی برای

331

00:13:11,690 –> 00:13:14,060

مدل سازی تصمیم گیری در شرایطی

332

00:13:14,060 –> 00:13:16,339

که نتایج تا حدی تصادفی و

333

00:13:16,339 –> 00:13:18,200

تا حدودی تحت کنترل تصمیم

334

00:13:18,200 –> 00:13:20,930

گیرنده هستند فراهم می کند. اکنون باید به این مفهوم یک

335

00:13:20,930 –> 00:13:23,300

شکل ریاضی بدهیم که به احتمال زیاد

336

00:13:23,300 –> 00:13:26,110

معادله ای است که می توان آن را ادامه داد،

337

00:13:26,110 –> 00:13:29,449

اکنون ممکن است تعجب کنید که ما می

338

00:13:29,449 –> 00:13:30,920

توانیم این کار را با کمک t انجام دهیم. او

339

00:13:30,920 –> 00:13:33,740

معادله را با چند تغییر جزئی انجام داد، بنابراین

340

00:13:33,740 –> 00:13:35,420

اگر به معادله بلمن اصلی نگاهی بیندازیم

341

00:13:35,420 –> 00:13:37,880

V از X برابر است با حداکثر

342

00:13:37,880 –> 00:13:41,870

کامای ما A به اضافه گامای V از s – چه چیزی

343

00:13:41,870 –> 00:13:43,490

باید در معادله بالا تغییر

344

00:13:43,490 –> 00:13:45,620

کند تا بتوانیم معرفی کنیم.

345

00:13:45,620 –> 00:13:48,380

مقدار بیشتری تصادفی در اینجا تا

346

00:13:48,380 –> 00:13:50,389

زمانی که مطمئن نباشیم ربات چه زمانی ممکن

347

00:13:50,389 –> 00:13:52,850

است چرخش مورد انتظار را انجام

348

00:13:52,850 –> 00:13:55,160

ندهد، همچنین مطمئن نیستیم که در کدام اتاق ممکن است به پایان

349

00:13:55,160 –> 00:13:57,829

برسد که چیزی جز اتاقی نیست که

350

00:13:57,