در این مطلب، ویدئو آموزش عمیق یادگیری پایتون، تنسورفلو و کراس: مقدمه و نصب با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:06:23

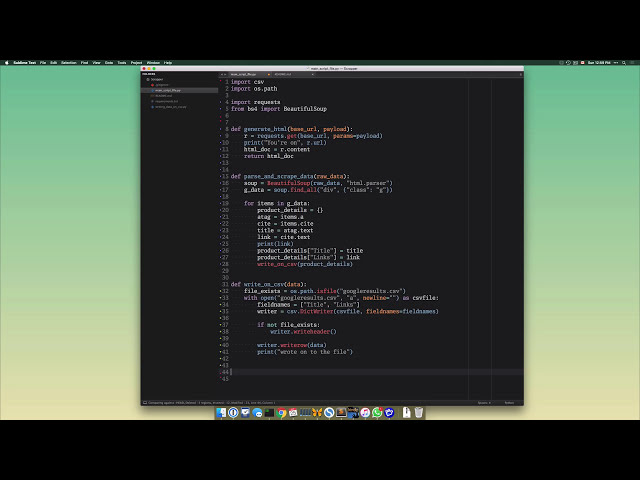

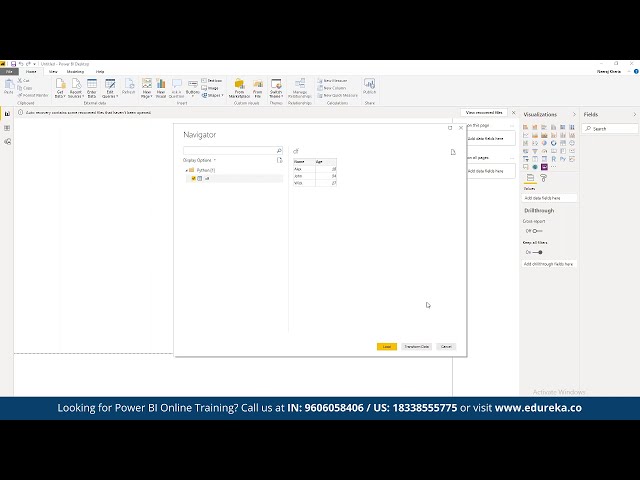

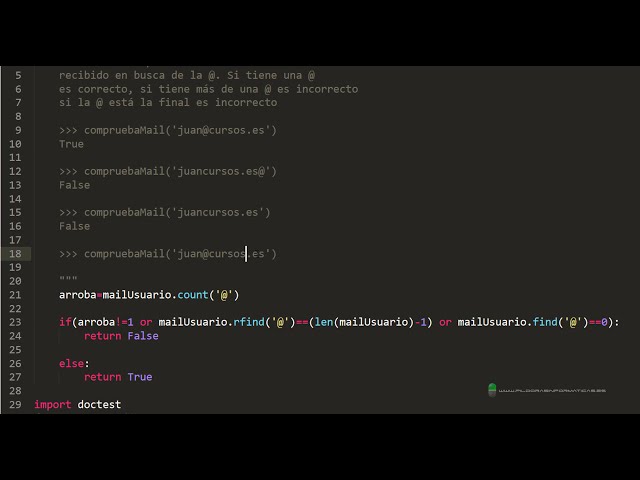

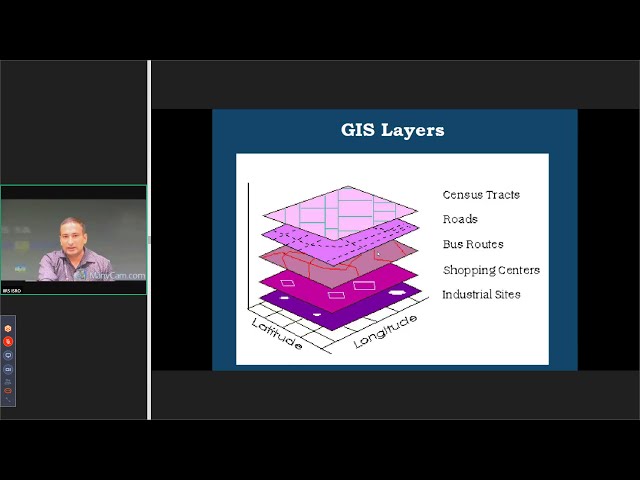

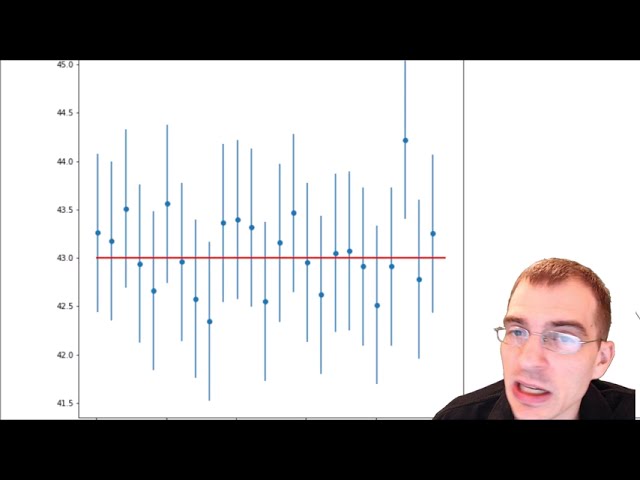

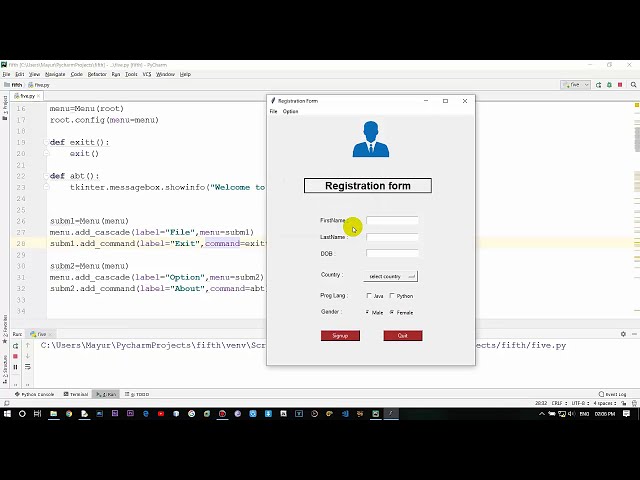

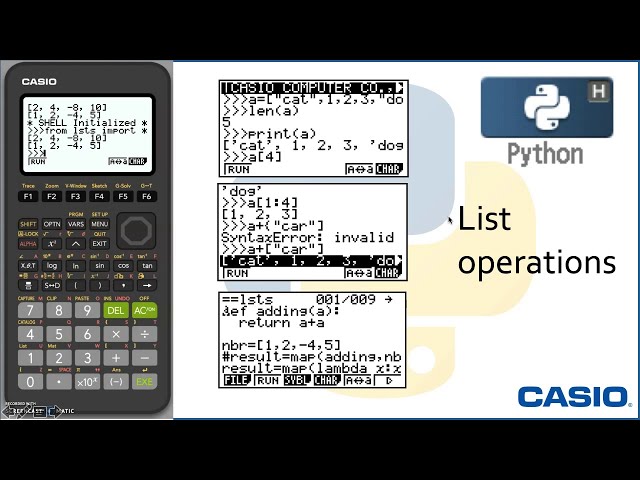

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,080 –> 00:00:02,159

سلام دوستان، من هیجان زده هستم که

2

00:00:02,159 –> 00:00:04,240

شروع سری آموزش های یادگیری عمیق خود را

3

00:00:04,240 –> 00:00:07,120

با استفاده از کتابخانه keras python اعلام کنم،

4

00:00:07,120 –> 00:00:09,360

اکنون وقتی به الگوریتم های یادگیری ماشین نگاه می کنید،

5

00:00:09,360 –> 00:00:10,960

می توان آنها را به

6

00:00:10,960 –> 00:00:13,280

طور کلی به دو دسته تقسیم کرد،

7

00:00:13,280 –> 00:00:15,440

یکی مدل های ریاضی،

8

00:00:15,440 –> 00:00:18,320

دومی تکنیک های یادگیری عمیق تا کنون

9

00:00:18,320 –> 00:00:19,600

هر چه باشد. ما

10

00:00:19,600 –> 00:00:22,000

تمام آن تکنیکهای رگرسیون خطی درخت تصمیم svm را آموختهایم که

11

00:00:22,000 –> 00:00:23,920

مبتنی

12

00:00:23,920 –> 00:00:26,160

بر مدلهای ریاضی بودند.

13

00:00:26,160 –> 00:00:29,439

تکنیکهای یادگیری عمیق

14

00:00:29,439 –> 00:00:31,439

از روشی که مغز انسان کار میکند الهام

15

00:00:31,439 –> 00:00:33,200

16

00:00:33,200 –> 00:00:37,200

17

00:00:37,200 –> 00:00:39,760

18

00:00:39,760 –> 00:00:40,640

گرفته شده است.

19

00:00:40,640 –> 00:00:44,239

سیناپسها و سیگنال شیمیایی

20

00:00:44,239 –> 00:00:45,520

از سیناپسها عبور میکند

21

00:00:45,520 –> 00:00:48,079

و این نورونها شلیک میشوند و اینگونه است که

22

00:00:48,079 –> 00:00:48,719

23

00:00:48,719 –> 00:00:51,920

انسان تصمیم میگیرد یا چیزهای مختلفی یاد میگیرد،

24

00:00:51,920 –> 00:00:53,280

25

00:00:53,280 –> 00:00:56,160

وقتی چیزهای مختلف را یاد میگیریم این

26

00:00:56,160 –> 00:00:58,239

ارتباطات قویتر یا

27

00:00:58,239 –> 00:01:00,079

ضعیفتر میشوند و بر اساس

28

00:01:00,079 –> 00:01:02,480

آن کیفیت تصمیم شما را تعیین میکند.

29

00:01:02,480 –> 00:01:05,360

شبکه های عصبی مصنوعی

30

00:01:05,360 –> 00:01:07,280

از این عملکرد اساسی در اینجا الهام گرفته شده اند

31

00:01:07,280 –> 00:01:10,000

32

00:01:10,000 –> 00:01:11,600

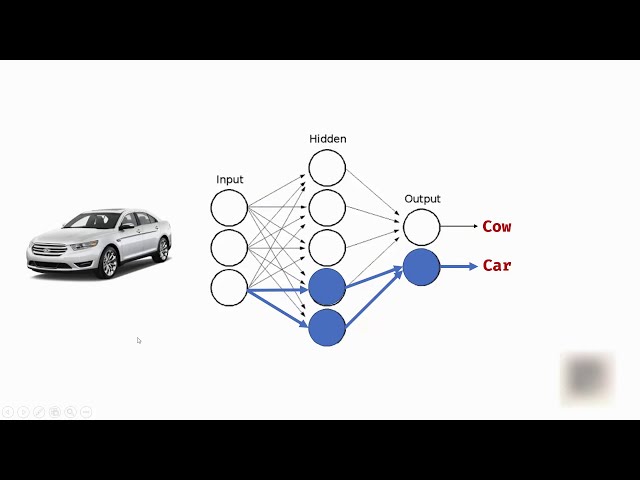

مدل شبکه عصبی بسیار ساده است

33

00:01:11,600 –> 00:01:13,920

همانطور که در تصویر می بینید دارای

34

00:01:13,920 –> 00:01:14,960

لایه پنهان

35

00:01:14,960 –> 00:01:17,119

لایه ورودی است و لایه خروجی می

36

00:01:17,119 –> 00:01:19,600

تواند بیش از یک

37

00:01:19,600 –> 00:01:21,439

لایه پنهان وجود داشته

38

00:01:21,439 –> 00:01:23,600

39

00:01:23,600 –> 00:01:26,880

باشد. نورونها

40

00:01:26,880 –> 00:01:28,640

فرض کنید میخواهید از این

41

00:01:28,640 –> 00:01:31,040

شبکه عصبی برای شناسایی تصویر استفاده

42

00:01:31,040 –> 00:01:32,799

کنید، میخواهید بدانید که آیا تصویر دادهشده مربوط به

43

00:01:32,799 –> 00:01:35,040

یک ماشین است یا یک

44

00:01:35,040 –> 00:01:38,240

گاو، روشی که کار میکند، ابتدا

45

00:01:38,240 –> 00:01:39,520

46

00:01:39,520 –> 00:01:41,680

شبکه عصبی را آموزش میدهید و سپس از

47

00:01:41,680 –> 00:01:42,880

شبکه آموزشدیده استفاده میکنید.

48

00:01:42,880 –> 00:01:45,200

ایجاد محافظت بنابراین در مرحله آموزش

49

00:01:45,200 –> 00:01:48,000

تصویری از یک گاو را احساس خواهید کرد

50

00:01:48,000 –> 00:01:51,360

و با استفاده از برخی الگوریتم ها

51

00:01:51,360 –> 00:01:55,119

به نوعی این مسیرها

52

00:01:55,119 –> 00:01:55,520

از

53

00:01:55,520 –> 00:01:59,439

ورودی به خروجی ایجاد می شود و این رنگ های آبی

54

00:01:59,439 –> 00:02:01,759

به این معنی است که این نورون ها شلیک می شوند و

55

00:02:01,759 –> 00:02:04,320

وزن این سیناپس ها یا لبه

56

00:02:04,320 –> 00:02:07,360

ها تنظیم می شوند. اکنون کمی بعداً به آن الگوریتمها نگاه خواهیم کرد

57

00:02:07,360 –> 00:02:08,000

58

00:02:08,000 –> 00:02:10,399

زیرا زمینه یادگیری عمیق

59

00:02:10,399 –> 00:02:11,680

آنقدر وسیع است

60

00:02:11,680 –> 00:02:14,000

که اگر به ریاضیات

61

00:02:14,000 –> 00:02:15,520

و تئوری پشت آن

62

00:02:15,520 –> 00:02:18,080

بپردازیم، نمیتوانیم ستاره کنیم. کدنویسی ما

63

00:02:18,080 –> 00:02:18,560

مشکلی ندارد،

64

00:02:18,560 –> 00:02:20,720

بنابراین میخواهم آن را بسیار مختصر بگویم و اگر

65

00:02:20,720 –> 00:02:21,840

میخواهید بیشتر

66

00:02:21,840 –> 00:02:25,120

وارد نظریه شوید، میتوانید با من تحمل کنید و

67

00:02:25,120 –> 00:02:28,319

ما آن را بعداً انجام خواهیم داد یا میتوانید مطالب دیگری را بخوانید

68

00:02:28,319 –> 00:02:30,640

، اما فقط تصور کنید

69

00:02:30,640 –> 00:02:31,760

که شما

70

00:02:31,760 –> 00:02:35,200

دو پایان دارید. امتیازها و شما به نوعی

71

00:02:35,200 –> 00:02:38,720

این مسیرها را با دادن

72

00:02:38,720 –> 00:02:39,760

تصویر یک گاو

73

00:02:39,760 –> 00:02:42,319

خوب ایجاد می کنید، بنابراین مرحله تمرین شما همین

74

00:02:42,319 –> 00:02:43,120

75

00:02:43,120 –> 00:02:45,280

اتفاق می افتد زمانی که تصویر دیگری از یک

76

00:02:45,280 –> 00:02:46,239

گاو می دهید برخی

77

00:02:46,239 –> 00:02:48,239

وزن های دیگر تنظیم می شوند و

78

00:02:48,239 –> 00:02:51,280

مسیرهای دیگری

79

00:02:51,280 –> 00:02:54,400

از ورودی به خروجی ایجاد می شود.

80

00:02:54,400 –> 00:02:56,640

همین اتفاق برای خودرویی میافتد که در آن میتوانید

81

00:02:56,640 –> 00:02:58,879

82

00:02:58,879 –> 00:03:01,360

مجموعهای از سیناپسها و نورونها

83

00:03:01,360 –> 00:03:01,920

84

00:03:01,920 –> 00:03:04,560

را مشاهده کنید که پس از آموزش شبکه عصبی شما مسیرهای متفاوتی ایجاد میشود،

85

00:03:04,560 –> 00:03:06,879

86

00:03:06,879 –> 00:03:10,239

اکنون میتوانید هر تصویر ورودی uh را تغذیه کنید

87

00:03:10,239 –> 00:03:11,680

و به شما بگوید که ماشین است

88

00:03:11,680 –> 00:0