در این مطلب، ویدئو آموزش پردازش زبان طبیعی | پایتون پردازش زبان طبیعی | آموزش NLP با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:25:23

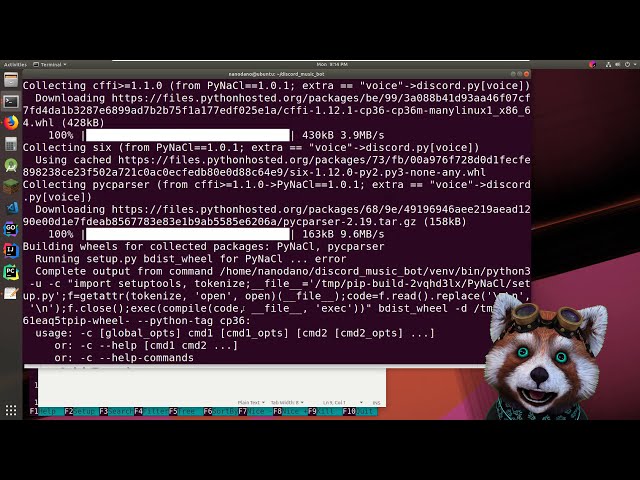

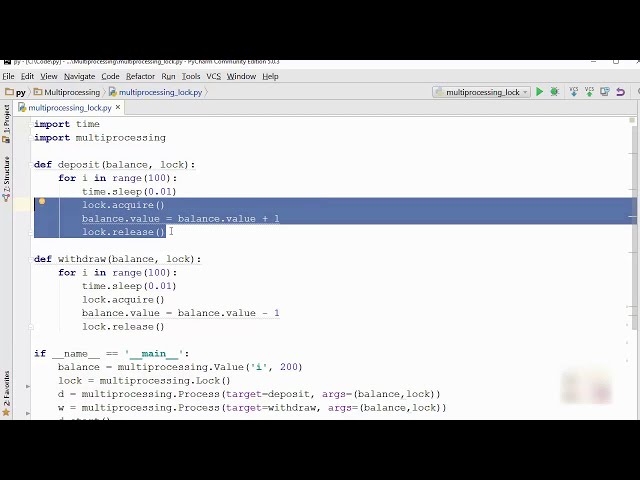

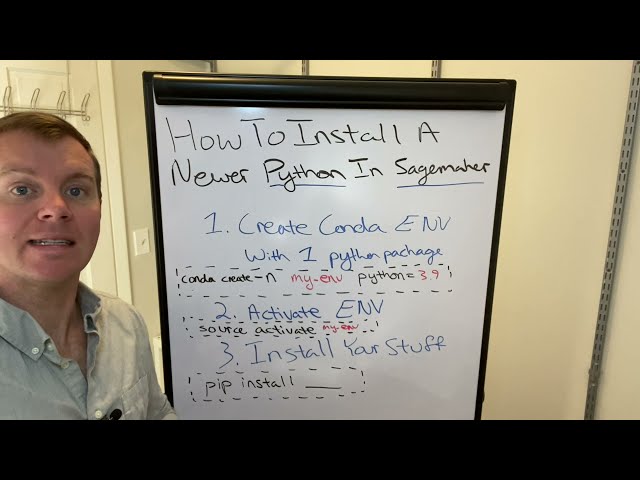

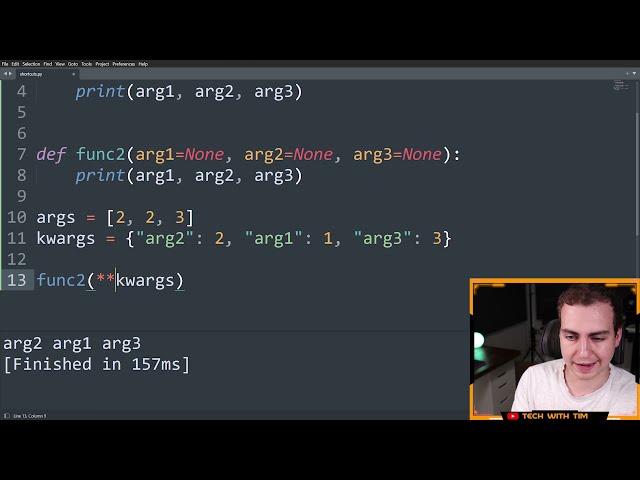

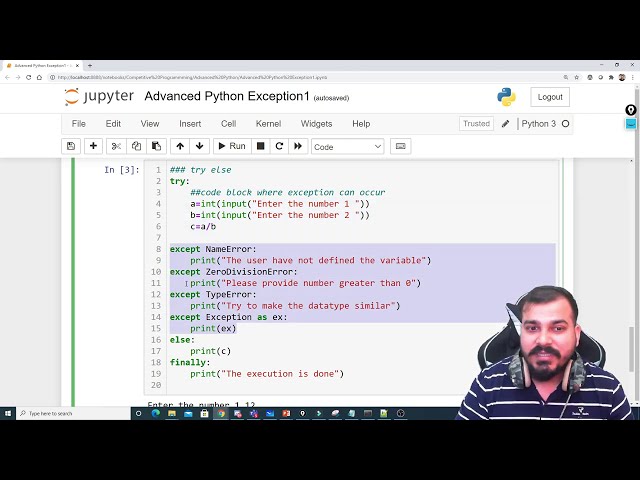

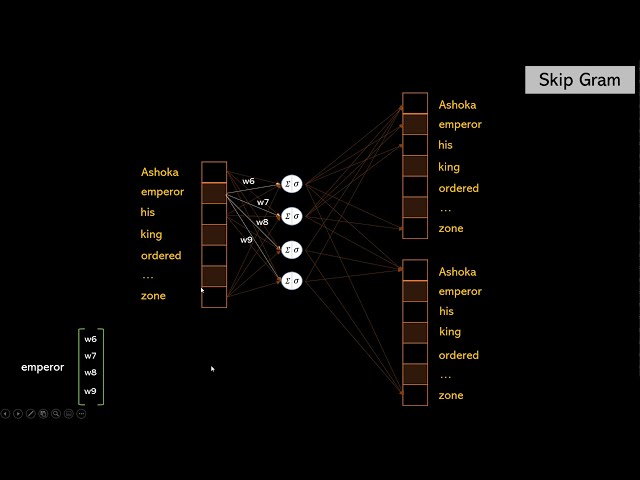

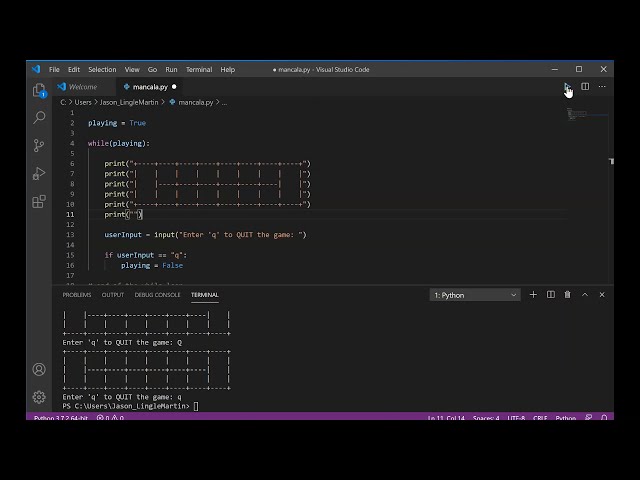

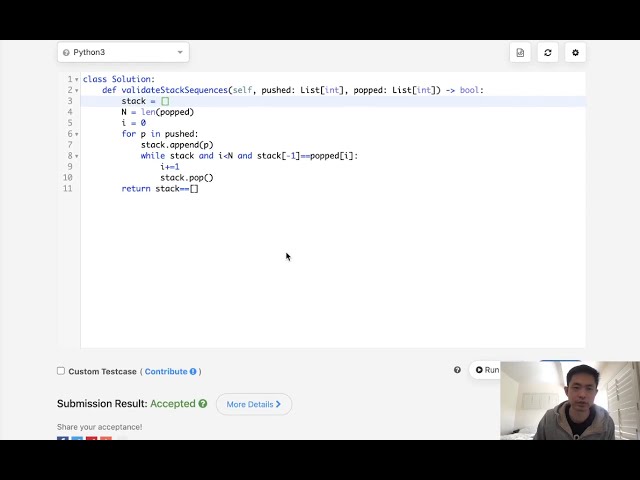

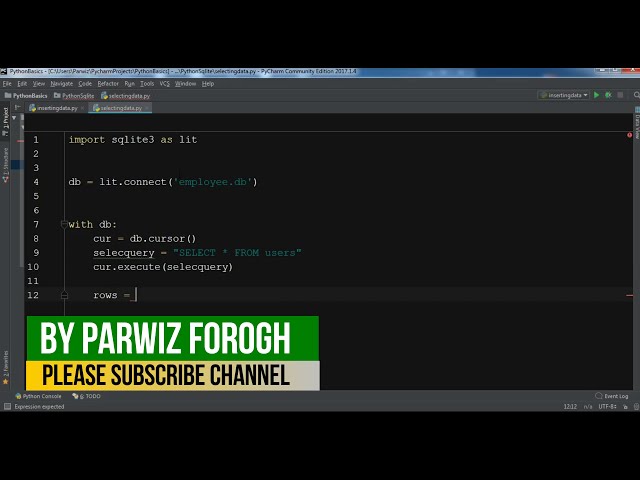

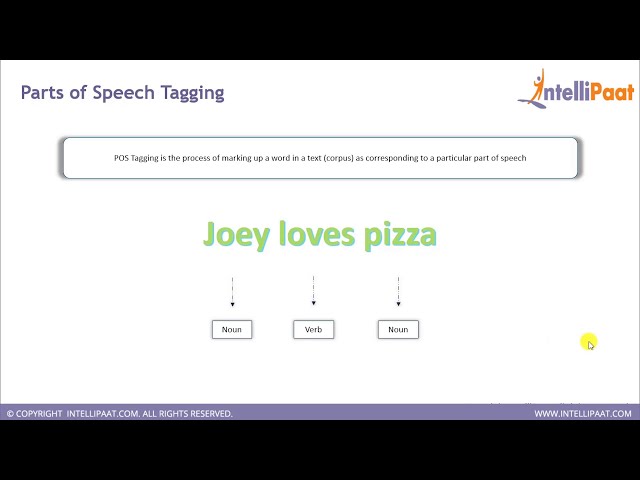

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,180 –> 00:00:03,280

[موسیقی]

2

00:00:04,370 –> 00:00:06,990

سلام بچه ها به جلسه

3

00:00:06,990 –> 00:00:09,630

پردازش زبان طبیعی امروز خوش آمدید،

4

00:00:09,630 –> 00:00:11,639

ما با درک اینکه NLP دقیقاً کجاست شروع می کنیم،

5

00:00:11,639 –> 00:00:13,860

سپس متوجه خواهیم شد که

6

00:00:13,860 –> 00:00:16,379

توکن سازی چیست و کلمات توکن شده او را

7

00:00:16,379 –> 00:00:19,199

با یک بسته LD k

8

00:00:19,199 –> 00:00:20,970

یاد می گیریم پس از آن با موارد مختلف آشنا خواهیم شد. مفاهیمی در

9

00:00:20,970 –> 00:00:24,600

NLP مانند تعیین محدودیتهای ریشهای

10

00:00:24,600 –> 00:00:27,090

برچسبگذاری POS و شناسایی موجودیت نامگذاری شده و

11

00:00:27,090 –> 00:00:30,810

پیادهسازی هر یک از آنها با استفاده از NL DK به

12

00:00:30,810 –> 00:00:33,000

خوبی با یک بسته فضایی برای

13

00:00:33,000 –> 00:00:35,969

پیادهسازی برخی از مفاهیم NLP کار میکنند و در

14

00:00:35,969 –> 00:00:38,040

نهایت یک مسابقه برای جمعبندی هر چیزی که یاد گرفتهایم وجود خواهد داشت.

15

00:00:38,040 –> 00:00:40,980

در جلسه امروز، اجازه

16

00:00:40,980 –> 00:00:42,809

دهید با طرح یک سوال بسیار ساده شروع کنم.

17

00:00:42,809 –> 00:00:45,539

18

00:00:45,539 –> 00:00:48,480

19

00:00:48,480 –> 00:00:51,809

20

00:00:51,809 –> 00:00:54,960

21

00:00:54,960 –> 00:00:57,590

22

00:00:57,590 –> 00:01:00,840

زبانهای

23

00:01:00,840 –> 00:01:03,300

متعددی که بهطور طبیعی در انسانها

24

00:01:03,300 –> 00:01:05,610

از طریق استفاده و تکرار بدون

25

00:01:05,610 –> 00:01:08,100

برنامهریزی آگاهانه تکامل یافتهاند، اکنون میتوانند به عنوان زبان طبیعی نامیده شوند،

26

00:01:08,100 –> 00:01:10,920

زیرا شما انسان هستید،

27

00:01:10,920 –> 00:01:13,110

ما میتوان این زبانها را درک کرد،

28

00:01:13,110 –> 00:01:15,659

اما در مورد ماشینی که

29

00:01:15,659 –> 00:01:19,049

همان زبانها به یک ماشین داده میشود،

30

00:01:19,049 –> 00:01:21,570

میتواند آنها را درک کند، بنابراین پردازش زبان طبیعی به این صورت است،

31

00:01:21,570 –> 00:01:23,939

32

00:01:23,939 –> 00:01:26,759

بنابراین پردازش زبان طبیعی

33

00:01:26,759 –> 00:01:28,619

توانایی برنامههای کامپیوتری برای

34

00:01:28,619 –> 00:01:31,710

درک است. و زبان انسان را

35

00:01:31,710 –> 00:01:34,979

همانطور که صحبت می شود تفسیر کنید به عبارت دیگر NLP

36

00:01:34,979 –> 00:01:36,930

برای به دست آوردن دانش از

37

00:01:36,930 –> 00:01:40,740

جزر و مد T متنی خام یا دفع استفاده می شود، حال اجازه دهید به

38

00:01:40,740 –> 00:01:42,450

جلو برویم و اجزای NLP را بررسی

39

00:01:42,450 –> 00:01:45,509

کنیم تا NLP اساساً به

40

00:01:45,509 –> 00:01:47,430

درک

41

00:01:47,430 –> 00:01:50,250

زبان طبیعی و تولید زبان طبیعی تقسیم شود. بنابراین

42

00:01:50,250 –> 00:01:51,299

بیایید با درک زبان طبیعی شروع

43

00:01:51,299 –> 00:01:54,540

کنیم، بنابراین NLU به عنوان نام

44

00:01:54,540 –> 00:01:57,450

ایالات، با درک ورودی داده شده

45

00:01:57,450 –> 00:02:00,149

در قالب جملات در قالب متن یا

46

00:02:00,149 –> 00:02:02,369

گفتار سر و کار دارد و اینجاست که

47

00:02:02,369 –> 00:02:04,560

دستگاه جنبههای مختلف زبان را تجزیه و تحلیل میکند،

48

00:02:04,560 –> 00:02:07,409

سپس ما تولید زبان طبیعی داریم،

49

00:02:07,409 –> 00:02:10,500

بنابراین انرژی به آن میپردازد. با

50

00:02:10,500 –> 00:02:13,290

تبدیل داده های خام به زبان ساده و

51

00:02:13,290 –> 00:02:15,569

قابل فهم یا به

52

00:02:15,569 –> 00:02:18,120

عبارت دیگر تولید زبان طبیعی از

53

00:02:18,120 –> 00:02:21,090

در حال حاضر ورودی خام برای پیاده سازی مفاهیم NLP

54

00:02:21,090 –> 00:02:23,640

به بسته هایی نیاز دارید

55

00:02:23,640 –> 00:02:25,349

که برای پردازش زبان طبیعی طراحی شده اند

56

00:02:25,349 –> 00:02:27,989

، بنابراین در جلسه امروز

57

00:02:27,989 –> 00:02:30,450

ما با دو بسته از این دست که یک

58

00:02:30,450 –> 00:02:34,140

کلید و گونه LD هستند کار خواهیم کرد، بنابراین به طور کلی اولین

59

00:02:34,140 –> 00:02:36,900

گام در فرآیند NLP سازماندهی است.

60

00:02:36,900 –> 00:02:39,599

زمانی که توکنسازی اساساً

61

00:02:39,599 –> 00:02:42,620

X را به واحدهای جداگانه تقسیم میکند و هر

62

00:02:42,620 –> 00:02:45,450

واحد جداگانه باید دارای یک مقدار

63

00:02:45,450 –> 00:02:46,590

مرتبط با آن باشد،

64

00:02:46,590 –> 00:02:49,079

بنابراین بیایید این مثال را در نظر بگیریم، یک جمله داریم که

65

00:02:49,079 –> 00:02:51,959

جوی پیتزا را به اشتراک نمیگذارد و ما

66

00:02:51,959 –> 00:02:53,700

این را به توکنهای جداگانه تقسیم میکنیم

67

00:02:53,700 –> 00:02:57,060

که هر کدام از آنها گرفته شود. به عنوان یک

68

00:02:57,060 –> 00:03:00,659

نشانه جداگانه و همچنین

69

00:03:00,659 –> 00:03:03,269

علائم تعجب، اما آنها می توانند نشانه های جداگانه ای داشته باشند، اکنون

70

00:03:03,269 –> 00:03:05,579

می توانیم از این نشانه ها برای

71

00:03:05,579 –> 00:03:08,519

فرآیند دیگری مانند تجزیه یا متن کاوی استفاده کنیم،

72

00:03:08,519 –> 00:03:10,799

بنابراین بیایید در واقع به یک

73

00:03:10,799 –> 00:03:13,200

دفترچه یادداشت مشتری برویم و یاد بگیریم که چگونه یک

74

00:03:13,200 –> 00:03:15,720

جمله را با استفاده از بسته تحلیلی a نشانه گذاری کنیم. بنابراین

75

00:03:15,720 –> 00:03:18,599

ما کار را با وارد کردن یک l TK و

76

00:03:18,599 –> 00:03:22,139

یک پیکره نقطه LD k شروع می کنیم. این کار را بعد از

77

00:03:22,139 –> 00:03:23,609

آن اجرا می کنم و به کلمه

78

00:03:23,609 –> 00:03:26,220

زیر خط تابع نشانه گذاری شده نیاز داریم.

79

00:03:26,220 –> 00:03:29,220

بسته NLP K dot tokenize بنابراین ما نیز

80

00:03:29,220 –> 00:03:31,560

این تابع را از پنالتی وارد می کنیم. او dot

81

00:03:31,560 –> 00:03:34,530

tokenize من روی run کلیک می کنم، بنابراین در اینجا

82

00:03:34,530 –> 00:03:37,109

یک رشته داریم، بنابراین پس از غافلگیری

83

00:03:37,109 –> 00:03:38,819

میزبان در آزمایش اول، سریلانکا یک

84

00:03:38,819 –> 00:03:41,129

ستاره مثبت به آزمایش دوم داد.

85

00:03:41,129 –> 00:03:43,829

این تمام رشته در اینجاست و من

86

00:03:43,829 –> 00:03:46,319

آن را در یک شی به نام کریکت ذخیره می کنم و

87

00:03:46,319 –> 00:03:49,709

اکنون کاری که انجام می دهم این است که این

88

00:03:49,709 –> 00:03:53,760

شی را در داخل تابع کلمه tokenize قرار می

89

00:03:53,760 –> 00:03:56,989

دهم و نتیجه را در

90

00:03:56,989 –> 00:04:00,000

نشانه های زیر خط کریکت ذخیره می کنم و چاپ خواهم کرد.

91

00:04:00,000 –> 00:04:02,220

پس این قسمتی است که در آن ما

92

00:04:02,220 –> 00:04:04,859

اساساً کل

93

00:04:04,859 –> 00:04:07,979

رشته را به توکن های جداگانه با

94

00:04:07,979 –> 00:04:10,169

کمک این کلمه underscore tokenize تبدیل

95

00:04:10,169 –> 00:04:13,349

می کنیم، بنابراین من روی run right کلیک می کنم تا

96

00:04:13,349 –> 00:04:15,389

ببینیم که کل این رشته

97

00:04:15,389 –> 00:04:18,418

به توکن های جداگانه تقسیم می شود. به عنوان یکی از

98

00:04:18,418 –> 00:04:21,750

نشانههای شگفتانگیز استوکین استوکین

99

00:04:21,750 –> 00:04:23,849

که توکنها است، پس دوباره از کل این

100

00:04:23,849 –> 00:04:25,430

رشته و

101

00:04:25,430 –> 00:04:28,940

آن را به توکنهای جداگانه تبدیل کردهایم، نه پس از

102

00:04:28,940 –> 00:04:31,070

انجام آن، اجازه دهید نگاهی

103

00:04:31,070 –> 00:04:33,050

به نوع آنها و تعداد

104

00:04:33,050 –> 00:04:36,410

توکنهای w داشته باشیم. اگر روی run کلیک می کنم، پس ببینید

105

00:04:36,410 –> 00:04:38,660

که این لیستی از تمام ژتون ها است

106

00:04:38,660 –> 00:04:42,229

و ما در مجموع دویست و یک و دو قوطی داریم،

107

00:04:42,229 –> 00:04:44,870

حالا بیایید فرکانس این توکن ها را هم دریافت کنیم،

108

00:04:44,870 –> 00:04:47,810

من می خواهم

109

00:04:47,810 –> 00:04:50,470

تعداد دفعات هر کدام را بفهمم.

110

00:04:50,470 –> 00:04:53,840

مقدار توکن رخ می دهد و برای آن من

111

00:04:53,840 –> 00:04:56,720

به آزمایش فرکانس از یک

112

00:04:56,720 –> 00:04:59,330

بسته احتمال LD KDOT نیاز دارم، بنابراین من این را وارد می

113

00:04:59,330 –> 00:05:02,060

کنم و نمونه ای از

114

00:05:02,060 –> 00:05:05,600

آن را با نام fdisk

115

00:05:05,600 –> 00:05:08,630

دوباره ایجاد می کنم و اکنون یک حلقه for ایجاد می کنم که

116

00:05:08,630 –> 00:05:11,750

این من است. ارزش در

117

00:05:11,750 –> 00:05:16,430

تمام توکنها با آن مبارزه میکند و برای هر توکن

118

00:05:16,430 –> 00:05:19,639

من به اضافه کردن تعداد آنها در هر کجا که با آن برخورد میشود ادامه

119

00:05:19,639 –> 00:05:22,520

میدهم و در نهایت آن را چاپ میکنم

120

00:05:22,520 –> 00:05:25,639

که F است، فقط برای اینکه

121

00:05:25,639 –> 00:05:28,220

فرکانس همه توکنها را در اینجا دریافت کنم، بنابراین

122

00:05:28,220 –> 00:05:30,830

ببینید که یازده بار گاما

123

00:05:30,830 –> 00:05:33,740

رخ می دهد T بار e شش بار

124

00:05:33,740 –> 00:05:36,050

رخ می دهد برای رخ می دهد شش بار در جنوب و آفریقا پنج

125

00:05:36,050 –> 00:05:37,699

بار درست است، بنابراین این اساساً

126

00:05:37,699 –> 00:05:39,849

توزیع فرکانس همه توکن ها است

127

00:05:39,849 –> 00:05:42,710

اکنون اگر بخواهم ده

128

00:05:42,710 –> 00:05:45,800

توکن رایج را پیدا کنم، پس من رایج ترین آن را دارم.

129

00:05:45,800 –> 00:05:49,310

تابع on بنابراین من F nest dot

130

00:05:49,310 –> 00:05:51,229

رایجترین را صدا میزنم و

131

00:05:51,229 –> 00:05:53,300

پارامتری که ده است را ارسال

132

00:05:53,300 –> 00:05:55,550

میکنم، بنابراین ده توکن رایج را به من میدهد و

133

00:05:55,550 –> 00:05:57,470

آن را در ده بالا ذخیره میکنم و آن را چاپ

134

00:05:57,470 –> 00:06:00,470

میکنم و روی آن کلیک میکنم. اجرا کنید، بنابراین این ده

135

00:06:00,470 –> 00:06:03,080

رایجترین نشانهها

136

00:06:03,080 –> 00:06:06,349

137

00:06:06,349 –> 00:06:09,020

138

00:06:09,020 –> 00:06:11,180

139

00:06:11,180 –> 00:06:13,820

هستند.

140

00:06:13,820 –> 00:06:15,080

141

00:06:15,080 –> 00:06:17,780

142

00:06:17,780 –> 00:06:19,639

کلمه در آن زمان

143

00:06:19,639 –> 00:06:22,750

ممکن است نتواند معنای یک جمله را به طور کامل درک

144

00:06:22,750 –> 00:06:25,789

کند و اینکه این

145

00:06:25,789 –> 00:06:28,699

کلمات وقتی یکی یکی داده می شوند به

146

00:06:28,699 –> 00:06:30,979

عنوان رمپ های منحصر به فرد شناخته می شوند، بنابراین بیایید این

147

00:06:30,979 –> 00:06:33,050

زبان را در اینجا ببریم من عاشق زبان طبیعی هستم

148

00:06:33,050 –> 00:06:35,719

و وقتی هر یک از این نشانه

149

00:06:35,719 –> 00:06:38,270

ها داده می شود یکی در یک زمان به ماشین

150

00:06:38,270 –> 00:06:39,020

151

00:06:39,020 –> 00:06:42,139

این چیزی نیست جز یک یونیگرام.

152

00:06:42,139 –> 00:06:44,509

153

00:06:44,509 –> 00:06:47,180

154

00:06:47,180 –> 00:06:49,370

155

00:06:49,370 –> 00:06:52,039

او

156

00:06:52,039 –> 00:06:55,639

یک بیگرام است من عاشق زبان طبیعی طبیعی هستم،

157

00:06:55,639 –> 00:06:58,159

بنابراین کل این جمله

158

00:06:58,159 –> 00:07:01,460

اساساً به صورت دو

159

00:07:01,460 –> 00:07:04,069

نشانه در یک زمان داده می شود و به طور مشابه وقتی

160

00:07:04,069 –> 00:07:06,139

کل جمله در یک زمان سه کلمه داده

161

00:07:06,139 –> 00:07:08,990

می شود به عنوان یک سه ضلعی شناخته

162

00:07:08,990 –> 00:07:11,030

می شود. به این صورت تقسیم شده است I love

163

00:07:11,030 –> 00:07:13,490

natural یک قسمت است و سپس ما

164

00:07:13,490 –> 00:07:16,069

عاشق زبان طبیعی هستیم، بنابراین

165

00:07:16,069 –> 00:07:18,169

این نموداری است که در اینجا داریم، پس

166

00:07:18,169 –> 00:07:20,240

بیایید دوباره به استودیوی Jupiter برگردیم

167

00:07:20,240 –> 00:07:22,729

و یاد بگیریم که چگونه نمودارها و تریگرام ها را ایجاد کنیم،

168

00:07:22,729 –> 00:07:25,400

بنابراین در اینجا این جمله را داریم.

169

00:07:25,400 –> 00:07:27,949

به شما بگویم که یک برجی وجود دارد که آنها

170

00:07:27,949 –> 00:07:29,870

به سمت زمین نگاه می کنند تا مردم را ببینند که به سرعت

171

00:07:29,870 –> 00:07:32,750

از آنجا می گذرند و من این را در دود سیاه ذخیره می

172

00:07:32,750 –> 00:07:34,759

کنم بنابراین فقط سریع ضربه می زنم و می دوم

173

00:07:34,759 –> 00:07:38,030

اکنون این جمله را

174

00:07:38,030 –> 00:07:40,340

با کمک کلمه tokenize function

175

00:07:40,340 –> 00:07:42,650

و I این نتیجه را در توکن دود سیاه ذخیره میکند

176

00:07:42,650 –> 00:07:46,069

و سپس آن را چاپ میکنم،

177

00:07:46,069 –> 00:07:49,130

روی run کلیک میکنم، بنابراین

178

00:07:49,130 –> 00:07:51,680

179

00:07:51,680 –> 00:07:54,740

اگر بخواهم

180

00:07:54,740 –> 00:07:57,680

بر حسب گرم و سهگرم از این

181

00:07:57,680 –> 00:08:01,009

ما ایجاد کنیم، این نشانههای منفرد از کل این جمله هستند که اکنون در اینجا داریم. نمودارهای NLD K نقطه و یک

182

00:08:01,009 –> 00:08:04,310

تابع سه گانه LD Couture را داشته باشید، بنابراین من از

183

00:08:04,310 –> 00:08:07,490

این تابع نمودارهای نقطه ای n LT K استفاده می کنم و

184

00:08:07,490 –> 00:08:11,060

سپس این نشانه های فردی را

185

00:08:11,060 –> 00:08:13,909

در داخل این تابع به درستی ارسال می کنم، بنابراین من

186

00:08:13,909 –> 00:08:17,000

این شی نشانه دود سیاه را به

187

00:08:17,000 –> 00:08:19,940

داخل تابع نمودارهای نقطه ای NLD ارسال می کنم.

188

00:08:19,940 –> 00:08:22,550

و من میخواهم نتیجه را در

189

00:08:22,550 –> 00:08:26,120

قالب یک لیست ببینم، بنابراین روی run کلیک میکنم، بنابراین اکنون

190

00:08:26,120 –> 00:08:28,219

این نشانهها

191

00:08:28,219 –> 00:08:30,409

به شکل نمودار نشان داده میشوند.

192

00:08:30,409 –> 00:08:32,809

193

00:08:32,809 –> 00:08:34,789

194

00:08:34,789 –> 00:08:36,979

شکل تریگرام من

195

00:08:36,979 –> 00:08:39,649

از تابع NLD K dot trigrams استفاده می کنم و

196

00:08:39,649 –> 00:08:42,380

سپس در این شی که

197

00:08:42,380 –> 00:08:45,320

نشانه دود سیاه است دوباره عبور می دهم. من روی run ضربه می زنم اکنون ما

198

00:08:45,320 –> 00:08:46,250

تریگرام داریم

199

00:08:46,250 –> 00:08:48,110

آیا می دانید که می دانید درست بود

200

00:08:48,110 –> 00:08:49,290

201

00:08:49,290 –> 00:08:51,480

و در نهایت ما یک چیز شناخته شده داریم همانطور که

202

00:08:51,480 –> 00:08:54,509

engrams، بنابراین engrams اساسا یک

203

00:08:54,509 –> 00:08:57,000

پارامتر اضافی در اینجا دارد، بنابراین اگر

204

00:08:57,000 –> 00:08:58,980

من چهار کلمه را با هم بخواهم،

205

00:08:58,980 –> 00:09:00,660

اگر پنج کلمه را با هم

206

00:09:00,660 –> 00:09:01,529

بخواهم، پنج کلمه را به

207

00:09:01,529 –> 00:09:02,940

طور مشابه قرار می دهم اگر ده کلمه را با هم

208

00:09:02,940 –> 00:09:05,459

بخواهم، فقط می گذارم در ده در اینجا، بنابراین برای

209

00:09:05,459 –> 00:09:07,470

آن باید از تابع NLD K dot

210

00:09:07,470 –> 00:09:09,779

engrams استفاده کنم و اولین پارامتر

211

00:09:09,779 –> 00:09:12,060

داخل آن لیست نشانهها خواهد بود و

212

00:09:12,060 –> 00:09:14,610

بعد از آن پارامتری که

213

00:09:14,610 –> 00:09:16,560

تعداد رایها را با هم به ما میگوید و

214

00:09:16,560 –> 00:09:18,389

این بار میخواهم چهار کلمه را

215

00:09:18,389 –> 00:09:20,339

با هم ببینید من در چهار قرار میدهم و سپس

216

00:09:20,339 –> 00:09:22,410

روی run all right کلیک میکنم، بنابراین آنچه در اینجا

217

00:09:22,410 –> 00:09:23,699

ما چهار کلمه با هم داریم،

218

00:09:23,699 –> 00:09:26,670

بنابراین اکنون بیایید ریشهیابی را بفهمیم بنابراین

219

00:09:26,670 –> 00:09:28,949

stemming فرآیند کاهش یک است

220

00:09:28,949 –> 00:09:32,130

که شکل پایهاش را انجام میدهد و این کار انجام میشود.

221

00:09:32,130 –> 00:09:34,560

با قطع شروع یا

222

00:09:34,560 –> 00:09:35,250

پایان کلمه،

223

00:09:35,250 –> 00:09:37,230

بنابراین این برش بی رویه

224

00:09:37,230 –> 00:09:39,660

در برخی موارد موفق و در موارد دیگر شکست خواهد خورد،

225

00:09:39,660 –> 00:09:41,639

بنابراین بیایید این سه مثال

226

00:09:41,639 –> 00:09:45,120

را در اینجا بیاوریم، بنابراین این مطالعه موردی اول

227

00:09:45,120 –> 00:09:47,940

، پسوند es را قطع کرده و تبدیل به

228

00:09:47,940 –> 00:09:50,610

مطالعه و دومی می شود. مورد

229

00:09:50,610 –> 00:09:54,000

دادن را قطع کرده ایم و تبدیل به G IV می شود و در

230

00:09:54,000 –> 00:09:56,610

حالت سوم خرید را قطع کرده

231

00:09:56,610 –> 00:10:00,449

و تبدیل به PI می شود بنابراین در هر سه

232

00:10:00,449 –> 00:10:03,899

مورد می بینیم که فقط در حالت سوم

233

00:10:03,899 –> 00:10:07,290

کلمه ای داریم که معنی دارد پس وقتی

234

00:10:07,290 –> 00:10:09,810

آنها من هستم پیادهسازی ریشه همیشه

235

00:10:09,810 –> 00:10:12,540

ضروری نیست که کلمه ریشهای نهایی

236

00:10:12,540 –> 00:10:14,910

که دریافت میکنیم باید معنایی

237

00:10:14,910 –> 00:10:17,010

مرتبط با آن داشته باشد، اکنون

238

00:10:17,010 –> 00:10:19,350

الگوریتمهای ریشهای زیادی در دسترس هستند، بنابراین یکی از

239

00:10:19,350 –> 00:10:21,389

این الگوریتمهای

240

00:10:21,389 –> 00:10:23,880

ریشهای پورتر استمر است و ما این پایه spo2 را

241

00:10:23,880 –> 00:10:26,430

از یک نقطه k LD وارد میکنیم. پکیج ساقه

242

00:10:26,430 –> 00:10:29,220

بعد از آن من نمونه ای از

243

00:10:29,220 –> 00:10:32,160

این استمر پرتر را با نام PST ایجاد خواهم کرد.

244

00:10:32,160 –> 00:10:34,649

می خواهم این سه چوب را در اینجا

245

00:10:34,649 –> 00:10:38,220

برنده شوم و بخرم، بنابراین

246

00:10:38,220 –> 00:10:40,709

این سه کلمه را داخل ساقه پوسیدگی PST می گذارم،

247

00:10:40,709 –> 00:10:43,769

بنابراین BST ضعیف ترین نمونه آزمایشی است

248

00:10:43,769 –> 00:10:46,560

و این نمونه اساساً

249

00:10:46,560 –> 00:10:49,050

تابع پایه است، بنابراین من میخواهم کلمه

250

00:10:49,050 –> 00:10:51,360

winning کلمه مطالعات و کلمه

251

00:10:51,360 –> 00:10:53,069

خرید را روی enter

252

00:10:53,069 –> 00:10:55,410

بزنم، بنابراین باید ابتدا این را اجرا کنم و حالا

253

00:10:55,410 –> 00:10:57,839

دوباره روی run کلیک میکنم تا ببینم که

254

00:10:57,839 –> 00:11:00,660

Wenning ریشه دارد. برای برنده شدن در مطالعات

255

00:11:00,660 –> 00:11:01,440

بوده است

256

00:11:01,440 –> 00:11:03,330

آنها به مطالعه و خرید

257

00:11:03,330 –> 00:11:06,060

به لوله کشیده شده است در حال حاضر شبیه به ریشه

258

00:11:06,060 –> 00:11:09,690

ما محدودیت نیز داریم بنابراین

259

00:11:09,690 –> 00:11:12,000

محدودیت فرآیند کاهش کلمات به

260

00:11:12,000 –> 00:11:15,330

لم یا دیکشنری آنها است. بنابراین، شکل پایه

261

00:11:15,330 –> 00:11:18,180

ای که کلمه به آن تبدیل می شود،

262

00:11:18,180 –> 00:11:20,370

قطعاً باید معنایی مرتبط

263

00:11:20,370 –> 00:11:23,100

با آن داشته باشد، بنابراین دوباره سه مورد

264

00:11:23,100 –> 00:11:26,310

در اینجا داریم Studies به مطالعه تبدیل شده است

265

00:11:26,310 –> 00:11:29,100

که بدیهی است که معنای داده شده

266

00:11:29,100 –> 00:11:31,650

است، تبدیل شده است به دادن به طور مشابه، خرید

267

00:11:31,650 –> 00:11:34,290

به PI تبدیل شده است. بنابراین ببینید که

268

00:11:34,290 –> 00:11:37,350

این سه کلمه جداگانه

269

00:11:37,350 –> 00:11:39,720

با آنها معنی مرتبط دارند اکنون برای

270

00:11:39,720 –> 00:11:41,880

پیاده سازی اقلیم سازی با کمک

271

00:11:41,880 –> 00:11:43,530

یک بسته تحلیلی، شما به

272

00:11:43,530 –> 00:11:46,080

کلمه net و warnet limit Iser نیاز دارید، بنابراین

273

00:11:46,080 –> 00:11:48,240

ما این do from و

274

00:11:48,240 –> 00:11:50,940

بسته های پایه آموزش ltk را پیاده سازی خواهیم کرد و من

275

00:11:50,940 –> 00:11:53,760

یک نمونه از این کلمه حد خالص ایجاد کنید

276

00:11:53,760 –> 00:11:58,920

Iser اکنون چه می خواهم این را می

277

00:11:58,920 –> 00:12:01,170

خواهم اشکال لم این سه کلمه

278

00:12:01,170 –> 00:12:05,190

Ghats cacti and geese را می خواهم و

279

00:12:05,190 –> 00:12:07,440

این را در کلمات موضوع ذخیره می کنم تا

280

00:12:07,440 –> 00:12:10,080

281

00:12:10,080 –> 00:12:12,540

ساقه این سه

282

00:12:12,540 –> 00:12:15,510

کلمه را مرور کنید و هر کدام را به هم ببندید، من به

283

00:12:15,510 –> 00:12:19,710

سمت راست ضربه می زنم، بنابراین ببینید که گربه ها

284

00:12:19,710 –> 00:12:22,170

یخ را محدود کرده اند تا کارت محدودیت چشم های

285

00:12:22,170 –> 00:12:24,630

اقیانوس کاکتوس ها شخصیت های یک d در نهایت

286

00:12:24,630 –> 00:12:26,720

نسخه چشم محدود غازها غاز است

287

00:12:26,720 –> 00:12:29,670

یکی دیگر از مفاهیم مهم

288

00:12:29,670 –> 00:12:31,950

پردازش زبان طبیعی بخش هایی از

289

00:12:31,950 –> 00:12:35,160

برچسب زدن گفتار است بنابراین در زبان انگلیسی کلمات را

290

00:12:35,160 –> 00:12:37,040

می توان به عنوان کوچکترین

291

00:12:37,040 –> 00:12:39,480

عناصری در نظر گرفت که دارای معانی متمایزی هستند

292

00:12:39,480 –> 00:12:42,690

و بر اساس کاربرد و کارکرد کلمات

293

00:12:42,690 –> 00:12:44,310

به دسته بندی می شوند. کلاسهای مختلف

294

00:12:44,310 –> 00:12:48,180

که به عنوان بخشهای گفتار شناخته میشوند، بنابراین

295

00:12:48,180 –> 00:12:50,940

او برچسبگذاری میشود، فرآیند علامتگذاری یا

296

00:12:50,940 –> 00:12:54,510

ب