در این مطلب، ویدئو حافظه زمانی سلسله مراتبی در پایتون – فرد روتبارت – PyCon Israel 2019 با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:34:23

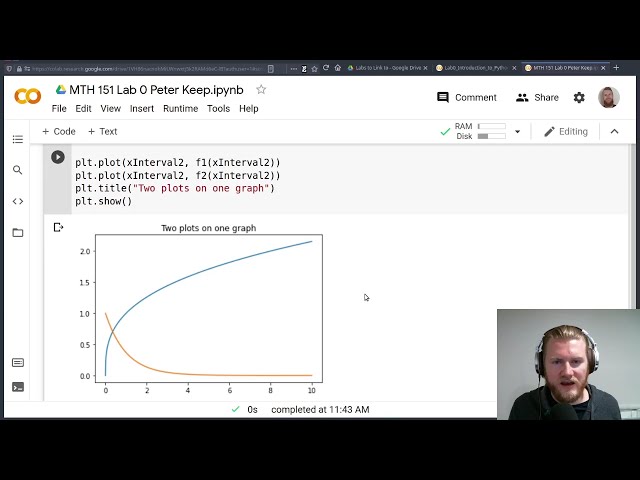

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:02,520 –> 00:00:17,570

[موسیقی]

2

00:00:18,500 –> 00:00:20,880

بسیار خوب، پس میخواستم سعی

3

00:00:20,880 –> 00:00:22,949

کنم شکل جدیدی از هوش مصنوعی به نام

4

00:00:22,949 –> 00:00:27,930

حافظه زمانی سلسله مراتبی را به شما معرفی کنم، معمولاً

5

00:00:27,930 –> 00:00:31,019

وقتی مردم میشنوند که من با

6

00:00:31,019 –> 00:00:34,260

هوش مصنوعی سر و کار دارم، میگویند اوه، باشه، شما وارد شبکههای

7

00:00:34,260 –> 00:00:36,329

عصبی عمیق میشوید و من گفتم نه من هستم. نه

8

00:00:36,329 –> 00:00:41,519

این چیزهای دیگر علاوه بر این که

9

00:00:41,519 –> 00:00:44,640

شبکه های عصبی عمیق واقعاً در

10

00:00:44,640 –> 00:00:47,610

حوزه برنامه خود بسیار مفید هستند، اما شما باید

11

00:00:47,610 –> 00:00:50,129

از محدودیت های آنها آگاه باشید و این

12

00:00:50,129 –> 00:00:52,589

محدودیت ها یکی از آنها به دلیل

13

00:00:52,589 –> 00:00:55,100

این محدودیت ها است که

14

00:00:55,100 –> 00:00:58,290

من آنها را هوش مصنوعی نمی نامم.

15

00:00:58,290 –> 00:01:04,769

آنها را هوش کمکی بنامید، بنابراین

16

00:01:04,769 –> 00:01:07,020

اگر محدودیتها را ندانید، DNA میتواند بسیار خطرناک باشد

17

00:01:07,020 –> 00:01:09,299

، اما اگر آنها را

18

00:01:09,299 –> 00:01:12,150

فقط کمک در نظر بگیرید و نه هوش مصنوعی،

19

00:01:12,150 –> 00:01:15,060

مشکلی ندارید، بنابراین آنها

20

00:01:15,060 –> 00:01:16,920

موفقیتهای بسیار بزرگی به دست

21

00:01:16,920 –> 00:01:22,500

آوردهاند، اما اگر آنها به هزاران موفقیت نیاز دارند.

22

00:01:22,500 –> 00:01:27,240

میلیونها نمونه کار نمیکنند، آنها

23

00:01:27,240 –> 00:01:31,580

سازگاری با دادههای در حال تغییر را بسیار سخت

24

00:01:31,580 –> 00:01:34,050

میدانند و فریب دادن آنها بسیار آسان است، گاهی

25

00:01:34,050 –> 00:01:38,040

اوقات اکنون اقداماتی را برای جلوگیری از

26

00:01:38,040 –> 00:01:41,310

آن برمیدارند و بسیار ساده حذف نویز هستند، اما

27

00:01:41,310 –> 00:01:45,560

تا آنجا که من نگرانم، شبکههای عصبی عمیق

28

00:01:45,560 –> 00:01:48,780

مانند مغز ما کار نمیکنند و

29

00:01:48,780 –> 00:01:54,470

واقعا نمیتوانند ما را به سمت هوش مصنوعی واقعی HTM و

30

00:01:54,470 –> 00:01:56,940

حافظه زمانی Oracle هدایت کنند، این یک

31

00:01:56,940 –> 00:02:00,540

چارچوب نظری برای

32

00:02:00,540 –> 00:02:05,040

هوش ماشینی بیولوژیکی و تعمیمیافته است که

33

00:02:05,040 –> 00:02:07,979

بر اساس آخرین ما است. درک

34

00:02:07,979 –> 00:02:12,569

نئوکورتکس و آن برخلاف DN n است،

35

00:02:12,569 –> 00:02:14,269

بنابراین فقط به چند صد نمونه نیاز

36

00:02:14,269 –> 00:02:19,200

دارد تا راه بیفتد و شروع به

37

00:02:19,200 –> 00:02:22,530

پیشبینی کند بدون نظارت یاد میگیرد و

38

00:02:22,530 –> 00:02:25,650

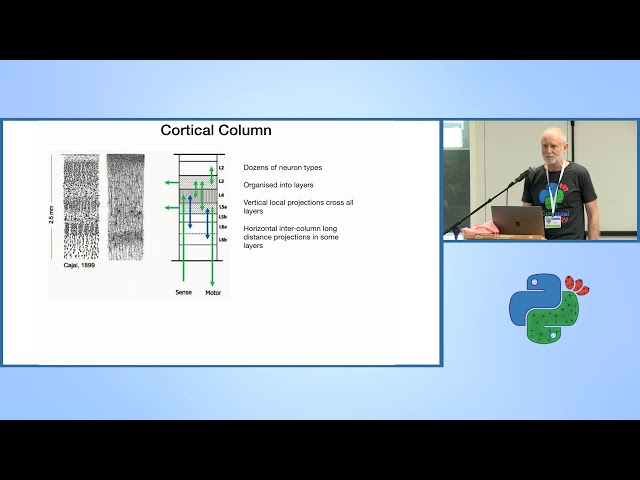

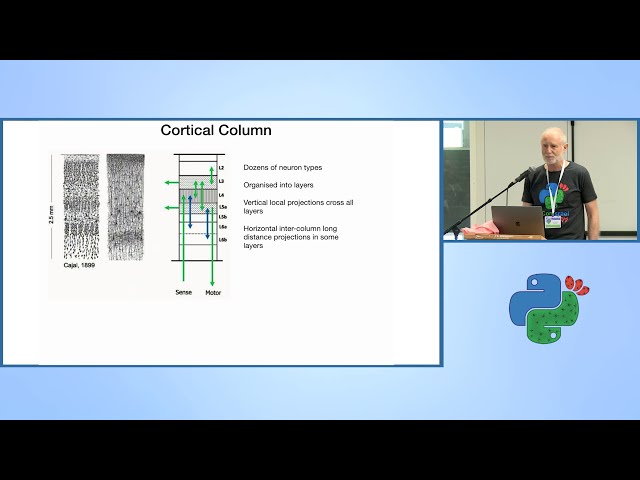

دوباره بر خلاف DN پایان مییابد هر

39

00:02:25,650 –> 00:02:27,540

چه پیش میرود یاد میگیرد و میتواند اشتباهات خود را اصلاح کند.

40

00:02:27,540 –> 00:02:28,920

41

00:02:28,920 –> 00:02:33,240

به طور باورنکردنی ایمن است از

42

00:02:33,240 –> 00:02:35,130

حدود

43

00:02:35,130 –> 00:02:41,760

40 درصد سر و صدا و مهمتر از همه چون

44

00:02:41,760 –> 00:02:44,220

فکر می کنم حداقل راه را

45

00:02:44,220 –> 00:02:49,050

برای سیستم های هوشمند واقعاً باز می کند،

46

00:02:49,050 –> 00:02:51,510

کمی از تاریخ خوب است، توپ

47

00:02:51,510 –> 00:02:56,790

در سال 2004 شروع شد، زمانی که جف هاوکینز برای

48

00:02:56,790 –> 00:02:59,310

افراد مسن شروع شد. کافی است بدانیم که او

49

00:02:59,310 –> 00:03:04,260

پالم خلبان را اختراع کرد، بنابراین میلیونها میتی کسبوکارش را

50

00:03:04,260 –> 00:03:07,560

فروخت و یک

51

00:03:07,560 –> 00:03:13,019

آزمایشگاه تحقیقاتی برای مهندسی معکوس

52

00:03:13,019 –> 00:03:16,200

قشر نئوکورتکس تشکیل داد و آنچه را

53

00:03:16,200 –> 00:03:20,580

که پس از چند سال منتشر کرد، در هوش مصنوعی به کار برد.

54

00:03:20,580 –> 00:03:28,019

بهعنوان منبع باز کار میکند و اگرچه

55

00:03:28,019 –> 00:03:32,220

API هنوز در پایتون 2.7 و ++C وجود دارد،

56

00:03:32,220 –> 00:03:35,280

اکنون تلاشهای جامعه برای انتقال آن به نسخه 3.0 انجام شده است،

57

00:03:35,280 –> 00:03:37,920

بسیاری از پیادهسازیهای شخص ثالث

58

00:03:37,920 –> 00:03:42,600

در حال حاضر از جمله موارد روی GPUها در

59

00:03:42,600 –> 00:03:44,579

تقریباً هر زبانی که فکرش را

60

00:03:44,579 –> 00:03:48,959

بکنید و دائماً درگیر است تا

61

00:03:48,959 –> 00:03:51,829

آنها بیشتر و بیشتر در مورد نئوکورتکس می آموزند،

62

00:03:51,829 –> 00:03:58,110

آنها مدل مانترای جدید HTM را بهبود می بخشند

63

00:03:58,110 –> 00:04:00,239

، یعنی تاسیس آیفون

64

00:04:00,239 –> 00:04:04,530

به قدری باز است که می توانید

65

00:04:04,530 –> 00:04:07,260

جلسات تحقیقاتی را در twitch زنده تماشا

66

00:04:07,260 –> 00:04:12,299

کنید اگر خیلی تمایل دارید، بنابراین بیایید در

67

00:04:12,299 –> 00:04:14,670

مورد نئوکورتکس صحبت کنیم که حدود 75 است. % از

68

00:04:14,670 –> 00:04:17,880

مغز شما لایه نازکی روی مغز است که حدود

69

00:04:17,880 –> 00:04:20,250

دو و نیم میلی متر ضخامت دارد، اگر

70

00:04:20,250 –> 00:04:24,270

آن را باز کنم و تا کنم،

71

00:04:24,270 –> 00:04:26,610

این چیزی است که به دست می آورید، پس این

72

00:04:26,610 –> 00:04:29,640

شما هستید، همانطور که می دانستید قشر بدنتان این

73

00:04:29,640 –> 00:04:32,160

چیزی است که به ما می دهد. صحبت کن این همان چیزی است که

74

00:04:32,160 –> 00:04:34,110

به این سخنرانی گوش می دهد فقط این

75

00:04:34,110 –> 00:04:37,610

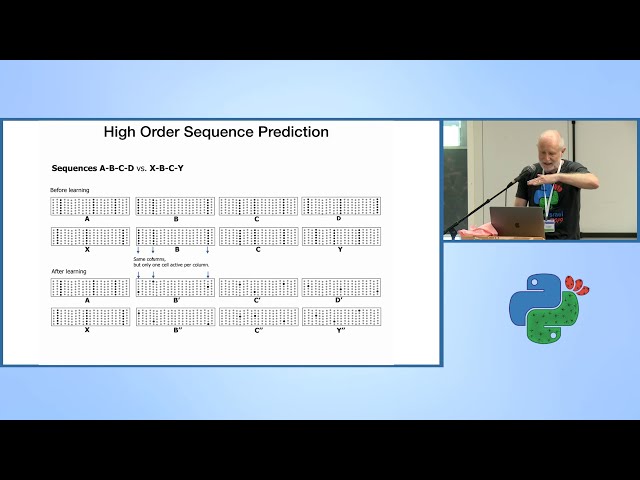

دستمال کوچک میلیاردها نورون دارد

76

00:04:37,610 –> 00:04:41,460

و یک نوشیدنی است و ده ها

77

00:04:41,460 –> 00:04:42,480

هزار

78

00:04:42,480 –> 00:04:45,000

سیناپس هزاران سیناپس برای

79

00:04:45,000 –> 00:04:48,780

نورون ها دارد، بنابراین این تعداد بسیار زیاد o

80

00:04:48,780 –> 00:04:51,630

اتصالات وجود دارد و

81

00:04:51,630 –> 00:04:54,660

نکته مهم در حال حاضر این است که فقط دو

82

00:04:54,660 –> 00:04:56,820

درصد از نورون های شما در هر زمان

83

00:04:56,820 –> 00:04:58,650

فعال هستند و اینگونه است که مغز شما

84

00:04:58,650 –> 00:05:01,470

موفق می شود و بسیاری از کارها را با

85

00:05:01,470 –> 00:05:04,830

قدرت بسیار کم انجام می دهد، بنابراین

86

00:05:04,830 –> 00:05:07,020

نئوکورتکس در ابتدا چه کاری انجام می دهد. همه چیز

87

00:05:07,020 –> 00:05:11,340

همیشه ورودی های خود را پیش بینی می کند همانطور که من به

88

00:05:11,340 –> 00:05:12,810

اطراف اتاق نگاه می کنم من پیش بینی می کنم که من

89

00:05:12,810 –> 00:05:15,300

افراد زیادی را می بینم و خوب این

90

00:05:15,300 –> 00:05:18,650

پیش بینی سقوط می کند بنابراین من باید

91

00:05:18,650 –> 00:05:21,600

مدل خود را به روز کنم که این کار دیگری است

92

00:05:21,600 –> 00:05:25,040

که قشر شما انجام می دهد. همچنین

93

00:05:25,040 –> 00:05:27,510

رفتارهایی ایجاد می کند که من

94

00:05:27,510 –> 00:05:31,890

در حال حاضر دارم این سخنرانی را انجام می دهم.

95

00:05:31,890 –> 00:05:34,790

یک چیز واقعاً باورنکردنی

96

00:05:34,790 –> 00:05:36,870

که در مورد نئوکورتکس کشف شده است

97

00:05:36,870 –> 00:05:40,410

این است که یکنواخت است و

98

00:05:40,410 –> 00:05:42,360

مهم نیست به کجا نگاه کنید.

99

00:05:42,360 –> 00:05:44,310

قشر بینایی

100

00:05:44,310 –> 00:05:46,980

یکسان به نظر می رسد، سیستم آدری یکسان به نظر می رسد،

101

00:05:46,980 –> 00:05:49,350

مناطقی که با لمس سروکار دارند

102

00:05:49,350 –> 00:05:52,680

یکسان به نظر می رسند، بنابراین آنچه که این چیز است یک ناحیه

103

00:05:52,680 –> 00:05:55,890

از ناحیه دیگر است و این همان چیزی است

104

00:05:55,890 –> 00:05:58,320

که به آن متصل هستند، بنابراین قشر بینایی

105

00:05:58,320 –> 00:06:00,090

به هم متصل می شوند. چشمان شما آدری شما

106

00:06:00,090 –> 00:06:03,210

یک قشر است که به گوش شما متصل است

107

00:06:03,210 –> 00:06:06,840

و یک واحد اصلی

108

00:06:06,840 –> 00:06:08,580

تکثیر وجود دارد که به آن ستون قشری گفته می

109

00:06:08,580 –> 00:06:12,300

شود که حدود 2 میلیون عدد از آنها وجود دارد، بنابراین

110

00:06:12,300 –> 00:06:16,860

ما انتظار داریم که چه چیزی باعث می شود

111

00:06:16,860 –> 00:06:19,140

که اگر ستون قشری مبتنی باشد

112

00:06:19,140 –> 00:06:21,450

تکثیر همچنین اساس

113

00:06:21,450 –> 00:06:25,230

محاسبات است، بنابراین اگر میخواهیم بفهمیم

114

00:06:25,230 –> 00:06:26,910

115

00:06:26,910 –> 00:06:29,270

در قشر جدید قشر شما چه میگذرد باید ستون قشری را درک کنیم،

116

00:06:29,270 –> 00:06:35,070

میتوانید در اینجا ریزنگارههای ستون قشر مغز

117

00:06:35,070 –> 00:06:38,370

را ببینید که نکته برجسته این است که

118

00:06:38,370 –> 00:06:40,440

به لایههایی تقسیم شده و تعداد زیادی از آن وجود دارد.

119

00:06:40,440 –> 00:06:42,510

انواع مختلفی از نورونها که

120

00:06:42,510 –> 00:06:45,150

نورونها همگی در آنهایی که به آن ستونهای کوچک میگویند ردیف شدهاند

121

00:06:45,150 –> 00:06:46,550

122

00:06:46,550 –> 00:06:50,700

، اتصالات زیادی بین لایهها

123

00:06:50,700 –> 00:06:54,900

وجود دارد و اتصالات جانبی

124

00:06:54,900 –> 00:06:57,150

وجود دارد که بین

125

00:06:57,150 –> 00:06:59,330

ستونهای قشری و سایر مکانهای مغز خارج میشوند،

126

00:06:59,330 –> 00:07:01,530

بنابراین چیزی که ما به آن نگاه میکنیم چیزی است

127

00:07:01,530 –> 00:07:04,980

که بسیار زیبا است. بسیار

128

00:07:04,980 –> 00:07:07,080

پیچیده است، به این معنی که آنها باید

129

00:07:07,080 –> 00:07:09,600

کار بسیار پیچیده ای انجام می دهند و هر

130

00:07:09,600 –> 00:07:11,160

کاری که انجام می دهند این همان چیزی است که قشر جدید شما

131

00:07:11,160 –> 00:07:15,810

وجود دارد. بنابراین بیایید به

132

00:07:15,810 –> 00:07:21,990

نورون شبکه عصبی برگردیم، آنها نسبتاً ساده

133

00:07:21,990 –> 00:07:25,610

هستند، سیناپس هایی دارید که

134

00:07:25,610 –> 00:07:28,260

وزن های متفاوتی دارند

135

00:07:28,260 –> 00:07:31,380

، اگر بخواهید در بدن نورون جمع می شوند و آنها

136

00:07:31,380 –> 00:07:34,110

از طریق یک تابع فعال سازی به طور معمول

137

00:07:34,110 –> 00:07:36,240

غیرخطی هستند که خروجی شما را اکنون به شما می

138

00:07:36,240 –> 00:07:39,620

دهد. بر اساس یک درک واقعا ساده

139

00:07:39,620 –> 00:07:45,120

از نورون ها در حدود سال 1957 و

140

00:07:45,120 –> 00:07:47,040

آنها موفقیت چندانی نداشتند تا این

141

00:07:47,040 –> 00:07:48,930

اواخر که مردم شروع به

142

00:07:48,930 –> 00:07:53,010

اتصال به شبکه های عصبی عمیق با

143

00:07:53,010 –> 00:07:56,610

لایه های پنهان زیادی کردند و سپس از انفجار استفاده کردند،

144

00:07:56,610 –> 00:08:01,530

اما چیزی که من Kawai می کنم این است

145

00:08:01,530 –> 00:08:04,110

که یادگیری با تنظیم

146

00:08:04,110 –> 00:08:06,180

وزنهای سیناپسی به این ترتیب

147

00:08:06,180 –> 00:08:08,550

شبکههای عصبی عمیق من نمیخواهم وارد آن شوم

148

00:08:08,550 –> 00:08:11,810

در فرآیندهای آنهایی که آن را میدانند

149

00:08:11,810 –> 00:08:14,990

وقتی بوتهام و خوب انجام نمیدهند، شما

150

00:08:14,990 –> 00:08:19,680

باید یاد بگیرید خوب، بنابراین نکته اینجاست

151

00:08:19,680 –> 00:08:25,320

که نورونهای واقعی هستند.

152

00:08:25,320 –> 00:08:28,440

این یک نورون واقعی نیست، بدن سلولی

153

00:08:28,440 –> 00:08:30,890

دندریت دارد

154

00:08:31,280 –> 00:08:34,260

، هر نورون بین پنج

155

00:08:34,260 –> 00:08:36,719

هزار تا 30 هزار سیناپس یا

156

00:08:36,719 –> 00:08:40,289

ارتباط با نورون های دیگر دارد که تنها 10

157

00:08:40,289 –> 00:08:42,590

درصد آنها c تقریباً پروگزیمال و از

158

00:08:42,590 –> 00:08:44,520

آنجایی که آنها به بدن سلولی نزدیک هستند،

159

00:08:44,520 –> 00:08:47,250

در واقع می توانند باعث ایجاد یک سنبله عصبی شوند، بنابراین

160

00:08:47,250 –> 00:08:49,280

اگر سیگنالی به آن سیناپس ها برسد،

161

00:08:49,280 –> 00:08:52,610

نورون به سرعت بالا می رود و سیگنالی را بیشتر ارسال می کند

162

00:08:52,610 –> 00:08:56,370

، 90٪ دیگر دیستال نامیده می شوند

163

00:08:56,370 –> 00:08:58,260

زیرا آنها از هم دورتر هستند. از

164

00:08:58,260 –> 00:09:00,690

بدن سلولی باعث ایجاد سنبله عصبی نمیشوند

165

00:09:00,690 –> 00:09:03,630

و برای سالهای متمادی

166

00:09:03,630 –> 00:09:05,050

یک معما

167

00:09:05,050 –> 00:09:06,310

بودند، پس اگر به خوبی باعث ایجاد

168

00:09:06,310 –> 00:09:11,410

سنبلههای عصبی نشوند، مشخص میشود که

169

00:09:11,410 –> 00:09:13,690

آشکارسازهای الگوی تشخیص الگوی

170

00:09:13,690 –> 00:09:15,070

بسیار خوب هستند،

171

00:09:15,070 –> 00:09:19,390

بنابراین اگر بین 8 یا 15 سیناپس که بطور

172

00:09:19,390 –> 00:09:22,860

منطقی نزدیک به هم هستند با هم شلیک میشوند و

173

00:09:22,860 –> 00:09:24,160

174

00:09:24,160 –> 00:09:26,080

این باعث میشود که

175

00:09:26,080 –> 00:09:28,660

سنبله دندریتی نامیده میشود که به بدن سلولی حرکت میکند

176

00:09:28,660 –> 00:09:31,420

و آنقدر قوی نیست که

177

00:09:31,420 –> 00:09:33,490

در واقع نورون را شلیک کند، اما آن

178

00:09:33,490 –> 00:09:36,720

را در حالتی قرار میدهد که به آن حالت

179

00:09:36,720 –> 00:09:39,910

پیشبینی کننده زیباتر میگویند. در

180

00:09:39,910 –> 00:09:42,970

حالت پیشبینی، اگر سیگنالی بالا بیاید، سریعتر شلیک میکند.

181

00:09:42,970 –> 00:09:46,480

182

00:09:46,480 –> 00:09:51,850

183

00:09:51,850 –> 00:09:56,440

184

00:09:56,440 –> 00:10:01,290

این را

185

00:10:01,290 –> 00:10:03,130

به خاطر بسپارید زیرا ما قرار است در

186

00:10:03,130 –> 00:10:06,190

مورد آن زیاد صحبت کنیم، بنابراین این یک HTM است که شما

187

00:10:06,190 –> 00:10:12,550

روی آن هستید، ساختار دندریتیک

188

00:10:12,550 –> 00:10:15,670

یک نورون واقعی را تکرار می کند و به

189

00:10:15,670 –> 00:10:17,560

جزئیات آنچه در سلول در یک نورون اتفاق می افتد نمی پردازد.

190

00:10:17,560 –> 00:10:20,560

بدن فقط میخواهد

191

00:10:20,560 –> 00:10:22,870

رفتار پردازش واقعی

192

00:10:22,870 –> 00:10:28,180

نورون را تکرار کند و نه جزئیات نورون،

193

00:10:28,180 –> 00:10:32,200

بنابراین رفتار یک HTM Euron فقط

194

00:10:32,200 –> 00:10:37,480

به تعداد سیناپسها و

195

00:10:37,480 –> 00:10:41,800

مکان تغییر حالت آن

196

00:10:41,800 –> 00:10:47,170

بستگی دارد و به وزنهای DNA بستگی ندارد. نورونها یک

197

00:10:47,170 –> 00:10:52,060

نورون میتواند در یکی از چهار حالت باشد،

198

00:10:52,060 –> 00:10:54,610

میتواند فعال باشد، به این معنی که

199

00:10:54,610 –> 00:10:57,190

200

00:10:57,190 –> 00:10:59,350

وقتی کاری

201

00:10:59,350 –> 00:11:02,680

202

00:11:02,680 –> 00:11:05,740

انجام نمیدهد میتواند غیرفعال

203

00:11:05,740 –> 00:11:09,160

باشد. حالت پیشبینی HTM همان

204

00:11:09,160 –> 00:11:11,740

روشی را یاد میگیرد که نورونهای بیولوژیکی با تقویت سیناپسها یاد میگیرند،

205

00:11:11,740 –> 00:11:14,200

بنابراین در یک

206

00:11:14,200 –> 00:11:17,350

نورون بیولوژیکی همانطور که یاد

207

00:11:17,350 –> 00:11:19,180

میگیرد سیناپسها را بین

208

00:11:19,180 –> 00:11:22,450

دندریتهای حساس مختلف نورونهای دیگر رشد میدهد

209

00:11:22,450 –> 00:11:25,150

تا زمانی که ارتباط برقرار کند و اگر بخواهد

210

00:11:25,150 –> 00:11:28,570

یا به روشی متفاوت یاد بگیرید،

211

00:11:28,570 –> 00:11:33,540

ممکن است این ارتباطات را قطع کند HTM

212

00:11:33,540 –> 00:11:37,960

چیزی دارد که سیناپس در HTM دارای مقداری

213

00:11:37,960 –> 00:11:40,690

به نام دائمی است، بنابراین اگر آن و آن

214

00:11:40,690 –> 00:11:44,860

ماندگاری افزایش مییابد همانطور که یاد

215

00:11:44,860 –> 00:11:47,380

میگیرد اگر ماندگاری شما زیر یک

216

00:11:47,380 –> 00:11:50,560

آستانه خاص باشد،

217

00:11:50,560 –> 00:11:54,040

سیناپسها قطع میشوند. اگر از آن آستانه عبور کند

218

00:11:54,040 –> 00:11:56,320

، متصل در نظر گرفته میشود،

219

00:11:56,320 –> 00:11:59,890

بنابراین یادگیری در HTM ساخت و

220

00:11:59,890 –> 00:12:02,650

شکستن سیناپسها است و نه با تنظیم

221

00:12:02,650 –> 00:12:07,960

وزن، خوب است، بنابراین اکنون به نورون HTM نگاه کردهایم،

222

00:12:07,960 –> 00:12:10,030

بیایید به یک ستون قشر مغز نگاه کنیم،

223

00:12:10,030 –> 00:12:12,280

من فقط یک لایه خاص را از آن میگیرم.

224

00:12:12,280 –> 00:12:17,290

آن ستون و این لایه ای

225

00:12:17,290 –> 00:12:22,560

که من انتخاب می کنم، حافظه توالی نامیده می شود

226

00:12:22,560 –> 00:12:29,370

، دایره ها برای مدت زمانی

227

00:12:29,370 –> 00:12:33,820

که دایره ها نورون هستند، نورون های

228

00:12:33,820 –> 00:12:36,250

رنگ خاکستری در حالت فعال هستند، آن هایی که

229

00:12:36,250 –> 00:12:39,130

رنگ سفید دارند غیرفعال هستند و می توانید ببینید که

230

00:12:39,130 –> 00:12:43,030

تعدادی ستون وجود دارد. بسیاری از ستونها که

231

00:12:43,030 –> 00:12:44,950

همه نورونها فعال هستند،

232

00:12:44,950 –> 00:12:48,970

ستونهای زیادی فقط 1 یا 2 فعال هستند، اما اگر به بالا نگاه

233

00:12:48,970 –> 00:12:53,380

میکردیم، هر ستون در اینجا اساساً یک

234

00:12:53,380 –> 00:12:56,020

ستون کوچک از نورونها است.

235

00:12:56,020 –> 00:13:01,020

به بالای حافظه دنباله نگاهی بیندازید و

236

00:13:01,020 –> 00:13:03,640

فقط از بالا

237

00:13:03,640 –> 00:13:07,270

نگاه کنید و هر یک از ستونهایی را که حداقل یک نورون فعال دارند علامت بزنید،

238

00:13:07,270 –> 00:13:09,700

این شبکه را میگیریم

239

00:13:09,700 –> 00:13:11,620

که میتوانید در اینجا در

240

00:13:11,620 –> 00:13:13,930

گوشه سمت راست ببینید و به آن یک

241

00:13:13,930 –> 00:13:19,170

نمایش پراکنده توزیع شده میگویند.

242

00:13:19,170 –> 00:13:22,090

نشان می دهد که چگونه

243

00:13:22,090 –> 00:13:27,480

مغز ما در واقع با دانش سروکار

244

00:13:27,480 –> 00:13:32,190

دارد و ساختاری

245

00:13:32,190 –> 00:13:36,180

که مغز هنگام

246

00:13:36,180 –> 00:13:39,960

پردازش آن را به اطراف منتقل می کند، بنابراین هر

247

00:13:39,960 –> 00:13:43,520

بیت می تواند معنای معنایی

248

00:13:43,520 –> 00:13:48,210

داشته باشد، ظرفیت بسیار بالایی دارد، بنابراین اگر

249

00:13:48,210 –> 00:13:51,630

STR های من اندازه و حدود 2k داشته باشند. دو درصد

250

00:13:51,630 –> 00:13:55,200

از بیتها فعال هستند، پس من میتوانم

251

00:13:55,200 –> 00:14:00,180

10 تا 84 الگوی منحصربهفرد داشته باشم که به

252

00:14:00,180 –> 00:14:03,720

طور منحصربهفرد قابل شناسایی هستند که

253

00:14:03,720 –> 00:14:07,920

تعداد زیادی است و اگر باس ثابت را

254

00:14:07,920 –> 00:14:10,290

حفظ کنید، این 2٪ است و

255

00:14:10,290 –> 00:14:11,670

یادتان میآید قبلاً اشاره کردم که به 2 مورد نیاز دارم.

256

00:14:11,670 –> 00:14:13,470

درصد نورونهای مغز شما

257

00:14:13,470 –> 00:14:16,290

همیشه فعال هستند، بنابراین اگر این پراکندگی را حفظ کنید،

258

00:14:16,290 –> 00:14:19,560

259

00:14:19,560 –> 00:14:23,370

دستکاری این STRها بسیار آسان است، بنابراین اگر 2 SDR

260

00:14:23,370 –> 00:14:25,710

بیتهای مشترک داشته باشند، به این معنی است که آنها مشکل دارند.

261

00:14:25,710 –> 00:14:29,150

اطلاعات معنایی مشترک دارند و

262

00:14:29,150 –> 00:14:30,960

مقایسه آنها صرفاً یک

263

00:14:30,960 –> 00:14:34,320

تقاطع است و بنابراین و اگر

264

00:14:34,320 –> 00:14:38,430

اتفاقاً اتحادی از STRها دارید، می توانید

265

00:14:38,430 –> 00:14:41,190

به راحتی با دستکاری بیتی دوباره بررسی کنید که آیا یک STR خاص در بین اتحادیه وجود دارد یا خیر،

266

00:14:41,190 –> 00:14:43,760

267

00:14:43,760 –> 00:14:47,870

بنابراین بسیار آسان است

268

00:14:47,870 –> 00:14:54,600

بیایید اکنون نگاهی به آن

269

00:14:54,600 –> 00:14:56,910

حافظه سکانسی بیندازیم که قبلاً در

270

00:14:56,910 –> 00:15:00,750

ستون قشری دیده بودیم که قبلاً

271

00:15:00,750 –> 00:15:02,790

حافظه زمانی نامیده می شد و از این رو

272

00:15:02,790 –> 00:15:04,740

حافظه زمانی سلسله مراتبی نامیده

273

00:15:04,740 –> 00:15:08,370

274

00:15:08,370 –> 00:15:14,010

می شد.

275

00:15:14,010 –> 00:15:15,630

تحقیقات سالها نشان داده است که

276

00:15:15,630 –> 00:15:18,600

این بیشتر یک حافظه متوالی

277

00:15:18,600 –> 00:15:21,420

است تا یک حافظه زمانی، اما

278

00:15:21,420 –> 00:15:23,100

نام آن گیر کرده است، بنابراین هنوز به آن

279

00:15:23,100 –> 00:15:25,650

حافظه زمانی می گویند، اکنون یک

280

00:15:25,650 –> 00:15:28,710

برش از لایه خود را می گیرم، بنابراین یک

281

00:15:28,710 –> 00:15:30,900

برش عمودی می گیرم و میتوانیم

282

00:15:30,900 –> 00:15:36,450

ستونها را بهصورت عمودی ببینیم.

283

00:15:36,450 –> 00:15:38,820

284

00:15:38,820 –> 00:15:40,260

285

00:15:40,260 –> 00:15:43,530

286

00:15:43,530 –> 00:15:49,470

287

00:15:49,470 –> 00:15:52,590

rons در یک ستون کوچک که

288

00:15:52,590 –> 00:15:56,640

به آن ورودی متصل است، بنابراین اگر

289

00:15:56,640 –> 00:15:59,430

ورودی وارد شود و تمام ستونهای کوچک وجود داشته باشد،

290

00:15:59,430 –> 00:16:06,720

آن ورودی را دریافت میکنند، بنابراین اگر من

291

00:16:06,720 –> 00:16:09,960

اجازه دادم C داشته باشیم، اگر بتوانم برای شما توضیح دهم

292

00:16:09,960 –> 00:16:14,430

که چگونه کار میکند، بنابراین در T 0

293

00:16:14,430 –> 00:16:17,730

I چیزی یاد نگرفته ام و شاید

294

00:16:17,730 –> 00:16:20,280

یاد گرفته باشم که ورودی قبلی

295

00:16:20,280 –> 00:16:24,630

داشته ام و حالا یک ورودی فید فوروارد از

296

00:16:24,630 –> 00:16:26,670

پایین قرار داده ام و تمام ستون های کوچک آن

297

00:16:26,670 –> 00:16:29,280

متصل به آن ورودی فعال می شوند همانطور

298

00:16:29,280 –> 00:16:33,410

که در اینجا می بینید. سمت چپ

299

00:16:34,790 –> 00:16:40,860

در نهایت یاد میگیرد و زمانی

300

00:16:40,860 –> 00:16:43,560

که یاد گرفت، فرض کنید ما دوباره

301

00:16:43,560 –> 00:16:47,600

ورودی قبلی را داشتیم و حالا این ورودی

302

00:16:47,600 –> 00:16:51,660

، ورودی قبلی وارد میشود

303

00:16:51,660 –> 00:16:56,660

، نورونها را در حالت پیشبینی قرار میدهد

304

00:16:56,660 –> 00:17:01,110

و فلشهای قرمز در اینجا وجود دارد. بنابراین اگر

305

00:17:01,110 –> 00:17:03,420

همان ورودی ای که قبلا آموخته وارد شود

306

00:17:03,420 –> 00:17:05,400

و با حالت پیش بینی مطابقت

307

00:17:05,400 –> 00:17:08,400

داشته باشد باعث می شود نورون هایی که در

308

00:17:08,400 –> 00:17:11,670

حالت پیش بینی فعال هستند

309

00:17:11,670 –> 00:17:16,109

که سیاه است و آن نورون ها به نوبه خود از

310

00:17:16,109 –> 00:17:18,150

طریق سیناپس ها و اتصالات خود به

311

00:17:18,150 –> 00:17:21,180

نورون های دیگر فعال می شوند. نورون ها برای

312

00:17:21,180 –> 00:17:24,690

بعدی برای n چرخه زمانی بعدی در

313

00:17:24,690 –> 00:17:28,440

حالت پیشبینی قرار بگیرید، بنابراین میتوانید

314

00:17:28,440 –> 00:17:30,600

شروع مکانیزمی را برای

315

00:17:30,600 –> 00:17:34,430

پیشبینی ورودیها مشاهده کنید، کاری که نئوکورتکس نورون ما

316

00:17:34,430 –> 00:17:39,840

317

00:17:39,840 –> 00:17:42,330

318

00:17:42,330 –> 00:17:45,210

انجام میدهد.

319

00:17:45,210 –> 00:17:47,070

ورودی بعدی که قرار است

320

00:17:47,070 –> 00:17:49,670

به آن حافظه توالی وارد شود،

321

00:17:49,670 –> 00:17:52,920

دوباره بسیار قوی است، این

322

00:17:52,920 –> 00:17:56,970

ویژگی HTM است، بنابراین اگر 40 درصد از نورونهای این

323

00:17:56,970 –> 00:18:01,680

لایه از بین بروند،

324

00:18:01,680 –> 00:18:05,250

همچنان یادگیری بدون نظارت و

325

00:18:05,250 –> 00:18:07,890

پیوسته عمل میکند، بنابراین همانطور