در این مطلب، ویدئو مقایسه طبقه بندی کننده های یادگیری ماشین در پایتون با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:11:07

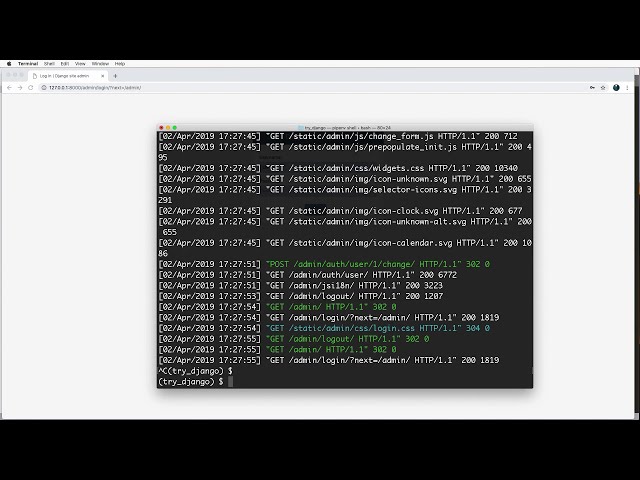

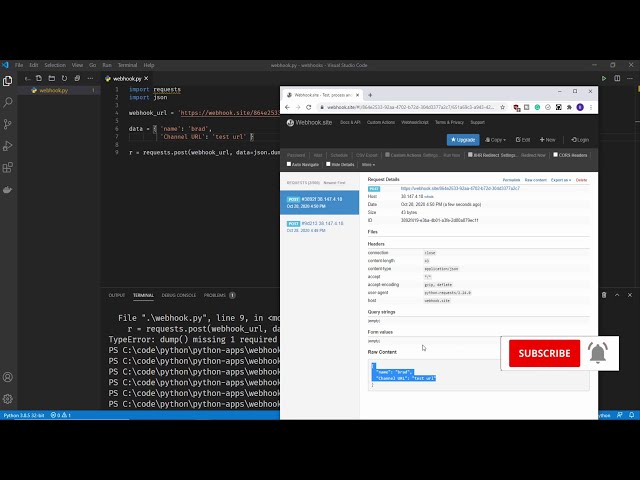

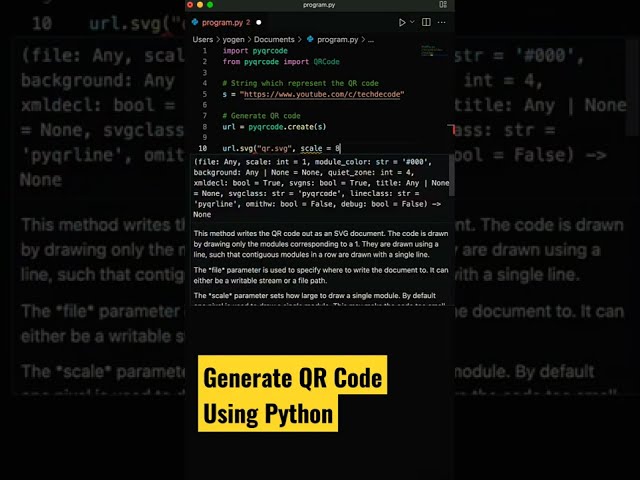

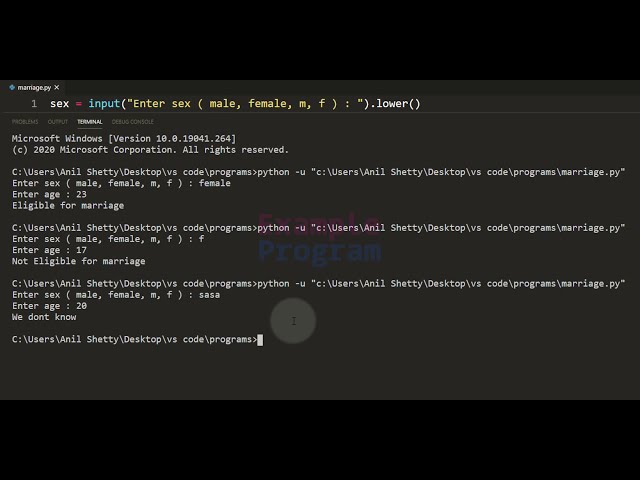

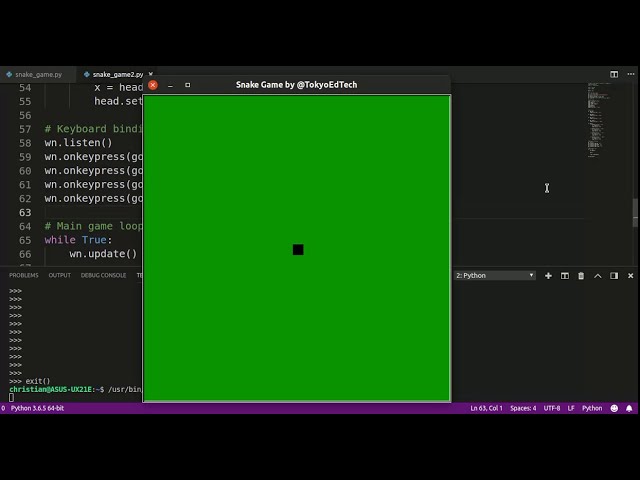

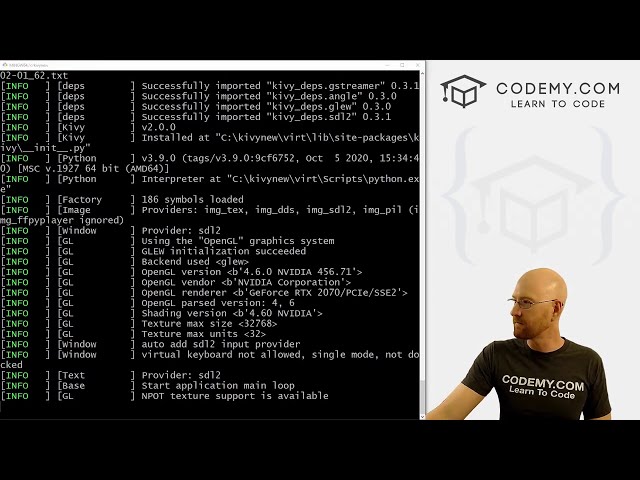

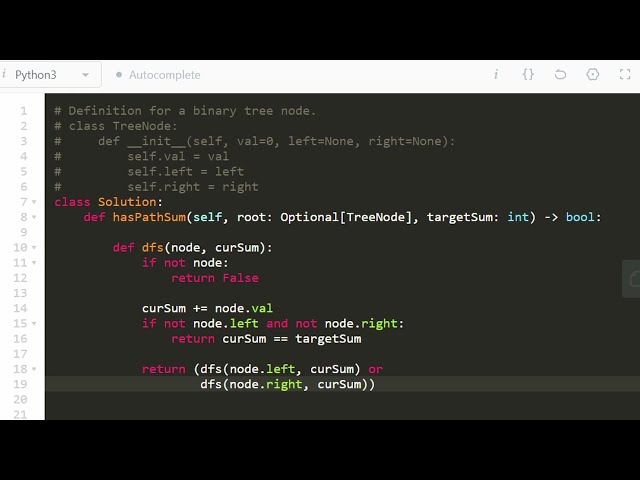

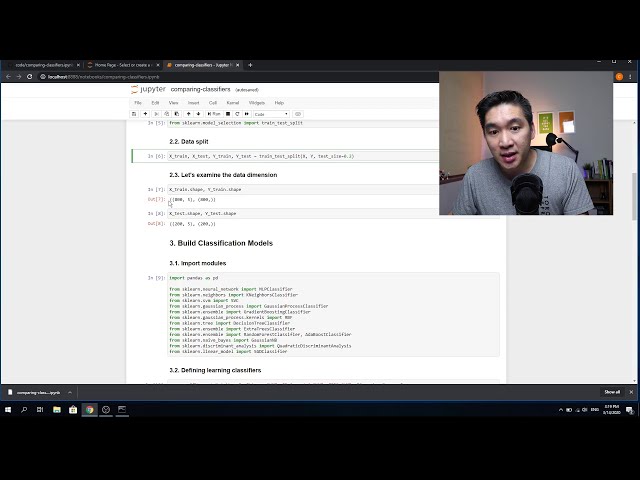

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,030 –> 00:00:02,250

2

00:00:02,250 –> 00:00:05,130

اگر تازه وارد هستید به کانال یوتیوب پروفسور داده خوش آمدید، نام من

3

00:00:05,130 –> 00:00:07,529

شانون نون توس است و احمد و من

4

00:00:07,529 –> 00:00:09,900

دانشیار بیوانفورماتیک در

5

00:00:09,900 –> 00:00:12,599

این کانال یوتیوب هستیم که در مورد

6

00:00:12,599 –> 00:00:15,480

مفاهیم علم داده و آموزش های عملی صحبت می کنیم،

7

00:00:15,480 –> 00:00:17,699

بنابراین اگر به این نوع علاقه دارید.

8

00:00:17,699 –> 00:00:20,310

لطفاً در این ویدیو مشترک شوید،

9

00:00:20,310 –> 00:00:22,080

ما

10

00:00:22,080 –> 00:00:25,289

عملکرد 14 الگوریتم یادگیری ماشینی

11

00:00:25,289 –> 00:00:27,330

را در یک مجموعه داده تولید شده به صورت مصنوعی مقایسه خواهیم کرد،

12

00:00:27,330 –> 00:00:30,480

بنابراین بدون هیچ مقدمه ای اجازه

13

00:00:30,480 –> 00:00:34,590

دهید شروع کنیم، بنابراین اولین کاری که

14

00:00:34,590 –> 00:00:36,719

اکنون می خواهید انجام دهید این است که به

15

00:00:36,719 –> 00:00:39,899

github بروید. استاد داده و

16

00:00:39,899 –> 00:00:43,110

روی مخزن کد کلیک کنید و به پایین بروید و

17

00:00:43,110 –> 00:00:45,930

روی پوشه پایتون کلیک کنید و

18

00:00:45,930 –> 00:00:48,719

سپس طبقه بندی کننده های مقایسه نقطه I

19

00:00:48,719 –> 00:00:52,020

py و B را مشاهده خواهید کرد، بنابراین ادامه دهید و روی آن کلیک کنید،

20

00:00:52,020 –> 00:00:56,640

بسیار خوب، اگر به رایانه دسترسی ندارید.

21

00:00:56,640 –> 00:00:58,859

که در آن می توانید کد

22

00:00:58,859 –> 00:01:01,170

را در صفحه github در اینجا دنبال کنید

23

00:01:01,170 –> 00:01:02,910

زیرا قبلاً در قالب نوت بوک

24

00:01:02,910 –> 00:01:04,890

است و برای کسانی از شما که

25

00:01:04,890 –> 00:01:06,720

مایل به دنبال کردن هستند لطفاً یک

26

00:01:06,720 –> 00:01:09,479

کپی از سمت راست دانلود کنید- روی پیوند خام کلیک کنید و

27

00:01:09,479 –> 00:01:12,740

سپس لینک را به عنوان در رایانه خود ذخیره کنید، بنابراین

28

00:01:12,740 –> 00:01:15,450

من می خواهم این را در پوشه پایتون ذخیره

29

00:01:15,450 –> 00:01:18,509

30

00:01:18,509 –> 00:01:22,650

کنم و سپس خط فرمان خود را باز کنم و سپس

31

00:01:22,650 –> 00:01:35,659

به پوشه ok بروید و سپس من قرار است

32

00:01:35,659 –> 00:01:39,990

محیط کاری خود را در

33

00:01:39,990 –> 00:01:46,680

Khanda و سپس Jupiter notebook فعال کنم و سپس روی نوت بوک

34

00:01:46,680 –> 00:01:52,320

ok کلیک می کنم،

35

00:01:52,320 –> 00:01:54,960

بنابراین در اینجا اجازه دهید شروع کنیم، بنابراین اولین کاری

36

00:01:54,960 –> 00:01:57,540

که می خواهیم انجام دهیم این است که یک

37

00:01:57,540 –> 00:02:00,180

مجموعه داده مصنوعی ایجاد کنیم و برای انجام این کار.

38

00:02:00,180 –> 00:02:01,740

ما از

39

00:02:01,740 –> 00:02:04,110

تابع طبقه بندی ساخت

40

00:02:04,110 –> 00:02:07,530

بسته scikit-learn استفاده می کنیم تا این را اجرا کنیم

41

00:02:07,530 –> 00:02:10,110

و اینتر را تغییر دهیم و سپس

42

00:02:10,110 –> 00:02:12,510

مجموعه داده های مصنوعی را

43

00:02:12,510 –> 00:02:13,500

با استفاده از این

44

00:02:13,500 –> 00:02:15,480

طبقه بندی ساخته شده تولید کنیم و سپس آن

45

00:02:15,480 –> 00:02:18,330

را اختصاص دهیم. به متغیر x و y

46

00:02:18,330 –> 00:02:20,070

که جدیداً در

47

00:02:20,070 –> 00:02:22,620

نتیجه این تابع ایجاد می شود و بنابراین آرگومان ورودی

48

00:02:22,620 –> 00:02:24,420

که در اینجا استفاده

49

00:02:24,420 –> 00:02:27,690

می کنیم این است که یک مجموعه داده مصنوعی

50

00:02:27,690 –> 00:02:31,140

متشکل از 1000 نمونه ایجاد می کنیم، بنابراین برای n

51

00:02:31,140 –> 00:02:33,570

نمونه زیرخط ما به

52

00:02:33,570 –> 00:02:37,200

آن مقدار 10 را اختصاص خواهیم داد 00 و برای n

53

00:02:37,200 –> 00:02:39,630

کلاس زیرخط

54

00:02:39,630 –> 00:02:41,280

، مقدار 2 را اختصاص می دهیم، زیرا

55

00:02:41,280 –> 00:02:44,580

دو کلاس برای این مجموعه داده و

56

00:02:44,580 –> 00:02:47,040

n ویژگی زیرخط ایجاد می کنیم

57

00:02:47,040 –> 00:02:49,860

که پنج مورد خواهیم داشت، بنابراین n زیرخط اضافی

58

00:02:49,860 –> 00:02:51,690

خواهیم داشت. آن را صفر می کنیم و سپس

59

00:02:51,690 –> 00:02:53,160

60

00:02:53,160 –> 00:02:55,920

وضعیت زیرخط تصادفی را به یک حالت خوب اختصاص می دهیم

61

00:02:55,920 –> 00:02:58,200

، زیرا ثبات را قرار می دهیم، پس بیایید ادامه دهیم و

62

00:02:58,200 –> 00:03:00,420

این سلول را اجرا کنیم، بنابراین بیایید

63

00:03:00,420 –> 00:03:03,750

شکل متغیر جدید تولید شده را بررسی کنیم تا

64

00:03:03,750 –> 00:03:06,690

شکل نقطه X به ما 1000 بدهد. سطرهایی

65

00:03:06,690 –> 00:03:09,180

که مقدار اول است و مقدار دوم

66

00:03:09,180 –> 00:03:11,459

مربوط به پنج ستون است

67

00:03:11,459 –> 00:03:13,080

که تعدادی ویژگی در اینجا است که

68

00:03:13,080 –> 00:03:14,910

قبلاً مقدار پنج را به آنها اختصاص داده ایم و

69

00:03:14,910 –> 00:03:18,299

سپس شکل نقطه y به ما 1000 می دهد

70

00:03:18,299 –> 00:03:20,250

که در اینجا همان بعد خواهد بود

71

00:03:20,250 –> 00:03:22,799

زیرا وجود دارد 1000 نمونه و هیچ

72

00:03:22,799 –> 00:03:25,260

مقداری از این یکی پیروی نمی کند، بنابراین

73

00:03:25,260 –> 00:03:27,510

یک ستون وجود دارد که برچسب کلاس Y

74

00:03:27,510 –> 00:03:29,549

است، بنابراین مرحله بعدی که

75

00:03:29,549 –> 00:03:31,830

انجام می دهیم این است که داده ها را به 8020 تقسیم می

76

00:03:31,830 –> 00:03:34,489

کنیم، بنابراین کتابخانه را وارد می کنیم.

77

00:03:34,489 –> 00:03:36,780

به خصوص ما از twee استفاده خواهیم کرد n

78

00:03:36,780 –> 00:03:39,090

تست از بسته scikit-learn

79

00:03:39,090 –> 00:03:41,940

جدا می شود، بنابراین ادامه دهید و آن را اجرا کنید و نمایش

80

00:03:41,940 –> 00:03:44,190

با استفاده از این تقسیم آزمایشی قطار در اینجا انجام

81

00:03:44,190 –> 00:03:46,709

می شود و ما

82

00:03:46,709 –> 00:03:49,560

متغیرهای x و y را که مربوط

83

00:03:49,560 –> 00:03:52,350

به پنج ویژگی ورودی

84

00:03:52,350 –> 00:03:55,739

و برچسب کلاس است وارد می کنیم. اندازه تست با 0.2

85

00:03:55,739 –> 00:03:58,380

که 20% است و سپس 80% برای tween خواهد بود

86

00:03:58,380 –> 00:04:00,799

و بنابراین در اینجا ما چهار

87

00:04:00,799 –> 00:04:03,420

متغیر را به طور همزمان تولید میکنیم

88

00:04:03,420 –> 00:04:06,930

و ترن x test y و

89

00:04:06,930 –> 00:04:09,420

چرا تستها را فشرده میکند بنابراین دو x در اینجا

90

00:04:09,420 –> 00:04:11,760

ویژگیهای ورودی هستند. پنج ویژگی ورودی

91

00:04:11,760 –> 00:04:14,310

و تستهای باران سفید و y

92

00:04:14,310 –> 00:04:17,339

برچسبهای کلاس هستند درست است، بنابراین از قطار x

93

00:04:17,339 –> 00:04:19,798

و باران سفید برای

94

00:04:19,798 –> 00:04:21,750

تولید مدل یادگیری ماشین استفاده میشود و

95

00:04:21,750 –> 00:04:23,720

پس از انجام این کار، میخواهیم

96

00:04:23,720 –> 00:04:25,400

مدل یادگیری ماشینی را اعمال کنیم. برای

97

00:04:25,400 –> 00:04:27,710

انجام یک پیش بینی که از

98

00:04:27,710 –> 00:04:29,900

تست X استفاده خواهیم کرد، بنابراین ذکر می کنیم که در

99

00:04:29,900 –> 00:04:32,090

زیر، اجازه دهید بعد داده را بررسی کنیم

100

00:04:32,090 –> 00:04:34,790

تا X underscore آموزش داده شده بر روی

101

00:04:34,790 –> 00:04:36,740

شکل، هشتصد در پنج را به ما بدهد

102

00:04:36,740 –> 00:04:38,540

زیرا هشتصد نمونه وجود دارد

103

00:04:38,540 –> 00:04:41,210

و می شود. چون هشتاد درصد از 1000

104

00:04:41,210 –> 00:04:43,190

هشتصد است و چرا آموزش روی

105

00:04:43,190 –> 00:04:45,950

شکل به ما هشتصد سطر می دهد و یک

106

00:04:45,950 –> 00:04:50,120

ستون X شکل آزمایشی به ما 205 می دهد

107

00:04:50,120 –> 00:04:52,190

که مربوط به دویست نمونه

108

00:04:52,190 –> 00:04:55,310

و پنج ستون است که چرا آزمایش یک شکل

109

00:04:55,310 –> 00:04:58,370

به ما دویست می دهد. قسمت سرگرم کننده

110

00:04:58,370 –> 00:05:00,800

درست اینجاست، بنابراین ما

111

00:05:00,800 –> 00:05:02,950

همه ماژول ها را وارد می کنیم تا اولین مورد

112

00:05:02,950 –> 00:05:05,900

پانداهای SP de برای نسل بعدی

113

00:05:05,900 –> 00:05:07,940

چارچوب داده

114

00:05:07,940 –> 00:05:10,910

نتایج باشد و سپس تکه بزرگ کد

115

00:05:10,910 –> 00:05:13,040

در اینجا تمام ماژول های یادگیری ماشین خواهد بود.

116

00:05:13,040 –> 00:05:16,220

الگوریتمهایی که ما استفاده میکنیم، بنابراین آن را

117

00:05:16,220 –> 00:05:18,860

اجرا میکنیم و نام همه

118

00:05:18,860 –> 00:05:20,330

الگوریتمهای یادگیری ماشین

119

00:05:20,330 –> 00:05:23,660

در اینجا در این فهرست نامها نشان داده میشود و

120

00:05:23,660 –> 00:05:25,670

سپس طبقهبندیکنندهها فهرستی از

121

00:05:25,670 –> 00:05:27,830

همه الگوریتمهای یادگیری ماشینی را

122

00:05:27,830 –> 00:05:29,630

که ما داریم، نشان میدهند. بنابراین در اینجا

123

00:05:29,630 –> 00:05:33,530

از ورودی اصلی برای الگوریتمها استفاده میکنیم،

124

00:05:33,530 –> 00:05:35,419

بنابراین در یک ویدیوی آینده احتمالاً

125

00:05:35,419 –> 00:05:37,280

د