در این مطلب، ویدئو دوره کامل TensorFlow 2.0 – آموزش شبکه های عصبی پایتون برای مبتدیان با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 6:52:08

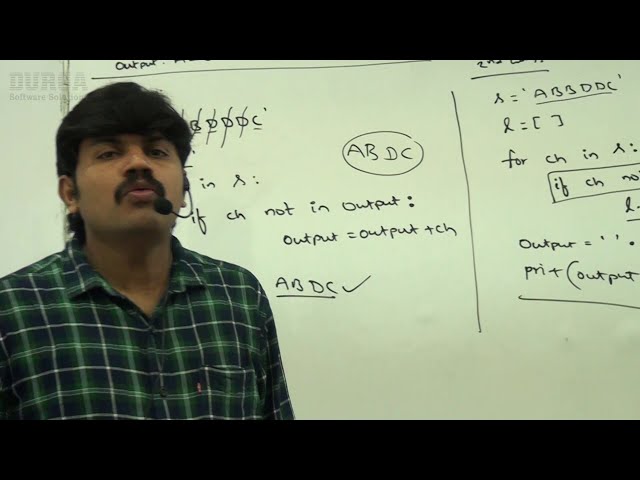

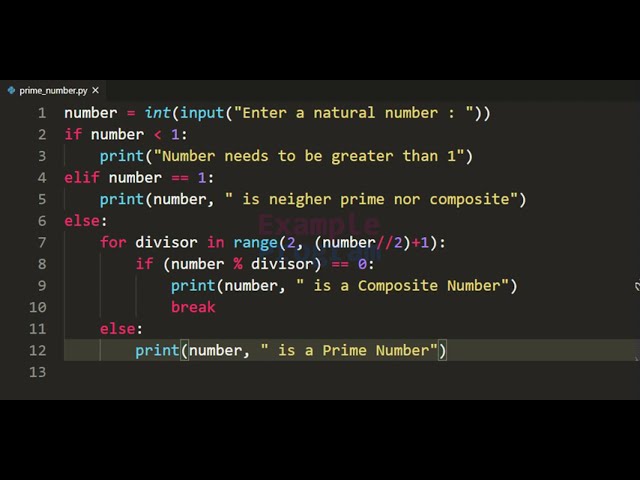

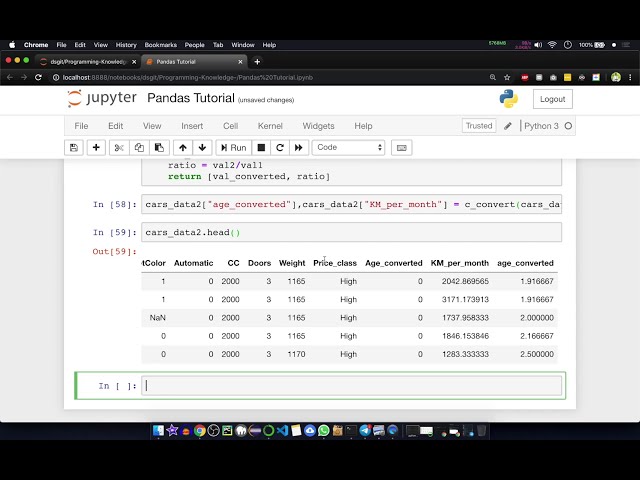

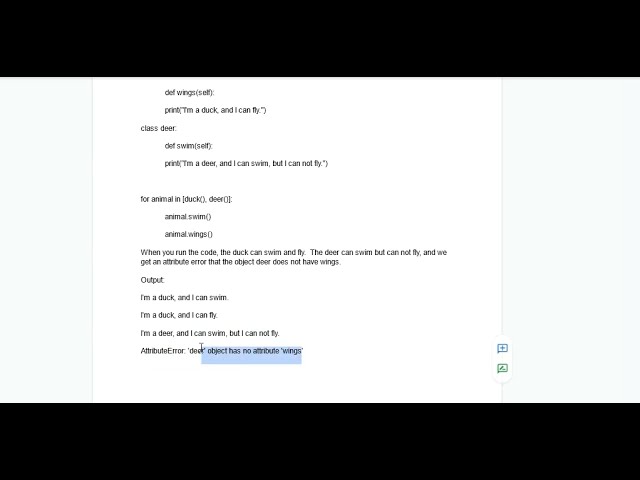

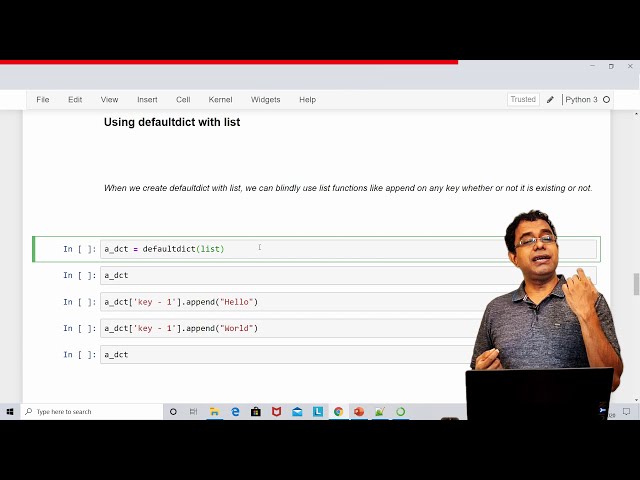

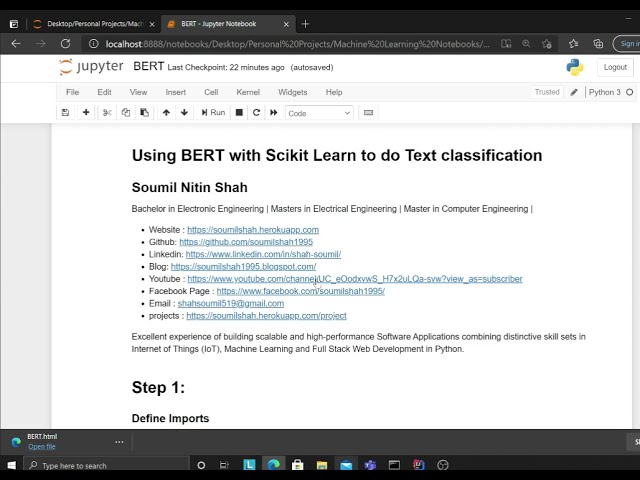

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,290 –> 00:00:05,490

سلام، به همه، و به یک یادگیری ماشینی

کاملاً عظیم TensorFlow خوش آمدید

2

00:00:05,490 –> 00:00:09,940

دوره هوش مصنوعی اسلش اکنون، لطفاً برای

این مقدمه کوتاه با من همراه باشید،

3

00:00:09,940 –> 00:00:14,210

از آنجایی که من قصد دارم اطلاعات مهم زیادی

در مورد محتوای دوره به شما بدهم،

4

00:00:14,210 –> 00:00:18,700

منابع دوره، و آنچه می توانید پس از گذراندن

آن انتظار داشته باشید. اکنون،

5

00:00:18,700 –> 00:00:23,540

ابتدا به شما خواهم گفت که این دوره برای چه کسانی طراحی

شده است. بنابراین این دوره برای افراد در نظر گرفته شده است

6

00:00:23,540 –> 00:00:27,710

که در یادگیری ماشین و هوش مصنوعی مبتدی

هستند یا شاید کمی داشته باشند

7

00:00:27,710 –> 00:00:32,149

کمی درک می کنند، اما سعی می کنند بهتر

شوند، اما دانش اساسی اساسی دارند

8

00:00:32,149 –> 00:00:36,500

برنامه نویسی و پایتون بنابراین اگر این

کار را نکرده اید، این دوره آموزشی نیست

9

00:00:36,500 –> 00:00:41,050

قبلاً هر گونه برنامه نویسی انجام داده اید، یا اگر به طور

کلی دستور زبان پایتون را نمی دانید، این کار انجام می شود.

10

00:00:41,050 –> 00:00:45,220

به شدت توصیه می شود که سینتکس اساسی پشت

پایتون را درک کنید، زیرا من قصد ندارم

11

00:00:45,220 –> 00:00:48,900

تا در طول این دوره توضیح داده شود. در حال

حاضر، از نظر مربی خود را برای این

12

00:00:48,900 –> 00:00:53,290

البته، این من خواهم بود، نام من تیم است، ممکن است برخی

از شما من را به عنوان یک متخصص فناوری بشناسید

13

00:00:53,290 –> 00:00:56,880

تیم، از کانال یوتیوب من، انواع موضوعات

مختلف برنامه نویسی را آموزش می دهد.

14

00:00:56,880 –> 00:01:00,480

و من در واقع با Free Code Camp کار کردهام و برخی

از سریالهایم را در آنها پست کردهام

15

00:01:00,480 –> 00:01:04,729

کانال نیز حالا بیایید وارد دوره آموزشی بشویم

و دقیقاً در مورد آنچه هستید صحبت کنیم

16

00:01:04,729 –> 00:01:08,510

قرار است یاد بگیرید و چه انتظاراتی از این دوره

دارید. بنابراین همانطور که این دوره به سمت

17

00:01:08,510 –> 00:01:12,390

مبتدیان، و افرادی که تازه در دنیای یادگیری ماشینی

و هوش مصنوعی شروع کرده اند، ما هستیم

18

00:01:12,390 –> 00:01:16,170

با تجزیه و تحلیل دقیق یادگیری ماشین

و هوش مصنوعی شروع می کنیم

19

00:01:16,170 –> 00:01:20,100

است. بنابراین صحبت در مورد اینکه چه تفاوت هایی

بین آنها وجود دارد، انواع مختلف آنها

20

00:01:20,100 –> 00:01:24,450

یادگیری ماشین، یادگیری تقویتی، به عنوان

مثال، در مقابل شبکه های عصبی در مقابل

21

00:01:24,450 –> 00:01:29,210

یادگیری ماشینی ساده، ما با تمام آن تفاوتهای

مختلف روبرو خواهیم شد. و سپس

22

00:01:29,210 –> 00:01:33,090

ما قصد داریم به معرفی کلی TensorFlow بپردازیم.

در حال حاضر، برای کسانی از شما که

23

00:01:33,090 –> 00:01:37,440

نمی دانم، TensorFlow یک ماژول است که توسط گوگل توسعه یافته

و نگهداری می شود و می توان از آن استفاده کرد

24

00:01:37,440 –> 00:01:41,880

در پایتون به انجام یک تن از محاسبات علمی

مختلف، یادگیری ماشین و مصنوعی

25

00:01:41,880 –> 00:01:45,510

کاربردهای هوش ما در کل آموزش

با آن کار خواهیم کرد

26

00:01:45,510 –> 00:01:49,450

سلسله. و پس از انجام این مقدمه کلی برای TensorFlow،

میخواهیم وارد برنامه خود شویم

27

00:01:49,450 –> 00:01:53,340

الگوریتم های اصلی یادگیری اکنون، اینها الگوریتم

های یادگیری هستند که باید بدانید

28

00:01:53,340 –> 00:01:58,160

قبل از اینکه بتوانیم بیشتر به یادگیری ماشین برویم،

آنها یک پایه واقعا قوی ایجاد می کنند، آنها هستند

29

00:01:58,160 –> 00:02:02,650

درک و پیاده سازی بسیار آسان است. و آنها فوق العاده

قدرتمند هستند. بعد از انجام این کار،

30

00:02:02,650 –> 00:02:06,070

ما قصد داریم وارد شبکههای

عصبی شویم

31

00:02:06,070 –> 00:02:09,449

شبکههای عصبی کار میکنند، چگونه میتوانیم از آنها استفاده

کنیم، و سپس مجموعهای از نمونههای مختلف را انجام دهیم.

32

00:02:09,449 –> 00:02:13,269

و سپس به برخی از جنبه های پیچیده تر

یادگیری ماشینی و مصنوعی می پردازیم

33

00:02:13,269 –> 00:02:17,760

هوش و رسیدن به شبکه های عصبی کانولوشن، که

می توانند کارهایی مانند تشخیص تصویر را انجام دهند

34

00:02:17,760 –> 00:02:20,989

و تشخیص و سپس وارد شبکه های عصبی

تکراری خواهیم شد، که هستند

35

00:02:20,989 –> 00:02:26,590

کارهایی مانند پردازش زبان طبیعی، رباتهای گفتگو،

پردازش متن، و همه اینها متفاوت است

36

00:02:26,590 –> 00:02:31,279

انواع چیزها، و در نهایت با یادگیری

تقویتی به پایان رسید. حالا از نظر منابع

37

00:02:31,279 –> 00:02:35,090

برای این دوره، تعداد زیادی وجود دارد، و کاری که ما

قصد داریم انجام دهیم تا این را واقعاً انجام دهیم

38

00:02:35,090 –> 00:02:39,799

آسان برای شما و برای من، انجام همه کارها از

طریق Google Collaboratory است. حالا اگر شما

39

00:02:39,799 –> 00:02:43,879

در مورد Google Collaboratory چیزی نشنیدهام، اساساً این

یک محیط برنامهنویسی مشترک است که

40

00:02:43,879 –> 00:02:49,120

یک نوت بوک iPython را در فضای ابری، روی یک دستگاه Google اجرا

می کند که در آن می توانید همه کارهای خود را انجام دهید

41

00:02:49,120 –> 00:02:53,080

یادگیری ماشینی به صورت رایگان بنابراین شما نیازی

به نصب هیچ بسته ای ندارید، نیازی به نصب ندارید

42

00:02:53,080 –> 00:02:57,183

از Pip استفاده کنید، نیازی به تنظیم محیط خود ندارید، تنها

کاری که باید انجام دهید این است که یک Google جدید باز کنید

43

00:02:57,183 –> 00:03:00,930

پنجره همکاری، و می توانید شروع به نوشتن کد کنید.

و این کاری است که ما انجام خواهیم داد

44

00:03:00,930 –> 00:03:04,890

در این سریال اگر همین الان به توضیحات نگاه کنید،

پیوندهایی به همه موارد را خواهید دید

45

00:03:04,890 –> 00:03:09,170

نوت بوک هایی که در این راهنما استفاده می کنم. بنابراین

اگر چیزی وجود دارد که می خواهید پاک کنید

46

00:03:09,170 –> 00:03:12,840

بالا، اگر کد را برای خود میخواهید، اگر میخواهید

فقط توضیحات مبتنی بر متن را داشته باشید

47

00:03:12,840 –> 00:03:16,579

چیزهایی که من می گویم، می توانید روی آن پیوندها

کلیک کنید و به آنها دسترسی پیدا کنید. پس با آن

48

00:03:16,579 –> 00:03:20,849

گفته می شود، من برای شروع بسیار هیجان زده هستم، امیدوارم

شما بچه ها نیز همینطور باشید. و بریم

49

00:03:20,849 –> 00:03:27,200

پیش بروید و وارد محتوا شوید.

50

00:03:27,200 –> 00:03:30,599

بنابراین در این بخش اول، من قصد دارم چند دقیقه

ای را صرف بحث در مورد تفاوت بین آنها کنم

51

00:03:30,599 –> 00:03:35,349

هوش مصنوعی، شبکه های عصبی و یادگیری

ماشینی. و دلیلی که ما نیاز داریم

52

00:03:35,349 –> 00:03:38,359

به این دلیل است که ما همه این موضوعات

را در طول این پوشش خواهیم داد

53

00:03:38,359 –> 00:03:42,409

دوره. بنابراین بسیار مهم است که شما بچه ها بفهمید که اینها در

واقع چه معنایی دارند. و شما می توانید مهربانی کنید

54

00:03:42,409 –> 00:03:46,540

از تمایز بین آنها بنابراین این چیزی است که ما اکنون

روی آن تمرکز خواهیم کرد. اکنون، سلب مسئولیت سریع

55

00:03:46,540 –> 00:03:50,390

در اینجا، فقط برای اینکه همه بدانند، من از چیزی

به نام Windows Inc استفاده می کنم. این فقط پیش فرض است

56

00:03:50,390 –> 00:03:53,599

همراه با ویندوز است، من یک تبلت طراحی

دارم. و این چیزی است که من خواهم شد

57

00:03:53,599 –> 00:03:58,499

برای برخی از بخش های توضیحی استفاده می شود، اما

هیچ کدنویسی واقعی وجود ندارد، فقط برای نشان دادن

58

00:03:58,499 –> 00:04:03,489

برخی از مفاهیم و موضوعات به شما. الان دستخط

خیلی وحشتناکی دارم، اهل هنر نیستم

59

00:04:03,489 –> 00:04:08,360

به هر حال، برنامه نویسی قطعاً بیشتر

از آنچه که می دانید، طراحی و

60

00:04:08,360 –> 00:04:11,769

انجام نمودارها و چیزهای دیگر اما من تمام

تلاشم را خواهم کرد. و این فقط راه آن است

61

00:04:11,769 –> 00:04:16,140

من متوجه شدم که می توانم بهترین اطلاعات را به شما عزیزان

منتقل کنم. بنابراین به هر حال، بیایید شروع کنیم و

62

00:04:16,140 –> 00:04:20,820

اولین موضوع را اینجا مطرح کنید که هوش

مصنوعی است. حالا هوش مصنوعی

63

00:04:20,820 –> 00:04:25,070

این روزها یک تبلیغات بزرگ است. و خنده دار است زیرا

بسیاری از مردم واقعاً نمی دانند این چیست

64

00:04:25,070 –> 00:04:29,890

به معنای. یا سعی کردند به مردم بگویند

آنچه ساخته اند هوش مصنوعی نیست،

65

00:04:29,890 –> 00:04:35,090

در حالی که در واقعیت، در واقع اینطور است. در حال

حاضر نوعی تعریف رسمی از AI و من فقط می خواهم

66

00:04:35,090 –> 00:04:38,690

آن را از اسلاید من در اینجا بخوانید تا مطمئن

شوید که این کار را خراب نمی کنم، این تلاش است

67

00:04:38,690 –> 00:04:45,080

برای خودکار کردن وظایف فکری که معمولاً توسط انسان انجام

می شود. حالا، این یک تعریف نسبتا بزرگ است،

68

00:04:45,080 –> 00:04:50,130

درست؟ کاری که یک وظیفه فکری تلقی می

شود و، می دانید، واقعاً کمکی نمی کند

69

00:04:50,130 –> 00:04:54,560

ما بیش از حد بنابراین کاری که می خواهم انجام دهم این است که ما را به زمانی

برگردانم که هوش مصنوعی برای اولین بار برای مهربانی ایجاد شد

70

00:04:54,560 –> 00:04:59,810

برای شما توضیح دهد که هوش مصنوعی چگونه تکامل یافته

است و واقعاً چه چیزی در سال 1950 شروع شد

71

00:04:59,810 –> 00:05:05,000

یک نوع سوال توسط دانشمندان و محققین

پرسیده می شد، کامپیوترها

72

00:05:05,000 –> 00:05:09,520

فکر کنید، آیا می توانیم آنها را وادار کنیم تا مسائل را بفهمند؟

آیا می توانیم از کدنویسی سخت دور شویم؟ و شما

73

00:05:09,520 –> 00:05:13,780

آیا میدانیم، آیا میتوانیم رایانهای را وادار کنیم که فکر

کند آیا میتواند کار خودش را انجام دهد؟ پس همین بود

74

00:05:13,780 –> 00:05:17,590

نوعی سوالی که پرسیده شد و این زمانی

بود که اصطلاح هوش مصنوعی بود

75

00:05:17,590 –> 00:05:23,670

نوعی ابداع و خلق شده است. در آن زمان هوش مصنوعی صرفاً

مجموعه ای از قوانین از پیش تعریف شده بود. بنابراین

76

00:05:23,670 –> 00:05:28,420

اگر به هوش مصنوعی فکر می کنید، شاید مانند تیک تاک

پا، یا هوش مصنوعی برای شطرنج، همه آنها

77

00:05:28,420 –> 00:05:32,980

در آن زمان قوانین از پیش تعریف شده ای وجود دارد

که انسان ها به وجود آورده و تایپ کرده اند

78

00:05:32,980 –> 00:05:37,260

کامپیوتر در کد و کامپیوتر به سادگی آن مجموعه

قوانین را اجرا می کند و از آنها پیروی می کند

79

00:05:37,260 –> 00:05:42,150

آن دستورالعمل ها بنابراین هیچ الگوریتم دیوانه وار

یادگیری ماشینی یادگیری عمیق وجود نداشت،

80

00:05:42,150 –> 00:05:46,560

به سادگی اگر میخواهید رایانه کاری

انجام دهد، باید از قبل به آن بگویید،

81

00:05:46,560 –> 00:05:51,420

بگو تو در این موقعیت هستی و این اتفاق می افتد، این کار را انجام

دهید. و این همان چیزی بود که هوش مصنوعی بود. و خیلی

82

00:05:51,420 –> 00:05:56,470

هوش مصنوعی خوب صرفاً مجموعهای از قوانین بسیار خوب بود که تعداد

زیادی از قوانین متفاوتی را که انسانها داشت، تشکیل میداد

83

00:05:56,470 –> 00:06:00,510

در برخی از برنامه ها پیاده سازی شده بود، شما می توانید برنامه

های هوش مصنوعی داشته باشید که در حال گسترش هستند

84

00:06:00,510 –> 00:06:04,930

بدانید، نیم میلیون خط کد، فقط با

تن و تن و تن از قوانین مختلف

85

00:06:04,930 –> 00:06:10,700

که برای آن هوش مصنوعی ایجاد شده اند. بنابراین فقط حواستان

باشد که هوش مصنوعی لزوماً به این معنا نیست

86

00:06:10,700 –> 00:06:15,830

هر چیز دیوانه کننده، پیچیده یا فوق العاده پیچیده.

اما اساساً، اگر میخواهید شبیهسازی کنید

87

00:06:15,830 –> 00:06:20,660

یک کار فکری، مانند انجام یک بازی که یک

انسان با کامپیوتر انجام می دهد، آن

88

00:06:20,660 –> 00:06:25,970

هوش مصنوعی در نظر گرفته شده است، بنابراین حتی یک هوش مصنوعی بسیار

ابتدایی برای بازی تیک تاک پا که در آن وجود دارد

89

00:06:25,970 –> 00:06:29,950

علیه شما بازی می کند، که هنوز هوش مصنوعی محسوب

می شود. و اگر به چیزی شبیه Pac فکر کنیم

90

00:06:29,950 –> 00:06:33,780

مرد، درست است، جایی که ما، می دانید، روح کوچکمان

را داریم، و این طرح اولیه من خواهد بود

91

00:06:33,780 –> 00:06:38,360

یک روح، ما پسر Pac Man خود را داریم که فقط همین

خواهد بود. خوب، وقتی این را در نظر می گیریم

92

00:06:38,360 –> 00:06:45,410

هوش مصنوعی شبح، کاری که انجام می دهد این است که تلاش می

کند نحوه رسیدن به Pac Man را بیابد و شبیه سازی کند،

93

00:06:45,410 –> 00:06:49,630

درست. و نحوه کار این فقط با استفاده از یک الگوریتم

مسیریابی بسیار ابتدایی است. این دارد

94

00:06:49,630 –> 00:06:53,310

هیچ ربطی به یادگیری عمیق، یا یادگیری ماشینی یا

هر چیز دیوانه کننده ای ندارد. اما این هنوز است

95

00:06:53,310 –> 00:06:58,200

در نظر گرفته شده هوش مصنوعی، کامپیوتر در حال کشف کردن

است که چگونه می تواند به نوعی بازی کند و

96

00:06:58,200 –> 00:07:02,170

با پیروی از یک الگوریتم کاری انجام دهید. بنابراین

لزوماً نیازی به داشتن چیزی نداریم

97

00:07:02,170 –> 00:07:07,510

پیچیده احمقانه و احمقانه که باید هوش مصنوعی در نظر

گرفته شود، فقط باید برخی از آن ها را شبیه سازی کند

98

00:07:07,510 –> 00:07:12,180

رفتار عقلانی انسان این نوعی

تعریف هوش مصنوعی است.

99

00:07:12,180 –> 00:07:16,900

اکنون، بدیهی است، امروز، هوش مصنوعی به حوزه بسیار پیچیدهتری

تبدیل شده است که در حال حاضر آن را داریم

100

00:07:16,900 –> 00:07:20,020

یادگیری ماشین و یادگیری عمیق و همه این

تکنیک های دیگر، چیزی که ما هستیم

101

00:07:20,020 –> 00:07:24,170

الان در موردش صحبت می کنیم بنابراین کاری که میخواهم

با انجام آن شروع کنم، کشیدن یک دایره در اینجا است.

102

00:07:24,170 –> 00:07:29,660

و من می خواهم به این دایره برچسب بزنم و بگویم، A، من

آن را دوست دارم. بنابراین این AI را تعریف می کند،

103

00:07:29,660 –> 00:07:34,360

زیرا هر چیزی که می خواهم در اینجا

قرار دهم، هوش مصنوعی محسوب می شود.

104

00:07:34,360 –> 00:07:38,230

خب حالا بیایید به یادگیری ماشین بپردازیم. بنابراین کاری

که من می خواهم انجام دهم این است که یک دایره دیگر بکشم

105

00:07:38,230 –> 00:07:44,050

داخل اینجا و ما این دایره را برای یادگیری ماشین

برچسب گذاری می کنیم. حالا توجه کنید

106

00:07:44,050 –> 00:07:48,480

من این را در دایره هوش مصنوعی قرار دادم. این

به این دلیل است که یادگیری ماشینی است

107

00:07:48,480 –> 00:07:54,210

بخشی از هوش مصنوعی حال، یادگیری ماشین

چیست؟ خوب، چیزی که ما صحبت کردیم

108

00:07:54,210 –> 00:08:00,050

قبلاً، نوعی این ایده بود که هوش مصنوعی فقط

مجموعه ای از قوانین از پیش تعریف شده بود،

109

00:08:00,050 –> 00:08:04,790

درست؟ جایی که اتفاقی می افتد، ما مقداری داده

را تغذیه می کنیم، قوانین را دنبال می کنیم

110

00:08:04,790 –> 00:08:08,450

توسط و سپس داده ها را با قوانین تجزیه و تحلیل کنید.

و سپس مقداری خروجی را بیرون می آوریم که

111

00:08:08,450 –> 00:08:12,310

آیا می دانید، ما قرار است چه کار کنیم. بنابراین

در مثال کلاسیک شطرنج، بگویید، ما هستیم

112

00:08:12,310 –> 00:08:17,240

در بررسی، آنچه که ما اطلاعات آن برد را به رایانه ارسال

می کنیم، مجموعه قوانین آن را بررسی می کند،

113

00:08:17,240 –> 00:08:21,500

آن را مشخص می کند که ما تحت کنترل هستیم، و سپس

ما را به جای دیگری منتقل می کند. حالا ماشین چیه

114

00:08:21,500 –> 00:08:26,310

یادگیری در مقابل آن؟ خوب، یادگیری

ماشین اولین زمینه ای است که در واقع

115

00:08:26,310 –> 00:08:31,650

قوانین را برای ما تعیین می کند بنابراین به جای اینکه

ما قوانین را به سختی در رایانه کدنویسی کنیم،

116

00:08:31,650 –> 00:08:36,479

کاری که یادگیری ماشین انجام میدهد این است

که دادهها را بگیرد و خروجی را بگیرد،

117

00:08:36,479 –> 00:08:38,360

و قوانین را برای ما مشخص کنید.

118

00:08:38,360 –> 00:08:39,360

بنابراین شما اغلب

119

00:08:39,360 –> 00:08:43,070

بشنوید که، می دانید، یادگیری ماشینی به داده های زیادی

نیاز دارد. و شما به نمونه های زیادی نیاز دارید

120

00:08:43,070 –> 00:08:48,430

و می دانید، داده های ورودی را برای آموزش واقعاً

یک مدل خوب وارد کنید. خوب، دلیل آن است

121

00:08:48,430 –> 00:08:52,809

زیرا روشی که یادگیری ماشینی کار می کند این است که

قوانین را برای ما ایجاد می کند. ما می دهیم

122

00:08:52,809 –> 00:08:57,471

مقداری از داده های ورودی به آن داده می شود که داده های

خروجی باید چه باشد. و سپس به آن نگاه می کند

123

00:08:57,471 –> 00:09:02,640

اطلاعات و کشف می کند که چه قوانینی را می توانیم ایجاد

کنیم، به طوری که وقتی به داده های جدید نگاه می کنیم،

124

00:09:02,640 –> 00:09:07,190

ما می توانیم بهترین خروجی ممکن را برای آن داشته باشیم.

در حال حاضر، به همین دلیل است که بسیاری از مواقع، ماشین

125

00:09:07,190 –> 00:09:12,209

مدل های یادگیری دقت 100% ندارند، به این

معنی که ممکن است لزوماً نباشند

126

00:09:12,209 –> 00:09:16,870

هر بار پاسخ صحیح را دریافت کنید و

هدف ما از ایجاد یادگیری ماشینی است

127

00:09:16,870 –> 00:09:20,870

مدلها این است که دقت ما را تا حد امکان بالا ببرند،

که به این معنی است که این کار را انجام میدهد

128

00:09:20,870 –> 00:09:25,269

کمترین اشتباه ممکن از آنجا که دقیقاً مانند یک

انسان، می دانید، مدل های یادگیری ماشینی ما،

129

00:09:25,269 –> 00:09:29,839

که در تلاش برای شبیه سازی هستند، می دانید، رفتار

انسان ممکن است اشتباه کند. اما به طور خلاصه

130

00:09:29,839 –> 00:09:35,069

که اساساً یادگیری ماشینی تفاوت بین آن

و نوع الگوریتمها را میدانید

131

00:09:35,069 –> 00:09:40,399

و هوش مصنوعی پایه این واقعیت است که به

جای ما برنامه نویس، آن را دریافت می کنیم

132

00:09:40,399 –> 00:09:45,279

قوانین را به آن می دهد. قوانین را برای ما مشخص

می کند. و ما ممکن است لزوماً ندانیم

133

00:09:45,279 –> 00:09:49,700

وقتی به یادگیری ماشین نگاه می کنیم و یادگیری

ماشین را ایجاد می کنیم، به صراحت قوانین چیست

134

00:09:49,700 –> 00:09:54,390

مدل ها. اما می دانیم که داده های ورودی را ارائه

می دهیم، خروجی مورد انتظار را ارائه می دهیم

135

00:09:54,390 –> 00:09:58,410

دادهها، و سپس به همه این اطلاعات نگاه میکند که الگوریتمهایی

را انجام میدهند که در مورد آنها صحبت خواهیم کرد

136

00:09:58,410 –> 00:10:03,339

بعداً و قوانین را برای ما مشخص می کند. به طوری

که بعداً وقتی به آن مقداری ورودی می دهیم

137

00:10:03,339 –> 00:10:07,350

دادهها، و ما دادههای خروجی را نمیدانیم، میتواند

از قوانینی که مشخص شده است استفاده کند

138

00:10:07,350 –> 00:10:11,920

از مثالهای ما و تمام دادههای آموزشی که

برای تولید خروجی به آن دادهایم. باشه،

139

00:10:11,920 –> 00:10:16,709

بنابراین این یادگیری ماشینی است. اکنون به هوش مصنوعی و یادگیری

ماشینی پرداخته ایم. و اکنون زمان آن فرا رسیده است

140

00:10:16,709 –> 00:10:21,639

برای پوشش شبکه های عصبی یا یادگیری عمیق. اکنون،

این دایره باید دقیقاً به داخل آن برود

141

00:10:21,639 –> 00:10:25,550

یادگیری ماشین دقیقاً در اینجا، من فقط می خواهم

به این یک و n که مخفف آن است برچسب بزنم

142

00:10:25,550 –> 00:10:30,480

شبکه های عصبی. در حال حاضر، شبکه های عصبی تبلیغات بزرگی

دریافت می کنند، آنها معمولا اولین چیزی هستند،

143

00:10:30,480 –> 00:10:33,680

می دانید، وقتی وارد یادگیری ماشینی می شوید، می خواهید

یاد بگیرید که شبکه های عصبی مهربان هستند

144

00:10:33,680 –> 00:10:37,709

مانند شبکه های عصبی جالب هستند، آنها قادر به کارهای

زیادی هستند. اما بیایید بحث کنیم که اینها چیست

145

00:10:37,709 –> 00:10:42,380

واقعا هستند بنابراین ساده ترین راه برای تعریف

یک شبکه عصبی آن به عنوان یک ماشین است

146

00:10:42,380 –> 00:10:47,699

یادگیری که از نمایش لایه ای داده ها استفاده

می کند. در حال حاضر، ما واقعا نمی فهمیم

147

00:10:47,699 –> 00:10:51,800

این کاملا در حال حاضر اما هرچه به جلوتر میرویم،

این موضوع باید حس بیشتری پیدا کند

148

00:10:51,800 –> 00:10:56,709

یک تعریف اما چیزی که باید به نوعی برای شما توضیح

دهم این است که در مثال قبلی، کجا

149

00:10:56,709 –> 00:11:00,399

ما فقط در مورد یادگیری ماشین صحبت کردیم، در اصل چیزی که

داشتیم این بود که حباب های ورودی داشتیم،

150

00:11:00,399 –> 00:11:04,569

که من می خواهم این را تعریف کنم، ما مجموعه ای

از قوانین داشتیم که در این بین قرار می گیرند

151

00:11:04,569 –> 00:11:08,519

در اینجا، و سپس ما مقداری خروجی داشتیم. و چه اتفاقی می

افتد این است که ما این ورودی را به این تغذیه کنیم

152

00:11:08,519 –> 00:11:14,019

مجموعه ای از قوانین، چیزی در اینجا اتفاق می افتد، و سپس

ما مقداری خروجی دریافت می کنیم. و سپس آن است

153

00:11:14,019 –> 00:11:17,579

آنچه می دانید، برنامه ما انجام می دهد، این چیزی است

که ما از مدل دریافت می کنیم، ما تقریباً فقط

154

00:11:17,579 –> 00:11:22,389

دارای دو لایه، یک نوع لایه ورودی،

لایه خروجی، و قوانین هستند

155

00:11:22,389 –> 00:11:27,129

چیزی که این دو لایه را به هم متصل می کند.

در حال حاضر در شبکه های عصبی، و چه

156

00:11:27,129 –> 00:11:31,560

ما یادگیری عمیق می نامیم، ما بیش از دو لایه داریم. در

حال حاضر، من فقط سعی می کنم همه چیز را پاک کنم

157

00:11:31,560 –> 00:11:36,019

این به سرعت بنابراین من می توانم آن را به شما نشان دهم. پس بیایید

بگوییم و همه روزنامه نگاران رنگ دیگری می خواهند،

158

00:11:36,019 –> 00:11:40,800

چرا که نه اگر ما در مورد شبکه های عصبی صحبت می کنیم،

آنچه ممکن است داشته باشیم، و این خواهد شد

159

00:11:40,800 –> 00:11:44,779

متفاوت است، و من در یک ثانیه در مورد این صحبت خواهم

کرد این واقعیت است که ما یک لایه ورودی داریم که

160

00:11:44,779 –> 00:11:49,620

اولین لایه داده ما خواهد بود، ما می توانیم

چند لایه در بین این لایه داشته باشیم

161

00:11:49,620 –> 00:11:54,990

همه به هم متصل هستند و سپس می توانیم مقداری لایه

خروجی داشته باشیم. بنابراین اساسا، چه

162

00:11:54,990 –> 00:12:00,980

اتفاق می افتد این است که داده های ما از طریق لایه

های مختلف و چیزهای مختلف تبدیل می شوند

163

00:12:00,980 –> 00:12:05,379

قرار است اتفاق بیفتد، ارتباطات مختلفی بین

این لایه ها وجود خواهد داشت. و سپس

164

00:12:05,379 –> 00:12:09,360

در نهایت به یک خروجی خواهیم رسید. اکنون توضیح

شبکه های عصبی بسیار دشوار است

165

00:12:09,360 –> 00:12:14,740

بدون اینکه به طور کامل عمیق شود. بنابراین ما چند

یادداشت دیگر را که در اینجا دارم پوشش خواهیم داد. اساسا،

166

00:12:14,740 –> 00:12:18,450

در شبکه های عصبی، ما فقط چندین لایه داریم،

این راهی است که باید به آن فکر کرد

167

00:12:18,450 –> 00:12:22,910

آنها و همانطور که ما یادگیری ماشین را می بینیم،

شما بچه ها باید این را بیشتر درک کنید.

168

00:12:22,910 –> 00:12:26,480

اما فقط درک کنید که ما با چندین لایه سروکار

داریم. و بسیاری از مردم در واقع

169

00:12:26,480 –> 00:12:31,850

این را فرآیند استخراج اطلاعات چند مرحله ای

می نامید. حالا من به این فکر نکردم

170

00:12:31,850 –> 00:12:35,889

مدت، اصطلاح. من فکر می کنم از یک کتاب یا چیزی است. اما

اساساً آنچه در نهایت اتفاق می افتد این است

171

00:12:35,889 –> 00:12:39,500

ما داده های خود را در این لایه اول داریم،

که همان اطلاعات ورودی است که می رویم

172

00:12:39,500 –> 00:12:43,709

برای انتقال به مدلی که قرار است کاری با

آن انجام دهیم، سپس به مدل دیگری می رود

173

00:12:43,709 –> 00:12:48,990

لایه، جایی که تبدیل خواهد شد، با استفاده از یک لایه

از پیش تعریف شده، به چیز دیگری تغییر خواهد کرد

174

00:12:48,990 –> 00:12:54,319

مجموعهای از قوانین و وزنها که بعداً در مورد

آن صحبت خواهیم کرد، سپس از آن عبور خواهد کرد

175

00:12:54,319 –> 00:12:58,360

همه این لایههای مختلف ویژگیهای متفاوتی

از دادهها بودند که باز هم،

176

00:12:58,360 –> 00:13:03,630

ما در یک ثانیه بحث خواهیم کرد استخراج

خواهد شد مشخص خواهد شد تا در نهایت

177

00:13:03,630 –> 00:13:07,649

ما به یک لایه خروجی می رسیم که در آن می توانیم هر

چیزی را که در مورد آن کشف کرده ایم ترکیب کنیم

178

00:13:07,649 –> 00:13:12,629

داده ها را به نوعی خروجی تبدیل می کند که برای برنامه ما

معنادار است. بنابراین این یک نوع بهترین است

179

00:13:12,629 –> 00:13:16,800

کاری که میتوانم برای توضیح شبکههای عصبی بدون رفتن

به سطح عمیقتر انجام دهم، این را میدانم

180

00:13:16,800 –> 00:13:20,639

احتمالاً بسیاری از شما در حال حاضر نمیدانید

که آنها چه هستند. و این کاملاً خوب است.

181

00:13:20,639 –> 00:13:26,459

اما فقط بدانید که نمایش لایه ای از داده ها وجود

دارد، ما چندین لایه اطلاعات داریم.

182

00:13:26,459 –> 00:13:30,980

در حالی که در یادگیری ماشینی استاندارد، ما

فقط یک یا دو لایه و سپس شما را می شناسیم

183

00:13:30,980 –> 00:13:35,490

هوش مصنوعی به طور کلی، ما لزوما نباید مانند

یک از پیش تعریف شده داشته باشیم

184

00:13:35,490 –> 00:13:36,959

مجموعه ای از لایه ها

185

00:13:36,959 –> 00:13:38,399

باشه پس

186

00:13:38,399 –> 00:13:42,529

تقریباً برای شبکه های عصبی است، آخرین چیزی

که در مورد آنها خواهم گفت این است

187

00:13:42,529 –> 00:13:46,749

آنها در واقع از مغز الگوبرداری نشده اند. بنابراین

به نظر می رسد بسیاری از مردم چنین فکر می کنند

188

00:13:46,749 –> 00:13:50,889

شبکهها بر اساس مغز و این واقعیت که نورونهایی

در بدن شما شلیک میکنند، مدلسازی میشوند

189

00:13:50,889 –> 00:13:55,610

مغز و این می تواند به شبکه های عصبی مربوط شود. در حال

حاضر، یک الهام بیولوژیکی برای وجود دارد

190

00:13:55,610 –> 00:14:00,660

شبکه های عصبی را به روشی که از زیست شناسی انسان

کار می کنند نام ببرید، اما همینطور است

191

00:14:00,660 –> 00:14:04,329

لزوماً در مورد نحوه عملکرد مغز ما مدل

سازی نشده است. و در واقع، ما در واقع

192

00:14:04,329 –> 00:14:08,371

واقعاً نمیدانم بسیاری از چیزهای مغز ما چگونه

عمل میکنند و چگونه کار میکنند. پس می شود

193

00:14:08,371 –> 00:14:12,600

برای ما غیرممکن است که بگوییم شبکه های عصبی

بر اساس مغز مدل شده اند، زیرا ما در واقع

194

00:14:12,600 –> 00:14:17,660

نمی دانم اطلاعات چگونه اتفاق می افتد و رخ

می دهد و از طریق مغز ما منتقل می شود.

195

00:14:17,660 –> 00:14:22,209

یا حداقل ما به اندازه کافی نمی دانیم که بتوانیم

بگوییم این دقیقا همان چیزی است که یک عصبی است

196

00:14:22,209 –> 00:14:25,550

شبکه. بنابراین به هر حال، این آخرین نکته

در آنجا بود. خوب، حالا ما نیاز داریم

197

00:14:25,550 –> 00:14:31,329

در مورد داده ها صحبت کنید اکنون داده ها مهمترین

بخش یادگیری ماشین و هوش مصنوعی است.

198

00:14:31,329 –> 00:14:36,939

شبکه های عصبی نیز و بسیار مهم است که

بفهمیم داده ها چقدر مهم هستند و

199

00:14:36,939 –> 00:14:40,149

انواع مختلف قطعات آن چیست، زیرا قرار

است به آنها ارجاع زیادی شود

200

00:14:40,149 –> 00:14:44,529

در هر یک از منابعی که ما استفاده می کنیم. اکنون کاری

که من می خواهم انجام دهم این است که فقط یک مثال ایجاد کنم

201

00:14:44,529 –> 00:14:49,699

در اینجا، من قصد دارم یک مجموعه داده درست کنم که در

مورد نمرات نهایی دانش آموزان مانند یک مدرسه باشد

202

00:14:49,699 –> 00:14:53,689

سیستم. بنابراین اساسا، ما این را به یک مثال بسیار آسان

تبدیل خواهیم کرد. ما تمام چیزی هستیم که می خواهیم

203

00:14:53,689 –> 00:14:57,329

دارای برای این مجموعه داده است که ما اطلاعاتی در مورد

دانش آموزان خواهیم داشت. بنابراین ما می خواهیم

204

00:14:57,329 –> 00:15:01,920

نمره میان ترم خود را یک، میان ترم به نمره،

و سپس ما آنها را خواهیم داشت

205

00:15:01,920 –> 00:15:08,811

نمرهی نهایی. بنابراین من فقط می خواهم بگویم میان

ترم، یک. و باز هم دست خط من را در اینجا ببخشید

206

00:15:08,811 –> 00:15:14,079

نوشتن با این تبلت طراحی ساده ترین کار نیست.

و بعد من فقط فینال را انجام می دهم.

207

00:15:14,079 –> 00:15:18,019

بنابراین این مجموعه داده ما خواهد بود. و ما در واقع

تعدادی مجموعه داده مشابه با این را خواهیم دید

208

00:15:18,019 –> 00:15:22,959

همانطور که در ادامه می گذریم و نمونه هایی را انجام می

دهیم. بنابراین برای دانش آموز، که ما فقط قرار می دهیم

209

00:15:22,959 –> 00:15:27,639

برخی از دانشآموزان اینجا، ما میخواهیم نمره میان

ترم آنها را بگیریم، شاید این نمره 70 باشد.

210

00:15:27,639 –> 00:15:32,129

میان ترم تا نمره، شاید 80 بود. و بعد فرض

کنید فینال آنها مانند آنها بود

211

00:15:32,129 –> 00:15:37,839

نمره ترم آخر، نه فقط نمره امتحان نهایی،

بیایید به آنها نمره 77 بدهیم

212

00:15:37,839 –> 00:15:41,999

میان ترم می توان به کسی 60 داد، شاید ما به

او 90 بدهیم، و سپس آن را تعیین می کنیم

213

00:15:41,999 –> 00:15:47,720

نمره نهایی در امتحان آنها، فرض کنید، 84 بود.

و سپس ما می توانیم با شاید کاری انجام دهیم

214

00:15:47,720 –> 00:15:55,670

در اینجا یک نمره پایین تر، بنابراین 4050، و سپس

شاید آنها 38، یا چیزی در نمره نهایی گرفته اند.

215

00:15:55,670 –> 00:15:59,259

اکنون، بدیهی است که ما میتوانیم اطلاعات دیگری را در اینجا

داشته باشیم که شاید در آنجا اعتراف میکنیم

216

00:15:59,259 –> 00:16:02,879

برخی از امتحانات، برخی تکالیف، هر

کار دیگری که انجام دادند کمک کرد

217

00:16:02,879 –> 00:16:07,470

به درجه آنها اما مشکلی که من می خواهم در اینجا

در نظر بگیرم این واقعیت است که با توجه به ما

218

00:16:07,470 –> 00:16:12,009

میان ترم، یک نمره و میان ترم به نمره و نمره نهایی

ما، چگونه می توانم از این اطلاعات استفاده کنم

219

00:16:12,009 –> 00:16:17,439

برای پیش بینی هر یک از این سه ستون. پس اگر

میان ترم دانشجویی به من داده شود، یک

220

00:16:17,439 –> 00:16:21,790

نمره، و نمره نهایی یک دانش آموز به من داده شد،

چگونه می توانم میان ترم آنها را پیش بینی کنم

221

00:16:21,790 –> 00:16:28,129

مقطع تحصیلی. بنابراین اینجا جایی است که ما در مورد ویژگی

ها و برچسب ها صحبت خواهیم کرد. حالا هر اطلاعاتی که باشه

222

00:16:28,129 –> 00:16:32,379

ما داریم که اطلاعات ورودی است، که اطلاعاتی

است که ما همیشه آن را خواهیم داشت

223

00:16:32,379 –> 00:16:37,360

ما باید به مدل بدهیم تا مقداری خروجی بگیریم چیزی که

ما آن را ویژگی های خود می نامیم. بنابراین در مثال

224

00:16:37,360 –> 00:16:41,279

جایی که ما سعی می کنیم میان ترم دو را پیش بینی کنیم، و

بیایید این کار را انجام دهیم و این را برجسته کنیم

225

00:16:41,279 –> 00:16:46,740

به رنگ قرمز، بنابراین ما متوجه می شویم که چه

ویژگی هایی داریم، اطلاعات ورودی ما چیست

226

00:16:46,740 –> 00:16:51,879

میان ترم خواهد بود و در نهایت، زیرا این اطلاعاتی

است که ما از آن استفاده خواهیم کرد

227

00:16:51,879 –> 00:16:56,480

برای پیشبینی چیزی، ورودی است، آن چیزی است

که باید مدل را ارائه کنیم. و اگر ما هستیم

228

00:16:56,480 –> 00:17:00,389

آموزش یک مدل برای نگاه کردن به نمره میان ترم

یک و آخر، هر زمان که بخواهیم جدید بسازیم

229

00:17:00,389 –> 00:17:04,849

پیش بینی، برای انجام این کار باید آن اطلاعات را داشته

باشیم. اکنون، آنچه با رنگ قرمز مشخص شده است،

230

00:17:04,849 –> 00:17:11,078

بنابراین این میان ترم دو در اینجا چیزی است که

ما آن را برچسب یا خروجی می نامیم. حالا، برچسب

231

00:17:11,079 –> 00:17:16,200

چیزی است که ما سعی می کنیم به دنبال آن باشیم یا پیش بینی

کنیم. بنابراین وقتی در مورد ویژگی ها در مقابل صحبت می کنیم

232

00:17:16,200 –> 00:17:20,030

برچسبها، ویژگیها اطلاعات ورودی ما هستند،

اطلاعاتی که ما به آن نیاز داریم

233

00:17:20,030 –> 00:17:25,010

برای پیش بینی استفاده کنید. و برچسب

ما آن اطلاعات خروجی است که فقط نشان می دهد

234

00:17:25,010 –> 00:17:30,050

شما می دانید ما به دنبال چه هستیم بنابراین وقتی ویژگی

های خود را به یک مدل تغذیه می کنیم، او خواهد داد

235

00:17:30,050 –> 00:17:34,000

برای ما یک برچسب و این نکته ای است که

ما باید آن را درک کنیم. پس این بود

236

00:17:34,000 –> 00:17:38,270

اساسی در اینجا و اکنون من فقط می خواهم کمی بیشتر در

مورد داده ها صحبت کنم، زیرا ما این کار را خواهیم کرد

237

00:17:38,270 –> 00:17:41,920

با ادامه کار و اهمیت آن بیشتر به این

موضوع بپردازید.

238

00:17:41,920 –> 00:17:42,920

پس دلیل آن

239

00:17:42,920 –> 00:17:48,550

داده ها بسیار مهم هستند، این چیزی است که ما برای

ایجاد مدل ها از آن استفاده می کنیم. بنابراین

240

00:17:48,550 –> 00:17:52,970

هر زمان که در حال انجام هوش مصنوعی و یادگیری ماشینی هستیم، تقریباً

به داده نیاز داریم، مگر اینکه شما این کار را انجام دهید

241

00:17:52,970 –> 00:17:56,680

یک نوع بسیار خاص از یادگیری ماشینی و هوش مصنوعی،

که ما در مورد آن صحبت خواهیم کرد

242

00:17:56,680 –> 00:18:00,880

در مورد بعد اکنون برای اکثر این مدل ها،

ما به هزاران داده مختلف نیاز داریم

243

00:18:00,880 –> 00:18:04,760

از نمونه های مختلف و این به این دلیل است که ما می

دانیم یادگیری ماشین در حال حاضر چگونه کار می کند

244

00:18:04,760 –> 00:18:10,400

اساساً، ما سعی میکنیم قوانینی را برای یک مجموعه

داده ارائه کنیم، ما مقداری اطلاعات ورودی داریم،

245

00:18:10,400 –> 00:18:14,920

ما برخی از اطلاعات خروجی یا برخی ویژگی ها و برخی برچسب

ها را داریم، می توانیم آن را به یک مدل بدهیم

246

00:18:14,920 –> 00:18:19,470

و به آن بگویید که آموزش را شروع کند. و کاری که انجام

خواهد داد این است که قوانینی را ارائه کند که ما

247

00:18:19,470 –> 00:18:22,980

فقط می تواند برخی از ویژگی ها را در آینده

به مدل بدهد. و سپس باید بتواند

248

00:18:22,980 –> 00:18:28,360

یک تخمین خوب از اینکه خروجی باید چقدر باشد به

ما بدهید. بنابراین وقتی در حال تمرین هستیم،

249

00:18:28,360 –> 00:18:33,700

ما مجموعه ای از داده های آموزشی داریم. و این

داده هایی است که در آن ما همه ویژگی ها و

250

00:18:33,700 –> 00:18:37,970

همه برچسب ها بنابراین ما همه این اطلاعات را

داریم، پس زمانی که می خواهیم آزمایش کنیم

251

00:18:37,970 –> 00:18:42,760

مدل یا بعداً از مدل استفاده کنید، ما

این اطلاعات میان ترم را نداریم

252

00:18:42,760 –> 00:18:46,820

این را در مدل پاس نمیکنیم، ما فقط ویژگیهایمان

را پاس میکنیم، که میانترم است

253

00:18:46,820 –> 00:18:51,420

و نهایی و سپس خروجی میان ترم دو را می گیریم.

بنابراین امیدوارم که منطقی باشد.

254

00:18:51,420 –> 00:18:56,060

این فقط به این معنی است که داده ها بسیار مهم هستند.

اگر داده ها یا داده های نادرستی را تغذیه می کنیم

255

00:18:56,060 –> 00:19:00,280

ما نباید از مدلی استفاده کنیم که قطعاً می

تواند منجر به اشتباهات زیادی شود. و

256

00:19:00,280 –> 00:19:04,100

اگر اطلاعات خروجی نادرست یا اطلاعات

ورودی نادرست داریم

257

00:19:04,100 –> 00:19:07,730

همچنین باعث اشتباهات زیادی شود، زیرا اساساً این

همان چیزی است که مدل از آن استفاده می کند

258

00:19:07,730 –> 00:19:12,690

یاد بگیرند و به نوعی توسعه دهند و بفهمند که

قرار است با اطلاعات ورودی جدید چه کاری انجام دهد.

259

00:19:12,690 –> 00:19:16,650

بنابراین به هر حال، این اطلاعات کافی است. حالا بیایید

در مورد انواع مختلف ماشین صحبت کنیم

260

00:19:16,650 –> 00:19:20,830

یادگیری. خوب، حالا که تفاوت بین هوش

مصنوعی را مورد بحث قرار دادیم،

261

00:19:20,830 –> 00:19:25,050

یادگیری ماشین و شبکه های عصبی، ما نوعی ایده مناسب

در مورد اینکه داده ها در آن قرار دارند، داریم

262

00:19:25,050 –> 00:19:29,470

تفاوت بین ویژگی ها و برچسب ها وقت آن است

که در مورد انواع مختلف صحبت کنیم

263

00:19:29,470 –> 00:19:35,000

یادگیری ماشین به طور خاص، که یادگیری

بدون نظارت، یادگیری نظارت شده است

264

00:19:35,000 –> 00:19:39,270

و یادگیری تقویتی اکنون، اینها

فقط انواع مختلف یادگیری هستند

265

00:19:39,270 –> 00:19:43,910

انواع فهمیدن چیزها اکنون، انواع مختلف الگوریتمها

در این الگوریتمهای متفاوت قرار میگیرند

266

00:19:43,910 –> 00:19:48,230

مقولههایی از درون هوش مصنوعی در

یادگیری ماشینی و درون عصبی

267

00:19:48,230 –> 00:19:52,050

شبکه های. بنابراین اولین موردی که قرار است

در مورد آن صحبت کنیم، یادگیری تحت نظارت است

268

00:19:52,050 –> 00:19:57,610

چیزی که قبلاً بحث کردیم. بنابراین من فقط

با نظارت اینجا می نویسم. باز هم بهانه

269

00:19:57,610 –> 00:20:02,130

دست خط بنابراین تحت نظارت یادگیری. حالا

این چیه؟

270

00:20:02,130 –> 00:20:03,130

خوب، تحت نظارت

271

00:20:03,130 –> 00:20:07,680

یادگیری نوعی از همه چیزهایی است که قبلاً آموخته ایم،

که این است که ما برخی ویژگی ها را داریم. بنابراین

272

00:20:07,680 –> 00:20:12,170

ما ویژگی های خود را اینگونه می نویسیم، درست است،

ما برخی از ویژگی ها را داریم. و آن ویژگی ها

273

00:20:12,170 –> 00:20:18,340

با برخی از برچسب ها یا برچسب های بالقوه مطابقت دارد،

گاهی اوقات ممکن است بیش از یک اطلاعات را پیش بینی کنیم.

274

00:20:18,340 –> 00:20:22,340

بنابراین وقتی این اطلاعات را داریم، ویژگیها

را داریم، و برچسبهایی را داریم که چه

275

00:20:22,340 –> 00:20:26,570

ما انجام می دهیم این است که این اطلاعات را به برخی از مدل

های یادگیری ماشینی منتقل می کنیم، آن را تشخیص می دهد

276

00:20:26,570 –> 00:20:30,630

قوانین برای ما و بعداً، تنها چیزی که نیاز داریم

ویژگیهاست. و مقداری به ما خواهد داد

277

00:20:30,630 –> 00:20:35,040

برچسب هایی که از آن قوانین استفاده می کنند. اما اساساً

آنچه یادگیری تحت نظارت است، زمانی است که داریم

278

00:20:35,040 –> 00:20:39,540

هر دوی این اطلاعات، دلیلی که تحت نظارت نامیده

می شود این است که چه چیزی به پایان می رسد

279

00:20:39,540 –> 00:20:44,840

زمانی که مدل یادگیری ماشین خود را آموزش میدهیم

این است که اطلاعات ورودی را ارسال میکنیم

280

00:20:44,840 –> 00:20:49,320

با استفاده از قوانینی که از قبل می داند، برخی پیش

بینی های دلخواه انجام می دهد. و سپس مقایسه می کند

281

00:20:49,320 –> 00:20:54,540

پیشبینیای که انجام داد تا پیشبینی واقعی

چیست، که این برچسب است. پس ما

282

00:20:54,540 –> 00:20:59,500

بر مدل نظارت کنید و ما می گوییم، خوب، پس شما

پیش بینی کردید که رنگ قرمز است، اما واقعا،

283

00:20:59,500 –> 00:21:03,180

رنگ هر چیزی که می گذشتیم باید آبی می بود.

بنابراین ما فقط باید شما را اصلاح کنیم

284

00:21:03,180 –> 00:21:07,110

کمی تا کمی بهتر شوید و

در مسیر درست حرکت کنید.

285

00:21:07,110 –> 00:21:10,920

و این به نوعی کار می کند. به عنوان مثال، بگویید

ما در حال پیش بینی هستیم، می دانید،

286

00:21:10,920 –> 00:21:15,670

نمره نهایی دانش آموز، خوب، اگر پیش بینی

کنیم که نمره نهایی 76 باشد، اما واقعی

287

00:21:15,670 –> 00:21:20,940

بهترین 77، ما خیلی نزدیک بودیم، اما کاملاً آنجا

نیستیم. بنابراین ما بر مدل نظارت می کنیم

288

00:21:20,940 –> 00:21:24,990

و ما می گوییم، هی، ما شما را کمی تغییر می

دهیم، شما را در مسیر درست حرکت می دهیم.

289

00:21:24,990 –> 00:21:29,830

و امیدواریم شما را به 77 برسانیم. و این راهی

برای توضیح این موضوع است، درست است، شما

290

00:21:29,830 –> 00:21:33,770

ویژگی ها را دارند بنابراین شما برچسبها را دارید،

وقتی ویژگیها را پاس میکنید، مدل دارای آن است

291

00:21:33,770 –> 00:21:38,050

برخی از قوانین، و از قبل ساخته شده است، پیش

بینی می کند. و سپس آن پیش بینی را مقایسه می کند

292

00:21:38,050 –> 00:21:43,500

به برچسب، و سپس دوباره مدل را تغییر دهید

و این کار را با 1000s روی 1000s ادامه دهید

293

00:21:43,500 –> 00:21:48,500

بر روی 1000 قطعه داده تا زمانی که در نهایت آنقدر

خوب شود که بتوانیم آموزش را متوقف کنیم.

294

00:21:48,500 –> 00:21:52,990

و این همان چیزی است که یادگیری تحت نظارت است، این

رایج ترین نوع یادگیری است، قطعاً همینطور است

295

00:21:52,990 –> 00:21:57,630

بیشترین کاربرد در بسیاری از موارد. و اکثر

الگوریتم های یادگیری ماشین که

296

00:21:57,630 –> 00:22:02,130

در واقع از نوعی یادگیری ماشینی نظارت شده استفاده

می شود. بسیاری از مردم به نظر می رسد

297

00:22:02,130 –> 00:22:06,590

فکر کنید که این یک روش کمتر پیچیده و کمتر پیشرفته

برای انجام کارها است. به این معنا که

298

00:22:06,590 –> 00:22:09,860

قطعا درست نیست همه روشهای مختلف، میخواهم

به شما بگویم که متفاوت هستند

299

00:22:09,860 –> 00:22:14,930

مزایا و معایب. و این مزیت بزرگی دارد که

شما تعداد زیادی از آن را داشته باشید

300

00:22:14,930 –> 00:22:19,440

اطلاعات و شما خروجی آن اطلاعات را نیز دارید.

اما گاهی اوقات ما این کار را نمی کنیم

301

00:22:19,440 –> 00:22:23,270

لوکس این کار را داشته باشید و اینجاست که ما

در مورد یادگیری بدون نظارت صحبت می کنیم.

302

00:22:23,270 –> 00:22:27,870

بنابراین امیدوارم که برای یادگیری نظارت شده منطقی

باشد، تمام تلاشم را کردم تا آن را توضیح دهم. و

303

00:22:27,870 –> 00:22:33,380

اکنون برای یادگیری نظارت شده وارد یا متأسفیم.

حالا بیایید به یادگیری بدون نظارت برویم.

304

00:22:33,380 –> 00:22:37,690

بنابراین اگر تعریف یادگیری تحت نظارت

را بدانیم، امیدواریم بتوانیم بیایم

305

00:22:37,690 –> 00:22:43,710

با تعریفی از یادگیری بدون نظارت، یعنی زمانی که ما

فقط ویژگی ها را داریم. بنابراین داده شده است

306

00:22:43,710 –> 00:22:50,170

مجموعه ای از ویژگی های مانند این، و مطلقا بدون

برچسب، هیچ خروجی برای این ویژگی ها. چی

307

00:22:50,170 –> 00:22:55,290

ما می خواهیم انجام دهیم این است که مدلی با آن برچسب ها

برای ما ارائه دهد. در حال حاضر، این یک نوع است

308

00:22:55,290 –> 00:22:59,350

عجیب و غریب. شما یک جورهایی شبیه ویت هستید، چطور کار

می کند؟ اصلاً چرا می خواهیم این کار را انجام دهیم؟

309

00:22:59,350 –> 00:23:05,231

خوب، بیایید این را به عنوان مثال در نظر بگیریم. ما برخی

از محورها و محورهای داده داریم، بسیار خوب. و ما

310

00:23:05,231 –> 00:23:09,870

مانند یک نقطه داده دو بعدی است. بنابراین من

فقط می خواهم این را صدا کنم، فرض کنید x، و

311

00:23:09,870 –> 00:23:14,390

بیایید بگوییم y، بسیار خوب، و من فقط می خواهم

یک دسته از نقطه ها را روی صفحه نمایش بگذارم.

312

00:23:14,390 –> 00:23:18,700

شاید یک نمودار پراکنده از برخی از داده های

مختلف ما را نشان دهد. و من فقط می روم

313

00:23:18,700 –> 00:23:21,760

برای قرار دادن برخی نقاط به طور خاص به نقاط دیگر،

314

00:23:21,760 –> 00:23:25,760

فقط به این دلیل که شما بچه ها به نوعی هدف کاری که ما در اینجا

می خواهیم انجام دهیم را متوجه شوید. پس بیایید انجام دهیم

315

00:23:25,760 –> 00:23:30,810

که خوب، پس فرض کنید من این مجموعه داده را دارم،

این چیزی است که ما با آن کار می کنیم.

316

00:23:30,810 –> 00:23:36,190

و ما این ویژگی ها را داریم، ویژگی های

این نمونه، x و y خواهند بود، درست است؟

317

00:23:36,190 –> 00:23:41,490

بنابراین X و Y ویژگی های من هستند. اکنون ما

هیچ خروجی خاصی برای این داده ها نداریم

318

00:23:41,490 –> 00:23:46,630

نکته، آنچه ما در واقع می خواهیم انجام دهیم این

است که می خواهیم نوعی مدل ایجاد کنیم که بتواند

319

00:23:46,630 –> 00:23:52,140

این نقاط داده را خوشه بندی کنید، به این معنی که

گروه های منحصر به فردی از داده ها را دریابید

320

00:23:52,140 –> 00:23:55,860

و بگویید، خوب، پس شما در گروه یک، در گروه

دو هستید، در گروه سه هستید، و شما

321

00:23:55,860 –> 00:24:01,020

در گروه چهار، ممکن است لزوماً ندانیم

چند گروه داریم، هرچند گاهی اوقات

322

00:24:01,020 –> 00:24:05,610

ما انجام می دهیم. اما کاری که ما می خواهیم انجام دهیم این است که فقط

آنها را گروه بندی کنیم و به نوعی بگوییم، خوب، می خواهیم بفهمیم

323

00:24:05,610 –> 00:24:09,900

مشخص کنید که کدام یک شبیه هستند و ما می خواهیم

آنها را با هم ترکیب کنیم. پس امیدوارم، چه

324

00:24:09,900 –> 00:24:14,280

ما میتوانیم با یک مدل یادگیری ماشینی بدون نظارت انجام

دهیم، همه این ویژگیها را پاس کنیم و سپس

325

00:24:14,280 –> 00:24:19,630

مدلی از این گروه بندی ها را ایجاد کند. پس مثل

اینکه شاید این یک گروه باشد، شاید این

326

00:24:19,630 –> 00:24:24,020

یک گروه است، شاید اگر ما چهار گروه داشتیم

این یک گروه باشد و شاید اگر داشتیم

327

00:24:24,020 –> 00:24:28,550

دو گروه بندی، ممکن است گروه بندی هایی دریافت کنیم

که چیزی شبیه به این هستند، درست است. و سپس

328

00:24:28,550 –> 00:24:33,320

هنگامی که ما یک نقطه داده جدید را به آن منتقل می

کنیم، می توانیم بفهمیم که کدام گروه یک است

329

00:24:33,320 –> 00:24:38,550

بخشی از با تعیین، می دانید که به کدام یک

نزدیکتر است. حالا این یک نوع خشن است

330

00:24:38,550 –> 00:24:42,270

مثال. باز هم توضیح دادن همه اینها بدون

پرداختن به عمق زیاد دشوار است

331

00:24:42,270 –> 00:24:46,810

الگوریتم های خاص اما یادگیری ماشینی بدون نظارت

یا به طور کلی فقط یادگیری زمانی است

332

00:24:46,810 –> 00:24:51,500

اطلاعات خروجی ندارید شما در واقع

می خواهید مدل آن را بفهمد

333

00:24:51,500 –> 00:24:55,430

خروجی برای شما و واقعاً برایتان مهم نیست که چگونه

به آنجا می رسد. شما فقط می خواهید آن را دریافت کنید

334

00:24:55,430 –> 00:25:00,010

آنجا. و دوباره، یک مثال خوب، خوشه بندی نقاط داده

است، و ما در مورد برخی موارد خاص صحبت خواهیم کرد

335

00:25:00,010 –> 00:25:04,410

کاربردهایی که ممکن است بعداً بخواهیم از آن

استفاده کنیم، فقط متوجه شوید که دارید

336

00:25:04,410 –> 00:25:09,040

ویژگیها، برچسبها را ندارید و مدل بدون

نظارت را به نوعی دریافت میکنید

337

00:25:09,040 –> 00:25:10,690

آن را برای شما رقم بزنید باشه پس

338

00:25:10,690 –> 00:25:14,650

اکنون آخرین نوع ما که با دو نوع که توضیح

دادم بسیار متفاوت است، نامیده می شود

339

00:25:14,650 –> 00:25:19,160

یادگیری تقویتی الان شخصاً یادگیری را تقویت می

کنم و حتی نمی دانم که بخواهم یا نه

340

00:25:19,160 –> 00:25:25,430

این را املا کنم زیرا احساس می کنم دارم

آن را خراب می کنم. یادگیری تقویتی است

341

00:25:25,430 –> 00:25:30,030

جالب ترین نوع یادگیری ماشینی به نظر من. و این زمانی

است که شما در واقع هیچ کدام را ندارید

342

00:25:30,030 –> 00:25:35,580

داده ها، شما چیزی را دارید که به آن یک عامل می

گویید، و محیط و یک پاداش. من می خواهم توضیح دهم

343

00:25:35,580 –> 00:25:40,471

این به طور خلاصه با یک مثال بسیار بسیار بسیار

ساده، زیرا بدست آوردن آن نیز سخت است

344

00:25:40,471 –> 00:25:44,880

دور پس فرض کنید ما یک بازی بسیار ابتدایی داریم،

می دانید، شاید این بازی را خودمان ساخته ایم.

345

00:25:44,880 –> 00:25:49,480

و اساساً هدف بازی رسیدن به

جریان است. باشه، همین

346

00:25:49,480 –> 00:25:54,430

است، ما مقداری زمین داریم، شما می توانید از چپ به

راست حرکت کنید، و ما می خواهیم به این پرچم برسیم.

347

00:25:54,430 –> 00:25:59,290

خوب، ما می خواهیم چند هوش مصنوعی، یک مدل یادگیری ماشینی

را آموزش دهیم که بتواند شکل بگیرد

348

00:25:59,290 –> 00:26:06,840

نحوه انجام این کار بنابراین کاری که ما انجام میدهیم این است

که این را عامل خود مینامیم، ما آن را کل مینامیم.

349

00:26:06,840 –> 00:26:12,370

بنابراین کل این موضوع اینجاست، محیط زیست. بنابراین حدس

میزنم میتوانم آن را اینجا بنویسم. بنابراین و

350

00:26:12,370 –> 00:26:18,050

منظور ما، فکر کنید من آن را درست نوشتم.

و سپس چیزی به نام پاداش داریم.

351

00:26:18,050 –> 00:26:22,920

و پاداش اساساً همان چیزی است که عامل وقتی کاری را

به درستی انجام می دهد، دریافت می کند. بنابراین

352

00:26:22,920 –> 00:26:27,000

فرض کنید نماینده یک گام در این راه برمی دارد. بنابراین

بیایید بگوییم که او یک موقعیت جدید است،

353

00:26:27,000 –> 00:26:31,210

من فقط می خواهم به کشیدن او ادامه دهم. بنابراین من فقط

از یک نقطه استفاده می کنم. خوب، او به آن نزدیکتر شد

354

00:26:31,210 –> 00:26:36,810

پرچم. بنابراین کاری که من در واقع انجام خواهم داد این است

که به او یک جایزه بعلاوه دو بدهم. پس بیایید بگوییم او

355

00:26:36,810 –> 00:26:42,940

دوباره حرکت میکند، به پرچم نزدیکتر میشود، شاید

الان به او بعلاوه یک بدهم، این بار، او حتی نزدیکتر شد.

356

00:26:42,940 –> 00:26:48,070

و هر چه نزدیکتر می شود، من به او پاداش بیشتری

می دهم. حالا اگر حرکت کند چه اتفاقی می افتد

357

00:26:48,070 –> 00:26:52,600

به عقب؟ پس بیایید این را پاک کنیم. و بیایید

بگوییم که در مقطعی از زمان، به جای

358

00:26:52,600 –> 00:26:58,940

با نزدیک شدن به پرچم، او به سمت عقب حرکت می

کند، خوب، ممکن است یک جایزه منفی دریافت کند.

359

00:26:58,940 –> 00:27:05,240

اکنون، اساساً هدف این عامل این است که

پاداش خود را به حداکثر برساند.

360

00:27:05,240 –> 00:27:09,860

بنابراین اگر برای حرکت رو به عقب به آن جایزه منفی

بدهید، به یاد میآورد که همینطور است

361

00:27:09,860 –> 00:27:14,750

می خواهم بگویم، خوب، در این موقعیت اینجا، جایی

که ایستاده بودم، وقتی به عقب حرکت کردم،

362

00:27:14,750 –> 00:27:19,720

جایزه منفی گرفتم بنابراین اگر به این موقعیت

برسم، باز هم نمیخواهم به عقب برگردم

363

00:27:19,720 –> 00:27:25,530

دیگر، من می خواهم به جلو بروم، زیرا این

باید یک پاداش مثبت به من بدهد. و

364

00:27:25,530 –> 00:27:31,100

نکته اصلی این است که ما این نماینده را داریم

که بدون هیچ ایده ای شروع می کند، نه

365

00:27:31,100 –> 00:27:36,360

می دانید، نوعی دانش از محیط زیست است. و کاری که انجام

می دهد این است که شروع به کاوش می کند، و

366

00:27:36,360 –> 00:27:40,880

این ترکیبی از کاوش تصادفی و کاوش با استفاده از

نوعی از چیزهایی است که به دست آمده است

367

00:27:40,880 –> 00:27:46,510

تا کنون، سعی کنید پاداش خود را به حداکثر برسانید.

بنابراین در نهایت، زمانی که عامل به

368

00:27:46,510 –> 00:27:51,970

پرچم، بیشترین پاداش ممکن را

خواهد داشت. و دفعه بعد

369

00:27:51,970 –> 00:27:57,190

اگر این عامل را به محیط وصل کنیم، میداند

چگونه فوراً به پرچم برسد،

370

00:27:57,190 –> 00:28:00,960

چون به نوعی متوجه شده است، مشخص شده

است که در تمام این موقعیت های مختلف،

371

00:28:00,960 –> 00:28:06,220

اگر من به اینجا نقل مکان کنم، اینجا بهترین مکان برای نقل

مکان است. بنابراین اگر در این موقعیت قرار گرفتم، به آنجا بروید.

372

00:28:06,220 –> 00:28:10,360

اکنون باز هم توضیح این موضوع بدون مثالهای

دقیقتر و ریاضیات بیشتر دشوار است

373

00:28:10,360 –> 00:28:14,850

و همه اینها، اما اساساً، فقط میدانیم که ما

عامل را داریم، که به نوعی همان چیزی است

374

00:28:14,850 –> 00:28:19,771

مسئله این است که در محیط ما در حال حرکت است، ما

این جادوگر محیط را داریم، که این است

375

00:28:19,771 –> 00:28:24,340

فقط چیزی که نماینده می تواند در آن جابجا شود.

و سپس ما یک جایزه داریم. و ثواب همین است

376

00:28:24,340 –> 00:28:28,690

ما باید به عنوان برنامه نویس راهی برای پاداش

صحیح به عامل پیدا کنیم تا بتوانیم

377

00:28:28,690 –> 00:28:35,150

به بهترین شکل ممکن به هدف می رسد. اما عامل

به سادگی آن پاداش را به حداکثر می رساند.

378

00:28:35,150 –> 00:28:38,810

بنابراین فقط متوجه می شود که برای به حداکثر رساندن آن

پاداش باید به کجا بروم، از همان زمان شروع می شود

379

00:28:38,810 –> 00:28:42,340

شروع، به نوعی به طور تصادفی محیط را کاوش

می کند، زیرا هیچ یک از آنها را نمی شناسد

380

00:28:42,340 –> 00:28:45,970

پاداش هایی که در هر یک از موقعیت ها دریافت می کند. و

سپس به عنوان آن را به بررسی برخی از متفاوت تر است

381

00:28:45,970 –> 00:28:50,660

به نوعی قوانین و روشی که محیط کار

می کند را مشخص می کند. و سپس

382

00:28:50,660 –> 00:28:55,170

ما تعیین خواهیم کرد که چگونه به هدف برسیم،

یعنی هر چیزی که باشد، این بسیار است

383

00:28:55,170 –> 00:28:58,740

به عنوان مثال ساده، می توانید یک مدل تقویت کننده برای

این کار آموزش دهید. و میدونی، مثل نصف

384

00:28:58,740 –> 00:29:03,460

یک ثانیه، درست است اما نمونه های بسیار پیشرفته

تری وجود دارد. و نمونه هایی از تقویت وجود دارد

385

00:29:03,460 –> 00:29:08,330

یادگیری، مانند هوش مصنوعی تقریباً فهمیدن

اینکه چگونه با هم بازی کنیم چگونه است

386

00:29:08,330 –> 00:29:11,740

در واقع برخی از کارهایی که یادگیری تقویتی

انجام می دهد بسیار جالب است. و

387

00:29:11,740 –> 00:29:15,210

این یک نوع پیشرفت واقعاً عالی در این زمینه

است زیرا به این معنی است که ما نیازی نداریم

388

00:29:15,210 –> 00:29:19,620

همه این داده ها دیگر ما فقط می توانیم این را به

نوعی بفهمیم که چگونه کارها را انجام دهیم

389

00:29:19,620 –> 00:29:23,950

ما و محیط را کاوش کرده و خود به خود یاد بگیرید.

حالا این می تواند خیلی طول بکشد،

390

00:29:23,950 –> 00:29:27,700

این می تواند مدت زمان بسیار کمی طول بکشد

که واقعاً به محیط بستگی دارد. اما واقعی

391

00:29:27,700 –> 00:29:31,690

استفاده از این آموزش هوش مصنوعی برای بازی کردن است،

همانطور که ممکن است بتوانید از نوع خود بگویید

392

00:29:31,690 –> 00:29:35,810

از چیزی که اینجا توضیح می دادم و بله،

پس این نوعی تفاوت اساسی است

393

00:29:35,810 –> 00:29:40,350

بین یادگیری تحت نظارت، بدون نظارت و تقویتی،

ما هر سه مورد را پوشش خواهیم داد

394

00:29:40,350 –> 00:29:44,550

این موضوعات در طول این دوره و دیدن

برخی از برنامه ها واقعا جالب است

395

00:29:44,550 –> 00:29:47,570

ما در واقع می توانیم با این کار انجام دهیم. بنابراین با

این گفته، من قصد دارم به نوعی به چه چیزی پایان دهم

396

00:29:47,570 –> 00:29:52,470

من ماژول یک را می نامم، که فقط یک

نمای کلی از موضوعات مختلف است،

397

00:29:52,470 –> 00:29:56,270

برخی از تعاریف و کسب دانش اساسی.

و در مورد بعدی، آنچه ما هستیم

398

00:29:56,270 –> 00:30:00,320

قرار است در مورد آن صحبت کنیم که TensorFlow

چیست، ما کمی بعد وارد کد خواهیم شد

399

00:30:00,320 –> 00:30:04,321

کمی، و ما قصد داریم در مورد برخی از جنبه های مختلف

TensorFlow و چیزهایی که نیاز داریم بحث کنیم

400

00:30:04,321 –> 00:30:10,000

بدانید که می توانید به جلو حرکت کنید و کارهای پیشرفته

تری انجام دهید.

401

00:30:10,000 –> 00:30:13,480

بنابراین اکنون در ماژول دو این دوره، کاری که

میخواهیم انجام دهیم، دریافت یک کلیات است

402

00:30:13,480 –> 00:30:18,230

مقدمه ای بر TensorFlow، درک اینکه

تانسور چیست درک اشکال و

403

00:30:18,230 –> 00:30:23,370

نمایش داده ها، و سپس نحوه عملکرد

TensorFlow در سطح کمی پایین تر،

404

00:30:23,370 –> 00:30:27,240

این بسیار مهم است، زیرا مطمئناً می توانید از طریق

یادگیری ماشینی یاد بگیرید و یاد بگیرید

405

00:30:27,240 –> 00:30:31,450

بدون به دست آوردن این اطلاعات و دانش.

اما این کار را بسیار دشوارتر می کند

406

00:30:31,450 –> 00:30:35,280

مدل های خود را تغییر دهید و واقعا بفهمید که چه اتفاقی

می افتد، اگر این کار را نکنید، می دانید، دارید

407

00:30:35,280 –> 00:30:39,900

دانش سطح پایین تر در مورد نحوه

عملکرد و عملکرد TensorFlow.

408

00:30:39,900 –> 00:30:43,590

بنابراین این دقیقاً همان چیزی است که ما در اینجا به آن می

پردازیم. حالا، برای کسانی از شما که نمیدانید چیست

409

00:30:43,590 –> 00:30:47,850

TensorFlow اساساً یک کتابخانه یادگیری

ماشین منبع باز است. این یکی است

410

00:30:47,850 –> 00:30:51,980

یکی از بزرگترین آنها در جهان، یکی از شناخته

شده ترین ها است و از آن نگهداری می شود

411

00:30:51,980 –> 00:30:57,690

و توسط گوگل پشتیبانی می شود. اکنون، TensorFlow، اساساً

به ما اجازه می دهد تا ماشین را انجام دهیم و ایجاد کنیم

412

00:30:57,690 –> 00:31:01,640

مدلهای یادگیری و شبکههای عصبی، و همه اینها

بدون نیاز به داشتن یک چیز بسیار پیچیده

413

00:31:01,640 –> 00:31:05,980

پس زمینه ریاضی اکنون، همانطور که بیشتر وارد میشویم،

شروع میکنیم به بحث مفصلتر در مورد چگونگی

414

00:31:05,980 –> 00:31:09,740

متوجه خواهید شد که شبکه های عصبی کار می کنند و

الگوریتم های یادگیری ماشین در واقع کار می کنند

415

00:31:09,740 –> 00:31:14,390

ریاضیات زیادی در این مورد وجود

دارد. اکنون، بسیار اساسی است،

416

00:31:14,390 –> 00:31:19,330

مانند حساب پایه و جبر خطی پایه. و سپس

در مسائل بسیار پیشرفته تر می شود

417

00:31:19,330 –> 00:31:24,440

مانند نزول گرادیان، و برخی تکنیک های

رگرسیون و طبقه بندی بیشتر. و در اصل،

418

00:31:24,440 –> 00:31:29,030

می دانید، بسیاری از ما نمی دانیم که واقعاً نیازی

به دانستن آن نداریم، تا زمانی که بدانیم

419

00:31:29,030 –> 00:31:33,710

یک درک اولیه از آن، سپس می توانیم از ابزارهایی

که TensorFlow برای ما فراهم می کند استفاده کنیم

420

00:31:33,710 –> 00:31:38,380

برای ایجاد مدل ها و این دقیقاً همان کاری است که تنسورفلو

انجام می دهد. در حال حاضر، آنچه در حال حاضر در آن هستم

421

00:31:38,380 –> 00:31:42,230

چیزی است که من آن را Google Collaboratory می نامم. من در

یک ثانیه در این مورد عمیق تر صحبت خواهم کرد.

422

00:31:42,230 –> 00:31:47,540

اما کاری که من برای کل این دوره انجام داده ام، این

است که همه چیز را با جزئیات کامل رونویسی کرده ام

423

00:31:47,540 –> 00:31:51,590

که من قصد دارم از طریق هر ماژول پوشش

دهم. بنابراین این یک نوع رونویسی است

424

00:31:51,590 –> 00:31:56,680

ماژول یک، که مقدمه ای برای TensorFlow است،

می توانید ببینید که طولانی نیست.

425

00:31:56,680 –> 00:32:01,040

اما من می خواستم این کار را انجام دهم تا هر کدام

از شما بتوانید با نوعی از پایه متن دنبال کنید

426

00:32:01,040 –> 00:32:04,660

و از نوع یادداشتهای سخنرانی من، تقریباً میخواهم

آنها را در حین گذراندن موارد مختلف صدا بزنم

427

00:32:04,660 –> 00:32:08,960

محتوا. بنابراین در توضیحات، پیوندهایی به

تمام این نوت بوک های مختلف وجود خواهد داشت.

428

00:32:08,960 –> 00:32:12,560

این در چیزی به نام Google Collaboratory است، که مجدداً

در یک ثانیه به آن خواهیم پرداخت.

429

00:32:12,560 –> 00:32:16,440

اما در اینجا می توانید ببینید که من یک دسته

از متن دارم، و سپس به مقداری متفاوت می رسد

430

00:32:16,440 –> 00:32:20,340

جنبه های کدگذاری و کاری که قرار است انجام دهم تا

مطمئن شوم در مسیر باقی میمانم، ساده است

431

00:32:20,340 –> 00:32:24,900

در ادامه این مطلب، ممکن است کمی منحرف شوم،

ممکن است به چند نمونه دیگر بپردازم.

432

00:32:24,900 –> 00:32:29,200

این همه چیزهایی است که من در هر

ماژول پوشش خواهم داد. پس دوباره،

433

00:32:29,200 –> 00:32:35,190

برای پیگیری، روی لینک در توضیحات کلیک کنید. خوب، پس

با TensorFlow چه کاری می توانیم انجام دهیم؟

434

00:32:35,190 –> 00:32:39,150

خوب، اینها برخی از چیزهای مختلفی هستند که من آنها

را در اینجا فهرست کرده ام. پس فراموش نمی کنم،

435

00:32:39,150 –> 00:32:44,500

می توانیم طبقه بندی تصویر، خوشه بندی داده ها، رگرسیون،

یادگیری تقویتی، طبیعی را انجام دهیم

436

00:32:44,500 –> 00:32:49,080

پردازش زبان و تقریباً هر چیزی که با یادگیری

ماشینی می توانید تصور کنید.

437

00:32:49,080 –> 00:32:54,000

اساساً کاری که TensorFlow انجام می دهد این است که کتابخانه

ای از ابزارها را به ما می دهد که به ما امکان حذف

438

00:32:54,000 –> 00:32:59,280

باید این عملیات ریاضی بسیار پیچیده را انجام دهد. فقط آنها را

برای ما انجام می دهد. در حال حاضر، وجود دارد

439

00:32:59,280 –> 00:33:04,280

کمی که ما باید در مورد آنها بدانیم، اما هیچ چیز خیلی پیچیده

نیست. حالا بیایید در مورد چگونگی TensorFlow صحبت کنیم

440

00:33:04,280 –> 00:33:10,080

در واقع کار می کند بنابراین TensorFlow دو مؤلفه

اصلی دارد که باید آنها را درک کنیم

441

00:33:10,080 –> 00:33:14,650

نحوه انجام عملیات و ریاضیات را دریابید.

اکنون چیزی به نام نمودار داریم

442

00:33:14,650 –> 00:33:21,720

و جلسات اکنون، روشی که جریان تانسور کار می کند،

این است که نموداری از محاسبات جزئی ایجاد می کند.

443

00:33:21,720 –> 00:33:25,240

حالا، من می دانم که این کمی پیچیده به نظر می

رسد، برخی از شما بچه ها فقط سعی کنید

444

00:33:25,240 –> 00:33:30,240

واژگان پیچیده را فراموش کنید و دنبال

کنید. اما اساسا، آنچه ما

445

00:33:30,240 –> 00:33:35,210

وقتی کدی را در TensorFlow می نویسیم، یک نمودار ایجاد

می کنیم. بنابراین اگر بخواهم برخی را ایجاد کنم

446

00:33:35,210 –> 00:33:40,360

متغیر، آن متغیر به نمودار اضافه می

شود و شاید آن متغیر مجموع باشد

447

00:33:40,360 –> 00:33:45,380

یا جمع دو متغیر دیگر. آنچه که نمودار اکنون تعریف

می کند این است که بگوید، می دانید،

448

00:33:45,380 –> 00:33:51,870

متغیر یک داریم که برابر با مجموع

متغیر دو و متغیر سه است. ولی

449

00:33:51,870 –> 00:33:57,059

چیزی که ما باید بدانیم این است که در واقع ارزیابی

نمی کند که به سادگی آن را بیان می کند

450

00:33:57,059 –> 00:34:02,180

این محاسباتی است که ما تعریف کرده ایم. بنابراین

تقریباً مانند نوشتن یک معادله است

451

00:34:02,180 –> 00:34:07,390

بدون انجام هیچ گونه ریاضی، ما به نوعی،

می دانید، آن معادله را در آنجا داریم.

452

00:34:07,390 –> 00:34:12,070

ما می دانیم که این ارزش است، اما آن را ارزیابی

نکرده ایم. بنابراین ما این ارزش را نمی دانیم

453

00:34:12,070 –> 00:34:17,500

مانند 7٪ است، ما فقط می دانیم که این مجموع،

می دانید، بردار یک و بردار دو است، یا

454

00:34:17,500 –> 00:34:22,139

این مجموع این است یا حاصل ضرب متقاطع یا حاصل ضرب

نقطه ای است، ما فقط همه را تعریف کردیم

455

00:34:22,139 –> 00:34:27,070

محاسبات جزئی مختلف، زیرا ما هنوز

آن محاسبات را ارزیابی نکرده ایم.

456

00:34:27,070 –> 00:34:31,960

و این همان چیزی است که در نمودار ذخیره می شود.

و دلیلی که به آن گراف می گویند این است که

457

00:34:31,960 –> 00:34:36,899

محاسبات مختلف را می توان به یکدیگر مرتبط

کرد. مثلاً اگر بخواهم بفهمم

458

00:34:36,899 –> 00:34:42,690

مقدار بردار یک، اما بردار یک برابر

با مقدار بردار سه به علاوه بردار است

459

00:34:42,690 –> 00:34:47,050

چهار، من باید مقدار بردار سه و بردار چهار

را تعیین کنم، زیرا قبل از اینکه بتوانم

460

00:34:47,050 –> 00:34:51,300

این محاسبات را انجام دهید، بنابراین آنها به نوعی

به هم مرتبط هستند و امیدوارم که کمی کمک کند

461

00:34:51,300 –> 00:34:57,990

از حس حالا جلسه چیست؟ Well session اساسا

راهی برای اجرای قسمت یا قسمت است

462

00:34:57,990 –> 00:35:03,330

کل نمودار بنابراین وقتی در یک جلسه شروع می کنیم، کاری که

انجام می دهیم این است که شروع به اجرای متفاوت می کنیم

463

00:35:03,330 –> 00:35:08,170

جنبه های نمودار بنابراین از پایین ترین سطح نمودار

شروع می کنیم، جایی که هیچ چیز وابسته نیست

464

00:35:08,170 –> 00:35:12,930

در مورد هر چیز دیگری، ما ممکن است مقادیر ثابت یا چیزی

شبیه به آن داشته باشیم. و سپس ما را حرکت می دهیم

465

00:35:12,930 –> 00:35:17,150

از نمودار عبور کرده و شروع به انجام

تمام محاسبات جزئی مختلف کنید

466

00:35:17,150 –> 00:35:21,020

ما تعریف کرده ایم حالا، امیدوارم که این خیلی گیج

کننده نباشد. من می دانم که این مقدار زیادی است

467

00:35:21,020 –> 00:35:24,910

شما بچه ها باید این را در حالی که ما از طریق آن عبور می کنیم،

درک خواهید کرد. و دوباره می توانید بخوانید

468

00:35:24,910 –> 00:35:28,530

از طریق برخی از این مؤلفهها در اینجا که

من در Collaboratory دارم، اگر به نوعی از آن بگذرم

469

00:35:28,530 –> 00:35:33,050

از طریق هر چیزی که واقعاً درک نمی کنید. اما این

روشی است که نمودارها و جلسات را نشان می دهد

470

00:35:33,050 –> 00:35:37,290

کار، ما خیلی با آنها عمیق نخواهیم

شد، ما باید درک کنیم که همین است

471

00:35:37,290 –> 00:35:41,880

روشی که TensorFlow کار می کند. و برخی مواقع وجود دارد که ما

نمی توانیم از یک مقدار خاص در خود استفاده کنیم

472

00:35:41,880 –> 00:35:46,820

هنوز کد، چون ما نمودار را ارزیابی نکرده ایم،

جلسه ای ایجاد نکرده ایم و دریافت نکرده ایم

473

00:35:46,820 –> 00:35:50,921

مقادیر هنوز، که ممکن است لازم باشد قبل از اینکه واقعاً

بتوانیم از برخی استفاده کنیم، انجام دهیم

474

00:35:50,921 –> 00:35:53,460

ارزش خاص بنابراین این فقط چیزی است که باید در نظر

گرفت.

475

00:35:53,460 –> 00:35:54,460

بسیار خوب،

476

00:35:54,460 –> 00:35:59,340

بنابراین اکنون ما در واقع وارد کدنویسی،

نصب TensorFlow می شویم. حالا این

477

00:35:59,340 –> 00:36:02,890

جایی است که من قصد دارم شما را با Google Collaboratory

آشنا کنم و توضیح دهم که چگونه می توانید

478

00:36:02,890 –> 00:36:07,430

بدون نیاز به نصب چیزی بر روی کامپیوتر

خود را دنبال کنید. و مهم نیست که

479

00:36:07,430 –> 00:36:11,560

شما مانند یک کامپیوتر واقعاً مزخرف دارید، یا حتی

اگر مانند یک آیفون روشن هستید، به خودی خود،

480

00:36:11,560 –> 00:36:17,560

شما در واقع می توانید این کار را انجام دهید، که شگفت انگیز

است. بنابراین تنها کاری که باید انجام دهید Google Google Collaboratory است،

481

00:36:17,560 –> 00:36:23,240

و یک نوت بوک جدید بسازید. اکنون آنچه Google

Collaboratory است، اساساً یک Jupyter رایگان است

482

00:36:23,240 –> 00:36:28,150

نوت بوک در ابر برای شما. روش کار این است که

شما می توانید این نوت بوک را باز کنید

483

00:36:28,150 –> 00:36:33,590

می توانم ببینم این به نام I، py و B است، بله،

آن چیزی است که من py و B، که فکر می کنم فقط

484

00:36:33,590 –> 00:36:38,619

مخفف عبارت IPython notebook است. و کاری که میتوانید

در اینجا انجام دهید، نوشتن کد و

485

00:36:38,619 –> 00:36:43,400

متن هم بنویس بنابراین، این همان چیزی

است که به آن میگویند، Google Collaboratory

486

00:36:43,400 –> 00:36:47,540

نوت بوک. و اساساً چرا به آن نوت بوک می گویند به

این دلیل است که نه تنها می توانید قرار دهید

487

00:36:47,540 –> 00:36:52,790

کد اما شما همچنین می توانید یادداشت قرار دهید،

کاری که من در اینجا با این عناوین خاص انجام داده ام.

488

00:36:52,790 –> 00:36:56,700

بنابراین می توانید در واقع از علامت گذاری در داخل این استفاده

کنید. بنابراین اگر من یکی از اینها را باز کنم، می توانید

489

00:36:56,700 –> 00:37:02,540

ببینید که من از متن علامت گذاری برای ایجاد

این بخش ها استفاده کرده ام. و بله، آن

490

00:37:02,540 –> 00:37:07,690

نوعی نحوه کار Collaboratory است. اما کاری که می توانید

در Collaboratory انجام دهید فراموش کردن آن است

491

00:37:07,690 –> 00:37:12,490

باید همه این ماژول ها را نصب کنید. آنها قبلاً

برای شما نصب شده اند. پس همینی که هستی

492

00:37:12,490 –> 00:37:17,190

در واقع وقتی یک پنجره مشارکتی را باز می کنید،

گوگل به طور خودکار انجام می دهد

493

00:37:17,190 –> 00:37:21,430

شما را به یکی از سرورهای آنها یا یکی از ماشین

های آنها که همه این موارد را دارد وصل کنید

494

00:37:21,430 –> 00:37:26,230

انجام شد و برای شما تنظیم شد. و می توانید شروع

به نوشتن کد و اجرای آن در دستگاه خود کنید

495

00:37:26,230 –> 00:37:31,680

و دیدن نتیجه به عنوان مثال، اگر میخواهم

hello را چاپ کنید، مانند این، و

496

00:37:31,680 –> 00:37:36,020

من کمی بزرگنمایی می کنم، تا بچه ها بتوانید این را بخوانید،

تمام کاری که انجام می دهم این است که یک کد جدید ایجاد کنم

497

00:37:36,020 –> 00:37:41,030

مسدود کردن، که من می توانم با کلیک کردن روی کد انجام

دهم. اینطوری میتونم یکی مثل اون رو هم حذف کنم. و

498

00:37:41,030 –> 00:37:45,970

زدم فرار. حالا توجه کنید، یک ثانیه به آن زمان بدهید،

بیشتر از زمانی که به تنهایی طول می کشد

499

00:37:45,970 –> 00:37:50,720

دستگاه، و ما Hello را در اینجا ظاهر می کنیم. بنابراین

نکته مهم در مورد Collaboratory این است

500

00:37:50,720 –> 00:37:55,310

این واقعیت که ما میتوانیم چندین بلوک کد داشته باشیم،

و میتوانیم آنها را در هر دنبالهای اجرا کنیم

501

00:37:55,310 –> 00:37:59,369

خواستن بنابراین برای ایجاد یک بلوک کد دیگر، فقط

می توانید بدانید، یک بلوک کد دیگر را انجام دهید

502

00:37:59,369 –> 00:38:03,620

در اینجا یا فقط با نگاه کردن به اینجا، کد دریافت

می کنید و متن دریافت می کنید. و من میتونم بدوم

503

00:38:03,620 –> 00:38:09,400

این به هر ترتیبی که من می خواهم بنابراین من می توانم مانند

چاپ انجام دهم. بله، برای مثال، می توانم Yes را اجرا کنم،

504

00:38:09,400 –> 00:38:13,410

و ما خروجی Yes را خواهیم دید و سپس می توانم

یک بار دیگر hello را چاپ کنم. و توجه کنید

505

00:38:13,410 –> 00:38:17,830

که این شماره را در سمت چپ در اینجا به من نشان

می دهد که در آن این نوع کدها وجود دارد

506

00:38:17,830 –> 00:38:23,330

بلوک ها اجرا شد. اکنون همه این بلوک های کد می توانند به

نوعی به یکدیگر دسترسی داشته باشند. بنابراین برای مثال،

507

00:38:23,330 –> 00:38:28,010

من فانک را تعریف میکنم، و فقط مقداری پارامتر H را میگیریم

و تمام کاری که انجام میدهیم این است که فقط چاپ کنیم

508

00:38:28,010 –> 00:38:33,780

H، خوب، اگر من یک بلوک کد دیگر را در اینجا ایجاد کنم، پس بیایید

به کدنویسی برویم. من می توانم با فانک تماس بگیرم

509

00:38:33,780 –> 00:38:39,980

بگویید، سلام، مطمئن شوید که ابتدا این بلوک را اجرا می کنم. بنابراین

ما تابع را تعریف می کنیم. حالا ما فانک اجرا می کنیم

510

00:38:39,980 –> 00:38:44,660

و توجه کنید که خروجی Hello را دریافت می کنیم. بنابراین

ما می توانیم به همه متغیرها، همه توابع دسترسی داشته باشیم،

511

00:38:44,660 –> 00:38:48,420

هر چیزی که در بلوکهای کد دیگر از بلوکهای

کد زیر آن یا کد تعریف کردهایم

512

00:38:48,420 –> 00:38:52,310

بلوک هایی که بعد از آن اجرا می شوند. حالا چیز دیگری

که در مورد Collaboratory عالی است این است

513

00:38:52,310 –> 00:38:56,330

این واقعیت که ما می توانیم تقریباً هر ماژولی

را که تصور کنیم وارد کنیم. و ما نیازی نداریم

514

00:38:56,330 –> 00:39:01,060

آن را نصب کنید. بنابراین من در واقع نحوه

نصب TensorFlow را به طور کامل بررسی نمی کنم.

515

00:39:01,060 –> 00:39:06,220

کمی در مورد نحوه نصب TensorFlow در دستگاه محلی

خود در داخل این نوت بوک وجود دارد.

516

00:39:06,220 –> 00:39:09,790

که من شما را به آن ارجاع خواهم داد. اما اساساً،

اگر می دانید چگونه از Pip استفاده کنید، بسیار ساده است.

517

00:39:09,790 –> 00:39:15,300

اگر یک GPU سازگار دارید، میتوانید TensorFlow

را با نصب Pip یا GPU TensorFlow نصب Pip کنید.

518

00:39:15,300 –> 00:39:20,140

که می توانید از لینکی که در این دفترچه است

بررسی کنید. حالا اگر بخواهم چیزی وارد کنم،

519

00:39:20,140 –> 00:39:24,119

کاری که من می توانم انجام دهم این است که به معنای واقعی کلمه واردات

را بنویسم. بنابراین می توانم بگویم NumPy را مانند این وارد کنید.

520

00:39:24,119 –> 00:39:28,270

و معمولا NumPy ماژولی است که باید نصب کنید. اما

ما نیازی به انجام این کار در اینجا نداریم.

521

00:39:28,270 –> 00:39:32,100

قبلاً روی دستگاه نصب شده است. بنابراین دوباره،

ما به آن سرورهای Google متصل می شویم،

522

00:39:32,100 –> 00:39:36,510

ما می توانیم از سخت افزار آنها برای انجام یادگیری ماشین

استفاده کنیم. و این فوق العاده است. این شگفت انگیز است.

523

00:39:36,510 –> 00:39:40,680

و زمانی که در حال دویدن هستید، مانند یک

نوع بدتر، مزایای عملکردی به شما می دهد

524

00:39:40,680 –> 00:39:44,670

ماشین، درست است بنابراین ما میتوانیم نگاهی

به RAM و فضای دیسک کامپیوتر خود بیندازیم

525

00:39:44,670 –> 00:39:49,750

می توانید ببینید که ما 12 گیگ رم داریم. ما با 107

گیگابایت داده در فضای دیسک خود سروکار داریم.

526

00:39:49,750 –> 00:39:53,690

و واضح است که میدانید، اگر بخواهیم،

میتوانیم به آن وصل شویم

527

00:39:53,690 –> 00:39:56,900

زمان اجرا محلی، که به اعتقاد من به دستگاه محلی

شما متصل می شود، اما من قصد ندارم بروم

528

00:39:56,900 –> 00:40:01,190

از طریق همه آن من فقط می خواهم برخی از اجزای

اساسی Have Collaboratory را به شما عزیزان نشان دهم.

529

00:40:01,190 –> 00:40:04,910

در حال حاضر، برخی از چیزهای دیگر که برای

درک مهم است، این تب زمان اجرا است، که شما

530

00:40:04,910 –> 00:40:10,920

ممکن است ببیند من استفاده می کنم. بنابراین راه اندازی مجدد زمان اجرا اساساً

تمام خروجی های شما را پاک می کند و فقط راه اندازی مجدد می شود

531

00:40:10,920 –> 00:40:15,320

هر اتفاقی افتاده از آنجا که چیز بزرگ با Collaboratory

این است که من می توانم به طور خاص اجرا کنم

532

00:40:15,320 –> 00:40:20,900

بلوک های کد، لازم نیست هر بار که می خواهم

چیزی را اجرا کنم کل کد را اجرا کنم،

533

00:40:20,900 –> 00:40:25,450

اگر فقط یک تغییر جزئی در یک بلوک کد ایجاد کرده باشم،

فقط می توانم آن کد را اجرا کنم. متاسفم، من

534

00:40:25,450 –> 00:40:29,540

فقط می تواند آن بلوک کد را اجرا کند. لازم نیست

همه چیز را قبل از آن اجرا کنم یا حتی همه چیز را

535

00:40:29,540 –> 00:40:34,650

بعد از آن درست اما گاهی اوقات می خواهید همه چیز را دوباره

راه اندازی کنید و فقط همه چیز را دوباره اجرا کنید.

536

00:40:34,650 –> 00:40:38,400

بنابراین برای انجام این کار، روی Restart Runtime کلیک کنید، این

کار فقط همه چیزهایی را که شما پاک میکنید پاک میکند

537

00:40:38,400 –> 00:40:43,560

دارند. و سپس راه اندازی مجدد و اجرای همه، زمان اجرا و همچنین

اجرای هر بلوک منفرد را مجدداً راه اندازی می کند

538

00:40:43,560 –> 00:40:49,321

کدی که دارید به ترتیبی که در آن چیز نشان داده

می شود. بنابراین من به شما توصیه می کنم

539

00:40:49,321 –> 00:40:52,690

بچه ها یکی از این پنجره ها را باز کنید، بدیهی

است که می توانید با این دفترچه همراه باشید

540

00:40:52,690 –> 00:40:56,050

اگر می خواهید اما اگر می خواهید آن را به تنهایی تایپ

کنید و به نوعی با آن مشکل دارید، باز کنید

541

00:40:56,050 –> 00:41:01,010

یک دفترچه یادداشت بردارید، آن را ذخیره کنید، بسیار

آسان است. و اینها دوباره بسیار شبیه ژوپیتر هستند

542

00:41:01,010 –> 00:41:07,840

نوت بوک یا نوت بوک Jupyter. آنها تقریباً یکسان

هستند. خوب، پس این یک نوع است

543

00:41:07,840 –> 00:41:11,970

جنبه مشارکتی Google نحوه استفاده از آن. بیایید

وارد وارد کردن TensorFlow شویم. اکنون،

544

00:41:11,970 –> 00:41:16,150

این به نوعی مختص Google Collaboratory خواهد بود. بنابراین

می توانید اینها را اینجا ببینید

545

00:41:16,150 –> 00:41:20,450

نوعی از مراحلی است که باید برای وارد کردن TensorFlow دنبال

کنیم. بنابراین از آنجایی که ما در حال کار هستیم

546

00:41:20,450 –> 00:41:24,670

در Google Collaboratory، آنها چندین نسخه از TensorFlow

دارند، آنها نسخه اصلی را دارند

547

00:41:24,670 –> 00:41:30,030

نسخه TensorFlow که 1.0 است و نسخه 2.0. حال

برای تعریف این واقعیت که ما

548

00:41:30,030 –> 00:41:31,930

می خواهید از TensorFlow 2.0 استفاده کنید.

549