در این مطلب، ویدئو اینتل – علم داده پایتون و یادگیری ماشین در مقیاس با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:34:51

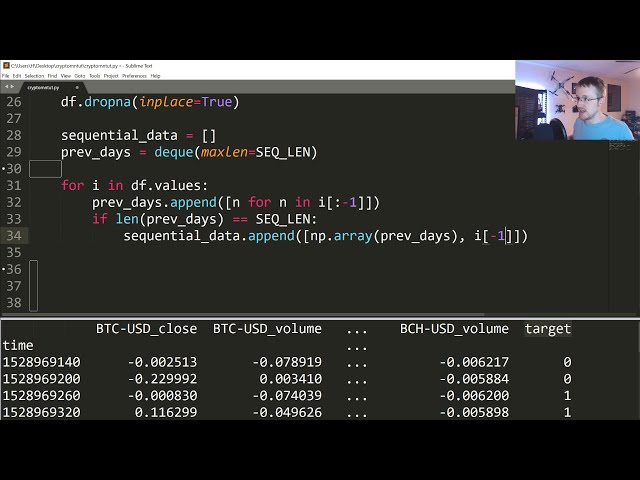

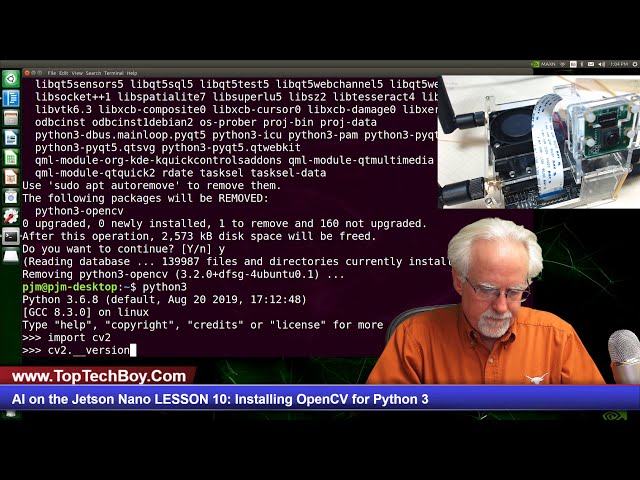

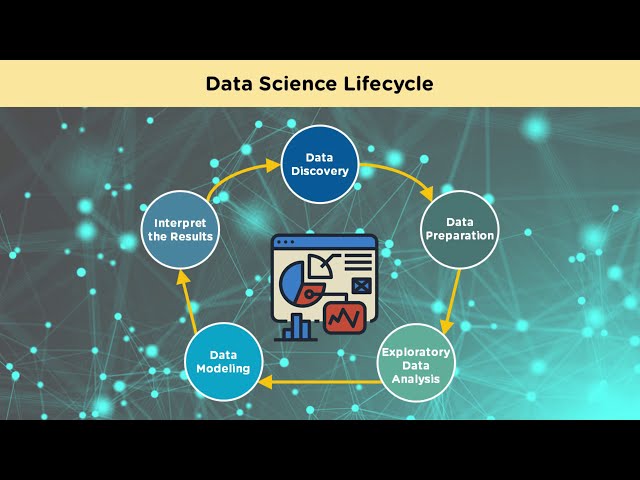

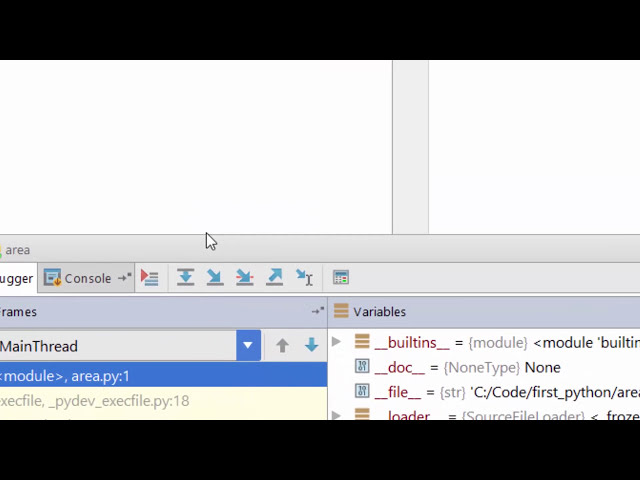

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:09,280 –> 00:00:15,310

[موسیقی]

2

00:00:16,560 –> 00:00:18,480

سلام نام من تاد دوماشیک است، من یک

3

00:00:18,480 –> 00:00:20,080

مدیر مهندسی در Intel در

4

00:00:20,080 –> 00:00:21,760

تیم عملکرد یادگیری ماشین ما

5

00:00:21,760 –> 00:00:24,080

هستم و معمار جعبه ابزار تجزیه و تحلیل ai هستم،

6

00:00:24,080 –> 00:00:26,400

یک مرور

7

00:00:26,400 –> 00:00:28,560

کلی از یادگیری ماشین پایتون و پیشنهادات هوش مصنوعی

8

00:00:28,560 –> 00:00:30,480

ارائه خواهم کرد. اینتل و اینکه چگونه

9

00:00:30,480 –> 00:00:32,960

میتوان از آنها برای باز کردن قفل عملکرد و مقیاس استفاده کرد. با

10

00:00:32,960 –> 00:00:34,960

تشکر از اعضای پانل برای اینکه وقت خود را در اختیار من گذاشتند.

11

00:00:34,960 –> 00:00:36,160

12

00:00:36,160 –> 00:00:37,680

من از شش سال پیش تا کنون با پروژه پایتون در

13

00:00:37,680 –> 00:00:39,760

اینتل کار کردهام

14

00:00:39,760 –> 00:00:41,600

و

15

00:00:41,600 –> 00:00:43,760

تعهد خود را به دو اصل کلیدی

16

00:00:43,760 –> 00:00:46,239

عملکرد حفظ کردهایم. و قابلیت استفاده

17

00:00:46,239 –> 00:00:48,559

و ما بر تقویت

18

00:00:48,559 –> 00:00:51,199

ابزارهای اکوسیستم موجود

19

00:00:51,199 –> 00:00:52,719

20

00:00:52,719 –> 00:00:54,800

21

00:00:54,800 –> 00:00:56,879

22

00:00:56,879 –> 00:00:59,039

تمرکز کردهایم

23

00:00:59,039 –> 00:01:01,840

24

00:01:01,840 –> 00:01:03,520

25

00:01:03,520 –> 00:01:05,280

به جای تکه تکه کردن آن.

26

00:01:05,280 –> 00:01:07,600

ابزارهایی مانند numpy و scikit-learn و

27

00:01:07,600 –> 00:01:10,000

پانداها به کتابخانه های عملکرد اینتل

28

00:01:10,000 –> 00:01:12,159

مانند هسته ریاضی intel one

29

00:01:12,159 –> 00:01:14,400

api brary و کتابخانه تجزیه و تحلیل داده های api intel one

30

00:01:14,400 –> 00:01:15,920

31

00:01:15,920 –> 00:01:18,159

برای مثال، ما

32

00:01:18,159 –> 00:01:21,680

numpy را با بسته های ریاضی mkl fft mkl تصادفی و

33

00:01:21,680 –> 00:01:24,320

mklu تسریع می کنیم که تولید اعداد تصادفی

34

00:01:24,320 –> 00:01:26,400

ffts و توابع ریاضی جهانی را

35

00:01:26,400 –> 00:01:29,759

در برخی موارد تا 400x

36

00:01:29,759 –> 00:01:31,920

پیاده سازی می کند و کد بومی امکان

37

00:01:31,920 –> 00:01:34,000

همزمانی در سطوح مختلف را فراهم می کند.

38

00:01:34,000 –> 00:01:36,000

قبلاً در دسترس نبودند،

39

00:01:36,000 –> 00:01:38,159

علاوه بر این، اینتل به

40

00:01:38,159 –> 00:01:40,240

41

00:01:40,240 –> 00:01:42,159

جای تمرکز بر روی تنها

42

00:01:42,159 –> 00:01:44,560

یک مرحله، مانند آموزش مدل با

43

00:01:44,560 –> 00:01:46,240

علم داده که تقریباً در هر

44

00:01:46,240 –> 00:01:47,759

صنعتی میرسد، روی

45

00:01:47,759 –> 00:01:49,520

شتابدهیها در سراسر خط لوله علم داده سرمایهگذاری میکند

46

00:01:49,520 –> 00:01:51,680

47

00:01:51,680 –> 00:01:53,520

. نمیخواهیم هر توسعهدهنده پایتون

48

00:01:53,520 –> 00:01:56,079

باید در c یا c plus plus متخصص باشد،

49

00:01:56,079 –> 00:01:58,240

بنابراین ما با

50

00:01:58,240 –> 00:02:00,000

اتصال آنها از طریق ابزارهای شناخته شده

51

00:02:00,000 –> 00:02:02,640

تنها با تغییرات کوچک کد، به قابلیت استفاده متعهد هستیم

52

00:02:02,640 –> 00:02:05,360

و در نهایت جامعه باز فعال و با استعداد

53

00:02:05,360 –> 00:02:07,360

پایتون واقعاً نیروی محرکه

54

00:02:07,360 –> 00:02:09,038

است. پایتون را به

55

00:02:09,038 –> 00:02:11,200

زبان شماره یک برای علم داده و اینتل تبدیل

56

00:02:11,200 –> 00:02:12,480

می کند کمکهای انجمن را مدیون

57

00:02:12,480 –> 00:02:14,800

کمک به اینکه

58

00:02:14,800 –> 00:02:16,959

ما نسل بعدی یک Api داده

59

00:02:16,959 –> 00:02:20,000

موازی C plus کامپایلر خود را در

60

00:02:20,000 –> 00:02:22,480

مخزن پیشفرض آناکوندا

61

00:02:22,480 –> 00:02:24,879

dpc plus plus در دسترس قرار دادهایم، مبتنی بر استانداردهای باز و نه

62

00:02:24,879 –> 00:02:26,640

اختصاصی است و اجازه

63

00:02:26,640 –> 00:02:30,000

برنامهنویسی در سراسر cpus و gpus باز

64

00:02:30,000 –> 00:02:32,560

و کارآمد را میدهد که تعهد ماست

65

00:02:32,560 –> 00:02:34,640

. نگاهی اجمالی به بهینهسازیهای هوش مصنوعی و

66

00:02:34,640 –> 00:02:36,800

علوم دادهای که توسط

67

00:02:36,800 –> 00:02:40,959

یک api که اینتل در حال حاضر ارائه میدهد

68

00:02:42,000 –> 00:02:43,680

را نگاه کنید، همانطور که میبینید اینتل طیف گستردهای

69

00:02:43,680 –> 00:02:45,360

از بهینهسازیها و ابزارها را برای

70

00:02:45,360 –> 00:02:48,160

توسعهدهندگان و دانشمندان دادهای

71

00:02:48,160 –> 00:02:50,319

ارائه

72

00:02:50,319 –> 00:02:52,080

میدهد. خط لوله علم داده

73

00:02:52,080 –> 00:02:54,400

از ابزارهایی مانند moden که

74

00:02:54,400 –> 00:02:56,239

فریم های داده پانداها را با

75

00:02:56,239 –> 00:02:58,959

تغییر چند خط کد به xg boost

76

00:02:58,959 –> 00:03:00,720

و tensorflow برای افزایش آموزش

77

00:03:00,720 –> 00:03:02,319

و شتاب استنتاج خارج از

78

00:03:02,319 –> 00:03:05,120

جعبه تا یادگیری روانی که کیت سایت را افزایش می دهد فریم های داده پانداها را توزیع

79

00:03:05,120 –> 00:03:07,760

80

00:03:07,760 –> 00:03:09,920

می کند. چند خط کد

81

00:03:09,920 –> 00:03:10,879

اضافه شده است،

82

00:03:10,879 –> 00:03:12,480

ما وارد جزئیات

83

00:03:12,480 –> 00:03:14,000

همه چیز نمی شویم در این صفحه نوشته شده است، اما همانطور

84

00:03:14,000 –> 00:03:16,239

که می بینید اینتل در حال بهینه سازی است،

85

00:03:16,239 –> 00:03:18,400

راه های زیادی برای بهبود

86

00:03:18,400 –> 00:03:22,080

حجم کاری توسعه دهندگان و دانشمند داده

87

00:03:22,159 –> 00:03:24,319

در زیر این بهینه سازی ها

88

00:03:24,319 –> 00:03:26,400

توسط یک کتابخانه api مانند یک

89

00:03:26,400 –> 00:03:30,159

شماره گیری یک dnn یک ccl و یک mkl ایجاد شده است، اما

90

00:03:30,159 –> 00:03:31,760

کاربران این کار را نمی کنند. نیاز به تعامل

91

00:03:31,760 –> 00:03:33,920

مستقیم با این بستهها برای مشاهده مقیاس

92

00:03:33,920 –> 00:03:35,599

و دستاوردهای عملکردی،

93

00:03:35,599 –> 00:03:37,040

این پیشنهادها در آناکوندا در دسترس هستند

94

00:03:37,040 –> 00:03:39,519

یا میتوان آنها را

95

00:03:39,519 –> 00:03:42,319

به صورت یک بسته از طریق جعبه ابزار تجزیه و تحلیل اینتل وان api ai دانلود

96

00:03:42,319 –> 00:03:45,280

97

00:03:45,280 –> 00:03:47,120

98

00:03:47,120 –> 00:03:49,120

کرد. pandas

99

00:03:49,120 –> 00:03:52,000

خط لوله علم داده

100

00:03:53,120 –> 00:03:55,519

ابزار پایتون مورد علاقه برای

101

00:03:55,519 –> 00:03:56,959

سازماندهی داده ها در سراسر خط لوله داده است

102

00:03:56,959 –> 00:03:58,400

و راه حل ما برای

103

00:03:58,400 –> 00:04:00,400

تسریع پایه ها

104

00:04:00,400 –> 00:04:02,000

توزیع هوشمند modin

105

00:04:02,000 –> 00:04:04,239

moden و amnisai پروژه های منبع باز هستند

106

00:04:04,239 –> 00:04:06,560

که پردازش قاب داده را هدف قرار داده اند

107

00:04:06,560 –> 00:04:08,159

و مهندسان اینتل از

108

00:04:08,159 –> 00:04:09,680

نزدیک با این پروژه ها کار کرده اند.

109

00:04:09,680 –> 00:04:12,080

بهینه سازی های قابل توجهی را در سطح بسیار بالا اضافه کنید و

110

00:04:12,080 –> 00:04:14,000

دستاوردهای عملکرد با پارتیشن به دست می آید

111

00:04:14,000 –> 00:04:16,320

قرار دادن داده ها در امتداد

112

00:04:16,320 –> 00:04:18,720

محورهای بهینه که امکان پردازش همزمان

113

00:04:18,720 –> 00:04:21,199

فریم های داده را در طول عملیات کلیدی فراهم می

114

00:04:21,199 –> 00:04:22,880

کند، توزیع ما این پروژه ها

115

00:04:22,880 –> 00:04:25,040

را در یک نصب ساده گرد هم می آورد و

116

00:04:25,040 –> 00:04:26,720

تنها با چند خط کدی که

117

00:04:26,720 –> 00:04:29,680

در اینجا می بینید، می توانید تا 38 برابر

118

00:04:29,680 –> 00:04:31,840

در عملیات etl با کارهای جدید بهبود پیدا کنید.

119

00:04:31,840 –> 00:04:33,360

مجموعه دادههای تاکسی نیویورک

120

00:04:33,360 –> 00:04:35,280

نه تنها با

121

00:04:35,280 –> 00:04:37,280

تغییر تنها چند خط کد به این نتایج دسترسی پیدا

122

00:04:37,280 –> 00:04:38,880

میکنند، بلکه به فرآیند اجازه میدهند از

123

00:04:38,880 –> 00:04:41,120

حافظه کامل سیستم و قابلیتهای i o استفاده کند

124

00:04:41,120 –> 00:04:43,199

که به دهها

125

00:04:43,199 –> 00:04:44,960

میلیون رکورد دیگر که

126

00:04:44,960 –> 00:04:46,720

در محصولات رقابتی شما امکانپذیر است، میرسد.

127

00:04:46,720 –> 00:04:48,160

می توانید

128

00:04:48,160 –> 00:04:50,639

با نصب بسته Intel aikid

129

00:04:50,639 –> 00:04:52,960

با استفاده از conda و

130

00:04:52,960 –> 00:04:55,759

کانال پیش فرض anaconda یا نوع

131

00:04:55,759 –> 00:04:57,520

forge که در اینجا نشان داده شده است توزیع اینتل moden را دریافت کنید

132

00:04:57,520 –> 00:05:00,639

یا می توانید بسته moden all را نصب کنید

133

00:05:00,639 –> 00:05:03,759

سپس moden را به صورت pd وارد کنید و برای جزئیات بیشتر از

134

00:05:03,759 –> 00:05:05,440

پانداها به طور معمول استفاده

135

00:05:05,440 –> 00:05:07,759

کنید. از

136

00:05:07,759 –> 00:05:10,000

پست وبلاگ آناکوندا که در اینجا به آن اشاره شده است یا از

137

00:05:10,000 –> 00:05:13,840

صفحه محصول توزیع اینتل bowden

138

00:05:15,759 –> 00:05:18,080

به طور مشابه بازدید کنید scikit Learn is the favorite

139

00:05:18,080 –> 00:05:20,160

ابزار e برای یادگیری ماشین پایتون و

140

00:05:20,160 –> 00:05:22,000

افزونه اینتل برای یادگیری روانی

141

00:05:22,000 –> 00:05:23,520

142

00:05:23,520 –> 00:05:25,360

با اتصال

143

00:05:25,360 –> 00:05:27,520

عملیات سکولار سطح بالا به

144

00:05:27,520 –> 00:05:29,759

پیاده سازی های بومی در

145

00:05:29,759 –> 00:05:31,840

کتابخانه تجزیه و تحلیل داده های intel one api

146

00:05:31,840 –> 00:05:34,000

به سادگی بسته هوشمند scikit-learn

147

00:05:34,000 –> 00:05:36,160

را همراه با scikit نصب کنید. خود را یاد بگیرید

148

00:05:36,160 –> 00:05:38,080

و عملیات وصلهای را که در زیر میبینید اجرا

149

00:05:38,080 –> 00:05:40,479

کنید تا قفل عملکرد Patching

150

00:05:40,479 –> 00:05:42,560

را به راحتی

151

00:05:42,560 –> 00:05:45,280

برای آزمایش یا آزمایشهای b روشن یا خاموش کنید و پس از

152

00:05:45,280 –> 00:05:47,600

وصله به سادگی وارد کنید و طبق معمول از sklearn استفاده کنید،

153

00:05:47,600 –> 00:05:49,520

اما پیشرفتهای قابل توجهی در

154

00:05:49,520 –> 00:05:51,120

عملکرد

155

00:05:51,120 –> 00:05:53,360

scikit-learn intel مشاهده خواهید کرد. ex

156

00:05:53,360 –> 00:05:55,919

در جعبه ابزار تجزیه و تحلیل intel one api ai

157

00:05:55,919 –> 00:05:58,000

از کانال پیشفرض آناکوندا از

158

00:05:58,000 –> 00:06:00,960

condo forge موجود است و در فهرست بسته پایتون

159

00:06:00,960 –> 00:06:04,000

و pi pi

160

00:06:04,960 –> 00:06:06,720

ما در واقع یک نسخه آزمایشی را انجام دادیم که در آن

161

00:06:06,720 –> 00:06:07,919

162

00:06:07,919 –> 00:06:08,720

163

00:06:08,720 –> 00:06:10,560

جریانهای کاری um آزمایش گردش کار علم داده را

164

00:06:10,560 –> 00:06:13,039

با استفاده از این ابزارها ضبط کردیم.

165

00:06:13,039 –> 00:06:14,720

می توانید از طریق آن نسخه ی نمایشی بروید

166

00:06:14,720 –> 00:06:16,560

یا آن را در اینجا نشان دهید، اما به صورت

167

00:06:16,560 –> 00:06:18,720

آنلاین در لینک موجود است این ارائه

168

00:06:18,720 –> 00:06:20,560

و یک لینک در انتهای این

169

00:06:20,560 –> 00:06:22,319

ارائه نیز وجود دارد تا بتوانید بعداً به آن نگاه کنید.

170

00:06:22,319 –> 00:06:24,639

171

00:06:25,199 –> 00:06:26,960

172

00:06:26,960 –> 00:06:29,680

173

00:06:29,680 –> 00:06:31,919

174

00:06:31,919 –> 00:06:34,240

175

00:06:34,240 –> 00:06:37,199

کیت ابزار مبتنی بر api برای

176

00:06:37,199 –> 00:06:39,520

پشتیبانی از توسعه دهندگان پایتون،

177

00:06:39,520 –> 00:06:41,360

کامپایلر داده موازی c plus نیز

178

00:06:41,360 –> 00:06:43,440

در ابر آناکوندا موجود است و

179

00:06:43,440 –> 00:06:45,280

استفاده از آن به سادگی نصب

180

00:06:45,280 –> 00:06:47,360

dpcpp

181

00:06:47,360 –> 00:06:50,000

و گنجاندن dpcpp به عنوان

182

00:06:50,000 –> 00:06:52,319

انتخاب کامپایلر در دستور العمل های ساخت کاندو است، همانطور

183

00:06:52,319 –> 00:06:53,520

که در اینجا نشان داده شده است،

184

00:06:53,520 –> 00:06:55,120

می توانید کامپایلر را نیز نصب کنید.

185

00:06:55,120 –> 00:06:57,120

بسته های

186

00:06:57,120 –> 00:07:00,240

مستقیم کامپایلر dpc plus یک کامپایلر منبع باز مبتنی بر llvm است که

187

00:07:00,240 –> 00:07:02,240

قادر به

188

00:07:02,240 –> 00:07:06,960

کامپایل کردن برای اهداف cpu و gpu است

189

00:07:09,120 –> 00:07:11,759

علم داده آنقدر برای صنعت حیاتی است

190

00:07:11,759 –> 00:07:14,479

که فراتر از cpus و gpus به xpus رشد کرده است

191

00:07:14,479 –> 00:07:17,199

و api one اینتل

192

00:07:17,199 –> 00:07:19,440

نوید محاسبات ناهمگن را در سراسر جهان ارائه می دهد.

193

00:07:19,440 –> 00:07:20,960

194

00:07:20,960 –> 00:07:22,960

پایتون موازی دادههای

195

00:07:22,960 –> 00:07:25,919

xpu یا dppy یک

196

00:07:25,919 –> 00:07:28,479

مدل برنامهنویسی یکپارچه ساده با استفاده از استانداردهای api داده پایتون

197

00:07:28,479 –> 00:07:31,039

chronos sickle و غیره است.

198

00:07:31,039 –> 00:07:33,280

برنامههای افزودنی و فنآوریهای r

199

00:07:33,280 –> 00:07:35,440

برای اجرای اکوسیستم پایتون بر روی

200

00:07:35,440 –> 00:07:38,000

انواع مختلف سختافزار یا xpus

201

00:07:38,000 –> 00:07:41,199

با استانداردهای باز و همه منبع باز، به

202

00:07:41,199 –> 00:07:42,720

این معنی است که کاربران میتوانند

203

00:07:42,720 –> 00:07:44,720

کد پایتون خود را با استفاده از

204

00:07:44,720 –> 00:07:48,000

کتابخانههای محبوب مانند numpy scipy xgboost

205

00:07:48,000 –> 00:07:50,479

tensorflow و pi torch اجرا کنند. استفاده از چندین

206

00:07:50,479 –> 00:07:52,639

xpu از

207

00:07:52,639 –> 00:07:54,800

محاسبات و حافظه گسترده هم در هاست و هم

208

00:07:54,800 –> 00:07:56,080

در دستگاه،

209

00:07:56,080 –> 00:07:57,759

همانطور که میتوانید تصور کنید چالشهای فنی

210

00:07:57,759 –> 00:07:59,039

211

00:07:59,039 –> 00:08:01,360

برای این مهم هستند، اما

212

00:08:01,360 –> 00:08:02,639

نتایج بسیار هیجانانگیز

213

00:08:02,639 –> 00:08:04,479

هستند، ما در حال استفاده از کامپایلر محبوب شماره

214

00:08:04,479 –> 00:08:07,440

پایتون و یک فناوری کامپایلر api dpc plus

215

00:08:07,440 –> 00:08:09,599

plus هستیم. به منظور

216

00:08:09,599 –> 00:08:12,160

حفظ محاسبات در دستگاههای مناسب و به

217

00:08:12,160 –> 00:08:15,080

حداقل رساندن جریمههای کپی دادهها

218

00:08:15,080 –> 00:08:16,680

بستههای dpnp

219

00:08:16,680 –> 00:08:20,400

dpctl و number dppy همگی

220

00:08:20,400 –> 00:08:23,680

بخشی از مجموعه بستههای dppy xpu در

221

00:08:23,680 –> 00:08:25,360

حال حاضر در کانال اینتل آناکوندا در دسترس

222

00:08:25,360 –> 00:08:27,280

هستند و به زودی به

223

00:08:27,280 –> 00:08:29,759

کانال پیشفرض آناکوندا میآیند.

224

00:08:29,759 –> 00:08:34,880

منتظر اطلاعات بیشتر در مورد dppy باشید

225

00:08:35,519 –> 00:08:37,440

در نهایت در اینجا مجموعه ای از پیوندها برای

226

00:08:37,440 –> 00:08:39,200

اطلاعات بیشتر در مورد بسیاری وجود دارد ابزارها و

227

00:08:39,200 –> 00:08:41,679

منابع فناوری در این سخنرانی

228

00:08:41,679 –> 00:08:44,080

از گسترش افق های خود و

229

00:08:44,080 –> 00:08:45,680

امتحان کردن این چیزها لذت می برند

230

00:08:45,680 –> 00:08:49,279

و به همین دلیل برای سؤالات به پنل می روم،

231

00:08:49,279 –> 00:08:51,200

232

00:08:51,200 –> 00:08:52,880

متشکرم این واقعاً چیزهای هیجان انگیزی

233

00:08:52,880 –> 00:08:55,279

است. اوم نام من کریس گراندمن است، من

234

00:08:55,279 –> 00:08:57,040

یکی از بنیانگذاران هستم. راهحلهای فناوری grundman

235

00:08:57,040 –> 00:08:59,519

و میزبان مشترک استفاده از پادکست AI،

236

00:08:59,519 –> 00:09:02,399

اما من دانشمند داده

237

00:09:02,399 –> 00:09:04,320

و برنامهنویس نیستم، بنابراین میخواهم

238

00:09:04,320 –> 00:09:05,760

با سوال احمقانه روز شروع

239

00:09:05,760 –> 00:09:08,480

240

00:09:08,480 –> 00:09:09,279

241

00:09:09,279 –> 00:09:10,959

کنم. برنامه نویسان و

242

00:09:10,959 –> 00:09:12,000

دانشمندان داده و آنها به دنبال این

243

00:09:12,000 –> 00:09:14,880

منابع هستند، بدیهی است که یک

244

00:09:14,880 –> 00:09:16,720

جعبه ابزار بزرگ در اینجا وجود دارد، اوه شما می دانید که ما دیدیم که

245

00:09:16,720 –> 00:09:18,959

از طریق چند اسلاید در آنجا چگونه می توانم

246

00:09:18,959 –> 00:09:20,720

بدانم و وقتی آن شخصیت را می آورم

247

00:09:20,720 –> 00:09:23,279

چگونه می توانم بدانم چه زمانی وجود دارد؟ یک api از

248

00:09:23,279 –> 00:09:25,600

wintel یا نه این چیزی است که

249

00:09:25,600 –> 00:09:26,880

من فقط می دانید اگر از

250

00:09:26,880 –> 00:09:28,160

پردازنده های اینتل استفاده می کنم باید به طور پیش فرض

251

00:09:28,160 –> 00:09:29,839

همیشه به دنبال بررسی

252

00:09:29,839 –> 00:09:32,880

نسخه اینتل باشم یا خط کمکی وجود دارد که

253

00:09:32,880 –> 00:09:34,320

می توانم با آن تماس بگیرم. واضح است حیلهگرانه

254

00:09:34,320 –> 00:09:35,680

این پیوندها مفید هستند، اما در آن

255

00:09:35,680 –> 00:09:36,800

لحظه که من در

256

00:09:36,800 –> 00:09:38,959

وسط برنامهنویسی هستم، چگونه میتوانم بدانم

257

00:09:38,959 –> 00:09:40,160

ابزار مناسب را بگیرم یا چگونه بدانم کدام

258

00:09:40,160 –> 00:09:41,279

ابزار را بگیرم،

259

00:09:41,279 –> 00:09:43,120

بله، این یک سوال عالی است، یکی از

260

00:09:43,120 –> 00:09:45,200

چیزهایی که

261

00:09:45,200 –> 00:09:47,040

ما داشتیم. زمانی که این پروژه را شروع کردیم، تمرکز ما این

262

00:09:47,040 –> 00:09:49,360

بود که سعی کنیم ابزارهای خود را به

263

00:09:49,360 –> 00:09:51,120

جایی برسانیم که کاربران در آن هستند،

264

00:09:51,120 –> 00:09:53,600

به جای اینکه سعی کنیم کاربران

265

00:09:53,600 –> 00:09:54,880

266

00:09:54,880 –> 00:09:57,600

بیایند یک سایت اینتل پیدا کنند و متوجه شوند که

267

00:09:57,600 –> 00:10:00,320

میدانید ساخت متفاوتی از numpy وجود دارد

268

00:10:00,320 –> 00:10:02,000

که در دسترس است. در این مکان و سپس

269

00:10:02,000 –> 00:10:03,920

آنها باید آن را شکار کنند و آن را پیدا کنند،

270

00:10:03,920 –> 00:10:06,000

ما سعی می کنیم بهینه سازی های خود را

271

00:10:06,000 –> 00:10:07,760

به جایی برسانیم که کاربران در حال حاضر

272

00:10:07,760 –> 00:10:10,240

بسته های عملکرد خود را دریافت می کردند،

273

00:10:10,240 –> 00:10:12,320

خیلی زود

274

00:10:12,320 –> 00:10:14,240

با آناکوندا که پشته

275

00:10:14,240 –> 00:10:16,160

شماره یک پایتون را داشت، همکاری کردیم.

276

00:10:16,160 –> 00:10:18,399

علم داده

277

00:10:18,399 –> 00:10:21,360

و ما شروع به کار با آنها کردیم

278

00:10:21,360 –> 00:10:23,839

تا بهینه سازی های خود را در بسته های خط اصلی آنها قرار دهیم

279

00:10:23,839 –> 00:10:26,640

که آنها ارائه می کنند،

280

00:10:26,640 –> 00:10:27,839

بنابراین

281

00:10:27,839 –> 00:10:29,600

یکی از مکان های کلیدی که

282

00:10:29,600 –> 00:10:31,760

ما بسته های خود را در آن قرار می دهیم، در کانال Intel در

283

00:10:31,760 –> 00:10:34,000

ابر آناکوندا

284

00:10:34,000 –> 00:10:36,320

با استفاده از آن کانال است. ساده است

285

00:10:36,320 –> 00:10:39,200

که برای نصب بسته ها، dash c intel را در دستورات conda خود قرار دهید،

286

00:10:39,200 –> 00:10:41,600

287

00:10:41,600 –> 00:10:42,880

بنابراین

288

00:10:42,880 –> 00:10:44,000

به دلیل اینکه

289

00:10:44,000 –> 00:10:46,800

conda و anaconda فریمورک های پایتون بسیار محبوبی بودند،

290

00:10:46,800 –> 00:10:49,200

291

00:10:49,200 –> 00:10:51,680

می توانید به راحتی با استفاده

292

00:10:51,680 –> 00:10:53,360

از ابزارهای رایجی که

293

00:10:53,360 –> 00:10:55,279

کاربران آناکوندا با آن آشنا هستند،

294

00:10:55,279 –> 00:10:57,760

آن بسته ها را از

295

00:10:57,760 –> 00:10:59,760

آنجا دریافت

296

00:10:59,760 –> 00:11:02,320

کنید. دانستن اینکه تمام اینتل چه چیزی دارد، این

297

00:11:02,320 –> 00:11:04,079

یکی از دلایلی است که چرا ما واقعاً

298

00:11:04,079 –> 00:11:06,800

جعبه ابزار تجزیه و تحلیل AI را ایجاد کردیم،

299

00:11:06,800 –> 00:11:09,279

قرار بود مجموعه ای از همه

300

00:11:09,279 –> 00:11:11,360

301

00:11:11,360 –> 00:11:12,160

302

00:11:12,160 –> 00:11:14,480

محصولات و اجزای مختلف ما باشد که

303

00:11:14,480 –> 00:11:16,560

دانشمندان داده ممکن است

304

00:11:16,560 –> 00:11:19,279

علاقه مند به استفاده از آنها باشند.

305

00:11:19,279 –> 00:11:22,640

کامپایلر ما شامل کتابخانههای عملکرد

306

00:11:22,640 –> 00:11:23,920

307

00:11:23,920 –> 00:11:26,160

mkl daal

308

00:11:26,160 –> 00:11:29,040

one dnn است که

309

00:11:29,040 –> 00:11:30,480

شبکه توزیعشده ما

310

00:11:30,480 –> 00:11:31,519

um است،

311

00:11:31,519 –> 00:11:34,000

بنابراین شامل ابزارهای زیادی است که همه

312

00:11:34,000 –> 00:11:35,680

به یکی کشیده میشوند، شامل tensorflow،

313

00:11:35,680 –> 00:11:38,399

شامل پی مشعل، شامل

314

00:11:38,399 –> 00:11:41,360

کمپرسور عصبی ماست که um است

315

00:11:41,360 –> 00:11:43,279

که در tensorflow و pytorch کار میکند.

316

00:11:43,279 –> 00:11:46,240

محیطهایی برای ارائه um کوانتیزهسازی

317

00:11:46,240 –> 00:11:48,240

و سایر بهینهسازیها برای آن

318

00:11:48,240 –> 00:11:49,600

چارچوبها

319

00:11:49,600 –> 00:11:53,120

ما شامل باغ وحش مدل میشود که i

320

00:11:53,120 –> 00:11:54,959

مدل های از پیش آموزش دیده و دسترسی به آن

321

00:11:54,959 –> 00:11:56,399

مدل های از پیش آموزش داده شده،

322

00:11:56,399 –> 00:11:58,240

بنابراین ما سعی کردیم همه آن چیزها

323

00:11:58,240 –> 00:12:00,079

را در این جعبه ابزار جمع آوری کنیم، جعبه ابزار

324

00:12:00,079 –> 00:12:02,399

اصلی one api که

325

00:12:02,399 –> 00:12:05,279

داریم، ما یک جعبه ابزار مبتنی بر api داریم

326

00:12:05,279 –> 00:12:07,760

که اساساً

327

00:12:07,760 –> 00:12:11,440

تحلیلگرهای کتابخانه های کامپایلر است که همه در مجموعه جمع آوری

328

00:12:11,440 –> 00:12:13,519

شده اند.

329

00:12:13,519 –> 00:12:15,920

ما یک جعبه ابزار hpc داریم که

330

00:12:15,920 –> 00:12:18,959

چیزهای دیگری مانند mpi

331

00:12:18,959 –> 00:12:20,959

um را به آن اضافه می کند و سپس جعبه ابزار تجزیه و تحلیل ai را

332

00:12:20,959 –> 00:12:23,360

اضافه می کند که چارچوب های پایتون tensorflow pytorch را که قبلاً ذکر کردم اضافه می کند،

333

00:12:23,360 –> 00:12:25,200

334

00:12:25,200 –> 00:12:26,160

335

00:12:26,160 –> 00:12:28,639

بنابراین چگونه مردم آن چیزها را پیدا

336

00:12:28,639 –> 00:12:30,160

می کنند.

337

00:12:30,160 –> 00:12:31,519

چندین تیم مختلف

338

00:12:31,519 –> 00:12:33,519

که روی این پروژههای مختلف کار میکنند و

339

00:12:33,519 –> 00:12:36,000

ما دائماً در تلاش

340

00:12:36,000 –> 00:12:38,560

هستیم تا حضور وب خود را اصلاح کنیم تا مردم

341

00:12:38,560 –> 00:12:40,880

بتوانند چیزهای مورد نیاز خود را پیدا کنند،

342

00:12:40,880 –> 00:12:43,440

اما ما همچنین سعی میکنیم آنها را

343

00:12:43,440 –> 00:12:46,079

به مکانهایی بیاوریم که کاربران

344

00:12:46,079 –> 00:12:48,399

کاندو کانال آناکوندا هستند. forge

345

00:12:48,399 –> 00:12:50,240

که یک کانال بزرگ برای

346

00:12:50,240 –> 00:12:52,000

توسعه منبع باز و ساخت

347

00:12:52,000 –> 00:12:53,600

بسته های پایتون است،

348

00:12:53,600 –> 00:12:56,000

ما اکنون بسته های خود را در آنجا حضور داریم

349

00:12:56,000 –> 00:12:58,560

و سپس

350

00:12:58,560 –> 00:13:00,240

بسیاری از بسته های ما یک

351

00:13:00,240 –> 00:13:03,279

در فهرست بسته پایتون در pipi نیز موجود است،

352

00:13:03,279 –> 00:13:05,600

برخی از آنها به این دلیل نیستند که

353

00:13:05,600 –> 00:13:07,760

ساختهای جایگزین پروژههای موجود

354

00:13:07,760 –> 00:13:09,839

مانند خود numpy هستند،

355

00:13:09,839 –> 00:13:12,160

بنابراین برای دریافت بیلد ما از numpy، باید

356

00:13:12,160 –> 00:13:13,680

به کانال اینتل در

357

00:13:13,680 –> 00:13:16,000

ابر آناکوندا بروید که میتوانید از طریق آن استفاده کنید.

358

00:13:16,000 –> 00:13:17,920

چرخها را درست مثل شما میتوانید از pipeyi نصب کنید،

359

00:13:17,920 –> 00:13:19,440

360

00:13:19,440 –> 00:13:21,440

اما بسیاری از بستههای دیگر ما

361

00:13:21,440 –> 00:13:22,959

مانند کتابخانهها

362

00:13:22,959 –> 00:13:26,079

در pi pi نیز موجود هستند.

363

00:13:26,079 –> 00:13:27,680

364

00:13:27,680 –> 00:13:29,600

365

00:13:29,600 –> 00:13:32,320

366

00:13:32,320 –> 00:13:33,839

شرکتی که مشاوره و

367

00:13:33,839 –> 00:13:37,040

خدماتی را در بازارهای hbc و ai ارائه میکند

368

00:13:37,040 –> 00:13:39,839

و من نیز میزبان پادکست

369

00:13:39,839 –> 00:13:42,240

با استفاده از ai هستم و میتوانم در

370

00:13:42,240 –> 00:13:45,040

توییتر و لینکدین بهعنوان frederick v v

371

00:13:45,040 –> 00:13:45,920

karen پیدا

372

00:13:45,920 –> 00:13:47,760

کنم، من در واقع یک توسعهدهنده هستم و فکر میکنم

373

00:13:47,760 –> 00:13:50,000

یکی از سوالاتی که من زیاد میپرسم این است که چگونه

374

00:13:50,000 –> 00:13:51,920

میتوانم درست شروع کنم، منظورم این است که در

375

00:13:51,920 –> 00:13:53,920

حال حاضر به اندازه کافی دشوار است که

376

00:13:53,920 –> 00:13:55,839

جامعه متنباز منبع باز

377

00:13:55,839 –> 00:13:57,920

378

00:13:57,920 –> 00:13:59,680

ابزارها

379

00:13:59,680 –> 00:14:02,880

و روشهای مختلفی در دسترس دارد، آیا دلیل خاصی وجود دارد

380

00:14:02,880 –> 00:14:05,279

که چرا چرا اینتل پس از آن

381

00:14:05,279 –> 00:14:07,600

تصمیم گرفت

382

00:14:07,600 –> 00:14:10,480

محصولات سازگار یا مشابهی را نسبت به

383

00:14:10,480 –> 00:14:12,240

آنچه در جامعه منبع باز موجود است ارائه دهد،

384

00:14:12,240 –> 00:14:14,320

به جای اینکه

385

00:14:14,320 –> 00:14:16,800

همه چیز را در یک

386

00:14:16,800 –> 00:14:19,600

بسته منبع باز جدید

387

00:14:19,600 –> 00:14:21,519

یکپارچه کند.

388

00:14:21,519 –> 00:14:24,399

389

00:14:24,399 –> 00:14:27,440

390

00:14:27,440 –> 00:14:29,279

بهینهسازیای که میتوانیم فکر کنیم که

391

00:14:29,279 –> 00:14:31,600

فکر میکنیم میتوانیم به یک پروژه منبع باز

392

00:14:31,600 –> 00:14:34,160

بیاوریم، اولین هدف ما این است که سعی کنیم

393

00:14:34,160 –> 00:14:36,240

آن بهینهسازیها را در بالادست بهدست آوریم

394

00:14:36,240 –> 00:14:38,000

تا به طور گسترده برای کل جامعه در دسترس

395

00:14:38,000 –> 00:14:39,199

396

00:14:39,199 –> 00:14:40,800

باشند، این رویکردی است که ما

397

00:14:40,800 –> 00:14:42,320

بهویژه

398

00:14:42,320 –> 00:14:44,800

با tensorflow در پیش گرفتهایم. بنابراین ما بسیار نزدیک

399

00:14:44,800 –> 00:14:46,079

با گوگل کار

400

00:14:46,079 –> 00:14:48,800

می کنیم تا بهینه سازی های خود را به تنسورفلو وارد

401

00:14:48,800 –> 00:14:51,199

کنیم تا کاربران این سوال را نداشته باشند که

402

00:14:51,199 –> 00:14:53,920

آیا این تنسورفلو را دریافت می کنم یا

403

00:14:53,920 –> 00:14:55,120

آن تنسورفلو و چه

404

00:14:55,120 –> 00:14:57,279

تفاوتی دارد اگر این باینری را

405

00:14:57,279 –> 00:14:59,440

در مقابل آن باینری دانلود کنم و واقعاً دانلود نکنیم.

406

00:14:59,440 –> 00:15:02,480

میخواهند فضای کاربر

407

00:15:02,480 –> 00:15:04,079

و آنچه کاربران آنها به

408

00:15:04,079 –> 00:15:06,320

دنبال آن هستند را تکه تکه کنند تا

409

00:15:06,320 –> 00:15:08,880

ساختارهای tensorflow که

410

00:15:08,880 –> 00:15:11,440

در جعبهابزار خود ارائه میکنیم واقعی باشند. ساختارهای

411

00:15:11,440 –> 00:15:13,680

بالادستی تنسورفلو

412

00:15:13,680 –> 00:15:15,199

آنها شامل

413

00:15:15,199 –> 00:15:17,040

برخی از بهینهسازیهای ما میشوند، اما این

414

00:15:17,040 –> 00:15:19,440

بهینهسازیها گزینههای ساختی هستند که

415

00:15:19,440 –> 00:15:21,440

شامل نمیشوند و در

416

00:15:21,440 –> 00:15:23,040

پروژه تنسورفلو بالادست گنجانده شدهاند،

417

00:15:23,040 –> 00:15:26,000

بنابراین اولین هدف ما همیشه این است که ابتدا در بالادست باشیم،

418

00:15:26,000 –> 00:15:28,240

اکنون با توجه به ماهیت

419

00:15:28,240 –> 00:15:29,920

برخی از پروژههای منبع باز

420

00:15:29,920 –> 00:15:32,399

که همیشه نمیدانید امکانپذیر است یا در

421

00:15:32,399 –> 00:15:35,839

برخی موارد کار زیادی میطلبد،

422

00:15:35,839 –> 00:15:38,000

فقط اجتماعی کردن جامعه و

423

00:15:38,000 –> 00:15:40,560

آوردن این تغییرات به آنها

424

00:15:40,560 –> 00:15:44,000

تا آنها بتوانند بفهمند ما چه میکنیم

425

00:15:44,000 –> 00:15:45,120

و در نتیجه

426

00:15:45,120 –> 00:15:47,040

بازههای زمانی مشخص نیست. همیشه سریع، بنابراین

427

00:15:47,040 –> 00:15:48,959

کاری که میخواهیم انجام دهیم این است که سعی کنیم

428

00:15:48,959 –> 00:15:50,880

بهینهسازیهای خود را در سریعترین زمان ممکن

429

00:15:50,880 –> 00:15:53,440

به کانالهایی که کنترل میکنیم، یعنی

430

00:15:53,440 –> 00:15:55,839

کانال اینتل در ابر آناکوندا

431

00:15:55,839 –> 00:15:58,240

و در منبع باز

432

00:15:58,240 –> 00:16:00,240

که github.com

433

00:16:00,240 –> 00:16:01,759

اینتل پایتون داریم، بیاوریم. از

434

00:16:01,759 –> 00:16:04,560

منابع ما در آنجا موجود است، بنابراین همه چیز

435

00:16:04,560 –> 00:16:06,079

هنوز منبع باز است و ما سعی می کنیم

436

00:16:06,079 –> 00:16:07,680

آنها را در دسترس نگه داریم،

437

00:16:07,680 –> 00:16:10,000

اما گاهی اوقات

438

00:16:10,000 –> 00:16:12,000

با

439

00:16:12,000 –> 00:16:13,759

انتشار آنها در اولین های خودمان، این مزایا را برای کاربران به ارمغان می آوریم. t یا کار

440

00:16:13,759 –> 00:16:16,480

با شرکای مانند آناکوندا

441

00:16:16,480 –> 00:16:18,560

و شاید یک سوال بعدی

442

00:16:18,560 –> 00:16:21,120

در مورد معماری باشد، بنابراین شما

443

00:16:21,120 –> 00:16:22,959

کمی در مورد xpu

444

00:16:22,959 –> 00:16:24,639

که روی معماری های مختلف اجرا می شود صحبت کردید،

445

00:16:24,639 –> 00:16:26,800

اکثر بسته هایی که ارائه

446

00:16:26,800 –> 00:16:28,959

می دهید بر روی معماری اینتل متمرکز

447

00:16:28,959 –> 00:16:32,000

هستند یا اینکه شما نیز تمرکز می کنید. در

448

00:16:32,000 –> 00:16:33,680

مورد آنچه رقبا به

449

00:16:33,680 –> 00:16:37,680

بازار می آورند مانند gpus و fpgas به عنوان مثال،

450

00:16:37,680 –> 00:16:40,079

بسیار خوب، سوال خوبی است، بنابراین

451

00:16:40,079 –> 00:16:41,759

um

452

00:16:41,759 –> 00:16:46,320

data موازی c plus plus

453

00:16:46,320 –> 00:16:48,399

مدل برنامه نویسی xpu ما است،

454

00:16:48,399 –> 00:16:50,880

این بر اساس یک استاندارد باز است و از

455

00:16:50,880 –> 00:16:54,880

کامپایلر مبتنی بر nlvm استفاده می کند و بر

456

00:16:54,880 –> 00:16:56,880

اساس داسی است. و برخی از فناوریهای موجود دیگر از

457

00:16:56,880 –> 00:16:58,240

458

00:16:58,240 –> 00:17:01,120

کامپایلری که میتوانید برای برنامهریزی

459

00:17:01,120 –> 00:17:04,640

در برابر cpus اینتل در برابر پردازندههای دیگر

460

00:17:04,640 –> 00:17:08,079

استفاده کنید، میتوان از آن برای nvidia gpus استفاده کرد،

461

00:17:08,079