در این مطلب، ویدئو کتابخانه STANZA | کتابخانه جدید استنفورد پایتون | بهتر از فضا و جنس ??????? با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:14:44

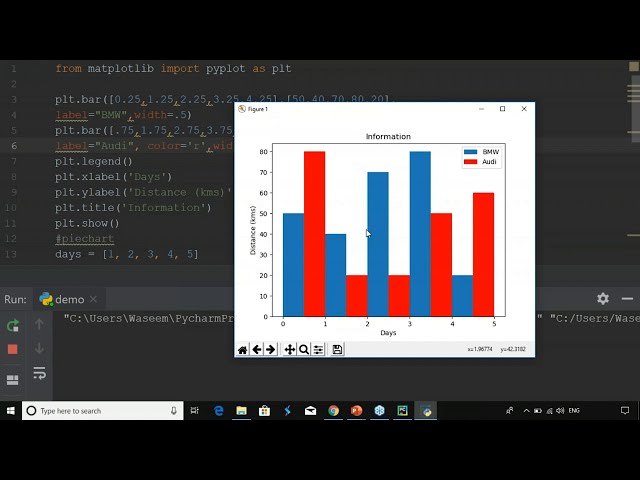

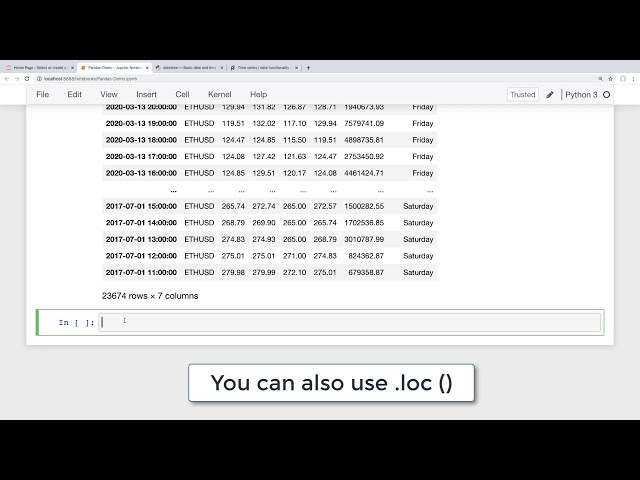

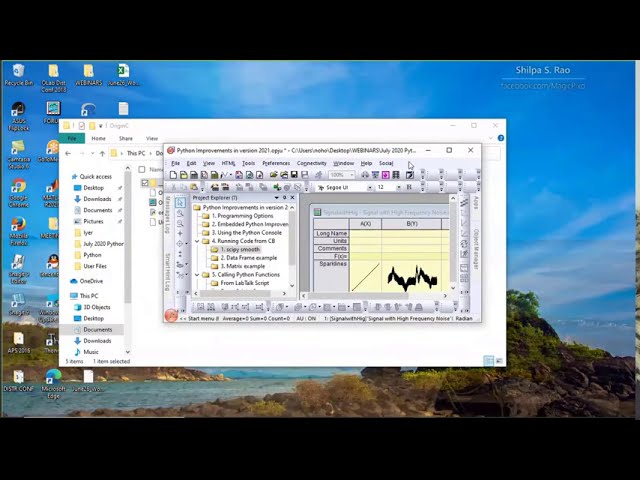

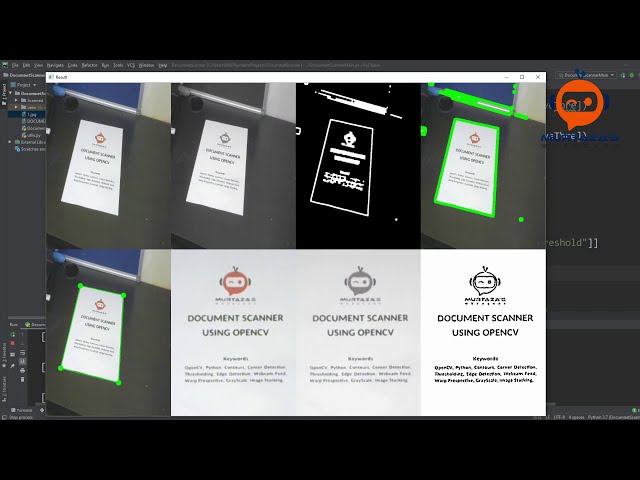

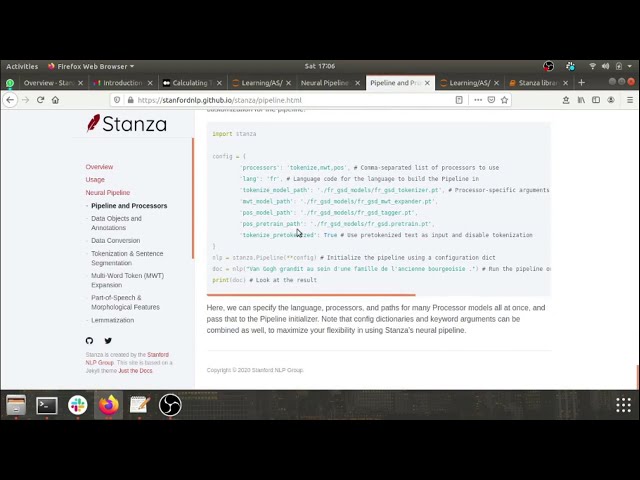

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:06,800 –> 00:00:08,400

[موسیقی]

2

00:00:08,400 –> 00:00:08,800

3

00:00:08,800 –> 00:00:10,559

بچه ها چه خبر است این akshay از

4

00:00:10,559 –> 00:00:13,200

eslearning است و امروز ما در مورد

5

00:00:13,200 –> 00:00:16,400

کتابخانه stanza خواهیم دید بنابراین همه ما می دانیم

6

00:00:16,400 –> 00:00:19,199

که core nlp یکی از بسته های جاوا

7

00:00:19,199 –> 00:00:19,920

8

00:00:19,920 –> 00:00:23,600

استنفورد است درست است بنابراین این بسته nlp هسته ای

9

00:00:23,600 –> 00:00:28,080

به دلیل اینکه در جاوا است

10

00:00:28,080 –> 00:00:30,640

دریافت نکرده است. از محبوبیت زیادی برخوردار است

11

00:00:30,640 –> 00:00:32,479

زیرا امروزه اکثر کارکنان علوم

12

00:00:32,479 –> 00:00:34,480

داده در پایتون کار می کنند

13

00:00:34,480 –> 00:00:36,800

و بسیاری از دانشمندان داده

14

00:00:36,800 –> 00:00:38,480

پایتون

15

00:00:38,480 –> 00:00:41,840

را به جاوا ترجیح می دهند و به همین دلیل است که

16

00:00:41,840 –> 00:00:43,760

بسیاری از تحقیقات انجام شده در

17

00:00:43,760 –> 00:00:45,120

18

00:00:45,120 –> 00:00:48,079

استانفورد به صورت منبع باز در دسترس بسیاری از مردم قرار نگرفت.

19

00:00:48,079 –> 00:00:50,320

20

00:00:50,320 –> 00:00:53,360

به همین دلیل است که فکر میکنم در آوریل

21

00:00:53,360 –> 00:00:56,960

یا حوالی آن دوره، استنفورد

22

00:00:56,960 –> 00:01:00,239

و تیم توسعهدهندهاش از

23

00:01:00,239 –> 00:01:04,000

گروه nlp

24

00:01:04,000 –> 00:01:07,439

یک کتابخانه پایتون به نام stanza ارائه کردند،

25

00:01:07,439 –> 00:01:10,960

بنابراین stanza

26

00:01:11,840 –> 00:01:15,040

stanza یک کتابخانه است که

27

00:01:15,040 –> 00:01:18,000

اوه یک بسته nlp برای بسیاری از

28

00:01:18,000 –> 00:01:19,920

زبانهای انسانی است،

29

00:01:19,920 –> 00:01:21,920

بنابراین یک مجموعه ای از ابزارهای دقیق و

30

00:01:21,920 –> 00:01:23,600

کارآمد برای

31

00:01:23,600 –> 00:01:27,119

بسیاری از زبان های انسانی در یک مکان، بنابراین با توجه

32

00:01:27,119 –> 00:01:29,439

به دانش من

33

00:01:29,439 –> 00:01:30,400

تاکنون هیچ کتابخانه ای ندیده ام،

34

00:01:30,400 –> 00:01:33,520

چه jensen

35

00:01:33,520 –> 00:01:36,880

spacey یا nltk که

36

00:01:36,880 –> 00:01:39,360

این کار را به خطر بیندازد. بسیاری از زبانهایی که

37

00:01:39,360 –> 00:01:40,880

در بند پوشش داده شدهاند،

38

00:01:40,880 –> 00:01:44,000

بنابراین مصراع در حال حاضر 66 زبان انسانی را پوشش میدهد

39

00:01:44,000 –> 00:01:44,640

40

00:01:44,640 –> 00:01:47,600

و این تقریباً اشکالی ندارد که

41

00:01:47,600 –> 00:01:48,640

کل

42

00:01:48,640 –> 00:01:51,759

جمعیت این دنیا را پوشش دهد، از

43

00:01:51,759 –> 00:01:52,799

متن

44

00:01:52,799 –> 00:01:54,960

ترسیمی گرفته تا تجزیه و تحلیل نحوی و بند شناسایی موجودیت،

45

00:01:54,960 –> 00:01:56,479

46

00:01:56,479 –> 00:01:59,439

مدلهای پیشرفته lp را به

47

00:01:59,439 –> 00:02:00,240

48

00:02:00,240 –> 00:02:03,840

زبانهای شما میآورد. با انتخاب همه ما در

49

00:02:03,840 –> 00:02:07,600

مورد نوع کار nlp که در استانفورد انجام می شود

50

00:02:07,600 –> 00:02:08,720

51

00:02:08,720 –> 00:02:11,920

و سطح مدل هایی که در

52

00:02:11,920 –> 00:02:13,120

آنجا توسعه داده می شوند، می دانیم

53

00:02:13,120 –> 00:02:16,160

همه این مدل ها تا کنون

54

00:02:16,160 –> 00:02:18,640

با کمک بند و پایتون

55

00:02:18,640 –> 00:02:19,200

56

00:02:19,200 –> 00:02:21,599

در دسترس ما هستند تا کنون که در دسترس بودند. شکلی از

57

00:02:21,599 –> 00:02:23,040

core nlp

58

00:02:23,040 –> 00:02:26,000

که یک بسته جاوا بود و حالا بالاخره

59

00:02:26,000 –> 00:02:26,959

سانفورد

60

00:02:26,959 –> 00:02:28,879

با یک بسته پایتون آمده است تا

61

00:02:28,879 –> 00:02:31,519

به کتابخانههایی مانند jensen

62

00:02:31,519 –> 00:02:34,480

spacey و ltk ضربه بزند و همه آنها بیایید بیشتر

63

00:02:34,480 –> 00:02:35,440

در مورد آن

64

00:02:35,440 –> 00:02:38,560

ببینیم این یک بسته تجزیه و تحلیل زبان طبیعی پایتون

65

00:02:38,560 –> 00:02:41,519

است که حاوی ابزارهایی است یک

66

00:02:41,519 –> 00:02:42,480

خط لوله

67

00:02:42,480 –> 00:02:44,720

برای متن زبان انسان به صورت جملات

68

00:02:44,720 –> 00:02:46,319

و کلمات ایجاد می کند، بنابراین

69

00:02:46,319 –> 00:02:49,360

اساساً بر اساس ایجاد

70

00:02:49,360 –> 00:02:53,200

خط لوله شبکه عصبی کار می کند و

71

00:02:53,200 –> 00:02:56,319

بله آن را com حدود 60 زبان را وعده می دهد

72

00:02:56,319 –> 00:02:59,760

و زبان های

73

00:02:59,920 –> 00:03:02,560

زیادی را به دلیل فرمالیسم وابستگی جهانی اش پوشش داده است، به همین دلیل است.

74

00:03:02,560 –> 00:03:03,440

75

00:03:03,440 –> 00:03:07,599

76

00:03:07,599 –> 00:03:10,959

77

00:03:10,959 –> 00:03:14,080

78

00:03:14,080 –> 00:03:18,159

79

00:03:18,159 –> 00:03:20,640

80

00:03:20,640 –> 00:03:21,440

که

81

00:03:21,440 –> 00:03:24,480

ما یک پردازنده مجزا

82

00:03:24,480 –> 00:03:28,000

برای همه این فعالیتهای

83

00:03:28,000 –> 00:03:32,159

وابستگی به بخشهایی از گفتار داریم و

84

00:03:32,159 –> 00:03:35,440

محدودیت تگگذاری منطقی رسمی،

85

00:03:35,440 –> 00:03:38,159

توکنسازی گسترش نشانه چند کلمهای،

86

00:03:38,159 –> 00:03:39,440

بنابراین

87

00:03:39,440 –> 00:03:41,680

پردازندههایی برای همه این فعالیتهای اصلی داریم

88

00:03:41,680 –> 00:03:43,040

89

00:03:43,040 –> 00:03:46,799

که وارد پیشپردازش nlp میشوند و

90

00:03:46,799 –> 00:03:49,360

سپس 66 زبان داریم. برای ما همه

91

00:03:49,360 –> 00:03:50,239

این پردازنده

92

00:03:50,239 –> 00:03:53,360

ها به 66 زبان در دسترس کاربران هستند

93

00:03:53,360 –> 00:03:56,560

و سپس یک

94

00:03:56,560 –> 00:03:58,799

95

00:03:58,799 –> 00:04:02,000

شی سند بسته سند متاسفیم و

96

00:04:02,000 –> 00:04:04,319

در شیء سند جملات داریم و

97

00:04:04,319 –> 00:04:06,000

در جملات کلمات

98

00:04:06,000 –> 00:04:09,360

در کلمات داریم توکن داریم و آن کلمات مربوط

99

00:04:09,360 –> 00:04:11,680

به خود را دارند. قسمت های لم از

100

00:04:11,680 –> 00:04:13,439

گفتار سر

101

00:04:13,439 –> 00:04:16,720

آوریل و همه بنابراین ما این را به طور

102

00:04:16,720 –> 00:04:19,519

کامل در یک کد پایتون خواهیم دید،

103

00:04:19,519 –> 00:04:20,000

104

00:04:20,000 –> 00:04:22,880

اما این درست است W خط لوله شبکه عصبی

105

00:04:22,880 –> 00:04:25,280

کار بند و کل

106

00:04:25,280 –> 00:04:27,360

این بلوک بنیادی

107

00:04:27,360 –> 00:04:28,320

کتابخانه بند است،

108

00:04:28,320 –> 00:04:31,840

خوب حالا اجازه دهید اوه، پس اگر می خواهید از transa استفاده

109

00:04:31,840 –> 00:04:32,479

110

00:04:32,479 –> 00:04:34,400

کنید، ابتدا باید یک بند نصب pip انجام دهید،

111

00:04:34,400 –> 00:04:36,960

112

00:04:37,360 –> 00:04:40,840

من به شما توصیه می کنم یک ماشین مجازی ایجاد کنید

113

00:04:40,840 –> 00:04:43,520

114

00:04:43,520 –> 00:04:46,720

زیرا اوه متاسفم. یک محیط مجازی

115

00:04:46,720 –> 00:04:49,759

چون در چارچوب پایتورچ ما کار میکند،

116

00:04:49,759 –> 00:04:50,560

117

00:04:50,560 –> 00:04:53,759

بنابراین ممکن است برخی از مسائل مربوط به وابستگیها وجود داشته باشد،

118

00:04:53,759 –> 00:04:56,000

بنابراین من یک محیط مجازی ایجاد کردم و

119

00:04:56,000 –> 00:04:57,680

سپس

120

00:04:57,680 –> 00:04:59,759

stanza را نصب کردم، بنابراین مصراع را وارد میکنم،

121

00:04:59,759 –> 00:05:02,000

122

00:05:02,000 –> 00:05:03,680

123

00:05:03,680 –> 00:05:06,880

با توجه به شلوغی کانال یوتیوب من، بند را برای زبان انگلیسی دانلود میکنم.

124

00:05:06,880 –> 00:05:09,600

اما شما می توانید این کار را برای 66

125

00:05:09,600 –> 00:05:10,000

126

00:05:10,000 –> 00:05:13,759

زبان مختلف انجام دهید، پس از آن، من یک

127

00:05:13,759 –> 00:05:15,039

خط لوله ایجاد می کنم

128

00:05:15,039 –> 00:05:18,240

و آن را nlp okay می نامم،

129

00:05:18,240 –> 00:05:20,639

بنابراین می بینید که

130

00:05:20,639 –> 00:05:23,440

استفاده از gpus و همچنین

131

00:05:23,440 –> 00:05:26,240

nvidia gpu عملکرد بسیار آسانی دارید.

132

00:05:26,240 –> 00:05:28,800

در پردازنده

133

00:05:28,800 –> 00:05:32,000

در کاما پارامتر خود از gpu true استفاده کنید،

134

00:05:32,000 –> 00:05:34,560

بنابراین به شما نشان خواهم داد که اگر می خواهید این کار را انجام دهید

135

00:05:34,560 –> 00:05:36,720

136

00:05:36,800 –> 00:05:41,440

، فکر می کنم در اینجا وجود دارد um

137

00:05:41,680 –> 00:05:45,919

pipeline و

138

00:05:47,440 –> 00:05:50,720

آن پارامتر استفاده از gpu را پردازش می کند

139

00:05:50,720 –> 00:05:53,360

بله بنابراین در اینجا می توانید استفاده از gpu true را مشاهده کنید

140

00:05:53,360 –> 00:05:54,320

و به این ترتیب

141

00:05:54,320 –> 00:05:57,199

می توانید شروع به استفاده از nvidia gpus برای

142

00:05:57,199 –> 00:05:57,919

آن

143

00:05:57,919 –> 00:06:00,880

کنید و همانطور که به شما گفتم ما پردازنده های

144

00:06:00,880 –> 00:06:01,600

145

00:06:01,600 –> 00:06:03,680

مختلفی برای فعالیت های مختلف داریم مانند

146

00:06:03,680 –> 00:06:05,039

tokenize pos

147

00:06:05,039 –> 00:06:08,400

lemma dependency passing sentiment

148

00:06:08,400 –> 00:06:11,680

و و anias okay now

149

00:06:11,680 –> 00:06:16,000

اوه ما اوه ما درست است یک خط لوله برای

150

00:06:16,000 –> 00:06:17,039

زبان انگلیسی ایجاد

151

00:06:17,039 –> 00:06:19,360

کرده ایم و ما جمله خود را تغذیه می کنیم،

152

00:06:19,360 –> 00:06:21,199

بنابراین من یک جمله گرفتم akshay در حال

153

00:06:21,199 –> 00:06:22,080

آموزش

154

00:06:22,080 –> 00:06:25,360

است یک کتابخانه و من یک

155

00:06:25,360 –> 00:06:26,400

شیء doc از آن ایجاد

156

00:06:26,400 –> 00:06:28,960

کردم، خوب وقتی این شی را چاپ می کنم فقط

157

00:06:28,960 –> 00:06:31,120

نتایج این را ببینید

158

00:06:31,120 –> 00:06:34,400

من یک شناسه دارم و سپس

159

00:06:34,400 –> 00:06:37,440

متنی دارم که akshay است، من

160

00:06:37,440 –> 00:06:40,400

یک لم از آن دارم که محدود کردن است، من یک pos

161

00:06:40,400 –> 00:06:40,800

دارم،

162

00:06:40,800 –> 00:06:43,919

بنابراین ما چیزی نیست جز

163

00:06:43,919 –> 00:06:48,160

بخشهایی از گفتار که توسط بخشهای جهانی گفتار انجام میشود.

164

00:06:48,160 –> 00:06:50,880

165

00:06:50,880 –> 00:06:52,560

166

00:06:52,560 –> 00:06:54,400

هنگامی که بخشهای گفتار با

167

00:06:54,400 –> 00:06:55,919

استفاده از بانک درختی

168

00:06:55,919 –> 00:06:58,720

Okay انجام میشود، بنابراین به این ترتیب ما دو بخش از

169

00:06:58,720 –> 00:06:59,280

گفتار داریم،

170

00:06:59,280 –> 00:07:02,319

زیرا میبینید که بخشهای

171

00:07:02,319 –> 00:07:03,759

کلی گفتار شما قادر

172

00:07:03,759 –> 00:07:07,360

به شناسایی درست آن نیستند، زیرا akshay یک

173

00:07:07,360 –> 00:07:10,400

اسم خاص است okay پس ما یک

174

00:07:10,400 –> 00:07:12,560

شاهکار داریم. در اینجا ما h عدد ave برابر با

175

00:07:12,560 –> 00:07:14,720

مفرد است، ما سر شما را

176

00:07:14,720 –> 00:07:18,479

داریم، دیپل شما را داریم، سپس

177

00:07:18,479 –> 00:07:20,160

کاراکتر آغازین خود را داریم،

178

00:07:20,160 –> 00:07:21,680

نویسه n را داریم و ner را داریم،

179

00:07:21,680 –> 00:07:24,080

بنابراین ner چیزی نیست جز تشخیص نهاد نام ما

180

00:07:24,080 –> 00:07:25,199

181

00:07:25,199 –> 00:07:29,360

خوب است، پس آه، پس

182

00:07:29,360 –> 00:07:33,360

به طور مشابه این کارها نیز

183

00:07:33,360 –> 00:07:35,919

انجام می شوند. برای هر نشانه دیگری از آن درست است،

184

00:07:35,919 –> 00:07:37,520

بنابراین ما یک جمله داریم، کلمات داریم و

185

00:07:37,520 –> 00:07:40,319

سپس نشانههایی داریم،

186

00:07:40,880 –> 00:07:42,639

بنابراین همانطور که میبینید، اکنون یک کتابخانه داریم که

187

00:07:42,639 –> 00:07:44,319

مخالفت کرده است،

188

00:07:44,319 –> 00:07:46,160

بنابراین شما یک سال دارید، ما اینجا داریم

189

00:07:46,160 –> 00:07:47,680

یک مطابقت پیدا میکنیم، سپس

190

00:07:47,680 –> 00:07:50,080

فید ما اعداد داریم. برابر