در این مطلب، ویدئو تابع ضرر یا هزینه | آموزش عمیق یادگیری 11 (آموزش تنسورفلو، کراس و پایتون) با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:24:37

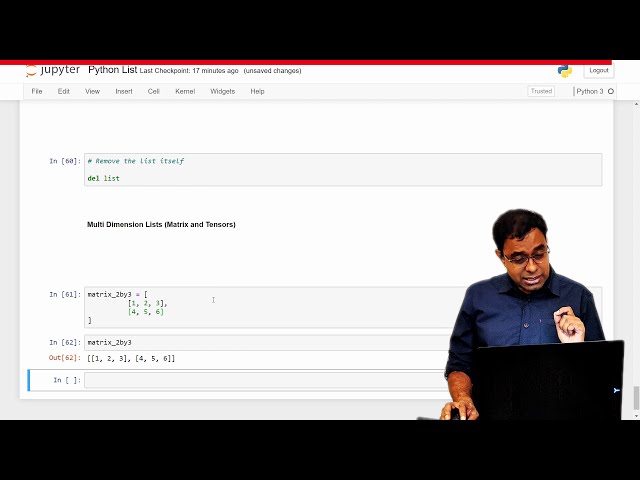

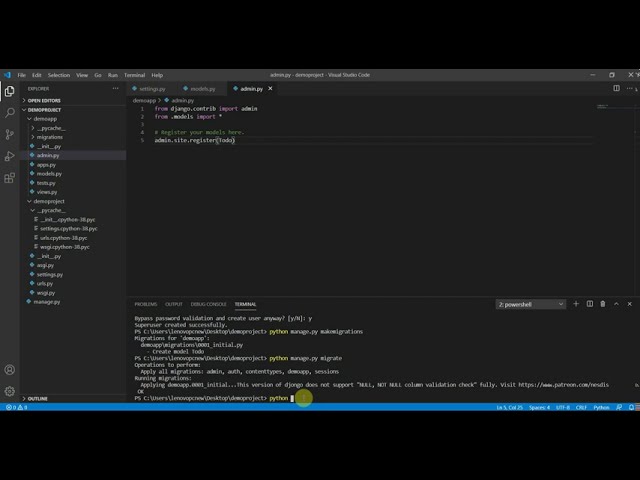

تصاویر این ویدئو:

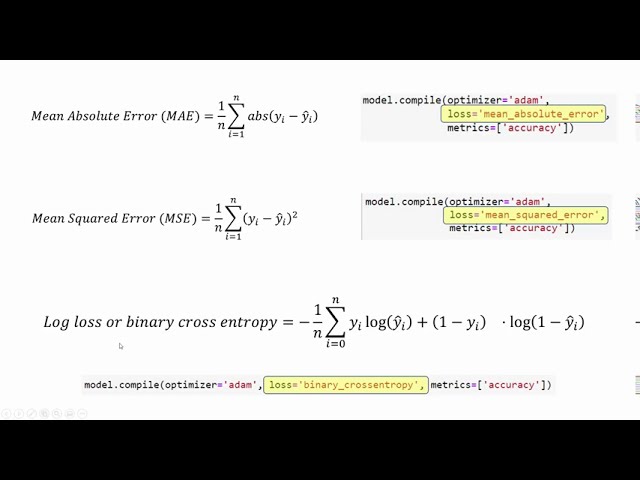

قسمتی از زیرنویس این فیلم:

00:00:00,399 –> 00:00:02,159

برای اینکه بفهمیم

2

00:00:02,159 –> 00:00:04,240

آموزش شبکه عصبی چگونه کار میکند، مهم

3

00:00:04,240 –> 00:00:05,759

است که درک خوبی از

4

00:00:05,759 –> 00:00:08,080

ضرر یا تابع هزینه داشته باشیم و این همان چیزی است

5

00:00:08,080 –> 00:00:10,000

که در این ویدیو

6

00:00:10,000 –> 00:00:11,840

به طور معمول به آن میپردازیم، ابتدا برخی از نظریهها را مرور

7

00:00:11,840 –> 00:00:14,080

میکنیم و سپس اجرا میکنیم.

8

00:00:14,080 –> 00:00:17,440

توابع هزینه های مختلف در پایتون و

9

00:00:17,440 –> 00:00:19,600

در پایان یک

10

00:00:19,600 –> 00:00:21,840

تمرین جالب برای شما خواهیم داشت که روی آن کار کنید، بنابراین بیایید

11

00:00:21,840 –> 00:00:23,279

12

00:00:23,279 –> 00:00:25,840

در این سری آموزش یادگیری عمیق شروع

13

00:00:25,840 –> 00:00:27,119

کنیم، ما قبلاً

14

00:00:27,119 –> 00:00:29,199

یک شبکه عصبی برای تشخیص

15

00:00:29,199 –> 00:00:30,480

16

00:00:30,480 –> 00:00:32,399

ارقام دست نویس ساخته ایم و اگر آن

17

00:00:32,399 –> 00:00:34,320

آموزش را دنبال کرده اید متوجه خواهید شد که یکی از

18

00:00:34,320 –> 00:00:36,480

پارامترهایی که در حین کامپایل مدل استفاده می کنیم

19

00:00:36,480 –> 00:00:37,760

، این

20

00:00:37,760 –> 00:00:40,079

تابع ضرر است و این چیزی است که

21

00:00:40,079 –> 00:00:42,079

در این ویدیو در مورد آن صحبت می کنیم،

22

00:00:42,079 –> 00:00:45,680

بنابراین با رفتن به ارائه ما،

23

00:00:45,680 –> 00:00:48,480

می توانید در هنگام ساختن یک تابع، مقادیر مختلفی را برای این تابع ضرر تعیین کنید.

24

00:00:48,480 –> 00:00:48,800

25

00:00:48,800 –> 00:00:51,120

26

00:00:51,120 –> 00:00:53,600

keras یا یک مدل tensorflow

27

00:00:53,600 –> 00:00:56,640

ما از آنتروپی متقاطع طبقهبندی گذشته استفاده میکنیم،

28

00:00:56,640 –> 00:00:58,000

اما مقادیر احتمالی

29

00:00:58,000 –> 00:01:01,120

دیگری مانند آنتروپی متقاطع باینری وجود دارد.

30

00:01:01,120 –> 00:01:03,920

آنتروپی متقاطع طبقهای میانگین

31

00:01:03,920 –> 00:01:06,159

خطای مطلق میانگین مربع خطا

32

00:01:06,159 –> 00:01:09,040

اکنون در لیست پخش آموزش یادگیری ماشین

33

00:01:09,040 –> 00:01:09,760

34

00:01:09,760 –> 00:01:11,920

ما قبلاً در مورد میانگین مربع خطا صحبت کرده ایم،

35

00:01:11,920 –> 00:01:12,880

36

00:01:12,880 –> 00:01:15,119

بنابراین می خواهیم با استفاده از مثال کارت بازی، فرض کنیم شما و دوستتان این دو

37

00:01:15,119 –> 00:01:17,600

خطای میانگین مطلق و میانگین مربع

38

00:01:17,600 –> 00:01:19,360

خطا را به سرعت بررسی

39

00:01:19,360 –> 00:01:21,040

کنیم

40

00:01:21,040 –> 00:01:24,000

. بازی کردن با

41

00:01:24,000 –> 00:01:25,520

42

00:01:25,520 –> 00:01:28,240

کلاب بازی، کارتهای بازی خوب است و دوست شما

43

00:01:28,240 –> 00:01:29,280

سه کارت دارد

44

00:01:29,280 –> 00:01:32,320

که شما از آنها مطلع نیستید و او از

45

00:01:32,320 –> 00:01:33,840

شما میخواهد که حدس

46

00:01:33,840 –> 00:01:36,400

بزنید این کارتها چیست، شما یک

47

00:01:36,400 –> 00:01:37,360

حدس تصادفی میزنید

48

00:01:37,360 –> 00:01:39,360

و میگویید کارت اول هشت است، کارت

49

00:01:39,360 –> 00:01:42,159

دوم است. ملکه و نفر سوم شش است،

50

00:01:42,159 –> 00:01:44,880

سپس از دوستتان بپرسید که

51

00:01:44,880 –> 00:01:47,439

پیش بینی شما چقدر دقیق بوده است

52

00:01:47,439 –> 00:01:49,759

که او چه خواهد کرد.

53

00:01:49,759 –> 00:01:51,840

54

00:01:51,840 –> 00:01:52,960

55

00:01:52,960 –> 00:01:55,759

56

00:01:55,759 –> 00:01:57,759

دو

57

00:01:57,759 –> 00:01:58,880

کارت

58

00:01:58,880 –> 00:02:00,719

به عنوان مثال فاصله بین هشت

59

00:02:00,719 –> 00:02:02,399

و یک پادشاه پنج است زیرا

60

00:02:02,399 –> 00:02:06,240

پس از آن که نه ده شد، سپس جک

61

00:02:06,240 –> 00:02:10,959

و سپس ملکه و سپس شاه. بنابراین مجموع پنج

62

00:02:10,959 –> 00:02:12,879

به طور مشابه فاصله بین شش و

63

00:02:12,879 –> 00:02:14,560

هفت بدیهی است یک

64

00:02:14,560 –> 00:02:17,599

و ملکه و نه سه است بنابراین مجموع

65

00:02:17,599 –> 00:02:19,920

خطای شما 9 بود

66

00:02:19,920 –> 00:02:22,400

و میانگین خطای آن سه خواهد بود

67

00:02:22,400 –> 00:02:24,000

زیرا سه کارت نه تقسیم بر

68

00:02:24,000 –> 00:02:25,520

سه می دانید که ریاضی ساده

69

00:02:25,520 –> 00:02:28,000

سه میانگین خطا است که به آن

70

00:02:28,000 –> 00:02:28,959

میانگین

71

00:02:28,959 –> 00:02:32,239

خطای مطلق می گویند و روش دیگر یافتن آن است. خطا

72

00:02:32,239 –> 00:02:34,000

همان مربع خطا خواهد بود،

73

00:02:34,000 –> 00:02:36,239

جایی که شما خطا را می گیرید و

74

00:02:36,239 –> 00:02:37,760

مربع آن را انجام می دهید

75

00:02:37,760 –> 00:02:40,160

و سپس میانگین آن مربع را می گیرید،

76

00:02:40,160 –> 00:02:41,920

بنابراین در اینجا

77

00:02:41,920 –> 00:02:45,280

میانگین مجذور خطا 35 در 3 خواهد بود.

78

00:02:45,280 –> 00:02:47,920

ممکن است بپرسید که چرا باید مربع را انجام دهید

79

00:02:47,920 –> 00:02:48,800

.

80

00:02:48,800 –> 00:02:51,440

خوب در آموزش شبکه عصبی یا به

81

00:02:51,440 –> 00:02:53,599

طور کلی در یادگیری ماشین،

82

00:02:53,599 –> 00:02:57,120

داشتن مربعات خطا تا حدی کاربرد

83

00:02:57,120 –> 00:03:00,000

دارد و به طراحی گرادیان شما اجازه می دهد تا به

84

00:03:00,000 –> 00:03:00,879

85

00:03:00,879 –> 00:03:02,879

روشی بهتر همگرا شود، اکنون چه

86

00:03:02,879 –> 00:03:04,319

نزول گرادیانی است

87

00:03:04,319 –> 00:03:07,360

چه همگرایی uh، ما بعداً به

88

00:03:07,360 –> 00:03:08,720

همه آن پارامترها خواهیم پرداخت.

89

00:03:08,720 –> 00:03:11,920

در حال حاضر فقط فرض کنید

90

00:03:11,920 –> 00:03:14,159

که مربع خطا در

91

00:03:14,159 –> 00:03:15,920

بسیاری از موارد مفید است، زمانی که شما در مورد

92

00:03:15,920 –> 00:03:18,560

یادگیری ماشین صحبت می کنید،

93

00:03:18,560 –> 00:03:21,760

بنابراین از دست دادن چه ارتباطی با

94

00:03:21,760 –> 00:03:23,519

شبکه عصبی دارد، این سوالی است

95

00:03:23,519 –> 00:03:26,159

که این حدود عبوس t دارد می پرسد

96

00:03:26,159 –> 00:03:28,799

و سگ عاقل می گوید

97

00:03:28,799 –> 00:03:30,959

که در آموزش شبکه های عصبی استفاده می شود، بنابراین ضرر

98

00:03:30,959 –> 00:03:32,080

در طول آموزش شبکه عصبی به شدت مورد استفاده قرار

99

00:03:32,080 –> 00:03:34,400

می گیرد و ما

100

00:03:34,400 –> 00:03:35,360

101

00:03:35,360 –> 00:03:38,000

دقیقا نحوه استفاده از آن را بررسی خواهیم کرد، بنابراین

102

00:03:38,000 –> 00:03:38,799

به

103

00:03:38,799 –> 00:03:42,480

مثال مجموعه داده های بیمه استاندارد خود برمی گردیم.

104

00:03:42,480 –> 00:03:44,159

اگر این مجموعه آموزشی را دنبال

105

00:03:44,159 –> 00:03:46,159

نمی کنید و به

106

00:03:46,159 –> 00:03:47,519

طور تصادفی با این ویدیو برخورد

107

00:03:47,519 –> 00:03:49,200

می کنید، پیشنهاد می کنم تمام

108

00:03:49,200 –> 00:03:51,360

آموزش های قبلی را در این مجموعه آموزش یادگیری عمیق

109

00:03:51,360 –> 00:03:52,560

110

00:03:52,560 –> 00:03:54,879

111

00:03:54,879 –> 00:03:57,439

112

00:03:57,439 –> 00:04:00,080

تماشا کنید.

113

00:04:00,080 –> 00:04:01,280

در مورد اینکه

114

00:04:01,280 –> 00:04:03,200

شما سعی می کنید پیش بینی کنید که شخص

115

00:04:03,200 –> 00:04:05,200

بیمه خواهد خرید یا خیر،

116

00:04:05,200 –> 00:04:08,159

گاهی اوقات فردی را می بینید که 47

117

00:04:08,159 –> 00:04:09,040

سال سن دارد

118

00:04:09,040 –> 00:04:12,080

و از قیمت مناسبی برخوردار است، بنابراین

119

00:04:12,080 –> 00:04:14,480

احتمالاً آن را با قیمت مناسب خریداری می کند به

120

00:04:14,480 –> 00:04:15,439

این معنی

121

00:04:15,439 –> 00:04:17,680

که آیا شخص می تواند بیمه را بخرد یا

122

00:04:17,680 –> 00:04:19,279

خیر اگر شما هستید 10

123

00:04:19,279 –> 00:04:21,040

000 روپیه در ماه اجرا کنید و اگر از

124

00:04:21,040 –> 00:04:24,240

شما بخواهم بیمه 9000 روپیه در ماه بخرید،

125

00:04:24,240 –> 00:04:26,560

قیمت شما صفر می شود زیرا

126

00:04:26,560 –> 00:04:28,080

این بسیار گران است

127

00:04:28,080 –> 00:04:30,000

اما اگر 10 000 درآمد داشته باشید و اگر من

128

00:04:30,000 –> 00:04:32,240

از شما می خواهم که بیمه بخرید یا ماهیانه 500 روپیه

129

00:04:32,240 –> 00:04:33,120

130

00:04:33,120 –> 00:04:36,240

، احتمالاً آن را بخرید، بنابراین این

131

00:04:36,240 –> 00:04:37,360

چیزی است که

132

00:04:37,360 –> 00:04:40,800

اکنون در اینجا وجود دارد سن و مقرون به صرفه بودن

133

00:04:40,800 –> 00:04:44,560

x است و داشتن بیمه y است که به

134

00:04:44,560 –> 00:04:46,639

این پارامترهای مستقل نیز می گویند

135

00:04:46,639 –> 00:04:48,479

و y یک

136

00:04:48,479 –> 00:04:52,240

پارامتر وابسته است و در ماشین یادگیری

137

00:04:52,240 –> 00:04:54,800

یادگیری تمام تلاش شما این است

138

00:04:54,800 –> 00:04:56,320

که به یک تابع پیش بینی برسید

139

00:04:56,320 –> 00:04:59,440

که y برابر با f از x است

140

00:04:59,440 –> 00:05:02,880

، به همین سادگی است و ما قبلاً

141

00:05:02,880 –> 00:05:04,479

این تصویر را دیده ایم که

142

00:05:04,479 –> 00:05:07,280

این رگرسیون لجستیک است که بر

143

00:05:07,280 –> 00:05:07,520

اساس

144

00:05:07,520 –> 00:05:10,720

سن و مقرون به صرفه بودن شما مجموع وزنی را محاسبه کنید

145

00:05:10,720 –> 00:05:12,479

و سپس

146

00:05:12,479 –> 00:05:13,759

تابع سیگموید را

147

00:05:13,759 –> 00:05:15,919

دوباره اعمال کردید، ما همه اینها را در ویدیوهای قبلی خود توضیح داده ایم،

148

00:05:15,919 –> 00:05:17,919

بنابراین بچه ها اگر آن را

149

00:05:17,919 –> 00:05:18,880

تماشا نکرده اید

150

00:05:18,880 –> 00:05:21,280

، پیشنهاد می کنم این ویدیو را مکث کنید و

151

00:05:21,280 –> 00:05:23,680

آن آموزش های عالی را تماشا کنید تا

152

00:05:23,680 –> 00:05:24,720

153

00:05:24,720 –> 00:05:27,360

از این همه ریاضیات نترسید.

154

00:05:27,360 –> 00:05:27,919

155

00:05:27,919 –> 00:05:30,560

اگر ویدیوهای قبلی را دیده اید، همه اینها ریاضی بسیار آسان است، به من اعتماد

156

00:05:30,560 –> 00:05:32,080

157

00:05:32,080 –> 00:05:36,240

کنید، بنابراین در اینجا نام بازی

158

00:05:36,240 –> 00:05:39,280

این است که w1 و w2 را بفهمید، بنابراین چه

159

00:05:39,280 –> 00:05:40,400

اتفاقی می افتد این است

160

00:05:40,400 –> 00:05:43,600

که شما مجموعه آموزشی خود را مرور کنید

161

00:05:43,600 –> 00:05:45,440

. یادگیری نظارت شده، بنابراین شما

162

00:05:45,440 –> 00:05:47,440

نمونه آموزشی خود را یکی یکی مرور می کنید،

163

00:05:47,440 –> 00:05:51,360

بنابراین 22 و یکی را می گیرید، سپس

164

00:05:51,360 –> 00:05:56,000

ابتدا سعی می کنید w1 و w2 را

165

00:05:56,000 –> 00:05:59,199

با مقداری وزن تصادفی شروع کنید،

166

00:05:59,199 –> 00:06:01,919

بنابراین در حال حاضر w1 w2 را مقداردهی اولیه می کنم تا

167

00:06:01,919 –> 00:06:03,120

یک

168

00:06:03,120 –> 00:06:05,759

باشد و می تواند صفر شود. مقادیر تصادفی

169

00:06:05,759 –> 00:06:07,600

باشید، شما فقط یک مورد تصادفی می سازید،

170

00:06:07,600 –> 00:06:10,880

بنابراین w یک و دو را به یک مقداردهی اولیه می

171

00:06:10,880 –> 00:06:13,360

کنیم و سپس اولین نمونه را

172

00:06:13,360 –> 00:06:14,880

به شبکه عصبی خود وارد می

173

00:06:14,880 –> 00:06:17,759

کنیم که اکنون در مورد آموزش صحبت می کنیم و

174

00:06:17,759 –> 00:06:19,440

سپس

175

00:06:19,440 –> 00:06:22,720

نتیجه را پیدا می کنیم تا از y

176

00:06:22,720 –> 00:06:26,000

کلاه برای پیش بینی استفاده شود. خروجی

177

00:06:26,000 –> 00:06:29,039

و y برای

178

00:06:29,039 –> 00:06:32,639

خروجی واقعی استفاده می شود، مقدار واقعی شما در اینجا صفر است، ببینید

179

00:06:32,639 –> 00:06:35,520

که بیمه 0 است اما کلاه y

180

00:06:35,520 –> 00:06:36,960

شما 0.99 را به شما می گوید،

181

00:06:36,960 –> 00:06:39,199

بنابراین واضح است که خطا می کند،

182

00:06:39,199 –> 00:06:40,720

بنابراین سعی کنید خطا را

183

00:06:40,720 –> 00:06:44,080

یکی از راه های پیدا کردن این خطا پیدا کنید.

184

00:06:44,080 –> 00:06:47,520

میانگین خطای مطلق است که

185

00:06:47,520 –> 00:06:49,440

فقط یک تفاوت مطلق بین این

186

00:06:49,440 –> 00:06:51,360

دو مقدار است،

187

00:06:51,360 –> 00:06:55,199

به طور مشابه شما نمونه دوم را

188

00:06:55,199 –> 00:06:57,039

که آن را به شبکه خود تغذیه می کنید، آن

189

00:06:57,039 –> 00:07:00,160

را یک گذر جلو می گویند.

190

00:07:00,160 –> 00:07:03,440

191

00:07:03,440 –> 00:07:05,599

192

00:07:05,599 –> 00:07:06,800

خطای شماره دو است،

193

00:07:06,800 –> 00:07:09,520

ما در مجموع 13 نمونه داریم، بنابراین در

194

00:07:09,520 –> 00:07:11,840

نهایت در نمونه سیزدهم

195

00:07:11,840 –> 00:07:12,479

،

196

00:07:12,479 –> 00:07:15,599

خطای شماره 13 را خواهید داشت و

197

00:07:15,599 –> 00:07:18,880

سپس تمام آن خطاها را جمع می کنید،

198

00:07:18,880 –> 00:07:21,919

بنابراین این

199

00:07:21,919 –> 00:07:24,319

فرمول است که مانند سیگما i برابر است با 1 تا n

200

00:07:24,319 –> 00:07:26,479

y مطلق. منهای y کلاه

201

00:07:26,479 –> 00:07:29,759

تمام کاری که انجام می دهد این است که

202

00:07:29,759 –> 00:07:33,840

تمام 13 خطا را جمع می کند و مجموعی که به دست می

203

00:07:33,840 –> 00:07:36,240

آید شما میانگین یا میانگین

204

00:07:36,240 –> 00:07:40,880

آن را میانگین خطای مطلق می گویند یا

205

00:07:40,880 –> 00:07:44,319

در اینجا میانگین خطای مطلق را

206

00:07:44,319 –> 00:07:47,360

تابع هزینه می نامند و خطاهای فردی

207

00:07:47,360 –> 00:07:50,319

که ما خطای 1 2 و غیره را دریافت می کنیم که اکنون به

208

00:07:50,319 –> 00:07:52,400

آن ضرر

209

00:07:52,400 –> 00:07:55,599

می گویند، گاهی اوقات افراد از ضرر و هزینه

210

00:07:55,599 –> 00:07:56,879

به عنوان مترادف استفاده می کنند،

211

00:07:56,879 –> 00:08:00,160

اما طبق گفته اندرو آنگ، می دانید که

212

00:08:00,160 –> 00:08:03,520

خطاهای فردی ضرر نامیده می شوند

213

00:08:03,520 –> 00:08:06,479

و خطای تجمعی یا میانگین

214

00:08:06,479 –> 00:08:08,000

خطای مطلق تابع هزینه نامیده می شود،

215

00:08:08,000 –> 00:08:11,360

بنابراین در

216

00:08:11,360 –> 00:08:14,800

اینجا میانگین خطای مطلق من است. 10.02 است

217

00:08:14,800 –> 00:08:18,400

و هنگامی که تمام نمونه های آموزشی را طی کردم،

218

00:08:18,400 –> 00:08:19,840

پس از اتمام

219

00:08:19,840 –> 00:08:23,039

دور تک مرحله

220

00:08:23,039 –> 00:08:26,479

Uh به جلو و گذراندن تمام نمونه آموزشی به

221

00:08:26,479 –> 00:08:27,599

آن

222

00:08:27,599 –> 00:08:30,720

یک دوره می گویند، بنابراین

223

00:08:30,720 –> 00:08:34,399

یک دوره تمام نمونه های آموزشی را طی می کند.

224

00:08:34,399 –> 00:08:38,080

e و اگر از model.fit ما به خاطر داشته باشید

225

00:08:38,080 –> 00:08:39,919

226

00:08:39,919 –> 00:08:41,919

یکی از پارامترهایی را که داشت متناسب بود

227

00:08:41,919 –> 00:08:43,200

epoch

228

00:08:43,200 –> 00:08:46,399

so epoch پنج بود، پس بیایید نگاه کنیم که

229

00:08:46,399 –> 00:08:49,519

در اینجا می بینید که ما phi epoch را انجام دادیم که

230

00:08:49,519 –> 00:08:50,800

به این معنی است که

231

00:08:50,800 –> 00:08:53,519

ما تمام نمونه ها را در مجموع پنج بار مرور کردیم

232

00:08:53,519 –> 00:08:56,480

233

00:08:56,959 –> 00:08:59,680

بنابراین میانگین خطای مطلق چیزی است که

234

00:08:59,680 –> 00:09:00,880

قبلاً به آن نگاه کرده ایم

235

00:09:00,880 –> 00:09:03,680

، انواع دیگری از خطاها مانند

236

00:09:03,680 –> 00:09:04,240

237

00:09:04,240 –> 00:09:06,800

میانگین مربعات خطا وجود دارد و اگر

238

00:09:06,800 –> 00:09:08,880

می خواهید مشخص کنید که از این پارامتر خاص استفاده می کنید.

239

00:09:08,880 –> 00:09:11,360

240

00:09:11,360 –> 00:09:13,920

241

00:09:13,920 –> 00:09:17,360

242

00:09:17,360 –> 00:09:18,240

243

00:09:18,240 –> 00:09:20,640

تنها تفاوت این است که به جای

244

00:09:20,640 –> 00:09:22,720

گرفتن تفاوت مطلق

245

00:09:22,720 –> 00:09:26,000

، مربعی از آن تفاوت را می گیرید

246

00:09:26,000 –> 00:09:28,000

و دوباره این یک مقدار دارد و اجازه می دهد

247

00:09:28,000 –> 00:09:30,080

نزول گرادیان شما به

248

00:09:30,080 –> 00:09:31,040

روشی بهتر همگرا شود،

249

00:09:31,040 –> 00:09:33,360

ما بعداً جزئیات را بررسی خواهیم کرد، اما

250

00:09:33,360 –> 00:09:35,680

این

251

00:09:35,680 –> 00:09:39,120

نوع سوم کاربرد دارد. خطای شما از

252

00:09:39,120 –> 00:09:39,920

دست دادن log

253

00:09:39,920 –> 00:09:42,560

یا آنتروپی متقاطع باینری است، بنابراین ممکن

254

00:09:42,560 –> 00:09:43,440

است دیده باشید

255

00:09:43,440 –> 00:09:45,440

که در model.compile گاهی اوقات افراد

256

00:09:45,440 –> 00:09:47,440

از آنتروپی متقاطع باینری استفاده می کنند

257

00:09:47,440 –> 00:09:50,399

و آنتروپی متقاطع باینری مترادف

258

00:09:50,399 –> 00:09:52,000

log است. از دست دادن

259

00:09:52,000 –> 00:09:55,680

و این فرمول برای از دست دادن گزارش است اکنون

260

00:09:55,680 –> 00:09:59,200

شما فقط می توانید بپذیرید که این

261

00:09:59,200 –> 00:10:00,320

فرمول است، من قصد

262

00:10:00,320 –> 00:10:03,440

ندارم به جزئیات چگونگی ارائه

263

00:10:03,440 –> 00:10:05,040

آن فرمول بپردازم زیرا در این صورت

264

00:10:05,040 –> 00:10:07,200

این آموزش بسیار طولانی خواهد شد،

265

00:10:07,200 –> 00:10:08,800

اما اگر شما سعی می کنید یادگیری ماشینی را یاد بگیرید،

266

00:10:08,800 –> 00:10:10,160

گاهی اوقات باید فقط

267

00:10:10,160 –> 00:10:12,800

حقایق ریاضی را بپذیرید

268

00:10:12,800 –> 00:10:16,079

، مثل این است که چرا پی 22 در 7 است، خوب این یک

269

00:10:16,079 –> 00:10:18,640

واقعیت ریاضی است، بنابراین به طور مشابه

270

00:10:18,640 –> 00:10:20,880

این تابع ثبت گزارش است،

271

00:10:20,880 –> 00:10:22,640

زیاد نگران این معادلات ریاضی نباشید،

272

00:10:22,640 –> 00:10:23,760

273

00:10:23,760 –> 00:10:26,320

این برای شماست. درک اوه،

274

00:10:26,320 –> 00:10:27,600

لازم

275

00:10:27,600 –> 00:10:29,360

نیست خیلی وارد جزئیات شوید، البته منظورم این است

276

00:10:29,360 –> 00:10:30,800

که اگر علاقه مند هستید، می توانید بروید و

277

00:10:30,800 –> 00:10:32,079

بفهمید که چرا این

278

00:10:32,079 –> 00:10:34,880

معادله به این شکل است، اما این همان چیزی است که

279

00:10:34,880 –> 00:10:36,959

آنتروپی متقاطع باینری

280

00:10:36,959 –> 00:10:40,240

در حال حاضر برای رگرسیون لجستیک

281

00:10:40,240 –> 00:10:44,480

از تلفات log استفاده می کنیم. ما در ارائه خود از

282

00:10:44,480 –> 00:10:48,160

میانگین مجذور خطا یا میانگین خطای مطلق استفاده نمی

283

00:10:48,160 –> 00:10:48,640

284

00:10:48,640 –> 00:10:52,640

کنیم، من از میانگین

285

00:10:52,640 –> 00:10:55,279

خطای مطلق فقط برای ساده نگه داشتن آن استفاده می کنیم،

286

00:10:55,279 –> 00:10:56,880

اما در واقع

287

00:10:56,880 –> 00:10:59,440

عملاً برای رگرسیون

288

00:10:59,440 –> 00:11:01,360

289

00:11:01,360 –> 00:11:04,560

لجستیک از میانگین خطای مجذور استفاده خواهیم کرد. البته

290

00:11:04,560 –> 00:11:04,880

291

00:11:04,880 –> 00:11:07,360

از دست دادن گزارش یا آنتروپی متقاطع باینری و

292

00:11:07,360 –> 00:11:08,240

برای این منظور

293

00:11:08,240 –> 00:11:11,360

من یک مقاله سایت خوب

294

00:11:11,360 –> 00:11:14,240

را به علم

295

00:11:14,240 –> 00:11:16,800

296

00:11:16,800 –> 00:11:20,160

داده پیوند خواهم داد.

297

00:11:20,160 –> 00:11:22,959

298

00:11:22,959 –> 00:11:24,480

299

00:11:24,480 –> 00:11:26,399

بسیار خوب، پس فقط کافی است این مقاله عالی را مرور

300

00:11:26,399 –> 00:11:28,320

کنید، یک ایده دریافت خواهید کرد،

301

00:11:28,320 –> 00:11:31,839

اما به طور کلی، کاری که اکنون می خواهیم انجام دهیم این

302

00:11:31,839 –> 00:11:32,240

303

00:11:32,240 –> 00:11:35,760

است که همه این

304

00:11:35,760 –> 00:11:37,920

توابع مختلف یا از دست دادن را مانند این سه در

305

00:11:37,920 –> 00:11:39,200

پایتون پیاده سازی می کنیم

306

00:11:39,200 –> 00:11:41,519

و سپس یک تمرین خواهیم داشت و

307

00:11:41,519 –> 00:11:43,120

اوه دلیل اینکه ما قصد داریم

308

00:11:43,120 –> 00:11:46,320

همه اینها را مرور کنیم این

309

00:11:46,320 –> 00:11:49,680

است که تابع ضرر در آموزش شبکه های عصبی ما استفاده می شود،

310

00:11:49,680 –> 00:11:51,200

بنابراین در

311

00:11:51,200 –> 00:11:53,040

ویدیوهای آینده شبکه عصبی را از ابتدا پیاد