در این مطلب، ویدئو الگوریتم خوشه بندی K-Means با آموزش پایتون با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:19:20

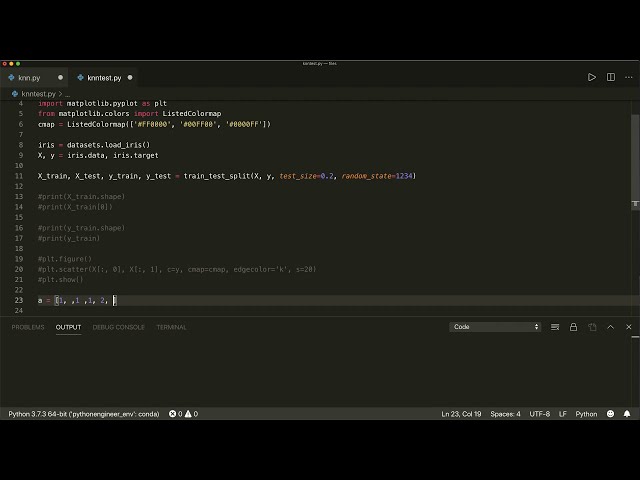

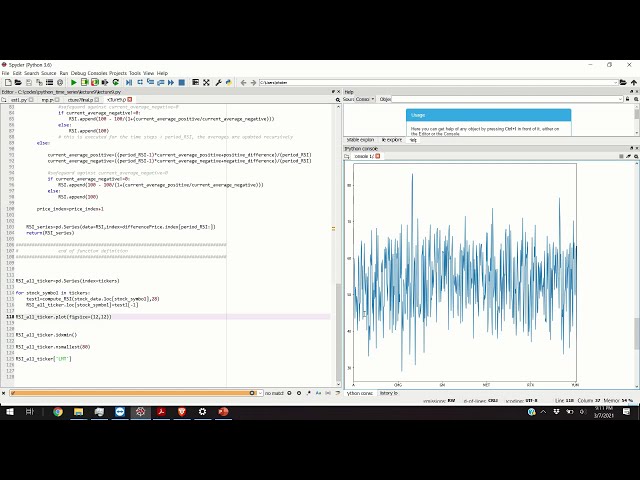

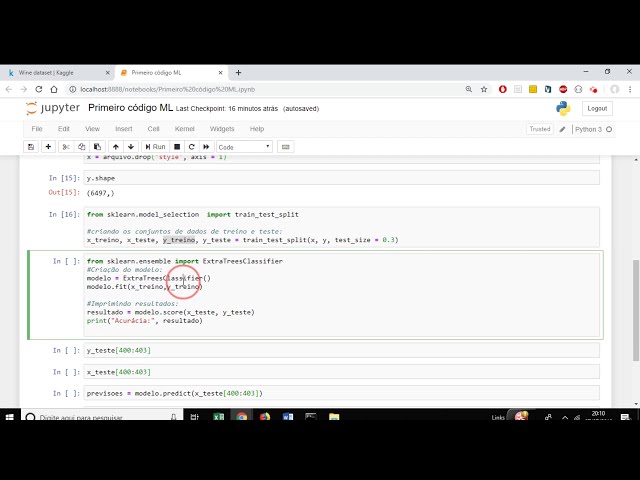

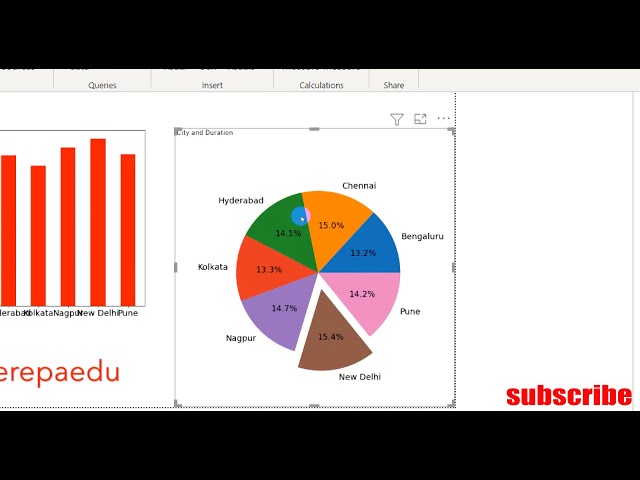

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,160 –> 00:00:01,599

سلام دوستان و به

2

00:00:01,599 –> 00:00:03,199

کانال بازگردید در ویدیوی امروز ما قصد

3

00:00:03,199 –> 00:00:04,799

داریم به الگوریتم یادگیری ماشین

4

00:00:04,799 –> 00:00:06,879

معروف به خوشه بندی k-means نگاه کنیم، خواهیم دید

5

00:00:06,879 –> 00:00:08,480

که چگونه می توانیم آن را روی داده های ثبت شده به خوبی اعمال کنیم

6

00:00:08,480 –> 00:00:10,400

و آن ها را به

7

00:00:10,400 –> 00:00:11,920

گروه های جداگانه تقسیم کنیم، اما قبل از آن ما وارد

8

00:00:11,920 –> 00:00:13,519

جنبه عملی

9

00:00:13,519 –> 00:00:15,599

خوشهبندی k-means در نوتبوکهای مشتری

10

00:00:15,599 –> 00:00:17,359

میشویم، ابتدا باید بفهمیم که k به معنای

11

00:00:17,359 –> 00:00:19,359

خوشهبندی چیست، یک

12

00:00:19,359 –> 00:00:21,520

فرآیند یادگیری ماشینی بدون نظارت است

13

00:00:21,520 –> 00:00:24,080

که از خود دادهها یاد میگیرد نه

14

00:00:24,080 –> 00:00:26,080

از نمونههای برچسبگذاری شده، همانطور که

15

00:00:26,080 –> 00:00:27,920

انتظار میرود با نظارت یادگیری آن

16

00:00:27,920 –> 00:00:29,599

17

00:00:29,599 –> 00:00:31,439

بر اساس ویژگی هایی که

18

00:00:31,439 –> 00:00:33,280

به آن ارائه می شود، داده ها را به گروه های متمایز تقسیم می کند، تعدادی روش خوشه بندی

19

00:00:33,280 –> 00:00:35,440

در دسترس است مانند

20

00:00:35,440 –> 00:00:37,920

مدل سازی مخلوط گاوسی dbscan و همچنین k

21

00:00:37,920 –> 00:00:39,360

به معنای خوشه بندی است که هدف

22

00:00:39,360 –> 00:00:41,200

اصلی این ویدئو خواهد بود

23

00:00:41,200 –> 00:00:42,960

. الگوریتم خوشه بندی k-means

24

00:00:42,960 –> 00:00:45,920

برای کاهش یا به حداقل رساندن

25

00:00:45,920 –> 00:00:48,160

مجموع فواصل بین

26

00:00:48,160 –> 00:00:50,480

مرکز خوشه و سایر نقاط داده

27

00:00:50,480 –> 00:00:51,920

s است. o بیایید نگاهی دقیقتر به نحوه عملکرد

28

00:00:51,920 –> 00:00:55,680

خوشهبندی k-means داشته باشیم

29

00:00:56,320 –> 00:00:58,160

تا فرآیند خوشهبندی k-means را

30

00:00:58,160 –> 00:01:00,559

31

00:01:00,559 –> 00:01:02,800

32

00:01:02,800 –> 00:01:04,879

33

00:01:04,879 –> 00:01:06,799

نشان دهیم. ما می خواهیم

34

00:01:06,799 –> 00:01:09,119

تولید کنیم، راه های زیادی وجود دارد که

35

00:01:09,119 –> 00:01:11,040

می توانیم تعداد بهینه

36

00:01:11,040 –> 00:01:12,880

خوشه ها را شناسایی کنیم و نمونه ای از

37

00:01:12,880 –> 00:01:14,560

یکی از این روش ها را در بخش آموزش پایتون خواهیم دید،

38

00:01:14,560 –> 00:01:16,159

39

00:01:16,159 –> 00:01:17,600

بنابراین برای ساده نگه داشتن موارد برای

40

00:01:17,600 –> 00:01:19,439

تصویرسازی، قصد داریم به آنها اشاره کنیم. با

41

00:01:19,439 –> 00:01:21,840

خوشه های آزاد کار کنید، یعنی k در

42

00:01:21,840 –> 00:01:25,040

k به معنای آزاد است، بنابراین پس از

43

00:01:25,040 –> 00:01:26,799

تعیین تعداد خوشه هایی که

44

00:01:26,799 –> 00:01:29,520

می خواهیم، مرحله بعدی ما انتخاب k نق

45

00:01:29,520 –> 00:01:31,600

ه تصادفی در مجموعه داده هایمان است، در این حالت سه

46

00:01:31,600 –> 00:01:33,360

ص

47

00:01:33,360 –> 00:01:35,920

دفی را انتخاب می کنیم. نقاط این نقاط انتخاب شده

48

00:01:35,920 –> 00:01:39,040

نقطه شروع خوشه های

49

00:01:39,040 –> 00:01:40,880

ما را تشکیل می دهند، سپس می توانیم فاصله اقلیدسی

50

00:01:40,880 –> 00:01:42,399

بین نقطه مرکز خوشه

51

00:01:42,399 –> 00:01:44,799

و سایر نقاط را محاسبه کنیم اگر

52

00:01:44,799 –> 00:01:46,640

این نقطه را در اینجا در نظر بگیریم، می توانیم

53

00:01:46,640 –> 00:01:48,640

ببینیم که به خوشه قرمز

54

00:01:48,640 –> 00:01:50,240

در مقایسه با خوشه های سبز و زرد نزدیک تر است، در

55

00:01:50,240 –> 00:01:53,280

نتیجه به خوشه قرمز اختصاص داده می شود

56

00:01:53,280 –> 00:01:54,720

،

57

00:01:54,720 –> 00:01:56,479

سپس این فرآیند را با تمام

58

00:01:56,479 –> 00:01:58,399

نقاط دیگر در نمودار پراکندگی تکرار می کنیم تا زمانی

59

00:01:58,399 –> 00:01:59,759

که پس از اینکه تمام نقاط آنها به یک

60

00:01:59,759 –> 00:02:01,360

خوشه مناسب اختصاص داده شوند.

61

00:02:01,360 –> 00:02:02,719

62

00:02:02,719 –> 00:02:04,880

به یک خوشه اختصاص داده می شود، سپس می

63

00:02:04,880 –> 00:02:07,280

توانیم نقطه اصلی هر خوشه را محاسبه کنیم

64

00:02:07,280 –> 00:02:10,560

که در اینجا با x نشان داده شده است،

65

00:02:10,560 –> 00:02:12,000

پس از محاسبه میانگین امتیازات جدید،

66

00:02:12,000 –> 00:02:14,080

می توانیم مراحل

67

00:02:14,080 –> 00:02:16,000

3 تا 5 را تکرار کنیم و بررسی کنیم که آیا نقاط

68

00:02:16,000 –> 00:02:18,080

متعلق به همان خوشه هستند یا به یک خوشه.

69

00:02:18,080 –> 00:02:19,360

70

00:02:19,360 –> 00:02:21,120

همانطور که در اینجا می بینیم، چند نقطه

71

00:02:21,120 –> 00:02:23,120

رنگ خود را تغییر داده اند، زیرا اکنون به

72

00:02:23,120 –> 00:02:24,959

نقاط میانگین مختلف نزدیکتر

73

00:02:24,959 –> 00:02:26,720

شده اند، پس از تخصیص مجدد نقاط،

74

00:02:26,720 –> 00:02:28,640

می توانیم نقطه اصلی را دوباره محاسبه کنیم و

75

00:02:28,640 –> 00:02:31,040

76

00:02:31,360 –> 00:02:33,360

در نهایت تکرار کنیم، در نهایت به نقطه ای خواهیم رسید که

77

00:02:33,360 –> 00:02:35,519

نقاط اصلی خوشه ها

78

00:02:35,519 –> 00:02:37,680

تغییر نکنید و سپس ما خوشه های نهایی خود را داریم

79

00:02:37,680 –> 00:02:38,800

80

00:02:38,800 –> 00:02:40,160

و این فقط یک تصویر بسیار ساده

81

00:02:40,160 –> 00:02:42,640

از نحوه کارکرد خوشه بندی k-means

82

00:02:42,640 –> 00:02:43,760

83

00:02:43,760 –> 00:02:45,360

در حال حاضر که اصول اولیه k-means را داریم می باشد.

84

00:02:45,360 –> 00:02:47,280

خوشه بندی پوشش داده شده است، اکنون می توانیم به

85

00:02:47,280 –> 00:02:49,280

گره مشتری خود برویم، می توانیم ببینیم چگونه می توانیم

86

00:02:49,280 –> 00:02:51,680

خوشه بندی k-means را از کتابخانه sk

87

00:02:51,680 –> 00:02:54,319

Learn python به برخی از داده های ثبت شده به خوبی اعمال کنیم،

88

00:02:54,319 –> 00:02:56,000

بنابراین بیایید به دفترچه یادداشت خود برویم و

89

00:02:56,000 –> 00:02:58,560

90

00:02:59,440 –> 00:03:00,959

در این آموزشی که می خواهیم شروع کنیم. ببینید چگونه

91

00:03:00,959 –> 00:03:03,120

می توان یک خوشه بندی ساده k-means را روی

92

00:03:03,120 –> 00:03:05,040

برخی از داده های ثبت شده به خوبی اجرا کرد، اگر با داده های گزارش چاه آشنایی ندارید، زیاد نگران نباشید

93

00:03:05,040 –> 00:03:06,560

94

00:03:06,560 –> 00:03:08,800

، همین فرآیند را می توان

95

00:03:08,800 –> 00:03:11,120

در سایر مجموعه های داده اعمال کرد، بنابراین اولین

96

00:03:11,120 –> 00:03:12,640

قدم وارد کردن داده ها است. کتابخانه های اصلی که

97

00:03:12,640 –> 00:03:14,400

قرار است از آنها استفاده کنیم، از پانداهایی استفاده خواهیم کرد

98

00:03:14,400 –> 00:03:17,280

که معمولاً به صورت pdf

99

00:03:17,280 –> 00:03:18,879

وارد می شوند و برای بارگیری داده ها از

100

00:03:18,879 –> 00:03:21,680

یک فایل csv و همچنین مشاهده داده های ما استفاده می شود

101

00:03:21,680 –> 00:03:24,000

و سپس نقشه نمودار نقطه pi را

102

00:03:24,000 –> 00:03:26,319

به صورت plt وارد می کنیم. و این کتابخانه اصلی

103

00:03:26,319 –> 00:03:27,920

رسم است که قرار است

104

00:03:27,920 –> 00:03:30,400

از آن برای نمایش نتایج خود استفاده کنیم و در

105

00:03:30,400 –> 00:03:32,480

نهایت کتابخانه اصلی و ماژول هایی

106

00:03:32,480 –> 00:03:34,159

را داریم که برای فرآیند یادگیری ماشین خود استفاده خواهیم کرد،

107

00:03:34,159 –> 00:03:36,560

اینها اسکالر استاندارد

108

00:03:36,560 –> 00:03:38,879

sklearn.preprocessing

109

00:03:38,879 –> 00:03:42,400

و k به معنی از sklearn.cluster

110

00:03:42,400 –> 00:03:44,000

یک بار ما کتابخانهها وارد شدهاند،

111

00:03:44,000 –> 00:03:46,159

سپس میتوانیم به بارگذاری

112

00:03:46,159 –> 00:03:48,239

دادهها برویم، دادههایی که امروز استفاده میکنیم، یک چاه منفرد

113

00:03:48,239 –> 00:03:50,000

از مجموعه دادههای بسیار بزرگتری است

114

00:03:50,000 –> 00:03:51,760

که برای مسابقه یادگیری ماشینی به

115

00:03:51,760 –> 00:03:54,799

میزبانی zeek and force 2020 استفاده شد،

116

00:03:54,799 –> 00:03:56,480

میتوانید پیوندی به مجموعه کامل داده ها و

117

00:03:56,480 –> 00:03:58,239

جزئیات مسابقه در توضیحات

118

00:03:58,239 –> 00:04:00,239

زیر برای بارگذاری در داده های ما که از df فراخوانی می کنیم

119

00:04:00,239 –> 00:04:03,439

برابر است با pd.read underscore

120

00:04:03,439 –> 00:04:06,080

csv و سپس مکان و

121

00:04:06,080 –> 00:04:08,560

نام فایل را می گذاریم تا کار برای ما راحت تر شود و آن را آسان تر

122

00:04:08,560 –> 00:04:10,879

کنیم. کار با دادههایمان آسانتر است،

123

00:04:10,879 –> 00:04:12,720

من ستون فهرست

124

00:04:12,720 –> 00:04:15,680

را روی عمق زیر خط md تنظیم

125

00:04:15,680 –> 00:04:17,358

میکنم و این فقط عمق اندازهگیری شده است

126

00:04:17,358 –> 00:04:19,199

که در امتداد سوراخ چاه به دست آمده است

127

00:04:19,199 –> 00:04:21,519

و پس از اجرا میتوانیم

128

00:04:21,519 –> 00:04:23,440

محتوای خود را با فراخوانی دادهها بررسی کنیم. فریم

129

00:04:23,440 –> 00:04:26,080

یا متغیر df و سپس میتوانیم

130

00:04:26,080 –> 00:04:28,479

ببینیم که اندازهگیریهایمان را از هر یک

131

00:04:28,479 –> 00:04:30,960

از ابزارهای گزارشگیری داریم، ردیف b را داریم

132

00:04:30,960 –> 00:04:33,360

که چگالی ظاهری ما gr است که

133

00:04:33,360 –> 00:04:34,479

پرتو گاما

134

00:04:34,479 –> 00:04:36,880

n phi است که تخلخل نوترونی

135

00:04:36,880 –> 00:04:38,880

pef ما است که ضریب فوتوالکتریک و

136

00:04:38,880 –> 00:04:40,800

dtc است. که کندی فشرده سازی صوتی است

137

00:04:40,800 –> 00:04:42,880

همانطور که از

138

00:04:42,880 –> 00:04:45,440

قاب داده می بینیم ما یک سری nand

139

00:04:45,440 –> 00:04:47,199

در داده های خود داریم و این به این معنی است که

140

00:04:47,199 –> 00:04:49,360

تعداد یا مقادیر گم نشده ای وجود ندارد

141

00:04:49,360 –> 00:04:51,280

و بسیاری از الگوریتم های یادگیری ماشینی

142

00:04:51,280 –> 00:04:53,280

نمی توانند مقادیر از دست رفته را مدیریت کنند، بنابراین ما

143

00:04:53,280 –> 00:04:55,919

باید هر دو را تعمیر کنیم. آنها را حذف کنید یا آنها را حذف

144

00:04:55,919 –> 00:04:58,160

کنید و در این شرایط کاری که ما می

145

00:04:58,160 –> 00:04:59,919

خواهیم انجام دهیم این است که آنها را حذف می

146

00:04:59,919 –> 00:05:02,240

کنیم و فقط برای ساده نگه داشتن چیزها

147

00:05:02,240 –> 00:05:04,320

، قبلاً ویدیویی را انجام داده ام که به

148

00:05:04,320 –> 00:05:06,080

روش های مختلفی برای پر کردن داده ها با استفاده از

149

00:05:06,080 –> 00:05:07,919

پانداها نگاه کرده ام، می توانید آن را بررسی کنید. در

150

00:05:07,919 –> 00:05:09,600

کانال من اگر مایل هستید،

151

00:05:09,600 –> 00:05:11,680

بنابراین برای حذف مقادیر گمشده،

152

00:05:11,680 –> 00:05:14,720

میتوانیم از df dot drop n a فراخوانی کنیم

153

00:05:14,720 –> 00:05:16,960

و در پرانتز

154

00:05:16,960 –> 00:05:18,560

آرگومان را در جای خود قرار میدهیم که

155

00:05:18,560 –> 00:05:20,400

برابر با true است،

156

00:05:20,400 –> 00:05:21,919

بنابراین به جای ایجاد یک کپی از

157

00:05:21,919 –> 00:05:24,080

قاب دادهای که ما داریم در اینجا

158

00:05:24,080 –> 00:05:26,800

این تابع drop n a را در

159

00:05:26,800 –> 00:05:29,120

قاب داده واقعی اعمال می کنیم و اکنون اگر

160

00:05:29,120 –> 00:05:30,960

به داده های خود نگاه کنیم می بینیم که برخی

161

00:05:30,960 –> 00:05:32,880

از ردیف ها ناپدید شده اند بنابراین ارزش بدهی

162

00:05:32,880 –> 00:05:33,960

163

00:05:33,960 –> 00:05:36,960

494.528 دیگر در چارچوب داده نیست

164

00:05:36,960 –> 00:05:38,960

و ما می توانیم ببینیم که ما d

165

00:05:38,960 –> 00:05:41,680

در اینجا هیچ نانی نداریم و میتوانیم

166

00:05:41,680 –> 00:05:43,199

این را با فراخوانی

167

00:05:43,199 –> 00:05:45,280

روش توصیف شده تأیید

168

00:05:45,280 –> 00:05:47,600

کنیم و میتوانیم ببینیم که تعداد

169

00:05:47,600 –> 00:05:50,240

ستونهای جداگانه در

170

00:05:50,240 –> 00:05:52,400

چارچوب داده ما برابر است و این فقط نشان میدهد

171

00:05:52,400 –> 00:05:56,000

که هیچ مقدار گم نشدهای وجود ندارد.

172

00:05:56,720 –> 00:05:58,800

بنابراین گام بعدی در فرآیند ما

173

00:05:58,800 –> 00:06:01,600

تبدیل دادهها است، بنابراین قبل از

174

00:06:01,600 –> 00:06:03,680

اعمال الگوریتم خوشهبندی k-means، باید

175

00:06:03,680 –> 00:06:06,080

دادهها را استاندارد کنیم زیرا مجموعه دادههای ما

176

00:06:06,080 –> 00:06:07,280

حاوی ویژگیهایی است که

177

00:06:07,280 –> 00:06:09,280

در واحدهای خود اندازهگیری شدهاند و

178

00:06:09,280 –> 00:06:11,759

برخی از ویژگیها محدوده دادههای خاص خود را دارند. ممکن است در

179

00:06:11,759 –> 00:06:13,360

نهایت تأثیر بیشتری بر

180

00:06:13,360 –> 00:06:15,840

نتایج نهایی نسبت به سایرین داشته باشد تا

181

00:06:15,840 –> 00:06:17,520

این تأثیر را کاهش دهیم، باید هر

182

00:06:17,520 –> 00:06:19,440

ویژگی را از میانگین آن

183

00:06:19,440 –> 00:06:21,759

ویژگی از هر مقدار کم کنیم و سپس

184

00:06:21,759 –> 00:06:24,160

آن را بر انحراف استاندارد ویژگی تقسیم کنیم تا

185

00:06:24,160 –> 00:06:25,520

به عنوان مثال ببینیم که اگر

186

00:06:25,520 –> 00:06:26,800

فریم داده جدید را در اینجا فراخوانی کنید

187

00:06:26,800 –> 00:06:29,600

تا مقادیر ما بالاتر از این روش df.describe باشد،

188

00:06:29,600 –> 00:06:32,080

سپس میتوانیم نگاهی

189

00:06:32,080 –> 00:06:34,880

به مقادیر و نحوه عملکرد این فرآیند

190

00:06:34,880 –> 00:06:36,800

بیندازیم تا اولین مقدار را در اینجا داشته باشیم.

191

00:06:36,800 –> 00:06:39,680

ستون ردیف b که 1.77 است

192

00:06:39,680 –> 00:06:42,720

و سپس میانگین 2.1499

193

00:06:42,720 –> 00:06:44,800

داریم و همچنین انحراف استاندارد

194

00:06:44,800 –> 00:06:46,560

0.25 داریم،

195

00:06:46,560 –> 00:06:49,680

بنابراین کاری که انجام می دهیم این است که 1.77 را می

196

00:06:49,680 –> 00:06:51,759

گیریم و میانگین را از آن حذف می کنیم و

197

00:06:51,759 –> 00:06:53,919

سپس آن نتیجه بر استاندارد تقسیم می شود.

198

00:06:53,919 –> 00:06:55,599

انحراف و سپس این

199

00:06:55,599 –> 00:06:57,120

برای هر یک از اندازهگیریهای

200

00:06:57,120 –> 00:06:59,199

داخل این ستون تکرار میشود، پس از انجام

201

00:06:59,199 –> 00:07:01,440

این کار، سپس به

202

00:07:01,440 –> 00:07:03,360

ستونهای دیگر در این چارچوب داده

203

00:07:03,360 –> 00:07:06,000

اعمال میشود، بنابراین اجازه دهید اسکالر استاندارد را اعمال کنیم،

204

00:07:06,000 –> 00:07:07,440

بنابراین ابتدا باید یک نمونه

205

00:07:07,440 –> 00:07:09,840

از اسکالر ایجاد کنیم. و ما میتوانیم این کار را با

206

00:07:09,840 –> 00:07:11,680

تایپ کردن اسکالر برابر با

207

00:07:11,680 –> 00:07:13,840

براکتهای باز اسکالر استاندارد انجام دهیم و

208

00:07:13,840 –> 00:07:15,599

کلاس را مقداردهی اولیه میکند،

209

00:07:15,599 –> 00:07:17,759

بنابراین باید آن اسکالر استاندارد را

210

00:07:17,759 –> 00:07:19,919

با دادههایمان تطبیق دهیم و سپس

211

00:07:19,919 –> 00:07:22,319

دادههایمان را با استفاده از آن اسکالر تبدیل کنیم، کاری که باید

212

00:07:22,319 –> 00:07:24,960

انجام دهیم در دادههایمان است. فریم ترجیح میدهم

213

00:07:24,960 –> 00:07:27,599

آن منحنیها یا خروجیها

214

00:07:27,599 –> 00:07:29,440

را به قاب داده بازگردانم تا

215

00:07:29,440 –> 00:07:31,840

اینکه آنها را بهعنوان یک آرایه مستقل در نظر بگیرم، بنابراین

216

00:07:31,840 –> 00:07:33,759

کاری که در اینجا انجام دادهام این است که

217

00:07:33,759 –> 00:07:36,960

منحنیها را با خط زیر اضافه کردم.

218

00:07:36,960 –> 00:07:38,800

ey تبدیل شده است

219

00:07:38,800 –> 00:07:40,880

که به عنوان یک لیست در داخل

220

00:07:40,880 –> 00:07:42,400

شی دیتافریم تنظیم شده است، بنابراین

221

00:07:42,400 –> 00:07:44,400

منحنی های جدیدی را به قاب داده شما اضافه می کنیم، سپس در

222

00:07:44,400 –> 00:07:46,000

سمت راست، باید

223

00:07:46,000 –> 00:07:47,840

اسکالر را فراخوانی کنیم و سپس این

224

00:07:47,840 –> 00:07:50,319

روش به نام fit را فراخوانی کنیم. تبدیل زیرخط

225

00:07:50,319 –> 00:07:52,879

و سپس

226

00:07:52,879 –> 00:07:54,639

منحنیهای اصلی خود را که میخواهیم آنها را

227

00:07:54,639 –> 00:07:57,039

تبدیل کنیم، در قاب دادههای خود عبور میدهیم تا بتوانیم این را اجرا کنیم

228

00:07:57,039 –> 00:07:59,039

و پس از مشاهده چارچوب دادههایمان،

229

00:07:59,039 –> 00:08:01,520

اکنون میتوانیم ببینیم که ردیف b

230

00:08:01,520 –> 00:08:03,680

زیرخط t و زیرخط phi t را داریم. و

231

00:08:03,680 –> 00:08:05,919

غیره اینجا در قاب داده و

232

00:08:05,919 –> 00:08:08,160

ما نیز مقادیر اصلی خود را داریم،

233

00:08:08,160 –> 00:08:10,080

پس چرا این کار را به خوبی انجام میدهم،

234

00:08:10,080 –> 00:08:11,840

وقتی به رسم نمودار میرسیم کار را آسانتر میکند،

235

00:08:11,840 –> 00:08:14,479

بنابراین اگر این کار را بدون

236

00:08:14,479 –> 00:08:16,319

اعمال مجدد آن به چارچوب داده انجام

237

00:08:16,319 –> 00:08:18,639

میدادم، با آن کار میکردیم. یک آرایه ناقص

238

00:08:18,639 –> 00:08:20,160

ما باید کار کنیم که چگونه

239

00:08:20,160 –> 00:08:21,759

آن را به قاب داده برگردانیم که می

240

00:08:21,759 –> 00:08:23,599

تواند با چند خط کد انجام شود، اما

241

00:08:23,599 –> 00:08:25,680

این احتمالاً به نظر من

242

00:08:25,680 –> 00:08:27,520

ساده ترین راه برای انجام آن

243

00:08:27,520 –> 00:08:30,479

برای وارد کردن به قاب داده است.

244

00:08:30,720 –> 00:08:32,399

حالا ما حرکت می کنیم در مورد اعمال واقعی

245

00:08:32,399 –> 00:08:34,640

خوشهبندی k-means در دادههای ما،

246

00:08:34,640 –> 00:08:35,679

247

00:08:35,679 –> 00:08:37,679

اما ممکن است یک سوال مهم

248

00:08:37,679 –> 00:08:40,159

داشته باشید و آن این است که

249

00:08:40,159 –> 00:08:42,320

چگونه میدانیم چند خوشه برای مقداردهی اولیه

250

00:08:42,320 –> 00:08:44,080

الگوریتم با شما

251

00:08:44,080 –> 00:08:47,120

در ارائه در ابتدا مشاهده میکردیم.

252

00:08:47,120 –> 00:08:49,680

برای

253

00:08:49,680 –> 00:08:51,839

شروع فرآیند خوشهبندی باید

254

00:08:51,839 –> 00:08:54,000

عددی برای k ارائه کنیم، روشهایی وجود دارد که میتوانیم برای

255

00:08:54,000 –> 00:08:56,000

شناسایی تعداد بهینه خوشهها استفاده کنیم

256

00:08:56,000 –> 00:08:58,080

و روشی که در اینجا نشان میدهم شامل

257

00:08:58,080 –> 00:09:00,399

نموداری است که به عنوان نمودار زانویی شناخته میشود. و برای

258

00:09:00,399 –> 00:09:02,480

ساده نگه داشتن چیزها برای تجسم

259

00:09:02,480 –> 00:09:04,480

در آینده، ما فقط با

260

00:09:04,480 –> 00:09:07,360

دو متغیر n phi underscore t و rho

261

00:09:07,360 –> 00:09:09,680

b underscore t

262

00:09:09,680 –> 00:09:12,320

کار می کنیم، بنابراین ایده ساده پشت این تابع این

263

00:09:12,320 –> 00:09:14,800

است که الگوریتم k-means خود را چندین بار اجرا می کنیم

264

00:09:14,800 –> 00:09:17,760

و اینرسی ها را رسم می کنیم.

265

00:09:17,760 –> 00:09:19,680

صرفاً اندازه گیری مجموع

266

00:09:19,680 –> 00:09:21,920

فواصل مربع تا نزدیکترین

267

00:09:21,920 –> 00:09:23,600

مرکز خوش