در این مطلب، ویدئو جنگل تصادفی توضیح داده شد | پایتون جنگل تصادفی | یادگیری ماشین پایتون | آموزش پایتون | ادورکا با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:48:17

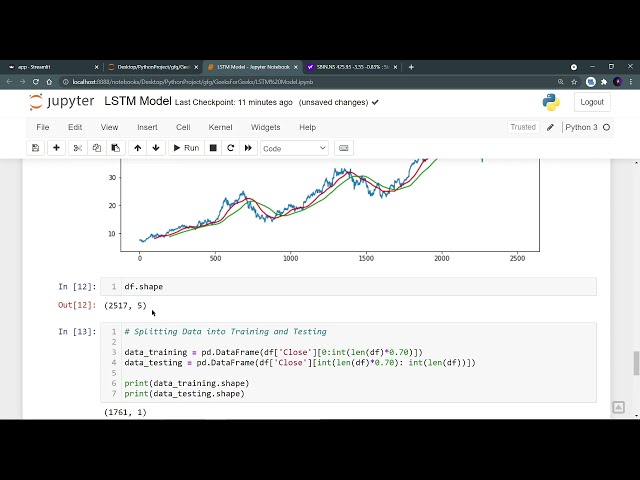

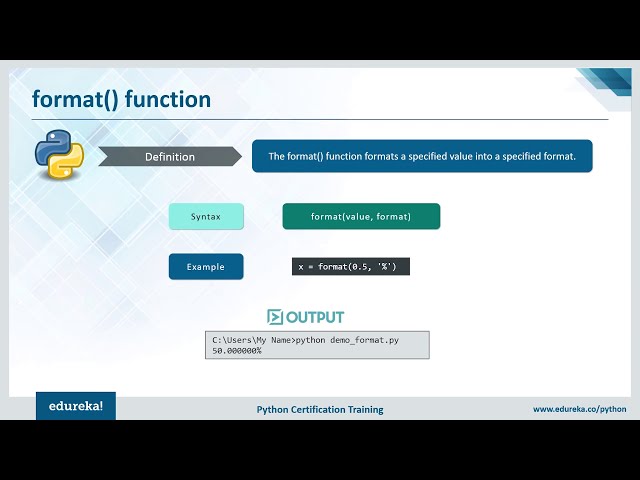

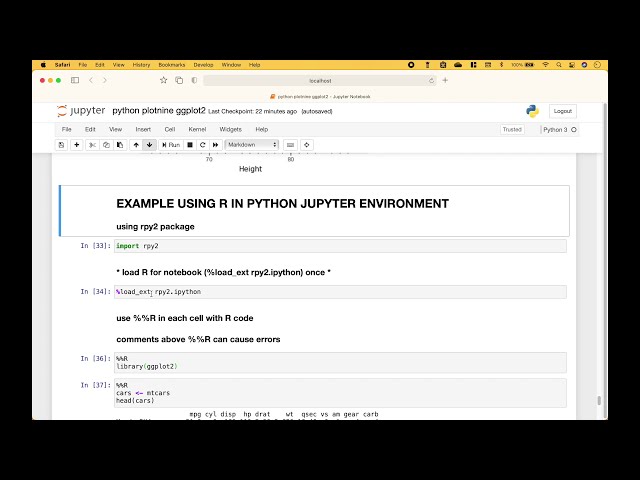

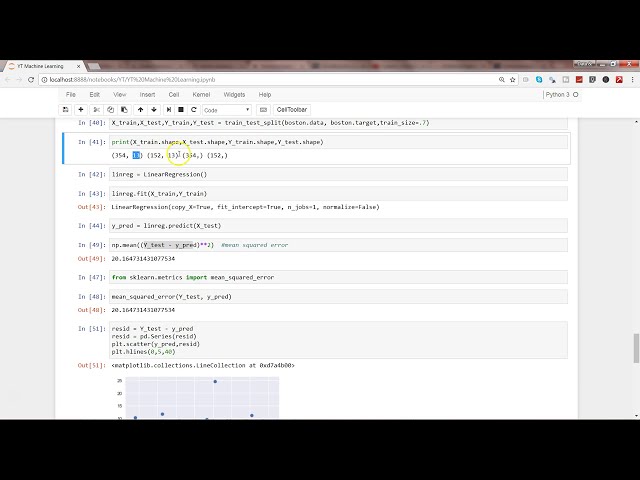

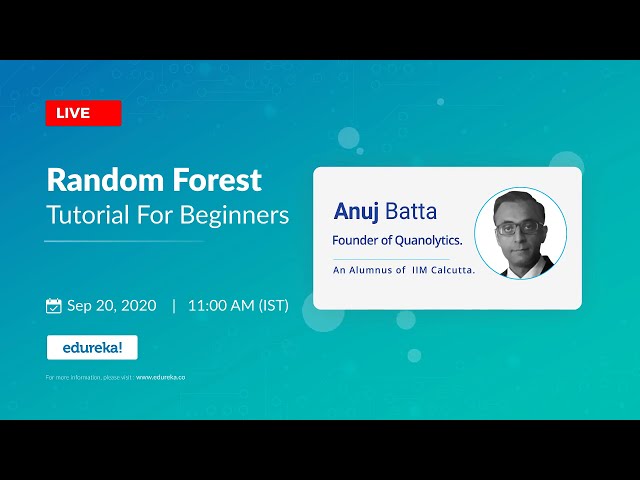

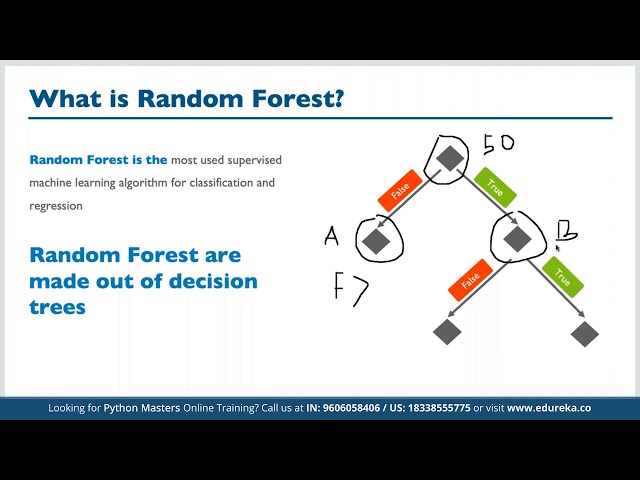

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:06,640 –> 00:00:07,120

سلام به

2

00:00:07,120 –> 00:00:10,240

همه خوش آمدید بیایید شروع

3

00:00:10,240 –> 00:00:13,440

کنیم نام من آنوج بهاتا است من نزدیک به

4

00:00:13,440 –> 00:00:15,679

دو دهه سابقه کار در صنعت ID

5

00:00:15,679 –> 00:00:18,720

دارم

6

00:00:18,720 –> 00:00:20,320

و از ابتدای کارم در زمینه تصمیم گیری مبتنی بر داده

7

00:00:20,320 –> 00:00:22,640

کار می کنم و

8

00:00:22,640 –> 00:00:24,800

شاهد تحولات

9

00:00:24,800 –> 00:00:26,720

زیادی بوده ایم. این دامنه با

10

00:00:26,720 –> 00:00:28,240

نام های مختلف مانند

11

00:00:28,240 –> 00:00:28,960

12

00:00:28,960 –> 00:00:31,599

علم داده هوش تجاری در حال حاضر به سمت

13

00:00:31,599 –> 00:00:33,600

ai و ml و غیره می رویم

14

00:00:33,600 –> 00:00:35,440

من برای شرکت هایی مانند فناوری های adobe

15

00:00:35,440 –> 00:00:37,600

sap hcl و غیره کار کرده

16

00:00:37,600 –> 00:00:39,520

ام من کلکته ایلومیناس هستم و در

17

00:00:39,520 –> 00:00:41,840

حال حاضر نیز در حال دنبال کردن دکترا در

18

00:00:41,840 –> 00:00:44,160

همان دامنه یادگیری ماشین هستم. و

19

00:00:44,160 –> 00:00:45,920

علم داده از دهلی نو

20

00:00:45,920 –> 00:00:49,039

برای پنج یا شش سال گذشته، همانطور که می دانید

21

00:00:49,039 –> 00:00:50,879

به عنوان یک سرگرمی شروع شد، بنابراین من شروع به

22

00:00:50,879 –> 00:00:52,879

مشاوره و آموزش بسیاری از

23

00:00:52,879 –> 00:00:54,480

تجربیات علم داده کردم

24

00:00:54,480 –> 00:00:56,719

و اکنون به نوعی زمان بیشتری را روی

25

00:00:56,719 –> 00:00:58,399

این موضوع صرف می کنم زیرا واقعاً

26

00:00:58,399 –> 00:01:00,800

آن را دوست دارم و این یکی از راههایی

27

00:01:00,800 –> 00:01:02,399

که میتوانم بدانم پل شکاف

28

00:01:02,399 –> 00:01:06,000

بین دانشگاهیان و صنعت را

29

00:01:06,000 –> 00:01:08,240

میکنیم، امروز میخواهیم یک جنگل تصادفی را پوشش

30

00:01:08,240 –> 00:01:09,520

31

00:01:09,520 –> 00:01:11,920

دهیم، بنابراین در مورد طبقهبندی uh صحبت خواهیم کرد.

32

00:01:11,920 –> 00:01:12,640

33

00:01:12,640 –> 00:01:14,880

تفاوت آن با رگرسیون و غیره

34

00:01:14,880 –> 00:01:17,040

مدلهای مختلفی است که میتوانیم

35

00:01:17,040 –> 00:01:19,520

از مفهوم جنگل تصادفی

36

00:01:19,520 –> 00:01:20,240

استفاده کنیم چرا از آن استفاده میکنیم.

37

00:01:20,240 –> 00:01:21,759

38

00:01:21,759 –> 00:01:22,880

39

00:01:22,880 –> 00:01:24,960

40

00:01:24,960 –> 00:01:27,119

و البته این یک مدل گروهی است،

41

00:01:27,119 –> 00:01:29,280

بنابراین ما در مورد مجموعهبندی و

42

00:01:29,280 –> 00:01:31,520

تقویت پشتیبان و غیره درباره مفاهیمی که

43

00:01:31,520 –> 00:01:33,280

برای جنگلهای تصادفی استفاده میشوند صحبت خواهیم کرد، بنابراین

44

00:01:33,280 –> 00:01:35,119

در مورد آنها صحبت

45

00:01:35,119 –> 00:01:37,200

میکنیم، سپس به شما قیاسی میدهیم تا

46

00:01:37,200 –> 00:01:38,560

بفهمید چرا

47

00:01:38,560 –> 00:01:41,119

و چگونه ما این را پیاده سازی می کنیم و اگر

48

00:01:41,119 –> 00:01:42,640

البته

49

00:01:42,640 –> 00:01:44,960

گام به گام متوجه می شویم که چگونه این را پیاده سازی کنیم

50

00:01:44,960 –> 00:01:45,840

و سپس

51

00:01:45,840 –> 00:01:48,560

یک نسخه ی نمایشی ساده و سریع در

52

00:01:48,560 –> 00:01:50,479

پایتون را به شما نشان خواهم داد تا شما نیز

53

00:01:50,479 –> 00:01:52,479

ایده ای در مورد چگونگی یکی از راه های پیاده سازی پیدا کنید.

54

00:01:52,479 –> 00:01:54,079

جنگل تصادفی

55

00:01:54,079 –> 00:01:57,280

بیایید با موضوعاتی شروع کنیم که چرا در اینجا

56

00:01:57,280 –> 00:01:59,200

در مورد طبقه بندی صحبت می کنیم،

57

00:01:59,200 –> 00:02:01,119

حتی اگر جنگل تصادفی را می توان

58

00:02:01,119 –> 00:02:03,280

هم برای طبقه بندی و هم برای رگرسیون استفاده کرد

59

00:02:03,280 –> 00:02:04,719

که من در مورد آن صحبت خواهم کرد، اما

60

00:02:04,719 –> 00:02:06,560

تمرکز ما تا حد زیادی بر

61

00:02:06,560 –> 00:02:08,080

طبقه بندی با استفاده از

62

00:02:08,080 –> 00:02:10,800

یک راندو خواهد بود. m جنگل در سطح بسیار بالایی در

63

00:02:10,800 –> 00:02:12,000

علم داده،

64

00:02:12,000 –> 00:02:13,760

ما در درجه اول فقط میتوانیم دو کار را

65

00:02:13,760 –> 00:02:15,040

درست انجام دهیم، یا میتوانیم

66

00:02:15,040 –> 00:02:17,520

رگرسیون انجام دهیم که یک

67

00:02:17,520 –> 00:02:18,480

مقدار نقطه را

68

00:02:18,480 –> 00:02:20,959

پیشبینی میکند یا یک متغیر پیوسته را پیشبینی میکند یا

69

00:02:20,959 –> 00:02:21,599

میتوانیم

70

00:02:21,599 –> 00:02:24,239

اشیاء یا نقاط داده مختلف

71

00:02:24,239 –> 00:02:25,599

را در گروههایی

72

00:02:25,599 –> 00:02:26,959

در سطح بسیار بالا قرار دهیم. که طبقه بندی نامیده می شود،

73

00:02:26,959 –> 00:02:29,120

بنابراین اینها تنها دو

74

00:02:29,120 –> 00:02:30,800

کاری هستند که می توانیم انجام دهیم، اما اگر به طور دقیق بررسی

75

00:02:30,800 –> 00:02:32,800

کنیم و به شما نگاه کنیم که

76

00:02:32,800 –> 00:02:35,360

چیزهای بیشتری را در گروه بندی نقاط داده

77

00:02:35,360 –> 00:02:37,040

یا اشیاء یا موجودیت های مختلف می دانید،

78

00:02:37,040 –> 00:02:39,760

می توانیم به خود این طبقه بندی

79

00:02:39,760 –> 00:02:41,840

به عنوان یک نام نگاه کنیم که یک

80

00:02:41,840 –> 00:02:43,120

الگوریتم یادگیری نظارت شده است

81

00:02:43,120 –> 00:02:46,000

یا می توانیم به خوشه بندی یا

82

00:02:46,000 –> 00:02:48,400

تداعی کاوی و مواردی از این دست نگاه کنیم،

83

00:02:48,400 –> 00:02:49,920

اما در اینجا ما در مورد

84

00:02:49,920 –> 00:02:51,760

طبقه بندی به عنوان الگوریتم

85

00:02:51,760 –> 00:02:54,000

گروه بندی یادگیری نظارت شده خاص صحبت می کنیم،

86

00:02:54,000 –> 00:02:55,120

بنابراین

87

00:02:55,120 –> 00:02:57,840

وقتی می گوییم طبقه بندی این است که اوه

88

00:02:57,840 –> 00:02:58,959

شما خوب می دانید که

89

00:02:58,959 –> 00:03:01,120

شناسایی داده ها و قرار دادن

90

00:03:01,120 –> 00:03:03,200

آنها در چند کلاس از پیش تعریف شده

91

00:03:03,200 –> 00:03:05,840

برای درک این مثال با

92

00:03:05,840 –> 00:03:07,280

تصویری که ما به آن نگاه می

93

00:03:07,280 –> 00:03:10,319

کنیم متفاوت است. سطل های زباله و ما به عنوان

94

00:03:10,319 –> 00:03:11,760

انسان

95

00:03:11,760 –> 00:03:13,760

یاد گرفته ایم که شما می دانید چگونه

96

00:03:13,760 –> 00:03:15,440

اشیاء مختلف را شناسایی کنید و چگونه آنها را به کلاس های مختلف نقشه برداری کنید،

97

00:03:15,440 –> 00:03:17,200

بنابراین در اینجا می

98

00:03:17,200 –> 00:03:20,319

توانیم بگوییم این سطل زباله

99

00:03:20,319 –> 00:03:23,120

آه که به عنوان شیشه کاغذی ارگانیک و غیره برچسب گذاری شده است

100

00:03:23,120 –> 00:03:24,640

آنها

101

00:03:24,640 –> 00:03:26,239

کلاس های مختلف یا گروه های مختلف هستند.

102

00:03:26,239 –> 00:03:27,680

103

00:03:27,680 –> 00:03:29,840

پس چرا ما آن را یادگیری نظارت شده

104

00:03:29,840 –> 00:03:31,200

می نامیم زیرا می دانیم

105

00:03:31,200 –> 00:03:33,920

کدام شی متعلق به کدام کلاس است

106

00:03:33,920 –> 00:03:35,360

و چگونه می دانیم که

107

00:03:35,360 –> 00:03:37,760

نقشه برداری خاصی در

108

00:03:37,760 –> 00:03:39,440

مغزمان بر اساس یادگیری تاریخی خود انجام

109

00:03:39,440 –> 00:03:41,840

داده ایم تا بتوانیم تشخیص دهیم که کدام شی متعلق

110

00:03:41,840 –> 00:03:43,360

به کدام کلاس است. درست است

111

00:03:43,360 –> 00:03:46,560

تا بتوانیم به راحتی مواد زائد خود

112

00:03:46,560 –> 00:03:47,760

را در

113

00:03:47,760 –> 00:03:50,560

کلاس تعیین شده قرار دهیم و این همان چیزی است که

114

00:03:50,560 –> 00:03:52,319

روشی برای یادگیری نظارت شده است که

115

00:03:52,319 –> 00:03:53,120

در

116

00:03:53,120 –> 00:03:54,400

علم داده نیز در هنگام انجام

117

00:03:54,400 –> 00:03:57,040

طبقه بندی

118

00:03:57,040 –> 00:04:00,239

پیاده

119

00:04:00,239 –> 00:04:00,959

سازی

120

00:04:00,959 –> 00:04:03,760

می کنیم. یا کادر خالی یا چیزهایی

121

00:04:03,760 –> 00:04:04,400

مانند

122

00:04:04,400 –> 00:04:07,280

اینها در مجموعه دادههای uh هستند که

123

00:04:07,280 –> 00:04:08,080

124

00:04:08,080 –> 00:04:10,239

اگر مجبور باشیم این را به مجموعه دادههای خود ربط دهیم، به یک ردیف داده تبدیل میشود،

125

00:04:10,239 –> 00:04:12,720

بنابراین هر شی که به دنبال آن هستیم

126

00:04:12,720 –> 00:04:13,200

در اینجا

127

00:04:13,200 –> 00:04:15,280

و ما سعی می کنیم آن را در یک کلاس قرار دهیم که در

128

00:04:15,280 –> 00:04:16,478

واقع ردیف داده ما است،

129

00:04:16,478 –> 00:04:19,199

بنابراین وقتی مجموعه ای از داده ها را

130

00:04:19,199 –> 00:04:19,759

در

131

00:04:19,759 –> 00:04:22,800

آن ستون دریافت می کنید، یک کلاس داده خواهد بود

132

00:04:22,800 –> 00:04:25,680

و همه ردیف ها به صورت جداگانه یک شی را

133

00:04:25,680 –> 00:04:26,479

نشان می دهند،

134

00:04:26,479 –> 00:04:28,960

بنابراین ما می خواهیم چه کاری انجام دهیم. به

135

00:04:28,960 –> 00:04:30,720

عنوان انسانها، درست همانطور که

136

00:04:30,720 –> 00:04:31,199

آموختهایم

137

00:04:31,199 –> 00:04:33,840

، برخی از مدلها را آموزش میدهیم

138

00:04:33,840 –> 00:04:34,720

139

00:04:34,720 –> 00:04:37,360

که در آن زمینه منطقیتر است، ما میدانیم

140

00:04:37,360 –> 00:04:38,560

آن مدل را آموزش میدهیم و

141

00:04:38,560 –> 00:04:40,560

ما میگوییم که کدام ردیف متعلق به کدام

142

00:04:40,560 –> 00:04:42,240

کلاس است، حالا یک بار

143

00:04:42,240 –> 00:04:44,800

روی دادههای زیادی که مدل است. آموزش داده شده،

144

00:04:44,800 –> 00:04:46,800

سپس می توانیم با یک ردیف جدید

145

00:04:46,800 –> 00:04:48,720

بدون کلاس عرضه کنیم و مدل می

146

00:04:48,720 –> 00:04:49,919

تواند پیش بینی کند

147

00:04:49,919 –> 00:04:52,240

که این شی باید در کدام کلاس قرار گیرد

148

00:04:52,240 –> 00:04:53,680

و اینجاست که ما

149

00:04:53,680 –> 00:04:56,800

طبقه بندی را با استفاده از بار نظارت شده انجام می دهیم،

150

00:04:56,800 –> 00:04:59,840

همانطور که گفتم رگرسیون به این معنی است که ما در حال انجام

151

00:04:59,840 –> 00:05:03,120

پیش بینی مقدار نقطه هستیم. به عنوان مثال،

152

00:05:03,120 –> 00:05:05,680

کسی می خواهد بداند که

153

00:05:05,680 –> 00:05:06,320

رکود

154

00:05:06,320 –> 00:05:08,320

در سه ماهه بعدی در شرکت من چه چیزی می تواند باشد، به طوری

155

00:05:08,320 –> 00:05:10,639

که می تواند یک مقدار خاص مانند

156

00:05:10,639 –> 00:05:13,120

نه نقطه پنج درصد یا یا ده نقطه

157

00:05:13,120 –> 00:05:14,639

پنج درصد باشد، بنابراین ما در مورد یک ولتاژ مداوم صحبت می کنیم.

158

00:05:14,639 –> 00:05:16,400

159

00:05:16,400 –> 00:05:18,880

میزان فروش برای

160

00:05:18,880 –> 00:05:21,199

محصول جدیدی که به عنوان مثال در هندوستان عرضه می کنیم، قابل

161

00:05:21,199 –> 00:05:23,120

162

00:05:23,120 –> 00:05:24,880

163

00:05:24,880 –> 00:05:27,360

پیش بینی است، بنابراین این یک نقطه پیش بینی ارزش است، بنابراین این همان چیزی است که رگرسیون uh است،

164

00:05:27,360 –> 00:05:29,280

بنابراین اگر این مثال ساده تر را

165

00:05:29,280 –> 00:05:30,000

166

00:05:30,000 –> 00:05:32,160

زمانی که می خواهیم بین آنها طبقه بندی کنیم، در نظر بگیرم.

167

00:05:32,160 –> 00:05:33,840

اوه، ما یک سوال

168

00:05:33,840 –> 00:05:36,240

می پرسیم که فردا هوا گرم است یا سرد، بنابراین

169

00:05:36,240 –> 00:05:38,320

ما سعی می کنیم

170

00:05:38,320 –> 00:05:41,919

داده ها را در یک کلاس قرار دهیم و فقط

171

00:05:41,919 –> 00:05:43,360

دو کلاس داریم، بنابراین یک

172

00:05:43,360 –> 00:05:45,759

مشکل طبقه بندی باینری است که رمزگذاری شده است،

173

00:05:45,759 –> 00:05:47,840

اما همانطور که در رگرسیون گفتم ما می

174

00:05:47,840 –> 00:05:50,000

خواهیم پیش بینی کنیم. یک

175

00:05:50,000 –> 00:05:51,840

مقدار نقطه برای مثال ما

176

00:05:51,840 –> 00:05:53,440

این سوال را می پرسیم که دمای

177

00:05:53,440 –> 00:05:54,960

فردا چقدر خواهد بود که

178

00:05:54,960 –> 00:05:56,240

بدیهی است که

179

00:05:56,240 –> 00:05:57,919

یک متغیر پیوسته خواهد بود چه

180

00:05:57,919 –> 00:05:59,919

فارنهایت باشد یا سانتیگراد یا

181

00:05:59,919 –> 00:06:02,160

اوه شما می دانید هر پیش بینی دیگری

182

00:06:02,160 –> 00:06:03,280

که ما انجام می

183

00:06:03,280 –> 00:06:06,720

دهیم یک رگرسیون است. من گفتم اوه

184

00:06:06,720 –> 00:06:08,400

مدل های مختلفی برای

185

00:06:08,400 –> 00:06:10,319

اهداف مختلف وجود دارد، اما مدل

186

00:06:10,319 –> 00:06:11,520

هایی وجود دارد که هم برای

187

00:06:11,520 –> 00:06:13,199

طبقه بندی و هم برای رگرسیون قابل استفاده هستند

188

00:06:13,199 –> 00:06:15,199

و جنگل تصادفی یکی از آن هاست.

189

00:06:15,199 –> 00:06:17,360

الگوریتمهایی که اکنون میتوانند برای هر دو مورد استفاده قرار گیرند

190

00:06:17,360 –> 00:06:20,080

، وقتی در مورد نمونههایی از الگوریتمهای طبقهبندی صحبت میکنیم، وجود دارند،

191

00:06:20,080 –> 00:06:22,319

192

00:06:22,319 –> 00:06:25,360

بنابراین میخواهم به این نکته نیز اشاره

193

00:06:25,360 –> 00:06:28,400

کنم که اول از همه باید

194

00:06:28,400 –> 00:06:29,600

الگوریتمهای

195

00:06:29,600 –> 00:06:32,319

امروزی را به سه بخش نگاه کنیم و

196

00:06:32,319 –> 00:06:33,280

این از

197

00:06:33,280 –> 00:06:35,360

رویکرد رگرسیون یا طبقهبندی نیست.

198

00:06:35,360 –> 00:06:36,400

اما به طور کلی

199

00:06:36,400 –> 00:06:39,520

می دانید دامنه یا یا

200

00:06:39,520 –> 00:06:43,520

نوع منطقه ای که

201

00:06:43,520 –> 00:06:45,600

الگوریتم ها از کجا آمده اند، بنابراین ما

202

00:06:45,600 –> 00:06:48,400

سه مجموعه الگوریتم داریم که معمولاً

203

00:06:48,400 –> 00:06:50,800

اولین مجموعه از الگوریتم های آماری شما

204

00:06:50,800 –> 00:06:51,680

205

00:06:51,680 –> 00:06:53,919

است که بر اساس معادلات و مفاهیم

206

00:06:53,919 –> 00:06:56,800

آماری و ریاضی

207

00:06:56,800 –> 00:07:00,319

است. سپس ما

208

00:07:00,319 –> 00:07:02,560

مجموعهای متفاوت از الگوریتمها داریم که

209

00:07:02,560 –> 00:07:05,599

الهامگرفتهشده از زیستشناسی یا الگوریتمهای الهامگرفته از بیولوژیک هستند،

210

00:07:05,599 –> 00:07:06,319

211

00:07:06,319 –> 00:07:08,639

بنابراین حتماً درباره

212

00:07:08,639 –> 00:07:10,639

شبکههای عصبی مصنوعی شنیدهاید که در آن سعی میکنیم

213

00:07:10,639 –> 00:07:12,400

214

00:07:12,400 –> 00:07:14,800

رفتار مغز انسان را درست تقلید کنیم، بنابراین

215

00:07:14,800 –> 00:07:16,560

الگوریتمی الهامگرفته از زیستشناسی است

216

00:07:16,560 –> 00:07:19,919

یا ما ژنتیک داریم. الگوریتمها نیز

217

00:07:19,919 –> 00:07:22,880

پس از آن دسته سوم الگوریتمها

218

00:07:22,880 –> 00:07:25,360

الگوریتمهای الهامگرفته از طبیعت هستند و

219

00:07:25,360 –> 00:07:28,639

حداقل 100 عدد به اضافه یک الگوریتم

220

00:07:28,639 –> 00:07:31,680

هایی که از طبیعت الهام گرفته شده اند، به عنوان مثال

221

00:07:31,680 –> 00:07:35,120

الگوریتم جستجوی فاخته الگوریتم مستعمره مورچه یا الگوریتم جست و جوی

222

00:07:35,120 –> 00:07:37,759

قورباغه یا

223

00:07:37,759 –> 00:07:39,599

الگوریتم موج دار شدن آب، پس

224

00:07:39,599 –> 00:07:43,120

ایده چیست هر اتفاقی در طبیعت بیفتد،

225

00:07:43,120 –> 00:07:44,639

به عنوان مثال اگر چیزی را

226

00:07:44,639 –> 00:07:46,160

در آب بیندازید، امواجی وجود دارد که

227

00:07:46,160 –> 00:07:47,280

بسیار آهان هستند، می دانید

228

00:07:47,280 –> 00:07:49,360

در شکل و فرکانس خاص و

229

00:07:49,360 –> 00:07:50,560

چیزهایی مانند آن

230

00:07:50,560 –> 00:07:53,280

ها یا وقتی در مورد جهش قورباغه صحبت می کنیم تا

231

00:07:53,280 –> 00:07:55,599

بدانیم چه زمانی یک قورباغه باید از مکان

232

00:07:55,599 –> 00:07:56,160

a به b

233

00:07:56,160 –> 00:07:58,879

برود به نوعی می پرد و یا می پرد، پس چگونه

234

00:07:58,879 –> 00:08:00,400

می داند که بهترین مکان چیست؟

235

00:08:00,400 –> 00:08:01,919

برای اینکه من بپرم

236

00:08:01,919 –> 00:08:04,479

اوه، دانشمندان تکامل یافته اند، شما

237

00:08:04,479 –> 00:08:06,400

برخی از الگوریتم ها را بر این اساس می شناسید و می

238

00:08:06,400 –> 00:08:08,160

دانید که بسیاری از مشکلات بهینه سازی

239

00:08:08,160 –> 00:08:09,680

وجود دارد که به دلیل این

240

00:08:09,680 –> 00:08:12,400

الگوریتم ها حل می شوند، سپس جستجوی کوکو دوباره

241

00:08:12,400 –> 00:08:14,720

الهام گرفته از طبیعت است، جایی که پرنده ای که

242

00:08:14,720 –> 00:08:15,520

هرگز

243

00:08:15,520 –> 00:08:18,319

اوهو لانه خود را ایجاد نمی کند. همیشه

244

00:08:18,319 –> 00:08:18,879

245

00:08:18,879 –> 00:08:20,960

تخمها را در لانه پرنده دیگران میگذارد یا تخمگذاری میکند

246

00:08:20,960 –> 00:08:22,879

و سپس

247

00:08:22,879 –> 00:08:25,199

به طور طبیعی بالاترین احتمال را پیشبینی میکند که

248

00:08:25,199 –> 00:08:26,560

در

249

00:08:26,560 –> 00:08:29,440

آن تخمها امن باشند و از تخم

250

00:08:29,440 –> 00:08:31,120

بیرون بیایند. در اینجا می دانید که ما همچنین سعی می کنیم

251

00:08:31,120 –> 00:08:32,719

آن نوع پدیده طبیعی را پیاده سازی کنیم

252

00:08:32,719 –> 00:08:33,599

253

00:08:33,599 –> 00:08:35,440

و این الگوریتم ها همانطور که گفتم به

254

00:08:35,440 –> 00:08:38,080

طور گسترده ای استفاده می شوند، به عنوان مثال uber ola از

255

00:08:38,080 –> 00:08:39,679

این الگوریتم جستجوی فاخته برای یکی از

256

00:08:39,679 –> 00:08:40,640

257

00:08:40,640 –> 00:08:42,000

برنامه ها استفاده می کند که در حال اختصاص

258

00:08:42,000 –> 00:08:44,800

کابین و غیره هستند، بنابراین در اینجا ما در مورد او صحبت می کنیم.

259

00:08:44,800 –> 00:08:47,519

الگوریتم طبقهبندی uh

260

00:08:47,519 –> 00:08:49,600

و نوع الگوریتمهایی که در

261

00:08:49,600 –> 00:08:51,279

حال حاضر روی صفحه نمایش خود نگاه میکنید، اینها

262

00:08:51,279 –> 00:08:53,519

الگوریتمهای مبتنی بر آماری هستند،

263

00:08:53,519 –> 00:08:55,440

بنابراین ما میتوانیم رگرسیون لجستیکی داشته باشیم،

264

00:08:55,440 –> 00:08:56,640

درختهای تصمیم

265

00:08:56,640 –> 00:08:59,040

جنگلهای تصادفی، خلیجهای ساده و غیره و

266

00:08:59,040 –> 00:09:00,160

البته الگوریتمهای بسیار بیشتری

267

00:09:00,160 –> 00:09:01,360

268

00:09:01,360 –> 00:09:04,480

در این زمینه وجود دارد. لیست بر اساس تجربه

269

00:09:04,480 –> 00:09:06,880

می توانم به شما بگویم که جنگل تصادفی یکی

270

00:09:06,880 –> 00:09:08,959

از پرکاربردترین

271

00:09:08,959 –> 00:09:11,440

الگوریتم های یادگیری ماشینی نظارت شده است

272

00:09:11,440 –> 00:09:12,080

و

273

00:09:12,080 –> 00:09:13,920

همانطور که گفتم از این الگوریتم هم برای

274

00:09:13,920 –> 00:09:15,120

طبقه بندی و هم برای

275

00:09:15,120 –> 00:09:18,480

رگرسیون استفاده می شود جنگل های تصادفی

276

00:09:18,480 –> 00:09:21,440

بر اساس مفهوم درخت های تصمیم ساخته شده اند

277

00:09:21,440 –> 00:09:23,200

و اینجاست که من میگفت

278

00:09:23,200 –> 00:09:24,480

279

00:09:24,480 –> 00:09:27,200

خوب است اگر بدانید درختهای تصمیم قبلاً

280

00:09:27,200 –> 00:09:28,240

281

00:09:28,240 –> 00:09:31,760

یکی از سادهترین الگوریتمها

282

00:09:31,760 –> 00:09:34,160

از نظر پیادهسازی هستند. و همچنین

283

00:09:34,160 –> 00:09:34,839

از نظر

284

00:09:34,839 –> 00:09:37,279

توضیح اینکه چگونه چیزها در

285

00:09:37,279 –> 00:09:38,480

پشت صحنه درست

286

00:09:38,480 –> 00:09:41,760

کار می کنند، بنابراین درخت های تصمیم

287

00:09:41,760 –> 00:09:44,720

مانند یک فلوچارت کار می کنند، شما از گره ریشه شروع

288

00:09:44,720 –> 00:09:45,200

می کنید،

289

00:09:45,200 –> 00:09:47,440

جایی که به تمام داده های خود

290

00:09:47,440 –> 00:09:48,959

مجموعه داده های آموزشی را می دهید

291

00:09:48,959 –> 00:09:52,080

و بر اساس بسیاری از پارامترهای مختلف

292

00:09:52,080 –> 00:09:55,120

مانند شاخص gd آنتروپی اوه می دانید

293

00:09:55,120 –> 00:09:58,160

یا الگوریتم های دیگر

294

00:09:58,160 –> 00:10:01,920

مجموعه داده های شما را به نوعی به حداقل دو

295

00:10:01,920 –> 00:10:04,959

زیر مجموعه تقسیم می کند همانطور که در اینجا نشان داده شده است داده ها

296

00:10:04,959 –> 00:10:08,000

اینجا هستند مجموعه داده اصلی

297

00:10:08,000 –> 00:10:10,079

اکنون دریافت می شود بنابراین فرض کنید این یک

298

00:10:10,079 –> 00:10:11,760

مشکل طبقه بندی است

299

00:10:11,760 –> 00:10:14,640

اکنون می گوییم داده ها به دو زیر مجموعه تقسیم می شوند.

300

00:10:14,640 –> 00:10:15,600

301

00:10:15,600 –> 00:10:18,560

یکی این یکی

302

00:10:18,560 –> 00:10:20,399

درست است پس زیرمجموعه a است

303

00:10:20,399 –> 00:10:23,839

و این زیرمجموعه b است که چگونه این

304

00:10:23,839 –> 00:10:26,640

تقسیم داده اتفاق می افتد در الگوریتم های مختلف اتفاق می افتد

305

00:10:26,640 –> 00:10:27,279

306

00:10:27,279 –> 00:10:29,120

که من در مورد آن صحبت می کنم مانند

307

00:10:29,120 –> 00:10:31,200

308

00:10:31,200 –> 00:10:33,519

کاهش واریانس آنتروپی شاخص gd یا الگوریتم های دیگری وجود دارد

309

00:10:33,519 –> 00:10:34,399

310

00:10:34,399 –> 00:10:37,200

ایده اصلی این است که ما سعی

311

00:10:37,200 –> 00:10:37,920

312

00:10:37,920 –> 00:10:41,440

میکنیم دادهها را به گونهای تقسیم کنند که

313

00:10:41,440 –> 00:10:44,640

خالصتر شوند، یعنی هدف نهایی این است

314

00:10:44,640 –> 00:10:45,040

که

315

00:10:45,040 –> 00:10:47,920

همه دادهها باید به یک کلاس تعلق داشته باشند،

316

00:10:47,920 –> 00:10:49,200

وقتی که دادهها

317

00:10:49,200 –> 00:10:51,360

را در اولین گره دارم. d من فقط دو

318

00:10:51,360 –> 00:10:52,480

کلاس دارم false

319

00:10:52,480 –> 00:10:54,959

true و false البته داده هایی

320

00:10:54,959 –> 00:10:56,720

برای هر دو کلاس مخلوط کرده

321

00:10:56,720 –> 00:10:59,920

ام اکنون تعدادی توابع ریاضی را اجرا می

322

00:10:59,920 –> 00:11:01,839

کنم و سعی می کنم

323

00:11:01,839 –> 00:11:05,519

این داده ها را به گونه ای تقسیم کنم که

324

00:11:05,519 –> 00:11:08,640

خلوص بیشتر یا ناخالصی کمتری در یک گره داشته باشم به این

325

00:11:08,640 –> 00:11:09,600

معنی که

326

00:11:09,600 –> 00:11:13,279

اگر 50 ردیف از دادههای من

327

00:11:13,279 –> 00:11:15,600

وجود داشت که از بین آنها 25 یا 25 نادرست

328

00:11:15,600 –> 00:11:18,320

درست بود، بنابراین این گره کاملاً ناخالص است،

329

00:11:18,320 –> 00:11:21,200

من سعی میکنم برخی از دادهها را بیاورم که در

330

00:11:21,200 –> 00:11:21,680

آنها

331

00:11:21,680 –> 00:11:24,880

مجموعه دادههای نادرست بزرگتر است در اینجا

332

00:11:24,880 –> 00:11:26,560

و شاید بدانید مجموعه دادههای واقعی در

333

00:11:26,560 –> 00:11:28,959

اینجا بزرگتر است و من این کار را

334

00:11:28,959 –> 00:11:31,920

تا زمانی ادامه میدهم که گرههای کاملاً خالص را به دست بیاورم

335

00:11:31,920 –> 00:11:34,320

یا مقداری آستانه تنظیم کنم،

336

00:11:34,320 –> 00:11:36,959

بنابراین این یک راه بسیار بالا برای

337

00:11:36,959 –> 00:11:39,360

درک نحوه عملکرد درختهای تصمیم

338

00:11:39,360 –> 00:11:42,880

در حال حاضر است، همانطور که گفتم اینها

339

00:11:42,880 –> 00:11:45,760

سادهترین شکل الگوریتمها هستند، زیرا توضیح آن

340

00:11:45,760 –> 00:11:46,480

بسیار

341

00:11:46,480 –> 00:11:49,680

آسان است. به یک کاربر تجاری که

342

00:11:49,680 –> 00:11:50,720

آنچه در حال رخ دادن است

343

00:11:50,720 –> 00:11:52,639

بر خلاف مدل های دیگر که ممکن است

344

00:11:52,639 –> 00:11:54,560

دیده باشید مانند رگرسیون یا

345

00:11:54,560 –> 00:11:56,240

شبکه های عصبی یا هر مدل دیگری که در آن

346

00:11:56,240 –> 00:11:57,760

برخی از ریاضیات در پشت

347

00:11:57,760 –> 00:11:59,760

صحنه هستند که توضیح دادن آن برای کسب و کار دشوار است.

348

00:11:59,760 –> 00:12:00,800

349

00:12:00,800 –> 00:12:03,120

اما در اینجا پیاده سازی و توضیح آن بسیار ساده

350

00:12:03,120 –> 00:12:04,399

351

00:12:04,399 –> 00:12:07,360

است اگر درخت های تصمیم

352

00:12:07,360 –> 00:12:08,399

بسیار مفید هستند

353

00:12:08,399 –> 00:12:10,480

و استفاده از آنها بسیار آسان است، پس چرا

354

00:12:10,480 –> 00:12:11,680

355

00:12:11,680 –> 00:12:14,639

باید کاری را در بالای درخت های تصمیم انجام دهیم، بنابراین

356

00:12:14,639 –> 00:12:15,360

این همان چیزی است که

357

00:12:15,360 –> 00:12:17,120

اکنون باید انجام دهیم. به این نگاه کنید که چرا ما

358

00:12:17,120 –> 00:12:19,040

به جنگل تصادفی نیاز داریم،

359

00:12:19,040 –> 00:12:22,320

بنابراین یکی از معایب درخت تصمیم این است

360

00:12:22,320 –> 00:12:23,040

که

361

00:12:23,040 –> 00:12:26,399

در مجموعه داده های واقعی خیلی خوب عمل نمی کند،

362

00:12:26,399 –> 00:12:30,000

بنابراین تمایل به تناسب بیش از حد دارد.

363

00:12:30,000 –> 00:12:32,639

364

00:12:32,639 –> 00:12:33,360

365

00:12:33,360 –> 00:12:36,399

اوه و

366

00:12:36,399 –> 00:12:39,440

روی دادههای واقعی یا دادههای آزمایشی شما خوب عمل نمیکند، به این

367

00:12:39,440 –> 00:12:42,560

معنی که شما واریانس بسیار بالایی دارید،

368

00:12:42,560 –> 00:12:45,279

درست است درختهای تصمیم پایین

369

00:12:45,279 –> 00:12:46,880

معمولاً بایاس پایینی دارند

370

00:12:46,880 –> 00:12:49,440

که اوه آنها به خوبی با

371

00:12:49,440 –> 00:12:50,880

مجموعه دادههای آموزشی شما مطابقت

372

00:12:50,880 –> 00:12:52,720

دارند، اما آنها دارند واریانس بسیار بالا

373

00:12:52,720 –> 00:12:54,320

به این معنی که آنها با

374

00:12:54,320 –> 00:12:56,399

مجموعه داده های مختلف که ندیده اند

375

00:12:56,399 –> 00:12:59,040

برای غلبه بر این مشکل خوب عمل نمی کنند، ما هنوز از

376

00:12:59,040 –> 00:13:00,959

درخت تصمیم استفاده می کنیم اما به شکل بسیار متفاوتی

377

00:13:00,959 –> 00:13:01,440

378

00:13:01,440 –> 00:13:03,200

که جنگل تصادفی نامیده می شود، بنابراین

379

00:13:03,200 –> 00:13:04,880

ما متوجه خواهیم شد که چه اتفاقی می افتد.

380

00:13:04,880 –> 00:13:08,000

یک مفهوم بسیار زیبا وجود دارد

381

00:13:08,000 –> 00:13:10,000

که می تواند به ما در درک درست این

382

00:13:10,000 –> 00:13:12,079

مفهوم Uh از یادگیری گروهی کمک کند، بنابراین

383

00:13:12,079 –> 00:13:14,399

این درخت تصمیم گیری مبتنی بر یادگیری گروهی

384

00:13:14,399 –> 00:13:17,680

است، بنابراین همه شما باید

385

00:13:17,680 –> 00:13:20,160

این داستان را در دوران مدرسه خوانده یا شنیده باشید

386

00:13:20,160 –> 00:13:22,480

یا اینکه در اوایل کودکی می دانید

387

00:13:22,480 –> 00:13:24,880

اوه خانواده مردان کور و فیل،

388

00:13:24,880 –> 00:13:25,680

389

00:13:25,680 –> 00:13:28,959

بنابراین یک سری مرد هستند که می خواهند

390

00:13:28,959 –> 00:13:29,360

بدانند

391

00:13:29,360 –> 00:13:32,320

یک فیل چگونه به نظر می رسد و

392

00:13:32,320 –> 00:13:34,000

متأسفانه همه آنها

393

00:13:34,000 –> 00:13:37,120

کور هستند، بنابراین چه اتفاقی می افتد این است که آنها سعی می کنند

394

00:13:37,120 –> 00:13:39,040

فیل را لمس کنند و سعی می کنند بدانند که

395

00:13:39,040 –> 00:13:42,320

چگونه به نظر می رسد. کسی

396

00:13:42,320 –> 00:13:45,519

که میدانی خرطوم را لمس میکند و

397

00:13:45,519 –> 00:13:47,360

به همه میگوید که فیل

398

00:13:47,360 –> 00:13:48,000

399

00:13:48,000 –> 00:13:51,279

مانند بامبوی پهن است، کسی

400

00:13:51,279 –> 00:13:53,120

فیل را از پهلو لمس میکند و

401

00:13:53,120 –> 00:13:55,519

او توضیح میدهد که فیل شبیه

402

00:13:55,519 –> 00:13:56,079

یک

403

00:13:56,079 –> 00:13:59,440

دیوار است و کسی خرطومش را وصل کرده است. گوش

404

00:13:59,440 –> 00:14:00,240

می دهد و می

405

00:14:00,240 –> 00:14:02,000

گوید مثل یک هوادار است که کسی که می شناسید

406

00:14:02,000 –> 00:14:04,079

دمش را لمس می کند و آنها می گویند

407

00:14:04,079 –> 00:14:05,600

این فیل است که شبیه طناب است و

408

00:14:05,600 –> 00:14:06,480

آنها می دانید که به

409

00:14:06,480 –> 00:14:09,040

بحث و جدل ادامه می دهند و چیزهایی از این قبیل از

410

00:14:09,040 –> 00:14:10,639

این ما وای باید درک کنید

411

00:14:10,639 –> 00:14:13,040

که یادگیری گروهی چیست، بنابراین اتفاقی که

412

00:14:13,040 –> 00:14:14,160

می افتد این است

413

00:14:14,160 –> 00:14:17,360

که نتایج را بر اساس

414

00:14:17,360 –> 00:14:18,800

رای های

415

00:14:18,800 –> 00:14:21,839

موجودات مختلف UH ترکیب می کنید، مثلاً از

416

00:14:21,839 –> 00:14:23,839

یک مدل استفاده نمی کند و از مدل های مختلف زیادی استفاده می کند

417

00:14:23,839 –> 00:14:24,720

418

00:14:24,720 –> 00:14:28,959

و سپس از یک رأی برای شناسایی در نهایت

419

00:14:28,959 –> 00:14:31,920

کلاس یا کلاس استفاده می کند. ارزش پیشبینی این

420

00:14:31,920 –> 00:14:32,560

نوع

421

00:14:32,560 –> 00:14:34,720

رویکرد، یادگیری گروهی نامیده میشود، اکنون

422

00:14:34,720 –> 00:14:36,079

بخش خوبی در مورد این

423

00:14:36,079 –> 00:14:39,040

در مقابل داستانی که دیدهایم این است

424

00:14:39,040 –> 00:14:40,079

که

425

00:14:40,079 –> 00:14:42,720

میتوانیم نوع دادههایی را که به الگوریتمهای مختلف نشان میدهیم کنترل کنیم

426

00:14:42,720 –> 00:14:44,079

427

00:14:44,079 –> 00:14:46,240

و این چیزی شبیه

428

00:14:46,240 –> 00:14:47,600

به افراد کاملاً

429

00:14:47,600 –> 00:14:50,240

نابینا نیست که مناطق مختلف را به طور کامل بررسی کنند.

430

00:14:50,240 –> 00:14:52,160

از مجموعه دادههای ما، بنابراین سردرگمی زیادی وجود خواهد داشت،

431

00:14:52,160 –> 00:14:53,279

432

00:14:53,279 –> 00:14:55,600

بنابراین، همانطور که ادامه میدهیم،

433

00:14:55,600 –> 00:14:57,360

این را با جزئیات درک خواهیم کرد که چگونه

434

00:14:57,360 –> 00:15:00,480

یادگیری گروهی

435

00:15:00,480 –> 00:15:02,000

به پیشبینیهای بهتر از

436

00:15:02,000 –> 00:15:03,519

درختهای تصمیمگیری کمک میکند، اما

437

00:15:03,519 –> 00:15:06,320

این ایده فقط درک آن

438

00:15:06,320 –> 00:15:07,920

است که یادگیری گروهی به این معنی که

439

00:15:07,920 –> 00:15:11,440

الگوریتمهای مختلف روی

440

00:15:11,440 –> 00:15:14,160

مجموعه دادههای شما در زیرمجموعههای مجموعه دادههای شما کار میکنند

441

00:15:14,160 –> 00:15:15,600

و سپس ما

442

00:15:15,600 –> 00:15:18,880

رایگیری بین این دو را انجام میدهیم.

443

00:15:18,880 –> 00:15:20,560

الگوریتمهای se را میتوان

444

00:15:20,560 –> 00:15:22,399

مانند 100 الگوریتم مختلف

445

00:15:22,399 –> 00:15:23,120

446

00:15:23,120 –> 00:15:26,000

در جنگل تصادفی زیر یک الگوریتم اجرا کرد، بنابراین اکنون میفهمیم

447

00:15:26,000 –> 00:15:26,720

448

00:15:26,720 –> 00:15:30,160

که چگونه اتفاق میافتد، خوب پس اوه، اکنون

449

00:15:30,160 –> 00:15:30,639

اضافه میکنیم

450

00:15:30,639 –> 00:15:32,800

که به آن یادگیری گروهی گفته میشود، بنابراین

451

00:15:32,800 –> 00:15:34,000

این یک مفهوم است،

452

00:15:34,000 –> 00:15:36,399

حالا ما چه کار میکنیم ما در یادگیری گروهی استفاده می کنیم چمدان

453

00:15:36,399 –> 00:15:37,600

454

00:15:37,600 –> 00:15:40,000

و بوت استرپینگ است که اتفاق می افتد

455

00:15:40,000 –> 00:15:40,880

این است که این

456

00:15:40,880 –> 00:15:44,240

مفهوم رای دادن به خودی خود التماس نامیده می شود

457

00:15:44,240 –> 00:15:47,040

خوب شما یک مجموعه داده دارید و برای

458

00:15:47,040 –> 00:15:49,360

سادگی ما در اینجا فقط چهار

459

00:15:49,360 –> 00:15:50,480

متغیر

460

00:15:50,480 –> 00:15:52,639

را انتخاب می کنیم.

461

00:15:52,639 –> 00:15:54,720

462

00:15:54,720 –> 00:15:57,199

بیماری قلبی یا نه بر اساس

463

00:15:57,199 –> 00:15:58,320

چهار ویژگی

464

00:15:58,320 –> 00:16:01,040

آه درد قفسه سینه گردش خون برخی از شما می

465

00:16:01,040 –> 00:16:02,000

دانید

466

00:16:02,000 –> 00:16:05,199

پارامتر بله یا خیر شریان های وبلاگ

467

00:16:05,199 –> 00:16:07,600

و سپس وزن فرد، بنابراین کاری که ما

468

00:16:07,600 –> 00:16:08,560

انجام می دهیم این است که ما

469

00:16:08,560 –> 00:16:10,320

داده های زیادی داریم که قبلاً

470

00:16:10,320 –> 00:16:12,560

برچسب گذاری شده است مانند بیماری قلبی در دسترس است

471

00:16:12,560 –> 00:16:14,480

بنابراین ما مدلها را آموزش میدهیم

472

00:16:14,480 –> 00:16:17,759

و سپس این دادهها را میگیریم و

473

00:16:17,759 –> 00:16:19,279

زیرمجموعه همه این دادهها را میگیریم

474

00:16:19,279 –> 00:16:21,600

و میدانید که چندین مدل را در

475

00:16:21,600 –> 00:16:23,279

بالای آن آموزش میدهیم و در نهایت

476

00:16:23,279 –> 00:16:26,320

از هر ماژول کلمه میگیریم که

477

00:16:26,320 –> 00:16:26,800

478

00:16:26,800 –> 00:16:29,680

مثلاً در اینجا یک سطر خاص را پاس می

479

00:16:29,680 –> 00:16:30,560

کنیم،

480

00:16:30,560 –> 00:16:33,600

فرض کنید مثلاً 1000 ردیف داده

481

00:16:33,600 –> 00:16:35,600

با این تعداد ستون وجود دارد، ما

482

00:16:35,600 –> 00:16:37,519

صدها درخت تصمیم یا

483

00:16:37,519 –> 00:16:39,199

مدل مختلف را در این مجموعه داده آموزش دادیم

484

00:16:39,199 –> 00:16:42,880

و در نهایت از هر

485

00:16:42,880 –> 00:16:45,279

درخت تیمی می خواهیم که چه چیزی را پیش بینی می کنید.

486

00:16:45,279 –> 00:16:47,120

بیایید اینجا بله یا خیر

487

00:16:47,120 –> 00:16:49,440

و ما می گوییم که با دیدن اینکه 95

488

00:16:49,440 –> 00:16:51,680

درخت مقدار را

489

00:16:51,680 –> 00:16:53,600

برای این داده پیش بینی می کنند که

490

00:16:53,600 –> 00:16:55,519

بله بله و 169

491

00:16:55,519 –> 00:16:59,839

درست است بنابراین 95 درخت به

492

00:16:59,839 –> 00:17:02,160

بله و پنج درخت به خیر رای می دهند.

493

00:17:02,160 –> 00:17:03,120

ما با

494

00:17:03,120 –> 00:17:04,959

بله پیش میرویم و این دقیقاً معنای بستهبندی است،

495

00:17:04,959 –> 00:17:06,480

بنابراین ما 100 الگوریتم موازی را اجرا میکنیم

496

00:17:06,480 –> 00:17:07,280

497

00:17:07,280 –> 00:17:08,880

و سپس نتایج را

498

00:17:08,880 –> 00:17:10,559

بر اساس آرا در اینجا جمع میکنیم،

499

00:17:10,559 –> 00:17:12,559

بنابراین بیایید این را با جزئیات ببینیم

500

00:17:12,559 –> 00:17:14,240

چه اتفاقی میافتد،

501

00:17:14,240 –> 00:17:16,959

بنابراین شما کل مجموعه دادههای خود را ایجاد کنید.

502

00:17:16,959 –> 00:17:17,520

n

503

00:17:17,520 –> 00:17:20,000

uh زیرمجموعه دادههای شما اکنون

504

00:17:20,000 –> 00:17:20,959

نکته جالب این است

505

00:17:20,959 –> 00:17:24,160

که اندازه دادهها ثابت میماند، بنابراین

506

00:17:24,160 –> 00:17:25,760

همه زیرمجموعههای

507

00:17:25,760 –> 00:17:29,039

شما از نظر تعداد ردیفها برابر هستند،

508

00:17:29,039 –> 00:17:32,400

به این معنی که شما زیر مجموعهها را

509

00:17:32,400 –> 00:17:35,600

در انتخاب تصادفی با جایگزین میگیرید. t

510

00:17:35,600 –> 00:17:37,520

و من آن را در شکل بعدی توضیح خواهم داد،

511

00:17:37,520 –> 00:17:38,960

اما فقط

512

00:17:38,960 –> 00:17:42,160

به یاد داشته باشید که ما در حال ایجاد

513

00:17:42,160 –> 00:17:46,000

n زیر مجموعه هستیم که در آن n می تواند 100 250

514

00:17:46,000 –> 00:17:48,480

یا هر عدد دیگری باشد که منطقی است،

515

00:17:48,480 –> 00:17:50,480

بنابراین بسیاری از زیرمجموعه های داده شما

516

00:17:50,480 –> 00:17:53,600

اما همه زیر مجموعه ها دارای تعداد مساوی هستند

517

00:17:53,600 –> 00:17:54,000

.

518

00:17:54,000 –> 00:17:57,039

ردیف ها به عنوان مجموعه داده های اصلی شما،

519

00:17:57,039 –> 00:18:00,080

سپس کاری که انجام می دهید این است که

520

00:18:00,080 –> 00:18:03,840

روی هر مجموعه داده یک درخت جداگانه ایجاد می کنید،

521

00:18:03,840 –> 00:18:05,600

حالا تفاوت این

522

00:18:05,600 –> 00:18:07,760

درخت ها چیست، یکی این است که آنها

523

00:18:07,760 –> 00:18:10,000

داده های متفاوتی دریافت می کنند زیرا اگرچه

524

00:18:10,000 –> 00:18:11,280

اندازه یکسان است،

525

00:18:11,280 –> 00:18:13,520

اما تکرار زیادی وجود دارد.

526

00:18:13,520 –> 00:18:14,480

سطرها

527

00:18:14,480 –> 00:18:18,480

و سپس دو زیرمجموعه از نظر داده با یکدیگر یکسان

528

00:18:18,480 –> 00:18:21,200

یا مساوی

529

00:18:21,200 –> 00:18:22,080

530

00:18:22,080 –> 00:18:24,480

نخواهند بود، در تعداد داده ها یکسان هستند اما

531

00:18:24,480 –> 00:18:25,919

داده های یکسان

532

00:18:25,919 –> 00:18:29,520

نیستند، تفاوت دیگر این است که هر درخت

533

00:18:29,520 –> 00:18:33,200

در معرض همه ستون ها

534

00:18:33,200 –> 00:18:36,320

نیست، بنابراین اگر 10 ستون وجود داشته باشد. ستونهای مجموعه دادههای

535

00:18:36,320 –> 00:18:36,880

536

00:18:36,880 –> 00:18:39,600

شما، زیرمجموعههای شما نیز به عنوان مثال 10 ستون خواهند داشت،

537

00:18:39,600 –> 00:18:40,480

538

00:18:40,480 –> 00:18:42,080

اما درخت تصمیم

539

00:18:42,080 –> 00:18:44,320

با 10 ستون عرضه نمیشود،

540

00:18:44,320 –> 00:18:46,480

ما تصمیم میگیریم چند ستون

541

00:18:46,480 –> 00:18:47,840

542

00:18:47,840 –> 00:18:50,400

به هر گره بدهیم در حالی که میتوان آن را تقسیم کرد.

543

00:18:50,400 –> 00:18:51,200

2

544

00:18:51,200 –> 00:18:54,080

3 4 هر عددی که فکر می کنیم درست است

545

00:18:54,080 –> 00:18:54,880

و

546

00:18:54,880 –> 00:18:58,000

سپس درخت

547

00:18:58,000 –> 00:19:00,720

بر اساس ستون های مختلف و

548

00:19:00,720 –> 00:19:02,160

ردیف های داده های مختلف پیش بینی می کند

549

00:19:02,160 –> 00:19:04,400

که پس از آن آزمایش می کنیم و

550

00:19:04,400 –> 00:19:05,520

من توضیح می دهم

551

00:19:05,520 –> 00:19:07,600

که چگونه این فرآیند را با جزئیات انجام دهیم چگونه

552

00:19:07,600 –> 00:19:09,520

این داده ها را ایجاد کنیم. مجموعهها و چگونه

553

00:19:09,520 –> 00:19:10,160

تصمیم میگیریم

554

00:19:10,160 –> 00:19:11,919

چند ستون و کدام ستون را

555

00:19:11,919 –> 00:19:14,080

انتخاب کنیم، اما این

556

00:19:14,080 –> 00:19:17,600

ایده کلی برای قرار دادن در یک جنگل تصادفی است،

557

00:19:17,600 –> 00:19:19,760

بنابراین فقط برای تکرار، کل مجموعه دادهها را در نظر بگیریم،

558

00:19:19,760 –> 00:19:20,880

559

00:19:20,880 –> 00:19:23,760

n زیر مجموعه با اندازه یکسان

560

00:19:23,760 –> 00:19:25,120

دادههای البته متفاوت است، زیرا آنچه ما داریم

561

00:19:25,120 –> 00:19:25,919

562

00:19:25,919 –> 00:19:29,600

نمونهبرداری تصادفی با جایگزینی است، سپس

563

00:19:29,600 –> 00:19:31,840

این دادهها را به درختهای مختلف

564

00:19:31,840 –> 00:19:34,080

منتقل میکنیم که در آن ستونهای متفاوتی

565

00:19:34,080 –> 00:19:37,039

برای درخت داریم و به صورت تصادفی است

566

00:19:37,039 –> 00:19:39,120

567

00:19:39,120 –> 00:19:40,400

و سپس میخواهیم این درختها را آموزش دهیم و سپس

568

00:19:40,400 –> 00:19:43,520

رأی این درختها را به عنوان ما

569

00:19:43,520 –> 00:19:44,640

چیزی به نام

570

00:19:44,640 –> 00:19:47,200

bagging داریم مفهوم دیگری به نام

571

00:19:47,200 –> 00:19:48,000

تقویت

572

00:19:48,000 –> 00:19:51,520

برای یادگیری گروهی وجود دارد، اما در تقویت

573

00:19:51,520 –> 00:19:55,039

الگوریتم های موازی را اجرا نمی کنیم، ما الگوریتم های متوالی را اجرا می

574

00:19:55,039 –> 00:19:55,919

575

00:19:55,919 –> 00:19:58,160

کنیم و الگوریتم های مختلف وجود دارد.

576

00:19:58,160 –> 00:19:59,520

thms برای این

577

00:19:59,520 –> 00:20:01,840

جنگل تصادفی روی تقویت کار نمیکند،

578

00:20:01,840 –> 00:20:02,880

خوب، روی

579

00:20:02,880 –> 00:20:06,000

یک التماس کار میکند، بنابراین در تقویت کاری که انجام میدهیم این است

580

00:20:06,000 –> 00:20:09,200

که مجموعه دادهای را که آموزش میدهیم، یک مدل را

581

00:20:09,200 –> 00:20:11,600

میگیریم که از این مدل یاد میگیریم،

582

00:20:11,600 –> 00:20:13,919

چند چیز را تغییر میدهیم، برخی از دادهها را در هر کجا که میدانیم تغییر میدهیم.

583

00:20:13,919 –> 00:20:15,840

ما حداکثر اطمینان را داریم و

584

00:20:15,840 –> 00:20:17,360

چیزهای دیگری وجود دارد که

585

00:20:17,360 –> 00:20:19,440

اتفاق می افتد، سپس مدل بعدی را آموزش می دهیم،

586

00:20:19,440 –> 00:20:20,880

سپس

587

00:20:20,880 –> 00:20:23,200

خروجی را که از آن یاد می گیریم دریافت می کنیم، سپس

588

00:20:23,200 –> 00:20:25,360

مدل دیگری را آموزش می دهیم، بنابراین حتی در

589

00:20:25,360 –> 00:20:27,679

اینجا از چندین الگوریتم و مدل استفاده می

590

00:20:27,679 –> 00:20:30,240

کنیم اما این کار را انجام می دهیم. به صورت متوالی و نه

591

00:20:30,240 –> 00:20:30,720

592

00:20:30,720 –> 00:20:33,440

موازی و در نهایت ما یک

593

00:20:33,440 –> 00:20:34,640

نتیجه نهایی خواهیم داشت،

594

00:20:34,640 –> 00:20:37,679

بنابراین این مفهوم تقویت هر دو

595

00:20:37,679 –> 00:20:39,679

کیسه و تقویت و مونتاژ

596

00:20:39,679 –> 00:20:41,200

الگوریتم ها است،

597

00:20:41,200 –> 00:20:44,240

بنابراین بیایید اکنون مقداری قیاس

598

00:20:44,240 –> 00:20:46,799

را درک کنیم تا شفافیت بیشتری در این مورد بدست

599

00:20:46,799 –> 00:20:48,960

آوریم. سعی میکند برای

600

00:20:48,960 –> 00:20:52,000

یک سفر تعطیلات یک ساله برنامهریزی کند،

601

00:20:52,000 –> 00:20:54,799

حالا او میخواهد انتخاب کند که کجا

602

00:20:54,799 –> 00:20:56,400

باید وقت خود را بگذراند و شما

603

00:20:56,400 –> 00:20:58,159

چنین چیزهایی را میدانید، بنابراین او

604

00:20:58,159 –> 00:21:00,559

سعی میکند

605

00:21:00,559 –> 00:21:02,960

مقصد تعطیلاتش را پیدا کند. بنابراین کاری که او انجام می دهد این است

606

00:21:02,960 –> 00:21:06,080

که از چند دوست می پرسد که می دانید اکنون

607

00:21:06,080 –> 00:21:07,200

کجا باید بروم

608

00:21:07,200 –> 00:21:10,159

دوستان از او سؤالاتی می پرسند

609

00:21:10,159 –> 00:21:10,799

610

00:21:10,799 –> 00:21:12,960

که دوست دارید در کدام مکان

611

00:21:12,960 –> 00:21:14,000

612

00:21:14,000 –> 00:21:16,720

وقت بگذرانید آیا ماجراجو هستید که می خواهید به

613

00:21:16,720 –> 00:21:18,320

مکان آرام تری بروید یا چیزهایی مانند آن بنابراین

614

00:21:18,320 –> 00:21:19,919

سؤالات زیادی وجود دارد

615

00:21:19,919 –> 00:21:22,080

و من می پرسم که این را توضیح می دهم

616

00:21:22,080 –> 00:21:22,960

زیرا این همان کاری است که

617

00:21:22,960 –> 00:21:26,159

اوه اوه اوه سه تا با داده ها

618

00:21:26,159 –> 00:21:26,799

درست انجام می

619

00:21:26,799 –> 00:21:29,840

دهند بنابراین یکی از دوستان می تواند مکان خاصی

620

00:21:29,840 –> 00:21:30,799

621

00:21:30,799 –> 00:21:32,559

را پیشنهاد کند دوست دوم می تواند مکان دیگری را پیشنهاد

622

00:21:32,559 –> 00:21:34,400

کند دوست بازیکن سوم آیا

623

00:21:34,400 –> 00:21:36,320

می دانید چیز دیگری پیشنهاد می کنید و

624

00:21:36,320 –> 00:21:37,440

البته ممکن است

625

00:21:37,440 –> 00:21:40,720

تداخل داشته باشد و اوه

626

00:21:40,720 –> 00:21:43,520

سپس روند ادامه پیدا می کند اوه چندلر

627

00:21:43,520 –> 00:21:44,000

همچنان

628

00:21:44,000 –> 00:21:45,440

از دوستان بیشتری می پرسد و می دانید که

629

00:21:45,440 –> 00:21:47,120

در نهایت چه اتفاقی می افتد

630

00:21:47,120 –> 00:21:50,080

پس از پرسیدن از همه است که می بیند آنچه

631

00:21:50,080 –> 00:21:50,559

632

00:21:50,559 –> 00:21:53,760

بر اساس علاقه من است.

633

00:21:53,760 –> 00:21:57,280

مکان توسط دوستان من

634

00:21:57,280 –> 00:21:59,280

حداکثر تعداد دفعات درست پیشنهاد شده است، بنابراین

635

00:21:59,280 –> 00:22:00,799

دقیقاً مانند رای دادن است

636

00:22:00,799 –> 00:22:03,120

و جنگل تصادفی شما نیز

637

00:22:03,120 –> 00:22:04,400

به این ترتیب کار می کند، بنابراین شما

638

00:22:04,400 –> 00:22:06,480

اطلاعاتی را به الگوریتم های مختلف

639

00:22:06,480 –> 00:22:08,640

ارائه می دهید. در این قیاس دوستان هستید

640

00:22:08,640 –> 00:22:12,000

و سپس در نهایت در مورد

641

00:22:12,000 –> 00:22:14,480

حداکثر تعداد پاسخ هایی که ما آنها

642

00:22:14,480 –> 00:22:15,200

را به عنوان

643

00:22:15,200 –> 00:22:18,159

وزن می نامیم تصمیم می گیرید، بنابراین اکنون سریعاً کاری که می

644

00:22:18,159 –> 00:22:18,960

خواهیم انجام دهیم این است

645

00:22:18,960 –> 00:22:21,039

که دوباره به طور شهودی خواهیم دید، بنابراین آنچه

646

00:22:21,039 –> 00:22:22,640

می گوییم اکنون مجموعه داده داریم.

647

00:22:22,640 –> 00:22:24,720

ما در حال ساخت چندین درخت تصمیم هستیم،

648

00:22:24,720 –> 00:22:26,320

بنابراین درختهای تصمیم زیادی در اینجا وجود خواهد داشت،

649

00:22:26,320 –> 00:22:27,919

ما فقط

650

00:22:27,919 –> 00:22:30,240

سه مورد را نشان میدهیم، اما اگر 10 متغیر

651

00:22:30,240 –> 00:22:32,159

در مجموعه دادههای خود و چند صد

652

00:22:32,159 –> 00:22:35,360

ردیف دارید، میتوانیم به راحتی مثلاً 30 40

653

00:22:35,360 –> 00:22:36,240

درخت تصمیم بسازیم

654

00:22:36,240 –> 00:22:38,000

در اینجا اندازه داده است. مراحل تنظیم

655

00:22:38,000 –> 00:22:41,280

و با افزایش ستونها، میتوانید

656

00:22:41,280 –> 00:22:42,880

به افزایش درختهای تصمیم ادامه دهید

657

00:22:42,880 –> 00:22:45,039

و این همه زمانی اتفاق میافتد که ما

658

00:22:45,039 –> 00:22:47,760

تکامل ماتریس uh را انجام دهیم و میبینیم که میدانید

659

00:22:47,760 –> 00:22:48,080

660

00:22:48,080 –> 00:22:50,400

چه تعداد درخت به شما

661

00:22:50,400 –> 00:22:51,360

نوع

662

00:22:51,360 –> 00:22:53,200

پیشبینی درست را میدهد، بنابراین در کجاست. ما

663

00:22:53,200 –> 00:22:55,120

در مورد تعداد درختان تصمیم میگیریم، اما میتوانیم

664

00:22:55,120 –> 00:22:57,360

بر

665

00:22:57,360 –> 00:22:59,760

اساس پیشنهادات یا

666

00:22:59,760 –> 00:23:01,200

اقدامات پیشنهادی که وجود دارد، از تعدادی شروع کنیم، بنابراین

667

00:23:01,200 –> 00:23:03,120

قوانین سخت و سریع وجود ندارد همانطور که گفتم میدانید که

668

00:23:03,120 –> 00:23:03,679

669

00:23:03,679 –> 00:23:06,559

همیشه با 23 یا 23 شروع میکنید. 25 پس این یک

670

00:23:06,559 –> 00:23:08,080

سوال کلی است که

671

00:23:08,080 –> 00:23:09,600

وقتی در این مورد شروع می کنید وجود دارد که

672

00:23:09,600 –> 00:23:11,600

از کجا شروع می کنید تا به

673

00:23:11,600 –> 00:23:13,280

طور کلی با تمرین همراه شود و در اینجا سعی خواهد شد

674

00:23:13,280 –> 00:23:14,080

و

675

00:23:14,080 –> 00:23:15,600

سپس البته می توانید

676

00:23:15,600 –> 00:23:17,360

توصیه هایی را از

677

00:23:17,360 –> 00:23:20,240

منابع مختلف مانند مقالات تحقیقاتی و غیره دریافت کنید. این همان

678

00:23:20,240 –> 00:23:20,559

چیزی است که

679

00:23:20,559 –> 00:23:22,880

به آن نگاه شد، اما اکنون میگوییم درباره همه مراحل صحبت میکنیم،

6