در این مطلب، ویدئو یادگیری ماشینی از ابتدا در پایتون – دوره کامل با 12 الگوریتم (5 ساعت) با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 4:55:23

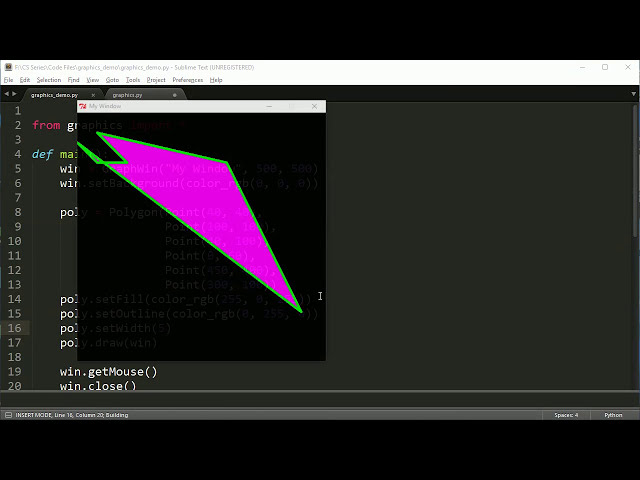

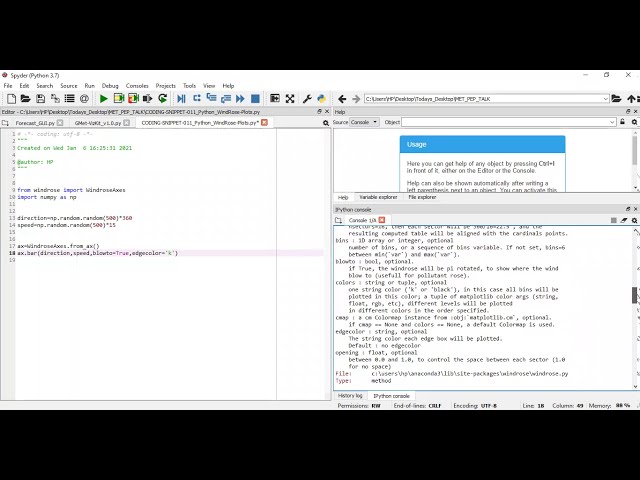

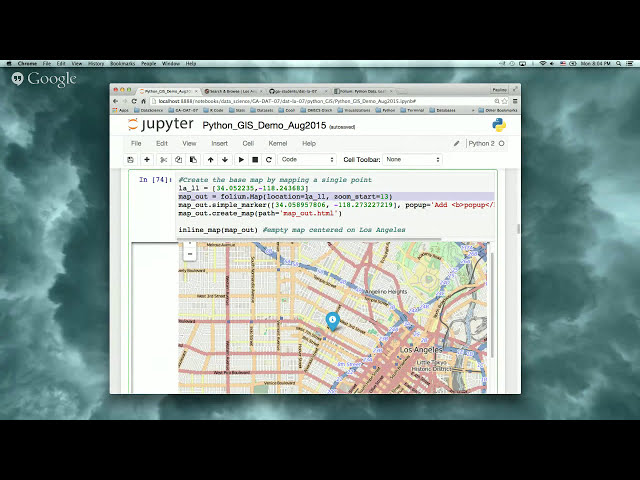

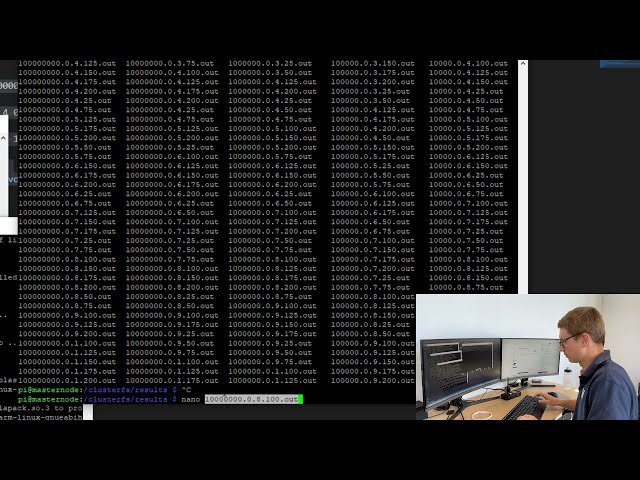

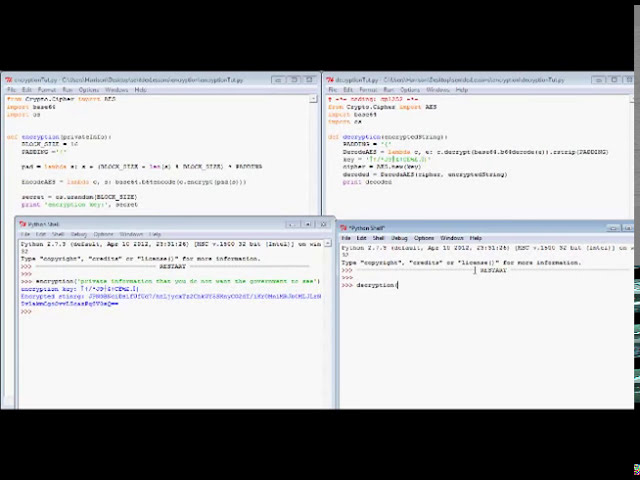

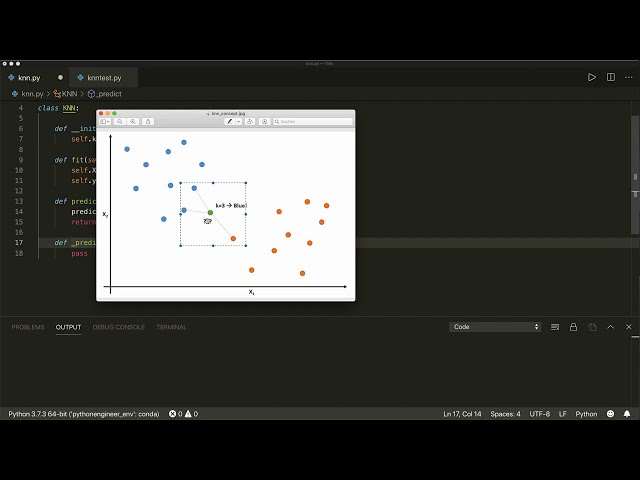

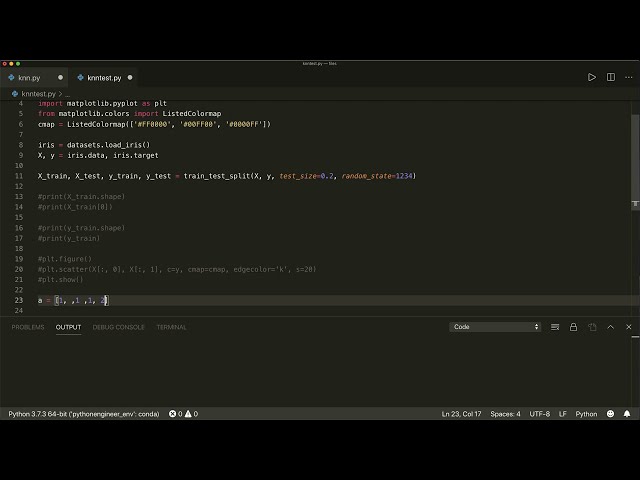

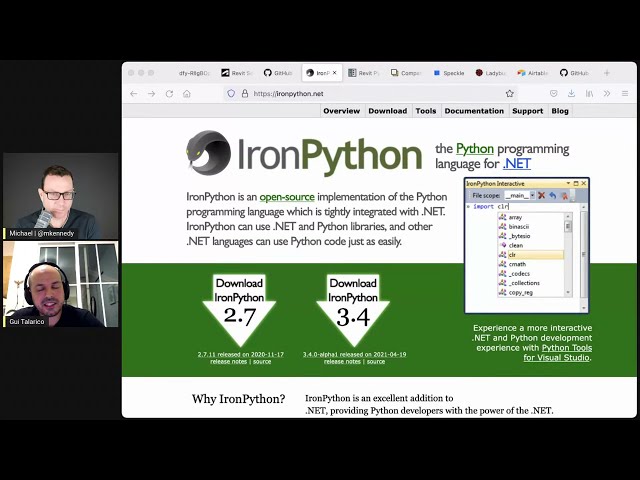

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,080 –> 00:00:01,920

به همه به همه چیز خود خوش آمدید

2

00:00:01,920 –> 00:00:03,919

ویدیو یادگیری ماشینی از ابتدا

3

00:00:03,919 –> 00:00:06,960

این ویدیو تمام 15 قسمت میلی لیتر من را می گیرد

4

00:00:06,960 –> 00:00:09,280

از سری اول و ترکیب آن به

5

00:00:09,280 –> 00:00:10,559

یک ویدیو تک

6

00:00:10,559 –> 00:00:12,400

در این مجموعه قصد داریم اجرا کنیم

7

00:00:12,400 –> 00:00:14,160

محبوب ترین یادگیری ماشینی

8

00:00:14,160 –> 00:00:15,280

الگوریتم هایی با استفاده از

9

00:00:15,280 –> 00:00:18,240

فقط python خالص و numpy این است

10

00:00:18,240 –> 00:00:20,400

عالی است اگر مبتدی هستید یا

11

00:00:20,400 –> 00:00:22,400

سطح مهارت متوسط است و می خواهید کسب کنید

12

00:00:22,400 –> 00:00:24,480

درک عمیق تر چگونه همه اینها

13

00:00:24,480 –> 00:00:26,080

الگوریتم ها کار می کنند

14

00:00:26,080 –> 00:00:28,320

همه ویدیوها همچنین حاوی یک نظریه کوچک هستند

15

00:00:28,320 –> 00:00:30,400

بخش قبل از اینکه به کد بپریم

16

00:00:30,400 –> 00:00:32,479

من برای هر بخش مهر زمانی می گذارم

17

00:00:32,479 –> 00:00:34,239

و البته همه کد موجود است

18

00:00:34,239 –> 00:00:34,960

در github

19

00:00:34,960 –> 00:00:37,280

من همچنین یک کتاب راهنمای numpy رایگان ایجاد کردم

20

00:00:37,280 –> 00:00:39,280

که تمام عملکردهای ضروری را پوشش می دهد

21

00:00:39,280 –> 00:00:40,879

که شما باید در numpy بدانید

22

00:00:40,879 –> 00:00:43,120

و حاوی نمونه های کد مفیدی است

23

00:00:43,120 –> 00:00:44,320

تمام بخش ها

24

00:00:44,320 –> 00:00:46,399

بنابراین می توانید این کتاب الکترونیکی را به صورت رایگان دانلود کنید

25

00:00:46,399 –> 00:00:48,399

در وب سایت من لینک را در آن می گذارم

26

00:00:48,399 –> 00:00:49,360

توضیحات

27

00:00:49,360 –> 00:00:51,280

پس بیایید شروع کنیم و اگر لذت می برید

28

00:00:51,280 –> 00:00:53,039

این مطالب حتما برای من لایک بگذارید

29

00:00:53,039 –> 00:00:59,840

و عضویت در کانال را در نظر بگیرید

30

00:01:00,480 –> 00:01:03,039

سلام به همه به یک آموزش جدید خوش آمدید

31

00:01:03,039 –> 00:01:05,280

این اولین ویدیو از یک سری جدید است

32

00:01:05,280 –> 00:01:07,840

به نام یادگیری ماشینی از ابتدا

33

00:01:07,840 –> 00:01:09,920

در این مجموعه قصد داریم اجرا کنیم

34

00:01:09,920 –> 00:01:12,000

الگوریتم های محبوب یادگیری ماشینی

35

00:01:12,000 –> 00:01:14,479

فقط با استفاده از ماژول های داخلی پایتون و

36

00:01:14,479 –> 00:01:15,600

بی حسی

37

00:01:15,600 –> 00:01:17,600

بنابراین امروز ما با k شروع خواهیم کرد

38

00:01:17,600 –> 00:01:19,439

الگوریتم نزدیکترین همسایه یا

39

00:01:19,439 –> 00:01:23,119

الگوریتم k n کوتاه مفهوم k

40

00:01:23,119 –> 00:01:26,000

و n نسبتا آسان است یک نمونه است

41

00:01:26,000 –> 00:01:28,640

با رای محبوبیت آن طبقه بندی شده است

42

00:01:28,640 –> 00:01:30,400

نزدیکترین همسایگان

43

00:01:30,400 –> 00:01:33,040

پس بیایید یک مثال با دو در نظر بگیریم

44

00:01:33,040 –> 00:01:33,920

کلاس ها

45

00:01:33,920 –> 00:01:37,200

و یک بردار ویژگی دو بعدی بنابراین

46

00:01:37,200 –> 00:01:40,159

اجازه دهید نگاهی به این رقم در اینجا بیاندازیم

47

00:01:40,159 –> 00:01:40,720

ما داریم

48

00:01:40,720 –> 00:01:44,000

دو کلاس کلاس آبی و

49

00:01:44,000 –> 00:01:45,680

کلاس نارنجی

50

00:01:45,680 –> 00:01:48,240

و ما بردارهای ویژگی با دو داریم

51

00:01:48,240 –> 00:01:49,439

ابعاد

52

00:01:49,439 –> 00:01:52,960

بنابراین در این محور x1 داریم

53

00:01:52,960 –> 00:01:56,159

و x2 در این محور

54

00:01:56,159 –> 00:01:58,880

و کاری که ما اینجا انجام می دهیم این است که مقداری داریم

55

00:01:58,880 –> 00:02:01,200

نمونه های آموزشی

56

00:02:01,200 –> 00:02:04,479

و سپس برای هر نمونه جدید که ما

57

00:02:04,479 –> 00:02:06,560

می خواهند طبقه بندی کنند

58

00:02:06,560 –> 00:02:09,758

ما فاصله این را محاسبه می کنیم

59

00:02:09,758 –> 00:02:14,319

نمونه برای هر یک از نمونه های آموزشی

60

00:02:14,319 –> 00:02:16,560

و سپس نگاهی به نزدیکترین آنها خواهیم داشت

61

00:02:16,560 –> 00:02:17,360

همسایه ها

62

00:02:17,360 –> 00:02:19,520

بنابراین در این مورد ما نگاهی به

63

00:02:19,520 –> 00:02:21,840

سه همسایه نزدیک

64

00:02:21,840 –> 00:02:25,200

اینها و سپس ما انتخاب می کنیم

65

00:02:25,200 –> 00:02:28,319

یا برچسب را بر اساس بیشترین پیش بینی کنید

66

00:02:28,319 –> 00:02:31,519

برچسب های کلاس رایج

67

00:02:31,519 –> 00:02:34,720

در اینجا ما دو کلاس آبی داریم

68

00:02:34,720 –> 00:02:37,680

و یک کلاس نارنجی پس این خواهد شد

69

00:02:37,680 –> 00:02:38,000

بودن

70

00:02:38,000 –> 00:02:40,879

یک کلاس آبی و این کل است

71

00:02:40,879 –> 00:02:42,080

مفهوم از

72

00:02:42,080 –> 00:02:46,000

k n و آنچه ما نیز باید بدانیم این است

73

00:02:46,000 –> 00:02:50,560

برای محاسبه فاصله ها

74

00:02:50,560 –> 00:02:53,920

ما از فاصله اقلیدسی استفاده می کنیم

75

00:02:53,920 –> 00:02:57,200

بنابراین در یک مثال 2 بعدی

76

00:02:57,200 –> 00:03:00,480

u فاصله اقلیدسی دو

77

00:03:00,480 –> 00:03:01,360

نکته ها

78

00:03:01,360 –> 00:03:05,120

به عنوان جذر تعریف می شود

79

00:03:05,120 –> 00:03:10,159

بیش از و سپس ما برای هر یک

80

00:03:10,159 –> 00:03:13,120

جزء بردار ویژگی ما داریم

81

00:03:13,120 –> 00:03:15,519

مربع

82

00:03:15,519 –> 00:03:19,440

تفاوت بنابراین ما x2 منهای x1 داریم

83

00:03:19,440 –> 00:03:22,800

مربع به اضافه y2 منهای

84

00:03:22,800 –> 00:03:26,560

مجذور y1 پس این اقلیدسی است

85

00:03:26,560 –> 00:03:27,519

فاصله در a

86

00:03:27,519 –> 00:03:32,080

حالت 2d و در حالت کلی تر

87

00:03:32,080 –> 00:03:35,599

یا فرمول تعریف شده است

88

00:03:35,599 –> 00:03:40,239

همانطور که این پس ریشه دوم است

89

00:03:40,239 –> 00:03:43,280

بیش از مجموع از i

90

00:03:43,280 –> 00:03:46,959

برابر 0 تا n که n عدد است

91

00:03:46,959 –> 00:03:48,480

ابعاد

92

00:03:48,480 –> 00:03:52,080

و سپس ما جمع را تمام می کنیم

93

00:03:52,080 –> 00:03:56,400

هر جزء و برای هر جزء

94

00:03:56,400 –> 00:04:00,239

ما مجذور فاصله یا عدد را محاسبه می کنیم

95

00:04:00,239 –> 00:04:02,239

اختلاف مربع

96

00:04:02,239 –> 00:04:05,519

بنابراین این فاصله اقلیدسی و

97

00:04:05,519 –> 00:04:08,080

این تمام چیزی است که ما باید بدانیم تا

98

00:04:08,080 –> 00:04:11,920

k و n را پیاده سازی کنید پس بیایید شروع کنیم

99

00:04:11,920 –> 00:04:14,959

و ابتدا یک کلاس را تعریف می کنیم

100

00:04:14,959 –> 00:04:18,079

به نام knn و این دارد

101

00:04:18,079 –> 00:04:21,199

البته یک روش اولیه

102

00:04:21,199 –> 00:04:24,320

پس خود و این اراده

103

00:04:24,320 –> 00:04:28,080

یک k بگیرید پس این عدد است

104

00:04:28,080 –> 00:04:31,360

نزدیکترین همسایه هایی که می خواهیم در نظر بگیریم

105

00:04:31,360 –> 00:04:34,080

و این نیز یک مقدار پیش فرض دریافت می کند

106

00:04:34,080 –> 00:04:34,479

بنابراین

107

00:04:34,479 –> 00:04:37,919

پیش فرض سه و در

108

00:04:37,919 –> 00:04:43,520

شروع آه متاسفم

109

00:04:43,520 –> 00:04:46,560

ما init را تعریف می کنیم بنابراین در in it ما

110

00:04:46,560 –> 00:04:47,600

به سادگی می خواهم

111

00:04:47,600 –> 00:04:50,720

K را ذخیره کنید بنابراین می گوییم خود

112

00:04:50,720 –> 00:04:53,840

نقطه k برابر است با k

113

00:04:53,840 –> 00:04:56,720

و سپس آنچه می خواهیم در اینجا پیاده سازی کنیم

114

00:04:56,720 –> 00:04:57,440

ام

115

00:04:57,440 –> 00:04:58,880

و در اینجا ما می خواهیم به دنبال

116

00:04:58,880 –> 00:05:00,639

کنوانسیون های دیگر

117

00:05:00,639 –> 00:05:02,800

برای مثال کتابخانه های یادگیری ماشینی

118

00:05:02,800 –> 00:05:04,880

کتابخانه اسکیتی-یادگیری

119

00:05:04,880 –> 00:05:07,919

بنابراین ما یک

120

00:05:08,639 –> 00:05:13,440

روش فیت بنابراین این مناسب است

121

00:05:13,440 –> 00:05:17,280

نمونه های آموزشی و برخی

122

00:05:17,280 –> 00:05:20,560

ام ام برچسب های آموزشی و این خواهد شد

123

00:05:20,560 –> 00:05:24,960

معمولا شامل یک مرحله آموزشی است

124

00:05:24,960 –> 00:05:27,840

بنابراین ما می خواهیم این یکی را اجرا کنیم و

125

00:05:27,840 –> 00:05:29,280

سپس ما نیز می خواهیم

126

00:05:29,280 –> 00:05:33,120

اجرای یک روش پیش بینی

127

00:05:33,120 –> 00:05:36,639

متاسفم این هم خودش دارد

128

00:05:36,639 –> 00:05:39,600

و روش پیش بینی بنابراین در اینجا ما می خواهیم

129

00:05:39,600 –> 00:05:40,560

برای پیش بینی

130

00:05:40,560 –> 00:05:44,639

نمونه های جدید بنابراین این روش ها ما هستند

131

00:05:44,639 –> 00:05:46,320

می خواهند اجرا کنند

132

00:05:46,320 –> 00:05:50,080

و در حال حاضر قبل از اینکه اول از همه ادامه دهیم

133

00:05:50,080 –> 00:05:53,440

بیایید نگاهی بیندازیم به اینکه داده های ما چگونه به نظر می رسد

134

00:05:53,440 –> 00:05:53,840

بنابراین

135

00:05:53,840 –> 00:05:57,440

چگونه این x و این y چیست؟

136

00:05:57,440 –> 00:06:00,560

و برای این یک تست نوشتم

137

00:06:00,560 –> 00:06:04,560

اسکریپت بنابراین در اینجا از معروف استفاده می کنم

138

00:06:04,560 –> 00:06:07,759

مجموعه داده های عنبیه تا شاید شنیده باشید

139

00:06:07,759 –> 00:06:09,280

در مورد این قبلا

140

00:06:09,280 –> 00:06:12,880

بنابراین من می توانم این را از

141

00:06:12,880 –> 00:06:16,240

ماژول scikit-learn و سپس آن را انجام خواهم داد

142

00:06:16,240 –> 00:06:19,759

تولید چند نمونه آموزشی و برخی

143

00:06:19,759 –> 00:06:23,600

نمونه های تست و آموزش های مرتبط

144

00:06:23,600 –> 00:06:24,319

برچسب ها

145

00:06:24,319 –> 00:06:27,680

و برچسب های آزمایشی، بنابراین اجازه دهید ابتدا a

146

00:06:27,680 –> 00:06:30,639

ببین چطور این

147

00:06:30,639 –> 00:06:34,160

نمونه های آموزشی به نظر می رسد بنابراین ما می خواهیم

148

00:06:34,160 –> 00:06:34,880

چاپ کنید

149

00:06:34,880 –> 00:06:38,090

شکل این یکی

150

00:06:38,090 –> 00:06:39,440

[موسیقی]

151

00:06:39,440 –> 00:06:42,880

بنابراین این یک nd ناتوان است

152

00:06:42,880 –> 00:06:46,720

آرایه شکل 120

153

00:06:46,720 –> 00:06:50,720

در 4 پس 120 است

154

00:06:50,720 –> 00:06:54,800

تعداد نمونه و 4 عدد است

155

00:06:54,800 –> 00:06:57,039

ویژگی های هر نمونه

156

00:06:57,039 –> 00:07:00,880

به عنوان مثال بیایید چاپ کنیم

157

00:07:00,880 –> 00:07:04,639

اولین نمونه پس این است

158

00:07:04,639 –> 00:07:07,680

چهار ویژگی در آن است

159

00:07:07,680 –> 00:07:10,880

بنابراین نمونه های آموزشی ما اینگونه به نظر می رسند

160

00:07:10,880 –> 00:07:13,840

و حالا بیایید نگاهی به خودمان بیندازیم

161

00:07:13,840 –> 00:07:14,840

آموزش

162

00:07:14,840 –> 00:07:18,880

برچسب ها بنابراین

163

00:07:18,960 –> 00:07:22,240

این یک بردار ردیف 1 بعدی است

164

00:07:22,240 –> 00:07:25,759

همچنین از سایز 120 برای

165

00:07:25,759 –> 00:07:30,400

هر یک از نمونه های آموزشی خود را داریم

166

00:07:30,400 –> 00:07:33,520

برچسب برای آن بنابراین

167

00:07:33,520 –> 00:07:36,720

اگر این را چاپ کنیم، این اراده را می بینیم

168

00:07:36,720 –> 00:07:37,039

بودن

169

00:07:37,039 –> 00:07:42,000

یک بردار 1 بعدی با تنها یک ردیف

170

00:07:42,000 –> 00:07:45,360

و حالا بیایید آنچه را که در اینجا می بینیم ما هستیم

171

00:07:45,360 –> 00:07:46,800

دارند

172

00:07:46,800 –> 00:07:50,319

برچسب های 0 1 و 2. پس این یک است

173

00:07:50,319 –> 00:07:53,840

مشکل سه کلاس پس بیایید نیز

174

00:07:53,840 –> 00:07:58,240

طرح این ام و

175

00:07:58,240 –> 00:08:01,599

اکنون برای مثال آنچه من در اینجا طرح می کنم i است

176

00:08:01,599 –> 00:08:05,039

فقط دو مورد اول را ترسیم کنید

177

00:08:05,039 –> 00:08:08,319

ویژگی ها به طوری که ما یک 2d داشته باشیم

178

00:08:08,319 –> 00:08:12,240

مورد چنین است

179

00:08:12,240 –> 00:08:15,840

اینگونه به نظر می رسد که داده های ما در اختیار داریم

180

00:08:15,840 –> 00:08:18,960

سه کلاس قرمز سبز

181

00:08:18,960 –> 00:08:23,280

و آبی و آره

182

00:08:23,280 –> 00:08:25,919

بنابراین داده های ما اینگونه به نظر می رسند و اکنون ما

183

00:08:25,919 –> 00:08:27,360

می تواند ادامه دهد

184

00:08:27,360 –> 00:08:30,400

با اجرای این چنین است

185

00:08:30,400 –> 00:08:33,519

در روش مناسب ما بنابراین

186

00:08:33,519 –> 00:08:36,719

در الگوریتم k n اینطور نیست

187

00:08:36,719 –> 00:08:40,399

شامل یک مرحله آموزشی است بنابراین ما چه کار می کنیم

188

00:08:40,399 –> 00:08:42,559

در اینجا ما به سادگی می خواهیم

189

00:08:42,559 –> 00:08:45,600

نمونه های آموزشی ما را ذخیره کنید

190

00:08:45,600 –> 00:08:48,399

و بعداً می توانیم از آنها استفاده کنیم تا بتوانیم

191

00:08:48,399 –> 00:08:49,120

گفتن

192

00:08:49,120 –> 00:08:52,080

بیایید آنها را ذخیره کنیم پس بیایید بگوییم خود و

193

00:08:52,080 –> 00:08:53,200

سپس ما این را صدا می زنیم

194

00:08:53,200 –> 00:08:56,959

قطار x برابر با x است

195

00:08:56,959 –> 00:09:01,200

و خودت تمرین کن

196

00:09:01,200 –> 00:09:04,800

برابر y پس این همه است

197

00:09:04,800 –> 00:09:08,000

برای روش مناسب ما و اکنون برای ما

198

00:09:08,000 –> 00:09:11,440

پیش بینی روش بنابراین این خواهد شد

199

00:09:11,440 –> 00:09:14,480

get می تواند چندین برابر شود

200

00:09:14,480 –> 00:09:17,680

نمونه در اینجا بنابراین ما

201

00:09:17,680 –> 00:09:20,720

اوم می تواند این را ببیند زیرا ما

202

00:09:20,720 –> 00:09:23,760

برای این کار از x بزرگ استفاده می کنیم

203

00:09:23,760 –> 00:09:27,040

بنابراین این می تواند چندین نمونه داشته باشد

204

00:09:27,040 –> 00:09:29,839

بنابراین می توانیم یک روش کمکی کوچک بنویسیم

205

00:09:29,839 –> 00:09:31,600

بنابراین ما می خواهیم این کار را انجام دهیم

206

00:09:31,600 –> 00:09:35,120

هر یک از نمونه هایی که می خواهیم بگوییم ما هستیم

207

00:09:35,120 –> 00:09:35,680

خواستن

208

00:09:35,680 –> 00:09:39,440

پیش بینی شده را دریافت کنید

209

00:09:39,440 –> 00:09:42,480

برچسب ها برابر است

210

00:09:42,480 –> 00:09:47,200

و سپس استفاده می کنیم

211

00:09:47,200 –> 00:09:50,959

یا یک روش کمکی می نویسیم که ما

212

00:09:50,959 –> 00:09:54,000

پیش بینی خط خطی تماس بگیرید

213

00:09:54,000 –> 00:09:57,040

و این فقط یکی را دریافت می کند

214

00:09:57,040 –> 00:10:00,240

نمونه در اینجا

215

00:10:00,240 –> 00:10:02,959

ما از درک لیست استفاده می کنیم پس چه می کنیم

216

00:10:02,959 –> 00:10:04,079

می خواهم انجام دهم

217

00:10:04,079 –> 00:10:07,360

آیا ما می خواهیم این را خود بنامیم

218

00:10:07,360 –> 00:10:10,560

با یک نمونه پیش بینی کنید

219

00:10:10,560 –> 00:10:13,680

x و سپس می خواهیم این کار را برای

220

00:10:13,680 –> 00:10:18,000

همه نمونه های ما در ما

221

00:10:18,000 –> 00:10:21,440

um نمونه ها را در اینجا برای

222

00:10:21,440 –> 00:10:25,440

x کوچک با x بزرگ و سپس

223

00:10:25,440 –> 00:10:28,480

اوم این یک لیست خواهد بود

224

00:10:28,480 –> 00:10:33,680

بیایید این را به یک آرایه numpy و تبدیل کنیم

225

00:10:33,680 –> 00:10:37,680

سپس این روش پیش بینی ما است

226

00:10:37,680 –> 00:10:40,560

و البته ما باید numpy را وارد کنیم

227

00:10:40,560 –> 00:10:41,839

ما میگوییم

228

00:10:41,839 –> 00:10:46,480

وارد کردن numpy snp

229

00:10:46,480 –> 00:10:50,240

و اکنون خط زیر ما چگونه پیش بینی می کند

230

00:10:50,240 –> 00:10:53,519

روش اکنون به نظر می رسد

231

00:10:53,519 –> 00:10:57,200

دوباره بیایید نگاهی بیندازیم

232

00:10:57,200 –> 00:11:00,560

در شکل اینجا، پس ما چه می کنیم

233

00:11:00,560 –> 00:11:04,320

آیا می خواهیم محاسبه کنیم

234

00:11:04,320 –> 00:11:07,839

تمام فاصله ها و سپس یک

235

00:11:07,839 –> 00:11:08,959

نگاه کن به

236

00:11:08,959 –> 00:11:12,320

نزدیکترین همسایگان و برچسب های

237

00:11:12,320 –> 00:11:14,079

نزدیکترین همسایگان

238

00:11:14,079 –> 00:11:17,200

و سپس ما رای اکثریت و

239

00:11:17,200 –> 00:11:17,680

انتخاب کنید

240

00:11:17,680 –> 00:11:20,959

رایج ترین برچسب کلاس بنابراین

241

00:11:20,959 –> 00:11:23,519

بیایید ابتدا نظرات خود را در اینجا بنویسیم

242

00:11:23,519 –> 00:11:24,560

از همه

243

00:11:24,560 –> 00:11:29,519

ما می خواهیم فاصله ها را محاسبه کنیم

244

00:11:29,519 –> 00:11:32,720

سپس ما می خواهیم

245

00:11:32,720 –> 00:11:35,920

k نزدیکترین همسایه را بدست آورید

246

00:11:35,920 –> 00:11:39,440

بنابراین k نزدیکترین را دریافت کنید

247

00:11:39,440 –> 00:11:44,079

نمونه ها و ما می خواهیم آن را دریافت کنیم

248

00:11:44,079 –> 00:11:47,440

همچنین می خواهید برچسب ها را دریافت کنید و سپس

249

00:11:47,440 –> 00:11:50,959

ما یک دنیای بلوغ انجام می دهیم

250

00:11:50,959 –> 00:11:54,800

بنابراین ما می خواهیم رایج ترین را دریافت کنیم

251

00:11:54,800 –> 00:11:59,200

برچسب کلاس بنابراین

252

00:11:59,200 –> 00:12:02,240

بیایید این کار را انجام دهیم پس بیایید بگوییم

253

00:12:02,240 –> 00:12:05,680

فاصله ها برابر است

254

00:12:05,680 –> 00:12:09,279

و اکنون همانطور که گفتم از اقلیدسی استفاده می کنیم

255

00:12:09,279 –> 00:12:10,240

فاصله اینجا

256

00:12:10,240 –> 00:12:14,079

پس بیایید این را تعریف کنیم و ما می خواهیم

257

00:12:14,079 –> 00:12:17,600

این را به عنوان یک تابع جهانی تعریف کنید تا شما

258

00:12:17,600 –> 00:12:18,880

ممکن است بخواهد

259

00:12:18,880 –> 00:12:21,360

این را در یک فایل جداگانه بنویسید یا تماس بگیرید

260

00:12:21,360 –> 00:12:22,160

این

261

00:12:22,160 –> 00:12:25,200

در برخی از کلاس های ابزار بنابراین اینجا

262

00:12:25,200 –> 00:12:27,600

من به سادگی این کار را در همان فایل انجام خواهم داد

263

00:12:27,600 –> 00:12:28,959

من می گویم

264

00:12:28,959 –> 00:12:33,600

شما cli dn

265

00:12:33,600 –> 00:12:36,880

فاصله از

266

00:12:36,880 –> 00:12:39,920

دو بردار ویژگی پس بیایید بگوییم

267

00:12:39,920 –> 00:12:43,040

x1 و x2

268

00:12:43,040 –> 00:12:46,320

و اکنون دوباره اجازه دهید نگاهی به

269

00:12:46,320 –> 00:12:47,600

فرمول

270

00:12:47,600 –> 00:12:50,639

بنابراین این جذر و سپس آن است

271

00:12:50,639 –> 00:12:54,720

جمع در هر مجذور فاصله

272

00:12:54,720 –> 00:12:58,480

بنابراین ما جذر داریم تا بتوانیم بگوییم

273

00:12:58,480 –> 00:13:01,600

اوم ناپخت

274

00:13:01,600 –> 00:13:06,079

dot sqrt و سپس مجموع را داریم

275

00:13:06,079 –> 00:13:09,760

بنابراین میتوانیم از مجموع نقطهای numpy استفاده کنیم

276

00:13:09,760 –> 00:13:12,880

بنابراین این مبلغ را برای محاسبه می کند

277

00:13:12,880 –> 00:13:17,279

بیش از هر جزء بردار ویژگی um

278

00:13:17,279 –> 00:13:21,120

و در اینجا ما مربع را داریم

279

00:13:21,120 –> 00:13:24,639

تفاوت بنابراین می توانیم x one را بگوییم

280

00:13:24,639 –> 00:13:30,160

منهای x دو به توان دو

281

00:13:30,160 –> 00:13:33,040

بنابراین این تمام چیزی است که ما نیاز داریم و سپس می خواهیم

282

00:13:33,040 –> 00:13:35,360

برای برگرداندن این البته

283

00:13:35,360 –> 00:13:40,560

و اکنون در روش پیش بینی ما

284

00:13:40,959 –> 00:13:44,639

کاری که ما می خواهیم انجام دهیم این است

285

00:13:45,600 –> 00:13:48,560

ما می خواهیم فاصله های آن را محاسبه کنیم

286

00:13:48,560 –> 00:13:49,760

این

287

00:13:49,760 –> 00:13:53,600

یک نمونه جدید برای تمام آموزش ها

288

00:13:53,600 –> 00:13:54,720

نمونه ها بنابراین

289

00:13:54,720 –> 00:13:57,920

ما همچنین از درک لیست در اینجا استفاده می کنیم

290

00:13:57,920 –> 00:14:01,279

و ما به این فاصله اقلیدسی می گوییم

291

00:14:01,279 –> 00:14:04,880

با نمونه آزمایشی جدید ما

292

00:14:04,880 –> 00:14:08,639

بنابراین و سپس به هر یک از آموزش

293

00:14:08,639 –> 00:14:10,720

نمونه پس ما می گوییم کوچک است

294

00:14:10,720 –> 00:14:14,639

x قطار و سپس می خواهیم محاسبه کنیم

295

00:14:14,639 –> 00:14:15,040

این

296

00:14:15,040 –> 00:14:18,560

برای x قطار در

297

00:14:18,560 –> 00:14:21,760

بزرگ یا به صورت خود نقطه

298

00:14:21,760 –> 00:14:25,199

قطار x بنابراین اکنون داریم

299

00:14:25,199 –> 00:14:28,240

تمام فاصله ها و

300

00:14:28,240 –> 00:14:31,839

اکنون می خواهیم k نزدیکترین را بدست آوریم

301

00:14:31,839 –> 00:14:34,959

نمونه ها و برچسب ها

302

00:14:34,959 –> 00:14:38,880

بنابراین کاری که ما اینجا انجام می دهیم این است

303

00:14:38,880 –> 00:14:42,000

فاصله هایمان را مرتب می کنیم

304

00:14:42,000 –> 00:14:45,279

و ما می توانیم این کار را انجام دهیم

305

00:14:45,279 –> 00:14:49,120

پس بیایید این را k بنامیم

306

00:14:49,120 –> 00:14:51,839

شاخص ها

307

00:14:52,160 –> 00:14:55,279

و این و اینجا از numpy استفاده می کنیم

308

00:14:55,279 –> 00:14:58,320

مرتب سازی قوس نقطه ای

309

00:14:58,320 –> 00:15:01,680

بنابراین این فاصله ها را مرتب می کند

310

00:15:01,680 –> 00:15:04,959

و باز خواهد گشت

311

00:15:04,959 –> 00:15:09,120

شاخص هایی از نحوه طبقه بندی این

312

00:15:09,120 –> 00:15:12,240

بنابراین در اینجا ما تماس می گیریم

313

00:15:12,240 –> 00:15:16,240

فواصل و این خواهد بود

314

00:15:16,240 –> 00:15:19,920

آرایه و ما نیز فقط می خواهیم

315

00:15:19,920 –> 00:15:23,839

بنابراین می خواهید k نزدیکترین نمونه را داشته باشید

316

00:15:23,839 –> 00:15:27,920

بیایید از برش در اینجا استفاده کنیم و شروع کنیم

317

00:15:27,920 –> 00:15:31,120

در ابتدا تا صفر یا می توانیم حذف کنیم

318

00:15:31,120 –> 00:15:32,000

این

319

00:15:32,000 –> 00:15:35,519

و این همه فقط تا زمانی که خود نقطه است پیش می رود

320

00:15:35,519 –> 00:15:39,600

k پس این خواهد بود

321

00:15:39,600 –> 00:15:43,600

شاخص های k نزدیکترین

322

00:15:43,600 –> 00:15:47,040

نمونه ها و حالا بیایید برچسب ها را دریافت کنیم

323

00:15:47,040 –> 00:15:51,120

بنابراین ما k را دریافت می کنیم

324

00:15:51,120 –> 00:15:54,639

نزدیکترین برچسب ها

325

00:15:54,639 –> 00:15:57,759

برابر است و در اینجا ما می توانیم

326

00:15:57,759 –> 00:16:01,120

ما همچنین از درک لیست استفاده می کنیم

327

00:16:01,120 –> 00:16:04,800

و سپس برچسب هر کدام را می گیریم

328

00:16:04,800 –> 00:16:08,160

آموزش و برچسب زدن با این

329

00:16:08,160 –> 00:16:11,600

در شاخص پس شاخص

330

00:16:11,600 –> 00:16:14,720

من و سپس برای من

331

00:16:14,720 –> 00:16:18,000

در k شاخص

332

00:16:18,000 –> 00:16:21,360

بنابراین اکنون ما برچسب های نزدیکترین خود را داریم

333

00:16:21,360 –> 00:16:22,079

همسایه ها

334

00:16:22,079 –> 00:16:25,680

و سپس از یک رای بلوغ استفاده می کنیم و می گیریم

335

00:16:25,680 –> 00:16:27,759

رایج ترین برچسب کلاس

336

00:16:27,759 –> 00:16:31,680

بنابراین بیایید این را رایج ترین بنامیم

337

00:16:31,680 –> 00:16:35,600

برابر است و برای این از دیگری استفاده می کنیم

338

00:16:35,600 –> 00:16:38,800

ماژول پایتون بنابراین ما از

339

00:16:38,800 –> 00:16:42,560

ماژول شمارنده پس می گوییم

340

00:16:42,560 –> 00:16:46,399

از واردات مجموعه ها

341

00:16:46,399 –> 00:16:50,959

شمارنده و سپس ام

342

00:16:50,959 –> 00:16:54,720

ما دریافت می کنیم

343

00:16:54,720 –> 00:16:57,759

یا یک شمارنده می گیریم

344

00:16:57,759 –> 00:17:01,600

از k نزدیکترین برچسب

345

00:17:01,600 –> 00:17:05,039

و سپس این روشی است به نام

346

00:17:05,039 –> 00:17:08,640

رایج ترین و ما فقط می خواهیم داشته باشیم

347

00:17:08,640 –> 00:17:13,359

اولین یا بسیار رایج ترین

348

00:17:13,359 –> 00:17:17,760

اوم و حالا بیایید نگاهی بیندازیم که این چگونه است

349

00:17:17,760 –> 00:17:18,720

به نظر می رسد

350

00:17:18,720 –> 00:17:22,000

پس اگر این را نظر بدهم

351

00:17:22,000 –> 00:17:25,119

بیایید یک مثال کوتاه بنویسیم

352

00:17:25,119 –> 00:17:27,599

چه مجموعه ها یا پیشخوان

353

00:17:27,599 –> 00:17:28,720

ماژول انجام خواهد داد

354

00:17:28,720 –> 00:17:32,240

بنابراین بیایید بگوییم ما یک لیست برابر داریم

355

00:17:32,240 –> 00:17:35,919

و این برخی از ارزش ها در آن است بنابراین یک

356

00:17:35,919 –> 00:17:39,679

یکی دو دو و بعد یکی دیگر

357

00:17:39,679 –> 00:17:42,720

برچسب ها و غیره نیز از

358

00:17:42,720 –> 00:17:47,440

شمارنده واردات مجموعه ها

359

00:17:47,440 –> 00:17:51,360

و اکنون ما رایج ترین را دریافت می کنیم

360

00:17:51,360 –> 00:17:54,960

برابر است

361

00:17:54,960 –> 00:17:58,240

ما یک شمارنده از این لیست ایجاد می کنیم

362

00:17:58,240 –> 00:18:01,760

و سپس یکی از رایج ترین

363

00:18:01,760 –> 00:18:06,559

پس بیایید این را چاپ کنیم

364

00:18:09,840 –> 00:18:13,440

پس مجبورم

365

00:18:13,440 –> 00:18:18,160

ابتدا این را ببندید، پس بیایید دوباره آن را اجرا کنیم

366

00:18:22,880 –> 00:18:26,080

بنابراین این یک لیست خواهد بود

367

00:18:26,080 –> 00:18:29,440

و پس از آن ما یک تاپیک از بیشتر داریم

368

00:18:29,440 –> 00:18:32,720

آیتم های رایج بنابراین برای مثال اگر ما

369

00:18:32,720 –> 00:18:35,120

در این مورد ما فقط می خواهیم

370

00:18:35,120 –> 00:18:36,240

یکی را داشته باش

371

00:18:36,240 –> 00:18:39,280

یکی از رایج ترین موارد و این است

372

00:18:39,280 –> 00:18:40,080

چندتایی

373

00:18:40,080 –> 00:18:43,360

و اولین مورد در اینجا

374

00:18:43,360 –> 00:18:46,640

رایج ترین مورد است بنابراین این است

375

00:18:46,640 –> 00:18:49,760

یکی و مورد دوم است

376

00:18:49,760 –> 00:18:52,720

تعداد دفعاتی که این در لیست ما قرار دارد

377

00:18:52,720 –> 00:18:53,600

سه بار

378

00:18:53,600 –> 00:18:56,880

یکی پس برای مثال اگر از دو استفاده می کنید

379

00:18:56,880 –> 00:18:58,320

آن را نیز خواهد کرد

380

00:18:58,320 –> 00:19:00,799

در دومین مورد رایج قرار دهید

381

00:19:00,799 –> 00:19:02,000

این مورد است

382

00:19:02,000 –> 00:19:05,520

دو و ما دو برابر دو داریم پس فقط داریم

383

00:19:05,520 –> 00:19:06,720

خواستن

384

00:19:06,720 –> 00:19:10,080

یکی از رایج ترین آنها همانطور که گفتم این یک است

385

00:19:10,080 –> 00:19:13,840

برای به دست آوردن اولین مورد، آن را فهرست کنید

386

00:19:13,840 –> 00:19:17,200

موردی که ما از آن استفاده می کنیم

387

00:19:17,200 –> 00:19:21,039

شاخص صفر است، بنابراین اکنون ما تاپل را داریم

388

00:19:21,039 –> 00:19:24,400

و حالا دوباره اقلام واقعی را دریافت کنید

389

00:19:24,400 –> 00:19:28,960

ما از اولین شاخص استفاده می کنیم و سپس داریم

390

00:19:28,960 –> 00:19:33,039

یکی پس اینجا ما باید همین کار را انجام دهیم

391

00:19:33,039 –> 00:19:35,280

و ما می خواهیم این را برگردانیم پس بیایید

392

00:19:35,280 –> 00:19:36,080

برگشت

393

00:19:36,080 –> 00:19:39,520

رایج ترین شاخص صفر

394

00:19:39,520 –> 00:19:43,360

از شاخص صفر و این است

395

00:19:43,360 –> 00:19:46,799

تمام اجرای ما از k

396

00:19:46,799 –> 00:19:50,080

n الگوریتم بنابراین

397

00:19:50,080 –> 00:19:54,480

بیایید این را امتحان کنیم تا

398

00:19:54,960 –> 00:19:58,480

بیایید در نمونه آزمایشی خود که قبلاً انجام دادیم

399

00:19:58,480 –> 00:19:59,440

ما را داشته باشید

400

00:19:59,440 –> 00:20:01,760

ما قبلاً فایل آزمایشی خود را داریم

401

00:20:01,760 –> 00:20:02,799

آموزش

402

00:20:02,799 –> 00:20:06,000

و نمونه های آزمایشی را انجام دهید

403

00:20:06,000 –> 00:20:09,679

از ما استفاده کنید

404

00:20:09,679 –> 00:20:12,880

k n کلاس بنابراین می توانیم بگوییم از

405

00:20:12,880 –> 00:20:16,159

k n واردات k

406

00:20:16,159 –> 00:20:20,799

n و سپس یک طبقه بندی کننده ایجاد کنید تا clf

407

00:20:20,799 –> 00:20:24,400

برابر k n است

408

00:20:24,400 –> 00:20:27,760

و بنابراین بیایید از k استفاده کنیم

409

00:20:27,760 –> 00:20:30,799

برابر با سه و سپس

410

00:20:30,799 –> 00:20:34,080

ما می خواهیم ابتدا متد فیت را بنامیم

411

00:20:34,080 –> 00:20:34,880

ما می خواهیم که

412

00:20:34,880 –> 00:20:38,240

مناسب قطار x ما

413

00:20:38,240 –> 00:20:42,240

و قطار y

414

00:20:42,240 –> 00:20:45,600

و سپس پیش بینی ها را دریافت می کنیم

415

00:20:45,600 –> 00:20:49,600

و این مانند این است که ما این کار را انجام می دهیم

416

00:20:49,600 –> 00:20:53,520

تماس clf dot

417

00:20:53,520 –> 00:20:57,360

پیش بینی کنید و سپس می خواهیم پیش بینی کنیم

418

00:20:57,360 –> 00:21:00,480

نمونه های آزمایشی ما

419

00:21:00,480 –> 00:21:03,600

بنابراین x تست

420

00:21:03,600 –> 00:21:07,360

و حالا بیایید دقت را محاسبه کنیم

421

00:21:07,360 –> 00:21:10,720

بنابراین دقت بنابراین این

422

00:21:10,720 –> 00:21:14,840

با تعداد ما تعریف می شود

423

00:21:14,840 –> 00:21:17,200

پیش بینی ها درست است

424

00:21:17,200 –> 00:21:20,400

طبقه بندی شده پس این است

425

00:21:20,400 –> 00:21:23,790

بنابراین در اینجا ما از جمع استفاده می کنیم

426

00:21:23,790 –> 00:21:26,990

[موسیقی]

427

00:21:27,440 –> 00:21:32,000

جمع و اینجا می نویسیم

428

00:21:32,000 –> 00:21:36,400

پیش بینی ها برابر است

429

00:21:36,400 –> 00:21:39,760

تست y برای

430

00:21:39,760 –> 00:21:43,360

هر پیش بینی که هست

431

00:21:43,360 –> 00:21:46,400

حق یا همان صحیح

432

00:21:46,400 –> 00:21:47,120

برچسب

433

00:21:47,120 –> 00:21:50,880

یکی اضافه می کند و سپس ما

434

00:21:50,880 –> 00:21:54,159

این را بر تعداد تقسیم کنید

435

00:21:54,159 –> 00:21:58,720

نمونه های آزمایشی بنابراین ما این را بر تقسیم می کنیم

436

00:21:58,720 –> 00:22:01,760

lang y

437

00:22:01,760 –> 00:22:08,080

تست کنید و بیایید دقت خود را چاپ کنیم

438

00:22:10,240 –> 00:22:13,679

و ببینید که آیا این کار می کند تا بله در این

439

00:22:13,679 –> 00:22:14,400

مورد آن است

440

00:22:14,400 –> 00:22:17,919

1.0 بنابراین همه پیش بینی های ما

441

00:22:17,919 –> 00:22:22,159

آیا درست است پس بیایید استفاده کنیم

442

00:22:22,159 –> 00:22:26,240

تعداد دیگری از همسایگان بنابراین

443

00:22:26,240 –> 00:22:29,360

k برابر است با پنج، بنابراین معمولاً می خواهید استفاده کنید

444

00:22:29,360 –> 00:22:29,600

یک

445

00:22:29,600 –> 00:22:34,640

عدد فرد در اینجا، پس بیایید این را اجرا کنیم

446

00:22:34,880 –> 00:22:38,480

اوه متاسفم پس در این مورد این نکته است

447

00:22:38,480 –> 00:22:41,520

نه شش تا

448

00:22:41,520 –> 00:22:43,679

نه به خوبی با سه همسایه اما

449

00:22:43,679 –> 00:22:45,039

همچنین بسیار خوب

450

00:22:45,039 –> 00:22:47,440

و بله، ما می بینیم که این کار می کند و

451

00:22:47,440 –> 00:22:48,960

این کل ماست

452

00:22:48,960 –> 00:22:52,400

اجرای k n و بله i

453

00:22:52,400 –> 00:22:54,240

امیدوارم از این آموزش لذت برده باشید

454

00:22:54,240 –> 00:22:58,720

و شما را در آموزش بعدی می بینم خداحافظ

455

00:23:02,880 –> 00:23:05,440

سلام به همه به یک آموزش جدید خوش آمدید

456

00:23:05,440 –> 00:23:07,280

این دومین ویدیو از دستگاه است

457

00:23:07,280 –> 00:23:10,080

مجموعه آموزش های یادگیری از ابتدا

458

00:23:10,080 –> 00:23:12,080

در این مجموعه قصد داریم اجرا کنیم

459

00:23:12,080 –> 00:23:14,000

الگوریتم های محبوب یادگیری ماشینی

460

00:23:14,000 –> 00:23:16,400

فقط با استفاده از ماژول های داخلی پایتون و

461

00:23:16,400 –> 00:23:19,039

numpy امروز می خواهیم پیاده سازی کنیم

462

00:23:19,039 –> 00:23:21,280

الگوریتم رگرسیون خطی

463

00:23:21,280 –> 00:23:23,039

پس بیایید در مورد مفهوم صحبت کنیم

464

00:23:23,039 –> 00:23:24,799

ابتدا رگرسیون خطی

465

00:23:24,799 –> 00:23:26,880

بنابراین در رگرسیون می خواهیم پیش بینی کنیم

466

00:23:26,880 –> 00:23:28,880

مقادیر پیوسته

467

00:23:28,880 –> 00:23:30,960

در حالی که در طبقه بندی می خواهیم

468

00:23:30,960 –> 00:23:32,799

یک مقدار گسسته را پیش بینی کنید

469

00:23:32,799 –> 00:23:36,240

مانند برچسب کلاس 0 یا 1. بنابراین اگر داشته باشیم

470

00:23:36,240 –> 00:23:38,320

نگاهی به این طرح نمونه

471

00:23:38,320 –> 00:23:41,600

سپس داده هایمان آبی است

472

00:23:41,600 –> 00:23:44,320

نقطه ها و ما می خواهیم این را تقریبی کنیم

473

00:23:44,320 –> 00:23:45,840

داده ها با یک خطی

474

00:23:45,840 –> 00:23:47,919

تابع به همین دلیل خطی نامیده می شود

475

00:23:47,919 –> 00:23:49,120

پسرفت

476

00:23:49,120 –> 00:23:52,799

بنابراین از یک تابع خطی برای پیش بینی استفاده می کنیم

477

00:23:52,799 –> 00:23:54,720

ارزش ها

478

00:23:54,720 –> 00:23:58,240

بنابراین می توانیم تقریب را به صورت تعریف کنیم

479

00:23:58,240 –> 00:24:01,520

y-hat برابر w بار است

480

00:24:01,520 –> 00:24:06,240

x به علاوه b پس این معادله خط a است

481

00:24:06,240 –> 00:24:10,240

جایی که w یا وزن های ما شیب است

482

00:24:10,240 –> 00:24:13,760

و b سوگیری یا فقط تغییر است

483

00:24:13,760 –> 00:24:17,520

در امتداد محور y در حالت 2d

484

00:24:17,520 –> 00:24:20,480

بنابراین این تقریب است و اکنون ما

485

00:24:20,480 –> 00:24:22,000

باید به این موضوع برسند

486

00:24:22,000 –> 00:24:26,720

w و b و چگونه این را پیدا کنیم

487

00:24:26,720 –> 00:24:29,840

بنابراین برای این ما یک تابع هزینه تعریف می کنیم

488

00:24:29,840 –> 00:24:31,919

و در رگرسیون خطی این است

489

00:24:31,919 –> 00:24:33,919

خطای میانگین مربعات

490

00:24:33,919 –> 00:24:37,840

بنابراین این تفاوت است

491

00:24:37,840 –> 00:24:40,960

بین ارزش واقعی

492

00:24:40,960 –> 00:24:44,400

و مقدار تقریبی تا واقعی است

493

00:24:44,400 –> 00:24:46,080

ارزش برای این ما نیاز داریم

494

00:24:46,080 –> 00:24:49,360

نمونه های آموزشی و سپس این را مربع می کنیم

495

00:24:49,360 –> 00:24:50,240

تفاوت

496

00:24:50,240 –> 00:24:53,120

و جمع آوری تمام نمونه ها و سپس

497

00:24:53,120 –> 00:24:55,520

تقسیم بر تعداد نمونه به این ترتیب

498

00:24:55,520 –> 00:24:56,960

روشی که ما به میانگین می رسیم

499

00:24:56,960 –> 00:25:00,000

خطا این هزینه است

500

00:25:00,000 –> 00:25:03,279

تابع پس این خطا است

501

00:25:03,279 –> 00:25:06,559

و البته ما می خواهیم خطا داشته باشیم

502

00:25:06,559 –> 00:25:07,440

به اندازه کوچک

503

00:25:07,440 –> 00:25:10,400

تا حد امکان، بنابراین ما باید آن را پیدا کنیم

504

00:25:10,400 –> 00:25:12,159

حداقل این تابع

505

00:25:12,159 –> 00:25:15,120

و چگونه حداقل را برای آن پیدا کنیم

506

00:25:15,120 –> 00:25:16,240

این ما نیاز داریم

507

00:25:16,240 –> 00:25:18,960

برای محاسبه مشتق یا

508

00:25:18,960 –> 00:25:20,400

شیب

509

00:25:20,400 –> 00:25:23,440

بنابراین ما گرادیان هزینه خود را محاسبه می کنیم

510

00:25:23,440 –> 00:25:25,840

تابع با توجه به w

511

00:25:25,840 –> 00:25:29,039

و با توجه به ب

512

00:25:29,039 –> 00:25:32,000

بنابراین این فرمول گرادیان است

513

00:25:32,000 –> 00:25:32,480

لطفا

514

00:25:32,480 –> 00:25:34,799

این را برای خودتان بررسی کنید و من نیز انجام خواهم داد

515

00:25:34,799 –> 00:25:37,120

چند لینک در توضیحات با

516

00:25:37,120 –> 00:25:38,640

برخی از خواندن های بیشتر

517

00:25:38,640 –> 00:25:42,159

اما اکنون وارد جزئیات نمی شوم

518

00:25:42,159 –> 00:25:45,520

و اکنون با این گرادیان از a استفاده می کنیم

519

00:25:45,520 –> 00:25:47,679

تکنیکی که گرادیان نامیده می شود

520

00:25:47,679 –> 00:25:48,960

نزول

521

00:25:48,960 –> 00:25:52,080

بنابراین این یک روش تکراری برای رسیدن به آن است

522

00:25:52,080 –> 00:25:53,360

حداقل

523

00:25:53,360 –> 00:25:56,159

بنابراین اگر ما هدف یا هزینه خود را داشته باشیم

524

00:25:56,159 –> 00:25:57,600

در اینجا عملکرد کنید

525

00:25:57,600 –> 00:26:00,679

سپس از جایی شروع می کنیم تا مقداری داشته باشیم

526

00:26:00,679 –> 00:26:02,000

مقداردهی اولیه

527

00:26:02,000 –> 00:26:05,039

از وزنه ها و تعصب

528

00:26:05,039 –> 00:26:07,360

و سپس ما می خواهیم وارد آن شویم

529

00:26:07,360 –> 00:26:08,240

جهت

530

00:26:08,240 –> 00:26:11,919

از تندترین فرود و تندترین

531

00:26:11,919 –> 00:26:14,400

نزول نیز شیب است

532

00:26:14,400 –> 00:26:16,799

بنابراین می خواهیم به سمتی برویم

533

00:26:16,799 –> 00:26:17,520

را

534

00:26:17,520 –> 00:26:19,919

در جهت منفی از

535

00:26:19,919 –> 00:26:21,440

شیب

536

00:26:21,440 –> 00:26:23,919

و ما این کار را تکراری انجام می دهیم تا زمانی که ما

537

00:26:23,919 –> 00:26:24,559

سرانجام

538

00:26:24,559 –> 00:26:27,919

رسیدن به حداقل و با هر

539

00:26:27,919 –> 00:26:31,520

تکرار ما یک قانون به روز رسانی برای آن داریم

540

00:26:31,520 –> 00:26:32,480

وزن های جدید

541

00:26:32,480 –> 00:26:35,520

و سوگیری جدید بنابراین جدید

542

00:26:35,520 –> 00:26:39,360

w منهای w قدیمی است

543

00:26:39,360 –> 00:26:42,559

آلفا برابر مشتق است

544

00:26:42,559 –> 00:26:45,200

منهای زیرا ما می خواهیم وارد آن شویم

545

00:26:45,200 –> 00:26:47,360

جهت منفی

546

00:26:47,360 –> 00:26:50,480

و سپس این آلفا به اصطلاح است

547

00:26:50,480 –> 00:26:53,279

نرخ یادگیری و این مهم است

548

00:26:53,279 –> 00:26:55,120

پارامتر برای مدل ما

549

00:26:55,120 –> 00:26:58,799

بنابراین نرخ یادگیری تعیین می کند که چقدر فاصله دارد

550

00:26:58,799 –> 00:27:01,600

تا چه اندازه به این سمت می رویم

551

00:27:01,600 –> 00:27:03,440

با هر مرحله تکرار

552

00:27:03,440 –> 00:27:05,600

بنابراین برای مثال اگر از یک کوچک استفاده می کنید

553

00:27:05,600 –> 00:27:06,880

میزان یادگیری

554

00:27:06,880 –> 00:27:09,279

سپس ممکن است بیشتر طول بکشد اما می تواند

555

00:27:09,279 –> 00:27:10,159

سرانجام

556

00:27:10,159 –> 00:27:13,279

به حداقل برسد و اگر برسیم یا اگر

557

00:27:13,279 –> 00:27:13,919

شما از a استفاده می کنید

558

00:27:13,919 –> 00:27:16,159

نرخ یادگیری بالا در آن صورت ممکن است باشد

559

00:27:16,159 –> 00:27:17,919

سریعتر اما ممکن است

560

00:27:17,919 –> 00:27:20,480

اینجوری بپر و هیچوقت پیداش نکن

561

00:27:20,480 –> 00:27:21,600

کمترین

562

00:27:21,600 –> 00:27:24,320

بنابراین این یک پارامتر مهم است که

563

00:27:24,320 –> 00:27:25,760

باید مشخص کنیم

564

00:27:25,760 –> 00:27:28,799

و لطفا این را در نظر داشته باشید

565

00:27:28,799 –> 00:27:33,760

بنابراین اکنون که قوانین به روز رسانی خود را می دانیم

566

00:27:33,760 –> 00:27:36,080

من فرمول ها را نوشته ام

567

00:27:36,080 –> 00:27:38,159

مشتقات دوباره اینجا

568

00:27:38,159 –> 00:27:41,600

و سپس

569

00:27:41,600 –> 00:27:44,640

آنها را کمی ساده کنید لطفا بررسی کنید

570

00:27:44,640 –> 00:27:46,320

که برای خودت

571

00:27:46,320 –> 00:27:48,640

بنابراین اینها فرمول های به روز رسانی هستند

572

00:27:48,640 –> 00:27:50,240

قوانین و مشتقات

573

00:27:50,240 –> 00:27:52,960

و این تنها چیزی است که اکنون باید بدانیم

574

00:27:52,960 –> 00:27:54,799

می توانیم شروع کنیم

575

00:27:54,799 –> 00:27:58,480

خب حالا بیایید کلاسی به نام تعریف کنیم

576

00:27:58,480 –> 00:28:02,799

رگرسیون خطی و این اراده

577

00:28:02,799 –> 00:28:06,480

البته روش init داره

578

00:28:06,480 –> 00:28:10,000

یا در آن دو خط زیر خط بکشید و سپس آن را

579

00:28:10,000 –> 00:28:10,320

دارد

580

00:28:10,320 –> 00:28:13,279

خود و میزان یادگیری را می گیرد و i

581

00:28:13,279 –> 00:28:14,399

این را خواهد داد

582

00:28:14,399 –> 00:28:17,440

مقدار پیش فرض پس معمولاً این است

583

00:28:17,440 –> 00:28:21,480

مقدار بسیار کمی است، بنابراین من آن را می دهم

584

00:28:21,480 –> 00:28:25,039

0.001 و سپس به آن یک عدد می دهم

585

00:28:25,039 –> 00:28:26,640

از تکرارها

586

00:28:26,640 –> 00:28:29,279

بنابراین ما از چند تکرار در خود استفاده می کنیم

587

00:28:29,279 –> 00:28:31,440

روش شیب مناسب

588

00:28:31,440 –> 00:28:34,880

و من همچنین به این um یک پیش فرض می دهم

589

00:28:34,880 –> 00:28:38,080

ارزش بنابراین من می گویم این 1000 است

590

00:28:38,080 –> 00:28:40,320

و سپس من به سادگی آنها را در اینجا ذخیره می کنم

591

00:28:40,320 –> 00:28:42,080

پس من خودم می گویم

592

00:28:42,080 –> 00:28:45,120

lr برابر lr و

593

00:28:45,120 –> 00:28:48,880

خود و اضافه کننده ها

594

00:28:48,880 –> 00:28:52,399

برابر و تکرار و سپس

595

00:28:52,399 –> 00:28:55,360

بعداً باید به آن بیایم

596

00:28:55,360 –> 00:28:56,080

وزنه ها

597

00:28:56,080 –> 00:28:58,240

اما در اینجا در آغاز من به سادگی

598

00:28:58,240 –> 00:28:59,279

خود بگو

599

00:28:59,279 –> 00:29:03,520

وزن برابر است با هیچ و تعصب

600

00:29:03,520 –> 00:29:07,760

مساوی هیچ و سپس باید تعریف کنیم

601

00:29:07,760 –> 00:29:10,399

دو تابع و ما به دنبال

602

00:29:10,399 –> 00:29:12,640

کنوانسیون های دیگر یادگیری ماشینی

603

00:29:12,640 –> 00:29:14,159

کتابخانه های اینجا

604

00:29:14,159 –> 00:29:17,440

بنابراین ما یک روش مناسب تعریف می کنیم

605

00:29:17,440 –> 00:29:20,880

که نمونه های آموزشی را می گیرد

606

00:29:20,880 –> 00:29:24,240

و برچسب برای آنها بنابراین این خواهد شد

607

00:29:24,240 –> 00:29:26,320

شامل مرحله آموزش و

608

00:29:26,320 –> 00:29:28,559

شیب نزول

609

00:29:28,559 –> 00:29:33,600

و سپس یک روش پیش بینی تعریف می کنیم

610

00:29:33,600 –> 00:29:37,279

پس وقتی جدید شد

611

00:29:37,279 –> 00:29:40,480

نمونه های آزمایشی سپس می تواند تقریبی باشد

612

00:29:40,480 –> 00:29:41,039

ارزش

613

00:29:41,039 –> 00:29:43,440

و مقدار را برگردانید بنابراین اینها هستند

614

00:29:43,440 –> 00:29:44,159

کارکرد

615

00:29:44,159 –> 00:29:48,320

باید اجرا کنیم و قبل از رفتن

616

00:29:48,320 –> 00:29:51,120

اجازه دهید نگاهی گذرا به داده های x داشته باشیم

617

00:29:51,120 –> 00:29:51,840

و y

618

00:29:51,840 –> 00:29:54,880

بنابراین چگونه به نظر می رسد و برای این من

619

00:29:54,880 –> 00:29:56,000

کمی نوشته است

620

00:29:56,000 –> 00:29:59,200

نمونه اسکریپت و من از آن استفاده می کنم

621

00:29:59,200 –> 00:30:02,080

ماژول scikit-learn برای تولید مقداری

622

00:30:02,080 –> 00:30:03,919

داده های نمونه

623

00:30:03,919 –> 00:30:06,720

و من داده ها را به آموزش تقسیم می کنم

624

00:30:06,720 –> 00:30:07,600

و

625

00:30:07,600 –> 00:30:11,600

نمونه های تست و همچنین آموزش و تست

626

00:30:11,600 –> 00:30:15,279

برچسب ها پس اول از همه بیایید a

627

00:30:15,279 –> 00:30:19,360

نگاه کنید که این داده ها چگونه به نظر می رسند

628

00:30:19,360 –> 00:30:22,399

بنابراین در اینجا طرح است

629

00:30:22,399 –> 00:30:24,720

داده های ما اینگونه به نظر می رسد و اکنون ما

630

00:30:24,720 –> 00:30:25,760

می خواهند پیدا کنند

631

00:30:25,760 –> 00:30:29,520

یک تابع در جایی اینجا

632

00:30:29,520 –> 00:30:33,600

که به مقدار تقریبی می رسد

633

00:30:33,600 –> 00:30:36,720

و اجازه دهید نگاهی به

634

00:30:36,720 –> 00:30:40,880

شکل x و y ما بنابراین

635

00:30:40,880 –> 00:30:43,840

بیایید این را اجرا کنیم و حالا من این را نمی خواهم

636

00:30:43,840 –> 00:30:46,720

دیگر اینجا نقشه بکش

637

00:30:46,720 –> 00:30:50,000

اوم پس

638

00:30:50,000 –> 00:30:53,200

اگر ببینیم که x ما

639

00:30:53,200 –> 00:30:56,480

آرایه دوم از اندازه است

640

00:30:56,480 –> 00:31:00,720

80 در 1 و این به این دلیل است که i

641

00:31:00,720 –> 00:31:05,120

در اینجا قرار دهید من می خواهم 100 نمونه داشته باشم

642

00:31:05,120 –> 00:31:08,720

و یک ویژگی برای هر نمونه

643

00:31:08,720 –> 00:31:10,799

و سپس من این را تقسیم می کنم

644

00:31:10,799 –> 00:31:13,840

فقط نمونه های آموزشی

645

00:31:13,840 –> 00:31:18,399

دارای 80 نمونه در آن است، بنابراین این یک دوم است

646

00:31:18,399 –> 00:31:22,080

آرایه سایز 80 در یک و ما

647

00:31:22,080 –> 00:31:25,919

برچسب های آموزشی فقط 1d است

648

00:31:25,919 –> 00:31:29,360

وکتور ردیف نیز در سایز 80

649

00:31:29,360 –> 00:31:32,799

بنابراین برای هر نمونه آموزشی یک نمونه داریم

650

00:31:32,799 –> 00:31:36,399

ارزش پس داده های ما اینگونه به نظر می رسند و

651

00:31:36,399 –> 00:31:37,440

حالا وقته

652

00:31:37,440 –> 00:31:40,000

ادامه دهید پس بیایید تناسب را اجرا کنیم

653

00:31:40,000 –> 00:31:41,120

روش

654

00:31:41,120 –> 00:31:44,399

بنابراین همانطور که گفتم باید آن را پیاده سازی کنیم

655

00:31:44,399 –> 00:31:46,159

روش نزول گرادیان

656

00:31:46,159 –> 00:31:49,360

اینجا و شیب نزول

657

00:31:49,360 –> 00:31:52,799

همیشه باید از جایی شروع کنیم بنابراین ما

658

00:31:52,799 –> 00:31:54,279

نیاز به داشتن مقداری

659

00:31:54,279 –> 00:31:57,840

مقداردهی اولیه بنابراین

660

00:31:57,840 –> 00:32:01,840

بیایید انجام دهیم اجازه دهید ما را راه اندازی کنیم

661

00:32:01,840 –> 00:32:05,360

پارامترها و برای این ابتدا بیایید دریافت کنیم

662

00:32:05,360 –> 00:32:06,399

را

663

00:32:06,399 –> 00:32:10,159

تعداد نمونه و تعداد

664

00:32:10,159 –> 00:32:13,279

ویژگی ها و ما می توانیم این را دریافت کنیم

665

00:32:13,279 –> 00:32:14,159

گفتن این است

666

00:32:14,159 –> 00:32:18,000

شکل نقطه x و سپس

667

00:32:18,000 –> 00:32:20,480

ما به سادگی تمام وزن ها را مقداردهی اولیه می کنیم

668

00:32:20,480 –> 00:32:21,600

با صفر

669

00:32:21,600 –> 00:32:24,880

بنابراین می توان گفت وزن خود برابر است

670

00:32:24,880 –> 00:32:28,399

صفرهای ناقص

671

00:32:28,399 –> 00:32:31,600

از نظر اندازه و ویژگی

672

00:32:31,600 –> 00:32:34,720

و ویژگی های بنابراین برای هر جزء ما

673

00:32:34,720 –> 00:32:35,519

قرار دادن در a

674

00:32:35,519 –> 00:32:38,880

صفر و خود. تعصب

675

00:32:38,880 –> 00:32:42,880

برابر با صفر این فقط یک مقدار um است

676

00:32:42,880 –> 00:32:45,600

بنابراین می توانید در اینجا از مقادیر تصادفی نیز استفاده کنید

677

00:32:45,600 –> 00:32:46,080

ولی

678

00:32:46,080 –> 00:32:49,440

ام 0 خوب است

679

00:32:49,440 –> 00:32:52,240

پس بیایید از صفر در اینجا استفاده کنیم و سپس استفاده کنیم

680

00:32:52,240 –> 00:32:54,720

شیب نزول بنابراین این یک است

681

00:32:54,720 –> 00:32:58,320

فرآیند تکرار شونده بنابراین از یک حلقه for استفاده می کنیم

682

00:32:58,320 –> 00:33:02,559

بنابراین برای من یا در واقع ما به این نیاز نداریم

683

00:33:02,559 –> 00:33:03,200

بنابراین برای

684

00:33:03,200 –> 00:33:06,320

خط زیر در محدوده

685

00:33:06,320 –> 00:33:09,519

و سپس self dot n

686

00:33:09,519 –> 00:33:14,640

چند بار و در حال حاضر آنچه ما نیاز داریم

687

00:33:14,640 –> 00:33:18,320

ابتدا باید تقریب کنیم

688

00:33:18,320 –> 00:33:20,640

یا بیایید نگاهی به فرمول بیندازیم

689

00:33:20,640 –> 00:33:22,080

از نو

690

00:33:22,080 –> 00:33:25,840

بنابراین فرمول برای ما

691

00:33:25,840 –> 00:33:29,519

وزن های جدید منهای وزن قبلی است

692

00:33:29,519 –> 00:33:32,880

نرخ یادگیری ضربدر مشتق

693

00:33:32,880 –> 00:33:36,000

و مشتق با توجه به

694

00:33:36,000 –> 00:33:39,840

w 1 روی n است

695

00:33:39,840 –> 00:33:43,679

و سپس جمع و مجموع را داریم

696

00:33:43,679 –> 00:33:46,960

بیش از 2 برابر x

697

00:33:46,960 –> 00:33:50,880

من بارها و سپس

698

00:33:50,880 –> 00:33:54,559

تفاوت در اینجا این تقریبی است

699

00:33:54,559 –> 00:33:55,760

و واقعی

700

00:33:55,760 –> 00:34:00,399

ارزش ها پس بیایید اول um

701

00:34:00,399 –> 00:34:03,519

ابتدا این تقریب را محاسبه کنید تا ما

702

00:34:03,519 –> 00:34:04,840

این فرمول را داشته باشید

703

00:34:04,840 –> 00:34:07,760

اینجا تقریب

704

00:34:07,760 –> 00:34:10,960

آیا ام

705

00:34:10,960 –> 00:34:16,079

وزن ها برابر x ما به اضافه انحراف است

706

00:34:16,079 –> 00:34:18,879

پس بیایید این کار را انجام دهیم، بگوییم و بیایید

707

00:34:18,879 –> 00:34:20,719

این را y صدا کن

708

00:34:20,719 –> 00:34:24,960

برابر پیش بینی کرد و سپس می توانیم استفاده کنیم

709

00:34:24,960 –> 00:34:28,399

np dot dot و سپس

710

00:34:28,399 –> 00:34:32,839

x و خود نقطه وزن

711

00:34:32,839 –> 00:34:37,839

به علاوه سوگیری بنابراین این چند برابر خواهد شد

712

00:34:37,839 –> 00:34:41,359

x با وزنه ها و اکنون

713

00:34:41,359 –> 00:34:44,000

که ما تقریبی که می توانیم داشته باشیم

714

00:34:44,000 –> 00:34:47,280

مشتق را با احترام محاسبه کنید

715

00:34:47,280 –> 00:34:50,399

به w و این است

716

00:34:50,399 –> 00:34:54,480

بیایید دوباره به این فرمول نگاهی بیندازیم

717

00:34:54,480 –> 00:34:58,000

1 روی n و سپس

718

00:34:58,000 –> 00:35:01,280

مجموع و سپس در داخل جمع ما

719

00:35:01,280 –> 00:35:02,160

محصول

720

00:35:02,160 –> 00:35:07,520

از x برابر این است که ما می گوییم

721

00:35:07,520 –> 00:35:10,640

1 بیش از

722

00:35:10,960 –> 00:35:13,839

n نمونه بنابراین ما قبلاً شماره را دریافت کرده ایم

723

00:35:13,839 –> 00:35:15,760

از نمونه ها در اینجا

724

00:35:15,760 –> 00:35:19,280

و پس از آن بار و سپس ما باید

725

00:35:19,280 –> 00:35:22,880

مجموع محصول بنابراین این چیزی نیست جز

726

00:35:22,880 –> 00:35:24,960

همچنین محصول نقطه است

727

00:35:24,960 –> 00:35:30,560

np dot dot اما حالا باید مراقب باشیم

728

00:35:30,560 –> 00:35:34,079

پس کاری که ما اینجا انجام دادیم

729

00:35:35,280 –> 00:35:38,880

در اینجا هر جزء وزنی را ضرب می کنیم

730

00:35:38,880 –> 00:35:41,200

با مولفه بردار ویژگی و

731

00:35:41,200 –> 00:35:42,480

خلاصه این که

732

00:35:42,480 –> 00:35:45,359

و ما این کار را برای همه نمونه ها و سپس انجام می دهیم

733

00:35:45,359 –> 00:35:45,680

گرفتن

734

00:35:45,680 –> 00:35:49,520

یک مقدار برای هر نمونه و اینجا

735

00:35:49,520 –> 00:35:52,400

ما می خواهیم برای هر کدام یک مقدار بدست آوریم

736

00:35:52,400 –> 00:35:54,640

جزء بردار ویژگی

737

00:35:54,640 –> 00:35:57,440

بنابراین هر نمونه را در ضرب می کنیم

738

00:35:57,440 –> 00:35:59,200

ارزش پیش بینی شده

739

00:35:59,200 –> 00:36:02,720

و آن را خلاصه کنید و سپس این کار را برای

740

00:36:02,720 –> 00:36:04,960

هر جزء بردار ویژگی و دریافت کنید

741

00:36:04,960 –> 00:36:07,760

یک مقدار برای هر جزء پس این است

742

00:36:07,760 –> 00:36:10,560

برعکس پس این هم همراه است

743

00:36:10,560 –> 00:36:13,359

محور دیگر

744

00:36:13,359 –> 00:36:16,800

و ما می توانیم پس باید از نقطه x استفاده کنیم

745

00:36:16,800 –> 00:36:20,240

جابجا شده در اینجا x نقطه t

746

00:36:20,240 –> 00:36:22,359

و این محصول نقطه ای است

747

00:36:22,359 –> 00:36:23,520

جابجا شد

748

00:36:23,520 –> 00:36:26,560

x و سپس داریم

749

00:36:26,560 –> 00:36:30,720

y منهای y واقعی را پیش بینی کرد

750

00:36:30,720 –> 00:36:34,400

بنابراین لطفاً تابع numpy dot را بررسی کنید

751

00:36:34,400 –> 00:36:36,320

برای خودت

752

00:36:36,320 –> 00:36:40,079

بنابراین این مشتق است

753

00:36:40,079 –> 00:36:43,760

w و مشتق

754

00:36:43,760 –> 00:36:46,960

از تعصب نیز است

755

00:36:46,960 –> 00:36:49,599

یکی یا دوباره اجازه دهید نگاهی به

756

00:36:49,599 –> 00:36:50,720

فرمول

757

00:36:50,720 –> 00:36:54,160

پس این همان است جز اینکه ما

758

00:36:54,160 –> 00:36:57,520

x را اینجا ندارید پس این است

759

00:36:57,520 –> 00:37:01,200

یک روی n و سپس فقط حاصل جمع

760

00:37:01,200 –> 00:37:04,800

از این تفاوت و به هر حال من

761

00:37:04,800 –> 00:37:07,440

من این دو را کنار گذاشتم پس این فقط یک است

762

00:37:07,440 –> 00:37:09,440

ضریب مقیاس که ما می توانیم

763

00:37:09,440 –> 00:37:12,800

اوم حذف پس اینجا

764

00:37:12,800 –> 00:37:15,760

یک بر n و سپس مجموع بیش از

765

00:37:15,760 –> 00:37:17,200

تفاوت

766

00:37:17,200 –> 00:37:20,480

بنابراین دوباره یک بار

767

00:37:20,480 –> 00:37:23,800

تعداد نمونه ها و سپس می توان گفت

768

00:37:23,800 –> 00:37:25,520

numpy.sum

769

00:37:25,520 –> 00:37:29,040

و مجموع y پیش بینی شده است

770

00:37:29,040 –> 00:37:32,640

منهای واقعی y بنابراین

771

00:37:32,640 –> 00:37:35,200

اینها مشتقات ما هستند و اکنون

772

00:37:35,200 –> 00:37:36,079

به روز می کنیم

773

00:37:36,079 –> 00:37:39,760

وزن ما بنابراین می گوییم وزن خود

774

00:37:39,760 –> 00:37:43,280

منهای برابر با خود نقطه است

775

00:37:43,280 –> 00:37:46,560

نرخ یادگیری برابر این است

776

00:37:46,560 –> 00:37:50,800

مشتق و خود.تعصب

777

00:37:50,800 –> 00:37:54,960

برابر خود منهای برابر است

778

00:37:54,960 –> 00:37:58,560

زمان نرخ یادگیری خود نقطه

779

00:37:58,560 –> 00:38:01,520

مشتق

780

00:38:02,960 –> 00:38:08,560

و بله، پس این نزول شیب است

781

00:38:08,560 –> 00:38:12,640

و اکنون به روش پیش بینی نیاز داریم

782

00:38:12,640 –> 00:38:17,320

پس دوباره تقریب میزنیم

783

00:38:17,320 –> 00:38:20,510

[موسیقی]

784

00:38:20,880 –> 00:38:24,000

ما مقادیر را با این تقریب می کنیم

785

00:38:24,000 –> 00:38:27,280

فرمول بنابراین ما

786

00:38:27,280 –> 00:38:30,560

در حال حاضر این را در اینجا داشته باشید، بنابراین این همان است

787

00:38:30,560 –> 00:38:33,520

حاصل ضرب نقطه ای x و وزن ها به اضافه

788

00:38:33,520 –> 00:38:36,320

تعصب

789

00:38:36,480 –> 00:38:39,599

و سپس ما به سادگی این را برمی گردانیم

790

00:38:39,599 –> 00:38:42,720

بنابراین این کل اجرا است

791

00:38:42,720 –> 00:38:46,079

که ما نیاز داریم و من فراموش کردم

792

00:38:46,079 –> 00:38:49,040

برای واردات numpy البته که گفتم

793

00:38:49,040 –> 00:38:49,680

بیایید بگوییم

794

00:38:49,680 –> 00:38:55,599

numpy snp را وارد کنید تا بتوانیم از آن استفاده کنیم

795

00:38:55,599 –> 00:39:00,000

و حالا بیایید این را آزمایش کنیم

796

00:39:00,000 –> 00:39:03,920

اوم بیایید

797

00:39:03,920 –> 00:39:07,040

بیایید بگوییم این کلاس را وارد کنید

798

00:39:07,040 –> 00:39:10,079

از خطی

799

00:39:10,079 –> 00:39:13,200

واردات رگرسیونی

800

00:39:13,200 –> 00:39:16,320

رگرسیون خطی و سپس

801

00:39:16,320 –> 00:39:20,079

مقداری رگرسیور برابر ایجاد کنید

802

00:39:20,079 –> 00:39:23,920

رگرسیون خطی و سپس می گوییم

803

00:39:23,920 –> 00:39:28,079

رگرسیور نقطه فیت و ما می خواهیم برازش کنیم

804

00:39:28,079 –> 00:39:31,200

نمونه های آموزشی

805

00:39:31,200 –> 00:39:34,960

و برچسب های آموزشی و سپس ما می توانیم

806

00:39:34,960 –> 00:39:35,520

گفتن

807

00:39:35,520 –> 00:39:40,839

ما می توانیم مقادیر پیش بینی شده برابر را بدست آوریم

808

00:39:40,839 –> 00:39:44,160

پیش بینی نقطه رگرسیون

809

00:39:44,160 –> 00:39:47,440

و اکنون می خواهیم پیش بینی کنیم

810

00:39:47,440 –> 00:39:51,040

تست کن

811

00:39:51,040 –> 00:39:54,960

نمونه ها و در حال حاضر به ترتیب

812

00:39:54,960 –> 00:39:58,320

برای محاسبه و یا برای دیدن چگونه ما

813

00:39:58,320 –> 00:40:01,520

مدل انجام می دهد در حال حاضر ما نمی توانیم

814

00:40:01,520 –> 00:40:04,720

ما نمی توانیم از اندازه گیری دقت استفاده کنیم اما

815

00:40:04,720 –> 00:40:06,240

در اینجا از میانگین استفاده می کنیم

816

00:40:06,240 –> 00:40:10,079

مربع خطا پس همانطور که گفتم این ماست

817

00:40:10,079 –> 00:40:12,960

تابع هزینه میانگین مربعات خطا

818

00:40:12,960 –> 00:40:14,800

که به ما می گوید چگونه

819

00:40:14,800 –> 00:40:18,000

تفاوت بزرگ بین واقعی

820

00:40:18,000 –> 00:40:18,560

ارزش

821

00:40:18,560 –> 00:40:21,760

و مقدار تقریبی است بنابراین اجازه دهید

822

00:40:21,760 –> 00:40:25,119

فرض کنید میانگین مربعات خطا را تعریف کنید

823

00:40:25,119 –> 00:40:30,079

def m s e و این خواهد شد

824

00:40:30,079 –> 00:40:33,119

ارزش های واقعی

825

00:40:33,119 –> 00:40:36,880

و مقادیر پیش بینی شده

826

00:40:36,880 –> 00:40:41,119

و این ناپاک است

827

00:40:41,119 –> 00:40:45,280

در اینجا می توانیم از numpy mean و سپس استفاده کنیم

828

00:40:45,280 –> 00:40:48,720

به سادگی تفاوت به قدرت

829

00:40:48,720 –> 00:40:50,839

دو تا y

830

00:40:50,839 –> 00:40:53,680

منهای واقعی

831

00:40:53,680 –> 00:40:57,040

y به قدرت پیش بینی کرد

832

00:40:57,040 –> 00:41:02,160

دو و سپس می خواهیم این را برگردانیم

833

00:41:02,400 –> 00:41:08,160

پس ببینیم یا بگوییم

834

00:41:10,480 –> 00:41:15,119

مقدار mse برابر با mse است

835

00:41:15,119 –> 00:41:19,200

تست خاموش y

836

00:41:19,200 –> 00:41:22,480

و پیش بینی شده

837

00:41:22,720 –> 00:41:26,720

ارزش ها و بیایید این را چاپ کنیم

838

00:41:28,800 –> 00:41:32,160

پس حالا اگر این را اجرا کنیم

839

00:41:33,119 –> 00:41:36,560

اوم ببین

840

00:41:36,560 –> 00:41:40,720

این در حال اجرا نیست تعصب تعریف نشده است

841

00:41:40,720 –> 00:41:44,640

بیایید بگوییم چه چیزهایی را اینجا از دست دادیم

842

00:41:44,640 –> 00:41:48,160

تعصب خود نقطه ای

843

00:41:48,160 –> 00:41:53,200

و اجازه دهید این را دوباره اجرا کنیم

844

00:41:54,240 –> 00:41:58,160

ام خط 27

845

00:41:58,160 –> 00:42:00,480

اوه ببخشید اینو کپی کردم و فراموش کردم

846

00:42:00,480 –> 00:42:01,839

اینجا هم

847

00:42:01,839 –> 00:42:05,359

پس سعی کنید بعدی

848

00:42:05,520 –> 00:42:08,760

حالا ما می بینیم که ما

849

00:42:08,760 –> 00:42:13,079

عملکرد بنابراین میانگین مربعات خطا است

850

00:42:13,079 –> 00:42:14,880

783 پس این است

851

00:42:14,880 –> 00:42:18,079

خیلی بالاست پس بیایید استفاده کنیم

852

00:42:18,079 –> 00:42:21,599

یکی دیگر از نرخ یادگیری در اینجا بنابراین بیایید بگوییم

853

00:42:21,599 –> 00:42:27,200

lr برابر با 0.01 است

854

00:42:27,200 –> 00:42:31,040

و اجازه دهید این را اجرا کنیم و اکنون آن را می بینیم

855

00:42:31,040 –> 00:42:31,520

ما

856

00:42:31,520 –> 00:42:34,640

خطا کوچکتر است و اجازه دهید در واقع

857

00:42:34,640 –> 00:42:39,040

این طوری طرح کنید

858

00:42:39,040 –> 00:42:42,240

بیایید ابتدا با نسخه اصلی طرح کنیم

859

00:42:42,240 –> 00:42:45,200

نرخ یادگیری بیایید ببینیم چگونه

860

00:42:45,200 –> 00:42:48,720

طرح چگونه به نظر می رسد

861

00:42:49,760 –> 00:42:52,400

بنابراین در حال حاضر

862

00:42:54,400 –> 00:42:58,800

طرح ما شبیه این است پس همینطور است

863

00:42:58,800 –> 00:43:02,000

تقریبا مثل اوم

864

00:43:02,000 –> 00:43:05,040

شیب مناسب اما نه دقیقا

865

00:43:05,040 –> 00:43:08,160

و حالا بیایید یادگیری دیگر را داشته باشیم

866

00:43:08,160 –> 00:43:08,640

نرخ

867

00:43:08,640 –> 00:43:11,520

پس بیایید از این میزان یادگیری استفاده کنیم و

868

00:43:11,520 –> 00:43:14,400

بیایید این را اجرا کنیم

869

00:43:15,760 –> 00:43:18,480

و اکنون طرح ما به این شکل است و

870

00:43:18,480 –> 00:43:20,240

این در واقع خیلی خوب به نظر می رسد

871

00:43:20,240 –> 00:43:23,680

بنابراین این بسیار مناسب یا زیبا است

872

00:43:23,680 –> 00:43:26,000

تقریب خوبی از این داده ها با

873

00:43:26,000 –> 00:43:30,000

یک تابع خطی بنابراین می بینیم که ما

874

00:43:30,000 –> 00:43:31,839

پیاده سازی کار می کند

875

00:43:31,839 –> 00:43:34,400

و امیدوارم از این آموزش لذت برده باشید و

876

00:43:34,400 –> 00:43:37,839

شما را در آموزش بعدی می بینم

877

00:43:38,839 –> 00:43:41,839

خدا حافظ

878

00:43:42,640 –> 00:43:44,800

سلام به یک دستگاه جدید خوش آمدید

879

00:43:44,800 –> 00:43:46,560

آموزش یادگیری از ابتدا

880

00:43:46,560 –> 00:43:48,720

امروز می خواهیم لجستیک را پیاده سازی کنیم

881

00:43:48,720 –> 00:43:50,800

رگرسیون فقط با استفاده از پایتون داخلی

882

00:43:50,800 –> 00:43:52,640

ماژول ها و ناتوانی

883

00:43:52,640 –> 00:43:54,640

اگر ویدیوی قبلی من را ندیده اید

884

00:43:54,640 –> 00:43:56,160

در مورد رگرسیون خطی

885

00:43:56,160 –> 00:43:57,920

تماشای آن را به شدت توصیه می کنم

886

00:43:57,920 –> 00:44:00,240

اول از زمانی که برخی از آنها را توضیح دادم

887

00:44:00,240 –> 00:44:02,000

مفاهیم کمی با جزئیات بیشتر

888

00:44:02,000 –> 00:44:02,880

آنجا

889

00:44:02,880 –> 00:44:04,400

اما من سعی خواهم کرد همه موارد را پوشش دهم

890

00:44:04,400 –> 00:44:06,720

مفاهیم مهم دوباره در این ویدیو

891

00:44:06,720 –> 00:44:08,720

پس بیایید در مورد مفاهیم صحبت کنیم

892

00:44:08,720 –> 00:44:10,720

رگرسیون لجستیک

893

00:44:10,720 –> 00:44:15,040

بنابراین همانطور که در رگرسیون خطی به یاد دارید

894

00:44:15,040 –> 00:44:16,800

ما داده های خود را مدل می کنیم

895

00:44:16,800 –> 00:44:19,839

با تابع خطی w

896

00:44:19,839 –> 00:44:23,520

برابر x به علاوه b پس این خواهد شد

897

00:44:23,520 –> 00:44:27,119

خروجی مقادیر پیوسته و اکنون در

898

00:44:27,119 –> 00:44:28,880

رگرسیون لجستیک

899

00:44:28,880 –> 00:44:32,000

ما ارزش های پیوسته را نمی خواهیم، اما ما

900

00:44:32,000 –> 00:44:34,319

یک احتمال می خواهند

901

00:44:34,319 –> 00:44:37,599

و به منظور مدل سازی این احتمال

902

00:44:37,599 –> 00:44:40,560

تابع سیگموئید را به ما اعمال می کنیم

903

00:44:40,560 –> 00:44:42,240

مدل خطی

904

00:44:42,240 –> 00:44:45,680

بنابراین تابع سیگموئید 1 است

905

00:44:45,680 –> 00:44:49,359

بیش از 1 به علاوه تابع نمایی

906

00:44:49,359 –> 00:44:52,640

منهای x

907

00:44:52,640 –> 00:44:55,599

بنابراین این تابع سیگموئید و

908

00:44:55,599 –> 00:44:56,160

منهای

909

00:44:56,160 –> 00:45:01,119

و x در مورد ما پس ماست

910

00:45:01,119 –> 00:45:04,480

مدل خطی ما بنابراین

911

00:45:04,480 –> 00:45:07,079

و این خروجی a است

912

00:45:07,079 –> 00:45:08,240

احتمال

913

00:45:08,240 –> 00:45:11,280

بین صفر و یک پس اگر نمودار را رسم کنیم

914

00:45:11,280 –> 00:45:13,680

تابع سیگموئید

915

00:45:13,680 –> 00:45:17,520

اوم پس می توانید ببینید که این بین صفر است

916

00:45:17,520 –> 00:45:20,960

و یکی پس با این تابع ما می توانیم

917

00:45:20,960 –> 00:45:21,359

مدل

918

00:45:21,359 –> 00:45:25,119

احتمال داده های ما و اکنون

919

00:45:25,119 –> 00:45:28,640

با این تقریبی

920

00:45:28,640 –> 00:45:32,720

um خروجی پس از آن ما می توانیم

921

00:45:32,720 –> 00:45:35,680

سپس باید به پارامترها برسیم

922

00:45:35,680 –> 00:45:36,720

w

923

00:45:36,720 –> 00:45:40,079

بنابراین وزن و تعصب ما

924

00:45:40,079 –> 00:45:43,200

و چگونه این کار را دوباره انجام دهیم

925

00:45:43,200 –> 00:45:45,280

قبلا در مورد قبلی توضیح داده شده است

926

00:45:45,280 –> 00:45:46,400

ویدئو

927

00:45:46,400 –> 00:45:49,599

بنابراین ما روشی را اعمال می کنیم که نامیده می شود

928

00:45:49,599 –> 00:45:53,440

شیب نزول بنابراین اول از همه ما نیاز داریم

929

00:45:53,440 –> 00:45:53,760

آ

930

00:45:53,760 –> 00:45:57,359

تابع هزینه و در اینجا ما آن را نداریم

931

00:45:57,359 –> 00:45:59,040

میانگین فلش مربع و

932

00:45:59,040 –> 00:46:01,920

دیگر اما ما از تابعی استفاده می کنیم که است

933

00:46:01,920 –> 00:46:03,040

صلیب نامیده می شود

934

00:46:03,040 –> 00:46:07,040

آنتروپی بنابراین این فرمول است

935

00:46:07,040 –> 00:46:09,599

اوم من به جزئیات در این مورد نمی پردازم

936

00:46:09,599 –> 00:46:11,040

اما من مقداری قرار خواهم داد

937

00:46:11,040 –> 00:46:14,400

خواندن بیشتر در توضیحات

938

00:46:14,400 –> 00:46:17,599

پس با این فرمول

939

00:46:17,599 –> 00:46:20,720

با چه کاری می خواهیم این را بهینه کنیم

940

00:46:20,720 –> 00:46:22,800

با احترام به پارامترهای ما

941

00:46:22,800 –> 00:46:25,839

w و b بنابراین استفاده می کنیم

942

00:46:25,839 –> 00:46:28,880

شیب نزول و این یعنی

943

00:46:28,880 –> 00:46:32,480

ما از یک نقطه شروع می کنیم و سپس

944

00:46:32,480 –> 00:46:36,400

به طور مکرر پارامترهای ما را به روز کنید

945

00:46:36,400 –> 00:46:40,079

بنابراین باید مشتق را محاسبه کنیم

946

00:46:40,079 –> 00:46:43,520

و سپس به سمت این بروید

947

00:46:43,520 –> 00:46:44,480

مشتق

948

00:46:44,480 –> 00:46:48,480

تا بالاخره به حداقل برسیم

949

00:46:48,480 –> 00:46:51,680

بنابراین و سپس ما نیز باید تعریف کنیم

950

00:46:51,680 –> 00:46:54,400

نرخ یادگیری به اصطلاح

951

00:46:54,400 –> 00:46:56,400

نرخ یادگیری را تعیین می کند

952

00:46:56,400 –> 00:46:59,200

چقدر به این سمت می رویم

953

00:46:59,200 –> 00:47:00,560

هر مرحله

954

00:47:00,560 –> 00:47:03,359

بنابراین این یک پارامتر مهم آن است

955

00:47:03,359 –> 00:47:04,160

نباید هم باشه

956

00:47:04,160 –> 00:47:07,040

بالا از آن زمان ممکن است به اطراف بپرد و

957

00:47:07,040 –> 00:47:08,800

هرگز حداقل را پیدا نکنید

958

00:47:08,800 –> 00:47:12,640

اما همچنین نباید خیلی کم باشد

959

00:47:12,720 –> 00:47:16,160

متاسفم و اکنون با این شیب

960

00:47:16,160 –> 00:47:18,640

نزول

961

00:47:18,640 –> 00:47:21,920

آنچه ما داریم این است که قوانین به روز رسانی خود را داریم

962

00:47:21,920 –> 00:47:22,319

بنابراین

963

00:47:22,319 –> 00:47:26,480

وزن ما وزن جدید ما است

964

00:47:26,480 –> 00:47:27,440

وزن قدیمی

965

00:47:27,440 –> 00:47:30,160

منهای زیرا ما می خواهیم وارد آن شویم

966

00:47:30,160 –> 00:47:32,000

جهت منفی

967

00:47:32,000 –> 00:47:34,480

منهای نرخ یادگیری ما برابر است

968

00:47:34,480 –> 00:47:36,559

مشتق

969

00:47:36,559 –> 00:47:40,960

و برای تعصب ما هم همینطور است

970

00:47:40,960 –> 00:47:43,359

و سپس در اینجا فرمول هایی هستند که ما

971

00:47:43,359 –> 00:47:44,240

نیاز داشتن

972

00:47:44,240 –> 00:47:48,319

برای مشتقات um ما بنابراین اینها هستند

973

00:47:48,319 –> 00:47:49,200

فرمول ها

974

00:47:49,200 –> 00:47:52,319

و در واقع یکسان هستند

975

00:47:52,319 –> 00:47:56,000

مشتقات um like in

976

00:47:56,000 –> 00:47:58,880

رگرسیون خطی بنابراین شما می توانید بررسی کنید

977

00:47:58,880 –> 00:48:00,720

خودت ریاضی پشتش

978

00:48:00,720 –> 00:48:02,400

من همچنین چند لینک در آن قرار خواهم داد

979

00:48:02,400 –> 00:48:03,839

شرح

980

00:48:03,839 –> 00:48:06,240

و این تمام چیزی است که اکنون برای بدست آوردن نیاز داریم

981

00:48:06,240 –> 00:48:07,200

آغاز شده

982

00:48:07,200 –> 00:48:10,240

و اکنون می توانیم تدارکات خود را پیاده سازی کنیم

983

00:48:10,240 –> 00:48:11,119

پسرفت

984

00:48:11,119 –> 00:48:14,880

پس البته ما دوباره از numpy استفاده می کنیم پس اجازه دهید

985

00:48:14,880 –> 00:48:19,280

numpy را به عنوان np وارد کنید

986

00:48:19,280 –> 00:48:21,680

و سپس کلاسی به نام ایجاد می کنیم

987

00:48:21,680 –> 00:48:23,119

لجستیکی

988

00:48:23,119 –> 00:48:26,720

رگرسیون و این یک خواهد داشت

989

00:48:26,720 –> 00:48:30,880