در این مطلب، ویدئو شبکه عصبی بازگشتی (RNN) چیست؟ آموزش عمیق یادگیری 33 (Tensorflow، Keras و Python) با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:15:59

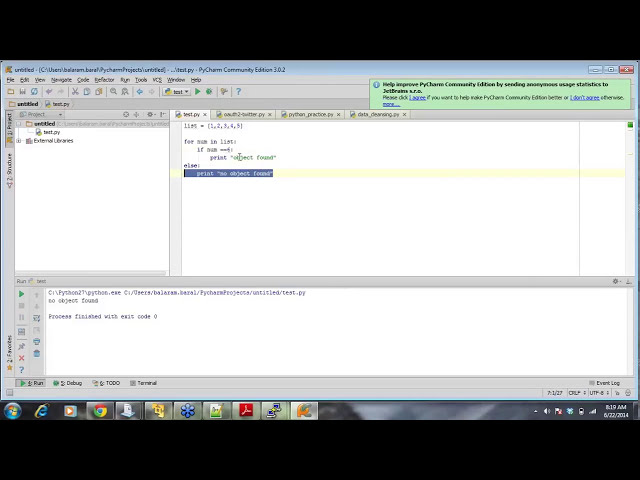

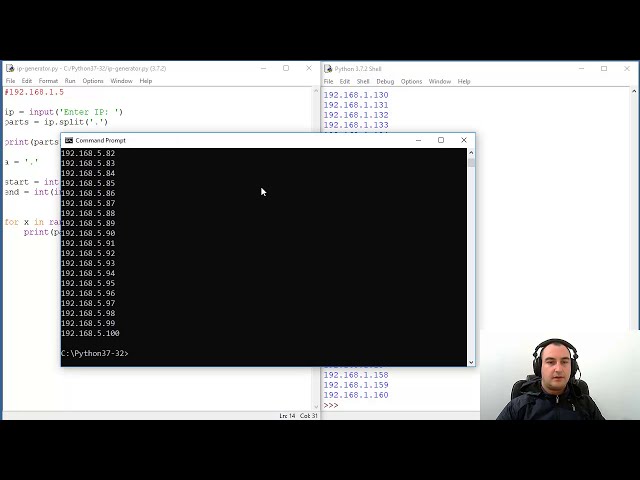

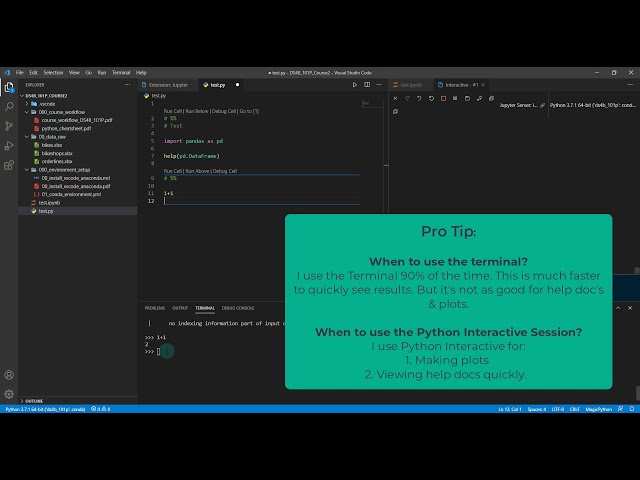

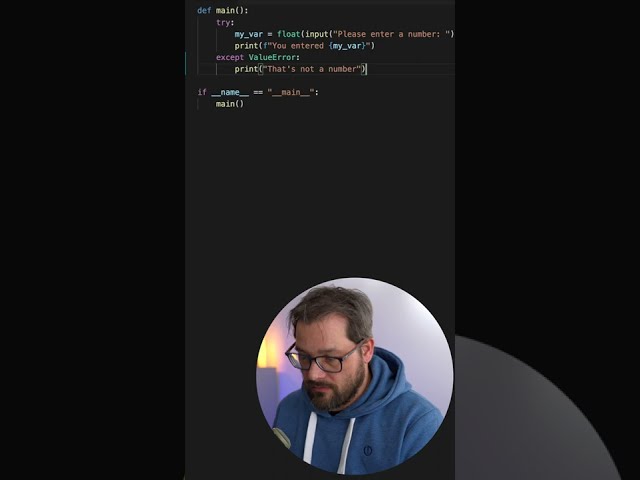

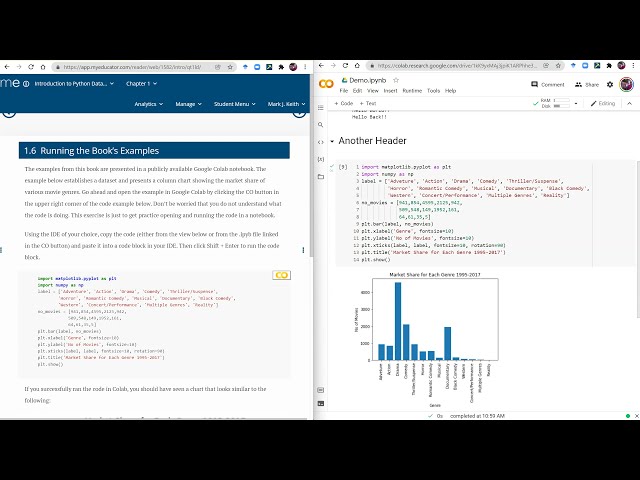

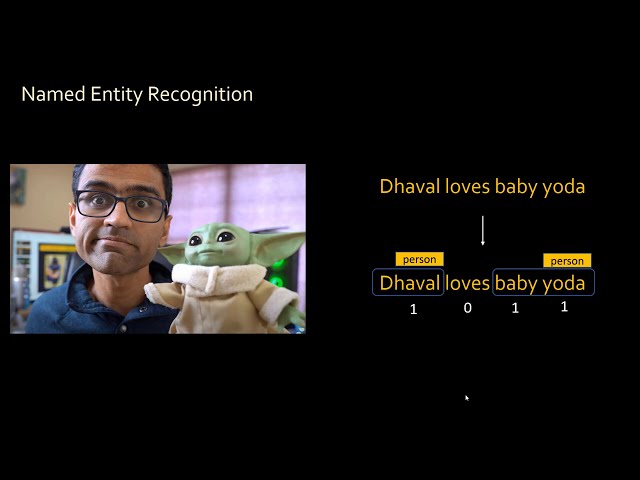

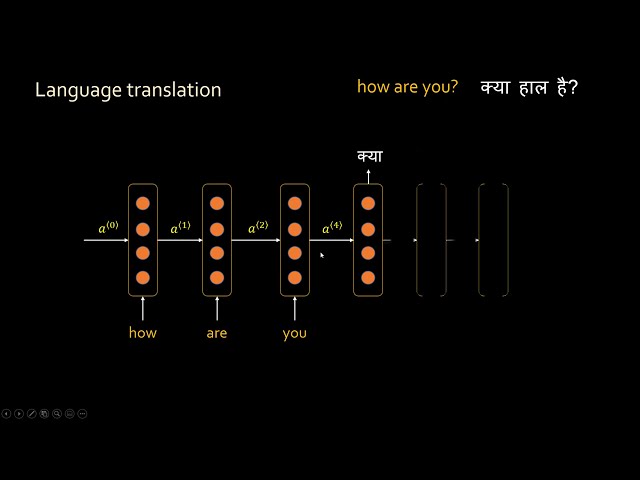

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,160 –> 00:00:02,240

تا کنون در سری آموزش های یادگیری عمیق

2

00:00:02,240 –> 00:00:03,439

ما به

3

00:00:03,439 –> 00:00:05,279

شبکه عصبی مصنوعی و

4

00:00:05,279 –> 00:00:06,879

شبکه عصبی کانولوشن که

5

00:00:06,879 –> 00:00:08,800

عمدتاً برای پردازش تصویر استفاده می شود نگاه کردیم

6

00:00:08,800 –> 00:00:10,559

در این ویدیو در مورد

7

00:00:10,559 –> 00:00:12,559

شبکه عصبی تکراری صحبت خواهیم کرد که

8

00:00:12,559 –> 00:00:13,679

عمدتاً برای

9

00:00:13,679 –> 00:00:15,759

وظایف پردازش زبان طبیعی استفاده می شود بنابراین اگر به

10

00:00:15,759 –> 00:00:17,440

فکر عمیق هستید. یادگیری کلی

11

00:00:17,440 –> 00:00:20,800

cnn ها عمدتاً برای تصاویر هستند rnn ها عمدتاً برای

12

00:00:20,800 –> 00:00:21,600

13

00:00:21,600 –> 00:00:24,560

nlp هستند موارد استفاده دیگری نیز وجود دارد بنابراین

14

00:00:24,560 –> 00:00:25,519

ما

15

00:00:25,519 –> 00:00:27,680

نحوه عملکرد شبکه عصبی مکرر را درک

16

00:00:27,680 –> 00:00:29,119

خواهیم کرد و به

17

00:00:29,119 –> 00:00:32,719

کاربردهای مختلف rnn در زمینه nlp

18

00:00:32,719 –> 00:00:35,200

و همچنین برخی از دامنه های دیگر خواهیم پرداخت.

19

00:00:35,200 –> 00:00:37,360

ما به چند مورد استفاده در زندگی واقعی نگاه خواهیم کرد که در

20

00:00:37,360 –> 00:00:38,399

آن

21

00:00:38,399 –> 00:00:41,120

مدلهای دنباله مفید هستند، شما باید

22

00:00:41,120 –> 00:00:41,760

از

23

00:00:41,760 –> 00:00:45,360

google mail gmail در اینجا استفاده کرده باشید، وقتی جملهای را تایپ میکنید

24

00:00:45,360 –> 00:00:47,600

، آن را به طور خودکار تکمیل میکند، بنابراین

25

00:00:47,600 –> 00:00:48,320

فقط ببینید

26

00:00:48,320 –> 00:00:50,800

زمانی که من در حال حاضر علاقهای به تایپ نمیکنم

27

00:00:50,800 –> 00:00:53,920

، چیزی است که خودکار است. تکمیل شد،

28

00:00:53,920 –> 00:00:57,760

بنابراین گوگل این rnn یا

29

00:00:57,760 –> 00:00:58,640

شبکه عصبی مکرر

30

00:00:58,640 –> 00:01:01,199

را در آن تعبیه کرده است، جایی که وقتی یک موضع را تایپ می کنید

31

00:01:01,199 –> 00:01:03,520

و علاقه ای به

32

00:01:03,520 –> 00:01:06,159

آن ندارید، به طور خودکار با th تکمیل می شود. وقت آن است

33

00:01:06,159 –> 00:01:08,560

که بگویید اگر تغییر کرد به شما اطلاع

34

00:01:08,560 –> 00:01:11,360

می دهیم در آینده نیز خواهد گفت، بنابراین

35

00:01:11,360 –> 00:01:12,320

در وقت شما صرفه جویی می

36

00:01:12,320 –> 00:01:15,840

کند و جمله را برای شما می

37

00:01:15,840 –> 00:01:18,960

نویسد مورد دیگری ترجمه است

38

00:01:18,960 –> 00:01:21,040

شما باید از ترجمه گوگل استفاده کرده باشید

39

00:01:21,040 –> 00:01:22,720

که می توانید جمله را از آن ترجمه کنید.

40

00:01:22,720 –> 00:01:24,960

یکی به زبان دیگر

41

00:01:24,960 –> 00:01:26,560

به راحتی

42

00:01:26,560 –> 00:01:28,400

مورد استفاده سوم به نام شناسایی موجودیت است

43

00:01:28,400 –> 00:01:29,920

44

00:01:29,920 –> 00:01:33,040

که در x میدانید که به

45

00:01:33,040 –> 00:01:34,240

شبکه عصبی یک بیانیه میدهید

46

00:01:34,240 –> 00:01:36,000

و در شبکه عصبی y به شما میگوید

47

00:01:36,000 –> 00:01:38,240

نام

48

00:01:38,240 –> 00:01:41,759

شخص شرکت و زمان رودلف اسمیت

49

00:01:41,759 –> 00:01:43,680

باید یک میلیونر باشد و جوایز تسلا سر به

50

00:01:43,680 –> 00:01:46,720

فلک کشیده است.

51

00:01:46,720 –> 00:01:49,920

بنابراین این موارد کاربردهای مختلفی هستند که

52

00:01:49,920 –> 00:01:53,040

استفاده از مدلهای توالی یا

53

00:01:53,040 –> 00:01:56,079

شبکه عصبی مکرر rnn کمک میکند

54

00:01:56,079 –> 00:01:57,520

چهارمین مورد استفاده،

55

00:01:57,520 –> 00:01:59,360

تجزیه و تحلیل احساسات است که در آن شما یک پاراگراف دارید و

56

00:01:59,360 –> 00:02:00,880

به شما میگوید که

57

00:02:00,880 –> 00:02:02,479

آیا این

58

00:02:02,479 –> 00:02:04,640

بررسی محصول یک ستاره دو ستاره است

59

00:02:04,640 –> 00:02:08,560

یا خیر. فکر می کنم

60

00:02:08,560 –> 00:02:12,560

چرا نمی توانیم از یک شبکه عصبی ساده

61

00:02:12,560 –> 00:02:14,879

برای حل این مشکل استفاده کنیم تا همه این

62

00:02:14,879 –> 00:02:15,680

مسائل را ببینیم

63

00:02:15,680 –> 00:02:18,160

که آنها را مسئله مدل سازی دنباله می نامند

64

00:02:18,160 –> 00:02:18,800

65

00:02:18,800 –> 00:02:21,360

زیرا دنباله i است وقتی

66

00:02:21,360 –> 00:02:23,280

صحبت از توالی زبان انسان به میان

67

00:02:23,280 –> 00:02:24,959

میآید بسیار مهم است، به عنوان مثال

68

00:02:24,959 –> 00:02:27,040

وقتی میگویید چطور هستید در مقابل

69

00:02:27,040 –> 00:02:30,239

شما چقدر منطقی نیست،

70

00:02:30,239 –> 00:02:32,800

بنابراین ترتیب در اینجا مهم است

71

00:02:32,800 –> 00:02:34,160

و

72

00:02:34,160 –> 00:02:36,560

فکر میکنید چرا از شبکه عصبی ساده برای آن استفاده نمیکنیم.

73

00:02:36,560 –> 00:02:37,599

خوب

74

00:02:37,599 –> 00:02:41,360

بیایید آن را امتحان کنیم، پس برای ترجمه زبان

75

00:02:41,360 –> 00:02:43,599

چگونه این نوع شبکه عصبی را

76

00:02:43,599 –> 00:02:44,640

77

00:02:44,640 –> 00:02:47,120

بسازیم، می دانیم که ورودی عبارت انگلیسی کجاست

78

00:02:47,120 –> 00:02:48,959

و خروجی می تواند در

79

00:02:48,959 –> 00:02:51,840

این عبارت باشد

80

00:02:51,840 –> 00:02:54,959

وقتی این شبکه را ساختم، اگر

81

00:02:54,959 –> 00:02:57,840

اندازه جمله من تغییر کند، بنابراین ممکن است

82

00:02:57,840 –> 00:02:58,480

ورودی

83

00:02:58,480 –> 00:03:00,560

متفاوتی داشته باشم. اندازه مرکز و با یک

84

00:03:00,560 –> 00:03:02,000

معماری شبکه عصبی ثابت

85

00:03:02,000 –> 00:03:02,959

کار نمی کند

86

00:03:02,959 –> 00:03:05,040

زیرا شما باید تصمیم بگیرید که چند

87

00:03:05,040 –> 00:03:06,480

نورون در لایه ورودی و

88

00:03:06,480 –> 00:03:07,680

خروجی وجود دارد،

89

00:03:07,680 –> 00:03:10,720

بنابراین با ترجمه زبان تعداد

90

00:03:10,720 –> 00:03:11,760

نورون ها

91

00:03:11,760 –> 00:03:14,400

به یک مشکل تبدیل می شود که مثلاً چه

92

00:03:14,400 –> 00:03:16,480

اندازه ای را انتخاب می کنید. نورونها

93

00:03:16,480 –> 00:03:18,800

حالا یکی بحث میکند خوب من

94

00:03:18,800 –> 00:03:19,920

تصمیم میگیرم مثلاً یک

95

00:03:19,920 –> 00:03:23,200

اندازه بزرگ مثلاً 100 100 نورون و

96

00:03:23,200 –> 00:03:24,319

بقیه

97

00:03:24,319 –> 00:03:26,720

اگر بگویم بریانی خوردی پس

98

00:03:26,720 –> 00:03:28,640

4 نورون را اشغال میکند.

99

00:03:28,640 –> 00:03:32,000

باقی مانده 96 من فقط می گویم 0

100

00:03:32,000 –> 00:03:34,879

یا شما می دانید عبارت خالی که ممکن است

101

00:03:34,879 –> 00:03:35,440

کار کند،

102

00:03:35,440 –> 00:03:38,319

اما هنوز ایده آل نیست، مسئله دوم

103

00:03:38,319 –> 00:03:40,319

محاسبات بیش از حد است،

104

00:03:40,319 –> 00:03:42,239

زمانی که همه می دانید شبکه های عصبی

105

00:03:42,239 –> 00:03:44,720

روی اعداد کار می کنند و روی رشته کار نمی کنند،

106

00:03:44,720 –> 00:03:47,840

بنابراین باید کلمه خود را تبدیل کنید.

107

00:03:47,840 –> 00:03:50,319

به بردار، بنابراین یکی از راه های

108

00:03:50,319 –> 00:03:52,000

تبدیل آن به بردار

109

00:03:52,000 –> 00:03:55,280

این است که فرض کنید 25000 کلمه

110

00:03:55,280 –> 00:03:58,080

در واژگان شما وجود دارد و شما یک

111

00:03:58,080 –> 00:03:59,200

رمزگذاری داغ انجام می دهید

112

00:03:59,200 –> 00:04:01,519

که در آن می دانید چگونه فرض کنید در

113

00:04:01,519 –> 00:04:02,560

موقعیت

114

00:04:02,560 –> 00:04:05,360

46 است، فرض کنید موقعیت دوم u است.

115

00:04:05,360 –> 00:04:06,000

فرض

116

00:04:06,000 –> 00:04:09,519

کنید در موقعیت 17 000، بنابراین در آن

117

00:04:09,519 –> 00:04:10,480

موقعیت، 1

118

00:04:10,480 –> 00:04:12,959

موقعیت باقیمانده را قرار می دهید، 0 را قرار می دهید و به

119

00:04:12,959 –> 00:04:13,599

آن

120

00:04:13,599 –> 00:04:16,880

یک کدگذاری داغ می گویند، باید کار مشابهی

121

00:04:16,880 –> 00:04:18,320

را برای خروجی نیز انجام دهید،

122

00:04:18,320 –> 00:04:21,279

اما متوجه می شوید که این باعث افزایش بیش از

123

00:04:21,279 –> 00:04:22,400

حد محاسبه

124

00:04:22,400 –> 00:04:24,160

هر یک از کلمات در هنگام تبدیل می شود. این به

125

00:04:24,160 –> 00:04:25,600

یک بردار

126

00:04:25,600 –> 00:04:27,120

شما می دانید که به چند نورون در لایه ورودی نیاز دارید

127

00:04:27,120 –> 00:04:28,639

128

00:04:28,639 –> 00:04:32,160

بسیار زیاد است. سومین

129

00:04:32,160 –> 00:04:34,960

مسئله این است که گاهی اوقات وقتی شما

130

00:04:34,960 –> 00:04:36,320

زبان

131

00:04:36,320 –> 00:04:38,320

را ترجمه می کنید، مثلاً دو عبارت مختلف انگلیسی

132

00:04:38,320 –> 00:04:41,360

ممکن است داشته باشید.

133

00:04:41,360 –> 00:04:44,400

اوه عبارت هندی پس در این مورد

134

00:04:44,400 –> 00:04:47,360

اوه وقتی می گویم یکشنبه کاپا طلا خوردم،

135

00:04:47,360 –> 00:04:48,160

بیایید

136

00:04:48,160 –> 00:04:50,560

بگوییم این شبکه را بر اساس این بیانیه آموزش می دهم

137

00:04:50,560 –> 00:04:51,759

138

00:04:51,759 –> 00:04:55,120

و سپس برای یکشنبه فرض

139

00:04:55,120 –> 00:04:56,400

کنید وزن

140

00:04:56,400 –> 00:04:59,280

تمام این لبه ها را که با رنگ زرد برجسته کرده ام تنظیم می کند.

141

00:04:59,280 –> 00:05:01,360

142

00:05:01,360 –> 00:05:03,840

همان عبارت من می توانم به طور متفاوت بگویم

143

00:05:03,840 –> 00:05:04,639

می توانم بگویم i

144

00:05:04,639 –> 00:05:08,240

در golgappa یکشنبه، بنابراین اکنون در

145

00:05:08,240 –> 00:05:09,440

یکشنبه معنی

146

00:05:09,440 –> 00:05:12,960

onsen یکسان است، اما در اینجا شبکه عصبی باید

147

00:05:12,960 –> 00:05:16,080

مجموعه ای از لبه ها را یاد بگیرد، می بینید که همه

148

00:05:16,080 –> 00:05:17,840

این لبه ها به رنگ زرد هستند

149

00:05:17,840 –> 00:05:20,960

بنابراین پارامترها نیستند. به اشتراک گذاشته شده

150

00:05:20,960 –> 00:05:23,039

ما در آموزش شبکه عصبی کانولوشن خود به این موضوع نگاه

151

00:05:23,039 –> 00:05:25,120

کردیم که با

152

00:05:25,120 –> 00:05:27,440

استفاده از عملیات کانولوشن

153

00:05:27,440 –> 00:05:29,199

میتوانیم پارامترها را

154

00:05:29,199 –> 00:05:32,720

در اینجا به اشتراک بگذاریم، استفاده

155

00:05:32,720 –> 00:05:34,960

از n یا شبکه عصبی مصنوعی

156

00:05:34,960 –> 00:05:36,240

به شما اجازه

157

00:05:36,240 –> 00:05:39,919

نمیدهد این کار را انجام دهید،

158

00:05:39,919 –> 00:05:41,840

خوب مهمترین بخش در تمام این

159

00:05:41,840 –> 00:05:43,759

بحث این است که دنباله را

160

00:05:43,759 –> 00:05:45,919

ببینید که چه زمانی داده های ساختاری دارید، به

161

00:05:45,919 –> 00:05:47,360

عنوان مثال، می خواهید بفهمید که

162

00:05:47,360 –> 00:05:50,560

آیا تراکنش تقلبی است یا خیر، و

163

00:05:50,560 –> 00:05:51,440

فرض

164

00:05:51,440 –> 00:05:53,280

کنید ویژگی های شما مبلغ تراکنش است،

165

00:05:53,280 –> 00:05:55,360

چه ترانس اقدام در خارج از

166

00:05:55,360 –> 00:05:56,000

کشور انجام شده است

167

00:05:56,000 –> 00:05:57,840

یا اینکه آیا قاتل

168

00:05:57,840 –> 00:05:59,919

ارائه شده توسط مشتری صحیح است یا نه،

169

00:05:59,919 –> 00:06:03,039

اکنون اگر ترتیب این

170

00:06:03,039 –> 00:06:05,759

ویژگی ها را تغییر دهید، فرض کنید ssn صحیح است من عرضه

171

00:06:05,759 –> 00:06:08,400

می کنم، شما می دانید اولین

172

00:06:08,400 –> 00:06:10,560

نورون من بر روی هر چیزی که می دانید تأثیر نمی گذارد

173

00:06:10,560 –> 00:06:11,520

174

00:06:11,520 –> 00:06:13,440

زیرا دنباله در که

175

00:06:13,440 –> 00:06:14,880

ورودی را وارد می کنید مهم نیست

176

00:06:14,880 –> 00:06:18,400

در حالی که اگر

177

00:06:18,400 –> 00:06:20,319

178

00:06:20,319 –> 00:06:22,160

ترجمه مترجم انگلیسی ترنس انگلیسی به هندی داشته باشید

179

00:06:22,160 –> 00:06:24,319

و به جای اینکه بگویید من پونس طلا خوردم

180

00:06:24,319 –> 00:06:25,360

و اگر بگویم i

181

00:06:25,360 –> 00:06:28,880

در یکشنبه در گلگوتا معنی

182

00:06:28,880 –> 00:06:31,600

کاملاً متفاوت می شود بنابراین اکنون

183

00:06:31,600 –> 00:06:32,880

نمی توانید

184

00:06:32,880 –> 00:06:36,880

بگویید هندی ترجمه زیاد است

185

00:06:36,880 –> 00:06:38,880

زیرا نامعتبر می شود، بنابراین

186

00:06:38,880 –> 00:06:41,199

توالی بسیار مهم است، به همین دلیل است که

187

00:06:41,199 –> 00:06:43,039

شبکه عصبی مصنوعی

188

00:06:43,039 –> 00:06:44,639

در این مورد

189

00:06:44,639 –> 00:06:47,039

کار نمی

190

00:06:47,039 –> 00:06:48,479

191

00:06:48,479 –> 00:06:53,840

192

00:06:54,080 –> 00:06:57,680

193

00:06:57,680 –> 00:06:59,440

194

00:06:59,440 –> 00:07:02,560

کند. دنیا

195

00:07:02,560 –> 00:07:06,240

عاشق بچه یودا است.

196

00:07:06,240 –> 00:07:06,960

197

00:07:06,960 –> 00:07:09,840

198

00:07:09,840 –> 00:07:10,479

199

00:07:10,479 –> 00:07:13,199

در این بیانیه با ما صحبت می

200

00:07:13,199 –> 00:07:14,319

کند،

201

00:07:14,319 –> 00:07:17,120

شیطان و بیبی یودا، نام افراد

202

00:07:17,120 –> 00:07:17,759

203

00:07:17,759 –> 00:07:19,680

بسیار خوب است، بنابراین تمام هدف از شناسایی موجودیت نام

204

00:07:19,680 –> 00:07:21,360

این

205

00:07:21,360 –> 00:07:24,400

است که

206

00:07:24,400 –> 00:07:26,639

موجودیتی را که می شناسید مانند دو به عنوان

207

00:07:26,639 –> 00:07:28,240

موجودیت، یک شخص است، بچه یودا

208

00:07:28,240 –> 00:07:30,560

به عنوان یک موجودیت به عنوان یک شخص، بنابراین

209

00:07:30,560 –> 00:07:31,280

کل

210

00:07:31,280 –> 00:07:34,639

هدف ner

211

00:07:34,639 –> 00:07:37,599

اکنون می توانید این را به صورت یک و

212

00:07:37,599 –> 00:07:39,120

صفر نشان دهید، بنابراین اگر

213

00:07:39,120 –> 00:07:42,240

کلمه نام شخص است، آن را به عنوان یک علامت گذاری کنید

214

00:07:42,240 –> 00:07:42,800

215

00:07:42,800 –> 00:07:44,960

و

216

00:07:57,199 –> 00:07:59,919

می توانید از یک واژگان استفاده کنید و از یک

217

00:07:59,919