در این مطلب، ویدئو برنامه انباشت مقدار در پایتون | Python از دست داده است با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:17:23

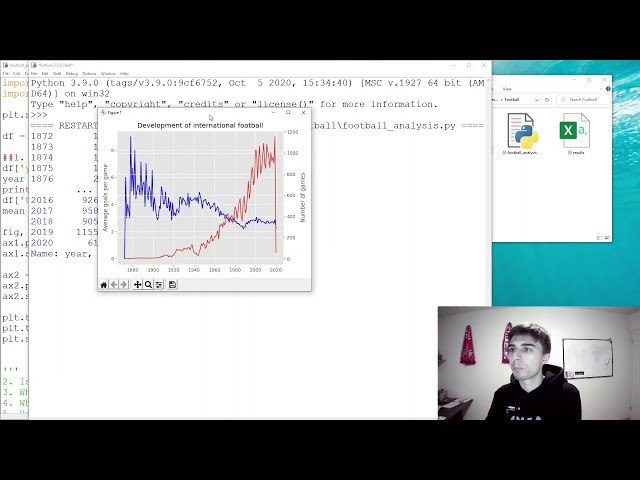

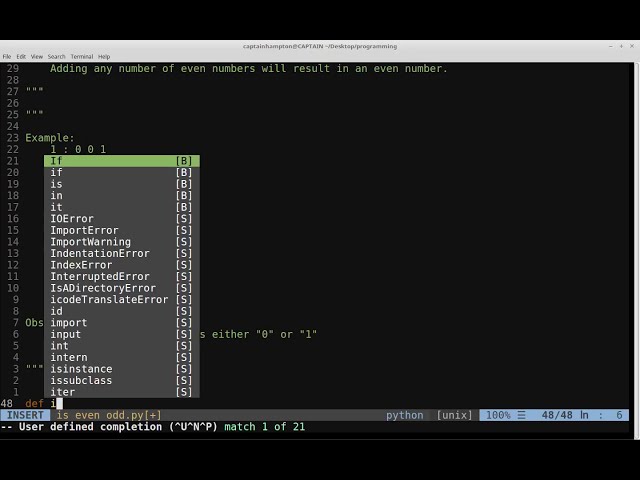

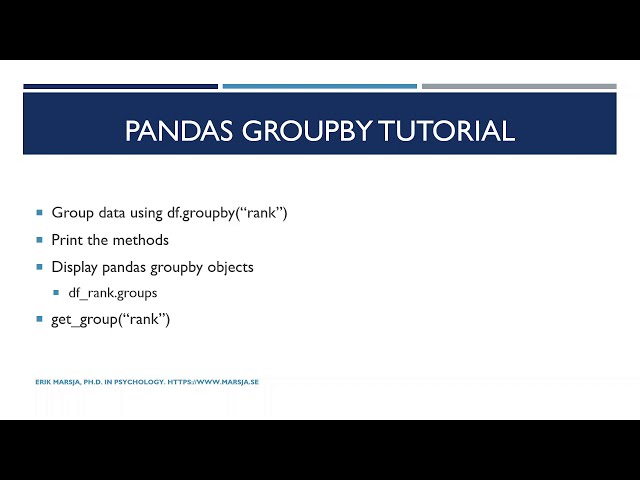

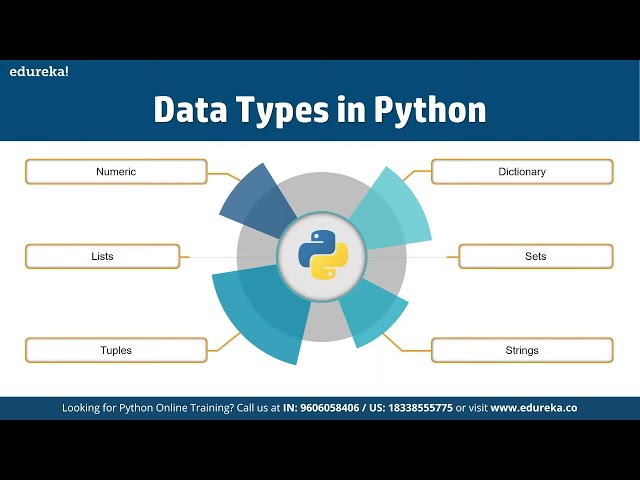

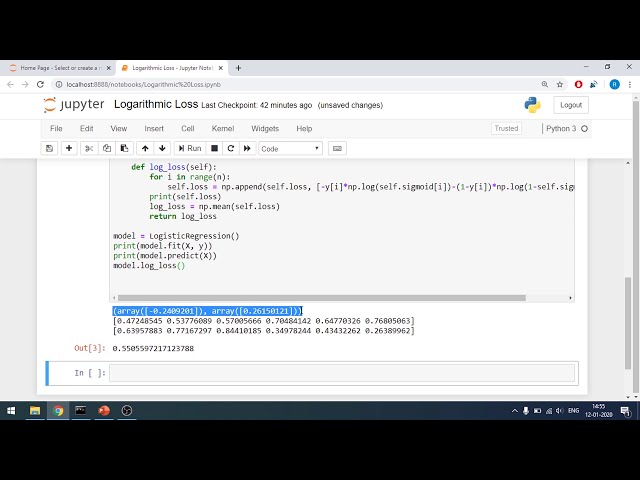

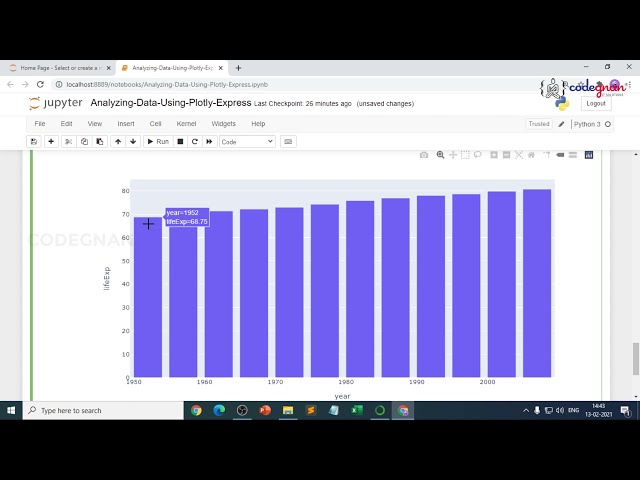

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,080 –> 00:00:01,680

خوش آمدید دوستان علم داده

2

00:00:01,680 –> 00:00:03,439

نام من امان است و من یک

3

00:00:03,439 –> 00:00:04,640

دانشمند

4

00:00:04,640 –> 00:00:06,480

داده هستم در آخرین ویدیوی خود در مورد تکنیک های انتساب ارزش از دست رفته

5

00:00:06,480 –> 00:00:09,120

شما بچه ها

6

00:00:09,120 –> 00:00:11,840

لایک های زیادی دادید و نظرات زیادی

7

00:00:11,840 –> 00:00:13,599

دادید. با تشکر فراوان از همه شما برای این کار

8

00:00:13,599 –> 00:00:15,759

و این یک ویدیوی بعدی است ویدیوی آن

9

00:00:15,759 –> 00:00:18,320

ویدیو فقط این قسمت دوم است که در آن من به شما

10

00:00:18,320 –> 00:00:19,680

11

00:00:19,680 –> 00:00:22,160

نمایش عملی تمام

12

00:00:22,160 –> 00:00:24,000

انگیزه ها و تکنیک های ارزش از دست رفته را نشان خواهم

13

00:00:24,000 –> 00:00:26,080

داد که در آن ویدیو توضیح می دادم

14

00:00:26,080 –> 00:00:28,240

این قدرت نظر و

15

00:00:28,240 –> 00:00:30,720

بازخورد شما است بچه ها که می دانم چه چیزی

16

00:00:30,720 –> 00:00:32,719

ایجاد کنم و چه چیزی را نباید ایجاد کرد،

17

00:00:32,719 –> 00:00:34,719

پس لطفاً ادامه دهید و نظرات را

18

00:00:34,719 –> 00:00:37,200

در این ویدیو نیز قرار دهید تا بدانم

19

00:00:37,200 –> 00:00:39,440

آیا مطابق انتظار بوده است،

20

00:00:39,440 –> 00:00:41,280

بنابراین بیایید به صفحه نمایش من برویم و به شما نشان خواهم داد

21

00:00:41,280 –> 00:00:43,680

که چه تکنیکهایی

22

00:00:43,680 –> 00:00:45,840

در پایتون در دسترس هستند و چگونه ما میتوانیم

23

00:00:45,840 –> 00:00:47,760

آن را اجرا کنیم،

24

00:00:47,760 –> 00:00:49,680

بنابراین بچهها آنچه را که میخواهم در اینجا برای شما توضیح دهم

25

00:00:49,680 –> 00:00:52,960

این است که انواع مختلفی از انباشتهسازی وجود دارد،

26

00:00:52,960 –> 00:00:55,520

خوب است و سپس چگونه این کار را در پایتون انجام دهیم،

27

00:00:55,520 –> 00:00:58,559

به عنوان مثال imputation hydrative،

28

00:00:58,559 –> 00:01:00,960

سپس به شما میگویم که موشهایی که چندگانه هستند چیست؟

29

00:01:00,960 –> 00:01:02,559

انتساب با

30

00:01:02,559 –> 00:01:04,559

معادله زنجیره ای من به شما می گویم انتساب مبتنی بر مدل

31

00:01:04,559 –> 00:01:06,720

به شما می گویم حذف عاقلانه لیست و مقداری انتساب ساده را به شما می گویم،

32

00:01:06,720 –> 00:01:09,439

بنابراین

33

00:01:09,439 –> 00:01:12,240

من چگونه پیش می روم من از موارد دشوار شروع می کنم که

34

00:01:12,240 –> 00:01:14,400

35

00:01:14,400 –> 00:01:16,880

درک آن کمی دشوار است و سپس به سراغ موارد آسان می روم.

36

00:01:16,880 –> 00:01:18,240

37

00:01:18,240 –> 00:01:19,840

بسیار خوب، بنابراین اولین چیزی که شما نیاز دارید که

38

00:01:19,840 –> 00:01:21,600

بچه ها را درک کنید چیزی است که به عنوان انتساب تکراری شناخته می شود،

39

00:01:21,600 –> 00:01:24,640

بسیار خوب، بنابراین این تصویری

40

00:01:24,640 –> 00:01:26,720

که من ایجاد کردم تا به شما توضیح دهم

41

00:01:26,720 –> 00:01:28,720

انتساب هیدراتیو چیست،

42

00:01:28,720 –> 00:01:30,560

سعی کنید این را درک کنید، زیرا این

43

00:01:30,560 –> 00:01:32,720

مفهوم در انتساب های چندگانه

44

00:01:32,720 –> 00:01:34,640

بیش از حد

45

00:01:34,640 –> 00:01:36,720

استفاده می شود.

46

00:01:36,720 –> 00:01:38,880

انتساب یک بار اتفاق نمی

47

00:01:38,880 –> 00:01:41,360

افتد به روشی جایگزین چندین بار اتفاق می افتد،

48

00:01:41,360 –> 00:01:42,720

به عنوان مثال

49

00:01:42,720 –> 00:01:45,520

فرض کنید این داده های ورودی شما هستند، خوب

50

00:01:45,520 –> 00:01:47,759

حالا چند مقدار را می توانید در

51

00:01:47,759 –> 00:01:50,240

داده های ورودی خود خالی ببینید، بچه ها یک مقدار در ارتفاع

52

00:01:50,240 –> 00:01:51,360

اینجا

53

00:01:51,360 –> 00:01:53,280

مقدار دوم در ارتفاع اینجا

54

00:01:53,280 –> 00:01:55,520

یک مقدار در سال تجربه

55

00:01:55,520 –> 00:01:58,320

یک مقدار در دستمزد خوب است، فرض کنید این

56

00:01:58,320 –> 00:01:59,920

کل دادههای شما است،

57

00:01:59,920 –> 00:02:03,119

بنابراین نحوه عملکرد تکرار شونده

58

00:02:03,119 –> 00:02:05,360

اول از همه یک ستون را به عنوان

59

00:02:05,360 –> 00:02:08,000

یک ستون هدف و دو ستون به عنوان

60

00:02:08,000 –> 00:02:10,878

ستون مستقل یا متناسب با یک مدل خوب است،

61

00:02:10,878 –> 00:02:13,280

بنابراین میتوانید اینجا ببینید که

62

00:02:13,280 –> 00:02:15,680

این ستونهای آبی ستون هدف هستند و

63

00:02:15,680 –> 00:02:18,000

این رنگها نارنجی کمی هستند.

64

00:02:18,000 –> 00:02:19,280

65

00:02:19,280 –> 00:02:22,800

66

00:02:22,800 –> 00:02:23,599

67

00:02:23,599 –> 00:02:24,480

68

00:02:24,480 –> 00:02:27,120

فرض کنید مدل

69

00:02:27,120 –> 00:02:30,000

این دو مقدار خالی را در a و b پیشبینی میکند،

70

00:02:30,000 –> 00:02:31,120

خوب،

71

00:02:31,120 –> 00:02:33,360

پس آنچه در مرحله بعد اتفاق میافتد،

72

00:02:33,360 –> 00:02:35,440

ستون دوم است که میتوانید اینجا را به رنگ آبی ببینید.

73

00:02:35,440 –> 00:02:37,920

74

00:02:37,920 –> 00:02:40,000

75

00:02:40,000 –> 00:02:42,239

76

00:02:42,239 –> 00:02:43,519

77

00:02:43,519 –> 00:02:45,120

و در مرحله سوم

78

00:02:45,120 –> 00:02:47,040

این دو به صورت مستقل ساخته می شوند

79

00:02:47,040 –> 00:02:49,519

و این دستمزد به عنوان هدف ساخته می شود

80

00:02:49,519 –> 00:02:51,760

و d پیش بینی می شود

81

00:02:51,760 –> 00:02:54,080

زمانی که این اتفاق برای همه ستون ها رخ دهد،

82

00:02:54,080 –> 00:02:55,840

سپس یک مجموعه داده نهایی خواهیم داشت

83

00:02:55,840 –> 00:02:57,040

درست

84

00:02:57,040 –> 00:02:59,760

این مجموعه داده نهایی مقایسه می شود.

85

00:02:59,760 –> 00:03:00,800

با

86

00:03:00,800 –> 00:03:03,519

مجموعه دادههای ورودی میانگین پایه، بنابراین میتوانید

87

00:03:03,519 –> 00:03:06,159

اینجا در پایین ببینید که این یک

88

00:03:06,159 –> 00:03:08,159

مجموعه دادههای منتسب متوسط است، بنابراین از این دا

89

00:03:08,159 –> 00:03:09,120

90

00:03:09,120 –> 00:03:11,200

ههای اصلی، یک مجموعه داده ورودی اصلی در حا

91

00:03:11,200 –> 00:03:13,360

ت okay پیشرفته ایجاد می

92

00:03:13,360 –> 00:03:14,400

93

00:03:14,400 –> 00:03:16,879

شود. پس از پر شدن همه ویژگیها، تمام

94

00:03:16,879 –> 00:03:18,959

ستونها پیشبینی میشوند،

95

00:03:18,959 –> 00:03:21,040

سپس این نتیجه نهایی

96

00:03:21,040 –> 00:03:23,040

با میانگین نتیجه منتسب محاسبه میشود

97

00:03:23,040 –> 00:03:25,120

و سپس تفاوت مشاهده میشود،

98

00:03:25,120 –> 00:03:26,400

خوب

99

00:03:26,400 –> 00:03:28,319

سعی میشود این تفاوت

100

00:03:28,319 –> 00:03:31,280

در تکرار بعدی به حداقل برسد، بنابراین من

101

00:03:31,280 –> 00:03:34,159

اینجا میگویم مقایسه کنید و درمان میکنم.

102

00:03:34,159 –> 00:03:36,400

این نوع انتساب به عنوان

103

00:03:36,400 –> 00:03:39,519

رویکرد تکراری انتساب شناخته میشود، بنابراین

104

00:03:39,519 –> 00:03:42,000

آنچه در تکرار اول اتفاق میافتد،

105

00:03:42,000 –> 00:03:44,159

تمام ستونها را یکی یکی میگیریم و سعی میکنیم آن

106

00:03:44,159 –> 00:03:46,640

را پیشبینی کنیم و سپس

107

00:03:46,640 –> 00:03:48,239

دادههای نهایی را

108

00:03:48,239 –> 00:03:50,000

با امپدانس میانگین مقایسه میکنیم تا

109

00:03:50,000 –> 00:03:52,720

ببینیم چقدر نزدیک یا چقدر است. دور این است که

110

00:03:52,720 –> 00:03:54,319

این یک اضافه در تکرار بعدی است

111

00:03:54,319 –> 00:03:56,159

چه اتفاقی می افتد دوباره این

112

00:03:56,159 –> 00:03:58,799

چیزها دوباره تکرار می شوند.

113

00:03:58,799 –> 00:04:00,959

114

00:04:00,959 –> 00:04:02,239

115

00:04:02,239 –> 00:04:04,000

116

00:04:04,000 –> 00:04:06,720

117

00:04:06,720 –> 00:04:08,720

118

00:04:08,720 –> 00:04:11,599

بارها اتفاق می افتد

119

00:04:11,599 –> 00:04:12,480

خوب است

120

00:04:12,480 –> 00:04:14,400

چگونه می توان این کار را در پایتون انجام داد،

121

00:04:14,400 –> 00:04:16,160

شما چیزی دارید که به عنوان

122

00:04:16,160 –> 00:04:17,918

رایانه تکرار شونده شناخته می شود، بنابراین ابتدا

123

00:04:17,918 –> 00:04:20,399

داده های خود را وارد می کنم خوب است. به این صورت است که

124

00:04:20,399 –> 00:04:21,918

داده های من به نظر می رسد

125

00:04:21,918 –> 00:04:24,560

اگر اینجا را ببینید من آگاهانه

126

00:04:24,560 –> 00:04:27,520

مقادیری را به عنوان n قرار می دهم بنابراین من قد دارم،

127

00:04:27,520 –> 00:04:29,280

سال ها تجربه دارم و حقوق دارم

128

00:04:29,280 –> 00:04:30,160

خوب است

129

00:04:30,160 –> 00:04:31,800

بنابراین nn

130

00:04:31,800 –> 00:04:34,800

nnn nan به این معنی است که این مقادیر

131

00:04:34,800 –> 00:04:36,720

گم شده اند، بنابراین دو مقدار در ارتفاع از

132

00:04:36,720 –> 00:04:38,720

دست رفته است. یکی در سال تجربه و

133

00:04:38,720 –> 00:04:41,199

یکی در حقوق خوب این دوباره

134

00:04:41,199 –> 00:04:43,840

داده های کارمند است برای مثال می توانید بگویید

135

00:04:43,840 –> 00:04:46,080

و دلیل اینکه نقطه صفر را می بینید این

136

00:04:46,080 –> 00:04:48,240

است که در حال حاضر 9

137

00:04:48,240 –> 00:04:50,400

در پایتون داده می آید فکر می کند همه اینها

138

00:04:50,400 –> 00:04:52,240

مقادیر شناور هستند و بنابراین به طور پیش فرض این است.

139

00:04:52,240 –> 00:04:54,560

تبدیل به float بسیار خوب است، بنابراین نگران

140

00:04:54,560 –> 00:04:57,680

نباشید، فقط مقادیر از دست رفته را ببینید

141

00:04:57,680 –> 00:04:59,600

n n n n خوب

142

00:04:59,600 –> 00:05:02,000

حالا چگونه می توان یک

143

00:05:02,000 –> 00:05:04,960

کامپیوتر تکراری ساده را در این مورد نسبت داد،

144

00:05:04,960 –> 00:05:06,800

شما به اینجا بروید و بگویید

145

00:05:06,800 –> 00:05:08,840

import numpy از

146

00:05:08,840 –> 00:05:10,960

sklearn.experimental import enable

147

00:05:10,960 –> 00:05:13,280

additive computer okay

148

00:05:13,280 –> 00:05:15,280

و سپس می گویید از مقیاس و نقطه وارد

149

00:05:15,280 –> 00:05:17,759

کامپیوتر تکراری محاسباتی

150

00:05:17,759 –> 00:05:19,840

میشوید، سپس مدلی را انتخاب میکنید که خوب

151

00:05:19,840 –> 00:05:22,320

اینجاست که من از رگرسیون خطی استفاده میکنم.

152

00:05:22,320 –> 00:05:24,720

153

00:05:24,720 –> 00:05:26,560

154

00:05:26,560 –> 00:05:28,880

به تخمینگر خود بهعنوان

155

00:05:28,880 –> 00:05:31,039

رگرسیون خطی مقدار گمشدهتان چیست، بنابراین

156

00:05:31,039 –> 00:05:33,440

در این مورد np dot nan چند

157

00:05:33,440 –> 00:05:35,520

تکرار میخواهید اجرا کنید

158

00:05:35,520 –> 00:05:37,039

امپدانس ترتیب انتساب شما چیست و ترتیب

159

00:05:37,039 –> 00:05:38,639

به معنای ستون چپ به راست یا راست به چپ

160

00:05:38,639 –> 00:05:40,639

است که میخواهید بروید

161

00:05:40,639 –> 00:05:42,400

و سپس شما می توانم این را اجرا کنم، بنابراین اجازه دهید

162

00:05:42,400 –> 00:05:44,400

یک بار این را در مقابل شما

163

00:05:44,400 –> 00:05:47,360

اجرا کنم، بنابراین اگر این را درست اجرا کنم، می بینید که

164

00:05:47,360 –> 00:05:49,120

معیارهای توقف زودهنگام این است که به

165

00:05:49,120 –> 00:05:50,960

شما می گویم توقف اولیه چیست

166

00:05:50,960 –> 00:05:53,120

و چند آدرس

167

00:05:53,120 –> 00:05:55,120

پنج تکرار را پیدا می کنند

168

00:05:55,120 –> 00:05:57,440

و سپس مقادیر از دست رفته شما را پیدا می کنند.

169

00:05:57,440 –> 00:05:59,120

اگر اینجا را ببینید این داده های منتسب

170

00:05:59,120 –> 00:06:00,240

171

00:06:00,240 –> 00:06:02,479

شما هستند اکنون دیگر هیچ nanی را در اینجا نمی بینید

172

00:06:02,479 –> 00:06:03,360

173

00:06:03,360 –> 00:06:04,319

174

00:06:04,319 –> 00:06:06,880

بسیار خوب پس این یک رایانه تکراری است به یاد داشته باشید

175

00:06:06,880 –> 00:06:09,039

این رایانه تکراری بچه ها چگونه

176

00:06:09,039 –> 00:06:11,759

انجام دادید که چیزی به نام

177

00:06:11,759 –> 00:06:14,800

iterative imputing را در رایانه افزودنی پایتون نسبت دادید

178

00:06:14,800 –> 00:06:17,280

و آنها این کار را انجام دادند، همه

179

00:06:17,280 –> 00:06:19,600

ستون ها

180

00:06:19,600 –> 00:06:21,680

در یک نقطه از زمان بودند، همه ستون ها

181

00:06:21,680 –> 00:06:24,639

هدف بودند و بقیه ویژگی های فردی در

182

00:06:24,639 –> 00:06:26,720

نقطه دیگری از زمان یک ستون

183

00:06:26,720 –> 00:06:28,960

هدف قرار گرفتند، بقیه ویژگی های فردی بودند

184

00:06:28,960 –> 00:06:31,840

به صورت گام به گام هنگامی که تمام ستون

185

00:06:31,840 –> 00:06:34,319

ها پیش بینی شدند آن را یک تکرار می نامیم

186

00:06:34,319 –> 00:06:35,520

و سپس

187

00:06:35,520 –> 00:06:37,039

آن را با پیش فرض

188

00:06:37,039 –> 00:06:39,199

پیش فرض مقایسه می کنیم و می

189

00:06:39,199 –> 00:06:41,600

دانید که سعی می شود بهینه شود

190

00:06:41,600 –> 00:06:43,759

این به عنوان رایانه افزودنی شما

191

00:06:43,759 –> 00:06:45,680

در پایتون نامیده می شود، می توانید از آن استفاده کنید

192

00:06:45,680 –> 00:06:47,280

جالب است. گزینهها در

193

00:06:47,280 –> 00:06:49,120

رایانههای تکراری به عنوان مثال استراتژی اولیه هستند،

194

00:06:49,120 –> 00:06:50,560

195

00:06:50,560 –> 00:06:52,800

همانطور که در اینجا به شما گفتم

196

00:06:52,800 –> 00:06:55,360

، در ابتدا به معنای impute است، بنابراین

197

00:06:55,360 –> 00:06:57,120

میتوانید با استفاده از پارامتر استراتژی اولیه

198

00:06:57,120 –> 00:06:59,440

خوب

199

00:06:59,440 –> 00:07:02,560

و ترتیب انتساب درست را تغییر دهید.

200

00:07:02,560 –> 00:07:05,039

201

00:07:05,039 –> 00:07:07,599

می دانم ستون اول من

202

00:07:07,599 –> 00:07:09,199

را به عنوان هدف من

203

00:07:09,199 –> 00:07:10,400

در

204

00:07:10,400 –> 00:07:12,240

گام دوم بگیرم، می خواهم ستون دومم را به

205

00:07:12,240 –> 00:07:14,319

عنوان هدف بگیرم و غیره و غیره شما

206

00:07:14,319 –> 00:07:16,160

می توانید آن را عربی کنید و مانند

207

00:07:16,160 –> 00:07:18,880

این ستون آخر به عنوان اولین

208

00:07:18,880 –> 00:07:21,039

متغیر هدف قرار می گیرد. به همین ترتیب و

209

00:07:21,039 –> 00:07:24,160

غیره، بنابراین چند داده منتسب را

210

00:07:24,160 –> 00:07:25,440

در اینجا مشاهده می کنید

211

00:07:25,440 –> 00:07:27,680

یک نتیجه یک خروجی تفاوت را درک کنید

212

00:07:27,680 –> 00:07:29,360

این یک

213

00:07:29,360 –> 00:07:32,240

انتساب چندگانه نیست، خوب این یک انتساب واحد است

214

00:07:32,240 –> 00:07:34,880

نه یک انتساب چندگانه

215

00:07:34,880 –> 00:07:36,880

تکراری اما تکی به این معنی است که

216

00:07:36,880 –> 00:07:39,039

فقط یک مقدار به شما می دهد، فقط یک

217

00:07:39,039 –> 00:07:41,039

مقدار نسبت داده شده در پایان خوب است،

218

00:07:41,039 –> 00:07:45,120

این در نهایت مقدار انتساب شما خوب است،

219

00:07:45,120 –> 00:07:46,960

حالا فرض کنید

220

00:07:46,960 –> 00:07:49,520

من می خواهم چیزی داشته باشم که به عنوان

221

00:07:49,520 –> 00:07:51,680

انتساب چندگانه شناخته

222

00:07:51,680 –> 00:07:54,000

می شود. همانطور که من در تئوری میگفتم که

223

00:07:54,000 –> 00:07:56,240

شما در ویدیوی تئوری

224

00:07:56,240 –> 00:07:58,800

چندین نسخه از شهرت را درست میگویید، بنابراین

225

00:07:58,800 –> 00:08:00,879

یک انتساب یک داده دوم امپدانس

226

00:08:00,879 –> 00:08:02,160

و داده دوم امپدانس سوم و

227

00:08:02,160 –> 00:08:03,840

داده سوم درست است،

228

00:08:03,840 –> 00:08:05,919

بنابراین یک بسته در پایتون وجود دارد که به عنوان ماوس شناخته میشود

229

00:08:05,919 –> 00:08:08,479

و نه موش، بسته cjr من

230

00:08:08,479 –> 00:08:09,520

اساساً

231

00:08:09,520 –> 00:08:12,160

بسته پایتون است. به عنوان جنگل موش شناخته میشود،

232

00:08:12,160 –> 00:08:12,960

233

00:08:12,960 –> 00:08:15,759

بنابراین جنگل موشها چه کاری انجام میدهد این است که

234

00:08:15,759 –> 00:08:17,599

پنج مجموعه داده مختلف را به

235

00:08:17,599 –> 00:08:19,199

عنوان مثال میگویم مجموعه دادههای شما

236

00:08:19,199 –> 00:08:20,639

برابر با پنج است

237

00:08:20,639 –> 00:08:22,080

، به شما پنج

238

00:08:22,080 –> 00:08:25,120

انتساب متفاوت برای یک مقدار داده میدهد،

239

00:08:25,120 –> 00:08:27,599

خوب، چگونه اجرا میکنید. البته اگر

240

00:08:27,599 –> 00:08:29,120

این بسته را ندارید، باید این بسته را

241

00:08:29,120 –> 00:08:30,879

داشته باشید،

242

00:08:30,879 –> 00:08:32,559

من دارم

243

00:08:32,559 –> 00:08:34,559

دادههایم را میخوانم و میگویم هسته imputation، میگویم دادههای من را بگیر

244

00:08:34,559 –> 00:08:37,760

پنج مجموعه داده همه

245

00:08:37,760 –> 00:08:40,240

دلایل من را ذخیره کنید به این معنی است که تمام نتایج من را به حالت تصادفی ذخیره کنید

246

00:08:40,240 –> 00:08:42,080

فقط برای بازسازی

247

00:08:42,080 –> 00:08:43,360

و سپس من

248

00:08:43,360 –> 00:08:45,360

الگوریتم موش ها را اجرا می کنم، بنابراین اگر می

249

00:08:45,360 –> 00:08:47,839

توانید اینجا را ببینید که اکنون در حال اجرا است

250

00:08:47,839 –> 00:08:49,60