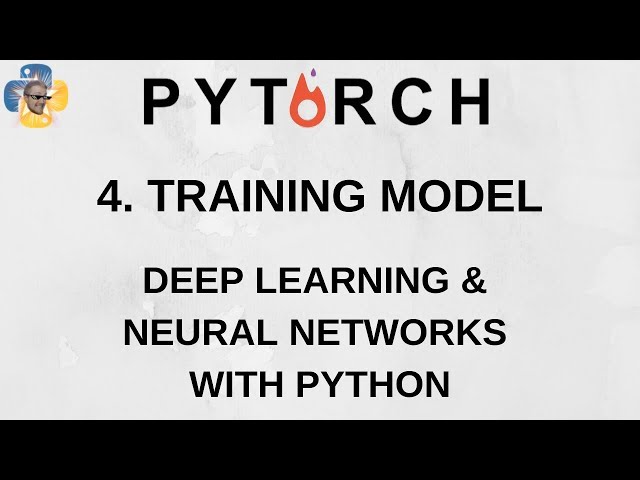

در این مطلب، ویدئو مدل آموزشی – یادگیری عمیق و شبکه های عصبی با پایتون و پایتورچ p.4 با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:30:55

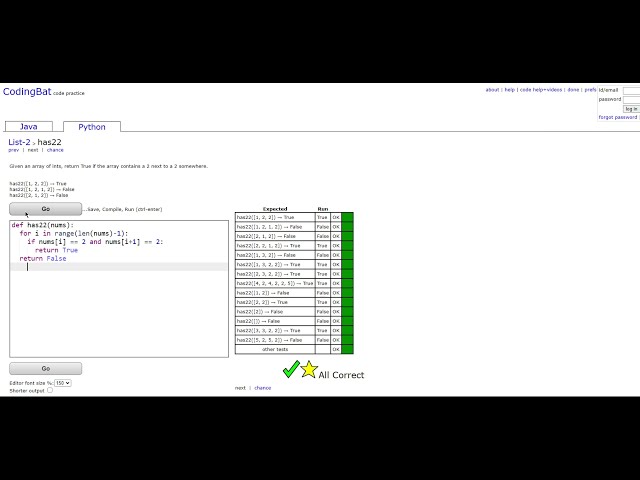

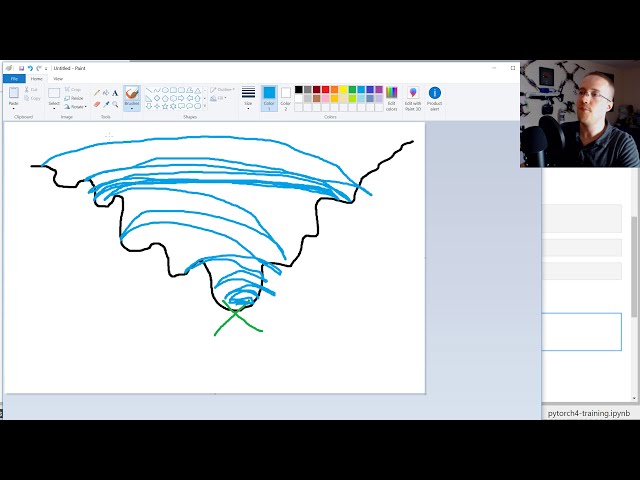

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:01,159 –> 00:00:03,780

چه اتفاقی برای همه می افتد و به

2

00:00:03,780 –> 00:00:06,120

بخش 4 آموزش عمیق با

3

00:00:06,120 –> 00:00:08,610

مشعل PI و آموزش پایتون در این

4

00:00:08,610 –> 00:00:09,870

آموزش خوش آمدید آنچه که ما می خواهیم انجام دهیم این است که

5

00:00:09,870 –> 00:00:12,090

اساساً با آنچه در

6

00:00:12,090 –> 00:00:13,889

اینجا داریم ادامه دهیم، بنابراین در مورد

7

00:00:13,889 –> 00:00:16,289

دریافت برخی از آنها صحبت کرده ایم. دادههایی که فکر میکنم

8

00:00:16,289 –> 00:00:18,210

کمی تقلب کردهایم، اما

9

00:00:18,210 –> 00:00:20,670

دادههایی داریم که شبکه عصبی خود را ساختهایم،

10

00:00:20,670 –> 00:00:22,199

دادههایی را از طریق آن شبکه عصبی ارسال کرده

11

00:00:22,199 –> 00:00:24,480

بودیم، پاسخ دریافت کردند، اما اکنون آنچه

12

00:00:24,480 –> 00:00:25,890

میخواهیم درباره آن صحبت کنیم این است که در واقع چگونه

13

00:00:25,890 –> 00:00:27,930

از طریق شما عبور کنیم. داده های برچسب گذاری شده را بشناسید

14

00:00:27,930 –> 00:00:30,300

و در واقع مدل را طوری آموزش دهید که

15

00:00:30,300 –> 00:00:32,729

امیدواریم بتوانیم هر آنچه

16

00:00:32,729 –> 00:00:34,320

را که می گذرانیم تشخیص دهد، بنابراین در این مورد

17

00:00:34,320 –> 00:00:37,320

ارقام دست نویس است، بنابراین ایده این است که

18

00:00:37,320 –> 00:00:38,700

این مدل را به نقطه ای برسانیم که

19

00:00:38,700 –> 00:00:40,500

بتوانیم آن را با ارقامی نشان دهیم که قبلاً هرگز دیده نشده است.

20

00:00:40,500 –> 00:00:43,440

و امیدوارم بتواند پیشبینی کند و

21

00:00:43,440 –> 00:00:45,719

تشخیص دهد که این یک هفت یا سه

22

00:00:45,719 –> 00:00:49,320

یا هر چیز دیگری است، بنابراین بله، بیایید

23

00:00:49,320 –> 00:00:51,120

شروع کنیم، بنابراین برای انجام آن

24

00:00:51,120 –> 00:00:53,309

دو مفهوم جدید وجود دارد که باید در

25

00:00:53,309 –> 00:00:56,730

مورد آنها صحبت کنیم، یکی ضرر و دیگری

26

00:00:56,730 –> 00:00:59,579

یک بهینهساز است. هنگامی که آن را ج

27

00:00:59,579 –> 00:01:03,619

این فقط معیاری است برای اینکه

28

00:01:03,619 –> 00:01:07,619

مدل چقدر اشتباه است، بنابراین هدف ما در طول

29

00:01:07,619 –> 00:01:10,290

زمان کاهش زیان است، بنابراین حتی اگر

30

00:01:10,290 –> 00:01:13,409

مدلی به درستی پیشبینی کند، شما

31

00:01:13,409 –> 00:01:15,600

از نظر حداکثر سازمان یا هر خروجی دیگری میدانید.

32

00:01:15,600 –> 00:01:16,790

این احتمال درست است

33

00:01:16,790 –> 00:01:19,770

که مدل حداقل از جهاتی اشتباه بوده است

34

00:01:19,770 –> 00:01:22,350

، کامل

35

00:01:22,350 –> 00:01:24,060

نبود، به هیچ یک از پیشبینیهایش صد در صد مطمئن نبود

36

00:01:24,060 –> 00:01:26,250

و شاید

37

00:01:26,250 –> 00:01:28,020

شصت درصد مطمئن بود که این چیزی

38

00:01:28,020 –> 00:01:29,939

است که به درستی پیشبینی کرده است.

39

00:01:29,939 –> 00:01:31,590

همچنین بیست درصد مطمئن بود

40

00:01:31,590 –> 00:01:34,860

چیز دیگری است که هنوز کاملاً

41

00:01:34,860 –> 00:01:36,479

صحیح نیست، درجاتی از خطا

42

00:01:36,479 –> 00:01:38,040

وجود دارد زیرا ما می خواهیم صد در

43

00:01:38,040 –> 00:01:40,979

صد مطمئن باشد تا ضررش همین باشد

44

00:01:40,979 –> 00:01:43,229

و سپس بهینه ساز وظیفه اش این

45

00:01:43,229 –> 00:01:44,939

است که از آن عبور کند و وزن ها را تنظیم کند.

46

00:01:44,939 –> 00:01:46,680

بر اساس تلفات بر اساس

47

00:01:46,680 –> 00:01:50,520

این گرادیان ها، می خواهد

48

00:01:50,520 –> 00:01:52,710

تمام وزن های ممکن را که

49

00:01:52,710 –> 00:01:56,130

می تواند تنظیم کند، بهینه سازی و تنظیم کند به گونه ای که در

50

00:01:56,130 –> 00:02:00,810

طول زمان تلفات را به آرامی کاهش دهد و

51

00:02:00,810 –> 00:02:02,549

به آرامی در طول زمان بر اساس

52

00:02:02,549 –> 00:02:07,320

نرخ یادگیری که ما از آن استفاده می کنیم، پس بیایید

53

00:02:07,320 –> 00:02:08,729

جلو برویم و مقداری واردات انجام دهیم و سپس

54

00:02:08,729 –> 00:02:11,849

من به طور خلاصه تصاویر شگفت انگیزی

55

00:02:11,849 –> 00:02:12,920

از

56

00:02:12,920 –> 00:02:16,420

نرخ یادگیری نشان می دهم، بنابراین مشعل بهینه را به عنوان بهینه وارد کنید

57

00:02:16,420 –> 00:02:18,790

و اکنون می خواهیم بگوییم که

58

00:02:18,790 –> 00:02:23,660

بهینه ساز برابر بهینه است و سپس Adam

59

00:02:23,660 –> 00:02:25,640

است. در حال حاضر دو پارامتر را می گیریم

60

00:02:25,640 –> 00:02:27,140

که اولی پارامترهای نقطه خالص خواهد بود.

61

00:02:27,140 –> 00:02:30,200

این مربوط

62

00:02:30,200 –> 00:02:33,709

به هر چیزی است که در مدل ما قابل تنظیم

63

00:02:33,709 –> 00:02:36,500

است، بنابراین چیزهایی وجود دارد که

64

00:02:36,500 –> 00:02:38,870

لزوماً لازم نیست قابل تنظیم باشند

65

00:02:38,870 –> 00:02:40,970

، بنابراین ممکن است لایه ها و شبکه عصبی شما وجود داشته باشد.

66

00:02:40,970 –> 00:02:42,410

و این درست خواهد بود،

67

00:02:42,410 –> 00:02:45,709

به خصوص اگر شما یادگیری انتقالی را انجام دهید،

68

00:02:45,709 –> 00:02:47,750

جایی که شاید مدلی داشته باشید که

69

00:02:47,750 –> 00:02:49,880

بر روی میلیون ها تصویر آموزش دیده است تا

70

00:02:49,880 –> 00:02:53,150

طبقه بندی را تشخیص دهد یا هر آنچه که آن

71

00:02:53,150 –> 00:02:55,489

چند لایه اول قرار است

72

00:02:55,489 –> 00:02:57,950

در انواع بسیار کوچک و کلی بسیار خوب باشد.

73

00:02:57,950 –> 00:03:00,350

وظایف تشخیص تصویر و

74

00:03:00,350 –> 00:03:01,760

سپس لایههای بعدی بسیار

75

00:03:01,760 –> 00:03:03,920

مختص به وظایفی هستند

76

00:03:03,920 –> 00:03:06,590

که شما آن را به خوبی آموزش

77

00:03:06,590 –> 00:03:09,200

78

00:03:09,200 –> 00:03:11,510

دادهاید. بله و سپس فقط اجازه دهید

79

00:03:11,510 –> 00:03:14,390

مدل یا بهینهساز وزنها را

80

00:03:14,390 –> 00:03:16,970

مانند لایههای آخر تنظیم کند و بعداً

81

00:03:16,970 –> 00:03:18,500

کمی بیشتر در مورد انتقال یادگیری صحبت خواهیم کرد،

82

00:03:18,500 –> 00:03:21,829

اما فقط بدانید که این

83

00:03:21,829 –> 00:03:23,390

کاری است که میتوانید انجام دهید و در واقع میتوانید به

84

00:03:23,390 –> 00:03:25,190

آنها بگویید Network Hey

85

00:03:25,190 –> 00:03:27,079

در اینجا، شیب ها را محاسبه نکنید، این وزن ها را تنظیم نکنید

86

00:03:27,079 –> 00:03:30,920

و سپس فقط

87

00:03:30,920 –> 00:03:32,750

وزن های خاصی را در مدل می شناسید

88

00:03:32,750 –> 00:03:35,870

، اما در حال حاضر ما اساساً

89

00:03:35,870 –> 00:03:37,100

همه چیز را داریم، زیرا ما طعمه نکرده ایم

90

00:03:37,100 –> 00:03:40,549

Eve alt قابل تنظیم است.

91

00:03:40,549 –> 00:03:42,049

دوست دارم که گفتم بعداً در مورد

92

00:03:42,049 –> 00:03:44,030

اینکه چگونه می توانید آنها را منجمد کنید و

93

00:03:44,030 –> 00:03:45,410

چرا ممکن است بخواهید این کار را انجام دهید صحبت خواهیم کرد، اما به هر

94

00:03:45,410 –> 00:03:48,260

حال اولین پارامتر این است که چه چیزی

95

00:03:48,260 –> 00:03:50,900

توسط این بهینه ساز قابل تنظیم است و سپس

96

00:03:50,900 –> 00:03:52,910

نرخ یادگیری ما را مشخص می کنیم.

97

00:03:52,910 –> 00:03:56,450

به عنوان 0.001 پیش می رود، شما اغلب این یکی را

98

00:03:56,450 –> 00:03:58,819

منفی 3 می بینید و فقط به همین

99

00:03:58,819 –> 00:04:01,400

معنی است، پس به چه معناست که

100

00:04:01,400 –> 00:04:02,600

این نرخ یادگیری چقدر است که چگونه

101

00:04:02,600 –> 00:04:06,799

با زمان های آموزش مطابقت دارد و

102

00:04:06,799 –> 00:04:08,090

مدل ها در واقع چقدر خوب می خواهند

103

00:04:08,090 –> 00:04:10,790

برای آن یاد بگیرند. من این r را کشیده ام

104

00:04:10,790 –> 00:04:13,370

این بسیار زیباست، اجازه دهید آن را

105

00:04:13,370 –> 00:04:17,180

منحنی بهینهسازی بنامیم، بنابراین هدف این است که

106

00:04:17,180 –> 00:04:19,850

اکنون به اینجا برسیم تا مدل شما

107

00:04:19,850 –> 00:04:22,180

یاد بگیرد و در واقع به این نقطه

108

00:04:22,180 –> 00:04:24,349

برسیم.

109

00:04:24,349 –> 00:04:26,300

110

00:04:26,300 –> 00:04:27,889

آن نقطه احتمالاً می تواند

111

00:04:27,889 –> 00:04:30,139

شما را متوجه این نکته کند و هنوز هم عملکرد بسیار

112

00:04:30,139 –> 00:04:32,060

خوبی داشته باشد، هنوز در

113

00:04:32,060 –> 00:04:34,280

پیش بینی چیزها بسیار دقیق باشید، اما هدف رسیدن

114

00:04:34,280 –> 00:04:37,940

به این نقطه است، نرخ یادگیری تا حدی

115

00:04:37,940 –> 00:04:41,990

اندازه مرحله ای را که

116

00:04:41,990 –> 00:04:44,560

بهینه ساز شما برای رسیدن به آن برمی دارد تعیین می کند. به بهترین

117

00:04:44,560 –> 00:04:45,710

مکان،

118

00:04:45,710 –> 00:04:47,930

بنابراین هر زمان که دادهها را از طریق این

119

00:04:47,930 –> 00:04:50,979

شبکه معمولی ارسال میکنید، ضرر دریافت میکنید،

120

00:04:50,979 –> 00:04:56,930

کاملاً قابل محاسبه است تا مشخص کنیم که چه

121

00:04:56,930 –> 00:05:00,080

وزنهایی برای از دست دادن صفر شدن

122

00:05:00,080 –> 00:05:02,780

نیاز داریم تا دقت کاملی در

123

00:05:02,780 –> 00:05:05,900

دادههایی که ارسال کردهایم، یک

124

00:05:05,900 –> 00:05:07,550

عملیات ساده ریاضی است. ما

125

00:05:07,550 –> 00:05:09,620

قطعاً میتوانیم کاری را انجام دهیم که نمیخواهیم این کار را انجام دهیم،

126

00:05:09,620 –> 00:05:11,750

زیرا در آن صورت یا اگر این کار را انجام دهیم،

127

00:05:11,750 –> 00:05:13,819

100٪ میشود، ما فقط

128

00:05:13,819 –> 00:05:16,039

به هر دستهای که از آن عبور میکند بیش از حد مناسب

129

00:05:16,039 –> 00:05:17,889

میشویم و اساساً این کار را انجام میدهیم.

130

00:05:17,889 –> 00:05:19,909

ov همه چیزهایی را که

131

00:05:19,909 –> 00:05:21,440

پیش میآید تطبیق میدهیم، بنابراین از نرخ یادگیری استفاده میکنیم تا

132

00:05:21,440 –> 00:05:24,440

به بهینهساز بگوییم که بهینهسازی

133

00:05:24,440 –> 00:05:26,270

ضرر را کاهش دهد، اما فقط گامهای اندازه خاصی را بردارید

134

00:05:26,270 –> 00:05:29,930

و سپس با گذشت زمان، همانطور که

135

00:05:29,930 –> 00:05:34,069

آن مراحل را انجام میدهید، بخشی از

136

00:05:34,069 –> 00:05:35,930

مراحل برداشته شده، تغییراتی است که انجام

137

00:05:35,930 –> 00:05:37,009

شد. ساخته شده است که ما اساساً

138

00:05:37,009 –> 00:05:39,740

فقط بر اساس دادههای ارسال شده هستیم، به

139

00:05:39,740 –> 00:05:41,479

نوعی بازنویسی میشود و وقتی

140

00:05:41,479 –> 00:05:43,520

باقی میمانیم که دستهای به دستهای پشت سر هم میرویم،

141

00:05:43,520 –> 00:05:46,039

چیزی که برای ما باقی میماند،

142

00:05:46,039 –> 00:05:48,740

اصول کلی واقعی است، اما به هر حال من دوری میکنم،

143

00:05:48,740 –> 00:05:51,050

اجازه دهید در مورد آن صحبت کنیم. نرخ یادگیری و

144

00:05:51,050 –> 00:05:52,849

اندازه گام، بنابراین فرض کنید شما این

145

00:05:52,849 –> 00:05:54,740

بهینه ساز را دارید و به آن می گویید هی

146

00:05:54,740 –> 00:05:56,719

واقعا سریع یاد بگیرید، فقط تا جایی

147

00:05:56,719 –> 00:05:59,180

که می توانید گام های بزرگ بردارید سریع بروید، مشکل

148

00:05:59,180 –> 00:06:01,219

این است که گام هایی را بردارید که انگار

149

00:06:01,219 –> 00:06:03,860

این را درست می دانید و سپس اینجا به

150

00:06:03,860 –> 00:06:06,319

اینجا می رسد و سپس فقط نگه می دارد که

151

00:06:06,319 –> 00:06:09,289

نمی تواند کمتر از آن درست باشد، بنابراین

152

00:06:09,289 –> 00:06:11,719

اگر سرعت یادگیری خیلی

153

00:06:11,719 –> 00:06:13,729

سریع و خیلی زیاد دارید، این

154

00:06:13,729 –> 00:06:15,830

گام های عظیم را برمی دارد و در واقع هرگز

155

00:06:15,830 –> 00:06:18,400

به نقطه اصلی نمی رسد. ما میخواهیم

156

00:06:18,400 –> 00:06:20,750

برعکس، اگر قدم خیلی کوچکی دارید که

157

00:06:20,750 –> 00:06:22,250

158

00:06:22,250 –> 00:06:25,400

برمیدارید، میروید و در اینجا گیر کردهاید،

159

00:06:25,400 –> 00:06:28,729

هرگز به جایی نرسیدید، بنابراین آنچه واقعاً

160

00:06:28,729 –> 00:06:30,440

به آن نیاز دارید، چیزی است

161

00:06:30,440 –> 00:06:33,800

که درست انجام میشود. مرحله اندازه، بنابراین فرض کنید این

162

00:06:33,800 –> 00:06:35,570

گامهایی مانند این را برمیدارد، فقط به آرامی

163

00:06:35,570 –> 00:06:38,089

پایین میآید که

164

00:06:38,089 –> 00:06:39,920

165

00:06:39,920 –> 00:06:43,040

166

00:06:43,040 –> 00:06:45,080

167

00:06:45,080 –> 00:06:48,800

باید به آن برسد. بنابراین، کاری که

168

00:06:48,800 –> 00:06:51,500

ما معمولاً در کارهای پیچیدهتر

169

00:06:51,500 –> 00:06:54,230

انجام میدهیم این است که ما چیزی را انجام میدهیم که

170

00:06:54,230 –> 00:06:56,330

نرخ یادگیری رو به زوال نامیده میشود و به روشی که این کار میکند و

171

00:06:56,330 –> 00:06:58,220

با این مراحل عظیم شروع میشود،

172

00:06:58,220 –> 00:07:00,410

اما با گذشت زمان سرعت یادگیری

173

00:07:00,410 –> 00:07:02,450

به آرامی کوچکتر و کوچکتر میشود، بنابراین

174

00:07:02,450 –> 00:07:04,490

شروع به گرفتن این میزان عظیم میکند. ممکن است قدمها

175

00:07:04,490 –> 00:07:06,980

در این حداقل منطقه گیر کنند،

176

00:07:06,980 –> 00:07:09,470

اما بعد درست کوچکتر میشود

177

00:07:09,470 –> 00:07:11,780

و سپس کوچکتر و کوچکتر میشود و بنابراین

178

00:07:11,780 –> 00:07:14,120

اساساً ایده این است که به شما کمک میکند

179

00:07:14,120 –> 00:07:17,260

این نوع کوه را بفرستید

180

00:07:17,260 –> 00:07:20,150

و به جایی که میخواهید برسید. نه

181

00:07:20,150 –> 00:07:22,340

برای بسیاری از مشکلات مانند من گفتم اگر

182

00:07:22,340 –> 00:07:24,350

به اینجا پایان دهید، حتی اگر می توانید

183

00:07:24,350 –> 00:07:26,690

به این نقطه برسید، اگر

184

00:07:26,690 –> 00:07:28,430

به اینجا برسید و در کارهایی که

185

00:07:28,430 –> 00:07:29,720

ما در حال حاضر انجام خواهیم داد، خوب

186

00:07:29,720 –> 00:07:31,520

خواهید بود. برای کاهش سرعت یادگیری، فقط

187

00:07:31,520 –> 00:07:34,340

پیچیدگی بیشتر و بیشتر میافزاید، در

188

00:07:34,340 –> 00:07:35,960

نهایت سرعت یادگیری کاهش مییابد،

189

00:07:35,960 –> 00:07:37,670

زیرا این کاری است که شما

190

00:07:37,670 –> 00:07:40,550

باید در مورد اکثر مسائل واقعی در

191

00:07:40,550 –> 00:07:42,200

مسئلهای مانند این انجام دهید،

192

00:07:42,200 –> 00:07:44,510

حل مسئله برای مدلها بسیار آسان است، بنابراین ما فقط

193

00:07:44,510 –> 00:07:46,640

لازم نیست، اما ما در مورد آن صحبت خواهیم

194

00:07:46,640 –> 00:07:48,140

کرد و این بدان معناست که من مجبور نخواهم

195

00:07:48,140 –> 00:07:49,610

بود بیشتر نقاشی

196

00:07:49,610 –> 00:07:51,050

بکشم، این ممکن است آخرین تصویری باشد که باید برای شما بکشم،

197

00:07:51,050 –> 00:07:54,490

بنابراین شما خوش آمدید، بنابراین به هر حال

198

00:07:54,490 –> 00:07:59,060

ما خودمان را داریم بهینه ساز در حال حاضر و دوباره تنها کاری

199

00:07:59,060 –> 00:08:00,050

که ما می خواهیم انجام دهیم این است که

200

00:08:00,050 –> 00:08:02,630

ضرر را بر اساس خروجی محاسبه می کنیم، بنابراین

201

00:08:02,630 –> 00:08:04,460

شما خروجی مدل ها را دریافت می کنید،

202

00:08:04,460 –> 00:08:06,590

خروجی هدفمند خروجی مورد نظر را دریافت می کنید

203

00:08:06,590 –> 00:08:08,990

و محاسبه می کنید که چقدر اشتباه است و سپس آن را دوباره

204

00:08:08,990 –> 00:08:11,720

اعمال می کنیم. کل شبکه

205

00:08:11,720 –> 00:08:14,210

وزن ها را بر اساس از دست دادن تنظیم می کنیم

206

00:08:14,210 –> 00:08:16,400

و سپس ما فقط به انجام این کار ادامه می دهیم، فقط

207

00:08:16,400 –> 00:08:17,810

داده ها را ارسال می کنیم و سپس امیدواریم

208

00:08:17,810 –> 00:08:20,600

که ضرر اضافه کار سقوط کند و با کاهش ضرر

209

00:08:20,600 –> 00:08:22,700

، انتظار این است که دقت

210

00:08:22,700 –> 00:08:25,700

نیز بهبود یابد، اما مدل در واقع

211

00:08:25,700 –> 00:08:29,450

اینطور نیست، ما برای دقت بهینه نمی کنیم، بلکه

212

00:08:29,450 –> 00:08:31,280

برای از دست دادن آن را بهینه می کنیم. اتفاق میافتد

213

00:08:31,280 –> 00:08:34,909

که دقت از آن پیروی میکند، بنابراین اجازه دهید

214

00:08:34,909 –> 00:08:38,330

به آن برسیم، بنابراین کاری که میخواهیم انجام دهیم این است که میخواهیم

215

00:08:38,330 –> 00:08:40,700

همه دادههایمان را تکرار کنیم، آن را

216

00:08:40,700 –> 00:08:44,390

از طریق مدل ارسال کنیم، اما معمولاً

217

00:08:44,390 –> 00:08:46,190

میخواهیم حداقل چند بار

218

00:08:46,190 –> 00:08:48,440

از طریق دادههایمان یک پاس کامل را تکرار کنیم.

219

00:08:48,440 –> 00:08:50,660

دادههای ما چیزی است که دوره نامیده میشود و میخواهیم

220

00:08:50,660 –> 00:08:52,370

بگوییم که دورهها برابر با سه است، بنابراین

221

00:08:52,370 –> 00:08:53,720

میخواهیم سه گذر کامل

222

00:08:53,720 –> 00:08:56,269

از کل مجموعه

223

00:08:56,269 –> 00:08:58,879

دادههایمان انجام دهیم، بنابراین کاری که من انجام میدهم این است که

224

00:08:58,879 –> 00:09:03,350

فضایی را در اینجا ایجاد کنم تا چیزی را که میخواهیم بگوییم خنک کند.

225

00:09:03,350 –> 00:09:08,449

چهار دوره در محدوده هر چند

226

00:09:08,449 –> 00:09:10,819

دوره ما داریم چه کاری میخواهیم

227

00:09:10,819 –> 00:09:13,939

خوب انجام دهیم، میخواهیم بگوییم دادههای قلعه در

228

00:09:13,939 –> 00:09:18,529

مجموعه قطار و دوباره دادهها یک داده دستهای است

229

00:09:18,529 –> 00:09:23,899

دستهای از ویژگیها و برچسبها درست یا

230

00:09:23,899 –> 00:09:26,170

مجموعه ویژگیها احتمالا بهتر است

231

00:09:26,170 –> 00:09:28,850

چیزی که آن را f مجموعه eature دارای

232

00:09:28,850 –> 00:09:31,220

ویژگیهایی است، بنابراین شما ویژگیها

233

00:09:31,220 –> 00:09:34,040

و برچسبها یا اهداف خود را اساساً

234

00:09:34,040 –> 00:09:35,899

طبقهبندیهای خود را دریافت کردهاید، بنابراین آنچه که میخواهیم

235

00:09:35,899 –> 00:09:38,870

بگوییم این است که X کاما بزرگ Y

236

00:09:38,870 –> 00:09:40,790

برابر با داده است، بنابراین ما فقط میخواهیم

237

00:09:40,790 –> 00:09:43,490

بستهبندی را باز کنیم زیرا دادهها اساساً

238

00:09:43,490 –> 00:09:45,589

یک a من فکر می کنم این یک تاپل خواهد بود من

239

00:09:45,589 –> 00:09:46,939

واقعاً مطمئن نیستم فکر می کنم حدس می زنم که این

240

00:09:46,939 –> 00:09:48,889

یک تاپل باشد. حتی کسی مرا در این مورد تصحیح کرده

241

00:09:48,889 –> 00:09:50,569

است.

242

00:09:50,569 –> 00:09:52,730

243

00:09:52,730 –> 00:09:54,829

واقعاً از این برای داده استفاده نمیکنم، من فقط از

244

00:09:54,829 –> 00:09:56,540

آن در اینجا استفاده میکنم، زیرا در ابتدا آن را برای اهداف آموزشی ساده میکند، به

245

00:09:56,540 –> 00:09:57,620

246

00:09:57,620 –> 00:10:02,870

هر حال این محفظهای است که

247

00:10:02,870 –> 00:10:04,759

شامل ده مجموعه ویژگی است و

248

00:10:04,759 –> 00:10:06,620

مجموعه ویژگیها فقط مقادیر پیکسلهای خاکستری را انتخاب میکنند

249

00:10:06,620 –> 00:10:10,009

و سپس ده هدف برچسبگذاری میکنند

250

00:10:10,009 –> 00:10:11,000

هر چیزی که میخواهید تماس بگیرید. آنها

251

00:10:11,000 –> 00:10:13,309

کلاسی هستند که اساساً می گویند هی این یک

252

00:10:13,309 –> 00:10:15,589

سه است این یک هفت است این یک نه است و

253

00:10:15,589 –> 00:10:21,379

غیره بنابراین داده های XY بنابراین در واقع اجازه دهید من فقط

254

00:10:21,379 –> 00:10:30,949

Y را چاپ کنم.

255

00:10:30,949 –> 00:10:32,629

256

00:10:32,629 –> 00:10:37,000

و سپس هی بیایید X بزرگ X چاپ کنیم

257

00:10:37,000 –> 00:10:41,540

صفر و همچنین جالب است، بنابراین همانطور که

258

00:10:41,540 –> 00:10:42,769

می توانید ببینید این تصویر شماست، اینها

259

00:10:42,769 –> 00:10:45,439

فقط ردیف هایی از پیکسل هستند که اساساً

260

00:10:45,439 –> 00:10:47,089

باید آنها را صاف کنیم و سپس به

261

00:10:47,089 –> 00:10:48,800

اینجا می آییم و سپس تانسور را دریافت می کنید

262

00:10:48,800 –> 00:10:51,079

هی که اگر بخواهیم این کار را انجام دهیم

263

00:10:51,079 –> 00:10:53,329

نمودار این یک چهار و

264

00:10:53,329 –> 00:10:59,439

غیره جالب به نظر می رسد، بنابراین اجازه دهید مشخص کنم که داده های XY

265

00:10:59,439 –> 00:11:01,370

عالی هستند، خوب

266

00:11:01,370 –> 00:11:05,269

mmm، بنابراین هر بار که محاسبه می کنیم یا

267

00:11:05,269 –> 00:11:07,089

هر بار

268

00:11:07,089 –> 00:11:10,660

که این نوع را اجرا می کنیم، هر بار که

269

00:11:10,660 –> 00:11:16,360

ضرر را محاسبه می کنیم و مدلی را که می خواهیم شروع کنیم بهینه می کنیم.

270

00:11:16,360 –> 00:11:18,189

هر

271

00:11:18,189 –> 00:11:20,259

بار که ما واقعاً

272

00:11:20,259 –> 00:11:22,029

این شیب های کوچک را محاسبه می کنیم و تقریباً

273

00:11:22,029 –> 00:11:24,309

هر بار که داده ها را از طریق

274

00:11:24,309 –> 00:11:26,379

شبکه عصبی خود ارسال می کنید، چیزی که می خواهید انجام دهید این

275

00:11:26,379 –> 00:11:31,420

است که NetZero گرادیان زیرخط دار انجام دهید، اکنون

276

00:11:31,420 –> 00:11:33,220

ممکن است اینطور باشد، به عنوان مثال

277

00:11:33,220 –> 00:11:35,050

، دو دلیل وجود دارد. ما دادههایمان را دستهبندی میکنیم،

278

00:11:35,050 –> 00:11:37,509

یکی این است که زمان آموزش را افزایش یا کاهش میدهد،

279

00:11:37,509 –> 00:11:40,209

بنابراین اگر به صورت دستهای تمرین کنیم، سریعتر پیش میرود،

280

00:11:40,209 –> 00:11:42,639

اما

281

00:11:42,639 –> 00:11:44,529

به دلایلی که قبلاً مطرح کردم، نمیخواهیم کل مجموعه داده را پاس

282

00:11:44,529 –> 00:11:47,319

کنیم، اما ما همچنین

283

00:11:47,319 –> 00:11:51,009

دستهها را دوست داریم زیرا در در اینجا

284

00:11:51,009 –> 00:11:53,410

قانون کاهش بازدهی وجود دارد، اما

285

00:11:53,410 –> 00:11:56,100

جایی بین معمولاً 32 تا شاید

286

00:11:56,100 –> 00:11:59,559

128 از یک اندازه دستهای نیز به

287

00:11:59,559 –> 00:12:01,240

تعمیم آن کمک میکند – دو

288

00:12:01,240 –> 00:12:03,610

چیز برای ما پیش میآید، بنابراین ممکن است مواقعی پیش

289

00:12:03,610 –> 00:12:07,509

بیاید که از یک GPU بسیار ضعیف استفاده کنید

290

00:12:07,509 –> 00:12:09,490

یا لپتاپ یا شاید روی Raspberry

291

00:12:09,490 –> 00:12:10,899

Pi یا چیزی هستید که میخواهید مدلی را آموزش دهید

292

00:12:10,899 –> 00:12:13,629

که دلیل آن را چه کسی میداند و فقط میتوانید

293

00:12:13,629 –> 00:12:17,769

از یک مجموعه از ویژگیها و

294

00:12:17,769 –> 00:12:20,019

برچسبها در یک زمان عبور کنید و

295

00:12:20,019 –> 00:12:21,850

این کار را بسیار سخت میکند. برای اینکه شبکه عصبی

296

00:12:21,850 –> 00:12:24,759

یاد بگیرد، بنابراین در تئوری میتوانید

297

00:12:24,759 –> 00:12:29,740

به اطراف بروید و میتوانید برای هر 10

298

00:12:29,740 –> 00:12:31,509

نمونه یا 10 چیزی که از

299

00:12:31,509 –> 00:12:35,139

مدل عبور میکنید، سپس گرادیان را صفر کنید و سپس

300

00:12:35,139 –> 00:12:36,519

همه چیز را دوباره محاسبه کنید،

301

00:12:36,519 –> 00:12:38,230

زیرا اگر گرادیان را صفر نکنید

302

00:12:38,230 –> 00:12:39,790

فقط به جمع شدن با هم ادامه دهید،

303

00:12:39,790 –> 00:12:43,809

بنابراین من حدس میزنم مشعل PI این را

304

00:12:43,809 –> 00:12:47,649

در دستان شما میگذارد، بهنظرم موارد خاص

305

00:12:47,649 –> 00:12:50,290

مانند جایی که شما میتوانید در آن واحد فقط

306

00:12:50,290 –> 00:12:52,179

یک مجموعه از ویژگیها و برچسبها را از طریق

307

00:12:52,179 –> 00:12:53,860

مدل خود عبور دهید، زیرا از یک

308

00:12:53,860 –> 00:12:57,670

GPU کوچک یا چیزی دیگر استفاده میکنید. سی پی یو اما تو

309

00:12:57,670 –> 00:12:59,740

من واقعاً مطمئن نیستم که هنوز هم میخواهم از مزایای آموزش دستهای بهره

310

00:12:59,740 –> 00:13:01,959

ببرم، اما به هر حال

311

00:13:01,959 –> 00:13:05,350

فقط میدانم که میخواهیم با

312

00:13:05,350 –> 00:13:06,490

این شیبها از صفر شروع کنیم و دوباره این

313

00:13:06,490 –> 00:13:08,980

شیبها اساساً به

314

00:13:08,980 –> 00:13:11,319

نوعی مانع از دست دادن شما خواهند شد، مثلاً چقدر

315

00:13:11,319 –> 00:13:13,149

اشتباه کردید و سپس بهینهساز شما میرود

316

00:13:13,149 –> 00:13:15,939

و از آن گرادیانها

317

00:13:15,939 –> 00:13:18,399

برای بهینهسازی این وزنها استفاده میکند، بنابراین کار

318

00:13:18,399 –> 00:13:20,110

بعدی که میخواهیم انجام دهیم این است که

319

00:13:20,110 –> 00:13:20,590

در

320

00:13:20,590 –> 00:13:22,390

واقع دادهها را از طریق شبکه گذشته تا

321

00:13:22,390 –> 00:13:26,140

خروجی برابر با خالص باشد و سپس X نقطه

322

00:13:26,140 –> 00:13:29,620

نمای منفی یک را پاس میکنیم. شما همچنین می توانید این را بسازید،

323

00:13:29,620 –> 00:13:31,090

فقط می توانید بگویید هی این من است

324

00:13:31,090 –> 00:13:33,460

هر اندازه دسته من باشد، اما در این

325

00:13:33,460 –> 00:13:35,020

مورد منفی خوب است و سپس

326

00:13:35,020 –> 00:13:39,010

28 در 28 است، بنابراین 784 دوباره این

327

00:13:39,010 –> 00:13:42,850

ابعاد تصویر شما عالی است، فکر می

328

00:13:42,850 –> 00:13:44,680

کنم همه باید بسیار خوب باشند. برای همه قابل درک است،

329

00:13:44,680 –> 00:13:45,280

330

00:13:45,280 –> 00:13:48,340

پس وقتی خروجی گرفتیم چه کارهایی

331

00:13:48,340 –> 00:13:51,040

را میتوانیم به خوبی انجام دهیم، اکنون میتوانیم محاسبه کنیم

332

00:13:51,040 –> 00:13:54,100

که چقدر اشتباه کردیم، بنابراین آنچه

333

00:13:54,100 –> 00:13:56,890

میخواهیم بگوییم این است که ضرر برابر است و

334

00:13:56,890 –> 00:14:01,300

از تلفات عملکردی و سپس NLL استفاده میکنیم و

335

00:14:01,300 –> 00:14:04,740

ما می خواهیم بگوییم put و Y و

336

00:14:04,740 –> 00:14:06,970

بعداً در این سری می توانیم در مورد

337

00:14:06,970 –> 00:14:12,610

معیارها و توابع ضرر فعلاً

338

00:14:12,610 –> 00:14:14,980

حداقل به عنوان یک تازه وارد صحبت کنیم که من فرض می کنم

339

00:14:14,980 –> 00:14:17,560

بسیاری از مردم فقط می دانند

340

00:14:17,560 –> 00:14:21,010

که دو روش اصلی برای محاسبه ضرر وجود

341

00:14:21,010 –> 00:14:25,570

دارد. بردارها بنابراین

342

00:14:25,570 –> 00:14:27,220

خروجی شبکه عصبی ما در واقع

343

00:14:27,220 –> 00:14:29,290

یک بردار شکار 1 است، درست بیرون می آید و

344

00:14:29,290 –> 00:14:31,540

شما این بردار را دارید که در

345

00:14:31,540 –> 00:14:33,100

واقع یک بردار تک داغ نیست، اما

346

00:14:33,100 –> 00:14:35,740

امیدواریم که هدف این باشد که این بردار

347

00:14:35,740 –> 00:14:38,650

نبود بلکه یک بردار است. -بردار داغ به

348

00:14:38,650 –> 00:14:40,720

معنای واقعی کلمه دقیقاً مانند این آرایه است که در آن یک

349

00:14:40,720 –> 00:14:43,840

مقدار در سمت راست است، یکی داغ است،

350

00:14:43,840 –> 00:14:46,030

بنابراین مانند چیزی شبیه به این،

351

00:14:46,030 –> 00:14:49,330

این یک بردار داغ است و اگر

352

00:14:49,330 –> 00:14:54,100

داده های ورودی یا ورودی ما اهداف داشته باشند، بنابراین

353

00:14:54,100 –> 00:14:56,230

اگر آنها یکی بودند، حقیقت واقعی زمین هدف می گیرد.

354

00:14:56,230 –> 00:14:58,150

داغ ما احتمالاً از میانگین

355

00:14:58,150 –> 00:14:59,830

مربعات خطا استفاده می کنیم که معمولاً همانی است که من

356

00:14:59,830 –> 00:15:02,860

استفاده می کنم و سپس برای رگرسیون

357

00:15:02,860 –> 00:15:04,900

احتمالاً از چیز دیگری استفاده می کنید و سپس برای اینکه

358

00:15:04,900 –> 00:15:08,950

در این مورد معیارهای ما

359

00:15:08,950 –> 00:15:11,170

یک مقدار خوب نیستند، یک مقدار منفرد است، فقط یک

360

00:15:11,170 –> 00:15:14,140

مقدار اسکالر است، بنابراین وقتی داده فقط یک

361

00:15:14,140 –> 00:15:15,790

اسکالر v است البته شما باید از یک

362

00:15:15,790 –> 00:15:17,710

معیار تلفات متفاوت استفاده کنید، نمی توانید از میانگین مربعات خطا استفا