در این مطلب، ویدئو آموزش پایتون. رگرسیون ماشین تقویت کننده گرادیان با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:10:44

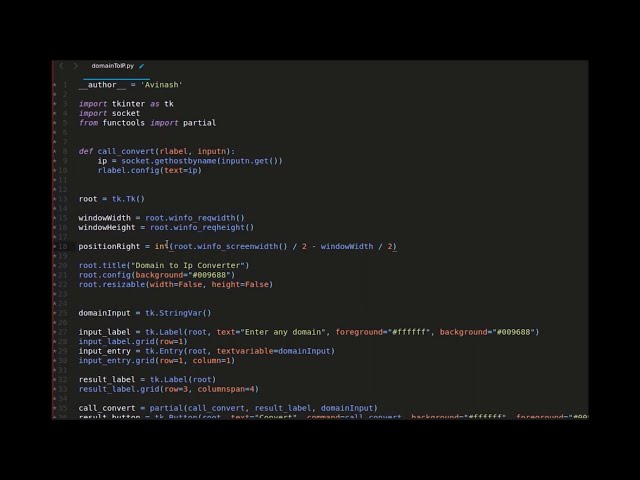

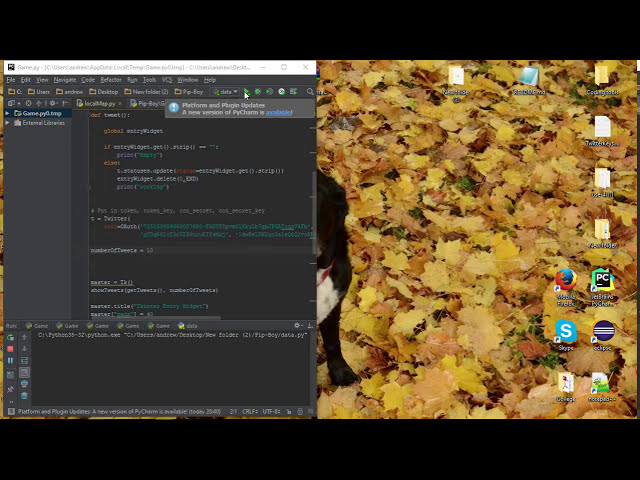

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:02,449 –> 00:00:05,549

یادگیری الگوریتم رگرسیون ماشینی تقویت گرادیان آموزش پایتون

2

00:00:05,549 –> 00:00:08,960

3

00:00:11,990 –> 00:00:14,430

شامل آموزش الگوریتم

4

00:00:14,430 –> 00:00:16,440

در زیرمجموعه داده های آموزشی برای

5

00:00:16,440 –> 00:00:18,270

تخمین پارامترهای بهینه و

6

00:00:18,270 –> 00:00:20,250

آزمایش الگوریتم در زیر مجموعه داده های آزمایشی

7

00:00:20,250 –> 00:00:22,110

با استفاده از پارامترهای بهینه سازی شده قبلی است که

8

00:00:22,110 –> 00:00:24,630

مربوط به

9

00:00:24,630 –> 00:00:26,490

10

00:00:26,490 –> 00:00:29,759

یک کار یادگیری ماشین رگرسیون نظارت شده است.

11

00:00:29,759 –> 00:00:32,098

Curse

12

00:00:32,098 –> 00:00:33,840

13

00:00:33,840 –> 00:00:35,370

با کلیک بر روی لینک در کادر توضیحات

14

00:00:35,370 –> 00:00:39,210

زیر نگاهی به برنامه درسی نفرین

15

00:00:39,210 –> 00:00:41,220

16

00:00:41,220 –> 00:00:42,989

17

00:00:42,989 –> 00:00:45,329

18

00:00:45,329 –> 00:00:47,190

19

00:00:47,190 –> 00:00:49,399

20

00:00:54,340 –> 00:00:56,540

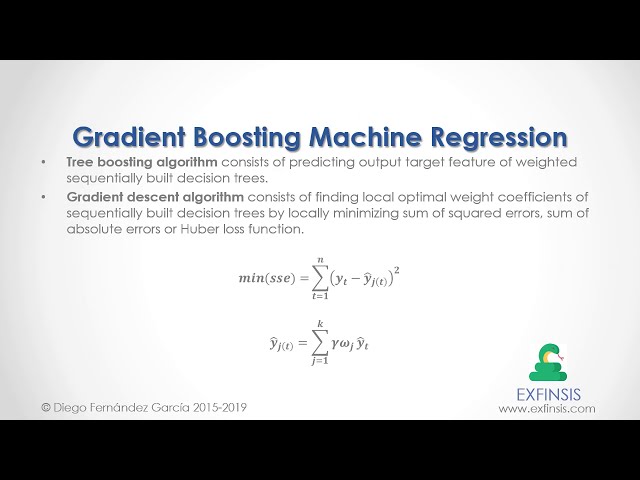

بیندازید. رگرسیون ماشین

21

00:00:56,540 –> 00:00:58,250

شامل الگوریتم مهتا یادگیری نظارت

22

00:00:58,250 –> 00:01:00,440

شده برای پیشبینی ویژگی هدف اپل

23

00:01:00,440 –> 00:01:02,000

با

24

00:01:02,000 –> 00:01:03,560

تقویت درختهای تصمیمگیری متوالی با وزن بهینه

25

00:01:03,560 –> 00:01:06,050

26

00:01:06,050 –> 00:01:08,090

27

00:01:08,090 –> 00:01:10,070

28

00:01:10,070 –> 00:01:13,520

است. برای

29

00:01:13,520 –> 00:01:14,900

مرجع کامل، توصیه میکنم

30

00:01:14,900 –> 00:01:17,750

تقریب تابع حریص فریدمن یک

31

00:01:17,750 –> 00:01:19,700

ماشین تقویت درجهبندی منتشر شده

32

00:01:19,700 –> 00:01:23,680

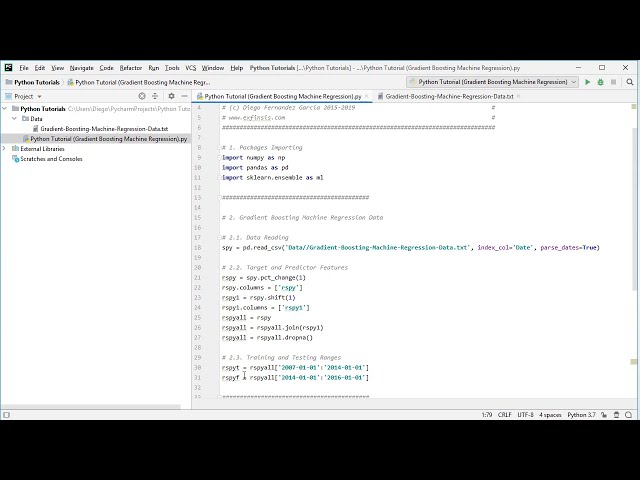

در سالنامه آمار در سال 2001 را مطالعه

33

00:01:23,770 –> 00:01:25,829

کنید.

34

00:01:29,060 –> 00:01:30,960

35

00:01:30,960 –> 00:01:32,909

الگوریتم طبقهبندی و درختان رگرسیون شامل رویکرد حریصانه از بالا به پایین

36

00:01:32,909 –> 00:01:34,860

برای یافتن

37

00:01:34,860 –> 00:01:37,290

تقسیمهای گره دودویی بازگشتی بهینه با کمینهسازی محلی

38

00:01:37,290 –> 00:01:39,000

انواع در ترمینال است. گره ها

39

00:01:39,000 –> 00:01:40,740

از طریق مجموع خطاهای مربعی تابع را در

40

00:01:40,740 –> 00:01:44,729

هر مرحله اندازه گیری می کنند به عنوان یک فرمول، ما

41

00:01:44,729 –> 00:01:46,350

کمینه سازی مجموع خطاهای مربعی

42

00:01:46,350 –> 00:01:47,970

برابر با مجموع اول تا

43

00:01:47,970 –> 00:01:49,590

آخر اختلاف بین

44

00:01:49,590 –> 00:01:52,350

داده های ویژگی هدف خروجی منهای

45

00:01:52,350 –> 00:01:53,850

میانگین ویژگی هدف خروجی گره پایانه داریم و

46

00:01:53,850 –> 00:01:57,410

نتیجه به توان دو

47

00:01:57,430 –> 00:01:59,720

گره ترمینال هدف خروجی مشخص شده است

48

00:01:59,720 –> 00:02:01,970

به این معنی که نوبت برابر است با 1 تقسیم بر M

49

00:02:01,970 –> 00:02:03,500

M تعداد تکرارها در

50

00:02:03,500 –> 00:02:05,540

گره ترمینال ضرب در نمونه

51

00:02:05,540 –> 00:02:07,490

اول تا آخرین

52

00:02:07,490 –> 00:02:09,970

داده های ویژگی هدف خروجی است

53

00:02:12,080 –> 00:02:14,140

که

54

00:02:14,220 –> 00:02:16,810

سعی می کنید تقویت الگوریتم شامل

55

00:02:16,810 –> 00:02:18,310

پیش بینی خروجی باشد. ویژگی هدف

56

00:02:18,310 –> 00:02:19,900

57

00:02:19,900 –> 00:02:23,620

ایجاد درختهای تصمیم با ساخت متوالی وزندار الگوریتم مناسب

58

00:02:23,620 –> 00:02:25,090

شامل یافتن ضرایب وزن بهینه محلی

59

00:02:25,090 –> 00:02:26,620

60

00:02:26,620 –> 00:02:28,990

درختان تصمیم گیری متوالی با کمینه سازی محلی مجموع

61

00:02:28,990 –> 00:02:31,180

خطاهای مجذور مجموع خطاهای مطلق

62

00:02:31,180 –> 00:02:35,380

یا تابع تلفات uber به عنوان فرمول است در

63

00:02:35,380 –> 00:02:37,060

اینجا مثالی از جمع کوچک

64

00:02:37,060 –> 00:02:38,890

مجموع مربعات خطاها داریم که برابر است

65

00:02:38,890 –> 00:02:40,360

با مجموع از اول تا

66

00:02:40,360 –> 00:02:42,250

آخر تفاوت بین هدف Alpo برای

67

00:02:42,250 –> 00:02:42,790

هر ایده

68

00:02:42,790 –> 00:02:44,980

– به طور متوالی ساخت درخت های تصمیم

69

00:02:44,980 –> 00:02:46,330

وزن دار خروجی ویژگی هدف

70

00:02:46,330 –> 00:02:48,490

مجموع پیش بینی و که نتیجه به

71

00:02:48,490 –> 00:02:50,970

توان دو

72

00:02:56,340 –> 00:02:58,600

درخت تصمیم گیری متوالی صورتحساب منتظر بود

73

00:02:58,600 –> 00:03:00,310

پیش بینی ویژگی هدف اپل برخی به

74

00:03:00,310 –> 00:03:03,370

نوبه خود برابر است با مجموع اولین

75

00:03:03,370 –> 00:03:05,110

تا آخرین K تعداد

76

00:03:05,110 –> 00:03:06,700

درخت های تصمیم گیری متوالی ساخته شده است و

77

00:03:06,700 –> 00:03:09,100

سپس ما ضریب منظم سازی نرخ یادگیری را در

78

00:03:09,100 –> 00:03:11,200

79

00:03:11,200 –> 00:03:12,850

80

00:03:12,850 –> 00:03:14,320

ضریب وزن درختان تصمیم گیری بهینه محلی

81

00:03:14,320 –> 00:03:16,210

ضرب در ساخت متوالی

82

00:03:16,210 –> 00:03:17,770

درختان تصمیم گیری در خروجی

83

00:03:17,770 –> 00:03:23,530

پیش بینی ویژگی هدف عالی داریم، پس بیایید به Python

84

00:03:23,530 –> 00:03:25,360

PyCharm IDE بروید تا بتوانیم مطالعه کنیم y

85

00:03:25,360 –> 00:03:27,070

رگرسیون ماشین تقویت کننده گرادیان

86

00:03:27,070 –> 00:03:30,150

با جزئیات بیشتر

87

00:03:32,430 –> 00:03:35,050

عالی است، بنابراین در اینجا ما در

88

00:03:35,050 –> 00:03:37,870

89

00:03:37,870 –> 00:03:40,000

90

00:03:40,000 –> 00:03:43,150

91

00:03:43,150 –> 00:03:44,560

92

00:03:44,560 –> 00:03:47,290

پایتون پایتون هستیم. دوباره

93

00:03:47,290 –> 00:03:50,800

پانداهای SMP numpy SPD را وارد می کنیم و

94

00:03:50,800 –> 00:03:52,330

آنها را از scikit-learn چاپ می کنیم، ما می خواهیم

95

00:03:52,330 –> 00:03:54,520

ویژگی را به عنوان ml برای

96

00:03:54,520 –> 00:03:57,730

الگوریتم یادگیری ماشین وارد کنیم و

97

00:03:57,730 –> 00:03:59,170

مرحله بعدی ایجاد داده برای

98

00:03:59,170 –> 00:04:01,270

رگرسیون ماشین افزایش گرادیان است که

99

00:04:01,270 –> 00:04:03,160

از طریق خواندن داده انجام می شود بنابراین ما این

100

00:04:03,160 –> 00:04:05,680

متغیر به نام sto I برابر با PD یا

101

00:04:05,680 –> 00:04:08,500

CSV را ایجاد می کنیم و

102

00:04:08,500 –> 00:04:10,390

سپس مسیر فایل داده را داریم که

103

00:04:10,390 –> 00:04:12,340

در فهرست داده ها ذخیره می شود و سپس

104

00:04:12,340 –> 00:04:14,170

فایل داده را داریم که داده های

105

00:04:14,170 –> 00:04:16,238

رگرسیون ماشین را تقویت می کند به عنوان یک فایل متنی ساده.

106

00:04:16,238 –> 00:04:18,279

با نقطه CSV یا مقادیر جدا شده با کاما،

107

00:04:18,279 –> 00:04:21,220

ستون یک وضعیت را نشان می دهد و

108

00:04:21,220 –> 00:04:24,130

آن تاریخ ها را به عنوان درست تجزیه می کنیم، بنابراین بیایید

109

00:04:24,130 –> 00:04:27,580

فایل داده را باز کنیم زیرا می بینیم که یک فایل متنی ساده داریم.

110

00:04:27,580 –> 00:04:29,230

e با نقطه CSV یا

111

00:04:29,230 –> 00:04:31,870

مقادیر جدا شده با کاما، ستون اول

112

00:04:31,870 –> 00:04:33,940

حالت ها و ستون دوم به عنوان

113

00:04:33,940 –> 00:04:36,550

s py تنظیم شده مربوط به

114

00:04:36,550 –> 00:04:37,990

ابزار سرمایه گذاری etf است که قصد دارد شاخص

115

00:04:37,990 –> 00:04:39,400

استاندارد و پورز 500 را تکرار کند

116

00:04:39,400 –> 00:04:42,130

، فقط مقالاتی که

117

00:04:42,130 –> 00:04:44,170

فقط با قیمت های بسته شامل می شوند.

118

00:04:44,170 –> 00:04:46,930

برای تفاوت و تقسیم دادههای نوریس

119

00:04:46,930 –> 00:04:48,760

یک فرکانس روزانه دارد و از

120

00:04:48,760 –> 00:04:50,950

ابتدای سال 2007 تا پایان

121

00:04:50,950 –> 00:04:51,940

سال 2015،

122

00:04:51,940 –> 00:04:57,500

بنابراین نه سال دادهها

123

00:04:57,500 –> 00:04:59,240

را در فایل زغال سنگ پس از خواندن دادهها،

124

00:04:59,240 –> 00:05:01,130

اکنون میخواهیم هدف ایجاد کنیم و

125

00:05:01,130 –> 00:05:04,160

ویژگیهای خود را پیشبینی کنید، بنابراین ابتدا

126

00:05:04,160 –> 00:05:06,470

با ویژگی هدف RSP Y شروع میکنیم که

127

00:05:06,470 –> 00:05:09,830

برابر با SP y dot PCT است که

128

00:05:09,830 –> 00:05:11,810

یک موقعیت را تغییر دهید، بنابراین

129

00:05:11,810 –> 00:05:13,820

نرخ

130

00:05:13,820 –> 00:05:15,980

بازده حسابی روزانه آن قیمتهای بسته تعدیلشده s py را محاسبه میکند

131

00:05:15,980 –> 00:05:17,900

که برای سود سهام تنظیم شدهاند

132

00:05:17,900 –> 00:05:20,420

و تقسیم می شود و نام ستون

133

00:05:20,420 –> 00:05:22,190

های این متغیر را با RSP در حالی که ستون ها

134

00:05:22,190 –> 00:05:24,530

و نام متغیر را تغییر می دهیم و سپس

135

00:05:24,530 –> 00:05:26,540

ویژگی پیش بینی را داریم، بنابراین در این حالت

136

00:05:26,540 –> 00:05:27,800

فقط یک پیش بینی خواهیم داشت. ویژگی tor

137

00:05:27,800 –> 00:05:29,600

که قرار است بازدهی spy-1 یا

138

00:05:29,600 –> 00:05:32,180

روز قبل ما باشد، بنابراین از

139

00:05:32,180 –> 00:05:33,980

درجه قبلی RSP که چرا

140

00:05:33,980 –> 00:05:37,070

یک موقعیت را تغی