در این مطلب، ویدئو آموزش PyTorch برای مبتدیان | آموزش عمیق یادگیری با پایتون | ادورکا | DL Rewind – 1 با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:38:30

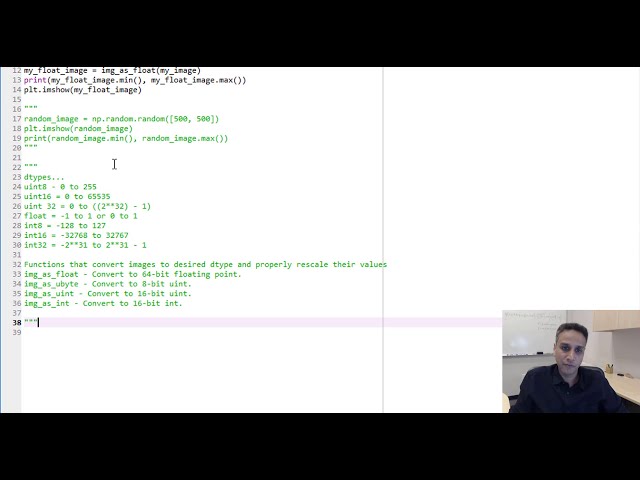

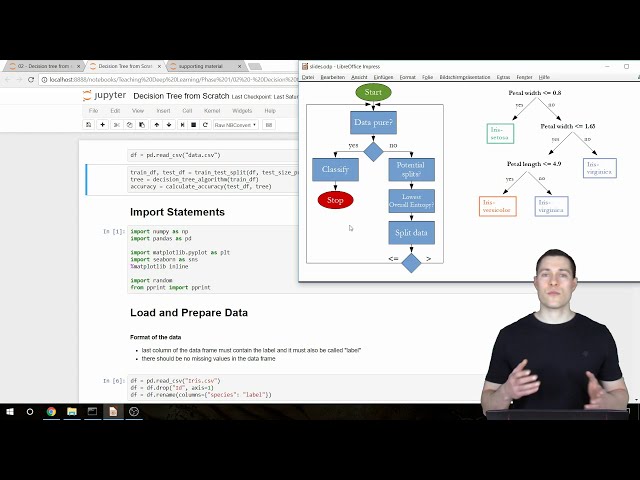

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:09,440 –> 00:00:11,200

پس صبح بخیر عصر بخیر و

2

00:00:11,200 –> 00:00:13,200

عصر بخیر بچه ها بر اساس مناطق زمانی که

3

00:00:13,200 –> 00:00:14,480

همه شما از آن می آیید،

4

00:00:14,480 –> 00:00:16,320

بنابراین بچه ها قبل از شروع جلسه،

5

00:00:16,320 –> 00:00:17,920

می توانید همیشه اطلاعات سریعی به من بدهید،

6

00:00:17,920 –> 00:00:20,000

اگر همه می توانید صفحه نمایش من را ببینید

7

00:00:20,000 –> 00:00:23,520

و صدای من را با صدای بلند و واضح بشنوید

8

00:00:25,680 –> 00:00:27,199

با تشکر از شما برای تایید

9

00:00:27,199 –> 00:00:29,199

همه،

10

00:00:29,199 –> 00:00:32,719

بنابراین اکنون بیایید شروع کنیم، دستور کار اصلی

11

00:00:32,719 –> 00:00:34,320

12

00:00:34,320 –> 00:00:37,200

جلسه امروز این است که در مورد یادگیری عمیق

13

00:00:37,200 –> 00:00:39,360

دقیقاً چه شبکه های عصبی

14

00:00:39,360 –> 00:00:40,640

هستند، کتابخانه های مختلف

15

00:00:40,640 –> 00:00:43,280

موجود در پایتون چه هستند دقیقاً مشعل جاسوسی

16

00:00:43,280 –> 00:00:44,000

17

00:00:44,000 –> 00:00:45,680

چه کاربردهای متفاوتی دارد. موارد

18

00:00:45,680 –> 00:00:47,840

مشعل آتشسوزی و سپس خلاصهای سریع از

19

00:00:47,840 –> 00:00:48,640

20

00:00:48,640 –> 00:00:51,440

هر آنچه که تا اینجا بحث کردهایم خواهیم داشت، بنابراین

21

00:00:51,440 –> 00:00:52,160

22

00:00:52,160 –> 00:00:53,840

به طور خلاصه آنچه را امروز پوشش خواهیم داد

23

00:00:53,840 –> 00:00:57,440

، بچهها، پس حالا بیایید شروع کنیم،

24

00:00:57,440 –> 00:00:59,600

بنابراین اول از همه بیایید یادگیری عمیق را درک کنیم.

25

00:00:59,600 –> 00:01:01,600

بنابراین، چگونه یادگیری عمیق

26

00:01:01,600 –> 00:01:03,680

دقیقاً دنیای ما را تغییر داده است،

27

00:01:03,680 –> 00:01:06,159

برای مثال وقتی در مورد

28

00:01:06,159 –> 00:01:06,799

29

00:01:06,799 –> 00:01:08,400

چه چیزی صحبت می کنیم، وقتی با هر

30

00:01:08,400 –> 00:01:10,080

دستیار مجازی صحبت می کنیم که می توانیم به آن فکر

31

00:01:10,080 –> 00:01:11,040

کنیم مانند

32

00:01:11,040 –> 00:01:13,360

الکسا. ما شهر داریم، دستیار گوگل داریم،

33

00:01:13,360 –> 00:01:14,479

34

00:01:14,479 –> 00:01:17,280

بنابراین دوباره همه اینها با یادگیری ماشینی پیشرفته شده اند،

35

00:01:17,280 –> 00:01:18,960

بنابراین ابتدا قبلاً ما

36

00:01:18,960 –> 00:01:21,119

به درستی یادگیری ماشینی

37

00:01:21,119 –> 00:01:23,200

داشتیم، اما جایی که ما کل سیستم را

38

00:01:23,200 –> 00:01:24,479

با

39

00:01:24,479 –> 00:01:26,320

روش های یادگیری متعددی که

40

00:01:26,320 –> 00:01:28,240

تحت نظارت و نظارت قرار داده ایم، آموزش دادیم و سپس ما

41

00:01:28,240 –> 00:01:29,040

42

00:01:29,040 –> 00:01:31,360

روشهای یادگیری تقویتی درست است و

43

00:01:31,360 –> 00:01:33,600

سپس ما اکنون از یادگیری ماشینی

44

00:01:33,600 –> 00:01:35,040

به یادگیری عمیق

45

00:01:35,040 –> 00:01:37,119

منتقل شدهایم که در آن کل سیستم را آموزش میدهیم

46

00:01:37,119 –> 00:01:38,320

تا خود کارآمد باشد

47

00:01:38,320 –> 00:01:40,880

تا تا حد امکان خودکفا

48

00:01:40,880 –> 00:01:42,640

باشد

49

00:01:42,640 –> 00:01:45,040

و از نظر یادگیری عمیق و

50

00:01:45,040 –> 00:01:47,520

رهبران اعمال شده در دستیار مجازی

51

00:01:47,520 –> 00:01:49,439

زمانی که مجدداً در حال ساختن سیستمی برای

52

00:01:49,439 –> 00:01:51,119

تشخیص چهره ها هستیم،

53

00:01:51,119 –> 00:01:53,200

بنابراین اکنون باید برنامه های دوربین چندگانه آنها را مشاهده کنید

54

00:01:53,200 –> 00:01:55,119

که می توانند

55

00:01:55,119 –> 00:01:56,079

چهره ها را به درستی تشخیص دهند

56

00:01:56,079 –> 00:01:58,960

که می توانند چهره ها را بر اساس سن

57

00:01:58,960 –> 00:02:00,640

بر اساس جنسیت تغییر دهند و می توانند

58

00:02:00,640 –> 00:02:04,000

چهره ها را بر اساس جنسیت سن و

59

00:02:04,000 –> 00:02:04,880

60

00:02:04,880 –> 00:02:07,759

همچنین بر اساس قومیت جنسی طبقه بندی کنند. از کل چهرهها

61

00:02:07,759 –> 00:02:08,878

در اینجا درست میتوانند آنها را

62

00:02:08,878 –> 00:02:12,000

درست تعریف کنند و سپس ما

63

00:02:12,000 –> 00:02:13,760

همه سیستمهای توصیهای را داریم

64

00:02:13,760 –> 00:02:15,200

به عنوان مثال، اگر در مورد

65

00:02:15,200 –> 00:02:17,840

پلتفرم های رسانه های اجتماعی صحبت می کنید، اگر

66

00:02:17,840 –> 00:02:19,280

برنامه های پخش جریانی

67

00:02:19,280 –> 00:02:22,080

داریم، نتفلیکس داریم، یوتیوب داریم، بنابراین

68

00:02:22,080 –> 00:02:22,879

همه

69

00:02:22,879 –> 00:02:25,040

آنها از رفتار کاربر یاد

70

00:02:25,040 –> 00:02:26,319

می گیرند، همه آنها می آموزند

71

00:02:26,319 –> 00:02:28,319

که دقیقاً الگوی

72

00:02:28,319 –> 00:02:29,760

کاربران

73

00:02:29,760 –> 00:02:32,319

چگونه بوده است. برنامهها و

74

00:02:32,319 –> 00:02:32,959

اینکه چگونه

75

00:02:32,959 –> 00:02:35,599

میتوانیم بهبود ببخشیم و چگونه میتوانیم از رفتارها درس

76

00:02:35,599 –> 00:02:36,560

77

00:02:36,560 –> 00:02:40,160

بگیریم و بداههسازی کنیم و

78

00:02:40,160 –> 00:02:42,720

توصیههای بهتری به آنها ارائه کنیم، بنابراین برای ما یک

79

00:02:42,720 –> 00:02:44,959

مثال ساده زمانی است که ما

80

00:02:44,959 –> 00:02:47,519

ویدیوها را از طریق نتفلیکس یا یوتیوب تماشا میکنیم،

81

00:02:47,519 –> 00:02:48,080

82

00:02:48,080 –> 00:02:50,400

بنابراین یوتیوب زودتر به یوتیوب قبلی نیاز دارد.

83

00:02:50,400 –> 00:02:52,640

فقط تجزیه و تحلیل شده

84

00:02:52,640 –> 00:02:55,120

فرض کنید چند ویدیو را تماشا کردهایم

85

00:02:55,120 –> 00:02:56,560

چه نوع ویدیوهایی

86

00:02:56,560 –> 00:02:57,920

را تماشا کردهایم،

87

00:02:57,920 –> 00:02:59,920

فرض کنید اگر 10 ویدیوی کمدی را دقیقاً تماشا کردهایم

88

00:02:59,920 –> 00:03:00,959

89

00:03:00,959 –> 00:03:02,640

، سطوح توصیه

90

00:03:02,640 –> 00:03:04,560

میکنند، سپس توصیههای بیشتری برای ویدیوهای کمدی دریافت میکنیم،

91

00:03:04,560 –> 00:03:05,599

92

00:03:05,599 –> 00:03:08,720

اما اکنون همه چیز تغییر کرده است. در حال حاضر حتی

93

00:03:08,720 –> 00:03:10,959

هر یک از اشاره گرهای کوچک

94

00:03:10,959 –> 00:03:11,760

95

00:03:11,760 –> 00:03:13,360

به عنوان بخشی از یادگیری عمیق در نظر گرفته می

96

00:03:13,360 –> 00:03:15,599

شوند که به این معنی است که ما چقدر ویدیو داریم

97

00:03:15,599 –> 00:03:17,200

در حال تماشای درست فرض کنید حتی اگر

98

00:03:17,200 –> 00:03:19,360

ویدیویی را شروع کرده باشیم،

99

00:03:19,360 –> 00:03:22,000

پس فرض کنید اگر به

100

00:03:22,000 –> 00:03:24,000

یک قسمت از کل

101

00:03:24,000 –> 00:03:25,840

ویدیو میپریم، چه نوع محتوایی در آن

102

00:03:25,840 –> 00:03:27,680

بخش خاص حاوی

103

00:03:27,680 –> 00:03:29,680

چقدر زمان است که ما واقعاً

104

00:03:29,680 –> 00:03:31,040

ویدیو را تماشا

105

00:03:31,040 –> 00:03:33,840

میکنیم. چیزی که ممکن است

106

00:03:33,840 –> 00:03:34,560

107

00:03:34,560 –> 00:03:36,879

10 ویدیو کمدی بازی کرده باشیم اما دوباره

108

00:03:36,879 –> 00:03:37,599

آنها را

109

00:03:37,599 –> 00:03:39,440

درست ندیده ایم، فقط

110

00:03:39,440 –> 00:03:40,959

چند ثانیه آنها را درست

111

00:03:40,959 –> 00:03:43,280

تماشا کرده ایم و داریم و دو

112

00:03:43,280 –> 00:03:44,000

ویدیو را برای

113

00:03:44,000 –> 00:03:45,760

اکشن تماشا کرده ایم، اما باز هم کامل

114

00:03:45,760 –> 00:03:48,000

است که درست است. ما بیشتر

115

00:03:48,000 –> 00:03:48,799

به

116

00:03:48,799 –> 00:03:51,920

اکشن علاقه مندیم تا کمدی درست

117

00:03:51,920 –> 00:03:54,000

و دوباره حتی از نظر کمدی

118

00:03:54,000 –> 00:03:55,680

چه نوع کمدی را دوست داریم

119

00:03:55,680 –> 00:03:58,239

بر اساس این که چند بار

120

00:03:58,239 –> 00:03:58,959

ویدیوها را

121

00:03:58,959 –> 00:04:00,560

در کدام جلسه مکث می

122

00:04:00,560 –> 00:04:02,959

کنیم و دوباره قبل از کدام یک ویدیوها را تماشا

123

00:04:02,959 –> 00:04:04,640

می کنیم. بازیگر ما در حال تماشای

124

00:04:04,640 –> 00:04:05,280

ویدیوها

125

00:04:05,280 –> 00:04:07,360

در چه زمانی از روز هستیم که آن را درست تماشا می

126

00:04:07,360 –> 00:04:08,799

کنیم،

127

00:04:08,799 –> 00:04:10,879

فرض کنید صبح آنها ترجیحات متفاوتی

128

00:04:10,879 –> 00:04:12,000

129

00:04:12,000 –> 00:04:14,239

داریم و همچنین در روز برای

130

00:04:14,239 –> 00:04:16,238

سابق به اندازه کافی در صبح یکشنبه، ما دوست داریم

131

00:04:16,238 –> 00:04:16,880

132

00:04:16,880 –> 00:04:18,478

چند ویدیو الهام بخش را درست یا

133

00:04:18,478 –> 00:04:20,399

چیزی مشابه تماشا کنیم و این خیلی دور از یک

134

00:04:20,399 –> 00:04:22,160

شخص خاص یا یک کانال

135

00:04:22,160 –> 00:04:24,400

درست است، در حالی که پنجشنبه عصر می

136

00:04:24,400 –> 00:04:25,440

خواهیم

137

00:04:25,440 –> 00:04:27,759

چند ویدیوی دیگر را دقیقاً تماشا کنیم، بنابراین بر اساس

138

00:04:27,759 –> 00:04:29,840

ترجیحاتمان، چه نوع ویدیویی هستیم.

139

00:04:29,840 –> 00:04:32,880

مشاهده الگوی ما

140

00:04:32,880 –> 00:04:35,199

چقدر بوده است که چقدر به آن

141

00:04:35,199 –> 00:04:37,199

زمان میدهیم چند بار

142

00:04:37,199 –> 00:04:37,759

143

00:04:37,759 –> 00:04:40,560

در کدام بخش خاص از آن عبور میکنیم، بنابراین همه اینها

144

00:04:40,560 –> 00:04:40,880

145

00:04:40,880 –> 00:04:43,280

بخشهای پیشرفتهای هستند که باید

146

00:04:43,280 –> 00:04:46,080

اینجا درست تحلیل کنیم

147

00:04:46,800 –> 00:04:48,560

و این برای هر برنامهای اتفاق میافتد،

148

00:04:48,560 –> 00:04:49,919

زیرا

149

00:04:49,919 –> 00:04:51,840

اکنون رقابت سخت است، اکنون

150

00:04:51,840 –> 00:04:54,960

رقابت نوک است و اکنون باید برای فیلتر کردن هرزنامه ایمیل،

151

00:04:54,960 –> 00:04:57,040

دوباره به سطح بعدی خود برسیم یا به

152

00:04:57,040 –> 00:04:58,080

153

00:04:58,080 –> 00:05:00,639

همان روشی

154

00:05:00,639 –> 00:05:01,520

155

00:05:01,520 –> 00:05:04,080

برسیم، بنابراین در ایمیلها نیز چندین

156

00:05:04,080 –> 00:05:06,080

الگوریتم داریم که در اینجا طراحی میکنیم.

157

00:05:06,080 –> 00:05:08,160

چند بار

158

00:05:08,160 –> 00:05:10,639

کلمه استفاده شده در ایمیل ها درست است،

159

00:05:10,639 –> 00:05:13,680

فرض کنید کلمه پیشنهادات خرید رایگان

160

00:05:13,680 –> 00:05:14,320

161

00:05:14,320 –> 00:05:16,880

بارها استفاده شده است، یعنی آنها دوباره

162

00:05:16,880 –> 00:05:17,600

بخشی از

163

00:05:17,600 –> 00:05:20,800

ایمیل های تبلیغاتی هستند.

164

00:05:20,800 –> 00:05:24,160

اگر پرندگانی مانند ما قیمت داشته باشند یا پول برنده شده

165

00:05:24,160 –> 00:05:24,720

166

00:05:24,720 –> 00:05:26,560

باشند یا چیزی دوباره چندین بار استفاده شده

167

00:05:26,560 –> 00:05:29,039

168

00:05:29,039 –> 00:05:32,000

باشد، اگر تصاویر زیادی

169

00:05:32,000 –> 00:05:32,639

170

00:05:32,639 –> 00:05:34,800

در ایمیل داده شده وجود داشته باشد، اگر پیوندهای زیادی وجود داشته باشد درست است، این دستوری برای هرزنامه است.

171

00:05:34,800 –> 00:05:36,240

172

00:05:36,240 –> 00:05:38,479

وقتی در مورد پیوندها صحبت می کنیم که

173

00:05:38,479 –> 00:05:40,400

محتوای موجود در آن چیزها چیست،

174

00:05:40,400 –> 00:05:41,759

فرض کنید که

175

00:05:41,759 –> 00:05:44,479

ما پنج پیوند را درست به ایمیل خود اضافه کرده

176

00:05:44,479 –> 00:05:45,840

177

00:05:45,840 –> 00:05:48,000

ایم، بنابراین نه تنها تعداد پیوندهای موجود در یک ایمیل را تجزیه و تحلیل می کند، بلکه تعداد آنها را تجزیه و تحلیل می کند، بلکه لینک هایی که وجود دارند را تجزیه و تحلیل می کند.

178

00:05:48,000 –> 00:05:49,759

179

00:05:49,759 –> 00:05:52,000

180

00:05:52,000 –> 00:05:53,520

اضافه

181

00:05:53,520 –> 00:05:55,840

شده است که محتوای موجود در آن

182

00:05:55,840 –> 00:05:56,880

183

00:05:56,880 –> 00:05:59,840

پیوند خاص دقیقاً چیست و دقیقاً

184

00:05:59,840 –> 00:06:02,319

چگونه با ایمیلی که درست به اشتراک گذاشتهایم مرتبط است

185

00:06:02,319 –> 00:06:04,319

و به علاوه در چه زمانی

186

00:06:04,319 –> 00:06:05,520

ایمیلها

187

00:06:05,520 –> 00:06:08,160

را در خط موضوع

188

00:06:08,160 –> 00:06:09,680

ارسال میکنیم از سرور خاصی که به

189

00:06:09,680 –> 00:06:11,280

اشتراک گذاشتهایم. همچنان چندین

190

00:06:11,280 –> 00:06:13,520

اشارهگر وجود دارد که به ما

191

00:06:13,520 –> 00:06:16,319

کمک میکند تا به این سیستمهای پستی کمک میکند تا

192

00:06:16,319 –> 00:06:17,680

193

00:06:17,680 –> 00:06:20,160

ایمیلهایی را که مهم هستند از

194

00:06:20,160 –> 00:06:21,680

این ایمیلهای هرزنامه جدا کنند

195

00:06:21,680 –> 00:06:24,800

و به همین دلیل است که gm ail

196

00:06:24,800 –> 00:06:26,800

بسیار روان بوده است زیرا دوباره الگوریتم

197

00:06:26,800 –> 00:06:28,800

مورد استفاده در آنجا برای کل کاربر یادگیری عمیق

198

00:06:28,800 –> 00:06:29,680

199

00:06:29,680 –> 00:06:32,160

200

00:06:32,160 –> 00:06:34,080

در مقایسه با سایر پلتفرمها بسیار روانتر و دقیقتر است،

201

00:06:34,080 –> 00:06:35,919

زیرا میداند چه نوع ایمیل و

202

00:06:35,919 –> 00:06:38,000

چه نوع الگوریتمی

203

00:06:38,000 –> 00:06:41,680

باید برای مرتب کردن این موارد اعمال شود.

204

00:06:41,680 –> 00:06:44,240

درست است پس دوباره اینها برخی

205

00:06:44,240 –> 00:06:46,160

از موارد استفاده کوچک هستند

206

00:06:46,160 –> 00:06:48,400

که از طریق آنها کل سیستم کل

207

00:06:48,400 –> 00:06:50,639

سیستم با استفاده

208

00:06:50,639 –> 00:06:53,199

درست از یادگیری عمیق تغییر می کند و این همان

209

00:06:53,199 –> 00:06:55,120

اهمیتی است که یادگیری عمیق به خصوص

210

00:06:55,120 –> 00:06:55,919

امروزه

211

00:06:55,919 –> 00:06:57,520

اگر در مورد راه حل های مختلفی صحبت کنید

212

00:06:57,520 –> 00:06:59,120

که ما روزانه از آنها استفاده می کنیم اهمیت دارد.

213

00:06:59,120 –> 00:07:03,199

بر اساس برنامه روزانه ما در اینجا

214

00:07:03,199 –> 00:07:07,360

درست است، پس بعدی ما یادگیری عمیق داریم،

215

00:07:07,360 –> 00:07:09,199

بنابراین اول از همه بیایید

216

00:07:09,199 –> 00:07:11,440

با درک خوبی از اینکه

217

00:07:11,440 –> 00:07:13,120

دقیقاً یادگیری عمیق درست است شروع کنیم،

218

00:07:13,120 –> 00:07:15,120

بنابراین اول از همه ما

219

00:07:15,120 –> 00:07:17,520

هوش مصنوعی را به عنوان دامنه ای برای داده ها داریم،

220

00:07:17,520 –> 00:07:19,599

بنابراین هوش مصنوعی

221

00:07:19,599 –> 00:07:21,520

به سادگی

222

00:07:21,520 –> 00:07:24,240

تمام ماشینها و برنامهها را

223

00:07:24,240 –> 00:07:26,319

هوشمند میکنیم، وقتی در مورد هوشمند صحبت

224

00:07:26,319 –> 00:07:28,639

میکنیم، فرض کنید به سیستم یک c کوچک دادهایم

225

00:07:28,639 –> 00:07:29,440

دستور

226

00:07:29,440 –> 00:07:32,720

برای محاسبه x به علاوه y درست است اما قبل از

227

00:07:32,720 –> 00:07:34,639

محاسبه x به علاوه پنج در اینجا اکنون سیستم

228

00:07:34,639 –> 00:07:35,680

تشخیص

229

00:07:35,680 –> 00:07:38,240

می دهد که برای پاک کردن x ابتدا

230

00:07:38,240 –> 00:07:39,120

231

00:07:39,120 –> 00:07:40,800

باید x را ایجاد کند،

232

00:07:40,800 –> 00:07:43,280

قبل از اینکه بتواند x به اضافه y را

233

00:07:43,280 –> 00:07:45,759

درست کند باید x را به مقادیر دیگری تبدیل کند، بنابراین دوباره این موارد باید این

234

00:07:45,759 –> 00:07:48,080

موارد باید ابتدا درست تجزیه و تحلیل شوند،

235

00:07:48,080 –> 00:07:51,440

به عنوان مثال ما x را به عنوان نه

236

00:07:51,440 –> 00:07:54,160

و y را به عنوان هشت ذکر کرده ایم، اما

237

00:07:54,160 –> 00:07:55,440

این دو را

238

00:07:55,440 –> 00:07:57,440

در حروف الفبا در حروف الفبا ذکر کرده ایم،

239

00:07:57,440 –> 00:07:59,919

بنابراین اکنون اول از همه برای

240

00:07:59,919 –> 00:08:01,680

انجام عملیات، عملیات خودکار

241

00:08:01,680 –> 00:08:02,639

242

00:08:02,639 –> 00:08:04,639

اول تمام سیستم به جای

243

00:08:04,639 –> 00:08:05,840

دادن یک

244

00:08:05,840 –> 00:08:09,120

خطای ساده باید بتواند

245

00:08:09,120 –> 00:08:11,280

آن مقدار کاراکتر را به طور خودکار به درستی تبدیل به عدد صحیح کند

246

00:08:11,280 –> 00:08:12,560

247

00:08:12,560 –> 00:08:14,800

و سپس باید شروع به درست کردن

248

00:08:14,800 –> 00:08:15,840

اضافات کند،

249

00:08:15,840 –> 00:08:18,560

بنابراین این کارها دوباره باید

250

00:08:18,560 –> 00:08:19,680

توسط سیستم به

251

00:08:19,680 –> 00:08:21,840

طور خودکار درست انجام شود و اینها کاربرد کمی دارند.

252

00:08:21,840 –> 00:08:23,360

مواردی برای

253

00:08:23,360 –> 00:08:26,720

هوش مصنوعی درست در مرحله بعدی این است که ما

254

00:08:26,720 –> 00:08:28,720

یادگیری ماشینی داریم،

255

00:08:28,720 –> 00:08:31,120

بنابراین یادگیری ماشینی به سادگی به

256

00:08:31,120 –> 00:08:32,719

سیستم توانایی یادگیری

257

00:08:32,719 –> 00:08:35,120

بدون اینکه به طور صریح حرفه ای باشد می دهد.

258

00:08:35,120 –> 00:08:36,799

درست همانطور که در مورد مثال بحث کردیم،

259

00:08:36,799 –> 00:08:38,080

260

00:08:38,080 –> 00:08:41,599

فرض کنید الان داریم و

261

00:08:41,599 –> 00:08:44,480

کم و بیش به همان روشی است که

262

00:08:44,480 –> 00:08:46,240

هر بچه خاصی را

263

00:08:46,240 –> 00:08:49,040

درست تربیت می کنیم، فرض کنید چگونه بچه ها را تربیت کنیم، آموزش می دهیم

264

00:08:49,040 –> 00:08:51,120

که اگر آنها را آموزش دهیم خوب است

265

00:08:51,120 –> 00:08:51,839

دو به علاوه چیست دو

266

00:08:51,839 –> 00:08:55,519

چهار خوب چه 5 به علاوه 5 است 10 است

267

00:08:55,519 –> 00:08:58,800

چه 7 به علاوه 5 است 12. خوب

268

00:08:58,800 –> 00:09:01,279

حالا که آنها وارد امتحان شدند اکنون

269

00:09:01,279 –> 00:09:02,480

ضریب ها را می گیرند خوب

270

00:09:02,480 –> 00:09:06,000

12 به اضافه 121 را حل کنید

271

00:09:06,000 –> 00:09:08,080

در حال حاضر ما آنها را در نسخه سه رقمی آموزش نداده ایم.

272

00:09:08,080 –> 00:09:09,360

273

00:09:09,360 –> 00:09:11,680

اما هر آنچه که آنها یاد گرفته اند یا

274

00:09:11,680 –> 00:09:13,680

چگونه اعداد جمع می شوند،

275

00:09:13,680 –> 00:09:16,640

می توانند همان منطق را برای حل

276

00:09:16,640 –> 00:09:18,320

مشکل کمی پیچیده تر به

277

00:09:18,320 –> 00:09:21,200

درستی اعمال کنند و این همان چیزی است که ما آنها را به

278

00:09:21,200 –> 00:09:23,040

عنوان بخشی از یادگیری ماشین به عنوان بخشی از

279

00:09:23,040 –> 00:09:24,720

یادگیری ماشینی درست آموزش می دهیم

280

00:09:24,720 –> 00:09:27,200

و سپس داریم یادگیری عمیق، به

281

00:09:27,200 –> 00:09:27,839

عنوان مثال،

282

00:09:27,839 –> 00:09:32,240

اگر ما به آنها آموزش داده ایم که چگونه

283

00:09:32,240 –> 00:09:35,120

انگلیسی را به ماندارین ترجمه کنند و همچنین

284

00:09:35,120 –> 00:09:36,080

به آنها آموزش داده ایم که چگونه

285

00:09:36,080 –> 00:09:38,080

پهنای باند را به انگلیسی ترجمه

286

00:09:38,080 –> 00:09:40,720

کنند، همچنین به آنها آموزش داده ایم که

287

00:09:40,720 –> 00:09:41,839

چگونه

288

00:09:41,839 –> 00:09:45,200

انگلیسی را به چینی به فرانسوی ترجمه کنند و ما به آنها آموزش داده ایم.

289

00:09:45,200 –> 00:09:46,880

همچنین به آنها آموزش دادهاند که

290

00:09:46,880 –> 00:09:49,120

چگونه ترجمه فرانسوی به انگلیسی را آموزش

291

00:09:49,120 –> 00:09:50,000

دهند، بنابراین

292

00:09:50,000 –> 00:09:52,160

اکنون سیستم میتواند شروع به یادگیری

293

00:09:52,160 –> 00:09:54,399

خود کند، به این معنی که

294

00:09:54,399 –> 00:09:56,560

اکنون در موقعیتی است که

295

00:09:56,560 –> 00:09:57,680

فرانسوی را

296

00:09:57,680 –> 00:10:00,480

مستقیماً به ماندارین ترجمه کند، زیرا

297

00:10:00,480 –> 00:10:01,120

اکنون آن را به

298

00:10:01,120 –> 00:10:03,279

درستی بر اساس تکامل یافته است.

299

00:10:03,279 –> 00:10:05,440

جایگشتها و ترکیبهای متعدد و بر

300

00:10:05,440 –> 00:10:07,600

اساس اینکه چقدر خوب آموزش داده شده است،

301

00:10:07,600 –> 00:10:10,399

میتواند به طور خودکار پاسخهایی را برای مسائل پیچیدهتر به ما بدهد،

302

00:10:10,399 –> 00:10:12,079

303

00:10:12,079 –> 00:10:14,800

درست به عنوان بخشی از

304

00:10:14,800 –> 00:10:16,320

یادگیری عمیق به عنوان بخشی از

305

00:10:16,320 –> 00:10:19,519

یادگیری عمیق در اینجا بخش بعدی است، اجازه دهید

306

00:10:19,519 –> 00:10:20,240

307

00:10:20,240 –> 00:10:24,160

در مورد مفهوم عصبی بحث کنیم. شبکهها

308

00:10:24,160 –> 00:10:26,880

در حال حاضر نقشههای خنثی را به نورونها میدهند،

309

00:10:26,880 –> 00:10:28,640

درست مثل اینکه

310

00:10:28,640 –> 00:10:31,040

ما نورونهایی را در مغز خود داریم، اکنون ممکن است داشته

311

00:10:31,040 –> 00:10:32,880

باشیم، باید

312

00:10:32,880 –> 00:10:35,920

نورونها را به کلاس

313

00:10:35,920 –> 00:10:38,320

نهم مطالعه کرده باشیم، حدس میزنم در کلاس نهم، اگر به دوران مدرسه برگردیم، زیستشناسی را در کلاس نهم مطالعه کرده

314

00:10:38,320 –> 00:10:39,440

315

00:10:39,440 –> 00:10:41,279

باشیم. باید

316

00:10:41,279 –> 00:10:43,920

مطالعه کرده باشد که مغز انسان دقیقا چگونه

317

00:10:43,920 –> 00:10:45,279

درست کار می کند،

318

00:10:45,279 –> 00:10:48,000

بنابراین مغز انسان همانطور که می دانیم از چندین نورون ساخته شده است،

319

00:10:48,000 –> 00:10:49,920

بنابراین

320

00:10:49,920 –> 00:10:52,320

میلیاردها نورون وجود دارد که با هم ما را تشکیل می دهند.

321

00:10:52,320 –> 00:10:55,360

مغز درست است بنابراین نورون ها اکنون ممکن است این را

322

00:10:55,360 –> 00:10:57,040

به خاطر بسپاریم ممکن است یادگیری

323

00:10:57,040 –> 00:10:57,920

نورون ها را

324

00:10:57,920 –> 00:11:00,640

از این نمودار به خاطر بسپاریم بنابراین در نورون

325

00:11:00,640 –> 00:11:01,360

ها

326

00:11:01,360 –> 00:11:03,920

بدن سلولی داریم که مانند یک هسته

327

00:11:03,920 –> 00:11:05,680

عمل می کند.

328

00:11:05,680 –> 00:11:06,560

329

00:11:06,560 –> 00:11:09,680

330

00:11:09,680 –> 00:11:11,600

چند ریز گرادیان درست

331

00:11:11,600 –> 00:11:13,680

سپس دندریت های متعددی داریم

332

00:11:13,680 –> 00:11:15,920

که مانند یک اتصال دهنده بین

333

00:11:15,920 –> 00:11:17,440

نورون های مختلف در سمت راست عمل می کند

334

00:11:17,440 –> 00:11:19,760

و سپس قسمت مرکزی به عنوان اگزون راست نامیده می شود

335

00:11:19,760 –> 00:11:21,519

336

00:11:21,519 –> 00:11:23,839

بنابراین میانگین استفاده از دندریت ها دوباره

337

00:11:23,839 –> 00:11:25,120

همانطور که دیدیم

338

00:11:25,120 –> 00:11:27,440

اساساً برای دریافت

339

00:11:27,440 –> 00:11:29,360

سیگنال از نورون های دیگر استفاده می شود. بنابراین آنها

340

00:11:29,360 –> 00:11:31,360

به برخی از نورون های دیگر متصل

341

00:11:31,360 –> 00:11:33,519

می شوند و می توانند سیگنال ها را بین

342

00:11:33,519 –> 00:11:34,800

آنها به سمت راست

343

00:11:34,800 –> 00:11:37,440

و بدنه سلولی مبادله کنند، این

344

00:11:37,440 –> 00:11:37,920

به

345

00:11:37,920 –> 00:11:40,560

این معنی است که قلب کل نورون است

346

00:11:40,560 –> 00:11:42,640

که تمام محاسبات در آنجا

347

00:11:42,640 –> 00:11:43,360

انجام می شود

348

00:11:43,360 –> 00:11:45,920

و آکسون اساساً برای انتقال سیگنال ها به سلول استفاده می شود.

349

00:11:45,920 –> 00:11:46,480

350

00:11:46,480 –> 00:11:49,600

سلول های دیگر درست است به طوری که

351

00:11:49,600 –> 00:11:51,360

اکنون پس از

352

00:11:51,360 –> 00:11:53,040

پردازش توسط یک بدنه سلولی

353

00:11:53,040 –> 00:11:55,760

، اجرای آن می تواند همان چیزی باشد که باید انجام شود.

354

00:11:55,760 –> 00:11:57,120

چه کاری باید انجام شود

355

00:11:57,120 –> 00:12:00,800

که آن قسمت می تواند توسط خود آکسون

356

00:12:00,800 –> 00:12:03,600

به عنوان بخشی از مغز انسان اجرا شود، اکنون اینگونه است

357

00:12:03,600 –> 00:12:05,360

که کل

358

00:12:05,360 –> 00:12:08,320

سلول برای هر انسان از

359

00:12:08,320 –> 00:12:10,000

کل سلول برای

360

00:12:10,000 –> 00:12:12,560

مغز انسان درست عمل می کند و همان

361

00:12:12,560 –> 00:12:14,959

مفهوم همان مفهوم برای نورون ها است. همچنین

362

00:12:14,959 –> 00:12:15,600

363

00:12:15,600 –> 00:12:19,760

در ai و همچنین در ai به

364

00:12:19,760 –> 00:12:22,320

درستی اعمال می شود، بنابراین در ai کاری که ما دقیقا انجام می

365

00:12:22,320 –> 00:12:23,839

دهیم این است که مفهوم یک

366

00:12:23,839 –> 00:12:26,480

لایه ورودی را داریم، سپس یک لایه پنهان

367

00:12:26,480 –> 00:12:28,639

داریم که یک لایه مخفی دوم

368

00:12:28,639 –> 00:12:30,800

داریم و سپس لایه خروجی را درست داریم،

369

00:12:30,800 –> 00:12:32,079

بنابراین پردازش

370

00:12:32,079 –> 00:12:34,800

اصلی در این لایههای پنهان انجام میشود

371

00:12:34,800 –> 00:12:36,240

و سپس آنها را با هم ترکیب

372

00:12:36,240 –> 00:12:39,440

میکنیم تا یک خروجی به

373

00:12:39,440 –> 00:12:40,399

374

00:12:40,399 –> 00:12:43,760

عنوان بخشی از شبکههای عصبی

375

00:12:43,760 –> 00:12:46,079

در حال حاضر از نظر درک این موضوع در حال حاضر

376

00:12:46,079 –> 00:12:48,320

از نظر درک

377

00:12:48,320 –> 00:12:51,200

عمیقتر آن به دست آوریم. انواع مختلفی از

378

00:12:51,200 –> 00:12:52,079

شبکه های عصبی

379

00:12:52,079 –> 00:12:54,320

درست است، به عنوان مثال یک دستگاه مدل کامپیوتری

380

00:12:54,320 –> 00:12:56,560

برای نشان دادن

381

00:12:56,560 –> 00:12:58,399

توانایی مغز برای تشخیص و

382

00:12:58,399 –> 00:13:00,480

تمایز به طوری که ما بتوانیم

383

00:13:00,480 –> 00:13:02,480

تفاوت بین دو

384

00:13:02,480 –> 00:13:03,200

سناریو

385

00:13:03,200 –> 00:13:06,399

یا شی یا هر چیز دیگر را پیدا کنیم.

386

00:13:06,399 –> 00:13:09,360

و باز هم سادهترین و قدیمیترین

387

00:13:09,360 –> 00:13:11,920

مدل نورون که میشناسیم دوباره اگر

388

00:13:11,920 –> 00:13:14,079

دو ورودی چندگانه داشته باشیم و

389

00:13:14,079 –> 00:13:15,760

تابع فعالسازی را داشته باشیم

390

00:13:15,760 –> 00:13:17,680

و بتوانیم خروجی آن را درست تعریف کنیم

391

00:13:17,680 –> 00:13:20,160

و به همین دلیل است که مفهوم

392

00:13:20,160 –> 00:13:22,880

شبکههای عصبی پیشخور را داریم. درست است

393

00:13:22,880 –> 00:13:24,959

و اساساً وقتی برای

394

00:13:24,959 –> 00:13:26,480

یادگیری نظارت شده می رویم وقتی

395

00:13:26,480 –> 00:13:28,000

برای یادگیری نظارت شده می

396

00:13:28,000 –> 00:13:31,680

رویم، اساساً از شبکه فید فوروارد استفاده می کنیم

397

00:13:31,680 –> 00:13:33,920

در حال حاضر وقتی در مورد یادگیری نظارت شده صحبت می کنیم، به

398

00:13:33,920 –> 00:13:35,120

این معنی است که ما

399

00:13:35,120 –> 00:13:38,880

سیستم را بر اساس

400

00:13:38,880 –> 00:13:41,839

داده ها به درستی معامله می کنیم، درست مانند مثال اگر ما

401

00:13:41,839 –> 00:13:42,160

هستیم.

402

00:13:42,160 –> 00:13:44,160

معامله هر سیستمی دو به اضافه دو

403

00:13:44,160 –> 00:13:45,279

چهار،

404

00:13:45,279 –> 00:13:47,839

هفت به علاوه پنج دوازده، 9 به علاوه 2

405

00:13:47,839 –> 00:13:49,360

، 11 درست است

406

00:13:49,360 –> 00:13:52,240

و سپس اگر مشکلی ببیند

407

00:13:52,240 –> 00:13:53,120

408

00:13:53,120 –> 00:13:56,639

که 19 به اضافه 37 است، به سادگی می تواند خروجی را پیش بینی کند

409

00:13:56,639 –> 00:13:58,800

، زیرا ما قبلا

410

00:13:58,800 –> 00:13:59,920

آن را

411

00:13:59,920 –> 00:14:03,040

بر اساس داده ها بر اساس داده ها به عنوان

412

00:14:03,040 –> 00:14:03,519

بخشی از

413

00:14:03,519 –> 00:14:06,320

حق یادگیری نظارت شده آموزش داد و در

414

00:14:06,320 –> 00:14:07,680

یادگیری نظارت شده همه

415

00:14:07,680 –> 00:14:09,839

گره ها به طور کامل به هم متصل هستند، هیچ

416

00:14:09,839 –> 00:14:11,519

ارتباط جزئی بین چندین

417

00:14:11,519 –> 00:14:12,160

گره وجود ندارد.

418

00:14:12,160 –> 00:14:14,959

درست است و این اساساً زمانی استفاده میشود که

419

00:14:14,959 –> 00:14:16,000

دادهها نه

420

00:14:16,000 –> 00:14:19,440

ترتیبی هستند و نه

421

00:14:19,440 –> 00:14:21,920

به درستی وابسته به زمان هستند، زیرا باز هم وقتی

422

00:14:21,920 –> 00:14:24,560

در مورد وابسته به زمان صحبت میکنیم، صرفاً به این معناست که

423

00:14:24,560 –> 00:14:26,800

دادهها تغییر نمیکنند، دادهها

424

00:14:26,800 –> 00:14:28,079

تغییر نمیکنند،

425

00:14:28,079 –> 00:14:31,040

حتی برای زمان تخصیص داده شده

426

00:14:31,040 –> 00:14:32,480

نیز

427

00:14:32,480 –> 00:14:35,839

درست است. و در اینجا آنها هیچ حلقه پشتی در

428

00:14:35,839 –> 00:14:38,240

دسترس نیستند، بنابراین هنگامی که ما

429

00:14:38,240 –> 00:14:40,480

خروجی را در اینجا داشته باشیم، هیچ حلقه پشتی

430

00:14:40,480 –> 00:14:43,760

به عنوان بخشی از

431

00:14:43,760 –> 00:14:44,880

پیشخور در دسترس

432

00:14:44,880 –> 00:14:47,279

نیست زیرا این نام همانطور که نشان می دهد

433

00:14:47,279 –> 00:14:49,040

دقیقاً در

434

00:14:49,040 –> 00:14:52,079

مرحله بعدی است، ما به سمت راست انتشار برگشت خواهیم داشت، بنابراین

435

00:14:52,079 –> 00:14:52,720

436

00:14:52,720 –> 00:14:55,279

اگر ما دوباره در حال حاضر از هر

437

00:14:55,279 –> 00:14:58,000

الگوریتم خاصی در اینجا استفاده می کنید، اگرچه همه آنها

438

00:14:58,000 –> 00:15:00,320

خودروهایی هستند که

439

00:15:00,320 –> 00:15:01,040

در اینجا چندین لاستیک دارند،

440

00:15:01,040 –> 00:15:03,360

اما باز هم آخرین مورد در اینجا به عنوان یک خودرو طبقه بندی نمی شود و در اینجا به

441

00:15:03,360 –> 00:15:05,040

عنوان یک

442

00:15:05,040 –> 00:15:08,480

خودرو طبقه بندی نمی

443

00:15:08,480 –> 00:15:11,519

شود

444

00:15:11,519 –> 00:15:13,040

و به همین دلیل همانطور که اکنون می بینید

445

00:15:13,040 –> 00:15:15,199

اگرچه بر اساس آن است. در مورد هر چیزی که ما

446

00:15:15,199 –> 00:15:16,639

آنجا آموزش می دادیم هر چیزی که

447

00:15:16,639 –> 00:15:18,480

اکنون آنها را آموزش می دادیم آخرین مورد

448

00:15:18,480 –> 00:15:20,880

اینجا یک ماشین است در هفته گذشته اینجا خود یک

449

00:15:20,880 –> 00:15:23,120

ماشین ابری است درست

450

00:15:23,120 –> 00:15:25,279

و دوباره بنفش و هفتم به همین دلیل است که ما

451

00:15:25,279 –> 00:15:27,519

در مورد انتشار

452

00:15:27,519 –> 00:15:29,360

، به سادگی یک الگوریتم آموزشی داریم که در آن میتوانیم

453

00:15:29,360 –> 00:15:30,639

454

00:15:30,639 –> 00:15:33,680

آن را برای اطمینان از خطاهایی

455

00:15:33,680 –> 00:15:35,680

که در

456

00:15:35,680 –> 00:15:37,519

قسمت راست طبقهبندی تصویر اتفاق میافتند تعریف کنیم،

457

00:15:37,519 –> 00:15:41,199

که به حداقل تعداد ممکن کاهش مییابد،

458

00:15:41,199 –> 00:15:43,759

زیرا اساساً

459

00:15:43,759 –> 00:15:45,759

میتوان گفت انتشار رو به جلو بخشی از

460

00:15:45,759 –> 00:15:46,399

461

00:15:46,399 –> 00:15:48,959

خود الگوریتم انتشار برگشتی است

462

00:15:48,959 –> 00:15:50,560

که میتوانیم آن را

463

00:15:50,560 –> 00:15:52,720

برای انتشار از خطاهایی که

464

00:15:52,720 –> 00:15:54,399

در

465

00:15:54,399 –> 00:15:56,720

کل سیستم اتفاق میافتد به درستی استفاده کنیم، بنابراین اساساً

466

00:15:56,720 –> 00:15:57,519

467

00:15:57,519 –> 00:15:59,040

از نظر درک کل

468

00:15:59,040 –> 00:16:01,279

معماری اینجا اول از همه

469

00:16:01,279 –> 00:16:03,279

میتوانیم به جلو حرکت کنیم. مقادیر در اینجا اول از

470

00:16:03,279 –> 00:16:04,000

همه

471

00:16:04,000 –> 00:16:06,160

ما می توانیم مقادیر را در اینجا به جلو منتقل

472

00:16:06,160 –> 00:16:08,079

کنیم و سپس می

473

00:16:08,079 –> 00:16:09,839

توانیم خطا و مقدار آن را محاسبه کنیم که

474

00:16:09,839 –> 00:16:11,839

به این معنی است که چقدر خطا چقدر خطا

475

00:16:11,839 –> 00:16:13,199

در اینجا

476

00:16:13,199 –> 00:16:16,160

درست می شود و

477

00:16:16,160 –> 00:16:18,000

سپس می توانیم دوباره منتشر کنیم و سپس به سادگی می توانیم

478

00:16:18,000 –> 00:16:20,079

این را به عنوان بخشی از حلقه به

479

00:16:20,079 –> 00:16:21,120

طور کلی کار کنید

480

00:16:21,120 –> 00:16:23,600

تا زمانی که و مگر اینکه کل سیستم

481

00:16:23,600 –> 00:16:24,320

482

00:16:24,320 –> 00:16:26,240

کامل شود تا کل سیستم

483

00:16:26,240 –> 00:16:28,399

484

00:16:28,399 –> 00:16:30,560

اکنون در اینجا از نظر زبان های برنامه نویسی کامل

485

00:16:30,560 –> 00:16:32,000

شده است یا ما می

486

00:16:32,000 –> 00:16:34,720

توانیم به طور کلی در اینجا استفاده کنیم، بنابراین چندین زبان وجود دارد که

487

00:16:34,720 –> 00:16:36,000

488

00:16:36,000 –> 00:16:38,320

امکان پشتیبانی از کار با

489

00:16:38,320 –> 00:16:40,320

شبکه های عصبی را فراهم می کند، چندین زبان وجود دارد

490

00:16:40,320 –> 00:16:43,360

که می توان برای

491

00:16:43,360 –> 00:16:45,519

طراحی اتحادیه شبکه های عصبی در اینجا استفاده کرد.

492

00:16:45,519 –> 00:16:48,079

ما لیستی داریم که پرولوگ داریم،

493

00:16:48,079 –> 00:16:50,880

جاوا از طریق جاوا داریم و پایتون بیشترین

494

00:16:50,880 –> 00:16:51,920

کاربر را دارد،

495

00:16:51,920 –> 00:16:53,600

بنابراین اساساً بسیاری از توسعه دهندگان

496

00:16:53,600 –> 00:16:56,560

از پایتون مخصوصاً برای

497

00:16:56,560 –> 00:16:59,120

مبتدیان استفاده می کنند زیرا پایتون همانطور که می شناسیم

498

00:16:59,120 –> 00:17:00,880

در مقایسه با زبان های دیگر

499

00:17:00,880 –> 00:17:03,519

پایتون کمترین گرامر

500

00:17:03,519 –> 00:17:05,520

را دارد. اساساً اگر ما و دوباره چندین

501

00:17:05,520 –> 00:17:06,160

502

00:17:06,160 –> 00:17:08,559

کتابخانه داخلی داشته باشد که به

503

00:17:08,559 –> 00:17:10,959

طور خاص برای دستکاری داده ها استفاده می شود و

504

00:17:10,959 –> 00:17:13,599

ما چندین کتابخانه در دسترس

505

00:17:13,599 –> 00:17:16,160

برای علم داده و همچنین برای

506

00:17:16,160 –> 00:17:17,359

علم داده برای هدف

507

00:17:17,359 –> 00:17:19,919

داریم که می توانیم مستقیماً برای شروع استفاده کنیم

508

00:17:19,919 –> 00:17:22,000

و به دلیل این کتابخانه ها

509

00:17:22,000 –> 00:17:24,319

این کد در اینجا نیز سبک می شود،

510

00:17:24,319 –> 00:17:26,000

به عنوان مثال اگر برای

511

00:17:26,000 –> 00:17:27,679

توسعه یک عملکرد برای همان

512

00:17:27,679 –> 00:17:29,679

عملکرد اینجا در اینجا باشد

513

00:17:29,679 –> 00:17:31,520

جاوا ممکن است مجبور باشیم 10 خط کد را در

514

00:17:31,520 –> 00:17:33,600

جاوا بنویسیم که در آن عملکردهای مشابه در

515

00:17:33,600 –> 00:17:36,000

پایتون را می توان تنها در

516

00:17:36,000 –> 00:17:38,240

دو خط دو یا سه خط به درستی به دست

517

00:17:38,240 –> 00:17:39,520

آورد، این تفاوت کل

518

00:17:39,520 –> 00:17:42,880

پایتون در مقایسه با

519

00:17:42,880 –> 00:17:44,880

سایر زبان های موجود است و

520

00:17:44,880 –> 00:17:47,360

به همین دلیل است. پایتون بیشترین استفاده را

521

00:17:47,360 –> 00:17:49,919

هم در علم داده و هم در

522

00:17:49,919 –> 00:17:51,280

حوزه هوایی دارد،

523

00:17:51,280 –> 00:17:53,840

اگرچه سایر فناوریها

524

00:17:53,840 –> 00:17:56,000

موارد استفاده و مزایای خاص خود را

525

00:17:56,000 –> 00:17:57,039

نسبت به پایتون دارند،

526

00:17:57,039 –> 00:17:59,200

اما در اینجا نیز مورد استفاده محدود

527

00:17:59,200 –> 00:18:00,960

است و

528

00:18:00,960 –> 00:18:02,880

از نظر محبوبیت در مقایسه با آن محدود است.

529

00:18:02,880 –> 00:18:05,440

به python کاملاً

530

00:18:05,440 –> 00:18:08,080

درست است و در اینجا من روی

531

00:18:08,080 –> 00:18:10,160

python که برای یادگیری عمیق استفاده می شود تمرکز می

532

00:18:10,160 –> 00:18:12,240

کنم و چندین کتابخانه وجود دارد

533

00:18:12,240 –> 00:18:13,200

که

534

00:18:13,200 –> 00:18:15,120

ما برای یادگیری عمیق خود از آنها استفاده می کنیم در اینجا ما

535

00:18:15,120 –> 00:18:16,240

چندین کتابخانه

536

00:18:16,240 –> 00:18:19,120

در پایتون داخلی داریم که برای یادگیری عمیق به

537

00:18:19,120 –> 00:18:20,400

538

00:18:20,400 –> 00:18:22,799

درستی استفاده می کنیم. از میان کتابخانههای اینجا،

539

00:18:22,799 –> 00:18:24,240

ما چندین کتابخانه در دسترس داریم، اجازه دهید به

540

00:18:24,240 –> 00:18:25,360

شما نشان دهم که

541

00:18:25,360 –> 00:18:27,760

پس اینجا ما تئاتر داریم، piotr، کراس داریم

542

00:18:27,760 –> 00:18:30,080

، ما tensorflow داریم،

543

00:18:30,080 –> 00:18:33,039

بنابراین همه اینها کتابخانههایی در پایتون موجود هستند

544

00:18:33,039 –> 00:18:34,400

که میتوانیم

545

00:18:34,400 –> 00:18:37,840

برای طیف گستردهای

546

00:18:37,840 –> 00:18: