در این مطلب، ویدئو آموزش NLTK Python | پردازش زبان طبیعی (NLP) با پایتون با استفاده از NLTK | Simplile Learn با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:43:39

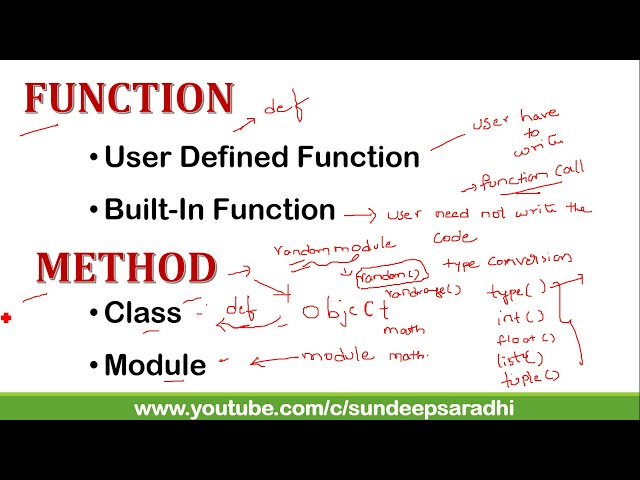

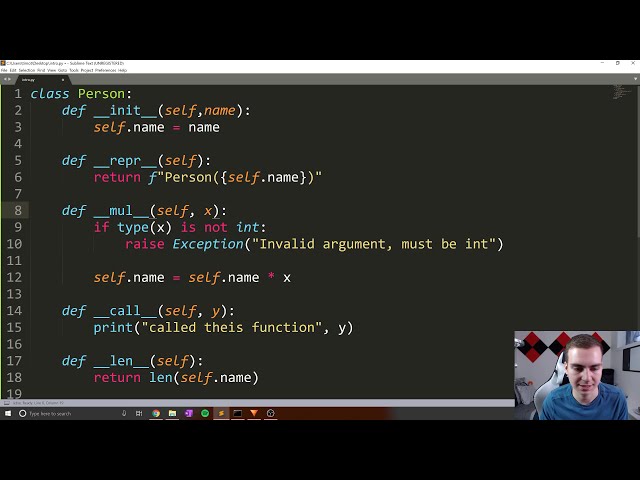

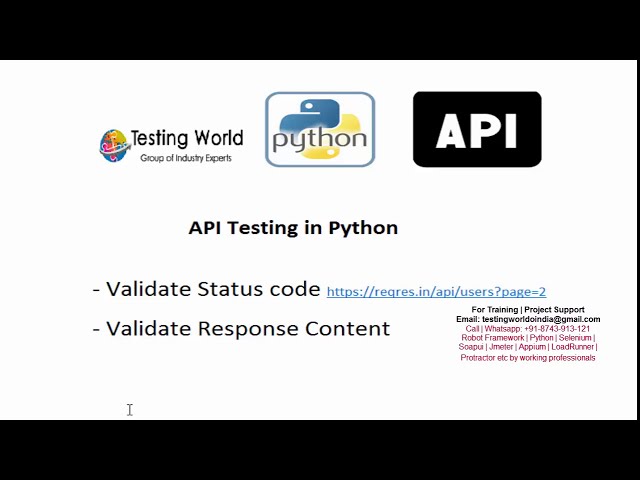

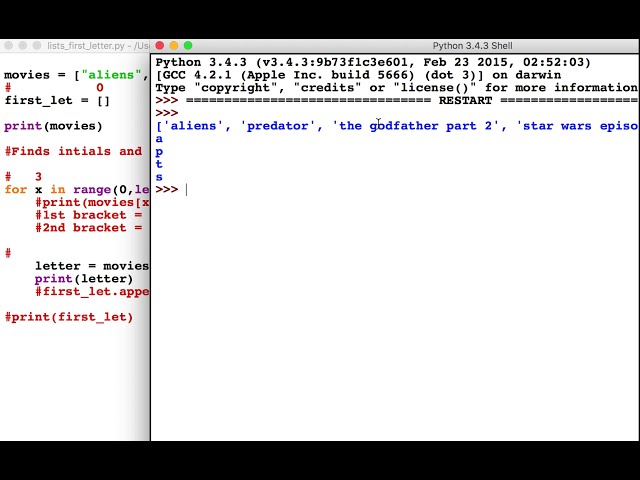

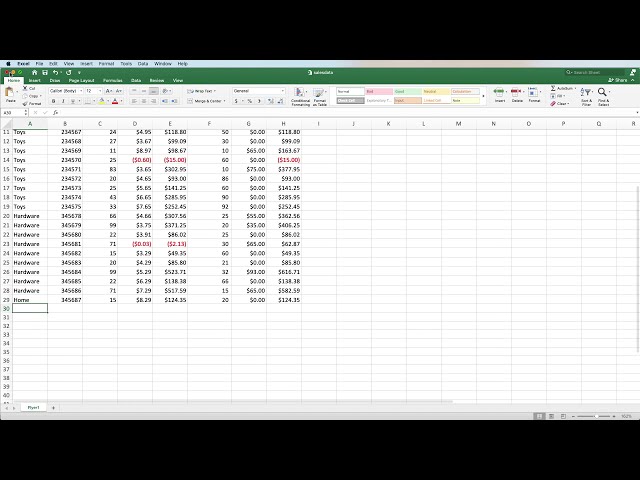

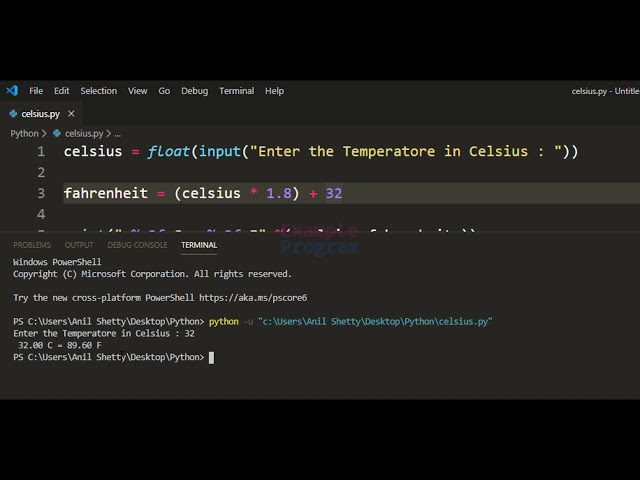

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:03,040 –> 00:00:04,799

بیایید ادامه دهیم و

2

00:00:04,799 –> 00:00:07,600

متن کاوی را با جزئیات درک کنیم، بیایید ابتدا

3

00:00:07,600 –> 00:00:09,280

بفهمیم متن کاوی

4

00:00:09,280 –> 00:00:11,360

چیست متن کاوی تکنیک

5

00:00:11,360 –> 00:00:13,920

کاوش مقادیر زیادی از

6

00:00:13,920 –> 00:00:14,400

7

00:00:14,400 –> 00:00:16,800

داده های متنی بدون ساختار و تجزیه و تحلیل آن به منظور

8

00:00:16,800 –> 00:00:19,439

استخراج الگوها از داده های متنی

9

00:00:19,439 –> 00:00:21,199

است که به کمک نرم افزاری که می تواند

10

00:00:21,199 –> 00:00:22,480

مفاهیم را شناسایی کند.

11

00:00:22,480 –> 00:00:25,039

الگوها موضوعات کلمات کلیدی و سایر

12

00:00:25,039 –> 00:00:26,640

ویژگی ها در داده ها

13

00:00:26,640 –> 00:00:29,439

از تکنیک های محاسباتی برای

14

00:00:29,439 –> 00:00:30,080

استخراج

15

00:00:30,080 –> 00:00:31,840

و خلاصه کردن اطلاعات با کیفیت بالا

16

00:00:31,840 –> 00:00:33,200

از

17

00:00:33,200 –> 00:00:36,320

منابع متنی بدون ساختار استفاده می کند.

18

00:00:36,320 –> 00:00:38,800

بیایید جریان متن کاوی را درک

19

00:00:38,800 –> 00:00:41,200

20

00:00:41,200 –> 00:00:42,719

21

00:00:42,719 –> 00:00:45,160

22

00:00:45,160 –> 00:00:46,719

23

00:00:46,719 –> 00:00:49,280

کنیم. برای بررسی متن بدون ساختار

24

00:00:49,280 –> 00:00:49,840

25

00:00:49,840 –> 00:00:51,840

با جستجوی کلمات مهم و

26

00:00:51,840 –> 00:00:54,520

یافتن روابط بین آنها استفاده می شود.

27

00:00:54,520 –> 00:00:57,199

طبقه بندی یا تبدیل متن

28

00:00:57,199 –> 00:00:58,920

ایجاد ویژگی

29

00:00:58,920 –> 00:01:01,760

تکنیک طبقه بندی برچسب های سند متنی

30

00:01:01,760 –> 00:01:04,400

تحت یک یا چند دسته

31

00:01:04,400 –> 00:01:07,200

طبقه بندی داده های متنی

32

00:01:07,200 –> 00:01:07,840

بر اساس

33

00:01:07,840 –> 00:01:10,040

نمونه های خروجی ورودی با

34

00:01:10,040 –> 00:01:11,680

دسته بندی انجام می شود.

35

00:01:11,680 –> 00:01:14,400

خوشهبندی یونی یا

36

00:01:14,400 –> 00:01:16,640

روش خوشهبندی انتخاب ویژگی برای گروهبندی اسناد متنی استفاده میشود

37

00:01:16,640 –> 00:01:19,200

که دارای خوشههای محتوایی مشابه

38

00:01:19,200 –> 00:01:21,119

هستند، پارتیشنها

39

00:01:21,119 –> 00:01:23,200

و هر خوشه دارای تعدادی

40

00:01:23,200 –> 00:01:24,320

سند با

41

00:01:24,320 –> 00:01:26,880

خوشهبندی محتوای مشابه

42

00:01:26,880 –> 00:01:28,880

خواهد بود.

43

00:01:28,880 –> 00:01:29,680

44

00:01:29,680 –> 00:01:31,680

اسنادی که

45

00:01:31,680 –> 00:01:33,680

46

00:01:33,680 –> 00:01:36,560

تکنیک تجسم محتوای مشابهی دارند، فرآیند

47

00:01:36,560 –> 00:01:38,240

یافتن اطلاعات مرتبط

48

00:01:38,240 –> 00:01:40,159

با تکنیک تجسم ساده میشود.

49

00:01:40,159 –> 00:01:43,439

این تکنیک از پرچمهای متنی

50

00:01:43,439 –> 00:01:45,680

برای نشان دادن گروهی از اسناد

51

00:01:45,680 –> 00:01:48,720

یا یک سند استفاده میکند و

52

00:01:48,720 –> 00:01:50,640

فشردگی با استفاده از

53

00:01:50,640 –> 00:01:53,119

تکنیک تجسم رنگها به نمایش

54

00:01:53,119 –> 00:01:53,759

55

00:01:53,759 –> 00:01:56,719

اطلاعات متنی در جذابتر کمک میکند. روش

56

00:01:56,719 –> 00:01:57,920

خلاصهسازی یا

57

00:01:57,920 –> 00:02:00,399

تفسیر یا ارزیابی

58

00:02:00,399 –> 00:02:02,399

تکنیک خلاصهسازی به

59

00:02:02,399 –> 00:02:04,479

کاهش طول سند

60

00:02:04,479 –> 00:02:06,240

و خلاصه کردن جزئیات

61

00:02:06,240 –> 00:02:08,560

اسناد کمک میکند و

62

00:02:08,560 –> 00:02:10,878

خواندن سند را برای کاربران آسان میکند و

63

00:02:10,878 –> 00:02:11,680

محتوا را

64

00:02:11,680 –> 00:02:14,400

در لحظه درک میکند بیایید اهمیت سند متن کاوی را درک کنیم.

65

00:02:14,400 –> 00:02:15,760

66

00:02:15,760 –> 00:02:19,920

خوشه بندی

67

00:02:19,920 –> 00:02:22,080

اسناد خوشه بندی بخش مهمی

68

00:02:22,080 –> 00:02:24,560

از متن کاوی است و کاربردهای زیادی

69

00:02:24,560 –> 00:02:25,920

در مدیریت دانش دارد

70

00:02:25,920 –> 00:02:28,400

و خوشه بندی بازیابی اطلاعات

71

00:02:28,400 –> 00:02:30,560

گروه بندی اسناد مشابه

72

00:02:30,560 –> 00:02:32,319

را در گروه های معنی دار آسان می کند،

73

00:02:32,319 –> 00:02:34,480

مانند روزنامه هایی که بخش ها

74

00:02:34,480 –> 00:02:36,400

اغلب به عنوان سیاست ورزشی تجاری

75

00:02:36,400 –> 00:02:38,239

و غیره

76

00:02:38,239 –> 00:02:41,120

متن شناسایی الگو گروه بندی می شوند. استخراج،

77

00:02:41,120 –> 00:02:43,200

فرآیند جستجوی خودکار

78

00:02:43,200 –> 00:02:44,640

حجم زیادی از

79

00:02:44,640 –> 00:02:46,640

متن برای الگوهای متنی است و شناسایی

80

00:02:46,640 –> 00:02:47,680

81

00:02:47,680 –> 00:02:49,519

ویژگیهایی مانند شماره تلفن و

82

00:02:49,519 –> 00:02:51,760

آدرس ایمیل را میتوان با استفاده از

83

00:02:51,760 –> 00:02:53,440

الگوهای مطابق

84

00:02:53,440 –> 00:02:56,239

با بینشهای محصول استخراج کرد.

85

00:02:56,239 –> 00:02:58,159

86

00:02:58,159 –> 00:03:00,640

87

00:03:00,640 –> 00:03:01,680

88

00:03:01,680 –> 00:03:03,920

بررسیهای مصرفکننده استخراج میتواند

89

00:03:03,920 –> 00:03:06,239

بینشهایی مانند محبوبترین ویژگیهای

90

00:03:06,239 –> 00:03:09,280

مورد نیاز برای منفورترین ویژگیها را نشان دهد

91

00:03:09,280 –> 00:03:12,159

و بررسی محصولات رقبا

92

00:03:12,159 –> 00:03:13,599

نظارت بر امنیت

93

00:03:13,599 –> 00:03:15,920

متن کاوی به نظارت و

94

00:03:15,920 –> 00:03:17,360

استخراج اطلاعات

95

00:03:17,360 –> 00:03:19,200

از مقالات و گزارشهای خبری برای

96

00:03:19,200 –> 00:03:21,519

اهداف امنیت ملی کمک

97

00:03:21,519 –> 00:03:23,599

میکند. مطمئن شوید که از تمام

98

00:03:23,599 –> 00:03:25,519

اطلاعات موجود خود استفاده می کنید،

99

00:03:25,519 –> 00:03:27,599

این یک کشف دانش موثرتر و سازنده است

100

00:03:27,599 –> 00:03:29,040

101

00:03:29,040 –> 00:03:30,959

که به شما امکان می دهد تصمیمات آگاهانه بهتری

102

00:03:30,959 –> 00:03:33,680

بگیرید، فرآیندهای فشرده اطلاعات را خودکارسازی کنید،

103

00:03:33,680 –> 00:03:34,959

104

00:03:34,959 –> 00:03:36,879

بینش های مهم تجاری را جمع آوری کنید و

105

00:03:36,879 –> 00:03:39,680

ریسک عملیاتی را کاهش

106

00:03:39,680 –> 00:03:42,080

دهید، بیایید به کاربردهای متن کاوی نگاه کنیم

107

00:03:42,080 –> 00:03:44,560

108

00:03:44,720 –> 00:03:47,200

.

109

00:03:47,200 –> 00:03:48,319

تشخیص و

110

00:03:48,319 –> 00:03:50,640

ترجمه زبان گفتاری به متن

111

00:03:50,640 –> 00:03:52,319

و بالعکس

112

00:03:52,319 –> 00:03:54,159

گفتار اغلب اطلاعات ارزشمندی

113

00:03:54,159 –> 00:03:56,480

را در مورد موضوعات

114

00:03:56,480 –> 00:03:59,200

و مفاهیم محتوای چندرسانه ای

115

00:03:59,200 –> 00:04:01,200

استخراج اطلاعات از گفتار در

116

00:04:01,200 –> 00:04:02,400

117

00:04:02,400 –> 00:04:04,400

مقایسه با محتوای چند رسانه ای پیچیده تر و در عین حال دقیق تر و دقیق تر

118

00:04:04,400 –> 00:04:06,080

است،

119

00:04:06,080 –> 00:04:08,560

این واقعیت انگیزه تجزیه و تحلیل گفتار مبتنی بر محتوا را فراهم می کند.

120

00:04:08,560 –> 00:04:11,200

داده کاوی و بازیابی چند رسانه ای

121

00:04:11,200 –> 00:04:12,000

122

00:04:12,000 –> 00:04:14,480

در جایی که پردازش صدا و گفتار

123

00:04:14,480 –> 00:04:17,199

کلیدی است که فناوری

124

00:04:17,199 –> 00:04:20,238

فیلتر هرزنامه را قادر می سازد تشخیص هرزنامه

125

00:04:20,238 –> 00:04:21,680

روش مهمی است که در آن

126

00:04:21,680 –> 00:04:24,000

اطلاعات متنی موجود در

127

00:04:24,000 –> 00:04:24,800

128

00:04:24,800 –> 00:04:28,080

ایمیل استخراج می شود و برای متن کاوی متمایز استفاده می شود و

129

00:04:28,080 –> 00:04:30,320

به صورت خودکار مفید است.

130

00:04:30,320 –> 00:04:32,560

شناسایی ایمیلهای هرزنامه بر اساس

131

00:04:32,560 –> 00:04:34,320

محتوای فیلتر شده

132

00:04:34,320 –> 00:04:36,560

با استفاده از متن کاوی، یک ارائهدهنده خدمات ایمیل

133

00:04:36,560 –> 00:04:39,199

مانند جیمیل یا

134

00:04:39,199 –> 00:04:42,160

ایمیل یاهو، محتوای ایمیل را بررسی میکند و

135

00:04:42,160 –> 00:04:44,160

اگر متن مخربی

136

00:04:44,160 –> 00:04:46,639

در ایمیل یافت شود، آن ایمیل بهعنوان هرزنامه علامتگذاری شده

137

00:04:46,639 –> 00:04:49,600

و به هرزنامه ارسال میشود.

138

00:04:49,600 –> 00:04:52,720

تجزیه و تحلیل احساسات پوشه

139

00:04:52,720 –> 00:04:54,479

به منظور تعیین اینکه آیا یک جمله داده شده

140

00:04:54,479 –> 00:04:55,199

بیانگر

141

00:04:55,199 –> 00:04:58,160

احساسات خنثی مثبت است یا منفی

142

00:04:58,160 –> 00:04:59,680

انجام می شود. تحلیل احساسات

143

00:04:59,680 –> 00:05:01,680

یکی از محبوب ترین کاربردهای

144

00:05:01,680 –> 00:05:03,199

145

00:05:03,199 –> 00:05:06,080

146

00:05:06,080 –> 00:05:08,320

تجزیه و تحلیل

147

00:05:08,320 –> 00:05:09,120

148

00:05:09,120 –> 00:05:11,360

متن است. نظر بیان

149

00:05:11,360 –> 00:05:14,240

شده توسط آن و سایر عوامل کلیدی شامل

150

00:05:14,240 –> 00:05:17,680

حالت و حالت معمولاً فرآیند

151

00:05:17,680 –> 00:05:19,680

تجزیه و تحلیل احساسات

152

00:05:19,680 –> 00:05:22,479

بر روی متنی که دارای زمینه ذهنی است بهترین کار را انجام می دهد

153

00:05:22,479 –> 00:05:24,479

سپس بر روی متنی که فقط با یک زمینه عینی

154

00:05:24,479 –> 00:05:25,919

155

00:05:25,919 –> 00:05:29,520

شخصی سازی تجارت الکترونیکی از متن

156

00:05:29,520 –> 00:05:30,960

کاوی برای پیشنهاد محصولاتی استفاده می شود

157

00:05:30,960 –> 00:05:33,919

که در یک متن مناسب هستند. متن کاوی نمایه کاربر

158

00:05:33,919 –> 00:05:34,960

159

00:05:34,960 –> 00:05:37,440

به طور فزاینده ای توسط خرده فروشان تجارت الکترونیک برای یادگیری بیشتر در مورد استفاده می شود

160

00:05:37,440 –> 00:05:38,400

161

00:05:38,400 –> 00:05:40,800

از آنجایی که مصرف کنندگان

162

00:05:40,800 –> 00:05:43,120

فرآیند تجزیه و تحلیل اطلاعات متنی

163

00:05:43,120 –> 00:05:44,000

164

00:05:44,000 –> 00:05:46,160

به منظور شناسایی الگوها و به دست آوردن

165

00:05:46,160 –> 00:05:47,360

بینش است

166

00:05:47,360 –> 00:05:50,000

، خرده فروشان تجارت الکترونیک می توانند

167

00:05:50,000 –> 00:05:51,520

افراد یا بخش های خاصی را

168

00:05:51,520 –> 00:05:54,160

با پیشنهادات و تخفیف های شخصی

169

00:05:54,160 –> 00:05:54,720

برای افزایش

170

00:05:54,720 –> 00:05:57,199

فروش و افزایش وفاداری مشتری با

171

00:05:57,199 –> 00:05:59,360

شناسایی الگوهای خرید مشتری

172

00:05:59,360 –> 00:06:00,240

و نظرات

173

00:06:00,240 –> 00:06:03,600

در مورد آنها هدف قرار دهند. بیایید با جزئیات

174

00:06:03,600 –> 00:06:06,000

به کتابخانه ابزار زبان طبیعی

175

00:06:06,000 –> 00:06:08,160

176

00:06:08,160 –> 00:06:10,319

177

00:06:10,319 –> 00:06:12,400

178

00:06:12,400 –> 00:06:14,400

179

00:06:14,400 –> 00:06:16,319

180

00:06:16,319 –> 00:06:19,759

181

00:06:19,759 –> 00:06:20,240

182

00:06:20,240 –> 00:06:23,520

183

00:06:23,520 –> 00:06:25,919

نگاه کنیم.

184

00:06:25,919 –> 00:06:26,880

مفسر پایتون را از

185

00:06:26,880 –> 00:06:29,199

خط آناکوندا راه اندازی کنید و دستورات زیر را

186

00:06:29,199 –> 00:06:30,479

187

00:06:30,479 –> 00:06:32,400

وارد کنید دستور پایتون را وارد کنید تا

188

00:06:32,400 –> 00:06:34,319

نسخه پایتون نصب شده روی سیستم خود را

189

00:06:34,319 –> 00:06:35,440

بررسی

190

00:06:35,440 –> 00:06:38,639

کنید import nltk را وارد کنید تا شما را به

191

00:06:38,639 –> 00:06:42,000

کتابخانه nltk موجود برای دانلود پیوند دهد

192

00:06:42,000 –> 00:06:45,360

سپس تابع nltk.download را وارد کنید که

193

00:06:45,360 –> 00:06:47,039

194

00:06:47,039 –> 00:06:49,360

پنجره دانلود nltk باز می شود. دایرکتوری دانلود را چک

195

00:06:49,360 –> 00:06:50,319

196

00:06:50,319 –> 00:06:52,319

کنید انتخاب کنید همه بسته ها را کلیک کنید و روی دانلود کلیک کنید

197

00:06:52,319 –> 00:06:53,440

198

00:06:53,440 –> 00:06:57,599

این nltk را در پایتون

199

00:06:57,599 –> 00:07:00,240

دانلود می کند، پس از دانلود nltk

200

00:07:00,240 –> 00:07:00,639

201

00:07:00,639 –> 00:07:02,720

باید عملکرد و عملکرد

202

00:07:02,720 –> 00:07:05,599

آن را بررسی کنید تا تنظیمات را تست کنید،

203

00:07:05,599 –> 00:07:08,400

دستور زیر را در پایتون بیکار

204

00:07:08,400 –> 00:07:11,440

از nltk dot corpus

205

00:07:11,440 –> 00:07:14,720

import قهوه ای نقطه قهوه ای وارد کنید.

206

00:07:14,720 –> 00:07:18,160

پرانتز پرانتز قهوه ای یک

207

00:07:18,160 –> 00:07:21,120

پیکره nltk است که تفاوت سیستماتیک

208

00:07:21,120 –> 00:07:21,840

209

00:07:21,840 –> 00:07:24,880

بین ژانرهای مختلف را نشان

210

00:07:24,880 –> 00:07:26,160

می دهد تابع کلمات موجود لیست

211

00:07:26,160 –> 00:07:28,560

کلمات موجود در

212

00:07:28,560 –> 00:07:30,319

ژانر را به

213

00:07:30,319 –> 00:07:31,680

214

00:07:31,680 –> 00:07:35,360

215

00:07:35,360 –> 00:07:37,440

شما می دهد. یک

216

00:07:37,440 –> 00:07:39,039

ماژول خاص از

217

00:07:39,039 –> 00:07:42,240

nltk corpora اگر میخواهید یک

218

00:07:42,240 –> 00:07:43,599

ماژول کامل را از

219

00:07:43,599 –> 00:07:46,639

nltk corpora وارد کنید، از علامت ستاره

220

00:07:46,639 –> 00:07:49,280

با فرمان import نام ماژول استفاده

221

00:07:49,280 –> 00:07:50,479

222

00:07:50,479 –> 00:07:54,160

کنید، دستور را از ستاره واردات nltk.book وارد

223

00:07:54,160 –> 00:07:55,280

224

00:07:55,280 –> 00:07:57,560

کنید، همه موارد موجود در

225

00:07:57,560 –> 00:08:00,080

ماژول کتاب nltk

226

00:08:00,080 –> 00:08:03,039

اکنون بارگذاری میشود تا explore brown corpus

227

00:08:03,039 –> 00:08:04,160

دستور

228

00:08:04,160 –> 00:08:07,919

nltk dot corpus import brown را وارد

229

00:08:07,919 –> 00:08:10,160

کنید این باعث وارد کردن corpus قهوهای میشود n

230

00:08:10,160 –> 00:08:11,280

پایتون

231

00:08:11,280 –> 00:08:14,560

تابع دستههای نقطه قهوهای را وارد کنید تا

232

00:08:14,560 –> 00:08:15,360

233

00:08:15,360 –> 00:08:18,319

ژانرهای مختلف موجود را بارگیری کنید، یک ژانر را انتخاب کنید و

234

00:08:18,319 –> 00:08:20,720

آن ژانر را با استفاده

235

00:08:20,720 –> 00:08:22,879

از دستور نحو زیر به

236

00:08:22,879 –> 00:08:25,520

متغیر اختصاص دهید، نام متغیر معادل با نقطه قهوهای

237

00:08:25,520 –> 00:08:26,560

238

00:08:26,560 –> 00:08:29,840

است.

239

00:08:29,840 –> 00:08:32,000

در

240

00:08:32,000 –> 00:08:33,599

ژانر انتخاب شده

241

00:08:33,599 –> 00:08:36,000

فقط نام متغیر تعریف شده را به عنوان یک دستور وارد کنید تا

242

00:08:36,000 –> 00:08:38,080

243

00:08:38,080 –> 00:08:40,399

استخراج متن و

244

00:08:40,399 –> 00:08:43,200

پیش پردازش را با جزئیات

245

00:08:43,200 –> 00:08:45,560

درک کنیم، بنابراین بیایید ابتدا مفهوم توکن سازی را درک کنیم

246

00:08:45,560 –> 00:08:47,120

247

00:08:47,120 –> 00:08:49,600

، فرآیند حذف

248

00:08:49,600 –> 00:08:50,880

داده های حساس

249

00:08:50,880 –> 00:08:52,560

و قرار دادن نمادهای منحصر به فرد

250

00:08:52,560 –> 00:08:53,920

شناسایی

251

00:08:53,920 –> 00:08:56,240

در آن مکان به ترتیب برای حفظ تمام

252

00:08:56,240 –> 00:08:57,680

اطلاعات ضروری

253

00:08:57,680 –> 00:09:00,399

مربوط به داده ها توسط امنیت

254

00:09:00,399 –> 00:09:02,560

آن، فرآیندی است برای شکستن

255

00:09:02,560 –> 00:09:04,480

جریان های متنی به کلمات و

256

00:09:04,480 –> 00:09:07,440

جملات که با جداسازی کلمات

257

00:09:07,440 –> 00:09:08,000

با استفاده از

258

00:09:08,000 –> 00:09:11,200

علائم نگارشی و

259

00:09:11,200 –> 00:09:13,920

استخراج متن و پیش پردازش

260

00:09:13,920 –> 00:09:15,920

n-gram کار می کند.

261

00:09:15,920 –> 00:09:18,720

حال بیایید ببینیم چه چیزی n-gram است و چگونه

262

00:09:18,720 –> 00:09:21,120

در متن کاوی مفید است

263

00:09:21,120 –> 00:09:23,040

n-gram ساده ترین مدلی است که به شما

264

00:09:23,040 –> 00:09:24,800

اختصاص می دهد. ns این احتمالات

265

00:09:24,800 –> 00:09:27,760

برای دنبالهای از کلمات یا جملات،

266

00:09:27,760 –> 00:09:29,920

n-gram ترکیبی از

267

00:09:29,920 –> 00:09:31,839

کلمات یا حروف مجاور

268

00:09:31,839 –> 00:09:35,519

و در متن مبدا هستند، بنابراین انگرام

269

00:09:35,519 –> 00:09:36,000

270

00:09:36,000 –> 00:09:38,399

زمانی که نیاز به

271

00:09:38,399 –> 00:09:40,880

استخراج الگوها از متن است،

272

00:09:40,880 –> 00:09:43,279

مانند مثال داده شده، در متن کاوی بسیار مفید است. یک جمله است که

273

00:09:43,279 –> 00:09:44,240

274

00:09:44,240 –> 00:09:45,839

همه این کلمات به عنوان کلمات منفرد در نظر گرفته می

275

00:09:45,839 –> 00:09:47,279

شوند

276

00:09:47,279 –> 00:09:50,320

و بنابراین نشان

277

00:09:50,320 –> 00:09:53,839

278

00:09:53,839 –> 00:09:55,680

279

00:09:55,680 –> 00:09:59,440

دهنده تک گرم ها هستند.

280

00:09:59,440 –> 00:10:01,600

281

00:10:01,600 –> 00:10:02,720

کلماتی مانند

282

00:10:02,720 –> 00:10:07,200

این یک جمله است یا یک جمله است،

283

00:10:07,200 –> 00:10:09,600

بیایید حالا بفهمیم که کلمات توقف چیست

284

00:10:09,600 –> 00:10:12,320

و چگونه می توان آنها را حذف کرد.

285

00:10:12,320 –> 00:10:14,480

286

00:10:14,480 –> 00:10:16,800

287

00:10:16,800 –> 00:10:19,920

288

00:10:19,920 –> 00:10:22,959

289

00:10:22,959 –> 00:10:25,120

در پایگاه داده

290

00:10:25,120 –> 00:10:27,440

یا افزایش زمان پردازش

291

00:10:27,440 –> 00:10:29,680

پس بهتر است برای حذف چنین کلماتی با

292

00:10:29,680 –> 00:10:32,160

ذخیره لیستی از کلمات توقف

293

00:10:32,160 –> 00:10:34,560

، لیستی از کلمات توقف را در

294

00:10:34,560 –> 00:10:37,440

فهرست داده های nltk که

295

00:10:37,440 –> 00:10:39,839

در 16 لیتر مختلف ذخیره می شود، پیدا کنید. زبانها

296

00:10:39,839 –> 00:10:41,760

از دستور زیر برای لیست

297

00:10:41,760 –> 00:10:44,320

کردن کلمات توقف زبان انگلیسی تعریف شده

298

00:10:44,320 –> 00:10:44,839

در

299

00:10:44,839 –> 00:10:48,959

300

00:10:48,959 –> 00:10:52,000

301

00:10:52,000 –> 00:10:55,440

302

00:10:55,440 –> 00:10:57,760

303

00:10:57,760 –> 00:10:58,720

304

00:10:58,720 –> 00:11:01,839

305

00:11:01,839 –> 00:11:04,800

nltk استفاده میکنند. همانطور که در زیر پرانتز قرار دارد

306

00:11:04,800 –> 00:11:05,279

توقف

307

00:11:05,279 –> 00:11:09,360

کلمات نقطه کلمات مجموعه ژانر به عنوان

308

00:11:09,360 –> 00:11:11,360

کلمات توقف انگلیسی قبل از

309

00:11:11,360 –> 00:11:13,760

پردازش داده های زبان طبیعی فیلتر می

310

00:11:13,760 –> 00:11:16,720

شوند زیرا اطلاعات زیادی را نشان نمی دهند، بنابراین

311

00:11:16,720 –> 00:11:18,399

همانطور که در مثال داده شده می توانید

312

00:11:18,399 –> 00:11:20,399

قبل از فیلتر کردن جمله مشاهده کنید، نشانه

313

00:11:20,399 –> 00:11:22,240

گذاری کلمه توقف به

314

00:11:22,240 –> 00:11:24,480

این صورت است. به منظور حذف این

315

00:11:24,480 –> 00:11:25,600

کلمات توقف پردازش شده

316

00:11:25,600 –> 00:11:27,600

و فیلتر به منظور

317

00:11:27,600 –> 00:11:29,279

فیلتر کردن جمله بر اساس برخی

318

00:11:29,279 –> 00:11:31,760

319

00:11:31,760 –> 00:11:34,320

320

00:11:34,320 –> 00:11:36,079

321

00:11:36,079 –> 00:11:38,320

322

00:11:38,320 –> 00:11:40,880

معیارها اعمال می شود.

323

00:11:40,880 –> 00:11:41,760

324

00:11:41,760 –> 00:11:44,640

و کمک کننده به

325

00:11:44,640 –> 00:11:46,320

ریشه کلمه کمک

326

00:11:46,320 –> 00:11:48,880

به فرآیند ریشه یا الگوریتم به

327

00:11:48,880 –> 00:11:50,800

طور کلی یک ریشه نامیده می شود

328

00:11:50,800 –> 00:11:53,040

وجود دارد stemming مختلف الگوریتم

329

00:11:53,040 –> 00:11:54,880

هایی مانند پورتر استمر

330

00:11:54,880 –> 00:11:58,240

لانکاستر استمر گلوله برفی و غیره

331

00:11:58,240 –> 00:12:00,399

از هر یک از استمرهای تعریف شده در

332

00:12:00,399 –> 00:12:02,560

بدنه پایه nltk استفاده

333

00:12:02,560 –> 00:12:04,720

می کنند تا همانطور که در مثال نشان داده شده است در

334

00:12:04,720 –> 00:12:05,920

335

00:12:05,920 –> 00:12:08,399

اینجا نشان

336

00:12:08,399 –> 00:12:10,639

337

00:12:10,639 –> 00:12:12,079

داده شده است.

338

00:12:12,079 –> 00:12:14,079

به ریشه کلمه یا متن اصلی آنها تقلیل داده شده است،

339

00:12:14,079 –> 00:12:15,839

340

00:12:15,839 –> 00:12:18,399

استخراج و

341

00:12:18,399 –> 00:12:20,800

342

00:12:20,800 –> 00:12:22,959

محدودسازی پیش پردازش، روشی است برای گروه

343

00:12:22,959 –> 00:12:25,440

بندی انواع مختلف یک کلمه

344

00:12:25,440 –> 00:12:27,600

به منظور تجزیه و تحلیل آنها به عنوان

345

00:12:27,600 –> 00:12:28,720

یک آیتم

346

00:12:28,720 –> 00:12:31,519

که از فهرست واژگان یا

347

00:12:31,519 –> 00:12:33,920

تجزیه و تحلیل صرفی برای بدست آوردن نتیجه استفاده می کند. کلمه ریشه

348

00:12:33,920 –> 00:12:34,800

349

00:12:34,800 –> 00:12:37,600

از پایگاه داده wordnet استفاده می کند که دارای

350

00:12:37,600 –> 00:12:38,000

کلمات انگلیسی است

351

00:12:38,000 –> 00:12:40,000

که با رابطه معنایی آنها به هم مرتبط شده اند،

352

00:12:40,000 –> 00:12:41,200

353

00:12:41,200 –> 00:12:43,839

همانطور که می توانید مثال داده شده را مشاهده کنید،

354

00:12:43,839 –> 00:12:44,959

کلمات مختلف

355

00:12:44,959 –> 00:12:46,880

356

00:12:46,880 –> 00:12:48,680

با استفاده از

357

00:12:48,680 –> 00:12:52,760

استخراج متن محدود و

358

00:12:52,760 –> 00:12:56,160

پیش پردازش برچسب گذاری پست

359

00:12:56,160 –> 00:12:57,760

به کلمه صرفی مربوطه استخراج شده اند. اجازه دهید اکنون بخش های مختلف را بررسی کنیم. از

360

00:12:57,760 –> 00:12:59,839

برچسبهای گفتاری موجود در کتابخانه ملی

361

00:12:59,839 –> 00:13:02,399

زبان،

362

00:13:02,399 –> 00:13:05,120

یک تگ pos یک spe است برچسب cial اختصاص داده شده به

363

00:13:05,120 –> 00:13:06,639

هر نشانه یا کلمه

364

00:13:06,639 –> 00:13:09,040

در یک مجموعه متن برای نشان دادن بخشی از

365

00:13:09,040 –> 00:13:09,680

گفتار

366

00:13:09,680 –> 00:13:11,600

و اغلب همچنین سایر

367

00:13:11,600 –> 00:13:13,519

مقوله های دستوری مانند

368

00:13:13,519 –> 00:13:16,079

تعداد زمان یا حالت جمع یا مفرد

369

00:13:16,079 –> 00:13:17,279

و غیره

370

00:13:17,279 –> 00:13:20,399

در ابزارها

371

00:13:20,399 –> 00:13:22,800

و الگوریتم های تجزیه و تحلیل متن و همچنین در جستجوی پیکره استفاده می

372

00:13:22,800 –> 00:13:23,680

373

00:13:23,680 –> 00:13:26,480

شود. به مثال داده شده در اینجا نگاه کنید آلیس

374

00:13:26,480 –> 00:13:27,600

یک برنامه نوشت

375

00:13:27,600 –> 00:13:30,720

متن مبدأ است که با توجه به تگ های pos

376

00:13:30,720 –> 00:13:32,800

داده

377

00:13:32,800 –> 00:13:35,519

378

00:13:35,519 –> 00:13:36,240

379

00:13:36,240 –> 00:13:38,480

380

00:13:38,480 –> 00:13:40,880

381

00:13:40,880 –> 00:13:42,000

شده است.

382

00:13:42,000 –> 00:13:44,079

جمله یا پاراگراف داده شده

383

00:13:44,079 –> 00:13:46,000

حاوی کلمات مختلفی است که

384

00:13:46,000 –> 00:13:48,639

قسمت های مختلف گفتار را نشان می دهد، ابتدا

385

00:13:48,639 –> 00:13:50,959

از نشانه گذاری و حذف کلمات توقف استفاده می کنیم

386

00:13:50,959 –> 00:13:51,760

387

00:13:51,760 –> 00:13:54,720

و سپس تگ های مختلف pos را

388

00:13:54,720 –> 00:13:56,639

که با کلمات مختلف در جمله داده شده نشان داده شده اند تخصیص می دهیم.

389

00:13:56,639 –> 00:13:59,440

390

00:13:59,440 –> 00:14:00,000

391

00:14:00,000 –> 00:14:02,880

392

00:14:02,880 –> 00:14:04,240

شناسایی موجودیت

393

00:14:04,240 –> 00:14:06,560

و استخراج روابط بین

394

00:14:06,560 –> 00:14:08,720

کلمات

395

00:14:08,720 –> 00:14:11,760

استخراج متن و پیش پردازش شناسایی موجودیت نامگذاری شده

396

00:14:11,760 –> 00:14:13,440

397

00:14:13,440 –> 00:14:15,519

اکنون اجازه دهید درک موضوع شناخت موجودیت نامگذاری شده چیست،

398

00:14:15,519 –> 00:14:17,360

399

00:14:17,360 –> 00:14:20,320

به دنبال استخراج موجودیت دنیای واقعی

400

00:14:20,320 –> 00:14:21,279

از متن

401

00:14:21,279 –> 00:14:24,160

و مرتبسازی آن به دستههای از پیش تعریفشده

402

00:14:24,160 –> 00:14:25,600

مانند اسامی افراد

403

00:14:25,600 –> 00:14:29,120

مکانهای سازمان و غیره است.

404

00:14:29,120 –> 00:14:31,040

405

00:14:31,040 –> 00:14:33,600

406

00:14:33,600 –> 00:14:35,600

محصولات ذکر شده در

407

00:14:35,600 –> 00:14:37,600

شکایات یا بررسیها

408

00:14:37,600 –> 00:14:39,360

آیا توییت حاوی نام

409

00:14:39,360 –> 00:14:41,519

شخص است آیا توییت حاوی

410

00:14:41,519 –> 00:14:43,279

آدرس شخص است،

411

00:14:43,279 –> 00:14:45,440

همانطور که در مثال داده شده مشاهده میکنید

412

00:14:45,440 –> 00:14:46,880

413

00:14:46,880 –> 00:14:49,839

صفحه لری گوگل آمریکا و غیره، نام یک

414

00:14:49,839 –> 00:14:51,920

مکان یا سازمان است،

415

00:14:51,920 –> 00:14:53,920

بنابراین این نامها در نظر گرفته میشوند. موجودیتها

416

00:14:53,920 –> 00:14:55,680

و دارای برچسبهای

417

00:14:55,680 –> 00:14:59,040

مختلف مانند سازمان شخص gpe

418

00:14:59,040 –> 00:15:03,279

یا نهاد ژئوپلیتیکی و غیره

419

00:15:03,279 –> 00:15:06,560

گردش کار فرآیند nlp

420

00:15:06,560 –> 00:15:08,399

اکنون شما از همه

421

00:15:08,399 –> 00:15:10,399

ابزارهای nltk آگاهی دارید،

422

00:15:10,399 –> 00:15:12,160

بنابراین اکنون بیایید

423

00:15:12,160 –> 00:15:14,399

روند کار پردازش زبان طبیعی

424

00:15:14,399 –> 00:15:17,519

مرحله 1 توکنسازی را درک کنیم،

425

00:15:17,519 –> 00:15:20,480

متن را به قطعات یا کلمات تقسیم میکند و

426

00:15:20,480 –> 00:15:22,240

427

00:15:22,240 –> 00:15:25,199

مرحله نقطهگذاری را حذف میکند. 2 حذف کلمه متوقف

428

00:15:25,199 –> 00:15:26,000

می شود و

429

00:15:26,000 –> 00:15:29,600

کلمات رایج مانند is are و غیره را

430

00:15:29,600 –> 00:15:32,079

حذف می کند اینها مربوط به مرحله تجزیه و تحلیل

431

00:15:32,079 –> 00:15:34,880

مرحله 3 نیستند و با محدود

432

00:15:34,880 –> 00:15:37,279

کردن، کلمات را به شکل پایه کاهش می دهد تا

433

00:15:37,279 –> 00:15:39,600

به عنوان یک مورد تجزیه و تحلیل شوند.

434

00:15:39,600 –> 00:15:43,360

435

00:15:43,360 –> 00:15:44,399

436

00:15:44,399 –> 00:15:47,680

437

00:15:47,680 –> 00:15:48,560

438

00:15:48,560 –> 00:15:52,880

مرحله 5 زمینه، بازیابی اطلاعات،

439

00:15:52,880 –> 00:15:54,959

اطلاعات مربوطه را

440

00:15:54,959 –> 00:15:56,800

از منبع

441

00:15:56,800 –> 00:16:00,480

استخراج میکند mo1 بیانیه مشکل پیکره قهوهای مجموعه

442

00:16:00,480 –> 00:16:03,040

استاندارد دانشگاه قهوهای

443

00:16:03,040 –> 00:16:05,040

انگلیسی آمریکایی امروزی

444

00:16:05,040 –> 00:16:08,000

که عموماً به عنوان مجموعه قهوهای نیز شناخته میشود،

445

00:16:08,000 –> 00:16:10,240

در دهه 1960

446

00:16:10,240 –> 00:16:12,399

به عنوان یک مجموعه کلی در زمینه

447

00:16:12,399 –> 00:16:14,160

زبانشناسی پیکره گردآوری

448

00:16:14,160 –> 00:16:16,480

شد. حاوی 500 نمونه

449

00:16:16,480 –> 00:16:17,759

متن انگلیسی است

450

00:16:17,759 –> 00:16:20,320

که در مجموع حدود 1 میلیون کلمه

451

00:16:20,320 –> 00:16:22,079

از آثار منتشر شده در

452

00:16:22,079 –> 00:16:24,720

ایا