در این مطلب، ویدئو رگرسیون خطی چند متغیره | کد نویسی در پایتون از ابتدا | آموزش یادگیری ماشین با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:09:55

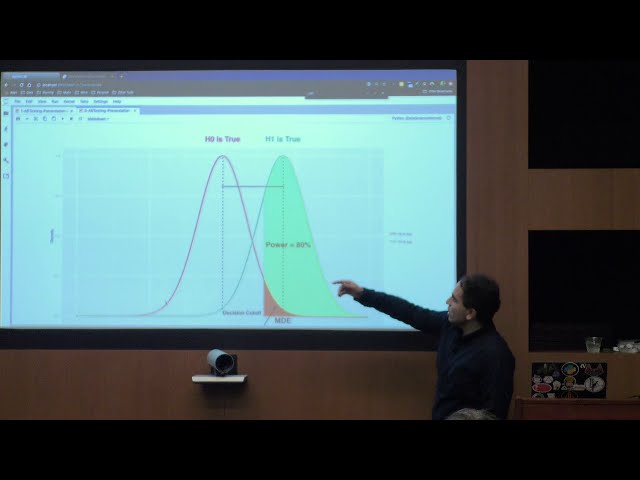

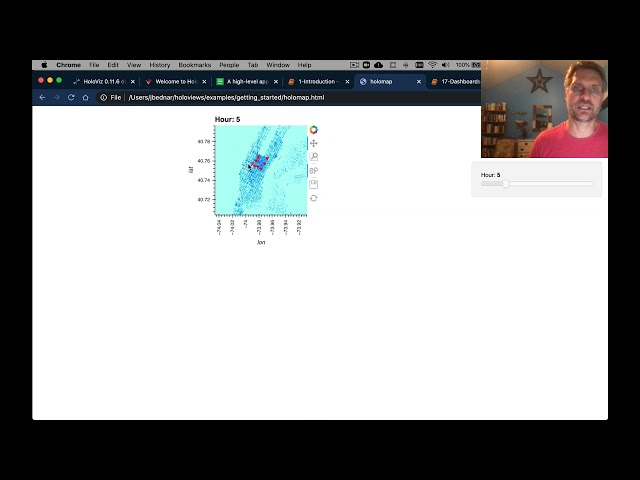

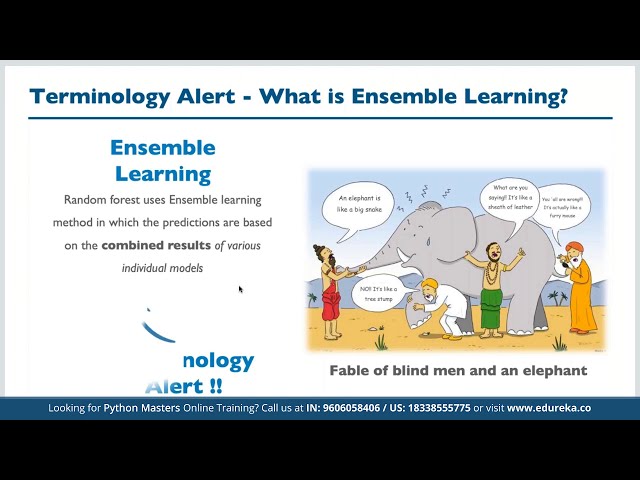

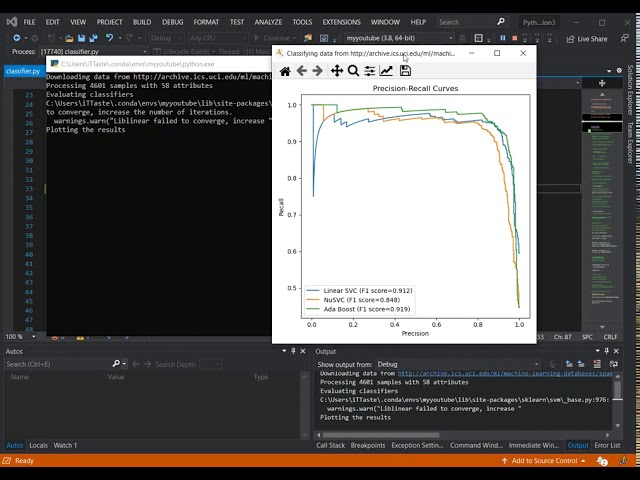

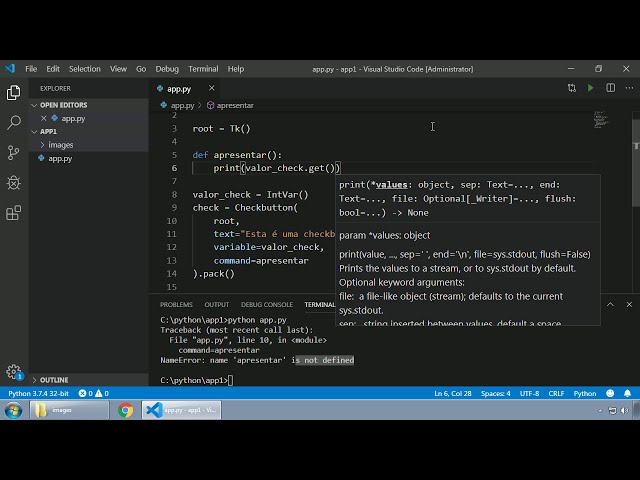

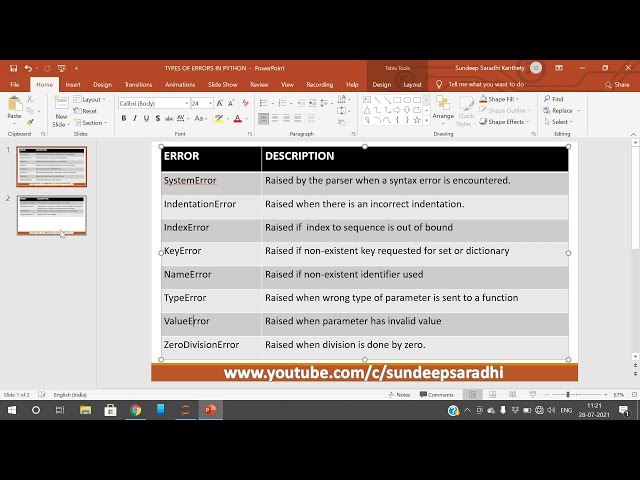

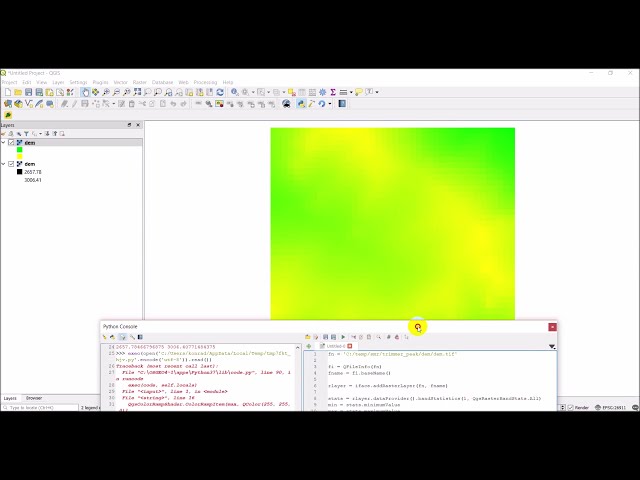

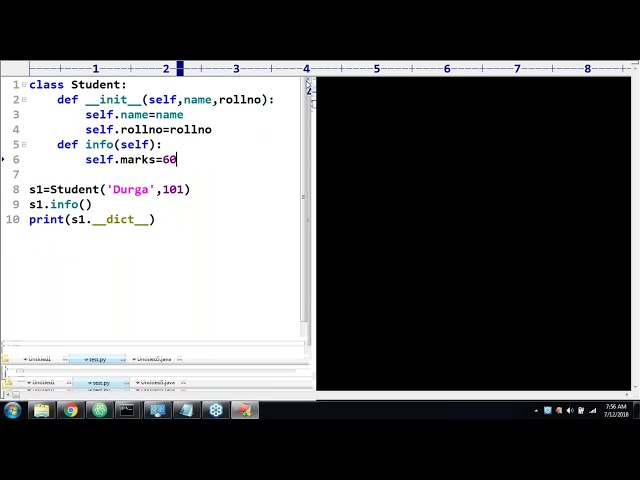

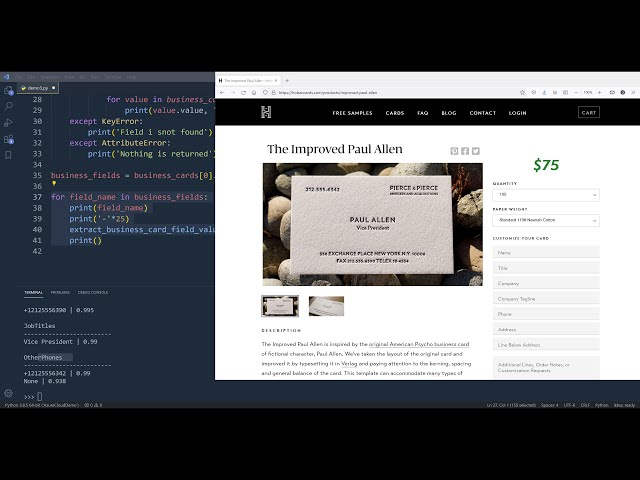

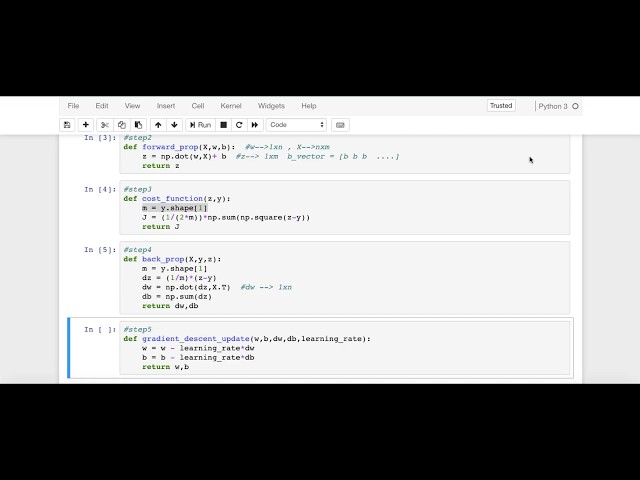

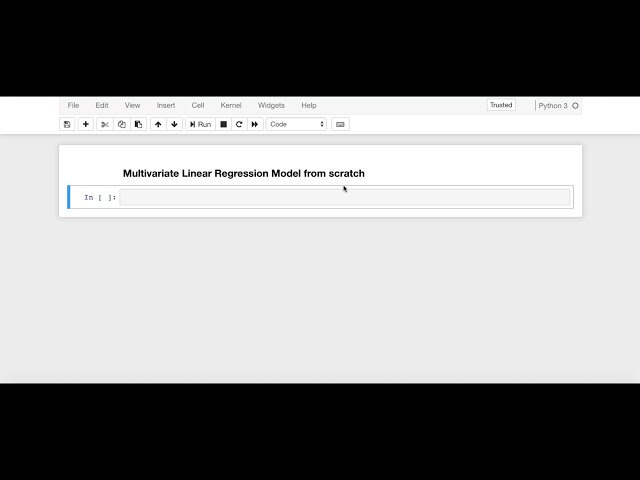

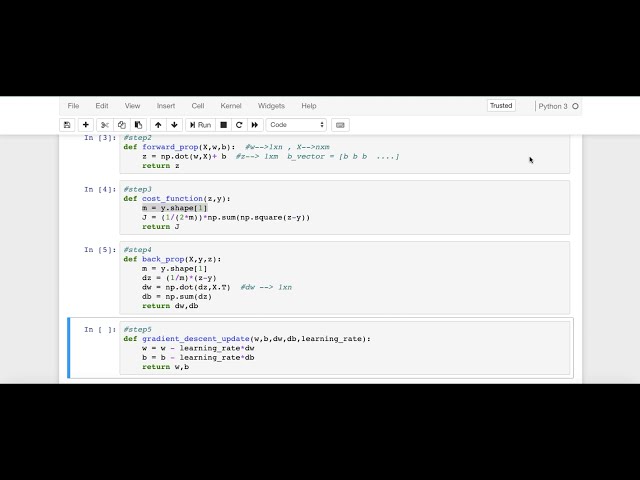

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,500 –> 00:00:02,730

سلام به همه بیایید

2

00:00:02,730 –> 00:00:04,950

مدل رگرسیون خطی چند متغیره را

3

00:00:04,950 –> 00:00:07,589

از ابتدا در پایتون پیاده سازی کنیم و من از

4

00:00:07,589 –> 00:00:10,050

نوت بوک Jupiter به دلیل ماهیت بسیار

5

00:00:10,050 –> 00:00:12,690

تعاملی آن استفاده می کنم، بنابراین بیایید

6

00:00:12,690 –> 00:00:15,690

تمام شش مرحله ای را که قبلاً

7

00:00:15,690 –> 00:00:19,289

در ویدیوی قبلی دیده بودیم پیاده سازی کنیم، بنابراین در اینجا

8

00:00:19,289 –> 00:00:21,000

ابتدا می خواهیم وارد کنیم. برخی از

9

00:00:21,000 –> 00:00:25,590

وابستگیها مانند import numpy به عنوان حسادت،

10

00:00:25,590 –> 00:00:28,560

بنابراین عدد اساساً برای

11

00:00:28,560 –> 00:00:30,179

عملیات ماتریسی مانند جمع تفریق استفاده میشود،

12

00:00:30,179 –> 00:00:34,079

سپس ما از این شکاف ریاضی وارداتی

13

00:00:34,079 –> 00:00:39,660

14

00:00:39,660 –> 00:00:42,270

15

00:00:42,270 –> 00:00:45,480

استفاده میکنیم.

16

00:00:45,480 –> 00:00:47,850

به عنوان تابعی از

17

00:00:47,850 –> 00:00:51,030

تکرارها بعداً، بنابراین این دو

18

00:00:51,030 –> 00:00:54,020

وابستگی هستند که اکنون از آنها استفاده

19

00:00:54,020 –> 00:00:59,280

خواهیم کرد، مرحله بعدی ما مرحله شماره یک است و در اینجا

20

00:00:59,280 –> 00:01:02,670

مرحله یک مقداردهی اولیه

21

00:01:02,670 –> 00:01:05,069

پارامترهایی است که در ویدیوی قبلی به خاطر می آوریم

22

00:01:05,069 –> 00:01:08,549

و در اینجا من قصد دارم تابع مقداردهی اولیه را تعریف کنم.

23

00:01:08,549 –> 00:01:12,500

24

00:01:12,500 –> 00:01:16,590

پارامترها و در اینجا من می خواهم

25

00:01:16,590 –> 00:01:20,850

طول آرگومان بردار وزن

26

00:01:20,850 –> 00:01:25,229

le و W را اساساً برای بردار وزن W 1

27

00:01:25,229 –> 00:01:30,270

W 2 W ارسال کنم. n در اینجا Elyan W برابر با n خواهد بود،

28

00:01:30,270 –> 00:01:34,979

اما پس از آن W را به صورت NP نقطه تصادفی n مقداردهی اولیه می کنیم،

29

00:01:34,979 –> 00:01:39,329

اساساً R و n n

30

00:01:39,329 –> 00:01:42,930

در اینجا این n مخفف توزیع نرمال استاندارد

31

00:01:42,930 –> 00:01:47,780

با سیگما 1 است و به معنای صفر است

32

00:01:47,780 –> 00:01:51,090

که اگر به یاد داشته باشیم و اینجا به منحنی می رسد

33

00:01:51,090 –> 00:01:55,020

. ما

34

00:01:55,020 –> 00:01:59,460

آرگومانهای 1 طول کاما بردار وزن را ارسال میکنیم،

35

00:01:59,460 –> 00:02:04,710

بنابراین این بردار W اساساً

36

00:02:04,710 –> 00:02:09,538

بردار Rho است که دارای ستونهای منفرد از طریق و E و W

37

00:02:09,538 –> 00:02:12,360

است

38

00:02:12,360 –> 00:02:16,650

و در اینجا اعداد به طور تصادفی

39

00:02:16,650 –> 00:02:19,410

از طریق توزیع نرمال استاندارد تولید میشوند و

40

00:02:19,410 –> 00:02:22,740

همچنین به یاد داشته باشید که میتوانیم از یکی از آنها استفاده کنیم.

41

00:02:22,740 –> 00:02:27,390

این روش یا می توانیم از این طریق استفاده کنیم

42

00:02:27,390 –> 00:02:32,550

همچنین W برابر است با NP نقطه صفر و 1

43

00:02:32,550 –> 00:02:36,390

و E و W اساساً و P نقطه صفر

44

00:02:36,390 –> 00:02:38,820

برای مقداردهی اولیه تمام مقادیر

45

00:02:38,820 –> 00:02:42,780

بردار وزن است که ما آزادیم

46

00:02:42,780 –> 00:02:46,020

این روش را نیز انجام دهیم. من از این روش استفاده میکنم

47

00:02:46,020 –> 00:02:47,510

48

00:02:47,510 –> 00:02:51,420

بعد مقداردهی اولیه بایاس است، بنابراین

49

00:02:51,420 –> 00:02:55,800

B برابر با 0 است و سپس W B ر

50

00:02:55,800 –> 00:02:59,670

برمیگردانیم، بنابراین این مرحله ما است، مرحله بعدی اگ

51

00:02:59,670 –> 00:03:02,730

به یاد داشته باشیم مرحله دوم انتشار به جلو اس

52

00:03:02,730 –> 00:03:08,310

، بنابراین افت رو به جلو را در اینجا تعریف کنید، من

53

00:03:08,310 –> 00:03:13,830

ر حال عبور از آرگوم هستم. X W B را نشان می دهد زیرا

54

00:03:13,830 –> 00:03:18,120

Z برابر است با W X به علاوه B بنابراین در اینجا این

55

00:03:18,120 –> 00:03:21,810

بردار Z برابر است با ضرب W X ماتریس

56

00:03:21,810 –> 00:03:25,290

W و X که در

57

00:03:25,290 –> 00:03:31,380

بمبئی به عنوان نقطه NP W کاما X استفاده می شود

58

00:03:31,380 –> 00:03:34,290

اگر بعد W W دارای

59

00:03:34,290 –> 00:03:40,470

بعد 1 برابر n سمت راست باشد و X دارای

60

00:03:40,470 –> 00:03:46,290

بعد n ضربدر M n تعداد ویژگی

61

00:03:46,290 –> 00:03:50,280

ضربدر M مثال های آموزشی است و اگر

62

00:03:50,280 –> 00:03:55,380

WX را 1 ضربدر n و n ضربدر M

63

00:03:55,380 –> 00:03:59,400

به ما می دهد Z در اینجا دارای بعد 1

64

00:03:59,400 –> 00:04:05,940

متقاطع M خواهد بود و بنابراین این Z ما

65

00:04:05,940 –> 00:04:07,470

برابر است با WX

66

00:04:07,470 –> 00:04:11,370

پلاس. بردار بایاس B در اینجا یک اسکالر

67

00:04:11,370 –> 00:04:17,910

است اما اگر این اسکالر را به WX

68

00:04:17,910 –> 00:04:22,890

n P نقطه WX اسکالر B پخش می شود

69

00:04:22,890 –> 00:04:26,040

تا بردار باشد بنابراین اساساً این بردار B

70

00:04:26,040 –> 00:04:30,000

به لطف numpy بنابراین

71

00:04:30,000 –> 00:04:32,480

b-بردار پخش می شود، می توانیم این را بگوییم بردار به

72

00:04:32,480 –> 00:04:38,790

صورت B BB تا M به سمت راست پخش می شود و

73

00:04:38,790 –> 00:04:42,540

سپس این بردار B به WX اضافه می شود

74

00:04:42,540 –> 00:04:45,540

بنابراین این همان مرحله شماره دو است و

75

00:04:45,540 –> 00:04:49,350

در اینجا من می خواهم Z را برگردانم و

76

00:04:49,350 –> 00:04:54,470

مرحله بعدی مرحله شماره سه است که

77

00:04:54,470 –> 00:04:57,420

محاسبه تابع هزینه ما درست است. بنابر